TL;DR: De recente release van OpenClaw voegt eersteklas, toekomstbestendige ondersteuning toe voor OpenAI’s GPT-5.4 en introduceert een “memory hot-swappable”-architectuur waarmee OpenClaw-agents tijdens runtime met minimale verstoring kunnen wisselen welk model en welke geheugenopslag actief is. Dit ontgrendelt workflows met grote context (de uitgebreidere contextvensters van GPT-5.4), directe modelspecialisatie en kosten-/latentie-optimalisaties voor productie-agents. De upgrade is beschikbaar in de releases en bijbehorende documentatie van OpenClaw; de onderstaande voorbeelden tonen praktische configuratie, codefragmenten, benchmarkcontext en aanbevolen best practices.

Wat OpenClaw’s update daadwerkelijk heeft geleverd (korte samenvatting)

Op 9 maart 2026 bracht het open-source agentframework OpenAI-verwant project OpenClaw een grote core-release (2026.3.7) uit die eersteklas ondersteuning toevoegt voor GPT-5.4 en een nieuw “memory hot-swappable”-mechanisme in de context-engine. Deze release transformeert een veelgebruikt experimenteel agentframework in wat de maintainers omschrijven als een “Agent Operating System” — gericht op het naadloos maken van productieklare agentworkflows en modelswitching voor ontwikkelaars en teams.

3 praktische zaken die tellen voor agentbouwers:

- Eersteklas GPT-5.4-ondersteuning — modelaliassen en providermappingen waarmee agents GPT-5.4 als primair uitvoeringsmodel kunnen kiezen (inclusief kanaaloverrides en per-agent modelpinnen).

- Context Engine & gedistribueerde kanaalbinding — verbeteringen in hoe OpenClaw lange contextvensters samenstelt uit geheugen, tooloutputs en kanaalgeschiedenis, zodat high-capacity modellen goed gestructureerde input krijgen.

- Memory hot-swappable-architectuur — duidelijkere memory-plugininterfaces en workflows zodat je geheugenbackends kunt vervangen of agents kunt upgraden zonder “identiteit” te verliezen of persistente status te corrumperen (het geheugen zelf blijft de single source of truth). OpenClaw’s geheugenontwerp (platte Markdown-bestanden, geïndexeerd zoeken, gepluginde retrieval) maakt veilig hot-swappen mogelijk.

GPT-5.4 — Wat GPT-5.4 is en benchmarkdoorbraak

GPT-5.4 is de nieuwste frontiermodel-release van OpenAI met sterke focus op professionele productiviteit (spreadsheets, document- en presentatiebewerking, meerstapsredeneren en toolaansturing). Volgens OpenAI en onafhankelijke berichtgeving legt de release de nadruk op:

- Uitgebreide context: GPT-5.4 introduceert de volgende trede van contextvensters, met experimentele 1M tokens en verbeterde long-contextafhandeling beschikbaar via Codex/Codex-compatibele endpoints — configuratieknoppen zoals

model_context_windowenmodel_auto_compact_token_limitzijn beschikbaar voor ontwikkelaars. Dit stelt je in staat veel grotere conversatiestaten, documenten en codebases actief in context te houden. - Hogere spreadsheet- en redeneeraccuracy — OpenAI rapporteert een flinke verbetering op spreadsheetmodelleringstaken (gemiddelde scores ~87% vs ~68% voor GPT-5.2 op hun banking/analyst spreadsheetbenchmark).

- Verbeteringen in nauwkeurigheid en factualiteit: Vroege reviews en QA tonen ~33% reductie in hallucinaties en minder foutgevoelige output ten opzichte van GPT-5.2, met opvallende winst bij documentopstellen en spreadsheetwerk. Reviewers noemden ook een ~18% afname van foutgevoelige reacties bij bepaalde productiviteitstaken.

- Geïntegreerd computergebruik en Codex-afstamming: GPT-5.4 bevat capaciteiten geërfd van de Codex-lijn die codegeneratie, interactieve debugging en operationele toolaansturing verbeteren (muis/toetsenbord/screenshot-automatisering in sommige demo’s). Dit maakt het beter in de write-run-inspect-patch-cyclus die typisch is voor agentloops.

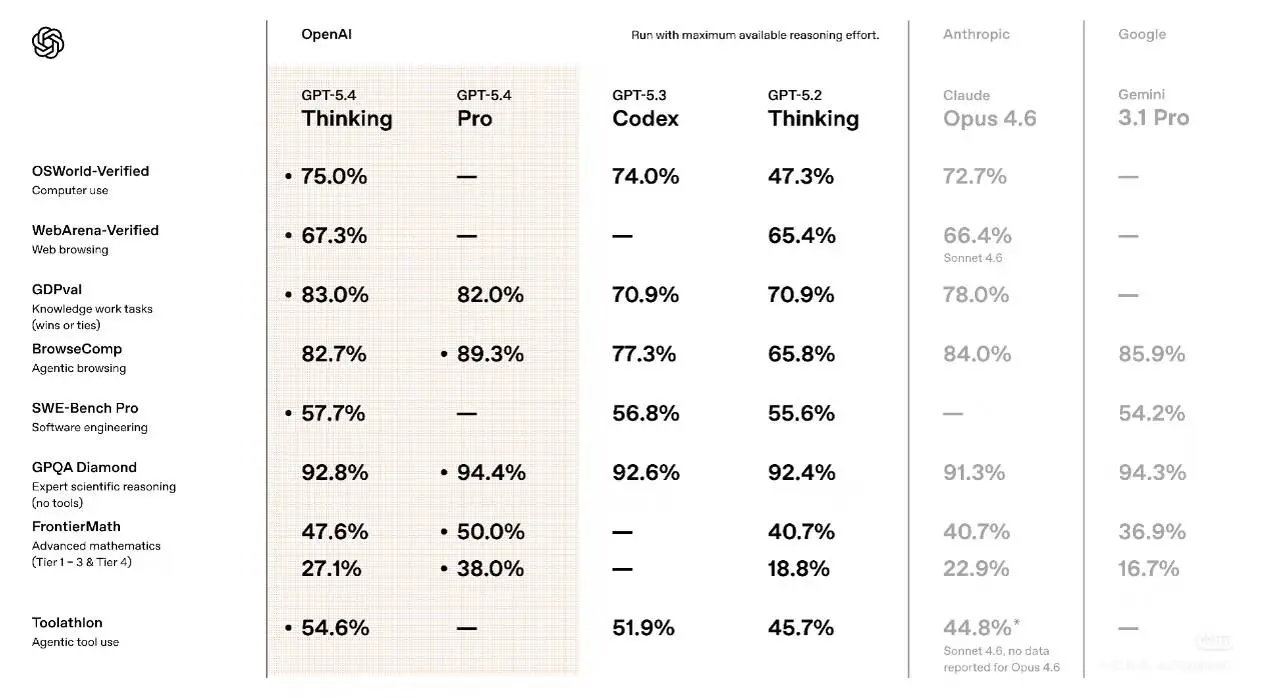

Benchmarks & vergelijkende context (wat de cijfers betekenen)

- Spreadsheetmodellering: Interne spreadsheetbenchmark van OpenAI: ~87.3% gemiddelde score voor GPT-5.4 vs ~68.4% voor GPT-5.2. Dit is de kop die de leverancier gebruikt om taak-specifieke winst te tonen.

- Computerinteractie (OSWorld / agent-achtige tests): onafhankelijke testers en community-runs tonen dat GPT-5.4 verbetert op agentinteractietaken die desktop- of gesimuleerde UI-manipulatie omvatten, soms net voor recente Anthropic-modelvarianten op deze testsets (verschillen zijn betekenisvol voor agents, maar niet per se doorslaggevend voor elke workload).

Interpretatie: GPT-5.4 is geen “magische kogel” die alles wint. Het heeft duidelijke sterktes in geïntegreerd toolgebruik, code-executiepatronen en spreadsheetredenering — precies de workloads die OpenClaw-agents vaak draaien. Voor agentbouwers is de combinatie van verbeterde executor-betrouwbaarheid (Codex-lijn) + plannercompetentie + betere long-contextafhandeling zeer relevant.

OpenClaw ondersteunt GPT-5.4: wat er veranderde en waarom dat telt

De release van OpenClaw (zie de projectreleases) werkt modelresolvers en runtime bij om toekomstbestendig te zijn voor GPT-5.4’s uitgebreide context- en tokenlimieten en voegt de “memory hot-swappable”-mogelijkheid toe zodat agents geheugenbackends of modellen tijdens runtime kunnen wisselen. Dit gebeurt op drie concrete manieren: 1) updates van modelmetadata en -resolver om de grotere context- en tokenlimieten te accepteren; 2) runtimewijzigingen in agents om gracieus modelswitchen en cache-warmup te orkestreren; 3) een memory-API die meerdere geheugengekanalen en hot-switchtriggers toelaat.

De ondersteuning voor GPT-5.4 in versie 2026.3.7 plus een memory hot-swappable ontwerp biedt twee praktische, complementaire voordelen:

- Eenvoudig upgradepad voor modellen. OpenClaw kan GPT-5.4 nu presenteren als een selecteerbare “runtime” voor agents, zodat je kunt wisselen van oudere GPT-5.x-modellen of alternatieve leveranciers zonder je agentlogica te herwerken. De OpenClaw-update verklaart expliciet stabiele GPT-5.4-integratie in de core.

- Memory Hot-Swapping. In plaats van één lineaire geheugensnapshot te persisteren, laat de Context Engine van OpenClaw geheugensegmenten loskoppelen, wisselen of migreren tijdens runtime — bijvoorbeeld een vector-DB-shard met hoge recall inwisselen voor debugging of wisselen naar een AVG-geschoonde geheugenvariant voor externe audits — zonder de agent te stoppen. Dat verlaagt het verstoringsrisico in productie en maakt usecase-specifieke geheugenconfiguraties mogelijk (debugging vs privacy vs performance).

praktische doorbraken in prestaties & voordelen

De integratie van OpenClaw richt zich op drie praktische gebieden waar GPT-5.4 uitblinkt:

- Betrouwbaardere toolorkestratie. GPT-5.4’s verbeterde interne tool-zoek en redenering vermindert tool-call churn (minder redundante tool-calls en minder retries). Dat vertaalt zich naar minder API-calls en snellere afronding voor complexe flows. Vroege rapporten wijzen op verbeteringen in token- en tool-call-efficiëntie vergeleken met oudere GPT-5.x-modellen.

- Langere, rijkere contextafhandeling. OpenClaw-agents kunnen nu veel grotere actieve contexten behouden (inclusief ingewisselde geheugensegmenten), waardoor ze lange conversaties, multifile-projecten en iteratieve debugging kunnen beheren zonder state te verliezen.

- Meer deterministische code-output. Voor workflows die automatisch code genereren (CI-hooks, function stubs, infrastructuursjablonen) levert GPT-5.4 doorgaans consistentere en uitvoerbare outputs, wat de menselijke reviewlast verlaagt. Onafhankelijke tests tonen aanzienlijke verbeteringen in codekwaliteitsmetrics t.o.v. eerdere GPT-5-modellen.

- Geheugencontinuïteit — “memory hot-swappable” laat je geheugenstores (lokale cache, vector-DB, LLM-geheugen) vervangen of uitbreiden zonder agentstate of context te verliezen, wat A/B-tests, rolling upgrades en failover mogelijk maakt.

In de OOLONG-benchmarktest behaalde de nieuwe versie van OpenClaw, in combinatie met de lossless-claw plugin, een hoge score van 74.8, waarmee Claude Code (70.3 punten) ruim werd overtroffen. Met name toonde OpenClaw stabiliteit en nauwkeurigheid naarmate de contextlengte toenam, wat de ingenieurs die de on-site tests uitvoerden ertoe bracht uit te roepen dat “het te conservatief is om te zeggen dat het goed draait”.

Hoe GPT-5.4 te configureren en gebruiken in OpenClaw (stap-voor-stap)

Een eenvoudige OpenClaw-workflow met GPT 5.4:

- Een typische configuratie staat hieronder:

- Gebruikers sturen berichten via platforms zoals Discord of Telegram.

- OpenClaw ontvangt de berichten via zijn gatewayserver.

- De gateway stuurt de prompts door naar GPT 5.4 via de AI-API-provider.

- GPT 5.4 genereert een antwoord of triggert een toolactie.

- OpenClaw stuurt het eindresultaat terug naar de gebruiker.

Hieronder staan pragmatische, copy-pastebare configuratievoorbeelden en workflows om GPT-5.4 veilig en reproduceerbaar te draaien in OpenClaw. Deze zijn bewust conservatief: schakel het model eerst in bij een testagent en instrumenteer alles voor metrics en fouten.

Vereisten

- OpenClaw geüpgraded naar de release die GPT-5.4-mappingen bevat (de hierboven aangehaalde releasenotes).

- Geldige OpenAI API-sleutel met toegang tot GPT-5.4 (ik kies het CometAPI-endpoint met lagere prijs).

1) Modelselectie & resolverconfiguratie (Json/ YAML / CLI)

Zet dit in ~/.openclaw/openclaw.json (of voeg samen met je bestaande config). Pas providernamen en tokenverwijzingen aan zoals je omgeving vereist.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw gebruikt een modelresolver om logische modelnamen (bijv. openai/gpt-5.4) te mappen naar endpoints en runtimeconfig. Voeg je resolverbestand toe of werk het bij (voorbeeld models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Of stel het in tijdens runtime via de CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Opmerking: De

context_windowenmax

Notes

agents.defaults.model.primarykiest het standaardmodel. Gebruikchannels.modelByChannelvoor per-kanaal overrides zodat je high-impact kanalen naar GPT-5.4 kunt routeren en minder veeleisende kanalen naar goedkopere modellen. Zie de documentatie voor modelselectie van OpenClaw voor de ordering semantics.- Raadpleeg de CometAPI-modelpagina voor specifieke modelnamen. Als je OpenAI wilt gebruiken, vervang dan de URL en API-sleutel door die van OpenAI.

- De sleutels

context_windowenmax_output_tokensweerspiegelen de toekomstbestendige wijzigingen in de resolver van OpenClaw zodat de agent geen verouderde Codex-limieten probeert te gebruiken.

2) “Memory hot-swapping” inschakelen en testen

Het geheugensubsysteem van OpenClaw is bestand-gebaseerd (Markdown-bestanden) plus indexers/zoekplugins, zodat je backend-plugins (bijv. SQLite-vector, Milvus of externe geheugenservices) veilig kunt wisselen zonder de ruwe geheugenbestanden te verliezen.

Een veelvoorkomend patroon:

- Standaardiseer de geheugenlocatie: gebruik een git-backed workspace:

~/.openclaw/workspace/waarMEMORY.mdenmemory/YYYY-MM-DD.mdleidend zijn. - Installeer en configureer een memory-plugin (voorbeeld: sqlite-vec) en wijs

plugins.slots.memoryernaar in de config. - Test migratie: voeg een nieuwe plugin toe, draai een shadow indexing job, vergelijk retrievalresultaten en switch vervolgens de alias

plugins.slots.memorynaar de nieuwe plugin zodra je tevreden bent.

Voorbeeld pluginswitch via alias (bash-pseudocommando’s):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Waarom dit “hot-swappable” is: de geheugenbestanden blijven de single source of truth. Plugins implementeren indexatie- en retrievallagen; ze herindexeren bij wisselen maar veranderen de onderliggende .md-bestanden niet. Dit voorkomt catastrofale identiteitsdrift bij modelswaps — de agent leest nog steeds dezelfde MEMORIES.

3) Voorbeeld: een individuele agent vastpinnen op GPT-5.4 (per-agent override)

Je kunt per agent modellen overschrijven; voeg een agent-entry toe zoals:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Als de communityrelease of jouw specifieke OpenClaw-versie de CLI vereist, kun je ook per sessie een model instellen tijdens runtime:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Operationele tip: pinnen zorgt voor deterministisch gedrag voor die agent terwijl je A/B-tests op anderen draait.

Als je OpenAI wilt gebruiken, vervang dan de URL en API-sleutel door die van OpenAI.

4) Codex 1M-contextopties gebruiken (API-knoppen)

Als je OpenClaw-deployment direct toegang heeft tot OpenAI Codex-endpoints, geef contextopties mee:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Verzoeken die de standaard contextvensters overschrijden kunnen tegen andere gebruikstarieven meetellen (OpenAI-docs noemen dubbele accounting voor verzoeken voorbij standaardvensters in Codex-preview).

Best practices: de sterke punten van GPT-5.4 maximaliseren in OpenClaw

Kosten, latentie & modelmix

- Hybridestrategie voor modellen: Gebruik een kleiner, goedkoper model voor korte queries en streamverwerking; hot-swap naar GPT-5.4 voor zware analyses, samenvattingen en codegeneratie die lange context vereisen. Dit verlaagt de totale tokenkosten met behoud van kwaliteit. (Implementeer via triggers in de geheugenconfig hierboven.)

- Tokencompactie & retrieval-augmentatie: Gebruik retrieval-augmented pipelines om het aantal tokens naar het model te beperken — sla lange documenten op in een vector-DB, haal relevante segmenten op en neem alleen de meest relevante stukken plus een compacte plan op. GPT-5.4’s tool search helpt hierbij door automatisch nuttige tools of documenten te vinden.

- Warm-up & cold start: Na een modelswitch, warm het model op met een korte contextpriming-run om latency-spikes bij de eerste aanvraag te vermijden. Precompileer eventuele prompttemplates en rehydrateer kritieke geheugencanalen. De rolling-strategie van OpenClaw (zie config) ondersteunt pre-warming.

Betrouwbaarheid & veiligheid

- Gracieuze fallback: Implementeer timeouts en fallback-plannen (bijv. degradeer naar een gecachte answer uit een vorige sessie) om API-ratelimits of quota-errors op te vangen.

- Veiligheidslagen: Handhaaf policyfilters en een verificatiestap wanneer outputs beslissingen beïnvloeden. GPT-5.4 reduceert hallucinaties statistisch, maar verificatie blijft belangrijk bij high-stakes taken.

Evaluatie & monitoring

- Reproduceer je benchmarks: Draai head-to-head-tests voor jouw workloads (code completion, multifile-refactor, spreadsheetanalyse) met een standaardrubriek. Publieke rapporten duiden op sterktes in spreadsheets en productiviteitstaken — valideer met jouw data.

- Telemetrie: Monitor tokenverbruik, modellatentie, frequentie van geheugenswitches en antwoordkwaliteit (menselijke beoordelingen/geautomatiseerde tests). Gebruik de telemetrie om switchdrempels te verfijnen.

Voorbeeld: codereview-agent die hot-swapt

Doel: Draai een routine lint + unittest-samenvatting bij push (goedkoop model) en schaal op naar GPT-5.4 voor multifile-refactorsuggesties wanneer tests falen of diffs > 10 bestanden zijn.

Flow (hoog niveau):

- Pre-commit trigger draait

local/fast-small-coderom een lintsamenvatting te genereren. - Als

test_failures > 0ofdiff_files > 10, triggerhot_swapnaaropenai/gpt-5.4. Promootlongterm_vectormet repo-geschiedenis. - Draai GPT-5.4-prompt met volledige falende stacktraces + relevante codebestanden die in context zijn gehaald. Genereer refactorpatch en unittestwijzigingen.

- Menselijke reviewer beoordeelt output; feedback werkt geheugen bij.

Promptskelet (verzonden naar GPT-5.4 na retrieval & compactie):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Deze usecase laat zien waarom grote context + memory hot-swap waardevol is: je kunt de volledige falende trace en meerdere bestanden tegelijk naar het model brengen. Implementeer switchtriggers conservatief om kosten te beheersen.

Tot slot: wie GPT-5.4 in OpenClaw zou moeten adopteren (en wanneer)

- Adopteer nu als je agents meerstaps code-/tooltaken uitvoeren, zware spreadsheetautomatisering of complexe documentbewerking waar iteratieve write-run-inspect-cycli de tijd domineren. De productiviteits- en betrouwbaarheidswinst is hier het duidelijkst.

- Adopteer voorzichtig als je werkt in kostengevoelige, high-volume chatkanalen waar eenvoudige redenering volstaat; gebruik routing om kostenefficiëntie te behouden.

- Ga niet uit van één-model-dominantie: benchmark met jouw data. GPT-5.4 is een sterke kandidaat voor agentworkloads, maar modelkeuze moet evidence-based zijn.

Ontwikkelaars kunnen GPT-5.4 nu benaderen via CometAPI (CometAPI is een one-stop aggregatieplatform voor grote model-API’s zoals GPT-API’s, Nano Banana API’s enz.). Om te beginnen, verken de mogelijkheden van het model in de Playground en raadpleeg de Openclaw integratiegids voor gedetailleerde instructies. Zorg ervoor dat je bent ingelogd bij CometAPI en de API-sleutel hebt verkregen voordat je toegang vraagt. CometAPI biedt een prijs die veel lager is dan de officiële prijs om je te helpen integreren.

Klaar om te starten?→ Meld je vandaag nog aan voor OpenClaw!

Wil je meer tips, gidsen en nieuws over AI? Volg ons op VK, X en Discord!