Hurtigsvar: Hvilken KI-modell bør utviklere prioritere i 2026?

For oppgaver som krever maksimal autonom resonnering og minimale hallusinasjoner, bør utviklere velge GPT-5.5 (xhigh), som leder markedet med en Intelligence Index på 60. Applikasjoner som krever sanntids interaktivitet, bør bruke Mercury 2, dagens fartsleder med omtrent 859 tokens per sekund. For storskala produksjon der budsjett er den primære begrensningen, tilbyr DeepSeek V4 Pro og Kimi K2.6 intelligens nær toppnivå til omtrent 10 % av kostnaden for flaggskip-proprietære modeller.

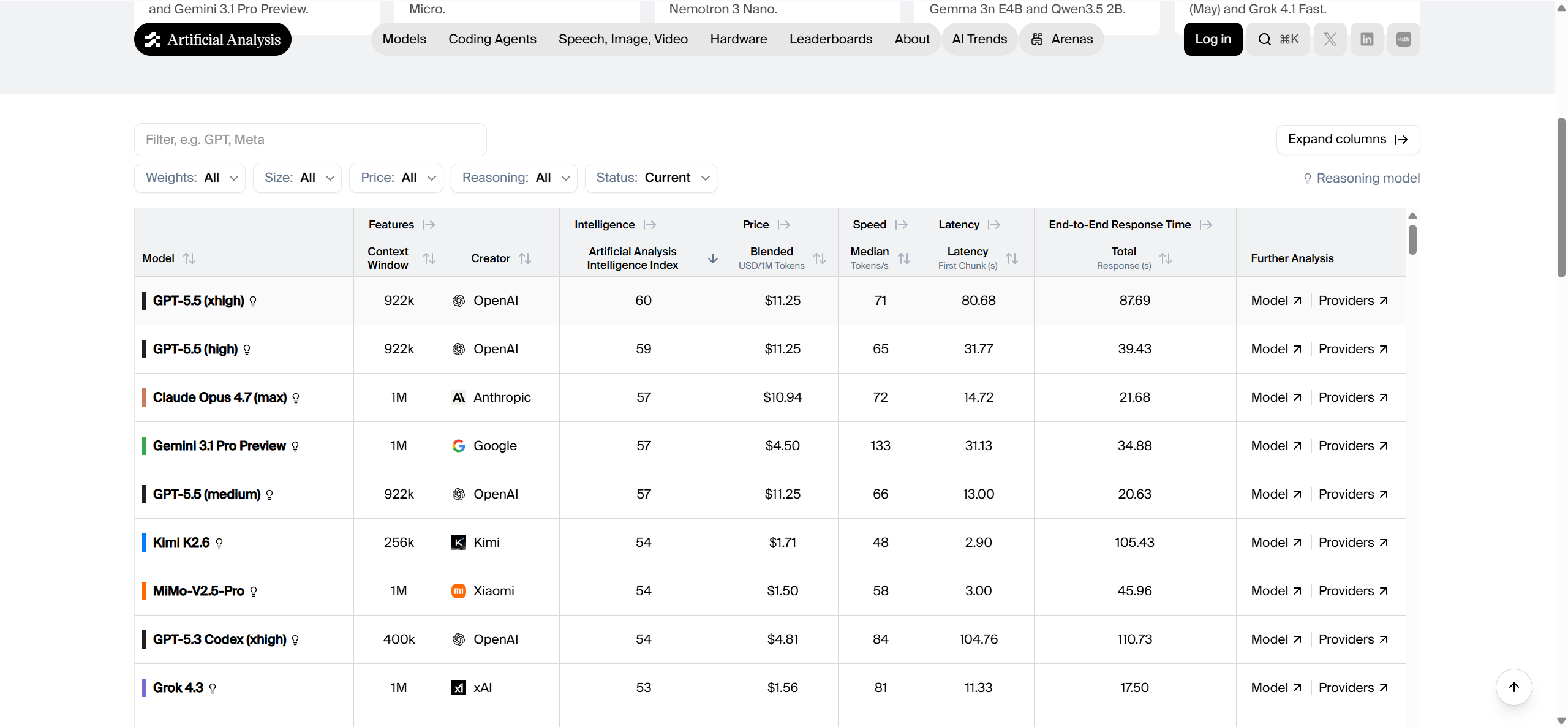

The Intelligence Index: Rangering av toppmodeller

KI-landskapet i 2026 har flyttet fokus fra å jage parameterantall til å optimalisere “tenke”-tetthet. Artificial Analysis Intelligence Index v4.0 fungerer som bransjestandard for å kvantifisere modellkapabilitet på tvers av ti spesialiserte dimensjoner, inkludert profesjonell koding og ekstrem logisk deduksjon.

| Model | Intelligence Index | Context Window | Best Use Case |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Vitenskapelig forskning og logikk |

| GPT-5.5 (high) | 59 | 922K | Kode på profesjonelt nivå |

| Claude Opus 4.7 (max) | 57 | 1M | Autonome agenter og planlegging |

| Gemini 3.1 Pro | 57 | 1M - 2M | Multimodal datasyntese |

| Kimi K2.6 | 54 | 256K | Terminalbasert agentarbeid |

| MiMo-V2.5-Pro | 54 | 1M | Fullstack-programvareutvikling |

| DeepSeek V4 Pro (Max) | 52 | 1M | Skalerbare resonnement-arbeidsflyter |

| GLM-5.1 | 51 | 200K | Langtids autonome oppgaver |

Slik leser du denne tabellen

Av de fem beste modellene er tre GPT-5.5-modeller, GPT-5.5 Medium, Claude Opus 4.7 og Gemini 3.1 Pro. Disse tre vestlige flaggskipmodellene ligger tett, mens Kimi K2 og mimo-v2.5 pro, to kinesiske modeller, tilbyr ytelse på nivå med de beste vestlige modellene til svært konkurransedyktige priser.

Artificial Analysis Intelligence Index er en normalisert metrikk avledet fra uavhengige evalueringer som Terminal-Bench Hard og IFBench. Ett poengs forskjell representerer et statistisk signifikant gap i en modells «autonomiterskel». For eksempel oversettes gapet på 3 poeng mellom GPT-5.5 (60) og Claude Opus 4.7 (57) ofte til forskjellen mellom en modell som krever menneskelig intervensjon hvert par steg, og en som kan fullføre en kompleks logikkjede selvstendig. En høyere indeks-score er generelt assosiert med høyere suksessrater i “Humanity's Last Exam” og færre verktøykallingsfeil i agentmiljøer.

Refleksene: Latens og genereringshastighet

For interaktiv programvare—fra live IDE-assistenter til kundevendte stemmeagenter—er rå intelligens sekundært i forhold til Time to First Token (TTFT) og Generation Throughput.

Topp 5 raskeste modeller (gjennomstrømning)

Gjennomstrømning måler hastigheten som en modell genererer tekst med etter den innledende behandlingsfasen. Høy gjennomstrømning er essensielt for generering av langt innhold og rask kode-refaktorering.

- Mercury 2: Omtrent 859 tokens/s

- Granite 4.0 H Small: Omtrent 407 tokens/s

- Granite 3.3 8B: Omtrent 365 tokens/s

- Gemini 3.1 Flash-Lite**** : Omtrent 331 tokens/s

- Qwen3.5 0.8B: Omtrent 287 tokens/s

Topp 5 lavest latens (TTFT)

Latens indikerer forsinkelsen før den første tokenen når brukeren. Dette er den kritiske metrikken for “vibe” og opplevd responsivitet i UI/UX.

- NVIDIA Nemotron 3 Nano: Omtrent 0.40s

- Ministral 3 3B: Omtrent 0.47s

- Qwen3.5 0.8B: Omtrent 0.52s

- LFM2 24B A2B: Omtrent 0.55s

- Grok 3 mini Reasoning: Omtrent 0.58s

Hvordan velge riktig modell i 2026

Å velge en modell krever balansering av “Intelligence-per-Dollar”-forholdet med de spesifikke oppetidskravene til applikasjonen din. Markedet i 2026 har sprunget ut i tre distinkte arkitektoniske retninger.

Uavhengige utviklere og budsjettsensitive team

For soloutviklere eller små team som kjører tusenvis av eksperimentelle agent-løkker, er DeepSeek V4 Pro det optimale strategiske valget. Den bruker en massiv 1.6T parameter Mixture-of-Experts (MoE)-arkitektur der kun 49B parametere aktiveres per token, noe som gjør at den kan levere flaggskipytelse til omtrent $0.416 per million tokens. Et annet godt alternativ for kodespesifikke oppgaver er Kimi K2.6, som spesialiserer seg på terminal-først-arbeidsflyter. Disse modellene gir nesten 90 % av resonneringskraften til premium-modeller samtidig som de er omtrent 70–80 % billigere, og forlenger effektivt runway for en startup.

Bedriftsproduksjonsmiljøer

For virksomhetsomspennende utrullinger der stabilitet og etterlevelse av komplekse systemprompter er ikke-forhandlingsbart, er industristandarden fortsatt GPT-5.5 Pro og Claude Opus 4.7. GPT-5.5 Pro er konstruert for presisjon med høy innsats og utmerker seg i områder som investeringsbank-modellering og vitenskapelig utforskning der kostnaden ved en feil overgår kostnaden for API-kallet. Claude Opus 4.7 foretrekkes av team som krever vedvarende pålitelighet i flerdagers prosjekter, da den viser en betydelig lavere hallusinasjonsrate i terminalmiljøer sammenlignet med den bredere GPT-familien. Bedrifter bruker vanligvis CometAPI for å integrere disse modellene gjennom en enkelt gateway, og sikrer 99.9 % oppetid og umiddelbar failover hvis en primærleverandør opplever regionale latensøkninger.

Sanntids interaktive applikasjoner

Applikasjoner som sanntids kundestøtte-boter eller øyeblikkelig videoteksting krever “flytende” KI som føles øyeblikkelig. I denne kategorien er Mercury 2 og Gemini 3.1 Flash-Lite de beste valgene. Mercury 2 tilbyr gjennomstrømning nesten ti ganger raskere enn standard resonneringsmodeller, noe som gjør den ideell for sanntids dokumentutkast. Gemini 3.1 Flash-Lite gir balansert multimodal kapasitet, behandler tekst, lyd og bilder i en samlet kontekst med omtrent 2.5x hastigheten til tidligere generasjoner, samtidig som den støtter et kontekstvindu på 1 million tokens.

Kontekstvindu: Fra snutter til hele repositorier

Kontekstvinduet fungerer som modellens “korttidsminne”. I 2026 har bransjen delt seg mellom standard vinduer (128K) og repositorie-skala kapasitet (1M–10M).

- Llama 4 Scout: 10,000,000 tokens

- Grok 4.20: 2,000,000 tokens

- Gemini 3.1 Pro: Approximately 1,048,576 tokens

- DeepSeek V4 Pro: 1,000,000 tokens

- GPT-5.5 Pro: 1,050,000 tokens

Når betyr kontekststørrelse noe?

Et 128K-kontekstvindu—standard for modeller som DeepSeek-V3.2—er nå grunnlaget for enkel samtalechat og oppsummering av enkeltartikler. Profesjonell programvareutvikling krever imidlertid “hele-systemets” bevissthet.

Et kontekstvindu på 1 million tokens lar en KI-agent ta inn et helt programvare-repositorium, inkludert alle kildefiler, dokumentasjon og historiske logger, i én forward pass. Dette forhindrer “minnedrift” assosiert med tradisjonelle RAG-systemer der relevant data kan gå tapt under chunking. Et konkret eksempel er en kodebaserefaktor: En modell med 1M tokens kan forstå hvordan en endring i et kjerneschemas for database påvirker femti forskjellige API-endepunkter på tvers av separate filer, mens en mindre modell kanskje bare “ser” noen få filer om gangen, noe som fører til brutte avhengigheter.

Økonomisk sammenligning: enhetspris per 1 million tokens

Følgende tabell bruker en Blended USD/1M Tokens-metrikk, med antakelse om et 3:1-forhold mellom input- og output-tokens for å gjenspeile bruksmønstre i den virkelige verden.

| Model | Blended Price (per 1M) | Relative Value | Discount via CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | Approximately $11.25 | Premium | 20 % rabatt |

| Claude Opus 4.7 (max) | Approximately $10.00 | Høy | 20 % rabatt |

| Gemini 3.1 Pro | Approximately $4.50 | Balansert | 20 % rabatt |

| Kimi K2.6 | Approximately $1.71 | Høy verdi | 20 % rabatt |

| DeepSeek V4 Pro | Approximately $0.53 | Ekstrem verdi | 20 % rabatt |

| Qwen3.5 0.8B | Approximately $0.02 | Nyttemodell | 20 % rabatt |

All rates verified as of May 2026. Official vendor rates are typically 20% higher than the discounted rates provided through unified gateways.

Kostnadsoptimaliseringsstrategi

For å hjelpe arkitekturplanlegging har vi estimert månedlige utgifter for tre vanlige vekstnivåer.

- Lite utviklerteam (10M tokens/måned): Team som primært bruker Kimi K2.6 for funksjonsbygging og DeepSeek V4 Flash for enkel logikk vil se månedlige utgifter i området $15 til $40. Dette muliggjør aggressiv prototyping med en økonomisk byrde som ikke er større enn et standard SaaS-abonnement.

- Mellomstor SaaS (100M tokens/måned): En startup som skalerer en KI-drevet automasjonsplattform med Claude Sonnet 4.6 og Gemini 3.1 Flash kan forvente månedlige kostnader mellom $250 og $550. Ved å bruke prompt-caching tilgjengelig på disse modellene faller den effektive kostnaden ofte med ytterligere 15 %.

- Stor virksomhet (1B tokens/måned): Globale selskaper som kjører agent-arbeidsflyter med høy samtidighet med GPT-5.5 og Claude Opus 4.7 vil sannsynligvis bruke i området $3,000 til $6,500 månedlig. I denne skalaen blir integrering via en samlet API-gateway essensielt for sentralisert fakturering og for å unngå overhead med å administrere separate kontrakter med flere leverandører.

Konklusjon: Velg din vei i 2026

Tiden for “én modell til alt” er over. Moderne KI-arkitektur krever orkestrering av en flåte spesialiserte modeller: GPT-5.5 for høykapasitets resonnering, Mercury 2 for interaktivitet og DeepSeek V4 for høyt volum. Ved å integrere én gang med CometAPI får utviklere portabiliteten til å bytte modeller ettersom benchmarkene utvikler seg, samtidig som de sikrer en permanent 20–40 % rabatt på hver forespørsel.

FAQ

Hvilken KI-modell er for øyeblikket den mest intelligente?

Ifølge Artificial Analysis Intelligence Index v4.0 er GPT-5.5 (xhigh) den mest intelligente tilgjengelige modellen, med en score på 60. Den etterfølges tett av GPT-5.5 (high) på 59 og Claude Opus 4.7 (max) på 57.

Hva er den raskeste KI-modellen for sanntidsapplikasjoner?

Mercury 2 er hastighetsmesteren i 2026, med omtrent 859.1 tokens per sekund. For lav latens (TTFT) leder NVIDIA Nemotron 3 Nano med en responstid på omtrent 0.40 sekunder.

Hvor høy må en Intelligence Index-score være for produksjonsagenter?

For grunnleggende automatisering eller klassifisering er en score mellom 30 og 40 (som GPT-5.4 nano) ofte tilstrekkelig. For “Agentic Engineering” der KI-en håndterer kodebaser eller hele nettleserøkter, anbefales en score over 54 (slik som Kimi K2.6 eller GPT-5.5) for å sikre konsistens i planlegging over lange horisonter.

Med tilsvarende prising, bør jeg velge GPT-5.5 eller Claude Opus 4.7?

Hvis arbeidsflyten din involverer terminaleksekvering og “Vibe Coding”, utmerker GPT-5.5 seg generelt i disse spesifikke benchmarkene. Men hvis du trenger ekstrem konsistens for profesjonell skriving, juridisk forskning eller flerdagers agent-sykluser med lav hallusinasjonsrate, er Claude Opus 4.7 den dokumenterte lederen i disse kategoriene.

Hva er det faktiske ytelsesgapet mellom open-weights (DeepSeek) og proprietære modeller?

I 2026 har gapet krympet til omtrent 10–15 % i rå resonnerings-benchmarker. Mens proprietære flaggskip som GPT-5.5 (xhigh) fortsatt leder i “peak” logikk (Index 60), leverer open-weight-modeller som DeepSeek V4 Pro (Index 52) og Kimi K2.6 (Index 54) over 85 % av kapasiteten til omtrent 1/10 av kostnaden.

Hvordan kan jeg redusere mine totale API-kostnader for disse modellene?

Ved å bruke et samlet API-lag som CometAPI får du tilgang til hele katalogen til priser som er 20 % til 40 % lavere enn offisiell leverandørprising gjennom bulk-innkjøp og intelligent path routing.

Hvilken modell har det største kontekstvinduet for lange dokumenter?

Llama 4 Scout støtter for tiden det største kontekstvinduet i markedet med 10 millioner tokens. Grok 4.20 følger med 2 millioner tokens, mens GPT-5.5 Pro, Gemini 3.1 Pro og DeepSeek V4 Pro alle støtter omtrent 1 million tokens.

Finnes det en måte å teste disse benchmarkene uten høy startkostnad?

Ja. Du kan registrere deg for en gratis konto hos CometAPI for å motta testkreditter uten krav om kredittkort, slik at du kan kjøre sammenlignende ytelsestester på tvers av over 500 modeller i det innebygde Playgroundet.