Utvikleropplevelsen med ChatGPTs videoanalyse støter ofte på en vegg: direkte YouTube-lenker feiler, og MP4-opplastinger gir «hallusinerte» sammendrag som overser visuelle nyanser. Dette er ikke en feil — det er en arkitektonisk begrensning. ChatGPT strømmer ikke video; den behandler sekvenser av uttrukne enkeltbilder og transkribert tekst. Så du prøvde å laste opp en MP4-fil, noe som fungerte … sånn delvis. Sammendraget nevnte lydtranskripsjonen, men overså fullstendig den visuelle spøken i den tredje scenen som fikk hele videoen til å gi mening.

ChatGPT kan analysere videoer — men ikke ved faktisk å se dem

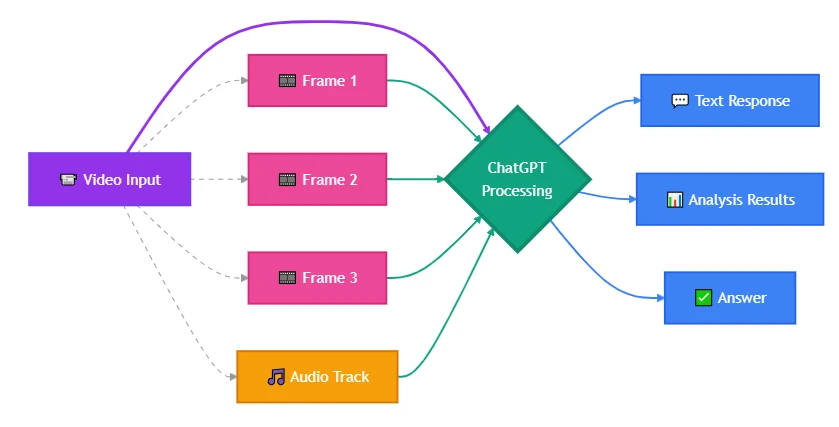

Her er hva som faktisk skjer: ChatGPT «ser» ikke videoer slik du gjør. Den trykker ikke på play, strømmer innholdet og observerer bevegelse over tid. Det den gjør, er å dele videoen opp i komponenter den allerede kan håndtere — stillbilder og teksttranskripsjoner — og så resonnerer den over disse delene hver for seg. Modellen ser videoen din som et fotoalbum med fortellerstemme, ikke som en kontinuerlig opplevelse. Det er derfor den fanget opp den muntlige forklaringen, men gikk glipp av den visuelle punchlinen: rammen med spøken var sannsynligvis ikke i det utvalgte settet.

Når noen spør «kan ChatGPT se videoer», mener de vanligvis ett av to spørsmål: Kan den strømme visuelt innhold slik et menneske ville, eller kan den trekke ut og analysere mening fra videodata — scener, dialog, tidsstempler, handlinger på skjermen? Det funksjonelle svaret er ja på det andre spørsmålet, med begrensninger som gjør at enkelte brukstilfeller feiler totalt. Moderne ChatGPT-varianter prosesserer video ved å behandle den som utvalgte enkeltbilder kombinert med lydtranskripsjon, enten gjennom automatisert uttrekk i webgrensesnittet eller ved å akseptere rammer som brukeren selv leverer via API. Dette fungerer for oppsummering, scenebeskrivelse og tekstuttrekk. Det feiler for bevegelsessporing, tidsavhengig analyse eller alt som krever at modellen «ser» hva som skjer mellom rammene.

De fleste guider stopper ved å bekrefte at funksjonen finnes, uten å forklare hvorfor din spesifikke implementering ikke fungerte — eller hvilken alternativ inputmetode du burde brukt.

ChatGPT Videokapasiteter: Hva modellen faktisk ser

ChatGPT laster ikke en MP4 og skrubber den bilde for bilde. Den har visjonsevne — evnen til å analysere statiske bilder — og lydtranskripsjon via Whisper-integrasjon. Når du sender inn video gjennom ChatGPTs web- eller mobilgrensesnitt, ekstraherer systemet nøkkelrammer, transkriberer lyden separat, og mater begge til modellen som distinkte input. Modellen beskriver deretter hva den «så» i disse rammene og hva den «hørte» i transkripsjonen.

Fra ditt perspektiv ser det ut som videoforståelse. Fra modellens perspektiv er det bildeanalyse pluss tekstbehandling. Den arkitektoniske forskjellen bestemmer hvilke brukstilfeller som fungerer og hvilke som ikke gjør det.

Hvis videoen din avhenger av bevegelse, subtile endringer mellom rammer eller presis timing — for eksempel å oppdage nøyaktig når et objekt kommer inn i bildet, eller spore hvordan et UI-element animeres — vil en nøkkelrammebasert tilnærming gå glipp av det. ChatGPT vil ikke fange opp et to sekunders visuelt hint som faller mellom utvalgte rammer. Den vil heller ikke spore objekter over tid med mindre du eksplisitt strukturerer input slik at progresjonen vises.

Gjeldende ChatGPT-videokapasiteter (per tidlig 2026):

- Bildebasert videoanalyse: Aksepterer videofiler eller uttrukne rammer; tolker visuelt innhold fra utvalgte bilder

- Lydtranskripsjon: Konverterer tale til tekst via Whisper; modellen kan deretter oppsummere eller svare på transkripsjonen

- Scenebeskrivelse: Identifiserer objekter, handlinger, miljøer og tekst som er synlig i innsendte rammer

- Tidsstempel-baserte forespørsler: Kan referere til spesifikke øyeblikk hvis du oppgir rammetidsstempler eller segmenterer videoen manuelt

- Tekstuttrekk: Leser undertekster, UI-etiketter eller dokumenter som er synlige i rammene

Spesifikk utvalgsfrekvens for rammer og automatisk valg av nøkkelrammer i ChatGPTs webgrensesnitt — ikke offentlig dokumentert per kunnskapsavgrensning

Hva som ikke er inkludert:

- Sanntids strømming av video via API

- Rammeperfekt bevegelsessporing eller objektpersistens over tid

- Nativ støtte for videokodeker — all prosessering skjer på uttrukne rammer og lyd

- Automatisk sceneskift-deteksjon uten eksplisitt oppfordring

Videokapasitet er begrenset av token-grenser og filstørrelse, ikke varighet. Selv om 5–10 minutter er en praktisk tommelfingerregel, skalerer de faktiske grensene dynamisk med visuell tetthet.

Hvis brukstilfellet ditt krever disse evnene, må du enten forprosessere videoen selv for å trekke ut riktige rammer, eller bytte til en modell med innebygd videostøtte. Neste seksjon forklarer hvilken inputmetode du bør bruke for ditt scenario.

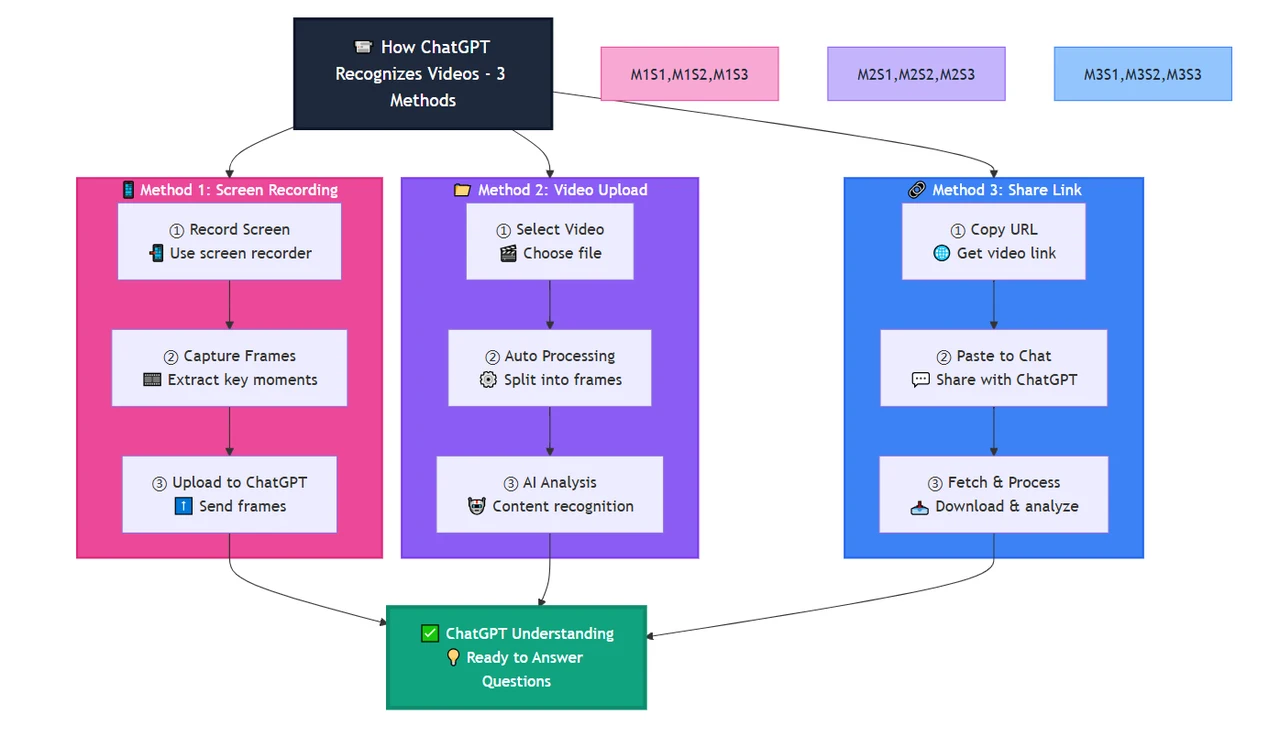

Slik gjenkjenner ChatGPT videoer: tre praktiske metoder

Det finnes ikke én måte å sende inn video til ChatGPT på. Metoden du velger, styrer hva modellen kan analysere og hva den vil gå glipp av. De fleste implementeringsfeil oppstår fordi man velger den bekvemme metoden i stedet for den riktige.

Metode 1: Manuelt uttrekk av enkeltbilder + opplasting av bilder

Trekk ut rammer selv med ffmpeg eller lignende verktøy, og last opp disse spesifikke rammene som bilder. Dette gir deg full kontroll over hva ChatGPT analyserer.

Eksempelarbeidsflyt(bash):

# Trekk ut ett enkeltbilde hvert 5. sekund fra en video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Eller trekk bare ut enkeltbilder ved sceneskift

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Denne tilnærmingen lar deg:

- Fokuser analysen på spesifikke øyeblikk (intro, nøkkelhandling, konklusjon) uten å sløse kontekst på irrelevante deler

- Fange bevegelse ved å laste opp påfølgende rammer med din valgte utvalgsfrekvens

- Omgå filstørrelsesbegrensninger — bilder er mindre enn komplette videofiler

- Bevare bildekvalitet som kan forringes under automatisk komprimering

Avveiingen:

Du håndterer forprosesseringen selv. For analyse av hundrevis av videoer i skala krever dette automasjon. For engangsanalyser eller feilsøking av spesifikke scener er det den mest pålitelige metoden.

Når bruke denne metoden:

- Du trenger ramme-nøyaktig analyse av bestemte øyeblikk

- Kritisk visuell informasjon er kortvarig eller forekommer mellom typiske intervaller for nøkkelrammer

- Du sammenligner visuelle endringer over en sekvens (UI-tilstandsendinger, animasjonsrammer)

- Du vil verifisere hva modellen faktisk «så» ved å inspisere de eksakte rammene du lastet opp

Metode 2: Direkte filopplasting via ChatGPT-grensesnittet

ChatGPTs nett- og mobilapper aksepterer videoopplastinger direkte i chatten. Slipp en MP4- eller MOV-fil i inntastingsfeltet, så håndterer systemet rammeuttrekk og transkripsjon automatisk.

Hva som skjer internt:

- Tjenesten sampler rammer med intervaller (spesifikk rate er ikke dokumentert; estimert til 1–2 rammer per sekund basert på observert atferd)

- Lyd transkriberes via Whisper eller tilsvarende tjeneste

- Begge outputene sendes som separate kontekstinput til modellen

- Modellen genererer svar basert på synlige rammer og transkripsjonen

Denne metoden fungerer for:

- Høynivå videosammendrag der du ikke trenger ramme-nøyaktige detaljer

- Identifisering av nøkkelobjekter, personer eller miljøer som vedvarer over scener

- Uttrekk av talte innhold eller skjermtekst som forekommer i flere rammer

- Rask, utforskende analyse uten forprosessering

Denne metoden feiler for:

- Ramme-nøyaktig analyse — du kontrollerer ikke hvilke rammer som samles

- For lengre videoinnhold som overskrider modellens komfortable kontekstkapasitet kreves logisk segmentering. Uten strategisk oppdeling eller forprosessering kan modeller oppleve forringelse eller trunkering når token-bruket akselererer med høy tetthet av visuelle data

- Deteksjon av bevegelse, overganger eller tidsavhengig innhold som krever sammenligning av påfølgende rammer

- Scenarioer der kritisk visuell informasjon vises kort (1–2 sekunder) mellom samplinger

Hvis du trenger kontroll over hvilke øyeblikk som analyseres, bruk Metode 1.

Metode 3: YouTube-lenke + innhenting av transkripsjon

Noen ChatGPT-tillegg og tredjepartsverktøy hevder at de «analyserer YouTube-videoer». I realiteten henter de videoens offentlige metadata og transkripsjon (hvis tilgjengelig), og sender den teksten til ChatGPT.

Dette fungerer når:

- Videoen har autogenererte eller brukeropplastede undertekster

- Analysen din kun krever talte innhold, ikke visuell informasjon

- Videoen er offentlig tilgjengelig (ikke privat, ulistet eller regionbegrenset)

- Du oppsummerer forelesninger, podkaster eller intervjuer der lyden bærer mesteparten av meningen

Dette fungerer ikke når:

- Du må analysere visuelt innhold (skjermdemonstrasjoner, diagrammer, ansiktsuttrykk)

- Videoen mangler transkripsjon eller undertekster

- Kritisk informasjon vises visuelt uten å bli nevnt i dialog

- Du jobber med private videofiler eller innhold bak autentisering

Vanlig feil: Utviklere forventer full videoforståelse (visuelt + lyd), men får bare et transkript-sammendrag. Dette er fint for innholdsanalyse av talestoff. Det er ubrukelig for produktdemoreview, visuell designanalyse eller scenarier der det du ser er viktigere enn det som sies.

Mønsteret: Metode 2 for raske sammendrag der presisjon ikke er kritisk. Metode 1 for kontrollert analyse der du trenger bestemte rammer. Metode 3 for lydfokusert innhold der visuell informasjon er sekundær eller fraværende. Velg basert på hvor den kritiske informasjonen i brukstilfellet ditt ligger — i bevegelse, i spesifikke rammer eller kun i dialog.

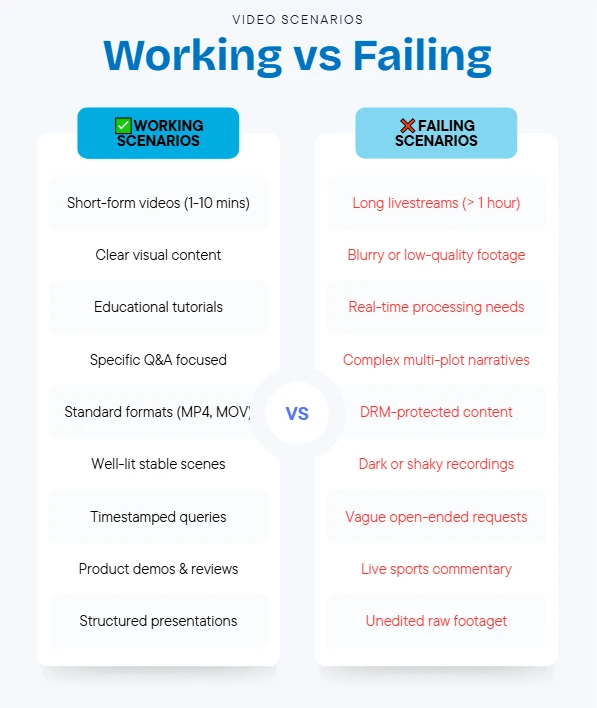

ChatGPT-video: bruksscenarier — hva som faktisk fungerer i produksjon

Å vite at ChatGPT kan prosessere videokomponenter, forteller ikke om det er riktig verktøy for problemet ditt. Disse scenariene viser hvor rammebasert analyse lykkes — og hvor arkitektoniske begrensninger knekker brukstilfellet.

Scenario 1: Oppsummering av læringsinnhold

Brukstilfelle: Du har en 10-minutters opplæringsvideo og trenger en strukturert oppsummering av hovedtrinn, nevnte verktøy og visuelle eksempler.

Hvorfor det fungerer: Læringsvideoer har ofte klare sceneskiller, vedvarende skjermtekst og fortellerstemme som samsvarer med visuelle elementer. Foreleseren beskriver det de viser mens det er synlig. ChatGPT kan transkribere forklaringen, identifisere verktøy eller diagrammer i utvalgte rammer og kombinere begge til en strukturert output.

Implementeringstilnærming: Last opp videoen via ChatGPT-grensesnittet eller trekk ut 8–12 nøkkelrammer ved større temaskifter. Prompt: «List opp hovedtrinnene som forklares i denne videoen, med referanse til både fortellingen og eventuell skjermtekst, diagrammer eller verktøynavn du ser.»

Hvor det bryter: Videoer som bygger på kontinuerlig bevegelse — som en kodescreencast der instruktøren skriver raskt i flere filer — vil ha manglende trinn mellom rammer. Du trenger høyere utvalgsfrekvens eller fokusere på lydtranskripsjonen alene.

Praktisk tips: For forelesninger og opplæring, kombiner automatisk opplasting (for transkripsjon) med manuelt uttrukne rammer av de 3–5 viktigste visuelle øyeblikkene. Dette gir både full dekning av lyd og bilder av høy kvalitet for nøkkelkonsepter.

Scenario 2: Analyse av produktdemo

Brukstilfelle: Du vurderer en konkurrents produktdemo og vil trekke ut UI-elementer, funksjonsnavn, brukerflyter og prisdetaljer som vises på skjermen.

Hvorfor det fungerer: Produktdemoer holder vanligvis hver skjerm lenge nok til at rammeutvalg fanger statisk UI. Tekstoverlegg, knappetiketter, menustrukturer og pristabeller er synlige over flere rammer. ChatGPTs visjonsevne kan lese og beskrive disse elementene selv om de ikke nevnes i fortellingen.

Implementeringstilnærming: Trekk ut rammer ved større sceneskift (introslide, funksjon 1-demo, funksjon 2-demo, prisskjerm, CTA). Last opp disse rammene og prompt: «For hver ramme, identifiser alle synlige UI-elementer, knappetiketter, funksjonsnavn og eventuell pris- eller produktinformasjon som vises.»

Hvor det bryter: Demoer med raske skjermoverganger, hovretilstander som kort avdekker informasjon, eller interaktive elementer som kun vises i 1–2 sekunder, blir ikke fanget av rammeutvalg. Hvis konkurrenten raskt blinker en funksjonssammenligningstabell, vil du gå glipp av den med mindre akkurat det øyeblikket ble utvalgt.

Praktisk tips: Skru gjennom videoen manuelt først for å identifisere tidsstempler for viktige avsløringer. Trekk ut rammer på disse tidspunktene i stedet for å stole på automatiske utvalgsintervaller.

Scenario 3: Møte- eller intervjutranskripsjon med visuell kontekst

Brukstilfelle: Du tok opp en kundesamtale og trenger både transkripsjon og annotasjoner for når spesifikke dokumenter, slides eller skjermdelinger dukket opp.

Hvorfor det fungerer: Lydtranskripsjon håndterer tale. Når deltakerne deler skjerm eller holder opp dokumenter, vises disse i utvalgte rammer. ChatGPT kan annotere «omtrent ved [timestamp] var et kontraktsdokument synlig på skjermen» sammen med transkripsjonen — nyttig for møtereferater som refererer til visuelt materiale.

Implementeringstilnærming: Last opp videoen og prompt: «Transkriber dette møtet og noter øyeblikk der dokumenter, presentasjonsbilder, skjermdeling eller andre visuelle referanser dukket opp. Beskriv hva som ble vist for hvert visuelt element.»

Hvor det bryter: Korte skjermdelinger (under 5–10 sekunder) kan falle mellom utvalgte rammer. Tekst som er for liten til å lese i komprimerte rammer kan ikke ekstrakteres. For juridiske etterlevelsesbehov som krever verbatim nøyaktighet av viste dokumenter, verifiser bildekvalitet og utvalgsdekning før du stoler på output.

Praktisk tips: For viktige møter, ta opp i høyere oppløsning og trekk ut rammer manuelt når noen sier «la meg vise dere dette dokumentet» — et signal om at en visuell referanse er i ferd med å komme.

Scenario 4: Innholdsmoderering eller compliance-gjennomgang

Brukstilfelle: Du må skanne brukeropplastede videoer for forbudt innhold — spesifikke logoer, tekstmønstre eller visuelle elementer som bryter plattformregler.

Hvorfor det fungerer: ChatGPT kan skanne rammer for synlig tekst, gjenkjennelige objekter eller beskrevne scener. Hvis du sjekker «viser noen av disse videoene en konkurrents logo», vil rammebasert analyse oppdage logoer som står på skjermen i mer enn et sekund eller to.

Implementeringstilnærming: Trekk ut rammer med jevne intervaller (hvert 3.–5. sekund), last dem opp, og prompt: «Gå gjennom disse rammene og identifiser eventuelle som inneholder [spesifikk logo, merkenavn, forbudt symbol osv.]. Beskriv hvor i rammen det vises for hver treff.»

Hvor det bryter: Lydrelaterte brudd (opphavsrettsbeskyttet musikk, forbudt tale) krever separat lydanalyse. Bevegelsesbaserte brudd (forbudte gester, handlinger over flere rammer) vil ikke fanges av stillbilder. Kort viste forbudte elementer kan falle mellom utvalgte rammer.

Praktisk tips: Kombiner ChatGPTs visuelle skanning med dedikerte lydfingeravtrykkstjenester og høyere utvalgsfrekvens for høyrisiko-kategorier. Bruk ChatGPT som førstelinjefilter, ikke som eneste modereringslag.

Mønsteret i vellykkede scenarier: meningsfullt innhold finnes i diskrete, stabile rammer og korrelerer med lyd eller tekst. Feil oppstår når kritisk informasjon ligger i bevegelse, timing, overganger eller vises for kort til å bli pålitelig utvalgt.

Gemini vs. Claude vs. ChatGPT: videokapasiteter

Hvis ChatGPTs ramme-samplingsarkitektur ikke passer, vurderer du alternativer. Gemini og Claude har ulike video-relaterte evner — og disse forskjellene avgjør hvilken modell som passer din implementering.

Geminis innebygde videobehandling

Gemini-modeller støtter innebygd videoinput på API-nivå. Du sender en videofil direkte uten å forprosessere til rammer. Modellen prosesserer video som en kontinuerlig strøm, muliggjør bevegelsessporing, sceneskift-deteksjon og temporær resonnering som ChatGPTs rammebaserte tilnærming ikke håndterer.

Eksempel på brukstilfelle der Gemini vinner:

Du må detektere når et spesifikt objekt kommer inn og ut av bildet i et klipp på 30 sekunder, eller spore hvordan en person beveger seg i en scene. Gemini kan følge objekter over rammer og resonnere om bevegelse. ChatGPT vil bare se objektet i de rammene som tilfeldigvis ble samplert — og kan gå glipp av inn- eller utgangen.

Avveiinger:

- Geminis native API er mer kostnadseffektivt enn OpenAIs rammebaserte sampling. Ved å unngå lineær token-overhead via kontekstcaching skalerer Gemini bedre for langformanalyse.

- Prosessering av lengre videoer gir høyere latenstid — modellen må innta hele filen før respons

- Ikke alle Gemini-varianter støtter videoinput; krever nyere Gemini-modeller

- Videolengdebegrensninger finnes, men er mer romslige enn ChatGPTs kontekstbaserte begrensninger

Når du bør velge Gemini over ChatGPT:

- Brukstilfellet krever bevegelsessporing, scenebundet deteksjon eller forståelse av temporære relasjoner

- Kritisk informasjon dukker raskt opp og forsvinner mellom rammer

- Du analyserer videoer der hendelsesforløp er viktig (sportsopptak, overvåkingsgjennomgang, animasjonsanalyse)

- Du vil unngå manuell uttrekk av rammer i forprosesseringen

Claudes nåværende videobegrensninger

Per tidlig 2026 støtter Claude-modeller ikke direkte videoinput via API. Du kan laste opp bilder (inkludert manuelt uttrukne videorammesekvenser), men det finnes ingen innebygd videoprosessering sammenlignbar med Gemini.

Hva Claude kan gjøre:

- Analysere sekvenser av opplastede rammer, lik ChatGPTs manuelle uttrekksmetode (Metode 2)

- Gi detaljerte beskrivelser av visuelt innhold i hver ramme

- Resonnere om implisert bevegelse eller endringer mellom rammer hvis det promptes eksplisitt

- Håndtere lengre bildesekvenser takket være større kontekstvindu (opptil 1M tokens i Claude Opus 4.7)

Hva Claude ikke kan gjøre:

- Akseptere videofiler direkte via noe grensesnitt

- Automatisk spore bevegelse eller objekter over tid uten eksplisitt ramme-for-ramme-oppfordring

- Transkribere lyd — krever separat forprosessering med Whisper eller tilsvarende, deretter sende transkriptet til Claude

Når du likevel velger Claude:

- Arbeidsflyten din inkluderer allerede uttrekk av rammer som forprosessering

- Du analyserer lange videoer som krever mange rammer og trenger Claudes store kontekstvindu

- Du sammenligner visuell analyse og opplever at Claudes rammebeskrivelser er mer nøyaktige for ditt domene (f.eks. medisinsk bildediagnostikk, tekniske diagrammer)

- Du må kombinere videoramme-analyse med store mengder annen kontekstinformasjon

Sammenligning av kapasiteter

| Funksjon | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Direkte opplasting av videofil | ✓ (web/app-grensesnitt) | ✓ (API + webgrensesnitt) | ✗ |

| Innebygd bevegelsessporing | ✗ | ✓ | ✗ |

| Lydtranskripsjon | ✓ (Whisper-integrasjon) | ✓ (integrert) | ✗ (krever eksternt verktøy) |

| Rammebasert analyse | ✓ | ✓ (også kontinuerlig prosessering) | ✓ (kun manuelt uttrekk) |

| Sceneskift-deteksjon | ✗ (kun manuelt) | ✓ (automatisk) | ✗ |

| Typisk håndtert videolengde | ~5–10 min (kontekstbegrenset) | ~1 time (avhengig av oppløsning) | N/A (antall rammer begrenset av kontekst) |

| Beste brukstilfelle | Raske sammendrag, rammeanalyse med noe kontroll | Bevegelsessporing, temporær resonnering, kontinuerlig video | Dyp ramme-for-ramme-beskrivelse med stort kontekstbehov |

| API-støtte for video | ✗ (kun bilder) | ✓ | ✗ |

Beslutningsramme:

- Velg ChatGPT når: Du trenger raske videosammendrag, den kritiske informasjonen vedvarer over flere rammer, du jobber med korte klipp (under 10 minutter), og du trenger ikke bevegelsessporing. Best for læringsinnhold, statiske produktdemoer, møtetranskripsjon.

- Velg Gemini når: Brukstilfellet krever bevegelsessporing, sceneskift-deteksjon eller temporær resonnering om hvordan elementer beveger seg eller endres over tid. Kritisk for overvåkningsopptak, sportsanalyse, animasjonsreview, eller scenarioer der «hva som skjer mellom rammene» betyr noe.

- Velg Claude når: Du allerede trekker ut rammer i pipelinen, må analysere mange rammer med omfattende ekstra kontekst, eller opplever at Claudes visuelle beskrivelser er mer nøyaktige for ditt domene. Krever mest forprosessering, men tilbyr det største kontekstvinduet.

For utviklere som jobber på tvers av flere modeller, tilbyr CometAPI et samlet grensesnitt for å teste videoprosesseringskvalitet på tvers av GPT-, Gemini- og Claude-varianter uten å skrive om integrasjonskode — nyttig når du sammenligner outputkvalitet før du låser deg til én leverandør.

Det ekte svaret på «kan ChatGPT se videoer» er ikke binært. Det er «ja, ved å konvertere video til formater den allerede håndterer — med begrensninger som bryter konkrete brukstilfeller». De fleste implementeringsfeil skyldes arkitektoniske misforhold, ikke kapabilitetsmangler. Modellen fungerer akkurat som designet; utviklere forventet bare et annet design.

Hvis du bygger videoanalysefunksjoner i skala, test arbeidsflyten med edge cases først: last opp samme video via direkte fil, manuelt uttrukne rammer og kun transkript. Sammenlign outputene. Metoden som fanger opp det kritiske signalet i brukstilfellet — ikke den som er raskest å implementere — er den som overlever produksjonstrafikk.

Før du forplikter deg til ChatGPT for video:

- Finn ut om den kritiske informasjonen din finnes i stabile rammer, bevegelse eller lyd

- Test dekning av rammeutvalg ved å trekke ut rammer manuelt med forventede intervaller

- Verifiser at skjermtekst er lesbar ved videooppløsningen etter komprimering

- Bekreft at videolengden passer innenfor praktiske kontekstgrenser for abonnementet ditt

- Ha en fallback for innhold som vises kort eller mellom utvalgte rammer

For utviklere som vurderer flere AI-leverandører for videobelastninger, tilbyr CometAPI en samlet sandkasse for å teste ChatGPT, Gemini og Claude med samme videoinput — slik at du kan sammenligne kvalitet, latenstid og kostnad før du bygger leverandørspesifikke integrasjoner.

FAQ – guide til AI-videoanalyse

Kjappe svar på vanlige spørsmål om AI-videoanalyse.

Kan ChatGPT analysere videoer?

Ja, ChatGPT (GPT-4o og nyere) kan analysere videoer ved å sample rammer (~1 per sekund) og transkribere lyd. Det fungerer godt for møtesammendrag, uttrekk av tekst fra slides og identifisering av objekter. Det sliter imidlertid med bevegelsessporing, videoer over 10 minutter og sanntidsstrømming.

Hvordan laster jeg opp videoer til ChatGPT?

Direkte URL-opplasting (anbefalt): Last opp via en offentlig URL for rask analyse. Best for videoer under 10 minutter.

Manuelt uttrekk av enkeltbilder: Trekk ut spesifikke rammer for presis kontroll. Best når du må analysere bestemte øyeblikk eller redusere token-kostnader.

Hva er maksimal videolengde ChatGPT kan håndtere?

ChatGPT håndterer pålitelig videoer opp til 5–10 minutter. Utover det må du segmentere videoen eller bytte til Gemini 2.5 Pro, som støtter videoer opptil 60 minutter nativt.

Hva er begrensningene i ChatGPTs videoanalyse?

- Kan ikke spore kontinuerlig bevegelse (sport, dans)

- Upresise tidsstempler (±1 sekunds nøyaktighet)

- Går glipp av innhold som vises i mindre enn 1 sekund

- Praktisk grense på 10 minutter

- Ingen støtte for sanntidsstrømming

- Sliter med lavkvalitets- eller mørke videoer

- Svak på tidsmessig årsak–virkning-resonnering *

Bør jeg bruke ChatGPT eller Gemini til videoanalyse?

Bruk ChatGPT for:

- Videoer under 10 minutter

- Overlegen tekstresonnering etter videoanalyse

- Rammenivå-analyse (slides, skjermbilder)

Bruk Gemini for:

- Videoer på 10–60 minutter

- Bevegelsessporing og bevegelsesanalyse

- Temporær resonnering

- Sport, dans eller overvåkningsopptak *

Kan Claude analysere videoer?

Nei, Claude støtter ikke direkte videoinput. Men du kan trekke ut rammer fra videoer og analysere dem med Claude, som tilbyr overlegen tekstresonnering og kontekstvindu for lange analyser.

Hvor mye koster videoanalyse?

Kostnader varierer etter modell og videolengde:

- ChatGPT 4o: ~$0,05 per minutt

- Gemini 2.5 Pro: ~$0,04 per minutt

CometAPI tilbyr kreditt for nye brukere for å komme i gang.