Claude Opus 4.7, lansert 16. april 2026, er en betydelig oppgradering over Opus 4.6 innen koding, agentbaserte arbeidsflyter, visjon og instruksjonsetterlevelse. Den scorer +6.8pp på SWE-bench Verified (87.6% vs 80.8%), +10.9pp på SWE-bench Pro (64.3% vs 53.4%), +12pp på CursorBench (70% vs 58%), og leverer 3,3× høyere oppløsningsvisjon med selv-verifiseringssløyfer som reduserer hallusinasjoner på lange oppgaver. Prisingen forblir identisk offisielt ($5/$25 per million tokens), men lav-innsats 4.7 matcher kvaliteten til mellom-innsats 4.6, noe som kutter reelle kostnader.

På CometAPI får du begge modellene (Claude Opus 4.7 og Opus 4.6) til $4 input / $20 output med OpenAI-kompatible endepunkter og null leverandørlåsing. Oppgrader hvis du kjører produksjonskodingsagenter, kompleks dokumentanalyse eller flerøkt-arbeidsflyter—4.7 er den nye standarden for banebrytende arbeid.

Claude Opus 4.7 vs Opus 4.6: Hurtig sammenligning

Konklusjon: Opus 4.7 føles som “Opus 4.6, men ustrupet og forfinet.” Den fjerner begrensninger som av og til dukket opp i 4.6 (f.eks. for tidlig avbrutte oppgaver, lavere visuell skarphet) og legger til effektivitet gjennom adaptiv resonnering. Brukere rapporterer at den er mer “meningsbærende” og samarbeidsvillig—som å jobbe med en senioringeniør som dobbeltsjekker sitt eget arbeid.

Hvorfor Claude Opus 4.7 betyr noe i 2026

- april 2026 lanserte Anthropic stille sin hittil mest kapable generelt tilgjengelige modell: Claude Opus 4.7. Bare uker etter den begrensede Mythos Preview (en kyber-fokusert kraftpakke), gjenvinner Opus 4.7 kronen for produksjonsarbeidslaster, samtidig som prisen er nøyaktig den samme som for Opus 4.6.

Utviklere og virksomheter trenger ikke lenger barnevakte de vanskeligste kodeoppgavene. Brukere rapporterer at de overlater “den typen som tidligere trengte tett oppfølging” til 4.7 med selvtillit. Modellen selv-verifiserer utdata, følger instruksjoner bokstavelig og opprettholder fler-timers agentbaserte kjøringer med færre verktøyfeil og bedre feilretting.

Modellen utmerker seg i:

- Strenge langvarige oppgaver med innebygd selv-verifisering (Planlegg → Utfør → Verifiser → Rapporter).

- Bokstavelig instruksjonsetterlevelse—ikke mer løs tolkning av “consider” eller “you might.”

- Betydelig bedre visjon (opptil 2,576 px lang kant ≈ 3,75 MP, mer enn 3× tidligere oppløsning).

- Høyere estetisk sans og kreativitet i profesjonelle leveranser som grensesnitt, lysbilder og dokumenter.

- Forbedret filsystem-minne for ekte flerøkt-autonomi.

Nye funksjoner inkluderer et xhigh-innsatsnivå (mellom high og max), oppgavebudsjetter på Platform API, og integrasjon med Claude Design-verktøy. Modell-ID er nå claude-opus-4-7. Prisingen er uendret offisielt, men forbedret tokeneffektivitet reduserer ofte effektiv kostnad per oppgave.

Kjerneforbedringer – Hva som faktisk endret seg

Avansert programvareutvikling og agentbasert koding

Opus 4.7 skinner på de vanskeligste problemene. På en intern kodebenchmark med 93 oppgaver oppnådde den en 13% løft over 4.6, og løste fire oppgaver verken 4.6 eller Sonnet 4.6 klarte. Rakuten-SWE-Bench viste 3× flere produksjonsklare oppgaver løst uten menneskelig inngripen. CursorBench (reelle IDE-arbeidsflyter) hoppet +12 poeng til 70%.

Intern 93-oppgave kodebenchmark viste et 13% løft, og løste fire oppgaver verken 4.6 eller Sonnet 4.6 klarte. I agentbaserte arbeidsflyter rapporterte Box 2× færre LLM-kall (7.1 vs 16.3) og 30% lavere AI-enhetsbruk for samme output—som gir direkte gevinst i kostnad og latens.

Hvorfor det betyr noe for utviklere: Du kan nå stole på at Opus 4.7 håndterer “det vanskeligste kodearbeidet” som tidligere trengte oppsyn. Den følger instruksjoner presist, verifiserer egne utdata, og gjenbruker filsystem-minne på tvers av økter—perfekt for autonom refaktorering over flere dager.

Reelle gevinster inkluderer:

- Autonom Rust-tekst-til-tale-motor fra én prompt.

- Fikset race conditions og samtidighetsfeil som stoppet tidligere modeller på Terminal-Bench 2.0 (+4.0 pp).

- 10–15% økning i Factory Droids-oppgavesuksess med ⅓ færre verktøyfeil.

- Tosifrede forbedringer i kodekvalitet, testkvalitet og review-nøyaktighet (CodeRabbit, Qodo).

Lav innsats i 4.7 matcher nå kvaliteten til mellom-innsats i 4.6, så du får mer gjort for samme (eller lavere) tokenforbruk.

Visjon og multimodal sprang

Dette er den største enkeloppgraderingen. Maksimal bildeoppløsning hopper fra 1,15 MP (1568 px) til 3,75 MP (2576 px på langkanten) — en 3,3× økning i piksler med 1:1-koordinatkartlegging. Ikke mer skalafaktorregning for skjermbilder eller diagrammer.

Resultater:

- Synsskarphetsbenchmark: 98.5% vs 54.5% på 4.6.

- CharXiv-R (uten verktøy): +13.4 pp; med verktøy: +13.6 pp.

- Låser opp piksel-presise databruksagenter, tett skjermbildeanalyse, kjemisk-struktur-parsing og UI/UX-designreview.

Agentbaserte arbeidsflyter, pålitelighet og instruksjonsetterlevelse

Opus 4.7 introduserer innebygd selv-verifisering—modellen planlegger, utfører, verifiserer og rapporterer. Dette reduserer dramatisk skråsikre, men feilaktige svar på langhorisont-oppgaver. Forbedringer i filsystem-minne muliggjør ekte fler-dagers autonomi.

Instruksjonsetterlevelsen er strengere og mer bokstavelig. Prompter justert for 4.6s løsere stil kan trenge revisjon—fraser som “consider” behandles nå som harde krav. Dette er en fordel for presisjonskritisk arbeid, men krever promptmigrering.

Merk om regresjoner: Needle-retrieval i lang kontekst (MRCR) falt merkbart (f.eks. 91.9% → 59.2% ved 256K). Anthropic opplyser at de faser ut slike syntetiske tester til fordel for anvendte GraphWalks-metrikker, der reell kodeforståelse forblir sterk.

Nytt xhigh-innsatsnivå + oppgavebudsjetter

Opus 4.7 legger til xhigh mellom high og max for finjustert kontroll. Claude Code bruker nå xhigh som standard på tvers av planer. Den nye task_budget (public beta) lar modellen spore totaltokens gjennom en hel agentisk sløyfe og avslutte pent.

Instruksjonsetterlevelse, selv-verifisering og minne

Opus 4.7 tolker prompter mer bokstavelig — flott for presisjon, men gamle, uklare prompter kan trenge innstramming. Den utleder nå egne verifiseringssteg (Planlegg → Utfør → Verifiser → Rapporter) og gjenbruker filsystem-minne på tvers av flerøktsarbeid langt bedre enn 4.6. For team som bygger vedvarende agenter, er dette en av de mest nyttige oppgraderingene fordi det reduserer re-forklaring, re-innlasting og re-planlegging.

Tokenizer-oppdatering

Ny tokenizer forbedrer kvaliteten, men kan bruke 1,0–1,35× flere tokens (opptil +35%). Token-telle-endepunktet returnerer nå andre tall. Nettoeffekt: høyere kvalitet per oppgave oppveier ofte økningen, særlig på lavere innsatsnivåer.

Sikkerhet, tilpasning og cybersikkerhet

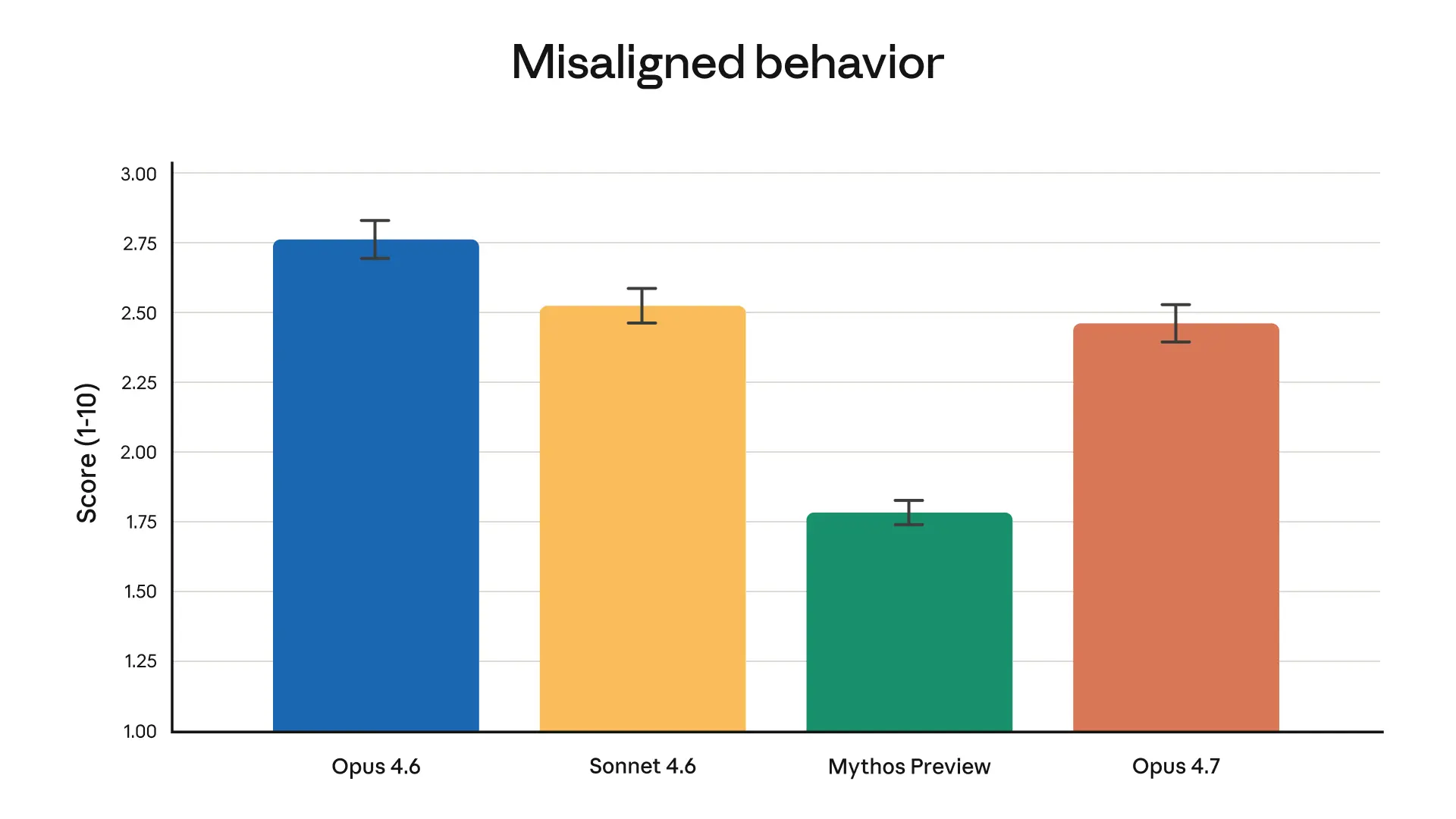

Sikkerhetsprofilen ligner 4.6 (lav feiltilpasning), med moderate forbedringer i ærlighet og motstand mot prompt-injeksjon.

Opus 4.7 leveres med Project Glasswing-vern: sanntidsblokkering av forbudt/høyrisiko kyberbruk. CyberGym-score bevisst flat. Feiltilpasset atferd moderat forbedret over 4.6. Fullt systemkort tilgjengelig på Anthropics nettsted.

Prising, tokeneffektivitet og CometAPI-besparelser

Offisiell prising er identisk, men effektiv kostnad per oppgave faller fordi lav-innsats 4.7 ≈ mellom-innsats 4.6-kvalitet, og høyere suksessrater betyr færre forsøk. Den nye tokenizer-en øker input-tokens 0–35% for identisk tekst, men nettoforbruk er ofte gunstig ved matchet kvalitet.

CometAPI-fordel: Få tilgang til begge modellene for $4 input / $20 output per million tokens—20% billigere enn offisielt—pluss sømløs veksling mellom 500+ modeller (GPT-5.4, Gemini 3.1, etc.) via ett OpenAI-kompatibelt eller Anthropic Messages-endepunkt. Ingen nedetid om leverandører endrer prising. Null leverandørlåsing. Playground-testing og samlet fakturering gjør migrering enkel.

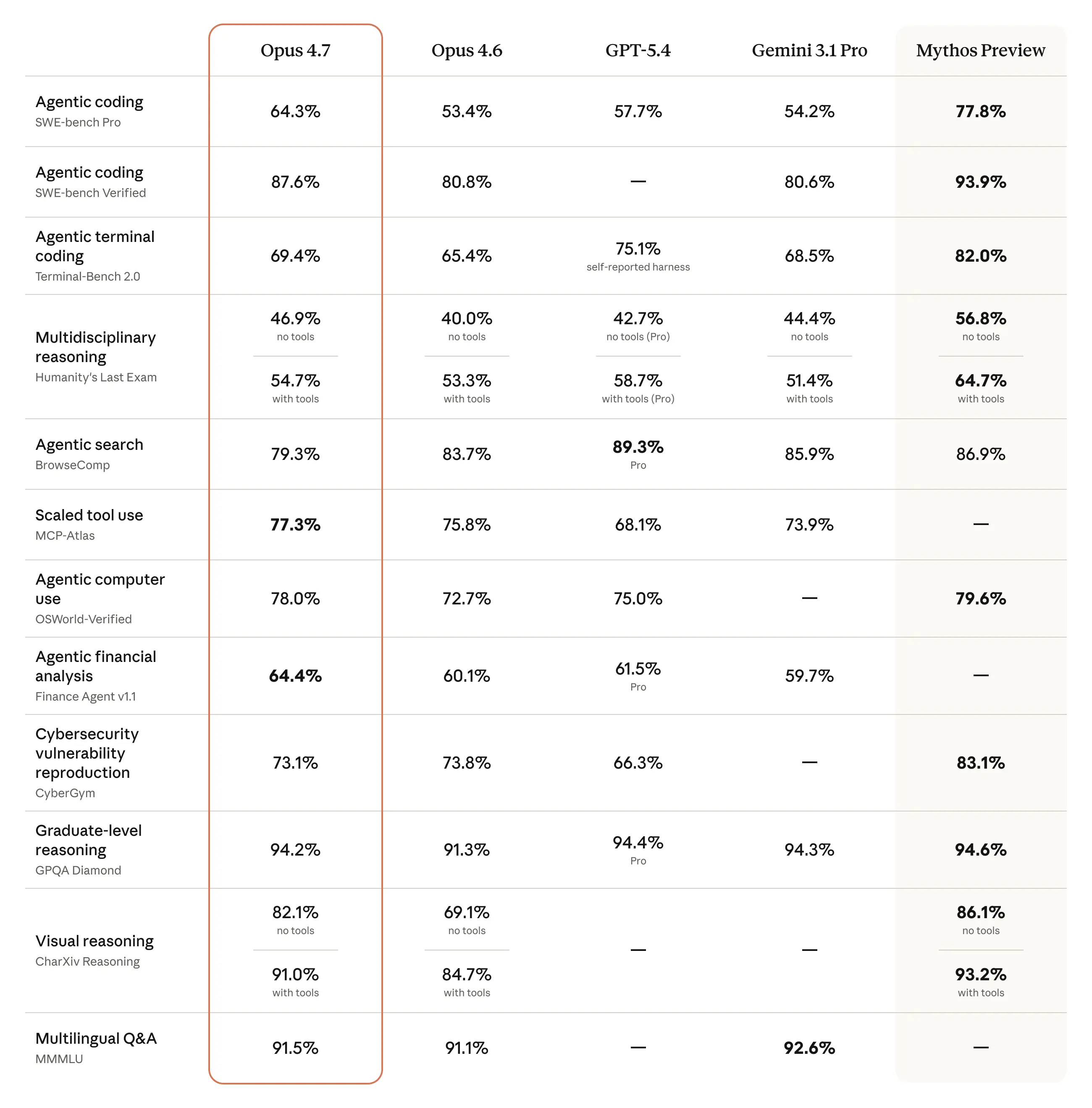

Dypdykk: Benchmark side om side

Her er den komplette 14-benchmark head-to-head fra Anthropics lanseringsdata (verifisert av partnere):

Kodebenchmarks

- SWE-bench Verified: 80.8% → 87.6% (+6.8 pp)

- SWE-bench Pro: 53.4% → 64.3% (+10.9 pp)

- Terminal-Bench 2.0: 65.4% → 69.4% (+4.0 pp)

Agentikk og verktøybruk

- MCP-Atlas: 62.7% → 77.3% (+14.6 pp) — største enkeltløft

- OSWorld-Verified: 72.7% → 78.0% (+5.3 pp)

- Finance Agent: 60.7% → 64.4% (+3.7 pp)

Resonnering og kunnskap

- GPQA Diamond: 91.3% → 94.2% (+2.9 pp)

- HLE (ingen verktøy): 40.0% → 46.9% (+6.9 pp)

- MMMLU: 91.1% → 91.5% (+0.4 pp)

Visjon

- CharXiv-R (uten verktøy): 68.7% → 82.1% (+13.4 pp)

- CharXiv-R (verktøy): 77.4% → 91.0% (+13.6 pp)

Regresjoner (åpne)

- BrowseComp: 84.0% → 79.3% (–4.7 pp) — følsom for måleramme

- CyberGym: 73.8% → 73.1% (–0.7 pp) — med hensikt for sikkerhet

Intern research-agent benchmark: 0.715 totalt (delt toppscore), med Finance-modul fra 0.767 til 0.813.

Reell ytelse og bruksområder

Box’ tester av agentiske arbeidsflyter viste at Opus 4.7 fullførte oppgaver med 7.1 LLM-kall vs 16.3 for 4.6 (2,3× færre) og 30% lavere AI Unit-bruk. Latens falt fra 242 s til 183 s median.

Enterprise-partnere (Harvey, Databricks, Hebbia, Ramp, Genspark) rapporterer:

- 21% færre feil i dokumentresonnering.

- Bedre multi-agent koordinering over timer.

- Tettere integrasjon av lysbilder, regneark og kode.

Hvem bør oppgradere umiddelbart?

- Programvareteam som bruker Cursor/Claude Code.

- Agentbyggere som trenger pålitelig autonomi over lang horisont.

- Visjonstunge arbeidsflyter (skjermbilder, diagrammer, UI-gjennomgang).

- Finans, juss og automatisering av kunnskapsarbeid.

API-endringer, migreringsguide og kodeeksempler

Bakoverinkompatible endringer (Messages API)

- Utvidede tenkebudsjetter fjernet → bruk

thinking: {"type": "adaptive"}. - Sampling-parametere (

temperature, etc.) aksepteres ikke lenger → bruk prompting. - Tankeinnhold utelates som standard.

- Ny tokenizer krever slingringsmonn i

max_tokens.

Migreringsguide + kodeeksempler (CometAPI)

Steg 1: Oppdater modellnavn til claude-opus-4-7 (eller CometAPI-alias).

Steg 2: Revider prompter for bokstavelig tolkning.

Steg 3: Test innsatsnivåer (start med xhigh for koding).

Steg 4: Bruk oppgavebudsjetter for å begrense forbruk.

Her er et kjørbart Python-eksempel som bruker CometAPIs Anthropic-kompatible endepunkt (fungerer også med offisiell SDK):

(Python)

import anthropic

import os

client = anthropic.Anthropic(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI sk- key

base_url="https://www.cometapi.com/console/" # CometAPI base

)

message = client.messages.create(

model="claude-opus-4-7", # or "claude-opus-4-6" for comparison

max_tokens=4096,

temperature=0.7,

effort="xhigh", # New level for deep reasoning

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Refactor this legacy Python module into clean, type-hinted, testable code. Follow instructions literally: use Pydantic v2, add comprehensive tests, no external deps beyond stdlib + pydantic. Verify your changes before responding."},

{"type": "image", "source": {"type": "base64", "media_type": "image/png", "data": "iVBORw0KGgoAAAANSUhEUg..."} } # High-res screenshot support

]

}

]

)

print(message.content[0].text)

Selv-verifiseringsdemoprompt (fungerer langt bedre på 4.7):

(tekst):

Plan → Execute → Verify → Report:

1. Analyze the attached codebase.

2. Propose refactors.

3. Implement changes in a new file.

4. Run mental unit tests and edge cases.

5. Only output final verified code if all checks pass.

Kjør A/B-tester på dine egne arbeidslaster—de fleste team ser 20–40% færre iterasjoner.

Merk:

For det første genererer den nye tokenizer-en flere tokens fra samme tekst. Opus 4.7 introduserte en ny tokenizer som forbedrer hvordan modellen prosesserer tekst. Avveiningen er at samme input vil mappe til flere tokens; eksakt antall avhenger av innholdstype, men er grovt mellom 1,0 og 1,35 ganger.

For det andre tillater høyere innsatsnivåer mer omfattende vurdering, spesielt i flerturns agent-scenarier.

Dette gir bedre pålitelighet, men også flere output-tokens.

Den offisielle løsningen gir tre tilnærminger:

- Justere innsatsnivå ved å bruke

efficiency-parameteren - Begrense budsjettet med oppgavebudsjetter

- Fortelle modellen å "være mer konsis" i prompten.

Kjente begrensninger og migrasjonsnotater

- Utvidede tenkebudsjetter fjernet → bruk

thinking: {"type": "adaptive"}.thinking: {type: "enabled", budget_tokens: N}støttes ikke lenger; bruk adaptiv tenking i stedet. - Sampling-parametere (

temperature, etc.) aksepteres ikke lenger → bruk prompting.temperature,top_pogtop_kbør fjernes fra forespørsler ved migrering til Opus 4.7. - Modellen beskrives som mer bokstavelig og mer direkte enn Opus 4.6, noe som er nyttig for presisjon, men kan kreve skarpere prompter.

- Ny tokenizer krever slingringsmonn i

max_tokens. Anthropic anbefaler å sjekkemax_tokens-marginen på nytt fordi Opus 4.7 kan produsere høyere tokenantall for samme tekst. - Tankeinnhold utelates som standard.

Endelig dom og anbefaling

Claude Opus 4.7 er den klare vinneren for enhver seriøs kode-, agent- eller visjonsarbeidslast i 2026. Gevinstene er ikke inkrementelle — de er produksjonstransformerende. Hvis du er på Opus 4.6, migrer denne uken. Kombinasjonen av høyere kvalitet, færre kall og identisk (eller lavere via CometAPI) prising gjør det til en selvfølge.

Tiltak:

- Test 4.7 i CometAPIs playground med dine reelle arbeidslaster.

- Oppdater én tjeneste først (Cursor eller agentrammeverket ditt).

- Overvåk tokenbruk den første uken.

- Skaler trygt i visshet om at du har enhetlig, rimeligere tilgang på tvers av 500+ modeller.