DeepSeek har offisielt forhåndsvist V4 som en åpen kildekode-modellfamilie, og overskriften er ikke bare «nok en modelloppdatering». Selskapet posisjonerer V4 som et system med lang kontekst, agent-vennlig og bygget for reelle arbeidsbelastninger: dokumenttung analyse, kodeassistenter, søkeagenter og flertrinns automatisering. Utgivelsen er live på web, app og API, og V4-serien introduserer et kostnadseffektivt kontekstvindu på 1M tokens på tvers av de offisielle tjenestene.

Det som gjør lanseringen spesielt bemerkelsesverdig, er kombinasjonen av skala og effektivitet. DeepSeek sier at V4-Pro har 1,6T totale parametre med 49B aktive, mens V4-Flash har 284B totale parametre med 13B aktive. I den tekniske rapporten hevder DeepSeek også at V4-arkitekturen bruker hybrid oppmerksomhet, MoE-ruting og ettertrening utformet for å forbedre agentatferd samtidig som beregningsbyrden for ultralang kontekst reduseres.

Hva er DeepSeek V4?

DeepSeek-V4 er selskapets nyeste forhåndsviste flaggskipsfamilie, og utgivelsen inkluderer to offentlige varianter: V4-Pro og V4-Flash. DeepSeek beskriver V4-Pro som den sterkere modellen for verdenkunnskap, matematikk, STEM, koding og agentisk koding, mens V4-Flash er det mer responsive, kostnadseffektive alternativet som likevel beholder mye av resonneringskvaliteten og langkontekst-evnen. V4-Pro leder nåværende åpne modeller innen agentisk koding og verdenkunnskap, mens V4-Flash er designet for hastighet og økonomisk utrulling.

V4 bruker en hybrid oppmerksomhetsarkitektur som kombinerer Compressed Sparse Attention (CSA) og Heavily Compressed Attention (HCA), pluss Manifold-Constrained Hyper-Connections og Muon optimizer. Selskapet sier også at modellene ble forhåndstrent på mer enn 32T tokens, og at V4-Pro ved 1M kontekst kun trenger 27% av FLOPs for enkelt-token-inferens og 10% av KV-cachen sammenlignet med DeepSeek-V3.2. Den effektiviteten er den egentlige overskriften bak lanseringen.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro er flaggskipmodellen for brukere som bryr seg mest om kvalitet. DeepSeek-V4-Pro leverer sterkere agentisk kodeytelse, rikere verdenkunnskap og resonnering i verdensklasse, og den leder nåværende åpne modeller, mens den kun ligger etter Gemini-3.1-Pro i verdenkunnskap ifølge lanseringssiden. I den tekniske rapporten er V4-Pro den større modellen i familien, og DeepSeek-V4-Pro er tilgjengelig gjennom de samme OpenAI-kompatible og Anthropic-kompatible grensesnittene som V4-Flash.

DeepSeek-V4-Flash

V4-Flash er effektivitet først-modellen; dens resonneringsevner nærmer seg V4-Pro, og den yter på nivå med V4-Pro på enkle agentoppgaver, samtidig som den bruker et mindre parameteravtrykk og har raskere responstider. Den støtter både tenkende og ikke-tenkende moduser, med samme 1M kontekstlengde og de samme kjernefunksjonene som Pro, men til langt lavere kostnad.

Hvilken bør du velge?

Bruk V4-Pro når oppgaven er høyrisiko, kunnskapstung eller vanskelig å verifisere: virksomhetsforskning, kompleks koding, flertrinns beslutningsstøtte eller oppgaver der du vil ha det sterkeste mulige svaret. Bruk V4-Flash når gjennomstrømming, latens eller token-kostnad betyr mer enn å presse ut de siste poengene på benchmarks. Det valget er konsistent med den offisielle posisjoneringen og de rapporterte benchmark-forskjellene mellom de to modellene.

| Element | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Totalt antall parametre | 284B | 1.6T |

| Aktive parametre | 13B | 49B |

| Kontekstlengde | 1M | 1M |

| Resonnement-moduser | Non-think + think | Non-think + think |

| Best egnet | Rask inferens, høy-gjennomstrømmingsapper, kostnadssensitive agenter | Høyest kapable resonnering, vanskeligere kode- og kunnskapsoppgaver |

| Offisielle API-priser | Cache-treff $0.028 / cache-bom $0.14 / utdata $0.28 per 1M tokens | Cache-treff $0.145 / cache-bom $1.74 / utdata $3.48 per 1M tokens |

| Maks utdata | 384K | 384K |

CometAPI gir tilgang til Deepseek v4 Pro og V4 Flash,—20% billigere enn offisielt—pluss sømløs bytting mellom 500+ modeller (GPT-5.4, Gemini 3.1, osv.) via ett OpenAI-kompatibelt eller Anthropic Messages-endepunkt.

Ytelsesbenchmark

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

I grunnmodell-sammenligningstabellen overgår både V4-Flash og V4-Pro DeepSeek-V3.2 på tvers av kjerne-benchmarks, med V4-Pro som oftest i tet. For eksempel lister rapporten følgende poeng: AGIEval 82.6 / 83.1 mot V3.2s 80.1; MMLU 88.7 / 90.1 mot 87.8; MMLU-Pro 68.3 / 73.5 mot 65.5; HumanEval 69.5 / 76.8 mot 62.8; og LongBench-V2 44.7 / 51.5 mot 40.2 for V3.2, der det midterste tallet er V4-Flash og det siste er V4-Pro.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Kilde: DeepSeek-V4 teknisk rapport, Tabell 1.

Mønsteret er enkelt: Flash snevrer inn gapet til Pro, men Pro er fortsatt den sterkere generelle modellen. Det gjør V4-Flash til det praktiske standardvalget for mange produksjonssystemer, mens V4-Pro er modellen å velge når svarkvalitet er viktigere enn kostnad eller latens.

Vestlige modell-sammenligninger: hvor V4 passer inn

I én menneskelig evaluering av kinesiske kontoroppgaver sier rapporten at DeepSeek-V4-Pro-Max overgikk Claude Opus 4.6-Max, med en 63% ikke-tap-andel. DeepSeek-V4-Pro «overgår betydelig» Claude Sonnet 4.5 og nærmer seg Claude Opus 4.5 på en FoU-kodebenchmark.

| Evalueringsområde | DeepSeek-resultat | Vestlig modell-sammenligning | Hva det antyder |

|---|---|---|---|

| Kinesiske kontoroppgaver | V4-Pro-Max, 63% ikke-tap-andel | vs Claude Opus 4.6-Max | Sterk prestasjon i praktiske forretningslignende oppgaver |

| FoU-kodebenchmark | V4-Pro-Max beståttgrad 67 | vs Claude Sonnet 4.5 på 47; Opus 4.5 på 70; Opus 4.6 Thinking på 80 | Konkurransedyktig med ledende frontmodeller, særlig mot Sonnet-nivå-systemer |

Det er ikke «nummer én på alle områder», men det er allerede på et nivå som «må vurderes seriøst».

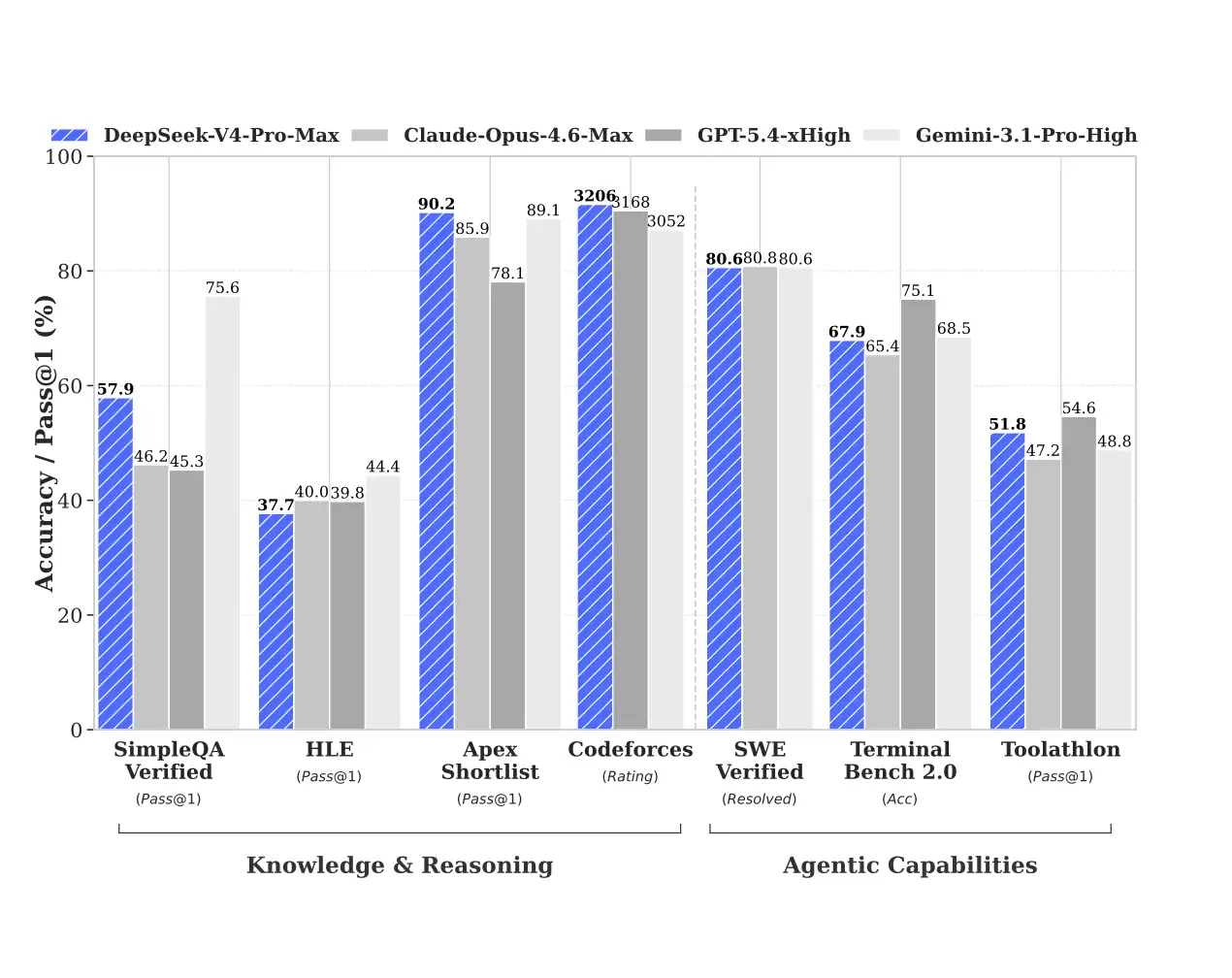

DeepSeeks tekniske rapport sammenligner V4-Pro-Max med Claude Opus 4.6 Max, GPT-5.4 xHigh og Gemini 3.1 Pro High i samme tabell. Resultatene er ikke svart-hvitt: Vestlige, lukket-kilde-modeller presterer fortsatt sterkt i noen kunnskaps- og inferensaspekter; likevel har V4-Pro-Max en svært sterk tilstedeværelse innen kode, lange kontekster og enkelte agentoppgaver. Med andre ord, det er ikke lenger en lavdimensjonal fortelling om «innenlandske alternativer», men har gått inn i fasen «hva passer best for ditt scenario».

Når det gjelder kunnskaps- og resonneringsevne, er det på nivå med Opus 4.6 Max, GPT-5.4 xHigh og Gemini 3.1 ProHigh. Det henger imidlertid litt etter i agentiske kapabiliteter, men forskjellen er ikke stor.

DeepSeek-V4-Pro-Max er svært konkurransedyktig i kodeorienterte og langkontekst-scenarier, mens de vestlige modellene fortsatt ser svært sterke ut i flere rene resonnerings- og kunnskapsbenchmarks. Det er riktig måte å lese lanseringen på: DeepSeek V4 er solid med i frontdiskusjonen, men benchmark-ledelse avhenger av oppgaven.

Slik får du tilgang til DeepSeek V4

1) Bruk den offisielle weben og appen

DeepSeek sier at V4 Preview er tilgjengelig nå på web, app og API. For vanlige brukere er den enkleste veien fortsatt det offisielle chattegrensesnittet, der modellen kan nås gjennom Expert Mode eller Instant Mode.

2) Bruk API-et

Jeg anbefaler sterkt CometAPI for tilgang til Deepseek V4, fordi det tilbyr den beste prisen og aggregeringsfordeler.

Modellnavnene er:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek sier også at de eldre navnene

deepseek-chatogdeepseek-reasonervil bli utfasede og for øyeblikket peker til ikke-tenkende og tenkende moduser av V4-Flash til 2026-07-24. Det er viktig for migrasjonsplanlegging hvis du allerede har eldre integrasjoner i produksjon.

- Registrer deg på CometAPI og hent API-nøkkelen din.

- Bruk standard OpenAI Python SDK (eller en kompatibel klient) med en egendefinert base-URL:

Her er et rent eksempel som bruker det offisielle OpenAI-kompatible formatet:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "Du er en hjelpsom assistent."},

{"role": "user", "content": "Oppsummer fordelene med million-token-kontekst."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Dette forespørselmønsteret følger hurtigstart-veiledningen: sett base-URL, velg deepseek-v4-pro eller deepseek-v4-flash, og aktiver tenking når du trenger dypere resonnering.

Hvordan bruke DeepSeek V4 effektivt

For arbeidsflyter med lange dokumenter er det sterkeste mønsteret å holde konteksten ren og strukturert. V4s 1M-token-vindu er en stor fordel, men modellen presterer likevel best når input er organisert i seksjoner, kildeutdrag, oppgaveinstruksjoner og eksplisitte utdata-krav. Det er den mest naturlige måten å utnytte langkontekst-kapasiteten DeepSeek fremhever.

For kode- og agentarbeidsflyter, start med V4-Flash for rask iterasjon, og eskaler deretter til V4-Pro for siste kjøring eller de vanskeligste trinnene. Den tilnærmingen passer den offisielle posisjoneringen: Flash er det effektive alternativet, Pro er den sterkere modellen, og begge deler den samme API-overflaten og kontekstlengden.

Til slutt

DeepSeek-V4 er bemerkelsesverdig fordi den kombinerer fire ting markedet har bedt om samtidig: lang kontekst, sterk resonnering, åpen tilgjengelighet og aggressive priser. Den egentlige historien er ikke bare at DeepSeek lanserte nok en modell. Det er at selskapet forsøker å gjøre frontlinje-aktig KI økonomisk brukbar i produksjon. For team som vurderer hvor de skal plassere neste KI-satsing, er det et signal verdt å teste, ikke ignorere.

For team som bygger på tvers av flere leverandører, er dette akkurat den typen lansering som er verdt å benchmarke i egen stack. CometAPI kan være det praktiske laget for å sammenligne DeepSeek-V4 ved siden av andre frontmodeller uten å tvinge produktteamet ditt til å bygge om integrasjonen hver gang markedet skifter.