Hva er GPT-5.2 API

GPT-5.2 API er det samme som GPT-5.2 Thinking i ChatGPT. GPT-5.2 Thinking er mellomnivå-varianten i OpenAIs GPT-5.2-familie, designet for dypere arbeid: flerstegsresonnement, oppsummering av lange dokumenter, kvalitetsmessig kodegenerering og profesjonelt kunnskapsarbeid der nøyaktighet og brukbar struktur betyr mer enn rå gjennomstrømming. I API-et eksponeres den som modellen gpt-5.2 (Responses API / Chat Completions), og den ligger mellom lav-latens-varianten Instant og den mer høyverdige men dyrere Pro-varianten.

Hovedfunksjoner

- Svært lang kontekst og komprimering: 400K effektivt vindu og komprimeringsverktøy for å håndtere relevans på tvers av lange samtaler og dokumenter.

- Konfigurerbar resonnementinnsats:

none | medium | high | xhigh(xhigh aktiverer maksimal intern beregning for krevende resonnement).xhigher tilgjengelig i Thinking/Pro-variantene. - Styrket verktøy- og funksjonsstøtte: førsteklasses verktøykalling, grammatikker (CFG/Lark) for å begrense strukturerte utdata, og forbedrede agentiske atferder som forenkler kompleks flertrinnsautomatisering.

- Multimodal forståelse: rikere bilde + tekst-forståelse og integrering i flertrinnsoppgaver.

- Forbedret sikkerhet / håndtering av sensitivt innhold: målrettede tiltak for å redusere uønskede svar i områder som selvskading og andre sensitive kontekster.

Tekniske kapabiliteter og spesifikasjoner (utviklerperspektiv)

- API-endepunkter og modell-ID-er:

gpt-5.2for Thinking (Responses API),gpt-5.2-chat-latestfor chat/instant-arbeidsflyter, oggpt-5.2-profor Pro-nivået; tilgjengelig via Responses API og Chat Completions der angitt. - Resonnementstokens og innsatsstyring: API-et støtter eksplisitte parametere for å tildele beregning (resonnementinnsats) per forespørsel; høyere innsats øker latenstid og kostnad, men forbedrer resultatkvaliteten for komplekse oppgaver.

- Verktøy for strukturert utdata: støtte for grammatikker (Lark / CFG) for å begrense modellens utdata til en DSL eller eksakt syntaks (nyttig for SQL, JSON, DSL-generering).

- Parallell verktøykalling og agentisk koordinering: forbedret parallellisering og renere verktøyorkestrering reduserer behovet for omfattende systemprompter og multi-agent-oppsett.

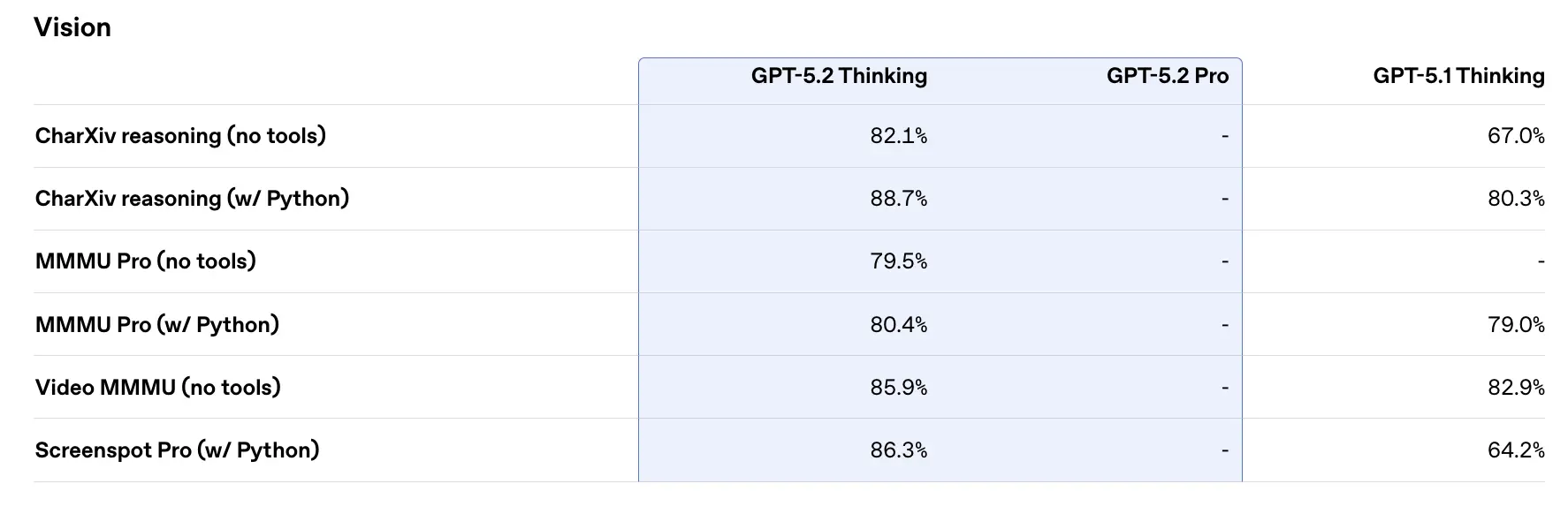

Benchmark-ytelse og støttedata

OpenAI publiserte en rekke interne og eksterne benchmark-resultater for GPT-5.2. Utvalgte høydepunkter (OpenAIs rapporterte tall):

- GDPval (44 yrker, kunnskapsarbeid) — GPT-5.2 Thinking "slår eller matcher topp bransjeprofesjonelle i 70.9% av sammenligningene"; OpenAI rapporterer at resultater ble produsert med >11× hastigheten og <1% av kostnaden av ekspertprofesjonelle på deres GDPval-oppgaver (hastighets- og kostnadsestimater er historisk basert). Disse oppgavene inkluderer regnearkmodeller, presentasjoner og korte videoer.

- SWE-Bench Pro (koding) — GPT-5.2 Thinking oppnår ≈55.6% på SWE-Bench Pro og ~80% på SWE-Bench Verified (kun Python) ifølge OpenAI, og etablerer et nytt toppnivå for kodegenerering / ingeniørevaluering i deres tester. Dette gir mer pålitelig feilsøking og ende-til-ende-rettinger i praksis, ifølge OpenAIs eksempler.

- GPQA Diamond (science Q&A på masternivå) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% på GPQA Diamond (ingen verktøy, maks resonnement).

- ARC-AGI-serien — På ARC-AGI-2 (en vanskeligere benchmark for flytende resonnement) scoret GPT-5.2 Thinking 52.9% og GPT-5.2 Pro 54.2% (OpenAI sier dette er nye state-of-the-art-merker for chain-of-thought-stil-modeller).

- Lang kontekst (OpenAI MRCRv2) — GPT-5.2 Thinking viser nær 100% nøyaktighet på 4-needle MRCR-varianten opp til 256k tokens og vesentlig forbedrede poeng vs GPT-5.1 på tvers av langkontekst-innstillinger. (OpenAI publiserte MRCRv2-diagrammer og -tabeller.)

Sammenligning med samtidige

- vs Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro er publisert med et ~1,048,576 (≈1M) token kontekstvindu og brede multimodale inndata (tekst, bilde, lyd, video, PDF-er) og sterke agentiske integrasjoner via Vertex AI / AI Studio. På papiret er Gemini 3s større kontekstvindu en differensierende faktor for svært store enkeltøkt-arbeidslaster; avveininger inkluderer verktøytilbud og økosystemtilpasning.

- vs Anthropic Claude Opus 4.5: Anthropics Opus 4.5 vektlegger enterprise-koding/agent-arbeidsflyter og rapporterer sterke SWE-bench-resultater og robusthet for lange agentiske økter; Anthropic posisjonerer Opus for automatisering og kodegenerering med et 200k kontekstvindu og spesialiserte agent-/Excel-integrasjoner. Opus 4.5 er en sterk konkurrent innen enterprise-automatisering og kodeoppgaver.

Praktisk konklusjon: GPT-5.2 retter seg mot en balansert pakke forbedringer (400k kontekst, høye token-utdata, forbedret resonnement/koding). Gemini 3 retter seg mot de absolutt største enkeltkontekstene (≈1M), mens Claude Opus fokuserer på enterprise-ingeniørarbeid og agentisk robusthet. Velg ved å matche kontekststørrelse, modalitetsbehov, funksjons-/verktøytilpasning, og kostnads-/latensavveininger.

Hvordan få tilgang til og bruke GPT-5.2 API

Trinn 1: Registrer deg for API-nøkkel

Logg inn på cometapi.com. Hvis du ikke er brukeren vår ennå, registrer deg først. Logg inn på din CometAPI console. Få tilgangslegitimasjonen API-nøkkel for grensesnittet. Klikk "Add Token" ved API-tokenet i det personlige senteret, hent token-nøkkelen: sk-xxxxx og send inn.

Trinn 2: Send forespørsler til GPT-5.2 API

Velg “gpt-5.2”-endepunktet for å sende API-forespørselen og angi forespørselskroppen. Forespørselsmetode og forespørselskropp hentes fra vår nettsides API-dokumentasjon. Vår nettside tilbyr også Apifox-test for din bekvemmelighet. Bytt ut <YOUR_API_KEY> med din faktiske CometAPI-nøkkel fra kontoen din. Utviklere kaller disse via Responses API / Chat endepunkter.

Sett inn spørsmålet eller forespørselen din i innholdsfeltet—det er dette modellen vil svare på . Prosesser API-responsen for å hente det genererte svaret.

Trinn 3: Hent og verifiser resultater

Prosesser API-responsen for å hente det genererte svaret. Etter prosessering svarer API-et med oppgavestatus og utdata.

Se også Gemini 3 Pro Preview API