Kort fortalt: OpenClaws nyeste utgivelse legger til førsteklasses, fremoverkompatibel støtte for OpenAIs GPT-5.4 og introduserer en «hot-swappable»-minnearkitektur som lar OpenClaw-agenter bytte hvilken modell og hvilket minnelager som er aktive under kjøring med minimal forstyrrelse. Dette åpner for arbeidsflyter med stor kontekst (GPT-5.4s utvidede kontekstvinduer), dynamisk modellspecialisering og kostnads-/latensoptimalisering for produksjonsagenter. Oppgraderingen er tilgjengelig i OpenClaws utgivelser og tilhørende dokumentasjon; eksemplene nedenfor viser praktisk konfigurasjon, kodeutdrag, benchmark-kontekst og anbefalte beste praksiser.

Hva OpenClaws oppdatering faktisk leverte (kort oppsummering)

Den 9. mars 2026 lanserte det åpne kildekode-agentrammeverket OpenClaw – et OpenAI-nært prosjekt – en større kjerneutgivelse (2026.3.7) som gir førsteklasses støtte for GPT-5.4 og en ny «memory hot-swappable»-mekanisme i kontekstmotoren. Denne utgivelsen forvandler et mye brukt eksperimentelt agentrammeverk til det vedlikeholderne beskriver som et «Agent Operating System» — med mål om å gjøre produksjonsklare agent-arbeidsflyter og modellswitching sømløs for utviklere og team.

3 praktiske punkter som betyr noe for agentbyggere:

- Førsteklasses støtte for GPT-5.4 — modellaliaser og leverandørmappinger som lar agenter velge GPT-5.4 som primær kjøremodell (inkludert kanaloverstyringer og modellpinnings per agent).

- Context Engine og distribuert kanalbinding — forbedringer i hvordan OpenClaw setter sammen lange kontekster fra minne, verktøyutdata og kanalhistorikk, slik at høy-kapasitetsmodeller får velstrukturerte input.

- Hot-swappable minnearkitektur — tydeligere minneplugin-grensesnitt og arbeidsflyter slik at du kan bytte minnebackender eller oppgradere agenter uten å miste «identitet» eller korrumpere vedvarende tilstand (selve minnet forblir den ene sannhetskilden). OpenClaws minnedesign (rene Markdown-filer, indeksert søk, plugin-basert gjenfinning) er en del av det som muliggjør trygg hot-swapping.

GPT-5.4 — hva GPT-5.4 er og gjennombrudd i benchmarker

GPT-5.4 er den nyeste OpenAI-frontier-modellen med tungt fokus på profesjonell produktivitet (regneark, dokument- og presentasjonsredigering, flerstegsresonnering og verktøystyring). Ifølge OpenAI og uavhengig pressedekning vektlegger utgivelsen:

- Utvidet kontekst: GPT-5.4 introduserer neste nivå av kontekstvinduer, med eksperimentelle 1M-token og forbedret langtidskontekst via Codex/Codex-kompatible endepunkter — konfigurasjonsbrytere som

model_context_windowogmodel_auto_compact_token_limiter eksponert for utviklere. Dette lar deg holde mye større samtalestatus, dokumenter og kodebaser i aktiv kontekst. - Høyere nøyaktighet i regneark og resonnering — OpenAI rapporterer en stor forbedring på regnearkmodelleringsoppgaver (gjennomsnittlig score ~87% vs ~68% for GPT-5.2 på deres bank/analytiker-regnearkbenchmark).

- Forbedringer i nøyaktighet og faktualitet: Tidlige omtaler og QA viser ~33% reduksjon i hallusinasjoner og færre feilutsatte svar relativt til GPT-5.2, med merkbare gevinster i dokumentutkast og regnearkarbeid. Anmeldere siterte også en ~18% reduksjon i feilutsatte svar på visse produktivitetsoppgaver.

- Integrert databruk og forbedringer fra Codex-linjen — GPT-5.4 inkluderer kapabiliteter arvet fra Codex-linjen som forbedrer kodegenerering, interaktiv debugging og operasjonell verktøystyring (mus/tastatur/skjermbilde-automatisering i noen demonstrasjoner). Dette gjør den bedre i skrive-kjør-inspeksjon-lapp-syklusen typisk for agentløkker.

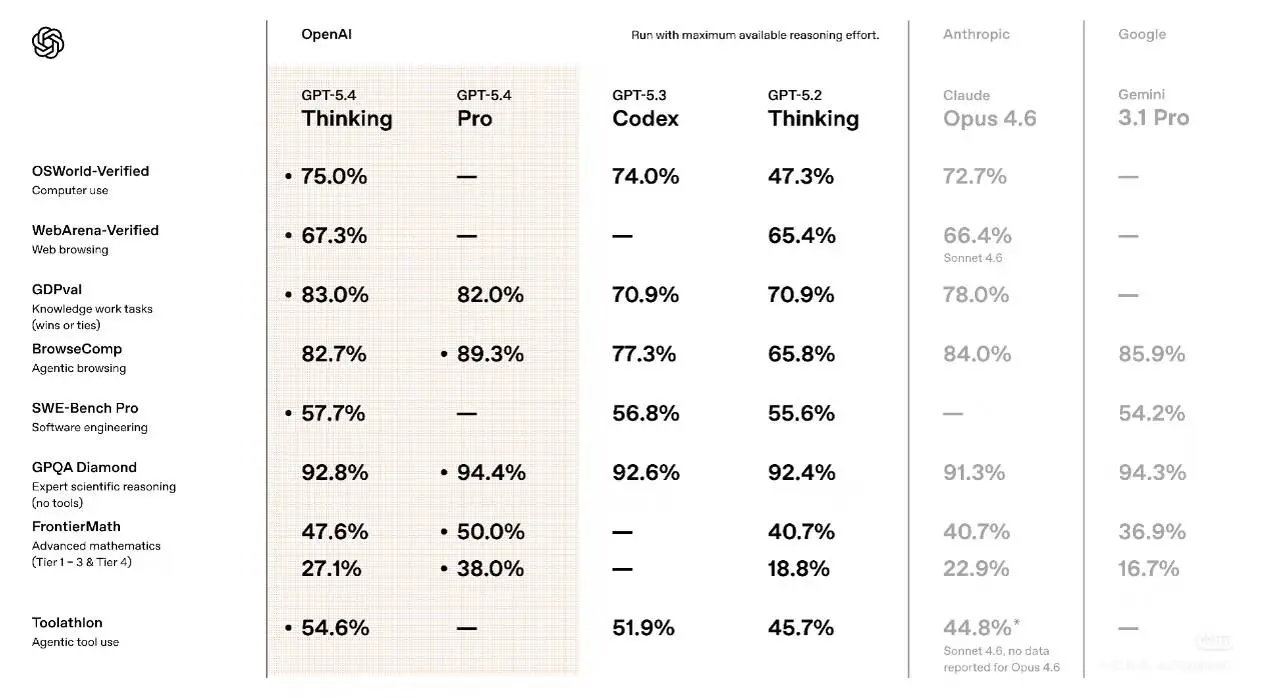

Benchmarks og sammenlignende kontekst (hva tallene betyr)

- Regnearkmodellering: OpenAIs interne regnearkbenchmark: ~87,3% gjennomsnittsscore for GPT-5.4 vs ~68,4% for GPT-5.2. Dette er overskriften leverandøren bruker for å vise oppgavespesifikke gevinster.

- Datamaskininteraksjon (OSWorld / agent-lignende tester): uavhengige testere og community-kjøringer viser at GPT-5.4 forbedrer agentinteraksjonsoppgaver som involverer skrivebord eller simulert UI-manipulasjon, og slår av og til nylige Anthropic-modellvarianter med små marginer på disse testsuitene (forskjellene er meningsfulle for agenter, men ikke nødvendigvis avgjørende i alle arbeidslaster).

Tolkning: GPT-5.4 er ikke en «magisk kule» som vinner alt. Den har klare styrker i integrert verktøybruk, kodekjøringsmønstre og regnearkresonnering — som er akkurat de arbeidslastene OpenClaw-agenter ofte kjører. For agentbyggere er kombinasjonen av forbedret eksekvator-pålitelighet (Codex-linje) + planleggingskompetanse + bedre håndtering av lang kontekst svært relevant.

OpenClaw støtter GPT-5.4: hva som endret seg og hvorfor det betyr noe

OpenClaws utgivelse (se prosjektets releases-side) oppdaterer modellresolvere og runtime for å være fremoverkompatibel med GPT-5.4s utvidede kontekst- og token-grenser og legger til «memory hot-swappable»-kapabilitet slik at agenter kan bytte minnebackender eller modeller under kjøring. Dette gjøres på tre konkrete måter: 1) oppdatering av modellmetadata og resolver for å akseptere den større konteksten og token-grensene; 2) endringer i agent-runtime for å orkestrere grasiøse modellsbytter og cache-oppvarming; 3) et minne-API som tillater flere minnekanaler og hot-switch-utløsere.

Versjon 2026.3.7s støtte for GPT-5.4 pluss en «memory hot-swappable»-design gir to praktiske, komplementære fordeler:

- Enkel oppgraderingsvei for modeller. OpenClaw kan nå presentere GPT-5.4 som en valgfri «runtime» for agenter, slik at du kan bytte fra eldre GPT-5.x-modeller eller alternative leverandører uten å måtte skrive om agentlogikken. OpenClaw-oppdateringen erklærer eksplisitt stabil GPT-5.4-integrasjon i kjernen.

- Memory Hot-Swapping. I stedet for å persistere et enkelt lineært minnesnapshot, lar OpenClaws Context Engine minnepartisjoner kobles fra, byttes eller migreres under kjøring — f.eks. bytte inn en høy-recall vektor-DB-shard for debugging eller bytte til en GDPR-sanert minnevariant for eksterne revisjoner — uten å stoppe agenten. Det reduserer forstyrrelsesrisiko i produksjon og muliggjør bruksspesifikke minnekonfigurasjoner (debugging vs personvern vs ytelse).

Praktiske ytelsesgjennombrudd og fordeler

OpenClaws integrasjon fokuserer på tre praktiske områder der GPT-5.4 utmerker seg:

- Høyere trofasthet i verktøysorkestrering. GPT-5.4s forbedrede interne verktøysøk og resonnering reduserer verktøykallstøy (færre redundante verktøykall og færre retryer). Det gir færre API-kall og raskere fullføring for komplekse løp. Tidlige rapporter indikerer forbedringer i token- og verktøykalleffektivitet sammenlignet med eldre GPT-5.x-modeller.

- Lengre og rikere konteksthåndtering. OpenClaw-agenter kan nå holde mye større aktive kontekster (inkludert innbyttede minnesharder), slik at de kan håndtere lange samtaler, flerfilprosjekter og iterativ debugging uten å miste tilstand.

- Mer deterministisk kodeutdata. For arbeidsflyter som autogenererer kode (CI-hooks, funksjonsstubber, infrastrukturmaler), tenderer GPT-5.4 til å produsere mer konsistent og kjørbar utdata, noe som reduserer manuelt gjennomgangsbehov. Uavhengige tester viser merkbare forbedringer i kodekvalitetsmetrikker vs tidligere GPT-5-modeller.

- Minnekontinuitet — «memory hot-swappable» lar deg bytte ut eller supplere minnelagre (lokal cache, vektor-DB, LLM-minne) uten å miste agenttilstand eller kontekst, og muliggjør A/B-testing, rullerende oppgraderinger og failover.

I OOLONG-benchmarktesten oppnådde den nye versjonen av OpenClaw, i kombinasjon med lossless-claw-pluginen, en høy score på 74,8, og la Claude Code (70,3 poeng) langt bak. Spesielt viste OpenClaw stabilitet og nøyaktighet etter hvert som kontekstlengden økte, og fikk ingeniørene som gjennomførte testingen på stedet til å utbryte at «det er for konservativt å si at den kjører bra».

Slik konfigurerer og bruker du GPT-5.4 i OpenClaw (trinn for trinn)

En enkel OpenClaw-arbeidsflyt med GPT 5.4:

- En typisk konfigurasjon er vist nedenfor:

- Brukere sender meldinger via plattformer som Discord eller Telegram.

- OpenClaw mottar meldingene gjennom gateway-serveren.

- Gatewayen videresender promptene til GPT 5.4 via AI-API-leverandøren.

- GPT 5.4 genererer et svar eller utløser en verktøyhandling.

- OpenClaw sender det endelige resultatet tilbake til brukeren.

Nedenfor er pragmatiske, kopier–lim-vennlige konfigurasjonseksempler og arbeidsflyter for å kjøre GPT-5.4 i OpenClaw trygt og reproduserbart. Disse er bevisst konservative: aktiver modellen først i en testagent og instrumenter alt for metrikk og feil.

Forutsetninger- OpenClaw oppgradert til utgivelsen som inkluderer GPT-5.4-mappinger (releasenotatene referert til ovenfor).

- Gyldig OpenAI API-nøkkel med tilgang til GPT-5.4 (jeg velger CometAPI endepunkt med billigere pris).

1) Modellvalg og resolver-konfigurasjon (Json/ YAML / CLI)

Legg dette i ~/.openclaw/openclaw.json (eller flett inn i din eksisterende konfig). Juster leverandørnavn og tokenreferanse etter hva miljøet ditt krever.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw bruker en modellresolver for å mappe logiske modellnavn (f.eks. openai/gpt-5.4) til endepunkter og runtime-konfig. Legg til eller oppdater resolver-filen din (eksempel models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Eller sett det ved kjøring via CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Merk:

context_windowogmax

Merknader

agents.defaults.model.primaryvelger standardmodellen. Brukchannels.modelByChannelfor overstyring per kanal slik at du kan rute kanaler med høy påvirkning til GPT-5.4 og mindre krevende kanaler til rimeligere modeller. Se OpenClaw-dokumentasjonen for modellvalg for ordensemantikk.- Se CometAPIs modellsider for spesifikke modellnavn. Hvis du ønsker å bruke OpenAI, bytt ut URL og API-nøkkel med OpenAIs.

- Nøklene

context_windowogmax_output_tokensgjenspeiler fremoverkompatibilitetsendringene i OpenClaws resolver slik at agenten ikke forsøker å bruke foreldede Codex-grenser.

2) Slik aktiverer og tester du «memory hot-swapping»

OpenClaws minnesubsystem er filbasert (Markdown-filer) pluss indekserere/søkplugins, slik at du trygt kan bytte backend-plugins (f.eks. SQLite-vektor, Milvus eller eksterne minnetjenester) uten å miste de rå minnefilene.

Et vanlig mønster:

- Standardiser minneplassering: bruk et git-støttet arbeidsområde:

~/.openclaw/workspace/derMEMORY.mdogmemory/YYYY-MM-DD.mder autoritative. - Installer og konfigurer en minneplugin (eksempel: sqlite-vec) og pek

plugins.slots.memorypå den i konfigen. - Test migrering: legg til en ny plugin, kjør en «shadow»-indekseringsjobb, sammenlign gjenfinningsresultater, og bytt deretter

plugins.slots.memory-aliaset til den nye pluginen når du er fornøyd.

Eksempel på aliasbytte for plugin (bash pseudokommandoer):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Hvorfor dette er «hot-swappable»: minnefilene forblir sannhetskilden. Pluginene implementerer indekserings- og gjenfinningslag; å bytte dem reindekserer, men endrer ikke de underliggende .md-filene. Dette tillater modellsbytter uten katastrofal identitetsdrift — agenten leser fortsatt de samme MINNENE.

3) Eksempel: pinn en individuell agent til GPT-5.4 (overstyring per agent)

Du kan overstyre modeller per agent; legg til en agentoppføring som:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Hvis community-utgivelsen eller din spesifikke OpenClaw-versjon krever CLI, kan du også sette en modell per økt ved kjøring:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Driftstips: pinning sikrer deterministisk atferd for den agenten mens du kjører A/B-tester på andre.

Hvis du ønsker å bruke OpenAI, bytt ut URL og API-nøkkel med OpenAIs.

4) Bruke Codex 1M-kontekstvalg (API-brytere)

Hvis OpenClaw-distribusjonen din aksesserer OpenAI Codex-endepunkter direkte, send kontekstvalg:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Forespørsler som overskrider standard kontekstvinduer kan telles med andre brukssatser (OpenAI-dokumentasjonen nevner dobbel prising for forespørsler utover standardvinduer i Codex-forhåndsvisning).

Beste praksis: maksimer GPT-5.4s styrker i OpenClaw

Kostnad, latens og modellmiks

- Hybrid modellstrategi: Bruk en mindre, rimeligere modell for korte forespørsler og strømprosessering; hot-swap til GPT-5.4 for tung analyse, oppsummering og kodegenerering som krever lang kontekst. Dette reduserer total tokenkostnad samtidig som kvaliteten bevares. (Implementer via triggere i minnekonfigen over.)

- Tokenkomprimering og gjenfinningstillegg (RAG): Bruk gjenfinningsstyrte piper for å begrense tokens sendt til modellen — lagre lange dokumenter i en vektor-DB, hent relevante segmenter, og inkluder kun de mest relevante bitene pluss en kompakt plan. GPT-5.4s verktøysøk hjelper ved å finne nyttige verktøy eller dokumenter automatisk.

- Oppvarming og kaldstart: Etter et modellsbytte, varm opp modellen med en kort kontekstpriming for å unngå latensspikes ved første forespørsel. Prekompiler eventuelle promptmaler og rehydrer kritiske minnekanaler. OpenClaws rullerende strategi (se konfig) støtter forhåndsoppvarming.

Pålitelighet og sikkerhet

- Grasiøs fallback: Implementer tidsavbrudd og fallback-planer (f.eks. degrader til et cachet svar fra en tidligere økt) for å håndtere API-ratebegrensninger eller kvotefeil.

- Sikkerhetslag: Oppretthold policyfiltre og et verifikasjonstrinn når utdata påvirker beslutninger. GPT-5.4 reduserer hallusinasjoner statistisk, men verifikasjon er fortsatt viktig for høyrisikooppgaver.

Evaluering og overvåking

- Reproduser dine benchmarks: Kjør head-to-head-tester for dine arbeidslaster (kodefullføring, flerfil-refaktor, regnearkanalyse) med en standard rubrikk. Offentlige rapporter indikerer styrker i regneark og produktivitetsoppgaver — valider med dine data.

- Telemetri: Overvåk tokenforbruk, modellatens, frekvens av minnebytter og svarkvalitet (menneskelige vurderinger/automatiserte tester). Bruk telemetrien til å finjustere byttegrenser.

Eksempel: Kodereview-agent som hot-swaper

Mål: Kjør rutinemessig lint + enhetstestoppsummering ved push (rimelig modell) og eskaler til GPT-5.4 for flerfil-refaktoreringsforslag når tester feiler eller diffs overstiger 10 filer.

Flyt (overordnet nivå):

- Pre-commit-trigger kjører

local/fast-small-coderfor å generere lint-oppsummering. - Hvis

test_failures > 0ellerdiff_files > 10, utløshot_swaptilopenai/gpt-5.4. Promoterlongterm_vectorsom inneholder repo-historikk. - Kjør GPT-5.4-prompt som har hele feilede stack traces + relevante kodefiler trukket inn i kontekst. Generer refaktor-patch og endringer i enhetstester.

- Menneskelig reviewer vurderer utdata; tilbakemelding oppdaterer minnet.

Prompt-skjelett (sendes til GPT-5.4 etter gjenfinning og komprimering):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Denne brukssaken illustrerer hvorfor stor kontekst + minne-hot-swap er verdifullt: du kan ta med hele feilede spor og flere filer inn i modellen samtidig. Implementer byttetriggere konservativt for å kontrollere kostnader.

Til slutt: hvem som bør ta i bruk GPT-5.4 i OpenClaw (og når)

- Ta i bruk nå hvis agentene dine utfører flerstegs kode-/verktøyoppgaver, tung regnearkautomatisering eller kompleks dokumentredigering der iterative skrive-kjør-inspeksjon-sykluser dominerer utviklertiden. Produktivitets- og pålitelighetsgevinstene er mest synlige her.

- Ta i bruk med varsomhet hvis du driver kostnadssensitive, høyt volum chat-kanaler der enklere resonnering er tilstrekkelig; bruk ruting for å bevare kostnadseffektivitet.

- Ikke anta én modell-dominans: benchmark på dine data. GPT-5.4 er en sterk kandidat for agentarbeidslaster, men modellvalg må være evidensdrevet.

Utviklere kan få tilgang til GPT-5.4 via CometAPI (CometAPI er en one-stop-aggregasjonsplattform for store modell-APIer som GPT-APIer, Nano Banana-APIer osv.) nå. For å komme i gang, utforsk modellens kapabiliteter i Playground og se Openclaw intergration guide for detaljerte instruksjoner. Før du får tilgang, sørg for at du har logget inn på CometAPI og innhentet API-nøkkelen. CometAPI tilbyr en pris som er langt lavere enn den offisielle prisen for å hjelpe deg å integrere.

Klar til å starte?→ Sign up fo openclaw today !

Hvis du vil vite flere tips, guider og nyheter om AI, følg oss på VK, X og Discord!