Krótka odpowiedź: który model AI powinni priorytetowo wybrać deweloperzy w 2026 roku?

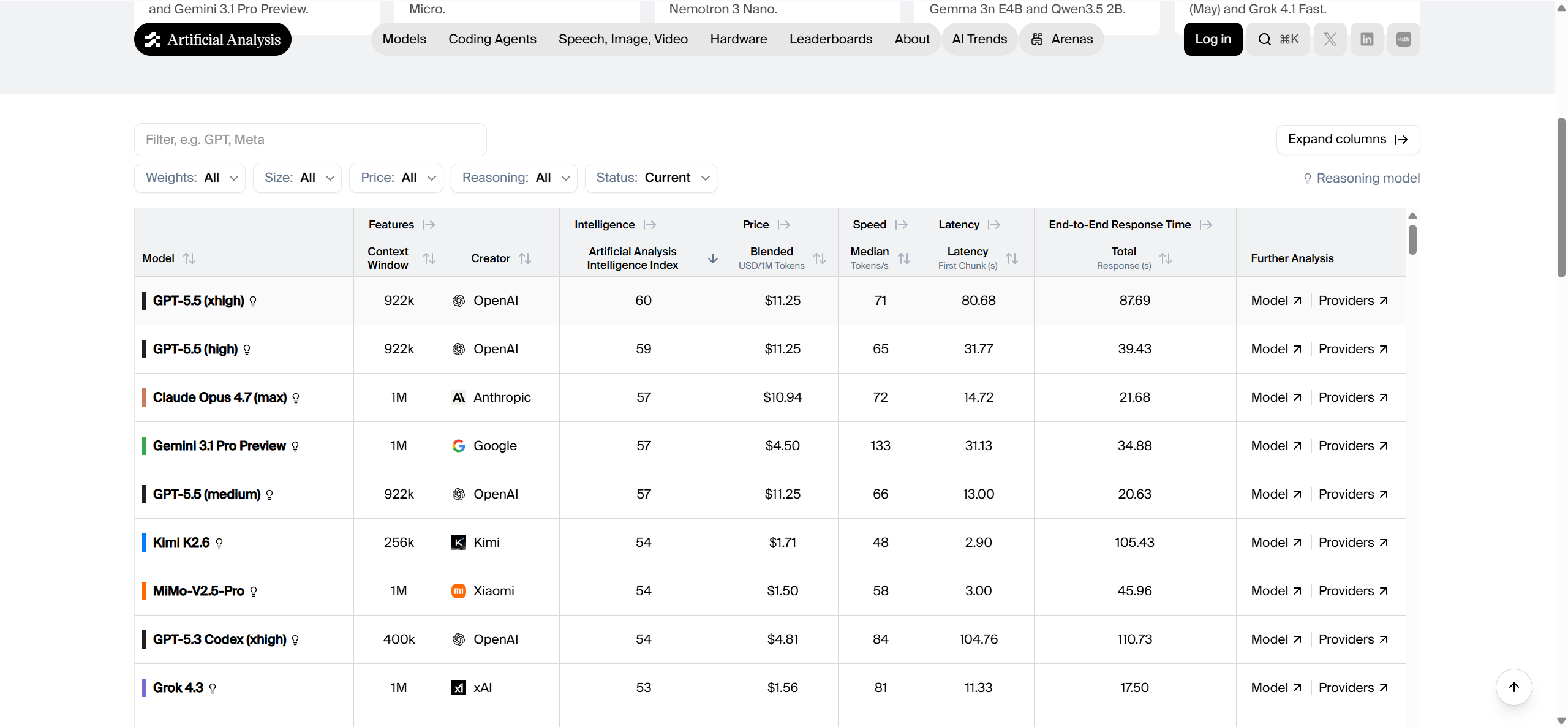

Do zadań wymagających maksymalnego autonomicznego rozumowania i minimalnych halucynacji deweloperzy powinni wybrać GPT-5.5 (xhigh), który prowadzi na rynku z wynikiem 60 w Indeksie Inteligencji. Aplikacje wymagające interaktywności w czasie rzeczywistym powinny korzystać z Mercury 2, obecnego lidera szybkości z około 859 tokenami na sekundę. Do produkcji na dużą skalę, gdzie budżet jest głównym ograniczeniem, DeepSeek V4 Pro i Kimi K2.6 oferują inteligencję bliską czołówce za około 10% kosztu flagowych modeli własnościowych.

The Intelligence Index: Ranking the Frontier Models

Krajobraz AI w 2026 roku przesunął się z pogoni za liczbą parametrów na optymalizację gęstości „myślenia”. Artificial Analysis Intelligence Index v4.0 służy jako branżowy standard do kwantyfikacji możliwości modelu w dziesięciu wyspecjalizowanych wymiarach, w tym w programowaniu klasy profesjonalnej i ekstremalnym wnioskowaniu logicznym.

| Model | Intelligence Index | Context Window | Best Use Case |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Badania naukowe i logika |

| GPT-5.5 (high) | 59 | 922K | Programowanie na poziomie profesjonalnym |

| Claude Opus 4.7 (max) | 57 | 1M | Agenci autonomiczni i planowanie |

| Gemini 3.1 Pro | 57 | 1M - 2M | Synteza danych multimodalnych |

| Kimi K2.6 | 54 | 256K | Praca agentyczna oparta na terminalu |

| MiMo-V2.5-Pro | 54 | 1M | Inżynieria oprogramowania full‑stack |

| DeepSeek V4 Pro (Max) | 52 | 1M | Skalowalne przepływy wnioskowania |

| GLM-5.1 | 51 | 200K | Autonomiczne zadania o długim horyzoncie |

Jak czytać tę tabelę

Z pięciu najlepszych modeli, trzy to modele GPT-5.5, GPT-5.5 Medium, Claude Opus 4.7 i Gemini 3.1 Pro. Te trzy zachodnie modele flagowe idą łeb w łeb, podczas gdy Kimi K2 i mimo-v2.5 pro, dwa chińskie modele, oferują wydajność porównywalną z czołowymi modelami zachodnimi przy niezwykle konkurencyjnych cenach.

Artificial Analysis Intelligence Index to znormalizowana metryka wyprowadzona z niezależnych ewaluacji, takich jak Terminal-Bench Hard i IFBench. Jedna różnica punktu reprezentuje statystycznie istotną lukę w „progu autonomii” modelu. Na przykład 3‑punktowa różnica między GPT-5.5 (60) a Claude Opus 4.7 (57) często przekłada się na różnicę między modelem, który wymaga interwencji człowieka co kilka kroków, a modelem, który potrafi samodzielnie domknąć złożony łańcuch logiczny. Wyższy wynik indeksu jest na ogół powiązany z wyższymi wskaźnikami sukcesu w „Humanity's Last Exam” i zredukowaną liczbą błędów w wywołaniach narzędzi w środowiskach agentycznych.

Odruchy: opóźnienie i szybkość generowania

Dla oprogramowania interaktywnego — od asystentów IDE na żywo po głosowych agentów obsługi klienta — surowa inteligencja ustępuje miejsca metrykom Time to First Token (TTFT) i Generation Throughput.

Top 5 najszybszych modeli (przepustowość)

Przepustowość mierzy szybkość, z jaką model generuje tekst po początkowej fazie przetwarzania. Wysoka przepustowość jest niezbędna do tworzenia długich form treści i szybkiego refaktoringu kodu.

- Mercury 2: Około 859 tokenów/s

- Granite 4.0 H Small: Około 407 tokenów/s

- Granite 3.3 8B: Około 365 tokenów/s

- Gemini 3.1 Flash-Lite**** : Około 331 tokenów/s

- Qwen3.5 0.8B: Około 287 tokenów/s

Top 5 modeli o najniższej latencji (TTFT)

Latencja wskazuje opóźnienie zanim pierwszy token dotrze do użytkownika. To kluczowa metryka dla „feelu” i postrzeganej responsywności w UI/UX.

- NVIDIA Nemotron 3 Nano: Około 0.40s

- Ministral 3 3B: Około 0.47s

- Qwen3.5 0.8B: Około 0.52s

- LFM2 24B A2B: Około 0.55s

- Grok 3 mini Reasoning: Około 0.58s

Jak wybrać model w 2026 roku

Wybór modelu wymaga zbalansowania relacji „inteligencja za dolara” ze specyficznymi wymaganiami dot. dostępności Twojej aplikacji. Rynek w 2026 roku rozszczepił się na trzy odrębne ścieżki architektoniczne.

Niezależni deweloperzy i zespoły wrażliwe na koszty

Dla solowych deweloperów lub małych zespołów uruchamiających tysiące eksperymentalnych pętli agentów, DeepSeek V4 Pro jest optymalnym wyborem strategicznym. Wykorzystuje masywną architekturę Mixture-of-Experts (MoE) z 1,6T parametrów, gdzie na token aktywowanych jest jedynie 49B parametrów, co pozwala zaoferować wydajność klasy flagowca przy koszcie około $0.416 za milion tokenów. Inną doskonałą opcją do zadań stricte programistycznych jest Kimi K2.6, który specjalizuje się w przepływach pracy typu terminal‑first. Modele te zapewniają niemal 90% mocy wnioskowania modeli premium, będąc przy tym około 70–80% tańszymi, efektywnie wydłużając runway startupu.

Środowiska produkcyjne w przedsiębiorstwach

Dla wdrożeń na poziomie całej firmy, gdzie stabilność i przestrzeganie złożonych promptów systemowych są nienegocjowalne, standardem branżowym pozostają GPT-5.5 Pro i Claude Opus 4.7. GPT-5.5 Pro jest zaprojektowany do precyzji w sytuacjach wysokiego ryzyka, excelując w obszarach takich jak modelowanie bankowości inwestycyjnej i eksploracja naukowa, gdzie koszt błędu przewyższa koszt wywołania API. Claude Opus 4.7 jest preferowany przez zespoły wymagające utrzymanej niezawodności w projektach trwających wiele dni, ponieważ wykazuje istotnie niższy wskaźnik halucynacji w środowiskach terminalowych w porównaniu do szerszej rodziny GPT. Przedsiębiorstwa zazwyczaj używają CometAPI, aby zintegrować te modele przez pojedynczą bramę, zapewniając 99.9% uptime i natychmiastowe przełączenie w razie regionalnych skoków latencji u głównego dostawcy.

Interaktywne aplikacje czasu rzeczywistego

Aplikacje takie jak boty wsparcia klienta w czasie rzeczywistym czy natychmiastowe napisy do wideo wymagają „płynnej” AI, która działa jak natychmiastowa. W tej kategorii Mercury 2 i Gemini 3.1 Flash-Lite to najlepsze wybory. Mercury 2 oferuje przepustowość niemal dziesięciokrotnie wyższą niż standardowe modele wnioskowania, co czyni go idealnym do tworzenia dokumentów w czasie rzeczywistym. Gemini 3.1 Flash-Lite zapewnia zrównoważone możliwości multimodalne, przetwarzając tekst, audio i obrazy w jednolitym kontekście z prędkością około 2,5x w stosunku do wcześniejszych generacji, jednocześnie wspierając okno kontekstu rzędu 1 miliona tokenów.

Okno kontekstu: od fragmentów do całych repozytoriów

Okno kontekstu działa jak „pamięć krótkotrwała” modelu. W 2026 roku branża podzieliła się na standardowe okna (128K) i pojemności na skalę repozytorium (1M–10M).

- Llama 4 Scout: 10,000,000 tokenów

- Grok 4.20: 2,000,000 tokenów

- Gemini 3.1 Pro: Około 1,048,576 tokenów

- DeepSeek V4 Pro: 1,000,000 tokenów

- GPT-5.5 Pro: 1,050,000 tokenów

Kiedy rozmiar kontekstu ma znaczenie?

Okno kontekstu 128K — standard dla modeli takich jak DeepSeek‑V3.2 — jest teraz bazą dla podstawowych rozmów i podsumowywania pojedynczych artykułów. Jednak profesjonalna inżynieria oprogramowania wymaga „świadomości całego systemu”.

Okno kontekstu rzędu 1 miliona tokenów pozwala agentowi AI wczytać całe repozytorium oprogramowania, włącznie ze wszystkimi plikami źródłowymi, dokumentacją i logami historycznymi, w jednym przejściu. Zapobiega to „dryfowi pamięci” związanemu z tradycyjnymi systemami RAG, gdzie istotne dane mogą zostać pominięte na etapie dzielenia na fragmenty. Konkretnym przykładem jest refaktoryzacja kodu: model z 1M tokenów może zrozumieć, jak zmiana w podstawowym schemacie bazy danych wpływa na pięćdziesiąt różnych punktów końcowych API w różnych plikach, podczas gdy mniejszy model może „widzieć” tylko kilka plików naraz, co prowadzi do zerwanych zależności.

Porównanie ekonomiczne: cena jednostkowa za 1 milion tokenów

Poniższa tabela używa metryki Blended USD/1M Tokens, zakładając stosunek 3:1 tokenów wejściowych do wyjściowych, aby odzwierciedlić wzorce użycia w świecie rzeczywistym.

| Model | Cena łączona (za 1M) | Wartość względna | Zniżka przez CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | Około $11.25 | Premium | 20% OFF |

| Claude Opus 4.7 (max) | Około $10.00 | Wysoka | 20% OFF |

| Gemini 3.1 Pro | Około $4.50 | Zrównoważona | 20% OFF |

| Kimi K2.6 | Około $1.71 | Wysoka wartość | 20% OFF |

| DeepSeek V4 Pro | Około $0.53 | Ekstremalna wartość | 20% OFF |

| Qwen3.5 0.8B | Około $0.02 | Użytkowy | 20% OFF |

Wszystkie stawki zweryfikowane na maj 2026. Oficjalne stawki dostawców są zazwyczaj o 20% wyższe niż stawki z rabatem oferowane przez ujednolicone bramy.

Strategia optymalizacji kosztów

Aby wesprzeć planowanie architektury, oszacowaliśmy miesięczne wydatki dla trzech typowych progów wzrostu.

- Mały zespół deweloperski (10M tokenów/miesiąc): Zespoły korzystające głównie z Kimi K2.6 do tworzenia funkcji i DeepSeek V4 Flash do prostych zadań logicznych zobaczą miesięczne wydatki na poziomie $15–$40. Pozwala to na agresywne prototypowanie przy obciążeniu finansowym nie większym niż standardowa subskrypcja SaaS.

- Średniej wielkości SaaS (100M tokenów/miesiąc): Startup skalujący platformę automatyzacji opartą na AI z użyciem Claude Sonnet 4.6 i Gemini 3.1 Flash może oczekiwać miesięcznych kosztów między $250 a $550. Dzięki wykorzystaniu buforowania promptów dostępnego w tych modelach, efektywny koszt często spada o dodatkowe 15%.

- Duże przedsiębiorstwo (1B tokenów/miesiąc): Globalne firmy uruchamiające wysoko‑konkurencyjne, agentyczne przepływy pracy z GPT-5.5 i Claude Opus 4.7 prawdopodobnie wydadzą $3,000–$6,500 miesięcznie. Na tej skali integracja przez ujednoliconą bramę API staje się niezbędna dla scentralizowanego rozliczania i uniknięcia narzutu związanego z zarządzaniem osobnymi umowami z wieloma dostawcami.

Wnioski: wybór ścieżki w 2026 roku

Era „modelu do wszystkiego” dobiegła końca. Nowoczesna architektura AI wymaga orkiestracji floty wyspecjalizowanych modeli: GPT-5.5 do zadań o wysokim zapotrzebowaniu na obliczenia, Mercury 2 do interaktywności oraz DeepSeek V4 do realizacji zadań o dużej objętości. Integrując się raz z CometAPI, deweloperzy zyskują przenośność w zakresie podmiany modeli wraz z ewolucją benchmarków, jednocześnie zapewniając stałą zniżkę 20–40% na każde żądanie.

FAQ

Który model AI jest obecnie najbardziej inteligentny?

Zgodnie z Artificial Analysis Intelligence Index v4.0, GPT-5.5 (xhigh) jest obecnie najbardziej inteligentnym dostępnym modelem, z wynikiem 60. Tuż za nim plasują się GPT-5.5 (high) z wynikiem 59 oraz Claude Opus 4.7 (max) z wynikiem 57.

Jaki jest najszybszy model AI do aplikacji czasu rzeczywistego?

Mercury 2 jest mistrzem szybkości roku 2026, dostarczając około 859.1 tokenów na sekundę. W kategorii niskiej latencji (TTFT) prowadzi NVIDIA Nemotron 3 Nano z czasem odpowiedzi około 0.40 sekundy.

Jak wysoki musi być wynik w Indeksie Inteligencji dla agentów produkcyjnych?

Do podstawowej automatyzacji lub klasyfikacji często wystarcza wynik między 30 a 40 (jak GPT-5.4 nano). Jednak dla „inżynierii agentowej” (Agentic Engineering), gdzie AI zarządza bazami kodu lub całymi sesjami przeglądarki, zalecany jest wynik powyżej 54 (taki jak Kimi K2.6 lub GPT-5.5), aby zapewnić spójność w planowaniu długohoryzontalnym.

Przy zbliżonych cenach, wybrać GPT-5.5 czy Claude Opus 4.7?

Jeśli Twój workflow obejmuje wykonywanie w terminalu i „Vibe Coding”, GPT-5.5 zazwyczaj wyróżnia się w tych konkretnych benchmarkach. Jednak jeśli potrzebujesz ekstremalnej spójności dla pisania profesjonalnego, badań prawnych lub wielodniowych cykli agentów o niskim poziomie halucynacji, Claude Opus 4.7 jest udokumentowanym liderem w tych kategoriach.

Jaka jest rzeczywista różnica wydajności między modelami z otwartymi wagami (DeepSeek) a modelami zastrzeżonymi?

W 2026 roku luka zawęziła się do około 10–15% w surowych benchmarkach wnioskowania. Choć flagowce własnościowe, takie jak GPT-5.5 (xhigh), wciąż prowadzą w „szczytowej” logice (Index 60), modele z otwartymi wagami jak DeepSeek V4 Pro (Index 52) i Kimi K2.6 (Index 54) zapewniają ponad 85% możliwości przy kosztach rzędu 1/10 ceny.

Jak mogę obniżyć całkowite koszty API dla tych modeli?

Użycie ujednoliconej warstwy API, takiej jak CometAPI, pozwala uzyskać dostęp do całego katalogu po stawkach o 20% do 40% niższych niż oficjalne ceny dostawców dzięki zakupom hurtowym i inteligentnemu trasowaniu ścieżki.

Który model ma największe okno kontekstu dla długich dokumentów?

Llama 4 Scout obecnie wspiera największe okno kontekstu na rynku — 10 milionów tokenów. Grok 4.20 plasuje się za nim z 2 milionami tokenów, podczas gdy GPT-5.5 Pro, Gemini 3.1 Pro i DeepSeek V4 Pro wspierają około 1 miliona tokenów.

Czy jest sposób, aby przetestować te benchmarki bez wysokiego kosztu początkowego?

Tak. Możesz zarejestrować darmowe konto na CometAPI, aby otrzymać środki testowe bez konieczności podawania karty kredytowej, co pozwala uruchamiać porównawcze testy wydajności dla ponad 500 modeli w wbudowanym Playground.