Doświadczenie deweloperów z analizą wideo w ChatGPT często napotyka ścianę: bezpośrednie linki do YouTube zawodzą, a przesłane pliki MP4 zwracają „zmyślone” podsumowania, które pomijają wizualne niuanse. To nie jest błąd — to ograniczenie architektoniczne. ChatGPT nie strumieniuje wideo; przetwarza sekwencje wyodrębnionych klatek i tekst transkrypcji. Próbowałeś więc przesłać plik MP4 i to zadziałało… w pewnym sensie. Podsumowanie uwzględniło transkrypt audio, ale całkowicie przegapiło żart wizualny w trzeciej scenie, który nadawał sens całemu wideo.

ChatGPT potrafi analizować filmy — ale nie poprzez ich faktyczne „oglądanie”

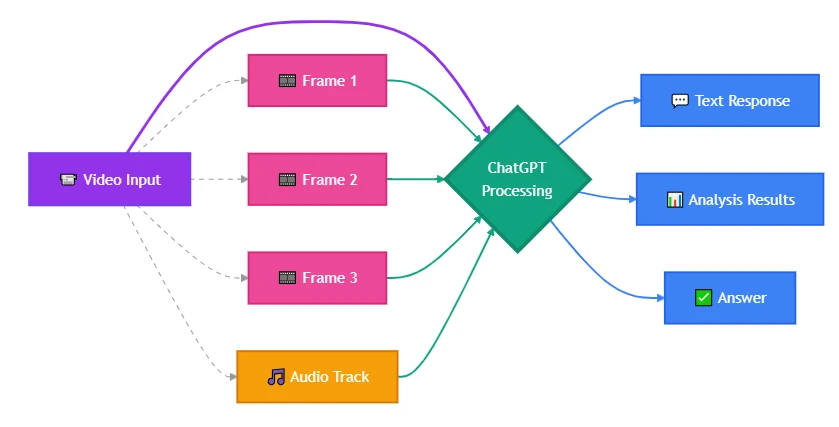

Oto, co tak naprawdę się dzieje: ChatGPT nie „ogląda” filmów tak jak ty. Nie wciska „play”, nie strumieniuje treści i nie obserwuje ruchu w czasie. Zamiast tego rozbija wideo na komponenty, z którymi już potrafi pracować — nieruchome obrazy i transkrypcję tekstu — a następnie rozumuje o tych elementach niezależnie. Model postrzega twoje wideo jako album zdjęć z narracją, a nie jako ciągłe doświadczenie. Dlatego wychwycił wyjaśnienie wypowiedziane na głos, ale przegapił puentę wizualną: klatka z żartem prawdopodobnie nie znalazła się w próbkowanym zestawie.

Gdy ktoś pyta „czy ChatGPT może oglądać filmy”, zwykle chodzi o jedno z dwóch pytań: czy potrafi strumieniować treści wizualne jak ludzki obserwator, czy potrafi wydobywać i analizować znaczenie z danych wideo — scen, dialogów, znaczników czasu, akcji na ekranie? Odpowiedź funkcjonalna na drugie pytanie brzmi „tak”, z ograniczeniami, które całkowicie wykluczają niektóre przypadki użycia. Nowoczesne warianty ChatGPT przetwarzają wideo, traktując je jako próbkowane klatki połączone z transkrypcją audio — albo poprzez automatyczną ekstrakcję w interfejsie webowym, albo przez przyjęcie dostarczonych przez użytkownika klatek przez API. To działa do streszczeń, opisu scen i ekstrakcji tekstu. Zawodzi w śledzeniu ruchu, analizie zależnej od czasu lub wszędzie tam, gdzie model musi „zobaczyć”, co dzieje się między klatkami.

Większość poradników poprzestaje na potwierdzeniu, że taka możliwość istnieje, nie wyjaśniając, dlaczego twoja konkretna implementacja nie zadziałała — ani które alternatywne wejście byłoby właściwe.

ChatGPT Możliwości wideo: co model faktycznie „widzi”

ChatGPT nie ładuje pliku MP4 i nie przewija go klatka po klatce. Ma zdolność widzenia — analizowania statycznych obrazów — oraz transkrypcję audio dzięki integracji z Whisper. Gdy przesyłasz wideo przez web lub aplikację mobilną ChatGPT, system wyodrębnia klatki kluczowe, oddzielnie transkrybuje audio i przekazuje oba strumienie do modelu jako odrębne wejścia. Model następnie opisuje to, co „zobaczył” w tych klatkach, i to, co „usłyszał” w transkrypcji.

Z twojej perspektywy wygląda to jak rozumienie wideo. Z perspektywy modelu to analiza obrazów plus przetwarzanie tekstu. Ta różnica architektoniczna determinuje, które przypadki użycia działają, a które nie.

Jeśli twoje wideo opiera się na ruchu, subtelnych zmianach między klatkami lub precyzyjnym timingu — jak wykrycie dokładnego momentu wejścia obiektu w kadr albo śledzenie animacji elementu UI — podejście oparte na klatkach kluczowych to przegapi. ChatGPT nie wyłapie dwusekundowej wskazówki wizualnej, która wypada między próbkowanymi klatkami. Nie będzie też śledzić obiektów w czasie, chyba że explicite ustrukturyzujesz wejście tak, by pokazać progresję.

Obecne możliwości wideo ChatGPT (na początku 2026 r.):

- Analiza wideo oparta na obrazach: przyjmuje pliki wideo lub wyodrębnione klatki; interpretuje treść wizualną z próbkowanych obrazów

- Transkrypcja audio: konwertuje mowę na tekst przez Whisper; model może następnie streszczać lub odpowiadać na pytania do transkryptu

- Opis scen: identyfikuje obiekty, działania, środowiska i tekst widoczny w dostarczonych klatkach

- Zapytania oparte na znacznikach czasu: może odwoływać się do konkretnych momentów, jeśli podasz znaczniki czasu klatek lub ręcznie podzielisz wideo

- Ekstrakcja tekstu: odczytuje napisy na ekranie, etykiety UI lub dokumenty widoczne w klatkach

Konkretna częstotliwość próbkowania klatek i zachowanie automatycznego wyboru klatek kluczowych w interfejsie webowym ChatGPT — nieudokumentowane publicznie na moment zamknięcia bazy wiedzy

Czego nie obejmuje:

- Wejście strumieniowane wideo w czasie rzeczywistym przez API

- Bezbłędne śledzenie ruchu lub trwałość obiektów w czasie

- Rodzime wsparcie dla kodeków wideo — całe przetwarzanie odbywa się na wyodrębnionych klatkach i audio

- Automatyczne wykrywanie zmian scen bez wyraźnego poproszenia

Pojemność wideo ograniczają limity tokenów i rozmiar pliku, nie długość. Choć 5–10 minut to praktyczna heurystyka, rzeczywiste limity skalują się dynamicznie z gęstością wizualną.

Jeśli twój przypadek użycia wymaga tych możliwości, albo wstępnie przetwarzasz wideo samodzielnie, aby wyodrębnić właściwe klatki, albo przechodzisz na model z natywną obsługą wideo. Kolejna sekcja pokazuje, którą metodę wejścia dobrać do konkretnego scenariusza.

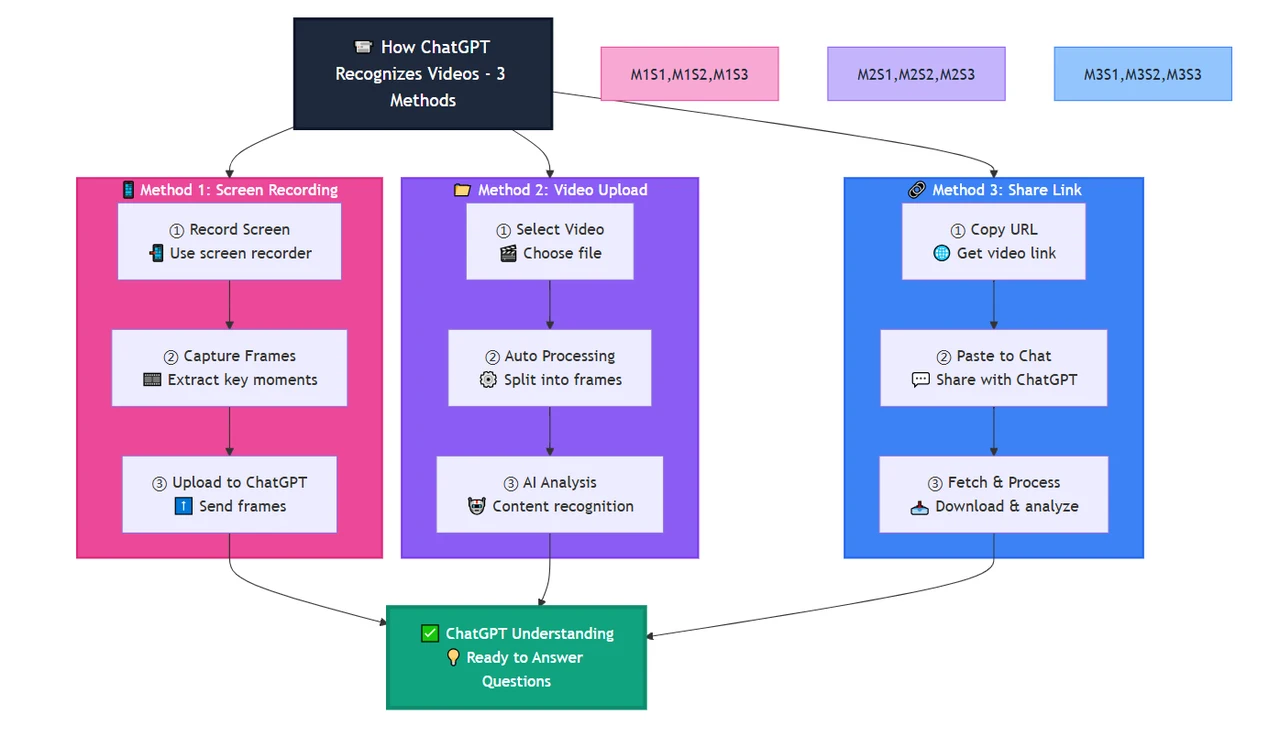

Jak ChatGPT rozpoznaje filmy: trzy praktyczne metody

Nie ma jednej drogi przesyłania wideo do ChatGPT. Metoda, którą wybierzesz, determinuje, co model może analizować, a co przeoczy. Większość porażek implementacyjnych bierze się z wyboru wygodnej metody zamiast właściwej.

Metoda 1: Ręczna ekstrakcja klatek + przesyłanie obrazów

Wyodrębnij klatki samodzielnie za pomocą ffmpeg lub podobnych narzędzi, a następnie prześlij te konkretne klatki jako obrazy. Zyskujesz pełną kontrolę nad tym, co ChatGPT analizuje.

Przykładowy workflow (bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

To podejście pozwala:

- Skupić analizę na konkretnych momentach (intro, kluczowe działanie, zakończenie), bez marnowania kontekstu na nieistotne fragmenty

- Uchwycić ruch, przesyłając kolejne klatki z wybraną przez ciebie częstotliwością próbkowania

- Obejść limity rozmiaru pliku — obrazy są mniejsze niż pełne pliki wideo

- Zachować jakość klatek, która mogłaby ulec degradacji podczas automatycznej kompresji

Kompromis:

To ty zajmujesz się preprocessingiem. Aby analizować setki filmów na skalę, potrzebna jest automatyzacja. Do jednorazowej, pogłębionej analizy lub debugowania konkretnych scen jest to najpewniejsza metoda.

Kiedy użyć tej metody:

- Potrzebujesz analizy z dokładnością do klatki w określonych momentach

- Krytyczna informacja wizualna jest krótka lub wypada między typowymi interwałami klatek kluczowych

- Porównujesz zmiany wizualne w sekwencji (stany UI, klatki animacji)

- Chcesz zweryfikować, co model faktycznie „widział”, przeglądając dokładnie te klatki, które przesłałeś

Metoda 2: Bezpośrednie przesyłanie pliku przez interfejs ChatGPT

Aplikacja webowa i mobilne ChatGPT akceptują bezpośrednie przesyłanie wideo w czacie. Upuść plik MP4 lub MOV w polu wprowadzania, a system automatycznie zajmie się ekstrakcją klatek i transkrypcją.

Co dzieje się pod spodem:

- Usługa próbuje klatki w interwałach (dokładna częstotliwość nie jest udokumentowana; na podstawie obserwacji szacuje się 1–2 kl./s)

- Audio jest transkrybowane przez Whisper lub podobną usługę

- Oba wyniki są przekazywane do modelu jako osobne wejścia kontekstowe

- Model generuje odpowiedzi na podstawie widocznych klatek i usłyszanego transkryptu

Ta metoda działa dla:

- Wysokopoziomowych streszczeń, gdy nie potrzebujesz szczegółów z dokładnością do klatki

- Identyfikacji kluczowych obiektów, osób lub środowisk utrzymujących się w scenach

- Ekstrakcji treści mówionych lub tekstu na ekranie, który pojawia się w wielu klatkach

- Szybkiej analizy wstępnej bez preprocessingu

Ta metoda zawodzi w przypadku:

- Analizy z dokładnością do klatki — nie kontrolujesz, które klatki są próbkowane

- Dłuższych treści wideo przekraczających komfortową pojemność kontekstu modelu — wymagana jest logiczna segmentacja. Bez strategicznego dzielenia lub preprocessingu modele mogą degradować jakość lub ulegać obcięciu wraz z przyspieszonym zużyciem tokenów przy dużej gęstości wizualnej

- Wykrywania ruchu, przejść lub treści zależnych od timingu, wymagających porównania kolejnych klatek

- Scenariuszy, w których krytyczna informacja wizualna pojawia się krótko między próbkowanymi klatkami

Jeśli potrzebujesz kontroli nad analizowanymi momentami, użyj Metody 1.

Metoda 3: Link do YouTube + pobranie transkryptu

Niektóre wtyczki ChatGPT i narzędzia firm trzecich deklarują „analizę filmów z YouTube”. W praktyce pobierają publiczne metadane i transkrypt wideo (jeśli dostępny), a następnie przekazują ten tekst do ChatGPT.

Działa, gdy:

- Wideo ma automatyczne lub wgrane napisy

- Twoja analiza wymaga tylko treści mówionej, a nie wizualnej

- Wideo jest publicznie dostępne (nie prywatne, nie ukryte, bez ograniczeń regionalnych)

- Streszczasz wykłady, podcasty lub wywiady, gdzie audio przenosi większość sensu

Nie działa, gdy:

- Musisz analizować treść wizualną (demonstracje na ekranie, diagramy, mimika)

- Wideo nie ma transkryptu ani napisów

- Krytyczne informacje pojawiają się wizualnie i nie są wspomniane w dialogu

- Pracujesz z prywatnymi plikami wideo lub treściami za uwierzytelnianiem

Częsty błąd: Deweloperzy oczekują pełnego zrozumienia wideo (wizualne + audio), a otrzymują jedynie streszczenie transkryptu. To w porządku dla analizy treści mówionej. Jest bezużyteczne do przeglądu demo produktu, analizy designu wizualnego lub scenariuszy, gdzie to, co „widać”, jest ważniejsze niż to, co „słychać”.

Schemat: Metoda 2 do szybkich streszczeń, gdzie precyzja nie ma znaczenia. Metoda 1 do kontrolowanej analizy, gdy potrzebujesz konkretnych klatek. Metoda 3 do treści audio, gdzie informacja wizualna jest wtórna lub nie istnieje. Wybierz w zależności od tego, gdzie żyje krytyczna informacja w twoim przypadku użycia — w ruchu, w konkretnych klatkach czy wyłącznie w dialogu.

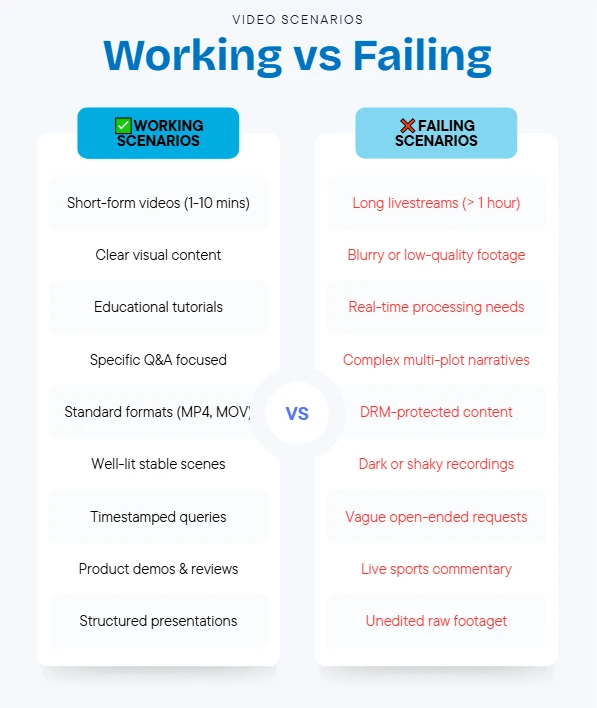

Scenariusze zastosowań wideo ChatGPT: co faktycznie działa w produkcji

Wiedza, że ChatGPT potrafi przetwarzać komponenty wideo, nie mówi, czy to właściwe narzędzie do twojego problemu. Te scenariusze pokazują, gdzie analiza oparta na klatkach się sprawdza — i gdzie ograniczenia architektoniczne łamią przypadek użycia.

Scenariusz 1: Streszczanie treści edukacyjnych

Przypadek: Masz 10‑minutowy film instruktażowy i potrzebujesz strukturalnego streszczenia kluczowych kroków, wspomnianych narzędzi i pokazanych przykładów wizualnych.

Dlaczego działa: Filmy edukacyjne zwykle mają wyraźne granice scen, trwały tekst na ekranie i narrację zgodną z wizualizacjami. Prowadzący opisuje to, co pokazuje, gdy jest to widoczne. ChatGPT potrafi przetranskrybować wyjaśnienie, zidentyfikować narzędzia lub diagramy w próbkowanych klatkach i połączyć oba elementy w ustrukturyzowany wynik.

Podejście: Prześlij film przez interfejs ChatGPT lub wyodrębnij 8–12 klatek kluczowych przy głównych przejściach tematów. Prompt: „Wypisz główne kroki wyjaśnione w tym filmie, odnosząc się zarówno do narracji, jak i do widocznego na ekranie tekstu, diagramów lub nazw narzędzi.”

Gdzie się sypie: Filmy opierające się na ciągłym ruchu — jak screencast z kodowaniem, gdzie instruktor szybko pisze w wielu plikach — będą miały brakujące kroki między klatkami. Trzeba zwiększyć częstotliwość próbkowania klatek lub oprzeć się wyłącznie na transkrypcji audio.

Praktyczna wskazówka: Dla wykładów lub tutoriali połącz automatyczne przesyłanie (dla transkryptu) z ręcznie wyodrębnionymi klatkami 3–5 najważniejszych momentów wizualnych. Zyskasz pełne pokrycie audio i wysokiej jakości obrazy kluczowych koncepcji.

Scenariusz 2: Analiza demo produktu

Przypadek: Przeglądasz demo produktu konkurencji i chcesz wyodrębnić elementy UI, nazwy funkcji, przepływy użytkownika i szczegóły cenowe pokazane na ekranie.

Dlaczego działa: Dema produktu zwykle zatrzymują każdy ekran wystarczająco długo, aby próbkowanie klatek uchwyciło statyczny UI. Nakładki tekstowe, etykiety przycisków, struktury menu i tabele cen są widoczne w wielu klatkach. Zdolność widzenia ChatGPT potrafi odczytać i opisać te elementy nawet wtedy, gdy nie są wymienione w narracji.

Podejście: Wyodrębnij klatki przy głównych zmianach scen (slajd wstępny, demo funkcji 1, demo funkcji 2, ekran cen, CTA). Prześlij te klatki i poproś: „Dla każdej klatki zidentyfikuj wszystkie widoczne elementy UI, etykiety przycisków, nazwy funkcji oraz wszelkie informacje o cenach lub produkcie.”

Gdzie się sypie: Dema z szybkimi przejściami, stanami hover odsłaniającymi informacje na krótko lub elementami interaktywnymi pokazanymi tylko przez 1–2 sekundy nie zostaną uchwycone przez próbkowanie. Jeśli konkurent szybko mignie tabelą porównawczą funkcji, przegapisz to, o ile dana chwila nie została zsamplowana.

Praktyczna wskazówka: Najpierw ręcznie przewiń wideo, by zidentyfikować znaczniki czasu ważnych ujawnień. Wyodrębnij klatki dokładnie w tych momentach, zamiast polegać na stałych interwałach próbkowania.

Scenariusz 3: Transkrypcja spotkania lub wywiadu z kontekstem wizualnym

Przypadek: Nagrałeś rozmowę z klientem i potrzebujesz zarówno transkryptu, jak i adnotacji wskazujących, kiedy pojawiły się konkretne dokumenty, slajdy lub udostępnione ekrany.

Dlaczego działa: Transkrypcja audio obsługuje dialog. Gdy uczestnicy udostępniają ekrany lub pokazują dokumenty, te pojawiają się w próbkowanych klatkach. ChatGPT może dodać adnotacje „około [timestamp] na ekranie widoczny był dokument umowy” obok transkryptu — przydatne w protokołach spotkań odnoszących się do materiałów wizualnych.

Podejście: Prześlij film i poproś: „Ztranskrybuj to spotkanie i zanotuj momenty, gdy pojawiły się dokumenty, slajdy prezentacji, udostępnione ekrany lub inne odniesienia wizualne. Dla każdego elementu wizualnego opisz, co było pokazane.”

Gdzie się sypie: Krótkie udostępnienia ekranu (poniżej 5–10 sekund) mogą wypaść między próbkowanymi klatkami. Zbyt mały tekst w skompresowanych klatkach nie będzie czytelny. W zastosowaniach prawnych/zgodności wymagających dosłownej dokładności wyświetlanych dokumentów, zweryfikuj jakość klatek i pokrycie próbkowania zanim oprzesz się na wyniku.

Praktyczna wskazówka: Dla ważnych spotkań nagrywaj w wyższej rozdzielczości i wyodrębnij klatki ręcznie w momentach, gdy ktoś mówi „pokażę ten dokument” — zapowiadając pojawienie się odniesienia wizualnego.

Scenariusz 4: Moderacja treści lub przegląd zgodności

Przypadek: Musisz skanować filmy przesyłane przez użytkowników pod kątem treści zabronionych — konkretnych logotypów, wzorców tekstu lub elementów wizualnych naruszających polityki platformy.

Dlaczego działa: ChatGPT potrafi skanować klatki pod kątem widocznego tekstu, rozpoznawalnych obiektów lub opisanych scen. Jeśli sprawdzasz, „czy którykolwiek z tych filmów pokazuje logo konkurenta”, analiza klatek wyłapie logotypy utrzymujące się na ekranie dłużej niż sekundę lub dwie.

Podejście: Wyodrębnij klatki w regularnych interwałach (co 3–5 sekund), prześlij je i poproś: „Przejrzyj te klatki i wskaż te, które zawierają [specific logo, brand name, prohibited symbol, etc.]. Dla każdego dopasowania opisz, gdzie w kadrze się znajduje.”

Gdzie się sypie: Naruszenia oparte na audio (muzyka objęta prawami, zabronione wypowiedzi) wymagają osobnej analizy audio. Naruszenia oparte na ruchu (zabronione gesty, działania rozciągnięte na wiele klatek) nie zostaną wykryte analizą statycznych obrazów. Szybko mignięte treści zabronione mogą nie pojawić się w próbkowanych klatkach.

Praktyczna wskazówka: Połącz wizualne skanowanie ChatGPT z dedykowanymi usługami odcisków audio oraz wyższymi częstotliwościami próbkowania dla kategorii wysokiego ryzyka. Traktuj ChatGPT jako filtr pierwszego przejścia, nie jedyną warstwę moderacji.

Wzorzec w udanych scenariuszach: istotna treść istnieje w dyskretnych, stabilnych klatkach i koreluje z elementami audio lub tekstowymi. Porażki występują, gdy krytyczna informacja żyje w ruchu, timingu, przejściach lub pojawia się zbyt krótko, by zostać wiarygodnie zsamplowana.

Możliwości wideo Gemini vs. Claude vs. ChatGPT

Jeśli architektura próbkowania klatek ChatGPT nie pasuje do twojego przypadku użycia, rozważasz alternatywy. Gemini i Claude oferują różne możliwości związane z wideo — a te różnice przesądzają, który model sprawdzi się w twojej implementacji.

Natywne przetwarzanie wideo w Gemini

Modele Gemini wspierają natywne wejście wideo na poziomie API. Przekazujesz plik wideo bez preprocessingu do klatek. Model przetwarza wideo jako ciągły strumień, umożliwiając śledzenie ruchu, wykrywanie zmian scen i rozumowanie temporalne, których podejście oparte na klatkach w ChatGPT nie obsługuje.

Przykładowy przypadek, w którym Gemini wygrywa:

Musisz wykryć, kiedy konkretny obiekt wchodzi i wychodzi z kadru w 30‑sekundowym klipie, albo śledzić, jak osoba porusza się po scenie. Gemini potrafi podążać za obiektami w kolejnych klatkach i rozumować o ruchu. ChatGPT zobaczyłby obiekt tylko w tych klatkach, które akurat zostały zsamplowane — potencjalnie przegapiając wejście lub wyjście.

Kompromisy:

- Natywne API Gemini jest bardziej opłacalne niż podejście oparte na próbkowaniu klatek w OpenAI. Dzięki unikaniu liniowych narzutów tokenów poprzez cache kontekstu Gemini lepiej skalują się dla długich analiz

- Przetwarzanie dłuższych filmów zwiększa latencję — model musi wczytać cały plik przed odpowiedzią

- Nie wszystkie warianty Gemini obsługują wejście wideo; wymaga późniejszych modeli Gemini

- Limity długości wideo istnieją, ale są bardziej hojnie ustawione niż ograniczenia oparte na kontekście w ChatGPT

Kiedy wybrać Gemini zamiast ChatGPT:

- Twój przypadek wymaga śledzenia ruchu, wykrywania granic scen lub rozumienia relacji w czasie

- Krytyczne informacje szybko pojawiają się i znikają między klatkami

- Analizujesz filmy, gdzie liczy się progresja zdarzeń (sport, monitoring, analiza animacji)

- Chcesz uniknąć preprocessingu polegającego na ekstrakcji klatek

Obecne ograniczenia wideo Claude

Na początku 2026 r. modele Claude nie obsługują bezpośredniego wejścia wideo przez API. Możesz przesyłać obrazy (w tym ręcznie wyodrębnione klatki), ale brak natywnej zdolności przetwarzania wideo porównywalnej z Gemini.

Co Claude potrafi:

- Analizować sekwencje przesłanych klatek, podobnie do ręcznej ekstrakcji (Metoda 2)

- Dostarczać szczegółowych opisów treści wizualnej w każdej klatce

- Rozumować o implikowanym ruchu lub zmianach między klatkami, jeśli zostanie to wyraźnie zasygnalizowane w promptach

- Obsługiwać dłuższe sekwencje obrazów dzięki rozszerzonemu oknu kontekstu (do 1M tokenów w Claude Opus 4.7)

Czego Claude nie potrafi:

- Akceptować plików wideo bezpośrednio przez jakikolwiek interfejs

- Automatycznie śledzić ruch lub obiekty między klatkami bez jawnego, klatka‑po‑klatce prowadzenia

- Transkrybować audio — wymaga osobnego preprocessingu w Whisper lub podobnym narzędziu i przekazania transkryptu do Claude

Kiedy nadal wybrać Claude:

- Twój workflow już obejmuje ekstrakcję klatek jako krok preprocessingu

- Analizujesz długie filmy wymagające wielu klatek i potrzebujesz dużego okna kontekstu Claude

- Porównujesz jakość analizy wizualnej i stwierdzasz, że opisy klatek przez Claude są trafniejsze dla twojej dziedziny (np. obrazowanie medyczne, diagramy techniczne)

- Musisz połączyć analizę klatek z dużymi ilościami innego kontekstu

Tabela porównania możliwości

| Funkcja | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Bezpośrednie przesyłanie pliku wideo | ✓ (interfejs web/aplikacja) | ✓ (API + interfejs web) | ✗ |

| Natywne śledzenie ruchu | ✗ | ✓ | ✗ |

| Transkrypcja audio | ✓ (integracja Whisper) | ✓ (zintegrowana) | ✗ (wymaga zewnętrznego narzędzia) |

| Analiza oparta na klatkach | ✓ | ✓ (także przetwarzanie ciągłe) | ✓ (tylko ręczna ekstrakcja) |

| Wykrywanie zmian scen | ✗ (tylko ręcznie) | ✓ (automatyczne) | ✗ |

| Obsługa typowej długości wideo | ~5–10 min (ograniczenie kontekstu) | ~1 godzina (zależnie od rozdzielczości) | N/D (liczba klatek ograniczona kontekstem) |

| Najlepszy przypadek użycia | Szybkie streszczenia, analiza na poziomie klatek z pewną kontrolą | Śledzenie ruchu, rozumowanie temporalne, ciągłe wideo | Głęboki opis klatka‑po‑klatce przy dużych potrzebach kontekstowych |

| Wsparcie wideo przez API | ✗ (tylko obrazy) | ✓ | ✗ |

Ramy decyzyjne:

- Wybierz ChatGPT, gdy: potrzebujesz szybkich streszczeń wideo, krytyczne informacje utrzymują się przez wiele klatek, pracujesz z krótkimi klipami (poniżej 10 minut) i nie potrzebujesz śledzenia ruchu. Najlepsze do treści edukacyjnych, statycznych dem produktowych, transkrypcji spotkań.

- Wybierz Gemini, gdy: przypadek wymaga śledzenia ruchu, wykrywania zmian scen lub rozumowania o zmianach w czasie. Krytyczne do monitoringu, analizy sportu, przeglądu animacji lub wszędzie tam, gdzie „to, co dzieje się między klatkami”, ma znaczenie.

- Wybierz Claude, gdy: już ekstraktujesz klatki w swoim pipeline, musisz analizować wiele klatek z obszernym kontekstem, lub uznajesz, że opisy wizualne Claude są trafniejsze dla twojej domeny. Wymaga najwięcej preprocessingu, ale oferuje największe okno kontekstu.

Dla deweloperów pracujących z wieloma modelami CometAPI zapewnia ujednolicony interfejs do testowania jakości przetwarzania wideo w wariantach GPT, Gemini i Claude bez przepisywania kodu integracyjnego — przydatny, gdy porównujesz jakość wyjściową przed wyborem konkretnego dostawcy.

Prawdziwa odpowiedź na pytanie „czy ChatGPT może oglądać filmy” nie jest binarna. To „tak, poprzez konwersję wideo do formatów, które już obsługuje — z ograniczeniami, które łamią konkretne przypadki użycia”. Większość porażek implementacji wynika z niedopasowania architektury, a nie z braków możliwości. Model działa dokładnie tak, jak zaprojektowano; deweloperzy po prostu oczekiwali innego projektu.

Jeśli budujesz funkcje analizy wideo na skalę, testuj swój workflow najpierw na przypadkach brzegowych: prześlij to samo wideo jako plik bezpośredni, ręcznie wyodrębnione klatki i metodą tylko z transkryptem. Porównaj wyniki. Metoda, która uchwyci krytyczny sygnał w twoim przypadku użycia — nie ta najszybsza w implementacji — przetrwa ruch produkcyjny.

Zanim zdecydujesz się na ChatGPT do wideo:

- Ustal, czy krytyczne informacje żyją w stabilnych klatkach, ruchu czy audio

- Przetestuj pokrycie próbkowania klatek, ręcznie wyodrębniając klatki w oczekiwanych interwałach

- Zweryfikuj, że tekst na ekranie jest czytelny przy rozdzielczości twojego wideo po kompresji

- Potwierdź, że długość wideo mieści się w praktycznych limitach kontekstu dla twojego planu

- Miej fallback dla treści, które pojawiają się krótko lub między próbkowanymi klatkami

Dla deweloperów oceniających wielu dostawców AI pod kątem obciążeń wideo CometAPI oferuje ujednolicony playground do testów ChatGPT, Gemini i Claude na tych samych wejściach wideo — pozwalając porównać jakość, latencję i koszt przed budową integracji specyficznych dla dostawcy.

FAQ – Przewodnik po analizie wideo przez AI

Szybkie odpowiedzi na najczęstsze pytania o analizę wideo przez AI.

Czy ChatGPT może analizować filmy?

Tak, ChatGPT (GPT-4o i nowsze) potrafi analizować filmy, próbkowując klatki (~1 na sekundę) i transkrybując audio. Dobrze sprawdza się przy streszczeniach spotkań, wyciąganiu tekstu ze slajdów i identyfikacji obiektów. Ma jednak problemy ze śledzeniem ruchu, filmami powyżej 10 minut i strumieniowaniem w czasie rzeczywistym.

Jak przesłać filmy do ChatGPT?

Bezpośrednie przesłanie URL (zalecane): Prześlij przez publiczny URL do szybkiej analizy. Najlepsze dla filmów poniżej 10 minut.

Ręczna ekstrakcja klatek: Wyodrębnij konkretne klatki dla precyzyjnej kontroli. Najlepsze, gdy musisz analizować określone momenty lub ograniczyć koszty tokenów.

Jaka jest maksymalna długość filmu, jaką ChatGPT obsłuży?

ChatGPT wiarygodnie radzi sobie z filmami do 5–10 minut. Powyżej trzeba segmentować wideo lub przejść na Gemini 2.5 Pro, który natywnie obsługuje filmy do 60 minut.

Jakie są ograniczenia analizy wideo w ChatGPT?

- Brak możliwości śledzenia ciągłego ruchu (sport, taniec)

- Niedokładne znaczniki czasu (dokł. ±1 s)

- Pomija treści pojawiające się krócej niż 1 sekunda

- Praktyczny limit 10 minut

- Brak wsparcia dla strumieniowania w czasie rzeczywistym

- Słabe wyniki przy niskiej jakości lub ciemnych nagraniach

- Słabe rozumowanie przyczynowo‑skutkowe w czasie *

Czy wybrać ChatGPT czy Gemini do analizy wideo?

Użyj ChatGPT, gdy:

- Filmy mają poniżej 10 minut

- Potrzebujesz lepszego rozumowania tekstowego po analizie wideo

- Chodzi o analizę na poziomie klatek (slajdy, zrzuty ekranu)

Użyj Gemini, gdy:

- Filmy mają 10–60 minut

- Wymagane jest śledzenie ruchu i analizy zmian

- Zadania z rozumowaniem temporalnym

- Materiał sportowy, taneczny lub z monitoringu *

Czy Claude może analizować filmy?

Nie, Claude nie obsługuje bezpośredniego wejścia wideo. Możesz jednak wyodrębnić klatki i analizować je w Claude, który oferuje lepsze rozumowanie tekstowe i większe okno kontekstu przy długich analizach.

Ile kosztuje analiza wideo?

Koszty zależą od modelu i długości wideo:

- ChatGPT 4o: ~$0.05 za minutę

- Gemini 2.5 Pro: ~$0.04 za minutę

CometAPI oferuje środki na start dla nowych użytkowników.