Claude Opus 4.7, wydany 16 kwietnia 2026 r., to znacząca aktualizacja względem Opus 4.6 w obszarach programowania, przepływów agentowych, wizji i przestrzegania instrukcji. Uzyskuje wyniki: +6,8 pp na SWE-bench Verified (87,6% vs 80,8%), +10,9 pp na SWE-bench Pro (64,3% vs 53,4%), +12 pp na CursorBench (70% vs 58%) i zapewnia 3,3× wyższą rozdzielczość wizji z pętlami samoweryfikacji, które ograniczają halucynacje przy długich zadaniach. Oficjalne ceny pozostają identyczne ($5/$25 na milion tokenów), ale tryb low-effort w 4.7 dorównuje jakości medium-effort w 4.6, co obniża realne koszty.

Na CometAPI otrzymujesz oba modele (Claude Opus 4.7 i Opus 4.6) w cenie $4 za wejście / $20 za wyjście z endpointami kompatybilnymi z OpenAI i zerowym lock-inem dostawcy. Zaktualizuj, jeśli uruchamiasz produkcyjne agentowe systemy programistyczne, złożoną analizę dokumentów lub wielosesyjne przepływy — 4.7 to nowy domyślny wybór dla pracy na granicy możliwości.

Claude Opus 4.7 vs Opus 4.6: Szybkie porównanie

Sedno: Opus 4.7 sprawia wrażenie „Opus 4.6, ale odblokowany i dopracowany”. Usuwa ograniczenia, które czasem pojawiały się w 4.6 (np. przedwczesne porzucanie zadań, niższa ostrość wizji), jednocześnie zwiększając efektywność dzięki adaptacyjnemu rozumowaniu. Użytkownicy raportują, że jest bardziej „stanowczy” i współpracujący — jak praca ze starszym inżynierem, który samodzielnie sprawdza swoją pracę.

Dlaczego Claude Opus 4.7 ma znaczenie w 2026 r.

16 kwietnia 2026 r. Anthropic po cichu wypuścił swój najbardziej zaawansowany model dostępny ogólnie: Claude Opus 4.7. Zaledwie kilka tygodni po ograniczonym Mythos Preview (mocno „cyber”-ukierunkowanym), Opus 4.7 odzyskuje prymat dla obciążeń produkcyjnych, utrzymując dokładnie tę samą cenę co Opus 4.6.

Deweloperzy i przedsiębiorstwa nie muszą już nadzorować najtrudniejszych zadań programistycznych. Użytkownicy raportują, że powierzają 4.7 „takie, które wcześniej wymagały ścisłego nadzoru” z pełnym zaufaniem. Model teraz sam weryfikuje wyniki, dosłownie podąża za instrukcjami i utrzymuje wielogodzinne przebiegi agentowe z mniejszą liczbą błędów narzędziowych i lepszym odzyskiwaniem po błędach.

Model wyróżnia się w:

- Rygorystycznych, długotrwałych zadaniach z wbudowaną samoweryfikacją (Plan → Wykonaj → Zweryfikuj → Zraportuj).

- Dosłownym przestrzeganiu instrukcji — koniec z luźną interpretacją „rozważ” czy „możesz”.

- Znacznie lepszej wizji (do 2 576 px na długim boku ≈ 3,75 MP, ponad 3× wcześniejsza rozdzielczość).

- Wyższym „smaku” i kreatywności w profesjonalnych wynikach, takich jak interfejsy, slajdy i dokumenty.

- Ulepszonej pamięci systemu plików dla prawdziwej autonomii wielosesyjnej.

Nowe funkcje obejmują poziom effort xhigh (pomiędzy high i max), budżety zadań w Platform API oraz integrację z narzędziem Claude Design. Identyfikator modelu to teraz claude-opus-4-7. Cennik pozostaje bez zmian, ale poprawa efektywności tokenów często obniża rzeczywisty koszt zadania.

Kluczowe usprawnienia możliwości — co faktycznie się zmieniło

Zaawansowane inżynieria oprogramowania i agentowe programowanie

Opus 4.7 błyszczy przy najtrudniejszych problemach. Na wewnętrznym benchmarku kodowania obejmującym 93 zadania zanotował 13% wzrost skuteczności względem 4.6, rozwiązując cztery zadania, z którymi nie poradziły sobie ani 4.6, ani Sonnet 4.6. Rakuten-SWE-Bench wykazał 3× więcej zadań produkcyjnych rozwiązanych bez interwencji człowieka. CursorBench (realne przepływy IDE) skoczył o +12 punktów do 70%.

Wewnętrzny benchmark 93 zadań kodowania wykazał 13% wzrost, rozwiązując cztery zadania, których nie rozwiązały ani 4.6, ani Sonnet 4.6. W przepływach agentowych Box zgłosił 2× mniej wywołań LLM (7,1 vs 16,3) i 30% niższe zużycie jednostek AI dla tego samego wyniku — co przekłada się bezpośrednio na koszty i opóźnienia.

Dlaczego to ma znaczenie dla deweloperów: Możesz teraz zaufać Opus 4.7 w „najtrudniejszych pracach programistycznych”, które wcześniej wymagały nadzoru. Model precyzyjnie zwraca uwagę na instrukcje, sam weryfikuje swoje wyniki i ponownie wykorzystuje pamięć systemu plików między sesjami — idealnie do autonomicznego refaktoringu przez wiele dni.

Przykłady z praktyki:

- Autonomiczny silnik text-to-speech w Rust z jednego promptu.

- Naprawione warunki wyścigu i błędy współbieżności, które pokonały wcześniejsze modele na Terminal-Bench 2.0 (+4,0 pp).

- Wzrost skuteczności Factory Droids o 10–15% przy ⅓ mniejszej liczbie błędów narzędziowych.

- Dwucyfrowe poprawy jakości kodu, jakości testów i trafności recenzji (CodeRabbit, Qodo).

Tryb low-effort w 4.7 teraz dorównuje jakości medium-effort w 4.6, więc zrobisz więcej za tę samą (lub niższą) liczbę tokenów.

Wizja i multimodalność — skok naprzód

To największa pojedyncza aktualizacja. Maksymalna rozdzielczość obrazu skacze z 1,15 MP (1568 px) do 3,75 MP (2576 px na długim boku) — 3,3× więcej pikseli z mapowaniem współrzędnych 1:1. Koniec z przeliczaniem skali dla zrzutów ekranu lub diagramów.

Rezultaty:

- Benchmark ostrości widzenia: 98,5% vs 54,5% w 4.6.

- CharXiv-R (bez narzędzi): +13,4 pp; z narzędziami: +13,6 pp.

- Odblokowuje pixel-perfect agentów do obsługi komputera, gęstą analizę zrzutów ekranów, parsowanie struktur chemicznych i przegląd UI/UX.

Przepływy agentowe, niezawodność i przestrzeganie instrukcji

Opus 4.7 wprowadza natywną samoweryfikację — model planuje, wykonuje, weryfikuje, a następnie raportuje. To znacząco redukuje pewne, ale błędne odpowiedzi w zadaniach o długim horyzoncie. Ulepszenia pamięci systemu plików umożliwiają prawdziwą autonomię wielodniową.

Przestrzeganie instrukcji jest bardziej rygorystyczne i dosłowne. Prompty dostrojone do luźniejszego stylu 4.6 mogą wymagać audytu — sformułowania takie jak „rozważ” są teraz traktowane jako twarde wymagania. To zaleta przy pracy wymagającej precyzji, ale wymaga migracji promptów.

Uwaga o regresjach: Wydobywanie igły z długiego kontekstu (MRCR) spadło zauważalnie (np. 91,9% → 59,2% przy 256K). Anthropic informuje, że odchodzi od takich syntetycznych testów na rzecz stosowanych metryk GraphWalks, gdzie realne rozumienie kodu pozostaje silne.

Nowy poziom effort xhigh + budżety zadań

Opus 4.7 dodaje xhigh pomiędzy high i max dla bardziej szczegółowej kontroli. Claude Code domyślnie używa xhigh we wszystkich planach. Nowy task_budget (public beta) pozwala modelowi śledzić całkowitą liczbę tokenów w całej pętli agentowej i kończyć pracę w kontrolowany sposób.

Przestrzeganie instrukcji, samoweryfikacja i pamięć

Opus 4.7 interpretuje prompty bardziej dosłownie — świetne dla precyzji, ale stare, niejednoznaczne prompty mogą wymagać doprecyzowania. Model sam opracowuje kroki weryfikacji (Plan → Wykonaj → Zweryfikuj → Zraportuj) i dużo lepiej niż 4.6 ponownie wykorzystuje pamięć systemu plików w pracy wielosesyjnej. Dla zespołów budujących trwałych agentów to jedno z najcenniejszych usprawnień, bo redukuje ponowne tłumaczenie, ponowne ładowanie i ponowne planowanie.

Aktualizacja tokenizera

Nowy tokenizer poprawia jakość, ale może zużywać 1,0–1,35× więcej tokenów (do +35%). Endpoint zliczania tokenów zwraca teraz inne wartości. Efekt netto: wyższa jakość na zadanie często kompensuje wzrost, szczególnie przy niższych poziomach effort.

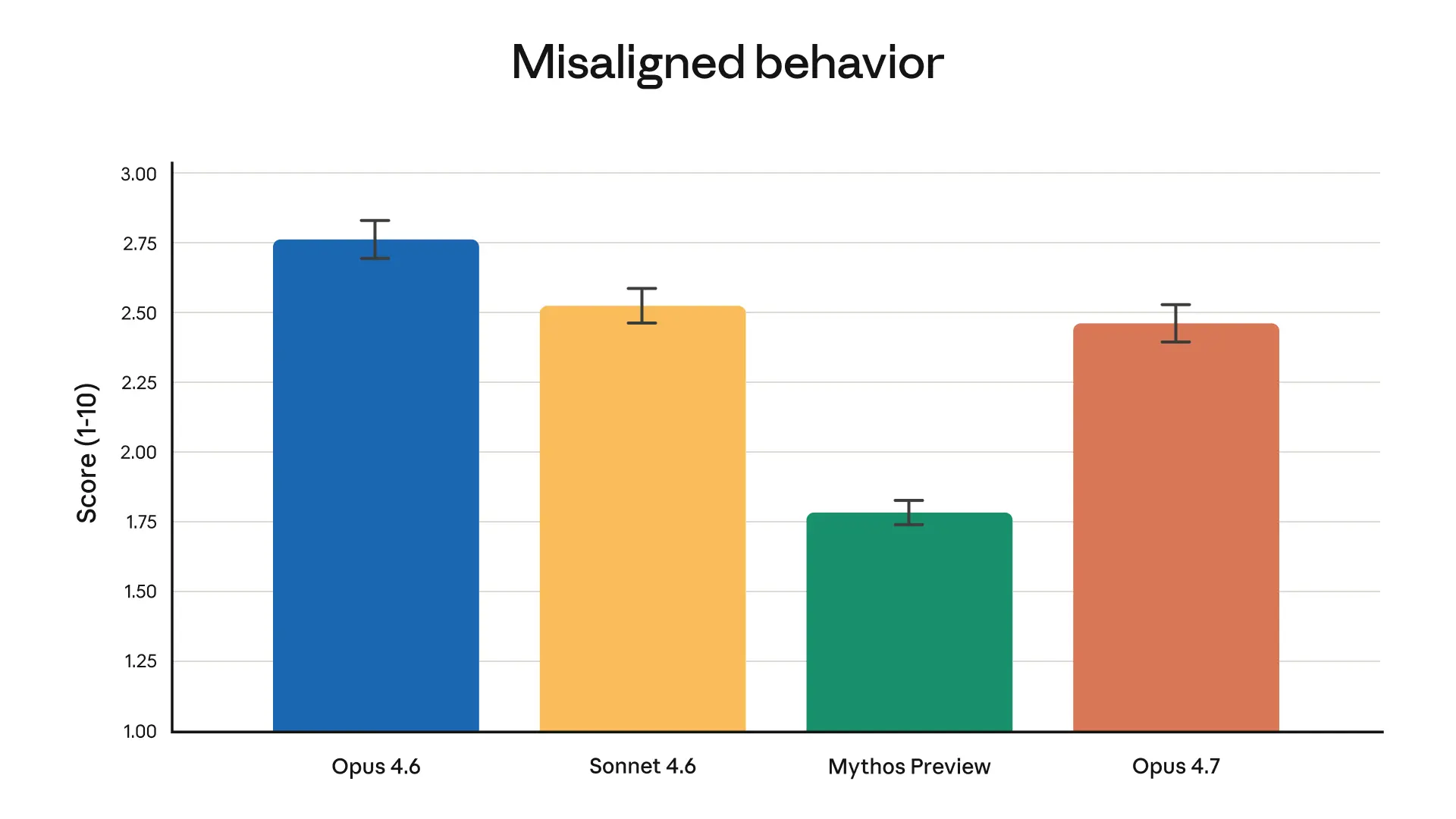

Bezpieczeństwo, alignment i cyberbezpieczeństwo

Profil bezpieczeństwa jest podobny do 4.6 (niskie rozjechanie z celem), z umiarkowanymi poprawami w uczciwości i odporności na wstrzyknięcia promptów.

Opus 4.7 dostarcza zabezpieczenia Project Glasswing: blokowanie w czasie rzeczywistym zabronionych/z wysokim ryzykiem zastosowań cyber. Wynik CyberGym celowo płaski. Zachowania niezespolone z celem umiarkowanie poprawione względem 4.6. Pełna karta systemowa dostępna na stronie Anthropic.

Cennik, efektywność tokenów i oszczędności z CometAPI

Oficjalne ceny są identyczne, ale efektywny koszt na zadanie spada, ponieważ low-effort 4.7 ≈ jakość medium-effort 4.6, a wyższy odsetek sukcesów oznacza mniej powtórzeń. Nowy tokenizer zwiększa liczbę tokenów wejściowych o 0–35% dla identycznego tekstu, ale przy dopasowanej jakości zużycie netto jest często korzystne.

Przewaga CometAPI: Dostęp do obu modeli za $4 input / $20 output na milion tokenów — o 20% taniej niż oficjalnie — plus płynne przełączanie się między 500+ modelami (GPT-5.4, Gemini 3.1 itd.) przez pojedynczy kompatybilny z OpenAI lub Anthropic Messages endpoint. Brak przestojów, jeśli dostawcy zmieniają ceny. Zero lock-inu dostawcy. Testy w Playground i ujednolicone rozliczenia ułatwiają migrację.

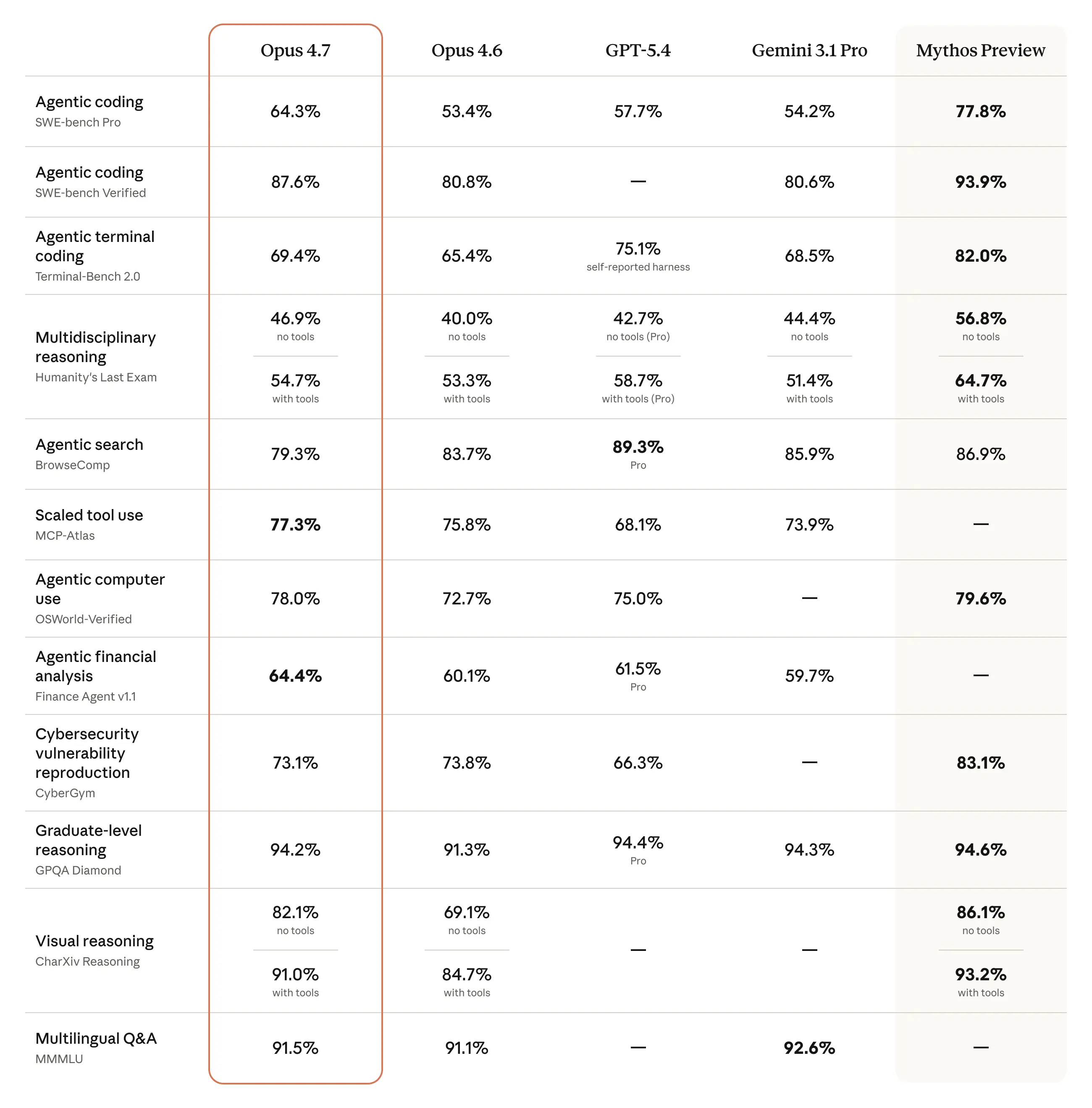

Szczegółowe porównanie benchmarków side-by-side

Oto pełne zestawienie 14 benchmarków head-to-head z danych premierowych Anthropic (zweryfikowane przez partnerów):

Benchmarki programistyczne

- SWE-bench Verified: 80,8% → 87,6% (+6,8 pp)

- SWE-bench Pro: 53,4% → 64,3% (+10,9 pp)

- Terminal-Bench 2.0: 65,4% → 69,4% (+4,0 pp)

Agentowe i użycie narzędzi

- MCP-Atlas: 62,7% → 77,3% (+14,6 pp) — największy pojedynczy skok

- OSWorld-Verified: 72,7% → 78,0% (+5,3 pp)

- Finance Agent: 60,7% → 64,4% (+3,7 pp)

Rozumowanie i wiedza

- GPQA Diamond: 91,3% → 94,2% (+2,9 pp)

- HLE (bez narzędzi): 40,0% → 46,9% (+6,9 pp)

- MMMLU: 91,1% → 91,5% (+0,4 pp)

Wizja

- CharXiv-R (bez narzędzi): 68,7% → 82,1% (+13,4 pp)

- CharXiv-R (narzędzia): 77,4% → 91,0% (+13,6 pp)

Regresje (transparentnie)

- BrowseComp: 84,0% → 79,3% (–4,7 pp) — wrażliwy na harness

- CyberGym: 73,8% → 73,1% (–0,7 pp) — celowe ze względów bezpieczeństwa

Wewnętrzny benchmark agenta badawczego: 0,715 ogółem (wyrównany najwyższy wynik), moduł Finance z 0,767 do 0,813.

Wydajność w rzeczywistych warunkach i przypadki użycia

Testy przepływów agentowych Box pokazały, że Opus 4.7 kończy zadania przy 7,1 wywołaniach LLM vs 16,3 dla 4.6 (2,3× mniej) i 30% niższym zużyciu AI Unit. Mediana opóźnienia spadła z 242 s do 183 s.

Partnerzy korporacyjni (Harvey, Databricks, Hebbia, Ramp, Genspark) raportują:

- 21% mniej błędów w rozumowaniu nad dokumentami.

- Lepszą koordynację multi-agenta przez wiele godzin.

- Tęższą integrację slajdów, arkuszy i kodu.

Kto powinien zaktualizować od razu?

- Zespoły inżynierii oprogramowania używające Cursor/Claude Code.

- Twórcy agentów AI potrzebujący niezawodnej autonomii długohoryzontalnej.

- Przepływy silnie wizualne (zrzuty ekranów, diagramy, przegląd UI).

- Finanse, prawo i automatyzacja pracy z wiedzą.

Zmiany w API, przewodnik migracji i przykłady kodu

Zmiany niezgodne wstecznie (Messages API)

- Usunięto rozszerzone budżety thinking → użyj

thinking: {"type": "adaptive"}. - Parametry próbkowania (

temperatureitd.) nie są już akceptowane → użyj promptowania. - Treść thinking domyślnie pomijana.

- Nowy tokenizer wymaga zapasu w

max_tokens.

Przewodnik migracji + przykłady kodu (CometAPI)

Krok 1: Zaktualizuj nazwę modelu do claude-opus-4-7 (lub alias CometAPI).

Krok 2: Przeaudytuj prompty pod kątem dosłownej interpretacji.

Krok 3: Przetestuj poziomy effort (zacznij od xhigh dla kodowania).

Krok 4: Użyj budżetów zadań, aby ograniczyć wydatki.

Oto gotowy do uruchomienia przykład w Pythonie z użyciem endpointu Anthropic-kompatybilnego CometAPI (działa też z oficjalnym SDK):

(Python)

import anthropic

import os

client = anthropic.Anthropic(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI sk- key

base_url="https://www.cometapi.com/console/" # CometAPI base

)

message = client.messages.create(

model="claude-opus-4-7", # or "claude-opus-4-6" for comparison

max_tokens=4096,

temperature=0.7,

effort="xhigh", # New level for deep reasoning

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Refactor this legacy Python module into clean, type-hinted, testable code. Follow instructions literally: use Pydantic v2, add comprehensive tests, no external deps beyond stdlib + pydantic. Verify your changes before responding."},

{"type": "image", "source": {"type": "base64", "media_type": "image/png", "data": "iVBORw0KGgoAAAANSUhEUg..."} } # High-res screenshot support

]

}

]

)

print(message.content[0].text)

Demo prompt samoweryfikacji (działa znacznie lepiej w 4.7):

(tekst):

Plan → Execute → Verify → Report:

1. Analyze the attached codebase.

2. Propose refactors.

3. Implement changes in a new file.

4. Run mental unit tests and edge cases.

5. Only output final verified code if all checks pass.

Uruchom testy A/B na własnych obciążeniach — większość zespołów obserwuje o 20–40% mniej iteracji.

Uwaga:

Po pierwsze, nowy tokenizer generuje więcej tokenów z tego samego tekstu. Opus 4.7 wprowadził nowy tokenizer, poprawiając przetwarzanie tekstu przez model. Kompromisem jest to, że to samo wejście będzie mapować do większej liczby tokenów; dokładna wartość zależy od typu treści, ale wynosi w przybliżeniu od 1,0 do 1,35 raza.

Po drugie, wyższe poziomy effort umożliwiają bardziej wszechstronne rozważenie, zwłaszcza w scenariuszach agentowych wieloturnowych.

To prowadzi do lepszej niezawodności, ale także większej liczby tokenów w wyjściu.

Oficjalne rozwiązanie zapewnia trzy podejścia:

- Dostosowanie poziomu effort przy użyciu parametru

efficiency - Ograniczenie budżetu przy użyciu budżetów zadań

- Polecenie modelowi w promptcie, aby „był bardziej zwięzły”.

Znane ograniczenia i uwagi migracyjne

- Usunięto rozszerzone budżety thinking → użyj

thinking: {"type": "adaptive"}.thinking: {type: "enabled", budget_tokens: N}nie jest już wspierane; zamiast tego użyj adaptive thinking. - Parametry próbkowania (

temperatureitd.) nie są już akceptowane → użyj promptowania.temperature,top_pitop_knależy usunąć z żądań podczas migracji do Opus 4.7. - Model jest bardziej dosłowny i bezpośredni niż Opus 4.6, co jest użyteczne dla precyzji, ale może wymagać ostrzejszych promptów.

- Nowy tokenizer wymaga zapasu w

max_tokens. Anthropic zaleca ponowne sprawdzenie zapasumax_tokens, ponieważ Opus 4.7 może produkować wyższą liczbę tokenów dla tego samego tekstu. - Zawartość thinking jest domyślnie pomijana.

Ostateczny werdykt i rekomendacja

Claude Opus 4.7 to bezdyskusyjny zwycięzca dla poważnych obciążeń programistycznych, agentowych i wizualnych w 2026 r. Zyski nie są inkrementalne — są transformacyjne dla produkcji. Jeśli używasz Opus 4.6, zmigruj w tym tygodniu. Połączenie wyższej jakości, mniejszej liczby wywołań i identycznego (lub niższego przez CometAPI) cennika czyni tę decyzję oczywistą.

Działania:

- Przetestuj 4.7 w Playground CometAPI na swoich realnych obciążeniach.

- Zaktualizuj najpierw jedną usługę (Cursor lub twoje frameworki agentowe).

- Monitoruj użycie tokenów przez pierwszy tydzień.

- Skaluj z pewnością, mając ujednolicony, tańszy dostęp do 500+ modeli.