Gemini 3 Pro (Preview) to najnowszy flagowy multimodalny model rozumowania Google/DeepMind z rodziny Gemini 3. Pozycjonowany jako „najinteligentniejszy model do tej pory”, zaprojektowany do głębokiego rozumowania, agentowych przepływów pracy, zaawansowanego kodowania oraz długokontextowego rozumienia multimodalnego (tekst, obrazy, audio, wideo, kod i integracje narzędziowe).

Kluczowe funkcje

- Modalności: tekst, obraz, wideo, audio, PDF (oraz strukturyzowane wyjścia narzędzi).

- Agentowość/narzędzia: wbudowane wywoływanie funkcji, wyszukiwanie jako narzędzie, wykonywanie kodu, kontekst URL oraz wsparcie dla orkiestracji wieloetapowych agentów. Mechanizm „thought-signature” zachowuje wieloetapowe rozumowanie między wywołaniami.

- Kodowanie i „vibe coding”: zoptymalizowany pod generowanie front-endu, interaktywne generowanie interfejsów oraz agentowe kodowanie (lider odpowiednich rankingów raportowanych przez Google). Promowany jako najsilniejszy dotąd model do „vibe-coding”.

- Nowe kontrolki dla deweloperów:

thinking_level(low|high) do równoważenia kosztu/opóźnienia względem głębokości rozumowania orazmedia_resolutiondo kontroli wierności multimodalnej na obraz/kadr wideo. Pomaga to zbalansować wydajność, opóźnienie i koszt.

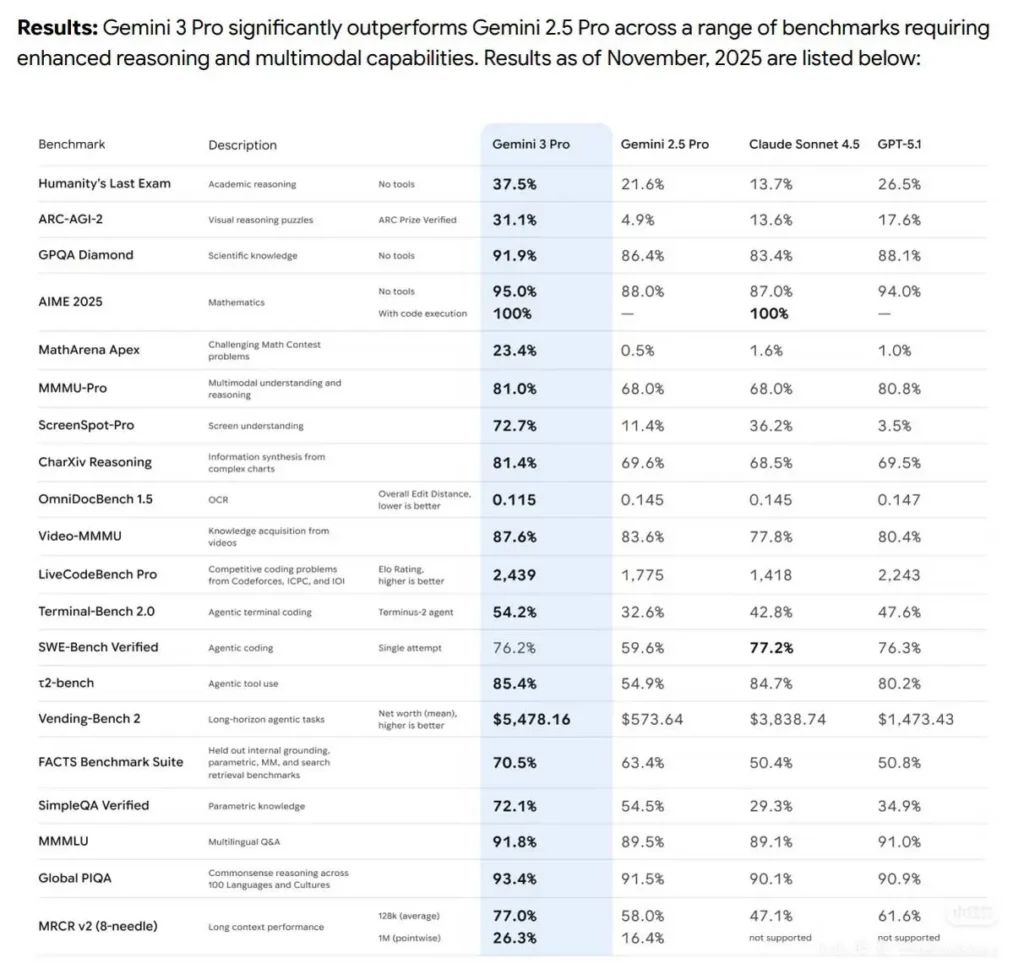

Wyniki w benchmarkach

- Gemini3Pro zdobył pierwsze miejsce w LMARE z wynikiem 1501, wyprzedzając 1484 punkty Grok-4.1-thinking oraz prowadząc przed Claude Sonnet 4.5 i Opus 4.1.

- Zajął też pierwsze miejsce w arenie programistycznej WebDevArena z wynikiem 1487.

- W Humanity’s Last Exam z zakresu akademickiego rozumowania osiągnął 37,5% (bez narzędzi); w GPQA Diamond (nauki ścisłe) 91,9%; a w konkursie matematycznym MathArena Apex 23,4%, ustanawiając nowy rekord.

- W zdolnościach multimodalnych MMMU-Pro osiągnął 81%; a w Video-MMMU w zakresie rozumienia wideo 87,6%.

Szczegóły techniczne i architektura

- Parametr „thinking level”: Gemini 3 udostępnia kontrolkę

thinking_level, która pozwala deweloperom wymieniać głębokość wewnętrznego rozumowania na opóźnienie/koszt. Model traktujethinking_leveljako względny limit na wewnętrzne wieloetapowe rozumowanie, a nie ścisłą gwarancję liczby tokenów. Domyślnie zazwyczajhighdla Pro. To jawna nowa kontrola do strojenia wieloetapowego planowania i głębokości chain-of-thought. - Strukturyzowane wyjścia i narzędzia: model wspiera strukturyzowane wyjścia JSON i może być łączony z wbudowanymi narzędziami (osadzanie Google Search, kontekst URL, wykonywanie kodu itd.). Część funkcji structured-output+tools jest dostępna wyłącznie w trybie podglądu dla

gemini-3-pro-preview. - Integracje multimodalne i agentowe: Gemini 3 Pro jest explicite zbudowany pod agentowe przepływy pracy (narzędzia + wielu agentów nad kodem/terminalami/przeglądarką).

- Akceptuje wejścia tekstowe, obraz, wideo, audio i PDF; wyjście tekstowe.

Ograniczenia i znane zastrzeżenia

- Nie doskonała faktografia — halucynacje są nadal możliwe. Pomimo deklarowanych przez Google istotnych usprawnień, w środowiskach wysokiego ryzyka (prawnych, medycznych, finansowych) konieczna jest weryfikacja z ugruntowaniem i przegląd ludzki.

- Zmienna skuteczność przy długim kontekście. Obsługa okna wejściowego 1M to twarda możliwość, ale empiryczna skuteczność spada na niektórych benchmarkach przy ekstremalnych długościach (obserwowane punktowe spadki przy 1M w niektórych testach długiego kontekstu).

- Kompromisy koszt/opóźnienie. Duże konteksty i wyższe ustawienia

thinking_levelzwiększają obliczenia, opóźnienie i koszt; progi cenowe zależą od wolumenów tokenów. Używajthinking_leveli strategii dzielenia na fragmenty, aby zarządzać kosztami. - Bezpieczeństwo i filtry treści. Google nadal stosuje polityki bezpieczeństwa i warstwy moderacji; niektóre treści i działania pozostają ograniczone lub wywołają tryby odmowy.

Jak Gemini 3 Pro Preview wypada na tle innych topowych modeli

Wysokopoziomowe porównanie (preview → jakościowe):

Wobec Gemini 2.5 Pro: skokowe ulepszenia w rozumowaniu, agentowym użyciu narzędzi i integracji multimodalnej; znacznie większa obsługa kontekstu i lepsze rozumienie długich form. DeepMind pokazuje spójne zyski w zakresie akademickiego rozumowania, kodowania i zadań multimodalnych.

Wobec GPT-5.1 i Claude Sonnet 4.5 (wg raportów): na zestawie benchmarków Google/DeepMind Gemini 3 Pro jest przedstawiany jako prowadzący w kilku metrykach agentowych, multimodalnych i długiego kontekstu (zob. Terminal-Bench, MMMU-Pro, AIME). Wyniki porównawcze różnią się w zależności od zadania.

Typowe i wysokowartościowe przypadki użycia

- Podsumowywanie długich dokumentów/książek i Q&A: wsparcie długiego kontekstu czyni go atrakcyjnym dla zespołów prawnych, badawczych i compliance.

- Zrozumienie i generowanie kodu w skali repozytorium: integracja z łańcuchami narzędzi do kodowania i ulepszone rozumowanie pomagają w refaktoryzacjach dużych baz kodu i zautomatyzowanych przeglądach.

- Multimodalni asystenci produktowi: przepływy obraz + tekst + audio (obsługa klienta, która przetwarza zrzuty ekranu, fragmenty rozmów i dokumenty).

- Generowanie i edycja mediów (zdjęcie→wideo): wcześniejsze funkcje rodziny Gemini obejmują teraz możliwości w stylu Veo/Flow dla konwersji zdjęcie→wideo; podgląd sugeruje głębsze multimedia dla prototypów i przepływów medialnych.

Jak wywołać API gemini-3-pro-preview z CometAPI

Cennik Gemini 3 Pro Preview w CometAPI, 20% taniej niż cena oficjalna:

| Input Tokens | $1.60 |

| Output Tokens | $9.60 |

Wymagane kroki

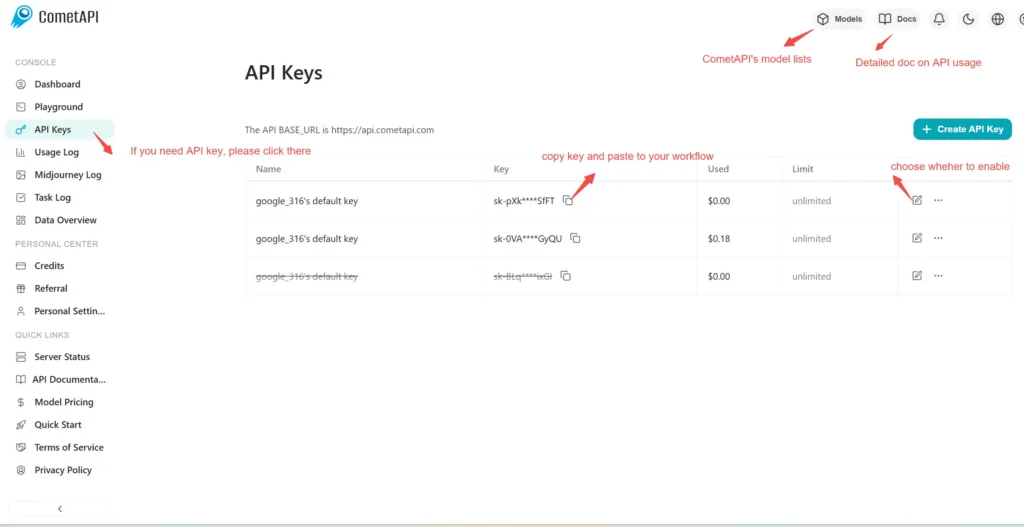

- Zaloguj się na cometapi.com. Jeśli nie jesteś naszym użytkownikiem, zarejestruj się najpierw.

- Zaloguj się do konsoli CometAPI.

- Uzyskaj klucz dostępu API interfejsu. Kliknij „Add Token” przy tokenie API w centrum osobistym, pobierz klucz tokena: sk-xxxxx i zatwierdź.

Sposób użycia

- Wybierz endpoint „

gemini-3-pro-preview”, aby wysłać żądanie API i ustaw ciało żądania. Metoda żądania i ciało żądania są dostępne w naszej dokumentacji API na stronie. Nasza strona oferuje również testy w Apifox dla Twojej wygody. - Zastąp <YOUR_API_KEY> swoim rzeczywistym kluczem CometAPI z konta.

- Wstaw swoje pytanie lub prośbę do pola content — na to odpowie model.

- . Przetwórz odpowiedź API, aby uzyskać wygenerowaną odpowiedź.

CometAPI zapewnia w pełni kompatybilne REST API — dla bezproblemowej migracji. Kluczowe szczegóły do Chat:

- Base URL: v1/chat/completions

- Model Names:

gemini-3-pro-preview - Authentication:

Bearer YOUR_CometAPI_API_KEYheader - Content-Type:

application/json.

Zobacz też GPT-5.1 API