na dzień 15 grudnia 2025 r. publicznie dostępne informacje pokazują, że Google’s Gemini 3 Pro (wersja zapoznawcza) i OpenAI’s GPT-5.2 oba wyznaczają nowe granice w rozumowaniu, multimodalności i pracy z długim kontekstem — lecz podążają różnymi ścieżkami inżynieryjnymi (Gemini → rzadki MoE + ogromny kontekst; GPT-5.2 → gęste/„routingowe” projekty, kompaktowanie i tryby rozumowania xhigh), przez co wymieniają się między sobą szczytowymi zwycięstwami w benchmarkach a przewidywalnością inżynieryjną, narzędziami i ekosystemem. To, które jest „lepsze”, zależy od głównej potrzeby: aplikacje agentowe o ekstremalnym kontekście i multimodalności skłaniają się ku Gemini 3 Pro; stabilne narzędzia deweloperskie dla przedsiębiorstw, przewidywalne koszty i natychmiastowa dostępność API przemawiają za GPT-5.2.

What is GPT-5.2 and what are its main features?

GPT-5.2 to wydanie OpenAI z 11 grudnia 2025 r. w rodzinie GPT-5 (warianty: Instant, Thinking, Pro). Pozycjonowany jako najpotężniejszy model firmy do „profesjonalnej pracy z wiedzą” — zoptymalizowany pod arkusze kalkulacyjne, prezentacje, rozumowanie na długim kontekście, wywoływanie narzędzi, generowanie kodu i zadania wizji. OpenAI udostępniło GPT-5.2 płatnym użytkownikom ChatGPT oraz przez OpenAI API (Responses API / Chat Completions) pod nazwami modeli takimi jak gpt-5.2, gpt-5.2-chat-latest i gpt-5.2-pro.

Model variants and intended use

- gpt-5.2 / GPT-5.2 (Thinking) — najlepszy do złożonego, wieloetapowego rozumowania (domyślny wariant rodziny „Thinking” używany w Responses API).

- gpt-5.2-chat-latest / Instant — niższa latencja do codziennej asysty i czatu.

- gpt-5.2-pro / Pro — najwyższa wierność/niezawodność dla najtrudniejszych problemów (dodatkowa moc obliczeniowa, wspiera

reasoning_effort: "xhigh").

Key technical features (user-facing)

- Ulepszenia wizji i multimodalności — lepsze rozumowanie przestrzenne na obrazach i poprawiona analiza wideo przy wsparciu narzędzi kodowych (narzędzie Python), plus wsparcie dla narzędzi w stylu code-interpreter do wykonywania fragmentów.

- Konfigurowalny wysiłek rozumowania (

reasoning_effort: none|minimal|low|medium|high|xhigh) dla kompromisu między latencją/kosztem a głębokością.xhighto nowość w GPT-5.2 (wspierana w Pro). - Ulepszone radzenie sobie z długim kontekstem i funkcje kompaktowania, aby rozumować na setkach tysięcy tokenów (OpenAI raportuje mocne metryki MRCRv2 / long-context).

- Zaawansowane wywoływanie narzędzi i przepływy agentowe — silniejsza koordynacja wieloturu, lepsza orkiestracja narzędzi w architekturze „pojedynczego mega-agenta” (OpenAI podkreśla wyniki narzędzi w Tau2-bench).

What is Gemini 3 Pro Preview?

Gemini 3 Pro Preview to najbardziej zaawansowany model generatywnej SI Google, wydany jako część szerszej rodziny Gemini 3 w listopadzie 2025 r. Model kładzie nacisk na zrozumienie multimodalne — potrafi rozumieć i syntezować tekst, obrazy, wideo i audio — i oferuje duże okno kontekstu (~1 milion tokenów) do obsługi obszernych dokumentów lub baz kodu.

Google pozycjonuje Gemini 3 Pro jako stan techniki w zakresie głębi i niuansów rozumowania i wykorzystuje go jako silnik dla wielu narzędzi deweloperskich i korporacyjnych, w tym Google AI Studio, Vertex AI oraz platform rozwoju agentów, takich jak Google Antigravity.

Na ten moment Gemini 3 Pro jest w wersji preview — co oznacza, że funkcjonalność i dostęp wciąż się rozszerzają, ale model już teraz osiąga wysokie wyniki w logice, zrozumieniu multimodalnym i przepływach agentowych.

Key technical & product features

- Context window: Gemini 3 Pro Preview obsługuje 1,000,000-token input (i do 64k token outputs), co stanowi istotną przewagę praktyczną przy wczytywaniu niezwykle dużych dokumentów, książek lub transkryptów wideo w jednym żądaniu.

- API features: parametr

thinking_level(low/high) do kompromisu między latencją a głębią rozumowania; ustawieniamedia_resolutiondo kontroli wierności multimodalnej i użycia tokenów; wspierane są ugruntowanie wyszukiwaniem, kontekst plików/URL, wykonywanie kodu i wywoływanie funkcji. Thought signatures i cache kontekstu pomagają utrzymać stan w przepływach wielowywołaniowych. - Deep Think mode / higher reasoning: opcja „Deep Think” zapewnia dodatkowe przejście rozumowania, by podbić wyniki w trudnych benchmarkach. Google publikuje Deep Think jako osobną ścieżkę wysokiej wydajności dla złożonych problemów.;

- Multimodal native support: wejścia tekst, obraz, audio i wideo z bliskim ugruntowaniem do wyszukiwania i integracji produktowych (podkreślane są wyniki Video-MMMU i inne benchmarki multimodalne).

Quick preview — GPT-5.2 vs Gemini 3 Pro

Zwięzła tabela porównawcza z najważniejszymi faktami (z podaniem źródeł).

| Aspect | GPT-5.2 (OpenAI) | Gemini 3 Pro (Google / DeepMind) |

|---|---|---|

| Vendor / positioning | OpenAI — flagowa aktualizacja GPT-5.x skupiona na profesjonalnej pracy z wiedzą, kodowaniu i przepływach agentowych. | Google DeepMind / Google AI — flagowa generacja Gemini skupiona na ultradługim kontekście, multimodalnym rozumowaniu i integracji narzędzi. |

| Main model flavors | Instant, Thinking, Pro (oraz Auto przełączające się między nimi). Pro dodaje wyższy wysiłek rozumowania. | Rodzina Gemini 3 zawierająca Gemini 3 Pro i tryby Deep-Think; nacisk na multimodalność/przepływy agentowe. |

| Context window (input / output) | ~400,000 łącznej pojemności wejściowej; do 128,000 tokenów wyjścia/rozumowania (zaprojektowany pod bardzo długie dokumenty i bazy kodu). | Do ~1,000,000 tokenów wejścia/okna kontekstu (1M) z maks. 64K tokenów wyjścia |

| Key strengths / focus | Rozumowanie na długim kontekście, agentowe wywoływanie narzędzi, kodowanie, ustrukturyzowane zadania biurowe (arkusze, prezentacje); aktualizacje bezpieczeństwa i kart systemowych podkreślają niezawodność. | Zrozumienie multimodalne na skalę, rozumowanie + kompozycja obrazów, bardzo duży kontekst + tryb rozumowania „Deep Think”, silne integracje narzędzi/agentów w ekosystemie Google. |

| Multimodal & image capabilities | Ulepszona wizja i ugruntowanie multimodalne; dostrojony do użycia narzędzi i analizy dokumentów. | Obrazowanie wysokiej wierności + kompozycja z ulepszonym rozumowaniem, edycja wieloreferencyjna obrazów i czytelne renderowanie tekstu. |

| Latency / interactivity | Dostawca podkreśla szybszą inferencję i responsywność promptów (niższa latencja niż wcześniejsze modele GPT-5.x); wiele poziomów (Instant / Thinking / Pro). | Google podkreśla zoptymalizowany „Flash”/serwowanie i porównywalne prędkości interaktywne dla wielu przepływów; tryb Deep Think wymienia latencję na głębsze rozumowanie. |

| Notable features / differentiators | Poziomy wysiłku rozumowania (medium/high/xhigh), ulepszone wywoływanie narzędzi, wysokiej jakości generowanie kodu, wysoka efektywność tokenowa dla przepływów korporacyjnych. | 1M tokenów kontekstu, silne natywne wczytywanie multimodalne (wideo/audio), tryb rozumowania „Deep Think”, ścisłe integracje z produktami Google (Docs/Drive/NotebookLM). |

| Typical best uses (short) | Analiza długich dokumentów, przepływy agentowe, złożone projekty kodowe, automatyzacja przedsiębiorstw (arkusze/raporty). | Ekstremalnie duże projekty multimodalne, długohoryzontowe przepływy agentowe wymagające kontekstu 1M tokenów, zaawansowane potoki obraz + rozumowanie. |

How do GPT-5.2 and Gemini 3 Pro compare architecturally?

Core architecture

- Benchmarks / real-work evals: GPT-5.2 Thinking osiągnął 70,9% zwycięstw/remisów w GDPval (ewaluacja pracy z wiedzą dla 44 zawodów) i duże wzrosty na benchmarkach inżynierskich i matematycznych względem wcześniejszych wariantów GPT-5. Znaczące poprawy w kodowaniu (SWE-Bench Pro) i naukowych QA (GPQA Diamond).

- Tooling & agents: Silne wbudowane wsparcie dla wywoływania narzędzi, wykonywania Pythona i przepływów agentowych (wyszukiwanie dokumentów, analiza plików, agenci data science). 11× szybciej / <1% kosztu vs eksperci-ludzie dla niektórych zadań GDPval (miara potencjalnej wartości ekonomicznej, 70,9% vs. wcześniejsze ~38,8%) oraz konkretne zyski w modelowaniu arkuszy (np. +9,3% w zadaniu dla młodszego analityka IB vs GPT-5.1).

- Gemini 3 Pro: Rzadki Transformer Mixture-of-Experts (MoE). Model aktywuje niewielki zestaw ekspertów na token, umożliwiając niezwykle dużą łączną pojemność parametrów przy subliniowym koszcie na token. Google publikuje kartę modelu wyjaśniającą, że rzadki MoE jest kluczowym czynnikiem poprawy profilu wydajności. Ta architektura umożliwia podbicie pojemności modelu znacznie wyżej bez liniowego kosztu inferencji.

- GPT-5.2 (OpenAI): OpenAI kontynuuje użycie architektur opartych na Transformerach ze strategiami routingu/kompaktowania w rodzinie GPT-5 ( „router” wyzwala różne tryby — Instant vs Thinking — a firma dokumentuje techniki kompaktowania i zarządzania tokenami dla długich kontekstów). GPT-5.2 kładzie nacisk na trening i ewaluacje „pomyśl zanim odpowiesz” oraz kompaktowanie dla zadań długohoryzontowych, zamiast ogłaszać klasyczny rzadki MoE na dużą skalę.

Implications of the architectures

- Kompromisy latencji i kosztu: Modele MoE jak Gemini 3 Pro mogą oferować wyższą szczytową zdolność na token przy utrzymaniu niższego kosztu inferencji dla wielu zadań, ponieważ uruchamiana jest tylko podgrupa ekspertów. Mogą jednak dodawać złożoność do serwowania i schedulingu (zimny start ekspertów, IO). Podejście GPT-5.2 (gęste/routowane z kompaktowaniem) sprzyja przewidywalnej latencji i ergonomii deweloperskiej — zwłaszcza w narzędziach OpenAI, takich jak Responses, Realtime, Assistants i batch API.

- Skalowanie długiego kontekstu: 1M tokenów wejścia w Gemini pozwala podawać niezwykle długie dokumenty i strumienie multimodalne natywnie. ~400k łączonego kontekstu (wejście+wyjście) w GPT-5.2 nadal jest ogromne i pokrywa większość potrzeb korporacyjnych, lecz jest mniejsze niż 1M w specyfikacji Gemini. Dla bardzo dużych korpusów czy wielogodzinnych transkryptów wideo specyfikacja Gemini daje wyraźną przewagę techniczną.

Tooling, agents, and multimodal plumbing

- OpenAI: głęboka integracja wywoływania narzędzi, wykonywania Pythona, trybów rozumowania „Pro” i płatnych ekosystemów agentów (ChatGPT Agents / integracje narzędzi dla przedsiębiorstw). Silny nacisk na przepływy zorientowane na kod oraz generowanie arkuszy/slajdów jako pełnoprawnych wyników.

- Google / Gemini: wbudowane ugruntowanie do Google Search (opcjonalna funkcja rozliczana), wykonywanie kodu, kontekst URL i plików oraz jawne sterowanie rozdzielczością mediów, aby wymieniać tokeny na wierność wizualną. API oferuje

thinking_leveli inne pokrętła do strojenia kosztu/latencji/jakości.

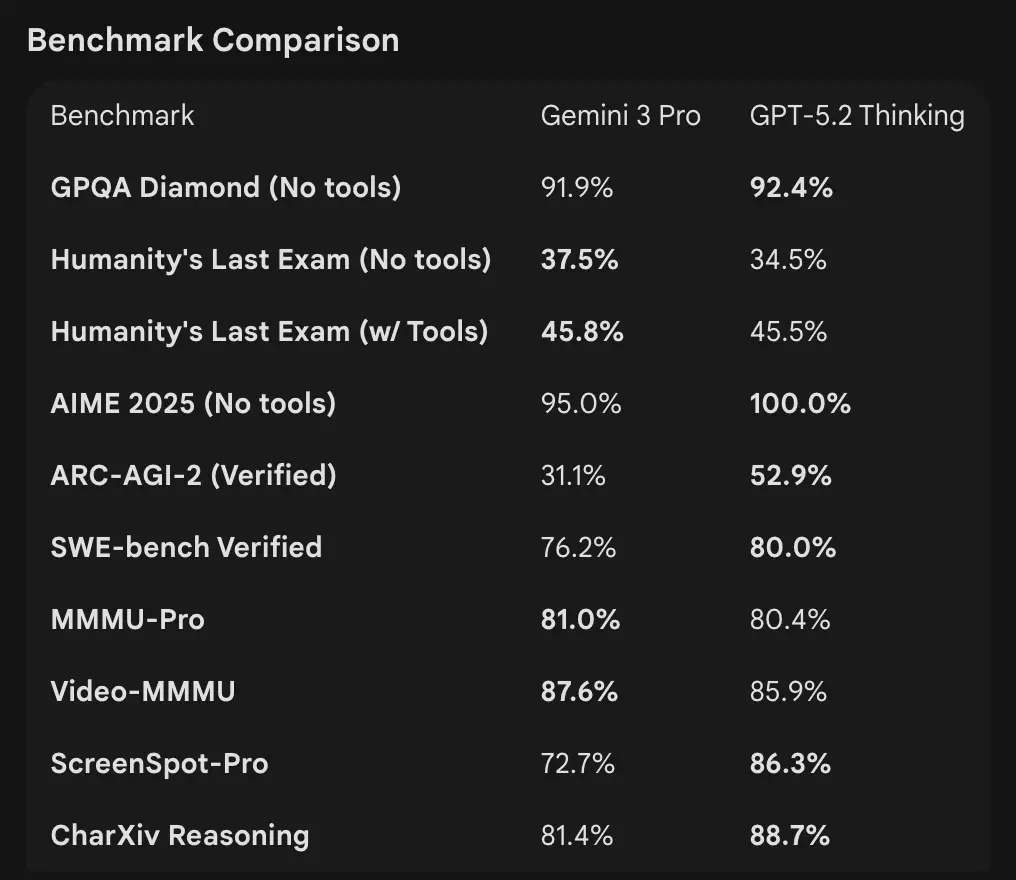

How do the benchmark numbers compare

Context windows and token handling

- Gemini 3 Pro Preview: 1,000,000 input tokens / 64k output tokens (karta modelu Pro preview). Knowledge cutoff: January 2025 (Google).

- GPT-5.2: OpenAI demonstruje silną wydajność w długim kontekście (wyniki MRCRv2 w testach „needle” 4k–256k z >85–95% w wielu ustawieniach) oraz używa funkcji kompaktowania; publiczne przykłady kontekstu wskazują solidne działanie nawet przy bardzo dużych kontekstach, ale OpenAI listuje okna specyficzne dla wariantów (i podkreśla kompaktowanie zamiast pojedynczej liczby 1M). Do użycia w API, nazwy modeli to

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-pro.

Reasoning and agentic benchmarks

- OpenAI (wybór): Tau2-bench Telecom 98,7% (GPT-5.2 Thinking), duże wzrosty w wieloetapowym użyciu narzędzi i zadaniach agentowych (OpenAI podkreśla scalenie systemów multi-agentowych w „mega-agenta”). GPQA Diamond i ARC-AGI wykazały wzrosty względem GPT-5.1.

- Google (wybór): Gemini 3 Pro: LMArena 1501 Elo, MMMU-Pro 81%, Video-MMMU 87,6%, wysokie GPQA i Humanity’s Last Exam; Google pokazuje też silne planowanie długohoryzontowe w przykładach agentowych.

Tooling & agents:

GPT-5.2: Silne wbudowane wsparcie dla wywoływania narzędzi, wykonywania Pythona i przepływów agentowych (wyszukiwanie dokumentów, analiza plików, agenci data science). 11× szybciej / <1% kosztu vs eksperci-ludzie dla niektórych zadań GDPval (miara potencjalnej wartości ekonomicznej, 70,9% vs. wcześniejsze ~38,8%) oraz konkretne zyski w modelowaniu arkuszy (np. +9,3% w zadaniu dla młodszego analityka inwestycyjnego vs GPT-5.1).

Interpretation: benchmarki się uzupełniają — OpenAI podkreśla benchmarki „realnej pracy z wiedzą” (GDPval), pokazujące, że GPT-5.2 wyróżnia się w zadaniach produkcyjnych, takich jak arkusze, slajdy i długie sekwencje agentowe. Google akcentuje „surowe” rankingi rozumowania i ekstremalnie duże okna kontekstu jednorazowego żądania. Co ważniejsze zależy od obciążenia: agentowe potoki długodokumentowe w przedsiębiorstwach sprzyjają udowodnionej wydajności GPT-5.2 w GDPval; wczytywanie masywnego surowego kontekstu (np. całe korpusy wideo/pełne książki w jednym przebiegu) faworyzuje 1M okna wejściowe Gemini.

How do multimodal capabilities compare?

Inputs & outputs

- Gemini 3 Pro Preview: obsługuje wejścia tekst, obraz, wideo, audio, PDF oraz wyjścia tekstowe; Google zapewnia granularne sterowanie

media_resolutioni parametrthinking_level, by stroić koszt vs. wierność pracy multimodalnej. Limit tokenów wyjścia 64k; wejście do 1M tokenów. - GPT-5.2: obsługuje rozbudowane przepływy wizji i multimodalne; OpenAI podkreśla poprawione rozumowanie przestrzenne (szacowane etykiety składowych obrazu), zrozumienie wideo (wyniki Video MMMU) i wizję wspieraną narzędziami (narzędzie Python na zadaniach wizji poprawia wyniki). GPT-5.2 akcentuje, że złożone zadania wizja + kod silnie zyskują przy włączonej obsłudze narzędzi (wykonywanie kodu Pythona).

Practical differences

Granularność vs. szerokość: Gemini udostępnia zestaw pokręteł multimodalnych (media_resolution, thinking_level), aby deweloperzy mogli stroić kompromisy per typ medium. GPT-5.2 kładzie nacisk na zintegrowane użycie narzędzi (wykonywanie Pythona w pętli), aby łączyć wizję, kod i transformacje danych. Jeśli przypadek użycia to ciężka analiza wideo + obrazów z ekstremalnie dużymi kontekstami, 1M kontekst Gemini jest przekonujący; jeśli przepływy wymagają wykonywania kodu w pętli (transformacje danych, generowanie arkuszy), narzędzia kodowe i przyjazność dla agentów w GPT-5.2 mogą być wygodniejsze.

What about API access, SDKs and pricing?

OpenAI GPT-5.2 (API & pricing)

- API:

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-proprzez Responses API / Chat Completions. Dojrzałe SDK (Python/JS), przewodniki „cookbook” i bogaty ekosystem. - Pricing (public): $1.75 / 1M input tokens i $14 / 1M output tokens; zniżki cache (90% dla cache’owanych wejść) obniżają efektywny koszt dla powtarzalnych danych. OpenAI podkreśla efektywność tokenową (wyższa cena za token, ale mniejszy łączny koszt do osiągnięcia progu jakości).

Gemini 3 Pro Preview (API & pricing)

- API:

gemini-3-pro-previewprzez Google GenAI SDK i endpointy Vertex AI/GenerativeLanguage. Nowe parametry (thinking_level,media_resolution) i integracja z ugruntowaniami i narzędziami Google. - Pricing (public preview): w przybliżeniu $2 / 1M input tokens i $12 / 1M output tokens dla poziomów preview poniżej 200k tokenów; mogą obowiązywać dodatkowe opłaty za Search grounding, Maps lub inne usługi Google (rozliczanie Search grounding od 5 stycznia 2026).

Use GPT-5.2 and Gemini 3 Via CometAPI

CometAPI to brama/koncentrator API: pojedynczy, w stylu OpenAI, endpoint REST, który daje ujednolicony dostęp do setek modeli od wielu dostawców (LLM, modele obraz/wideo, osadzania itp.). Zamiast integrować wiele SDK dostawców, CometAPI pozwala wywoływać znajome endpointy w formacie OpenAI (chat/completions/embeddings/images), przy jednoczesnym przełączaniu modeli lub dostawców „pod maską”.

Deweloperzy mogą jednocześnie korzystać z flagowych modeli dwóch różnych firm przez CometAPI bez zmiany dostawcy, a ceny API są bardziej przystępne, zwykle o 20% taniej.

Example: quick API snippets (copy-paste to try)

Poniżej minimalne przykłady do uruchomienia. Odzwierciedlają opublikowane przez dostawców quickstarty (OpenAI Responses API + klient Google GenAI). Zamień $OPENAI_API_KEY / $GEMINI_API_KEY na swoje klucze.

GPT-5.2 — Python (OpenAI Responses API, reasoning set to xhigh for deep problems)

# Python (requires openai SDK that supports responses API)from openai import OpenAIclient = OpenAI(api_key="YOUR_OPENAI_API_KEY")resp = client.responses.create( model="gpt-5.2-pro", # gpt-5.2 or gpt-5.2-pro input="Summarize this 50k token company report and output a 10-slide presentation outline with speaker notes.", reasoning={"effort": "xhigh"}, # deeper reasoning max_output_tokens=4000)print(resp.output_text) # or inspect resp to get structured outputs / tokens

Uwagi: reasoning.effort pozwala wymieniać koszt na głębokość. Użyj gpt-5.2-chat-latest do stylu „Instant chat”. Dokumentacja OpenAI pokazuje przykłady dla responses.create.

GPT-5.2 — curl (simple)

curl https://api.openai.com/v1/responses \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-5.2", "input": "Write a Python function that converts a PDF with tables into a normalized CSV with typed columns.", "reasoning": {"effort":"high"} }'

(Sprawdź JSON pod kątem output_text lub ustrukturyzowanych wyników).

Gemini 3 Pro Preview — Python (Google GenAI client)

# Python (google genai client) — example from Google docsfrom google import genaiclient = genai.Client(api_key="YOUR_GEMINI_API_KEY")response = client.models.generate_content( model="gemini-3-pro-preview", contents="Find the race condition in this multi-threaded C++ snippet: <paste code here>", config={ "thinkingConfig": {"thinking_level": "high"} })print(response.text)

Uwagi: thinking_level kontroluje wewnętrzną deliberację modelu; media_resolution można ustawić dla obrazów/wideo. Przykłady REST i JS znajdują się w poradniku deweloperskim Gemini Google.;

Gemini 3 Pro — curl (REST)

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-preview:generateContent" \ -H "x-goog-api-key: $GEMINI_API_KEY" \ -H "Content-Type: application/json" \ -X POST \ -d '{ "contents": [{ "parts": [{"text": "Explain the race condition in this C++ code: ..."}] }], "generationConfig": {"thinkingConfig": {"thinkingLevel": "high"}} }'

Dokumentacja Google zawiera przykłady multimodalne (obrazy jako dane inline, media_resolution).

Which model is “better” — practical guidance

Nie ma uniwersalnego „zwycięzcy”; wybieraj w zależności od przypadku użycia i ograniczeń. Poniżej krótka macierz decyzji.

Choose GPT-5.2 if:

- Potrzebujesz ścisłej integracji z narzędziami do wykonywania kodu (ekosystem interpreter/narzędzi OpenAI) dla programowych potoków danych, generowania arkuszy czy agentowych przepływów kodowych. OpenAI podkreśla ulepszenia narzędzia Python i użycie mega-agenta.

- Priorytetyzujesz efektywność tokenową zgodnie z deklaracjami dostawcy i chcesz jawnego, przewidywalnego rozliczania per token OpenAI z dużymi zniżkami na cache’owane wejścia (pomaga w przepływach wsadowych/produkcyjnych).

- Chcesz ekosystemu OpenAI (integracja produktu ChatGPT, partnerstwa Azure/Microsoft i narzędzia wokół Responses API i Codex).

Choose Gemini 3 Pro if:

- Potrzebujesz ekstremalnego wejścia multimodalnego (wideo + obrazy + audio + pdf) i chcesz jednego modelu, który natywnie przyjmuje te wszystkie wejścia z 1,000,000 token oknem wejściowym. Google wyraźnie kieruje to do długich wideo, potoków duży dokument + wideo i interaktywnego Search/AI Mode.&

- Budujesz na Google Cloud / Vertex AI i chcesz ścisłej integracji z ugruntowaniem wyszukiwaniem Google, udostępnianiem Vertex i klientami GenAI. Skorzystasz z integracji produktów Google (Search AI Mode, AI Studio, Antigravity do pracy z agentami).

Conclusion: Which Is Better in 2026?

W starciu GPT-5.2 vs. Gemini 3 Pro Preview odpowiedź jest zależna od kontekstu:

- GPT-5.2 prowadzi w profesjonalnej pracy z wiedzą, głębi analitycznej i ustrukturyzowanych przepływach.

- Gemini 3 Pro Preview błyszczy w zrozumieniu multimodalnym, zintegrowanych ekosystemach i zadaniach z dużym kontekstem.

Żaden model nie jest uniwersalnie „lepszy” — ich mocne strony uzupełniają różne realne potrzeby. Rozsądni użytkownicy powinni dopasować wybór modelu do konkretnych przypadków użycia, ograniczeń budżetowych i zgodności z ekosystemem.

Jasne w 2026 r. jest to, że granica SI znacząco się przesunęła, a zarówno GPT-5.2, jak i Gemini 3 Pro przesuwają możliwości inteligentnych systemów w przedsiębiorstwach i poza nimi.

Jeśli chcesz spróbować od razu, poznaj możliwości GPT-5.2 i Gemini 3 Pro w CometAPI w Playground i zajrzyj do przewodnika po API po szczegółowe instrukcje. Przed dostępem upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. CometAPI oferuje ceny znacznie niższe niż oficjalne, aby ułatwić integrację.

Ready to Go?→ Free trial of GPT-5.2 and Gemini 3 Pro !

If you want to