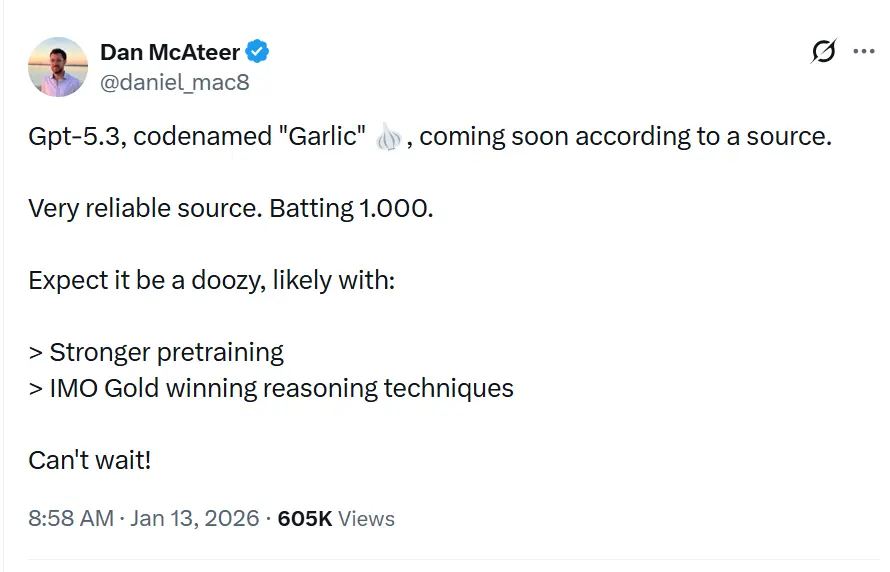

Kryptonim GPT-5.3„Garlic”, jest opisywany w przeciekach i doniesieniach jako kolejna przyrostowa/iteracyjna wersja GPT-5.x, której celem jest domknięcie luk w rozumowaniu, kodowaniu i wydajności produktu dla OpenAI, w odpowiedzi na presję konkurencyjną ze strony Gemini firmy Google i Claude firmy Anthropic.

OpenAI eksperymentuje z gęstszą, bardziej wydajną iteracją GPT-5.x, skoncentrowaną na silniejszym rozumowaniu, szybszej inferencji i dłuższych przepływach pracy w kontekście, zamiast wyłącznie na coraz większej liczbie parametrów. To nie jest jedynie kolejna odsłona serii Generative Pre-trained Transformer; to strategiczna kontr-ofensywa. Zrodzony z wewnętrznego „Code Red”, ogłoszonego przez CEO Sama Altmana w grudniu 2025 r., „Garlic” odrzuca dogmat „większe znaczy lepsze”, który rządził rozwojem LLM przez pół dekady. Zamiast tego stawia wszystko na nową miarę: gęstość poznawczą.

Czym jest GPT-5.3 „Garlic”?

GPT-5.3 — o kryptonimie „Garlic” — opisywany jest jako następny iteracyjny krok w rodzinie GPT-5 OpenAI. Źródła przedstawiające przeciek pozycjonują Garlic nie jako prosty checkpoint lub zmianę tokenów, lecz jako ukierunkowane udoskonalenie architektury i treningu: celem jest wyciągnięcie wyższej wydajności rozumowania, lepszego planowania wieloetapowego i poprawy zachowania w długim kontekście z bardziej kompaktowego, oszczędnego w inferencji modelu, zamiast polegać wyłącznie na surowej skali. Taka rama wpisuje się w szersze trendy branżowe w kierunku „gęstych” lub „wysokowydajnych” projektów modeli.

Przydomek „Garlic” — wyraźne odejście od niebiańskich (Orion) czy słodko-botanicznych (Strawberry) kryptonimów z przeszłości — ma rzekomo być celową, wewnętrzną metaforą. Tak jak pojedynczy ząbek czosnku potrafi nadać całej potrawie intensywniejszy smak niż większe, bardziej bezbarwne składniki, tak ten model ma dostarczać skoncentrowaną inteligencję bez ogromnego narzutu obliczeniowego gigantów branży.

Geneza „Code Red”

Istnienia Garlic nie da się oddzielić od egzystencjalnego kryzysu, który go zrodził. Pod koniec 2025 r. OpenAI po raz pierwszy od premiery ChatGPT znalazło się w „pozycji defensywnej”. Gemini 3 firmy Google przejęło koronę w multimodalnych benchmarkach, a Claude Opus 4.5 firmy Anthropic stał się de facto standardem dla złożonego kodowania i agentowych przepływów pracy. W odpowiedzi kierownictwo OpenAI wstrzymało projekty peryferyjne — w tym eksperymenty z platformą reklamową i rozszerzenia konsumenckich agentów — aby w pełni skupić się na modelu, który mógłby wykonać „uderzenie taktyczne” na tych konkurentów.

Garlic jest tym uderzeniem. Nie został zaprojektowany, by być największym modelem na świecie; ma być najmądrzejszy per parametr. Łączy linie badawcze wcześniejszych projektów wewnętrznych, w szczególności „Shallotpeat”, integrując poprawki błędów i usprawnienia pre-treningu, które pozwalają mu bić powyżej swojej wagi.

Jaki jest obecny status obserwowanych iteracji modelu GPT-5.3?

Na połowę stycznia 2026 r. GPT-5.3 znajduje się w finalnych etapach wewnętrznej walidacji, fazy często określanej w Dolinie Krzemowej jako „utwardzanie” (hardening). Model jest obecnie widoczny w logach wewnętrznych i był punktowo testowany przez wybranych partnerów korporacyjnych na mocy ścisłych umów o poufności.

Obserwowane iteracje i integracja „Shallotpeat”

Droga do Garlic nie była liniowa. Wycieki wewnętrznych notatek dyrektora ds. badań Marka Chena sugerują, że Garlic jest w istocie kompozytem dwóch odrębnych torów badawczych. Początkowo OpenAI rozwijało model o kryptonimie „Shallotpeat”, który miał być bezpośrednią przyrostową aktualizacją. Jednak podczas pre-treningu Shallotpeat badacze odkryli nową metodę „kompresowania” wzorców rozumowania — w praktyce uczenie modelu wcześniejszego odrzucania redundantnych ścieżek neuronalnych w procesie treningu.

To odkrycie doprowadziło do porzucenia samodzielnego wydania Shallotpeat. Jego architekturę połączono z bardziej eksperymentalną gałęzią „Garlic”. Efektem jest iteracja hybrydowa, łącząca stabilność dojrzałego wariantu GPT-5 z eksplodującą wydajnością rozumowania nowej architektury.

Kiedy możemy wnioskować o terminie wydania?

Przewidywanie dat wydań OpenAI jest notorycznie trudne, lecz status „Code Red” przyspiesza standardowe harmonogramy. Na podstawie zbieżności przecieków, aktualizacji dostawców i cykli konkurencji, możemy wyznaczyć okno premiery.

Główne okno: I kwartał 2026 (styczeń - marzec)

Konsensus wśród osób wtajemniczonych wskazuje na premierę w I kwartale 2026 r. „Code Red” ogłoszono w grudniu 2025 r., z dyrektywą wydania „tak szybko, jak to możliwe”. Biorąc pod uwagę, że model jest już w fazie sprawdzania/walidacji (a fuzja z „Shallotpeat” przyspieszyła harmonogram), najbardziej prawdopodobny wydaje się koniec stycznia lub początek lutego.

Wydanie „Beta”

Możemy zobaczyć stopniowe wdrożenie:

- Koniec stycznia 2026 r.: Wydanie „preview” dla wybranych partnerów i użytkowników ChatGPT Pro (być może pod etykietą „GPT-5.3 (Preview)”).

- Luty 2026 r.: Pełna dostępność API.

- Marzec 2026 r.: Integracja z darmową wersją ChatGPT (ograniczona liczba zapytań), aby przeciwstawić się darmowej dostępności Gemini.

3 cechy definiujące GPT-5.3?

Jeśli pogłoski się potwierdzą, GPT-5.3 wprowadzi pakiet funkcji, które przedkładają użyteczność i integrację nad czystą kreatywność generatywną. Zestaw funkcji brzmi jak lista życzeń dla architektów systemów i deweloperów korporacyjnych.

1. Wysokogęste wstępne szkolenie (EPTE)

Klejnotem w koronie Garlic jest Enhanced Pre-Training Efficiency (EPTE).

Tradycyjne modele uczą się, przeglądając ogromne ilości danych i tworząc rozległą sieć skojarzeń. Proces treningowy Garlic ma rzekomo obejmować fazę „przycinania”, w której model aktywnie kondensuje informacje.

- Efekt: Model fizycznie mniejszy (pod względem wymagań VRAM), ale zachowujący „Wiedzę o Świecie” znacznie większego systemu.

- Korzyść: Szybsza inferencja i znacząco niższe koszty API, co adresuje stosunek „inteligencja do kosztu”, który utrudniał masową adopcję takich modeli jak Claude Opus.

2. Natywne agentowe rozumowanie

W przeciwieństwie do wcześniejszych modeli, które wymagały „wrapperów” lub złożonego prompt engineeringu, by działać jako agenci, Garlic ma natywne możliwości wywoływania narzędzi.

Model traktuje wywołania API, wykonywanie kodu i zapytania do baz danych jako „obywateli pierwszej kategorii” w swoim słowniku.

- Głęboka integracja: Nie tylko „wie, jak pisać kod”; rozumie środowisko kodu. Podobno potrafi nawigować po katalogu plików, edytować wiele plików jednocześnie i uruchamiać własne testy jednostkowe bez zewnętrznych skryptów orkiestracyjnych.

3. Ogromne okna kontekstu i wyjścia

Aby rywalizować z milionowym oknem kontekstu Gemini, Garlic ma podobno oferować 400 000-tokenowe okno kontekstu. Choć mniejsze niż oferta Google, kluczowym wyróżnikiem jest „Perfect Recall” w tym oknie, wykorzystujące nowy mechanizm uwagi, który zapobiega utracie „środka kontekstu”, powszechnej w modelach z 2025 r.

- Limit wyjścia 128k: Być może jeszcze bardziej ekscytujące dla deweloperów jest rzekome rozszerzenie limitu wyjścia do 128 000 tokenów. Pozwoliłoby to modelowi generować całe biblioteki oprogramowania, kompleksowe pisma prawne lub pełnometrażowe nowele w jednym przebiegu, eliminując potrzebę „chunkowania”.

4. Drastycznie zredukowane halucynacje

Garlic wykorzystuje technikę wzmocnienia po treningu skupioną na „pokorze epistemicznej” — model jest rygorystycznie uczony, by wiedzieć, czego nie wie. Testy wewnętrzne pokazują istotnie niższy wskaźnik halucynacji w porównaniu z GPT-5.0, czyniąc go realnym dla branż wysokiego ryzyka, takich jak biomedycyna i prawo.

Jak wypada w porównaniu z konkurentami, takimi jak Gemini i Claude 4.5?

Sukces Garlic nie będzie mierzony w izolacji, lecz w bezpośrednim zestawieniu z dwiema potęgami dominującymi obecnie arenę: Gemini 3 firmy Google i Claude Opus 4.5 firmy Anthropic.

GPT-5.3 „Garlic” vs. Google Gemini 3

Pojedynek skali kontra gęstość.

- Gemini 3: Obecnie model „kuchenny zlew”. Dominuje w multimodalnym rozumieniu (wideo, audio, natywne generowanie obrazów) i ma praktycznie nieskończone okno kontekstu. To najlepszy model do „bałaganiastych” danych ze świata rzeczywistego.

- GPT-5.3 Garlic: Nie może konkurować z surową multimodalną rozpiętością Gemini. Zamiast tego atakuje Gemini w obszarze Czystości Rozumowania. W czystej generacji tekstu, logice kodu i złożonym podążaniu za instrukcjami, Garlic ma być ostrzejszy i mniej skłonny do „odmów” czy dygresji.

- Werdykt: Jeśli musisz analizować 3‑godzinny film, użyj Gemini. Jeśli musisz napisać backend aplikacji bankowej, użyj Garlic.

GPT-5.3 „Garlic” vs. Claude Opus 4.5

Bitwa o duszę dewelopera.

- Claude Opus 4.5: Wydany pod koniec 2025 r., zdobył serca deweloperów swoim „ciepłem” i „vibes”. Słynie z pisania czystego, zrozumiałego dla człowieka kodu i podążania za instrukcjami systemowymi z wojskową precyzją. Jest jednak drogi i wolny.

- GPT-5.3 Garlic: To bezpośredni cel. Garlic ma dorównać biegłości kodowania Opus 4.5, ale przy 2× większej szybkości i 0,5× kosztu. Dzięki „Wysokogęstemu wstępnemu szkoleniu” OpenAI chce zaoferować inteligencję na poziomie Opus przy budżecie na poziomie Sonnet.

- Werdykt: „Code Red” został wywołany konkretnie przez dominację Opus 4.5 w kodowaniu. Sukces Garlic zależy w całości od tego, czy zdoła przekonać deweloperów do przełączenia kluczy API z powrotem na OpenAI. Jeśli Garlic będzie kodować równie dobrze co Opus, ale działać szybciej, rynek zmieni się z dnia na dzień.

Wniosek

Wczesne wewnętrzne kompilacje Garlic już przewyższają Gemini 3 Google i Opus 4.5 Anthropic w określonych, wysoko wartościowych domenach:

- Biegłość w kodowaniu: W wewnętrznych „twardych” benchmarkach (wykraczających poza standardowy HumanEval) Garlic wykazuje mniejszą skłonność do utknięcia w „pętlach logicznych” niż GPT-4.5.

- Gęstość rozumowania: Model potrzebuje mniej tokenów „myślenia”, by dojść do poprawnych wniosków, w bezpośrednim kontraście do ciężkości „chain-of-thought” serii o1 (Strawberry).

| Metryka | GPT-5.3 (Garlic) | Google Gemini 3 | Claude 4.5 |

|---|---|---|---|

| Rozumowanie (GDP-Val) | 70.9% | 53.3% | 59.6% |

| Kodowanie (HumanEval+) | 94.2% | 89.1% | 91.5% |

| Okno kontekstu | 400K tokenów | 2M tokenów | 200K tokenów |

| Szybkość wnioskowania | Ultraszybka | Umiarkowana | Szybka |

Konkluzja

„Garlic” to aktywna i wiarygodna plotka: ukierunkowany tor inżynieryjny OpenAI, który priorytetyzuje gęstość rozumowania, efektywność i narzędzia z prawdziwego świata. Jego pojawienie najlepiej postrzegać w kontekście przyspieszającego wyścigu zbrojeń między dostawcami modeli (OpenAI, Google, Anthropic) — w którym strategiczną nagrodą jest nie tylko surowa zdolność, ale użyteczna zdolność w przeliczeniu na dolara i milisekundę opóźnienia.

Jeśli interesuje Cię ten nowy model, obserwuj CometAPI. Zawsze aktualizuje najnowsze i najlepsze modele AI w przystępnej cenie.

Deweloperzy mogą uzyskać dostęp do GPT-5.2, Gemini 3, Claude 4.5 przez CometAPI już teraz. Aby zacząć, zapoznaj się z możliwościami modeli CometAPI w Playground i zajrzyj do API guide po szczegółowe instrukcje. Zanim uzyskasz dostęp, upewnij się, że zalogowałeś(-aś) się do CometAPI i uzyskałeś(-aś) klucz API. CometAPI oferuje cenę znacznie niższą niż oficjalna, aby ułatwić integrację.

Gotowi do startu?→ Zarejestruj się w CometAPI już dziś!

Jeśli chcesz poznać więcej wskazówek, poradników i newsów o AI, śledź nas na VK, X i Discord!