Krótka odpowiedź: Jak przejść z OpenAI w 2026 roku?

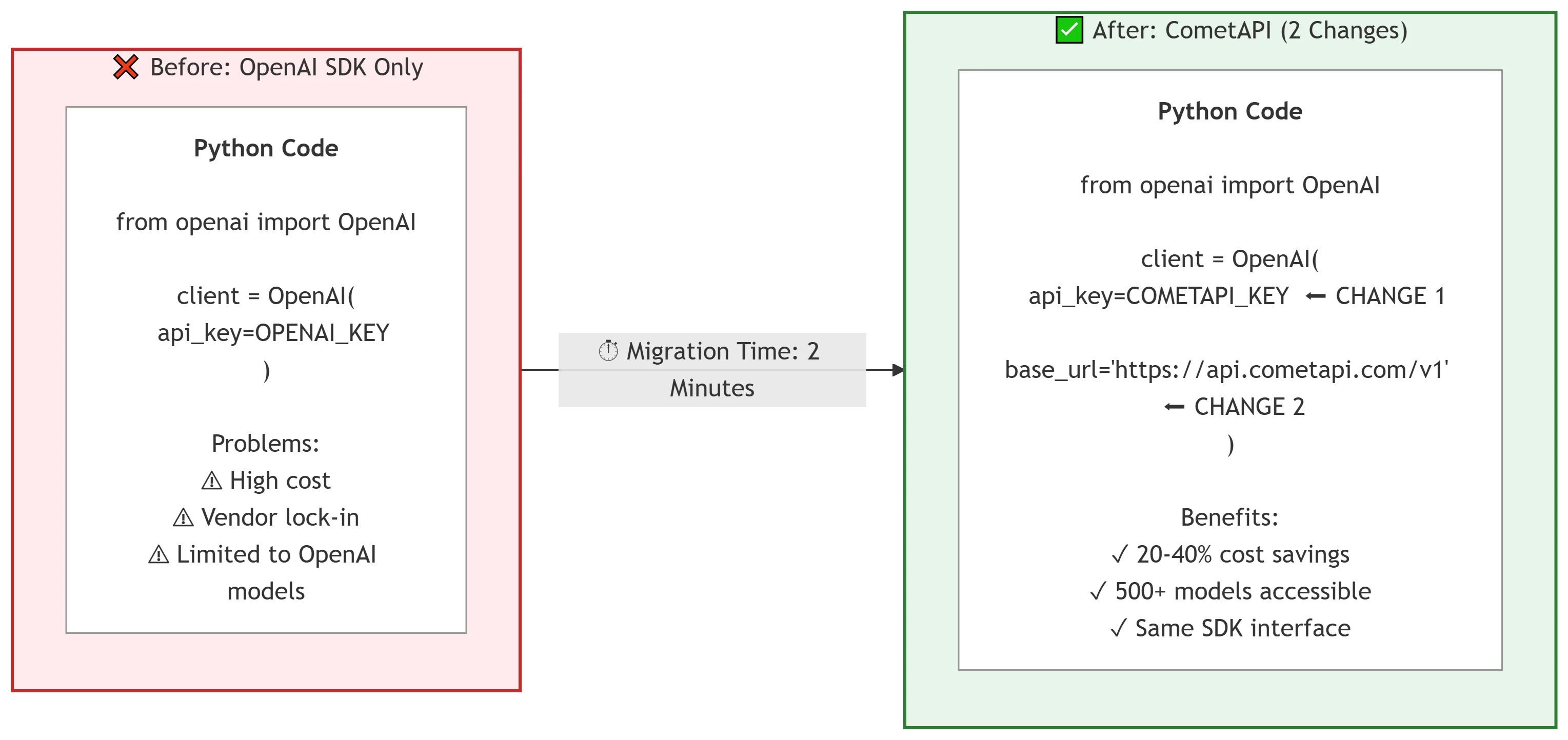

Aby przejść na ujednoliconą warstwę API, zaktualizuj base_url do https://api.cometapi.com/v1 i zamień swój klucz OpenAI na token CometAPI. Ta jedna integracja zapewnia natychmiastowy dostęp do 500+ najbardziej zaawansowanych modeli — w tym GPT-5.5, Claude Opus 4.7 i Gemini 3.1 Pro — jednocześnie trwale obniżając wydatki na API o 20%–40% względem oficjalnych stawek bezpośrednich.

Strategiczna potrzeba platformy wielomodelowej

Poleganie na jednym dostawcy w 2026 roku niesie znaczące ryzyka strukturalne dla aplikacji produkcyjnych. Gdy główny dostawca doświadcza wysokich opóźnień lub trafia w limity rate limit, cały Twój produkt jest narażony. Współczesne zespoły inżynieryjne stawiają na strategię platformy wielomodelowej, aby zapewnić ciągłość działania. Choć OpenAI pozostaje kluczowym graczem, inni dostawcy, tacy jak Anthropic i Google, wypuścili modele — Claude Opus 4.7 i Gemini 3.1 Pro — które często przewyższają GPT-4o w specjalistycznych zadaniach kodowania i multimodalnego rozumowania.

Problem techniczny Jest wtorek, 1:00 w nocy. System monitoringu wyzwala krytyczny alert: Twoje kluczowe funkcje AI zawodzą u 100% użytkowników. Logi pokazują lawinę błędów 429 Too Many Requests z oficjalnego endpointu OpenAI, mimo że mieścisz się w limitach Tier 5. Ponieważ kod aplikacji jest na stałe powiązany z jednym dostawcą, musisz wybierać między ręcznym hotfixem na szybko a czekaniem, aż dostawca się podniesie. Gdybyś zintegrował się przez ujednoliconą bramę, taką jak CometAPI, mógłbyś przerzucić ruch związany z rozumowaniem na Claude Opus 4.7 z poziomu dashboardu i przywrócić usługę w mniej niż 30 sekund.

Porównanie kosztów: oficjalne bezpośrednie vs. ujednolicona brama

Zarządzanie kosztami to główny czynnik dla zespołów szukających alternatywy dla OpenAI. Dzięki hurtowemu zakupowi wolumenów tokenów i inteligentnemu routingowi CometAPI zapewnia stałą 20% zniżkę w całym katalogu.

| Model | Official Price (Input / 1M) | CometAPI Price (Input / 1M) | Total Savings |

|---|---|---|---|

| GPT-5.5 Pro | $30.00 | $24.00 | 20% |

| GPT-5.5 | $5.00 | $4.00 | 20% |

| Claude Opus 4.7 | $3.75 | $3.00 | 20% |

| Claude Sonnet 4.6 | $3.00 | $2.40 | 20% |

| Gemini 3.1 Pro | $2.00 | $1.60 | 20% |

| DeepSeek V4 Pro | $0.52 | $0.42 | 20% |

| Grok 4.20 | $2.00 | $1.60 | 20% |

Ceny zweryfikowane na maj 2026 według CometAPI Pricing.

Problem kosztowy Rozważ zespół inżynierski przetwarzający 100 milionów tokenów GPT-5.5 miesięcznie dla swojego agenta wsparcia. Bezpośrednie, oficjalne rozliczenie wyniosłoby około $3,000. Kierując te same żądania przez CometAPI, zespół płaci $2,400. Te $600 różnicy to nie abstrakcja — wystarczą, by pokryć miesięczne koszty serwera całego środowiska staging lub co miesiąc zafundować kolację zespołowi dev, dosłownie za zmianę jednej linii konfiguracji.

Jakie modele są dostępne przez CometAPI?

Jeden klucz odblokowuje dostęp do ponad 500 modeli, obejmujących tekst, obraz, wideo i audio.

| Kategoria | Polecane modele | Najlepsze do |

|---|---|---|

| Rozumowanie | GPT-5.5 Pro, Claude Opus 4.7 | Złożone planowanie i autonomiczni agenci |

| Programowanie agentowe | Kimi K2.6, Qwen3.6-Plus | Refaktoryzacja w skali repozytorium i "Vibe Coding" |

| Długi kontekst | Grok 4.20 (2M tokens) | Masowa analiza logów i dokumentów |

| Multimodalne | Gemini 3.1 Pro, GPT Image 2 | Analiza wideo i projektowanie produkcyjne |

| Szybka odpowiedź | DeepSeek V4 Flash | Zadania klasyfikacyjne o dużej skali |

Niezawodność, którą możesz zweryfikować

CometAPI utrzymuje SLA dostępności 99.9% oraz średni czas odpowiedzi poniżej 400 ms. Nasz inteligentny routing automatycznie omija węzły o wysokich opóźnieniach, aby Twoja aplikacja pozostała responsywna nawet wtedy, gdy konkretni dostawcy regionalni doświadczają wahań wydajności.

Migracja techniczna: wdrożenie przełączenia

Antywzorzec W opisanym studium przypadku średniej wielkości zespół próbował zbudować własny wewnętrzny „proxy API”, aby oszczędzić koszty. Przydzielili jednego starszego inżyniera na pełen etat do utrzymania systemu. Między zarządzaniem aktualizacjami SDK, cyklami rozliczeń dostawców a budową własnego routera failover koszt pracy przekroczył $8,000 miesięcznie. Tymczasem zespół oszczędzał jedynie $300 miesięcznie dzięki zniżkom na API. „Odkrywali koło na nowo” ze znaczną stratą. CometAPI dostarcza całą tę infrastrukturę out‑of‑the‑box bez opłaty platformowej.

Standardowa integracja z obsługą błędów

CometAPI jest w 100% kompatybilne z OpenAI SDK. Wystarczy zaktualizować parametry inicjalizacji.

import os

from openai import OpenAI, APIError

# Step 1: Initialize using CometAPI credentials

client = OpenAI(

# Point to the unified endpoint

base_url="https://api.cometapi.com/v1",

# Use your CometAPI sk-token from environment variables

api_key=os.getenv("COMETAPI_API_KEY")

)

def run_ai_task(prompt, model="gpt-5.5"):

try:

# Step 2: Swap between models (gpt-5.5, claude-opus-4-7) directly

# Your message structure and parameters remain unchanged

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

temperature=0.7

)

return response.choices.message.content

except APIError as e:

# CometAPI handles unified error codes (401, 429, 500)

print(f"API Error: {e.status_code} - {e.message}")

except Exception as e:

print(f"Unexpected connection error: {str(e)}")

# Test the switch with a reasoning-heavy model

print(run_ai_task("Analyze our system's scalability benchmarks.", model="claude-opus-4-7"))

Prywatność danych i zgodność korporacyjna

Przejście na ujednoliconą bramę API nie oznacza kompromisów w zakresie bezpieczeństwa. CometAPI przestrzega rygorystycznych standardów zarządzania danymi:

- Brak trenowania na danych: Twoje prompty i odpowiedzi nigdy nie są używane do trenowania przyszłych iteracji modeli.

- Ścisłe przechowywanie: Logi są przechowywane maksymalnie przez 3 miesiące na potrzeby debugowania, po czym są trwale usuwane.

- Standardy korporacyjne: Platforma posiada certyfikat SOC 2 oraz szyfrowanie danych end‑to‑end.

Lista kontrolna: jak zacząć za darmo

Zweryfikuj wydajność tej platformy wielomodelowej w mniej niż pięć minut — bez karty kredytowej.

- Rejestracja: Utwórz darmowe konto na CometAPI.com.

- Wygeneruj klucz: Kliknij „Add Token” w panelu, aby otrzymać bonus $0.5.

- Uruchom test: Wykonaj pierwsze wywołanie API, aby zdobyć dodatkowe $1 kredytu.

- Pierwsze doładowanie: Zasil konto $10 po raz pierwszy i odbierz $3 nagrody.

- Wejście na produkcję: Zaktualizuj

base_urli zacznij oszczędzać 20% natychmiast.

FAQ

Korzystam obecnie z OpenAI SDK. Czy migracja będzie uciążliwa? Obawiam się, że rozbiję logikę produkcyjną.

W udokumentowanych przypadkach migracji deweloperzy przenosili projekty klasy enterprise w około 8 minut. Musisz zaktualizować tylko dwa elementy konfiguracji: base_url i api_key. Ponieważ CometAPI jest w 100% kompatybilne z OpenAI SDK, struktura messages, ustawienia temperature i logika streamingu pozostają identyczne. Zespoły z bazami kodu przekraczającymi 150,000 linii raportują, że ich zestawy testów jednostkowych przeszły od razu po aktualizacji konfiguracji, bez jakiegokolwiek refaktoringu.

Czy naprawdę mogę zaufać deklaracji dostępności 99.9%? Co się stanie, jeśli Wasza platforma padnie?

Naszą kluczową wartością jest redundancja. Podczas gdy bezpośrednie połączenie z jednym dostawcą stanowi pojedynczy punkt awarii, CometAPI wykorzystuje routing wieloregionowy. W scenariuszach, gdy duży oficjalny dostawca doświadcza zakłóceń o dużym wpływie, inteligentny router CometAPI automatycznie przekieruje żądanie do alternatywnego regionu lub porównywalnej rodziny modeli. Taka architektura pomaga utrzymać ciągłość usług, gdy bezpośrednie endpointy mogą zawodzić.

Czy 20% zniżki wynika z „obniżonej jakości” modeli? Czy są ukryte opłaty platformowe?

Jakość modeli jest identyczna jak w wersjach oficjalnych. Każde żądanie jest kierowane bezpośrednio do oryginalnych dostawców modeli, takich jak Anthropic czy OpenAI. Oferujemy stałą zniżkę 20%–40% dzięki naszemu hurtowemu modelowi zakupowemu: kupujemy setki miliardów tokenów rocznie po stawkach preferencyjnych i przekazujemy te oszczędności bezpośrednio deweloperom. Nie ma miesięcznych abonamentów ani ukrytych kosztów.

Jeśli wpłacę $10, żeby przetestować platformę, a ona nie zadziała w moim przypadku, to utknę?

Nie. CometAPI korzysta z przejrzystego, elastycznego systemu przedpłaconych środków, który umożliwia zwroty niewykorzystanych sald. Sugerujemy zacząć od ~$1.50 darmowych środków przyznawanych podczas onboardingu, aby przetestować różne modele w Playground, zanim dokonasz pierwszej wpłaty.

Jak obsługujecie dane wrażliwe? Czy używacie moich promptów lub zastrzeżonego kodu do trenowania modeli?

Absolutnie nie. Nasza polityka prywatności dla przedsiębiorstw wyraźnie stwierdza, że żadne dane użytkownika — wejścia ani wyjścia — nigdy nie są używane do trenowania modeli. Rozumiemy kluczowy charakter zastrzeżonych baz kodu. Logi są przechowywane jedynie przez 3 miesiące, aby pomóc w debugowaniu, a następnie automatycznie usuwane z naszych systemów bez możliwości odzyskania.

Czy obsługujecie modele multimodalne? Potrzebuję generować obrazy i wideo obok tekstu.

Tak. Z tym samym kluczem API masz dostęp do najbardziej zaawansowanych modeli multimodalnych na świecie. Obejmuje to GPT Image 2, który oferuje niemal perfekcyjną dokładność tekstu w obrazie, oraz Seedance 2.0 od ByteDance do generowania wideo klasy filmowej. Możesz zbudować kompletną aplikację AI obejmującą tekst, obraz i wideo bez tarcia związanego z zakładaniem kont na dziesiątkach różnych platform.

Czy ta platforma skaluje się do aplikacji o dużym ruchu? Mamy tysiące żądań na sekundę.

CometAPI jest zaprojektowane specjalnie z myślą o produkcyjnych środowiskach o wysokiej współbieżności. Nasza globalna infrastruktura utrzymuje średnie opóźnienie poniżej 400 ms. Oferujemy dynamiczne limity zapytań, które skalują się wraz z Twoimi potrzebami biznesowymi, zapewniając maksymalną przepustowość nawet w godzinach szczytu.