A experiência de desenvolvedores com a análise de vídeo do ChatGPT frequentemente bate numa parede: links diretos do YouTube falham, e uploads de MP4 retornam resumos “alucinados” que ignoram nuances visuais. Isso não é um bug — é uma limitação arquitetural. O ChatGPT não transmite vídeo; ele processa sequências de quadros extraídos e o texto da transcrição. Então você tentou enviar um arquivo MP4, o que funcionou… mais ou menos. O resumo mencionou a transcrição do áudio, mas ignorou a piada visual na terceira cena que dava sentido a todo o vídeo.

O ChatGPT pode analisar vídeos — mas não assistindo de fato a eles

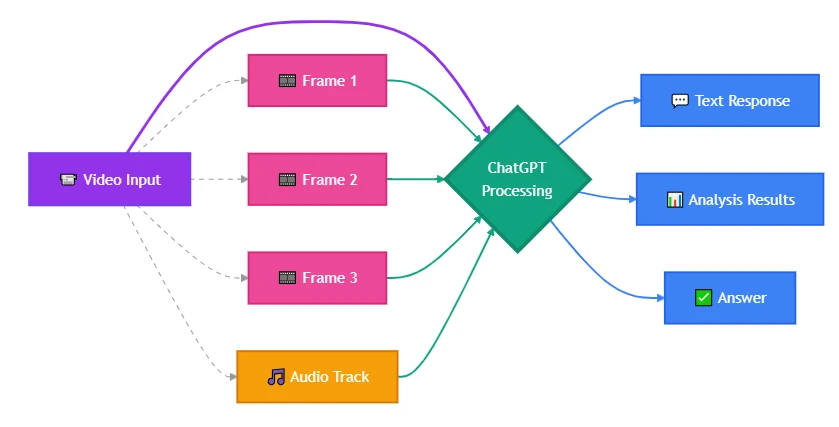

Eis o que realmente acontece: o ChatGPT não “assiste” aos vídeos como você. Ele não aperta play, transmite o conteúdo e observa o movimento ao longo do tempo. O que ele faz é decompor o vídeo em componentes que já sabe lidar — imagens estáticas e transcrições de texto — e então raciocina sobre essas partes de forma independente. O modelo vê seu vídeo como um álbum de fotos com narração, não como uma experiência contínua. É por isso que ele captou a explicação falada, mas perdeu o punchline visual: o quadro com a piada provavelmente não estava no conjunto amostrado.

Quando alguém pergunta “o ChatGPT pode assistir a vídeos?”, geralmente está perguntando uma de duas coisas: Ele consegue transmitir conteúdo visual como um observador humano faria, ou consegue extrair e analisar significado de dados de vídeo — cenas, diálogos, timestamps, ações na tela? A resposta funcional é sim para a segunda pergunta, com limitações que inviabilizam certos casos de uso. Variantes modernas do ChatGPT processam vídeo tratando-o como quadros amostrados combinados com transcrição de áudio, seja por extração automática na interface web, seja aceitando quadros fornecidos pelo usuário via API. Isso funciona para sumarização, descrição de cenas e extração de texto. Falha para rastreamento de movimento, análise dependente de tempo ou qualquer coisa que exija que o modelo “veja” o que acontece entre quadros.

A maioria dos guias se limita a confirmar que a capacidade existe, sem explicar por que sua implementação específica não funcionou — ou qual método de entrada alternativo usar.

ChatGPT Capacidades de vídeo: o que o modelo realmente vê

O ChatGPT não carrega um MP4 e percorre quadro a quadro. Ele tem capacidade de visão — habilidade de analisar imagens estáticas — e transcrição de áudio via integração com Whisper. Quando você envia vídeo pela interface web ou móvel do ChatGPT, o sistema extrai quadros-chave, transcreve o áudio separadamente e alimenta ambos ao modelo como entradas distintas. O modelo então descreve o que “viu” nesses quadros e o que “ouviu” na transcrição.

Do seu ponto de vista, parece compreensão de vídeo. Do ponto de vista do modelo, é análise de imagens + processamento de texto. Essa distinção arquitetural determina quais casos de uso funcionam e quais não.

Se seu vídeo depende de movimento, mudanças sutis entre quadros ou tempo preciso — como detectar exatamente quando um objeto entra no quadro, ou rastrear como um elemento de UI anima — a abordagem baseada em quadros-chave vai perder isso. O ChatGPT não vai captar um indício visual de dois segundos que caia entre quadros amostrados. Ele também não rastreia objetos ao longo do tempo, a menos que você estruture explicitamente a entrada para mostrar a progressão.

Capacidades atuais de vídeo do ChatGPT (no início de 2026):

- Análise de vídeo baseada em imagens: aceita arquivos de vídeo ou quadros extraídos; interpreta conteúdo visual a partir de imagens amostradas

- Transcrição de áudio: converte fala em texto via Whisper; o modelo pode então resumir ou consultar a transcrição

- Descrição de cenas: identifica objetos, ações, ambientes e texto visível nos quadros fornecidos

- Consultas baseadas em timestamp: pode referenciar momentos específicos se você fornecer timestamps de quadros ou segmentar o vídeo manualmente

- Extração de texto: lê legendas na tela, rótulos de UI ou documentos visíveis nos quadros

Taxa de amostragem de quadros específica e comportamento de seleção automática de quadros-chave na interface web do ChatGPT — não documentados publicamente até o limite de conhecimento

O que não inclui:

- Entrada de vídeo em streaming em tempo real via API

- Rastreamento de movimento perfeito por quadro ou persistência de objetos ao longo do tempo

- Suporte nativo a codecs de vídeo — todo o processamento acontece em quadros extraídos e áudio

- Detecção automática de mudança de cena sem solicitação explícita do usuário

A capacidade de vídeo é limitada por limites de tokens e tamanho de arquivo, não pela duração. Embora 5–10 minutos seja uma heurística prática, os limites reais escalam dinamicamente com a densidade visual.

Se seu caso de uso exige essas capacidades, você estará pré-processando o vídeo para extrair os quadros certos ou migrando para um modelo com suporte nativo a vídeo. A próxima seção detalha qual método de entrada usar para seu cenário específico.

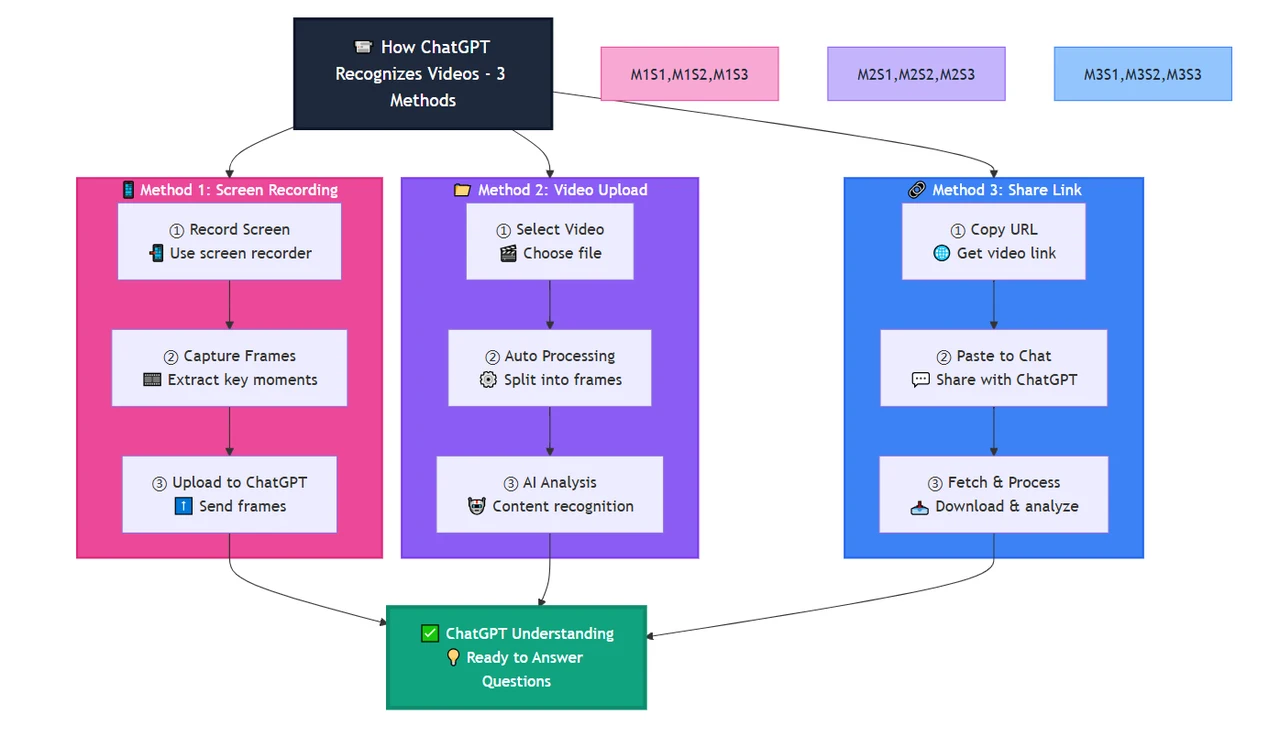

Como o ChatGPT interpreta vídeos: três métodos práticos

Não há apenas uma maneira de enviar vídeo ao ChatGPT. O método que você escolhe controla o que o modelo pode analisar e o que vai faltar. A maioria das falhas de implementação vem de escolher o método conveniente em vez do correto.

Método 1: Extração manual de quadros + upload de imagens

Extraia quadros você mesmo usando ffmpeg ou ferramentas similares e envie esses quadros específicos como imagens. Isso lhe dá controle total sobre o que o ChatGPT analisa.

Exemplo de fluxo de trabalho (bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Este método permite:

- Focar a análise em momentos específicos (intro, ação-chave, conclusão) sem desperdiçar contexto em trechos irrelevantes

- Capturar movimento enviando quadros consecutivos na taxa de amostragem que você escolher

- Contornar limites de tamanho de arquivo — imagens são menores que arquivos de vídeo completos

- Preservar a qualidade do quadro que pode degradar durante a compactação automática

A contrapartida:

Você lida com o pré-processamento. Para analisar centenas de vídeos em escala, isso exige automação. Para análises pontuais profundas ou depuração de cenas específicas, é o método mais confiável.

Quando usar este método:

- Você precisa de análise com precisão de quadro em momentos específicos

- A informação visual crítica é breve ou ocorre entre intervalos típicos de quadros-chave

- Você está comparando mudanças visuais ao longo de uma sequência (mudanças de estado de UI, quadros de animação)

- Você quer verificar o que o modelo realmente “viu” inspecionando os quadros exatos que enviou

Método 2: Upload direto de arquivo pela interface do ChatGPT

Os apps web e móvel do ChatGPT aceitam uploads de vídeo diretamente no chat. Solte um arquivo MP4 ou MOV no campo de entrada, e o sistema cuida da extração de quadros e transcrição automaticamente.

O que acontece internamente:

- O serviço amostra quadros em intervalos (taxa específica não documentada; estimada em 1–2 quadros por segundo com base em comportamento observado)

- O áudio é transcrito via Whisper ou serviço similar

- Ambas as saídas são passadas ao modelo como entradas de contexto separadas

- O modelo gera respostas com base nos quadros visíveis e na transcrição

Funciona para:

- Resumos de alto nível em que você não precisa de detalhes com precisão de quadro

- Identificar objetos, pessoas ou ambientes que persistem ao longo das cenas

- Extrair conteúdo falado ou texto na tela que aparece em múltiplos quadros

- Análises exploratórias rápidas sem pré-processamento

Falha para:

- Análise com precisão de quadro — você não controla quais quadros são amostrados

- Para conteúdo de vídeo extenso que excede a capacidade de contexto confortável do modelo, é necessária segmentação lógica. Sem divisão estratégica ou pré-processamento, os modelos podem degradar ou truncar à medida que o consumo de tokens acelera com alta densidade visual

- Detectar movimento, transições ou conteúdo dependente de tempo que exija comparação de quadros consecutivos

- Cenários em que a informação visual crítica aparece brevemente entre quadros amostrados

Se você precisa de controle sobre quais momentos são analisados, use o Método 1.

Método 3: Link do YouTube + recuperação de transcrição

Alguns plugins do ChatGPT e ferramentas de terceiros afirmam “analisar vídeos do YouTube”. O que eles realmente fazem é buscar metadados públicos e a transcrição do vídeo (se disponível) e passar esse texto ao ChatGPT.

Funciona quando:

- O vídeo tem legendas automáticas ou enviadas pelo usuário

- Sua análise exige apenas conteúdo falado, não informação visual

- O vídeo é publicamente acessível (não privado, não listado, nem com restrição regional)

- Você está resumindo palestras, podcasts ou entrevistas em que o áudio carrega a maior parte do significado

Não funciona quando:

- Você precisa analisar conteúdo visual (demonstrações na tela, diagramas, expressões faciais)

- O vídeo não tem transcrição ou legendas

- Informações críticas aparecem visualmente sem serem mencionadas no diálogo

- Você trabalha com arquivos de vídeo privados ou conteúdo atrás de autenticação

Erro comum: Desenvolvedores esperam compreensão completa de vídeo (visual + áudio), mas recebem apenas um resumo da transcrição. Isso é adequado para análise de conteúdo falado. É inútil para revisar demos de produto, analisar design visual ou qualquer cenário em que o que você vê importa mais do que o que é dito.

O padrão: Método 2 para resumos rápidos em que a precisão não importa. Método 1 para análise controlada quando você precisa de quadros específicos. Método 3 para conteúdo focado em áudio em que a informação visual é secundária ou inexistente. Escolha com base em onde vive a informação crítica do seu caso de uso — no movimento, em quadros específicos ou puramente no diálogo.

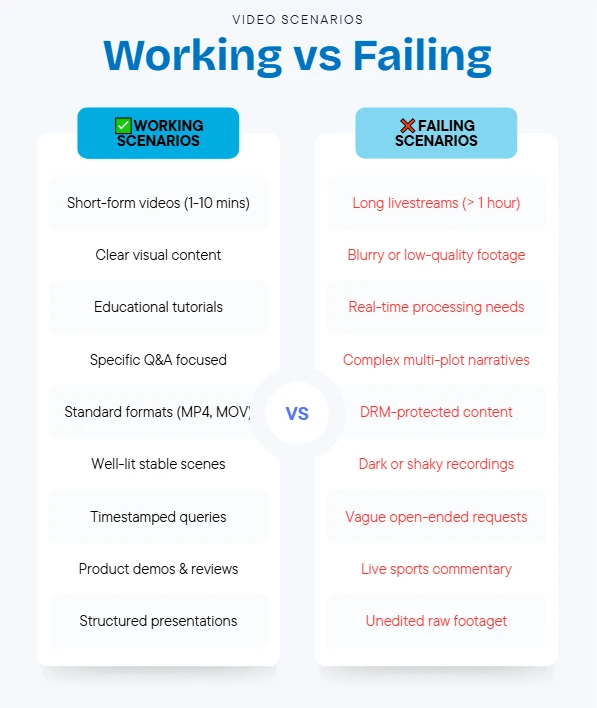

Cenários de aplicação de vídeo do ChatGPT: o que realmente funciona em produção

Saber que o ChatGPT pode processar componentes de vídeo não diz se ele é a ferramenta certa para seu problema. Estes cenários mostram onde a análise baseada em quadros tem sucesso — e onde as limitações arquiteturais inviabilizam o caso de uso.

Cenário 1: Sumarização de conteúdo educacional

Caso de uso: Você tem um vídeo tutorial de 10 minutos e precisa de um resumo estruturado dos passos-chave, ferramentas mencionadas e exemplos visuais mostrados.

Por que funciona: Vídeos educacionais geralmente têm limites claros de cena, texto estável na tela e narração alinhada às visuais. O apresentador descreve o que está mostrando enquanto está visível. O ChatGPT pode transcrever a explicação, identificar ferramentas ou diagramas nos quadros amostrados e combinar ambos em uma saída estruturada.

Abordagem de implementação: Envie o vídeo pela interface do ChatGPT ou extraia 8–12 quadros-chave nas transições dos principais tópicos. Prompt: “Liste as etapas principais explicadas neste vídeo, referenciando tanto a narração quanto qualquer texto na tela, diagramas ou nomes de ferramentas que você veja.”

Onde quebra: Vídeos que dependem de movimento contínuo — como um screencast de programação em que o instrutor digita rapidamente em vários arquivos — terão etapas ausentes entre quadros. Você precisaria de taxas de amostragem mais altas ou focar apenas na transcrição do áudio.

Dica prática: Para conteúdo de aula ou tutorial, combine upload automático (para a transcrição) com quadros extraídos manualmente dos 3–5 momentos visuais mais importantes. Isso lhe dá cobertura abrangente do áudio e imagens de alta qualidade dos conceitos-chave.

Cenário 2: Análise de demo de produto

Caso de uso: Você está revisando a demo de um produto concorrente e quer extrair elementos de UI, nomes de funcionalidades, fluxos de usuário e detalhes de preço mostrados na tela.

Por que funciona: Demos de produto normalmente mantêm cada tela por tempo suficiente para a amostragem capturar UI estática. Sobreposições de texto, rótulos de botões, estruturas de menu e tabelas de preços permanecem visíveis em múltiplos quadros. A capacidade de visão do ChatGPT pode ler e descrever esses elementos mesmo que não sejam mencionados na narração.

Abordagem de implementação: Extraia quadros nas principais mudanças de cena (slide de introdução, demo da funcionalidade 1, demo da funcionalidade 2, tela de preços, CTA). Envie esses quadros e peça: “Para cada quadro, identifique todos os elementos de UI visíveis, rótulos de botões, nomes de funcionalidades e quaisquer informações de produto ou preços exibidas.”

Onde quebra: Demos com transições rápidas de tela, estados de hover que revelam informação brevemente ou elementos interativos mostrados por apenas 1–2 segundos não serão capturados pela amostragem de quadros. Se o concorrente piscar rapidamente uma tabela de comparação de recursos, você perderá a menos que aquele momento exato tenha sido amostrado.

Dica prática: Percorra o vídeo manualmente primeiro para identificar timestamps de revelações importantes. Extraia quadros nesses momentos específicos em vez de depender de intervalos automáticos.

Cenário 3: Transcrição de reunião ou entrevista com contexto visual

Caso de uso: Você gravou uma chamada com um cliente e precisa da transcrição e de anotações indicando quando documentos, slides ou compartilhamentos de tela específicos apareceram.

Por que funciona: A transcrição de áudio lida com o diálogo falado. Quando participantes compartilham telas ou exibem documentos, esses aparecem nos quadros amostrados. O ChatGPT pode anotar “aproximadamente em [timestamp], um documento de contrato estava visível na tela” junto com a transcrição — útil para atas de reunião que referenciam materiais visuais.

Abordagem de implementação: Envie o vídeo e peça: “Transcreva esta reunião e anote quaisquer momentos em que documentos, slides de apresentação, telas compartilhadas ou outros referenciais visuais apareceram. Para cada elemento visual, descreva o que foi mostrado.”

Onde quebra: Compartilhamentos de tela breves (menos de 5–10 segundos) podem cair entre quadros amostrados. Texto pequeno demais em quadros comprimidos não será legível. Para casos legais ou de compliance que exigem precisão literal de documentos exibidos, verifique a qualidade dos quadros e a cobertura de amostragem antes de confiar no resultado.

Dica prática: Para reuniões importantes, grave em resolução mais alta e extraia quadros manualmente nos momentos em que alguém diz “vou mostrar este documento” — indicando que um elemento visual está prestes a aparecer.

Cenário 4: Moderação de conteúdo ou revisão de compliance

Caso de uso: Você precisa escanear vídeos enviados por usuários em busca de conteúdo proibido — logos específicos, padrões de texto ou elementos visuais que violem políticas da plataforma.

Por que funciona: O ChatGPT pode examinar quadros em busca de texto visível, objetos reconhecíveis ou cenas descritas. Se você estiver checando “algum destes vídeos mostra o logo de um concorrente”, a análise baseada em quadros detecta logos que persistem na tela por mais de um ou dois segundos.

Abordagem de implementação: Extraia quadros em intervalos regulares (a cada 3–5 segundos), envie-os e peça: “Revise estes quadros e identifique quaisquer que contenham [logo específico, nome de marca, símbolo proibido, etc.]. Para cada ocorrência, descreva onde no quadro ele aparece.”

Onde quebra: Violações baseadas em áudio (música com direitos autorais, fala proibida) exigem análise de áudio separada. Violações baseadas em movimento (gestos proibidos, ações que se estendem por múltiplos quadros) não serão capturadas por análise de imagens estáticas. Conteúdo proibido exibido rapidamente pode não aparecer nos quadros amostrados.

Dica prática: Combine a varredura visual do ChatGPT com serviços dedicados de fingerprinting de áudio e taxas de amostragem de quadros mais altas para categorias de alto risco. Use o ChatGPT como filtro de primeira passagem, não como a única camada de moderação.

O padrão nos cenários bem-sucedidos: conteúdo significativo existe em quadros discretos e estáveis e se correlaciona com áudio ou elementos de texto. As falhas ocorrem quando a informação crítica vive no movimento, no timing, nas transições ou aparece rápido demais para ser amostrada com confiabilidade.

Capacidades de vídeo do Gemini vs. do Claude vs. do ChatGPT

Se a arquitetura baseada em amostragem de quadros do ChatGPT não atende ao seu caso de uso, vale avaliar alternativas. Gemini e Claude oferecem capacidades de vídeo diferentes — e essas diferenças determinam qual modelo funciona para sua implementação específica.

Processamento nativo de vídeo do Gemini

Os modelos Gemini suportam entrada de vídeo nativa em nível de API. Você envia um arquivo de vídeo diretamente, sem pré-processamento em quadros. O modelo processa vídeo como um fluxo contínuo, permitindo rastreamento de movimento, detecção de mudanças de cena e raciocínio temporal que a abordagem baseada em quadros do ChatGPT não consegue fazer.

Exemplo de caso em que o Gemini vence:

Você precisa detectar quando um objeto específico entra e sai do quadro ao longo de um clipe de 30 segundos, ou rastrear como uma pessoa se move pela cena. O Gemini pode seguir objetos entre quadros e raciocinar sobre o movimento. O ChatGPT veria o objeto apenas nos quadros que por acaso foram amostrados — potencialmente perdendo a entrada ou a saída.

Trade-offs:

- A API nativa do Gemini é mais econômica do que a amostragem baseada em quadros do OpenAI. Ao evitar sobrecarga linear de tokens via cache de contexto, o Gemini escala melhor para análises longas.

- Processar vídeos mais longos implica maior latência — o modelo precisa ingerir o arquivo inteiro antes de responder

- Nem todas as variantes do Gemini suportam entrada de vídeo; requer modelos mais recentes do Gemini

- Limites de duração de vídeo existem, mas são mais generosos que as restrições baseadas em contexto do ChatGPT

Quando escolher o Gemini em vez do ChatGPT:

- Seu caso de uso exige rastreamento de movimento, detecção de limites de cena ou entendimento de relações temporais

- Informação crítica aparece e desaparece rapidamente ao longo dos quadros

- Você analisa vídeos em que a progressão de eventos importa (filmagens de esportes, revisão de vigilância, análise de animação)

- Você quer evitar o pré-processamento de extração de quadros

Limitações atuais de vídeo do Claude

No início de 2026, os modelos Claude não suportam entrada direta de vídeo via API. Você pode enviar imagens (incluindo quadros extraídos manualmente de vídeo), mas não há capacidade nativa de processamento de vídeo comparável ao Gemini.

O que o Claude pode fazer:

- Analisar sequências de quadros enviados, semelhante ao método de extração manual do ChatGPT (Método 2)

- Fornecer descrições detalhadas do conteúdo visual em cada quadro

- Raciocinar sobre movimento implícito ou mudanças entre quadros se solicitado explicitamente

- Lidar com sequências mais longas de imagens graças à janela de contexto estendida (até 1M tokens no Claude Opus 4.7)

O que o Claude não pode fazer:

- Aceitar arquivos de vídeo diretamente por qualquer interface

- Rastrear movimento ou objetos automaticamente ao longo de quadros sem instruções quadro a quadro explícitas

- Transcrever áudio — requer pré-processamento separado com Whisper ou ferramenta similar e então passar a transcrição ao Claude

Quando ainda escolher o Claude:

- Seu fluxo de trabalho já inclui extração de quadros como etapa de pré-processamento

- Você está analisando vídeos longos que requerem muitos quadros e precisa da grande janela de contexto do Claude

- Você está comparando a qualidade da análise visual e considera as descrições de quadros do Claude mais precisas para seu domínio (por exemplo, imagens médicas, diagramas técnicos)

- Você precisa combinar a análise de quadros com grandes quantidades de outras informações contextuais

Tabela comparativa de capacidades

| Recurso | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Upload direto de arquivo de vídeo | ✓ (interface web/app) | ✓ (API + interface web) | ✗ |

| Rastreamento nativo de movimento | ✗ | ✓ | ✗ |

| Transcrição de áudio | ✓ (integração com Whisper) | ✓ (integrada) | ✗ (requer ferramenta externa) |

| Análise baseada em quadros | ✓ | ✓ (também processamento contínuo) | ✓ (apenas extração manual) |

| Detecção de mudança de cena | ✗ (apenas manual) | ✓ (automática) | ✗ |

| Tratamento típico de duração de vídeo | ~5–10 min (limitado por contexto) | ~1 hora (dependente da resolução) | N/A (nº de quadros limitado por contexto) |

| Melhor caso de uso | Resumos rápidos, análise em nível de quadro com algum controle | Rastreamento de movimento, raciocínio temporal, vídeo contínuo | Descrição quadro a quadro profunda com grandes necessidades de contexto |

| Suporte a vídeo na API | ✗ (apenas imagens) | ✓ | ✗ |

Quadro de decisão:

- Escolha o ChatGPT quando: Você precisa de resumos rápidos, a informação crítica persiste em múltiplos quadros, está trabalhando com clipes curtos (menos de 10 minutos) e não precisa de rastreamento de movimento. Ideal para conteúdo educacional, demos estáticas de produto, transcrição de reuniões.

- Escolha o Gemini quando: Seu caso de uso exige rastreamento de movimento, detecção de mudanças de cena ou raciocínio temporal sobre como elementos se movem ou mudam ao longo do tempo. Crítico para vigilância, análise de esportes, revisão de animação, ou qualquer cenário em que “o que acontece entre os quadros” importa.

- Escolha o Claude quando: Você já extrai quadros como parte do pipeline, precisa analisar muitos quadros com amplo contexto adicional, ou considera as descrições visuais do Claude mais precisas para seu domínio específico. Exige mais pré-processamento, mas oferece a maior janela de contexto.

Para desenvolvedores que trabalham com múltiplos modelos, a CometAPI fornece uma interface unificada para testar a qualidade do processamento de vídeo entre variantes do GPT, Gemini e Claude sem reescrever o código de integração — útil quando você compara qualidade de saída antes de aderir a um provedor específico.

A resposta real para “o ChatGPT pode assistir a vídeos” não é binária. É “sim, convertendo vídeo em formatos que ele já lida — com limitações que quebram casos de uso específicos”. A maioria das falhas de implementação vem de desencontros arquiteturais, não de lacunas de capacidade. O modelo funciona exatamente como projetado; os desenvolvedores apenas esperavam um design diferente.

Se você está construindo recursos de análise de vídeo em escala, teste seu fluxo de trabalho com casos extremos primeiro: envie o mesmo vídeo via arquivo direto, quadros extraídos manualmente e métodos apenas de transcrição. Compare as saídas. O método que captura o sinal crítico do seu caso de uso — não o mais rápido de implementar — é o que sobrevive ao tráfego de produção.

Antes de adotar o ChatGPT para vídeo:

- Identifique se sua informação crítica vive em quadros estáveis, no movimento ou no áudio

- Teste a cobertura de amostragem de quadros extraindo manualmente nas taxas que você espera usar

- Verifique se o texto na tela é legível na resolução do seu vídeo após a compressão

- Confirme se a duração do vídeo se encaixa nos limites práticos de contexto do seu plano

- Tenha um plano reserva para conteúdo que apareça brevemente ou entre quadros amostrados

Para desenvolvedores que avaliam vários provedores de IA para cargas de vídeo, a CometAPI oferece um playground unificado para testar ChatGPT, Gemini e Claude com as mesmas entradas de vídeo — permitindo comparar qualidade de saída, latência e custo antes de construir integrações específicas de provedor.

FAQ - Guia de análise de vídeo com IA

Respostas rápidas para dúvidas comuns sobre análise de vídeo com IA.

O ChatGPT pode analisar vídeos?

Sim, o ChatGPT (GPT-4o e posteriores) pode analisar vídeos amostrando quadros (~1 por segundo) e transcrevendo o áudio. Funciona bem para resumos de reuniões, extração de texto de slides e identificação de objetos. No entanto, tem dificuldades com rastreamento de movimento, vídeos com mais de 10 minutos e streaming em tempo real.

Como envio vídeos ao ChatGPT?

Envio por URL direto (recomendado): Envie via URL público para análise rápida. Ideal para vídeos com menos de 10 minutos.

Extração manual de quadros: Extraia quadros específicos para controle preciso. Ideal quando você precisa analisar momentos particulares ou reduzir custos de tokens.

Qual é o comprimento máximo de vídeo que o ChatGPT consegue lidar?

O ChatGPT lida de forma confiável com vídeos de até 5–10 minutos. Além disso, será necessário segmentar o vídeo ou migrar para o Gemini 2.5 Pro, que suporta vídeos de até 60 minutos nativamente.

Quais são as limitações da análise de vídeo do ChatGPT?

- Não consegue rastrear movimento contínuo (esportes, dança)

- Timestamps imprecisos (±1 segundo de acurácia)

- Perde conteúdo que aparece por menos de 1 segundo

- Limite prático de 10 minutos

- Sem suporte a streaming em tempo real

- Tem dificuldades com vídeos escuros ou de baixa qualidade

- Fraco em raciocínio temporal de causa e efeito *

Devo usar o ChatGPT ou o Gemini para análise de vídeo?

Use o ChatGPT para:

- Vídeos com menos de 10 minutos

- Raciocínio textual superior após a análise de vídeo

- Análise em nível de quadro (slides, capturas de tela)

Use o Gemini para:

- Vídeos de 10–60 minutos

- Rastreamento de movimento e análise de deslocamento

- Tarefas de raciocínio temporal

- Filmagens de esportes, dança ou vigilância *

O Claude pode analisar vídeos?

Não, o Claude não suporta entrada direta de vídeo. No entanto, você pode extrair quadros de vídeos e analisá-los com o Claude, que oferece raciocínio textual superior e uma janela de contexto ampla para análises longas.

Quanto custa a análise de vídeo?

Os custos variam por modelo e duração do vídeo:

- ChatGPT 4o: ~US$ 0,05 por minuto

- Gemini 2.5 Pro: ~US$ 0,04 por minuto

A CometAPI oferece crédito para novos usuários começarem.