Claude Opus 4.7, lançado em 16 de abril de 2026, é uma atualização significativa em relação ao Opus 4.6 em codificação, workflows agênticos, visão e seguimento de instruções. Ele marca +6.8pp no SWE-bench Verified (87.6% vs 80.8%), +10.9pp no SWE-bench Pro (64.3% vs 53.4%), +12pp no CursorBench (70% vs 58%), e entrega visão com resolução 3.3× maior, com loops de autoverificação que reduzem alucinações em tarefas longas. A precificação permanece idêntica oficialmente ($5/$25 por milhão de tokens), mas o esforço baixo do 4.7 iguala a qualidade de esforço médio do 4.6, reduzindo custos reais.

Na CometAPI, você obtém ambos os modelos (Claude Opus 4.7 e Opus 4.6) a $4 de entrada / $20 de saída com endpoints compatíveis com OpenAI e zero vendor lock-in. Faça o upgrade se você executa agentes de codificação em produção, análise complexa de documentos ou workflows multi-sessão — 4.7 é o novo padrão para trabalho de fronteira.

Claude Opus 4.7 vs Opus 4.6: Comparação rápida

Em resumo: Opus 4.7 parece “Opus 4.6, porém sem estrangulamento e mais refinado”. Ele remove limitações que ocasionalmente apareciam no 4.6 (por exemplo, abandono prematuro de tarefas, menor acuidade visual) enquanto adiciona eficiência via raciocínio adaptativo. Usuários relatam que é mais “opinado” e colaborativo — como trabalhar com um engenheiro sênior que confere o próprio trabalho.

Por que o Claude Opus 4.7 importa em 2026

Em 16 de abril de 2026, a Anthropic lançou discretamente seu modelo geralmente disponível mais capaz até então: Claude Opus 4.7. Poucas semanas após o Mythos Preview restrito (um powerhouse focado em ciber), o Opus 4.7 retoma a liderança para workloads de produção mantendo exatamente o mesmo preço do Opus 4.6.

Desenvolvedores e empresas não precisam mais “ficar de babá” das tarefas de codificação mais difíceis. Usuários relatam delegar “do tipo que antes exigia supervisão de perto” ao 4.7 com confiança. O modelo agora autoverifica suas saídas, segue instruções literalmente e sustenta execuções agênticas de múltiplas horas com menos erros de ferramenta e melhor recuperação de erros.

O modelo se destaca em:

- Tarefas rigorosas e longas com autoverificação embutida (Planejar → Executar → Verificar → Relatar).

- Seguimento literal de instruções — chega de interpretações frouxas de “consider” ou “you might”.

- Visão substancialmente melhor (até 2.576 px na aresta longa ≈ 3.75 MP, mais de 3× a resolução anterior).

- Melhor “gosto” e criatividade em saídas profissionais como interfaces, slides e documentos.

- Memória de sistema de arquivos aprimorada para autonomia multi-sessão real.

Novos recursos incluem um nível de esforço xhigh (entre high e max), orçamentos de tarefa na Platform API e integração com a ferramenta Claude Design. O ID do modelo agora é claude-opus-4-7. O preço não mudou oficialmente, mas melhorias na eficiência de tokens frequentemente reduzem o custo efetivo por tarefa.

Melhorias centrais de capacidade – O que realmente mudou

Engenharia de software avançada e codificação agêntica

Opus 4.7 brilha nos problemas mais difíceis. Em um benchmark interno de 93 tarefas de codificação, alcançou um aumento de 13% na resolução em relação ao 4.6, resolvendo quatro tarefas que nem o 4.6 nem o Sonnet 4.6 conseguiram quebrar. O Rakuten-SWE-Bench mostrou 3× mais tarefas em nível de produção resolvidas sem intervenção humana. O CursorBench (workflows reais de IDE) saltou +12 pontos para 70%.

O benchmark interno de 93 tarefas de codificação mostrou um aumento de 13%, resolvendo quatro tarefas que nem o 4.6 nem o Sonnet 4.6 conseguiram quebrar. Em workflows agênticos, a Box reportou 2× menos chamadas de LLM (7.1 vs 16.3) e 30% menor uso de AI-units para a mesma saída — traduzindo diretamente em ganhos de custo e latência.

Por que isso importa para desenvolvedores: Agora você pode confiar no Opus 4.7 para “o trabalho de codificação mais difícil” que antes exigia supervisão. Ele presta atenção precisa às instruções, verifica suas próprias saídas e reutiliza memória do sistema de arquivos entre sessões — perfeito para refatorações autônomas ao longo de dias.

Vitórias no mundo real incluem:

- Motor autônomo de text-to-speech em Rust a partir de um único prompt.

- Correções de condições de corrida e bugs de concorrência que travavam modelos anteriores no Terminal-Bench 2.0 (+4.0 pp).

- Aumento de 10–15% no sucesso de tarefas no Factory Droids com ⅓ menos erros de ferramenta.

- Melhorias de dois dígitos em qualidade de código, qualidade de testes e precisão de revisão (CodeRabbit, Qodo).

O 4.7 em esforço baixo agora iguala a qualidade de esforço médio do 4.6, então você faz mais pelo mesmo (ou menor) gasto de tokens.

Salto em visão e multimodalidade

Este é o maior upgrade único. A resolução máxima de imagem salta de 1.15 MP (1568 px) para 3.75 MP (2576 px na aresta longa) — um aumento de 3.3× em pixels com mapeamento de coordenadas 1:1. Chega de contas de fator de escala para screenshots ou diagramas.

Resultados:

- Benchmark de acuidade visual: 98.5% vs 54.5% no 4.6.

- CharXiv-R (sem ferramentas): +13.4 pp; com ferramentas: +13.6 pp.

- Desbloqueia agentes de uso de computador pixel-perfect, análise densa de screenshots, parsing de estruturas químicas e revisão de UI/UX.

Workflows agênticos, confiabilidade e seguimento de instruções

O Opus 4.7 introduz autoverificação nativa — o modelo planeja, executa, verifica e então reporta. Isso reduz drasticamente respostas confiantes porém erradas em tarefas de horizonte longo. As melhorias de memória de sistema de arquivos permitem verdadeira autonomia de múltiplos dias.

O seguimento de instruções é mais estrito e literal. Prompts ajustados ao estilo mais solto do 4.6 podem precisar de auditoria — frases como “consider” agora são tratadas como requisitos rígidos. Isso é um recurso para trabalhos de precisão, mas exige migração de prompts.

Nota sobre regressões: A recuperação de agulhas em contexto longo (MRCR) caiu notavelmente (por exemplo, 91.9% → 59.2% em 256K). A Anthropic observa que está descontinuando tais testes sintéticos em favor de métricas aplicadas GraphWalks, onde a compreensão de código real permanece forte.

Novo nível de esforço xhigh + orçamentos de tarefa

O Opus 4.7 adiciona xhigh entre high e max para controle granular. O Claude Code agora padroniza xhigh em todos os planos. O novo task_budget (beta público) permite ao modelo acompanhar o total de tokens ao longo de todo o loop agêntico e finalizar graciosamente.

Seguimento de instruções, autoverificação e memória

O Opus 4.7 interpreta prompts mais literalmente — ótimo para precisão, mas prompts vagos antigos podem precisar de ajuste. Agora ele cria seus próprios passos de verificação (Planejar → Executar → Verificar → Relatar) e reutiliza muito melhor a memória do sistema de arquivos em trabalhos multi-sessão do que o 4.6. Para equipes construindo agentes persistentes, este é um dos upgrades mais úteis porque reduz reexplicação, recarregamento e replanejamento.

Atualização do tokenizer

O novo tokenizer melhora a qualidade, mas pode consumir 1.0–1.35× mais tokens (até +35%). O endpoint de contagem de tokens agora retorna números diferentes. Efeito líquido: maior qualidade por tarefa frequentemente compensa o aumento, especialmente em níveis de esforço menores.

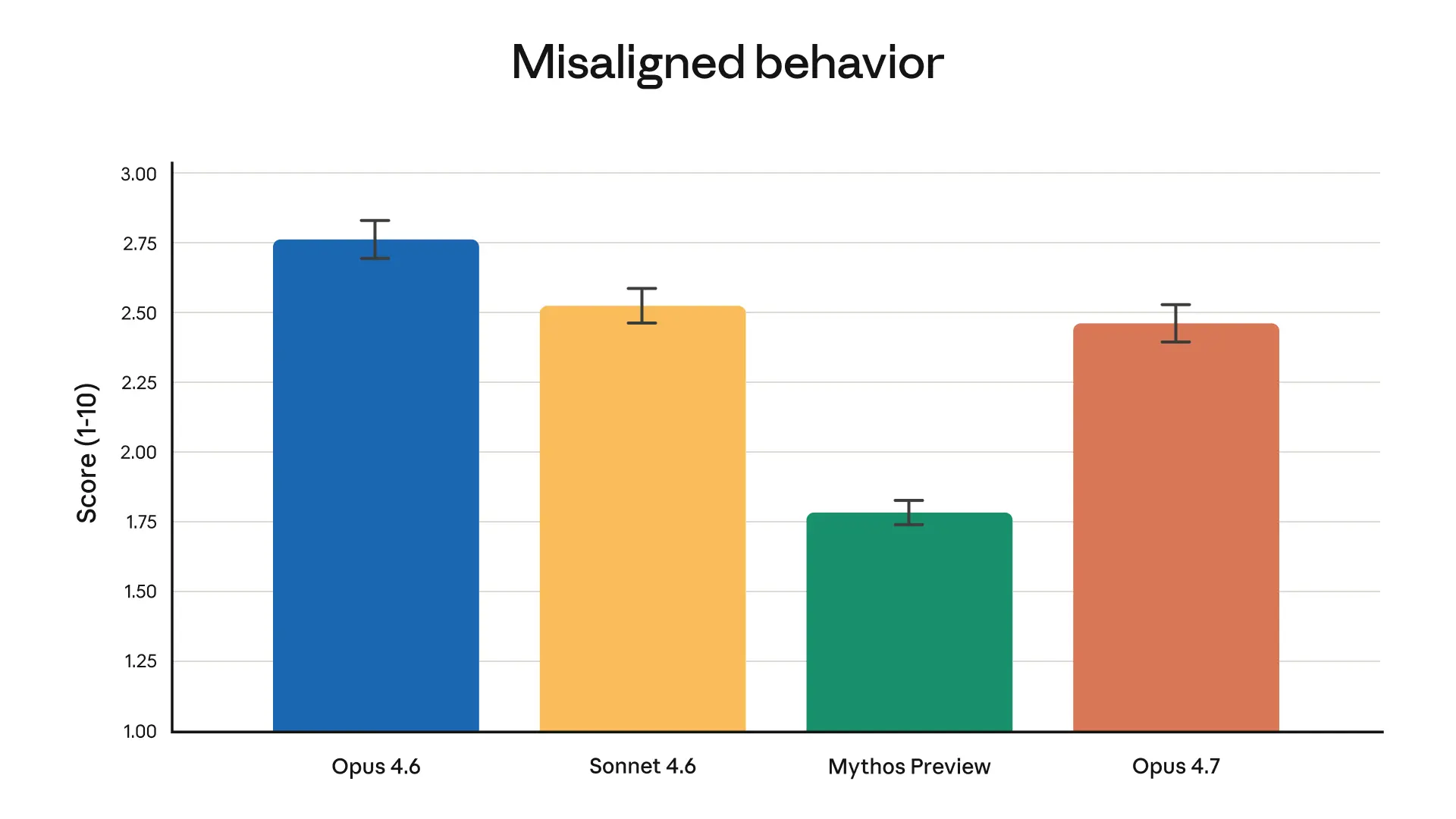

Segurança, alinhamento e cibersegurança

O perfil de segurança é similar ao 4.6 (baixo desalinhamento), com melhorias modestas em honestidade e resistência a prompt-injection.

O Opus 4.7 traz proteções do Project Glasswing: bloqueio em tempo real de usos ciber proibidos/de alto risco. Pontuação do CyberGym intencionalmente estável. Comportamento desalinhado modestamente melhorado em relação ao 4.6. O system card completo está disponível no site da Anthropic.

Preços, eficiência de tokens e economia com CometAPI

Os preços oficiais são idênticos, mas o custo efetivo por tarefa cai porque o 4.7 em esforço baixo ≈ qualidade de esforço médio do 4.6, e taxas de sucesso maiores significam menos tentativas. O novo tokenizer aumenta tokens de entrada em 0–35% para o mesmo texto, mas o uso líquido costuma ser favorável na qualidade combinada.

Vantagem da CometAPI: Acesse ambos os modelos por $4 de entrada / $20 de saída por milhão de tokens — 20% mais barato que o oficial — além de alternância transparente entre 500+ modelos (GPT-5.4, Gemini 3.1, etc.) via um único endpoint compatível com OpenAI ou Anthropic Messages. Sem downtime se os provedores mudarem preços. Zero vendor lock-in. Playground de testes e faturamento unificado tornam a migração sem esforço.

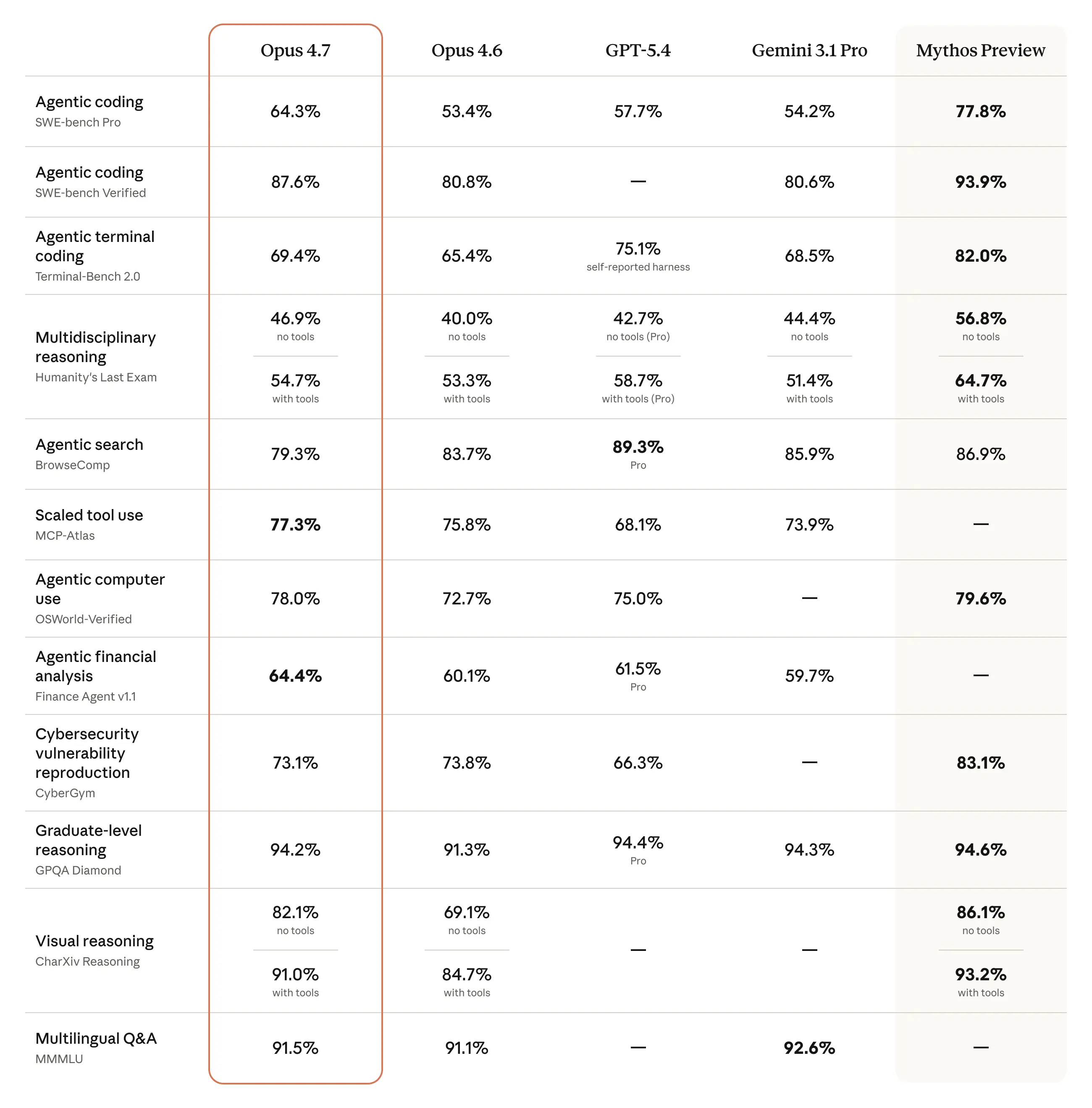

Mergulho detalhado lado a lado nos benchmarks

Aqui está o confronto completo em 14 benchmarks dos dados de lançamento da Anthropic (verificados por parceiros):

Benchmarks de codificação

- SWE-bench Verified: 80.8% → 87.6% (+6.8 pp)

- SWE-bench Pro: 53.4% → 64.3% (+10.9 pp)

- Terminal-Bench 2.0: 65.4% → 69.4% (+4.0 pp)

Agência e uso de ferramentas

- MCP-Atlas: 62.7% → 77.3% (+14.6 pp) — maior salto isolado

- OSWorld-Verified: 72.7% → 78.0% (+5.3 pp)

- Finance Agent: 60.7% → 64.4% (+3.7 pp)

Raciocínio e conhecimento

- GPQA Diamond: 91.3% → 94.2% (+2.9 pp)

- HLE (sem ferramentas): 40.0% → 46.9% (+6.9 pp)

- MMMLU: 91.1% → 91.5% (+0.4 pp)

Visão

- CharXiv-R (sem ferramentas): 68.7% → 82.1% (+13.4 pp)

- CharXiv-R (com ferramentas): 77.4% → 91.0% (+13.6 pp)

Regressões (transparentes)

- BrowseComp: 84.0% → 79.3% (–4.7 pp) — sensível ao harness

- CyberGym: 73.8% → 73.1% (–0.7 pp) — intencional por segurança

Benchmark interno de agente de pesquisa: 0.715 geral (pontuação empatada no topo), com o módulo Finance subindo de 0.767 para 0.813.

Desempenho no mundo real e casos de uso

Os testes de workflow agêntico da Box mostraram o Opus 4.7 completando tarefas com 7.1 chamadas de LLM vs 16.3 para o 4.6 (2.3× menos) e 30% menor uso de AI Unit. A latência caiu de 242 s para 183 s na mediana.

Parceiros corporativos (Harvey, Databricks, Hebbia, Ramp, Genspark) relatam:

- 21% menos erros em raciocínio sobre documentos.

- Melhor coordenação multiagente ao longo de horas.

- Integração mais estreita de slides, planilhas e código.

Quem deve atualizar imediatamente?

- Times de engenharia de software usando Cursor/Claude Code.

- Construtores de agentes de IA que precisam de autonomia confiável de longo prazo.

- Workflows pesados em visão (screenshots, diagramas, revisão de UI).

- Automação em finanças, jurídico e trabalho do conhecimento.

Mudanças na API, guia de migração e exemplos de código

Quebras de compatibilidade (Messages API)

- Orçamentos de pensamento estendidos removidos → use

thinking: {"type": "adaptive"}. - Parâmetros de amostragem (

temperature, etc.) não são mais aceitos → use prompting. - Conteúdo de “thinking” omitido por padrão.

- O novo tokenizer exige folga em

max_tokens.

Guia de migração + exemplos de código (CometAPI)

Passo 1: Atualize o nome do modelo para claude-opus-4-7 (ou alias da CometAPI).

Passo 2: Audite prompts para interpretação literal.

Passo 3: Teste níveis de esforço (comece com xhigh para codificação).

Passo 4: Use orçamentos de tarefa para limitar gastos.

Aqui está um exemplo Python pronto para rodar usando o endpoint compatível com Anthropic da CometAPI (funciona também com o SDK oficial):

(Python)

import anthropic

import os

client = anthropic.Anthropic(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI sk- key

base_url="https://www.cometapi.com/console/" # CometAPI base

)

message = client.messages.create(

model="claude-opus-4-7", # or "claude-opus-4-6" for comparison

max_tokens=4096,

temperature=0.7,

effort="xhigh", # New level for deep reasoning

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Refactor this legacy Python module into clean, type-hinted, testable code. Follow instructions literally: use Pydantic v2, add comprehensive tests, no external deps beyond stdlib + pydantic. Verify your changes before responding."},

{"type": "image", "source": {"type": "base64", "media_type": "image/png", "data": "iVBORw0KGgoAAAANSUhEUg..."} } # High-res screenshot support

]

}

]

)

print(message.content[0].text)

Prompt de demonstração de autoverificação (funciona muito melhor no 4.7):

(text):

Plan → Execute → Verify → Report:

1. Analyze the attached codebase.

2. Propose refactors.

3. Implement changes in a new file.

4. Run mental unit tests and edge cases.

5. Only output final verified code if all checks pass.

Execute testes A/B em seus próprios workloads — a maioria dos times vê 20–40% menos iterações.

Observação:

Primeiro, o novo tokenizer gera mais tokens com o mesmo texto. O Opus 4.7 introduziu um novo tokenizer, melhorando como o modelo processa texto. A troca é que a mesma entrada mapeará para mais tokens; o número exato depende do tipo de conteúdo, mas fica aproximadamente entre 1.0 e 1.35 vezes.

Em segundo lugar, níveis de esforço mais altos permitem consideração mais abrangente, especialmente em cenários agênticos de múltiplas rodadas.

Isso leva a melhor confiabilidade, mas também a mais tokens de saída.

A solução oficial oferece três abordagens:

- Ajustar o nível de esforço usando o parâmetro

efficiency - Limitar o orçamento usando orçamentos de tarefa

- Dizer ao modelo para “ser mais conciso” no prompt.

Limitações conhecidas e notas de migração

- Orçamentos de pensamento estendidos removidos → use

thinking: {"type": "adaptive"}.thinking: {type: "enabled", budget_tokens: N}não é mais suportado; use pensamento adaptativo em vez disso. - Parâmetros de amostragem (

temperature, etc.) não são mais aceitos → use prompting.temperature,top_petop_kdevem ser removidos das requisições ao migrar para o Opus 4.7. - O modelo é descrito como mais literal e mais direto do que o Opus 4.6, o que é útil para precisão, mas pode exigir prompts mais afiados.

- O novo tokenizer exige folga em

max_tokens. A Anthropic recomenda rever a folga demax_tokensporque o Opus 4.7 pode produzir contagens de tokens mais altas para o mesmo texto. - Conteúdo de “thinking” omitido por padrão.

Veredito final e recomendação

Claude Opus 4.7 é o vencedor claro para qualquer workload sério de codificação, agência ou visão em 2026. Os ganhos não são incrementais — são transformadores para produção. Se você está no Opus 4.6, migre esta semana. A combinação de maior qualidade, menos chamadas e preço idêntico (ou menor via CometAPI) torna a decisão óbvia.

Próximos passos:

- Teste o 4.7 no playground da CometAPI com seus workloads reais.

- Atualize um serviço primeiro (Cursor ou seu framework de agentes).

- Monitore o uso de tokens na primeira semana.

- Escalone com confiança sabendo que você tem acesso unificado e mais barato a 500+ modelos.