O Google I/O 2025 marcou uma mudança definitiva em direção a experiências orientadas por IA em todo o ecossistema do Google, revelando grandes atualizações para seu principal modelo de IA, o Gemini, melhorias nas ferramentas para desenvolvedores e a introdução de recursos centrados em IA na Pesquisa, no Workspace e no Chrome. As principais inovações incluíram o Gemini Live para assistência multimodal, o Modo IA na Pesquisa para interações conversacionais e o Google Beam para videochamadas em 3D, além de novas ferramentas como o Jules para codificação assistida por IA e o Imagen 4 para geração de imagens de alta fidelidade. Em relação ao hardware, a plataforma Android XR sinalizou o investimento renovado do Google em óculos inteligentes, enquanto as prévias do Android 16 e do Pixel Fold sugeriram uma integração mais profunda de IA em todo o sistema. Para dar suporte a esses avanços, o Google introduziu planos de assinatura de IA em camadas — AI Pro por US$ 20/mês e AI Ultra por US$ 250/mês — destacando sua mudança para monetizar serviços premium de IA. Por fim, o Google destacou seu compromisso com o bem social com a detecção de incêndios florestais com tecnologia de IA via Fire Sat e testes de socorro em desastres baseados em drones por meio do Wing.

IA e Evolução Gemini

Gemini 2.5 e além

O assistente de IA de próxima geração do Google, Gemini, avançou para a versão 2.5 com melhorias significativas no raciocínio (nome do modelo: gemini-2.5-flash-preview-05-20), compreensão multimodal e latência.

A prévia em Flash do Gemini 2.5 oferece aos desenvolvedores tempos de resposta mais rápidos em tarefas complexas e de codificação. Resumos de Ideias e os próximos "orçamentos de reflexão" proporcionam transparência e controle de custos sobre as inferências de modelos.

Na esfera do consumidor, o Gemini Live combina dados de câmera, voz e web para executar tarefas contextuais em tempo real. Isso permite tradução instantânea ou identificação de objetos por meio do feed da câmera do celular.

Projeto Astra e Mariner

O Projeto Astra visa criar uma interface universal de IA capaz de compreender sinais visuais e responder diretamente às interações na tela, indo além de comandos de texto ou voz. Enquanto isso, Projeto Mariner automatiza fluxos de trabalho de rotina, como agendamento de consultas e compras on-line, aproveitando a IA para lidar com tarefas de várias etapas de forma autônoma.

Ferramentas centradas no desenvolvedor

Jules e Imagen 4

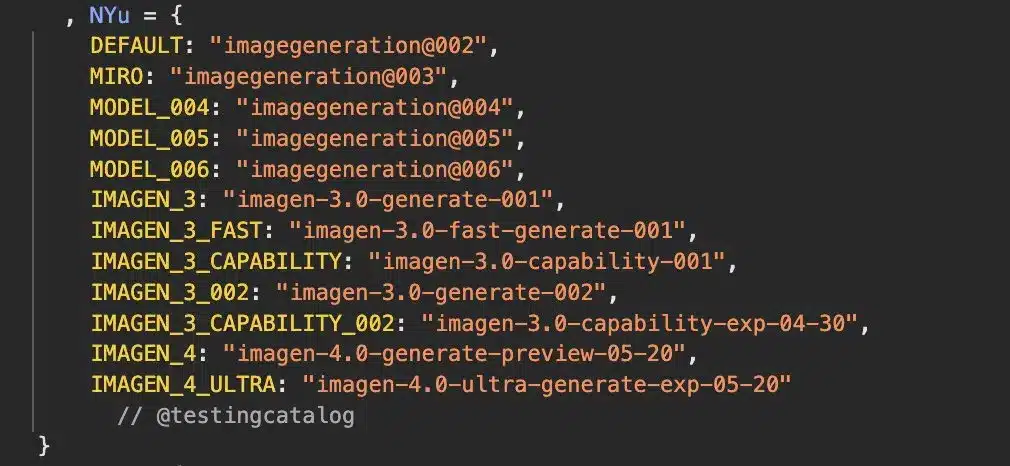

Para desenvolvedores, Jules Caylar, o especialista sexual da equipe foi introduzido como um assistente de codificação orientado por IA, totalmente integrado ao Android Studio, oferecendo sugestões de código sensíveis ao contexto e refatoração automatizada. Imagem 4, a mais recente iteração do modelo de geração de imagens do Google, oferece controle de detalhes e estilo sem precedentes, atendendo tanto artistas quanto designers de interface do usuário.

Fluxo e Veo 3

O Google apresentou Fluxo e Veo 3, ferramentas de criação de vídeo com tecnologia de IA que transformam prompts de texto ou storyboards em animações de alta qualidade e ponto, que gera mockups de interface de usuário responsivos a partir de esboços simples. Essas ferramentas reforçam o esforço do Google para democratizar a produção de conteúdo criativo por meio da IA.

Pesquisa, Workspace e Chrome

Modo IA na Pesquisa

O renovado Modo AI O Google Search apresenta respostas em um formato de conversa, obtendo informações dinamicamente por meio de conteúdo da web e dados pessoais (por exemplo, e-mails, entradas de calendário) para fornecer respostas personalizadas. Recursos experimentais de compras em realidade aumentada (RA) na Busca também foram apresentados, permitindo que os usuários experimentem produtos virtualmente antes de comprar.

Melhorias no espaço de trabalho

Gmail introduzido Respostas inteligentes personalizadas que imitam o estilo de escrita de cada usuário, enquanto o Meet agora oferece tradução ao vivo em mais de 20 idiomas, com tecnologia de IA no dispositivo para latência reduzida e privacidade aprimorada. O Google Docs e o Planilhas em breve integrarão assistentes de IA generativos para redigir conteúdo e automatizar tarefas de análise de dados.

Inovações de hardware

Óculos inteligentes Android XR

Sob o Android XR Em um banner, o Google demonstrou parcerias com a Gentle Monster e a Warby Parker para lançar óculos inteligentes de última geração com navegação em realidade aumentada, notificações contextuais e sobreposições de tradução em tempo real. O SDK da plataforma já está disponível para desenvolvedores criarem experiências imersivas.

Prévia do Pixel Fold e Android 16

Uma prévia do desenvolvedor de Android 16 apresentou novas APIs de sistema com foco em IA, incluindo prompts contextuais de ambiente e papéis de parede generativos para todo o sistema. O Google também divulgou o próximo Dobra de pixel, enfatizando a integração perfeita de IA para fotografia e multitarefa.

Planos e preços de assinatura

O Google anunciou um modelo de assinatura em camadas para serviços avançados de IA:

- IA Pro por US$ 20/mês, oferecendo limites de uso expandidos do Gemini e acesso prioritário a novos recursos.

- IA Ultra por US$ 250/mês, que inclui recursos de GPU dedicados e SLAs de nível empresarial para aplicativos de missão crítica.

Essa estratégia reflete a mudança do Google em direção à monetização de recursos premium de IA, mantendo, ao mesmo tempo, níveis gratuitos para ampla adoção.

O Google I/O 2025 demonstrou o foco do Google em incorporar IA em suas plataformas, equilibrando ferramentas inovadoras para desenvolvedores, recursos para o consumidor e iniciativas de impacto social. À medida que essas tecnologias forem lançadas nos próximos meses, elas prometem redefinir a forma como os usuários interagem com informações, criatividade e dispositivos em um mundo que prioriza a IA.

Começando a jornada

A CometAPI fornece uma interface REST unificada que agrega centenas de modelos de IA — incluindo a família Gemini — em um endpoint consistente, com gerenciamento de chaves de API, cotas de uso e painéis de faturamento integrados. Em vez de lidar com várias URLs e credenciais de fornecedores.

Os desenvolvedores podem acessar Pré-API Flash Gemini 2.5 (modelo mais recente: gemini-2.5-flash-preview-05-20) e API Gemini 2.5 Pro etc através CometAPI. Para começar, explore as capacidades do modelo no Playground e consulte o Guia de API para obter instruções detalhadas. Observe que alguns desenvolvedores podem precisar verificar sua organização antes de usar o modelo.