TL;DR: A versão recente do OpenClaw adiciona suporte de primeira classe e compatível com versões futuras ao GPT-5.4 da OpenAI e apresenta uma arquitetura de “troca a quente de memória” que permite aos agentes do OpenClaw alterar, em tempo de execução, qual modelo e qual armazenamento de memória estão ativos com mínima interrupção. Isso desbloqueia fluxos de trabalho de grande contexto (as janelas de contexto ampliadas do GPT-5.4), especialização de modelo sob demanda e otimizações de custo/latência para agentes em produção. A atualização está disponível nas releases do OpenClaw e na documentação correspondente; os exemplos abaixo mostram configuração prática, trechos de código, contexto de benchmark e práticas recomendadas.

O que a atualização do OpenClaw realmente entregou (resumo rápido)

Em 9 de março de 2026, o projeto OpenClaw — um framework de agentes open-source adjacente ao ecossistema da OpenAI — lançou uma grande release do core (2026.3.7) que adiciona suporte de primeira classe ao GPT-5.4 e um novo mecanismo de troca a quente de memória no seu motor de contexto. Esta versão converte um framework experimental de agentes amplamente utilizado naquilo que os mantenedores descrevem como um “Sistema Operacional de Agentes” — visando tornar fluxos de trabalho de agentes em produção e troca de modelos algo contínuo para desenvolvedores e equipes.

3 itens práticos que importam para quem constrói agentes:

- Suporte de primeira classe ao GPT-5.4 — aliases de modelo e mapeamentos de provedores que permitem aos agentes selecionar o GPT-5.4 como modelo principal de execução (incluindo sobrescritas por canal e fixações de modelo por agente).

- Motor de Contexto e vinculação distribuída de canais — melhorias em como o OpenClaw monta janelas de contexto longas a partir de memória, saídas de ferramentas e histórico de canais para que modelos de alta capacidade recebam entradas bem estruturadas.

- Arquitetura de memória com troca a quente — superfícies de plugin e fluxos de trabalho de memória mais claros para que você possa substituir backends de memória ou atualizar agentes sem perder a “identidade” ou corromper o estado persistido (a memória em si permanece a fonte única de verdade). O design de memória do OpenClaw (arquivos Markdown simples, busca indexada, recuperação plugável) é parte do que habilita uma troca a quente segura.

GPT-5.4 — O que é o GPT-5.4 e avanços de benchmarks

GPT-5.4 é a mais recente versão de fronteira da OpenAI focada fortemente em produtividade profissional (planilhas, edição de documentos e apresentações, raciocínio em múltiplas etapas e controle de ferramentas). Segundo a OpenAI e a cobertura de imprensa independente, o lançamento enfatiza:

- Contexto expandido: o GPT-5.4 introduz o próximo patamar de janelas de contexto, com opções experimentais de 1M tokens e melhor manuseio de contexto longo disponíveis via endpoints Codex/compatíveis com Codex — ajustes de configuração como

model_context_windowemodel_auto_compact_token_limitsão expostos para desenvolvedores. Isso permite manter um estado de conversa, documentos e bases de código muito maiores no contexto ativo. - Maior precisão em planilhas e raciocínio — a OpenAI relata uma melhora significativa em tarefas de modelagem de planilhas (pontuações médias ~87% vs ~68% do GPT-5.2 no benchmark de planilhas bancárias/analistas).

- Melhorias de precisão e factualidade: avaliações e QA iniciais mostram ~33% de redução em alucinações e menos saídas propensas a erro em relação ao GPT-5.2, com ganhos notáveis em redação de documentos e trabalho com planilhas. Revisores também citaram uma redução de ~18% em respostas propensas a erro em certas tarefas de produtividade.

- Uso de computador integrado e melhorias da linhagem Codex — o GPT-5.4 inclui capacidades herdadas da linhagem Codex que melhoram geração de código, depuração interativa e condução operacional de ferramentas (automação de mouse/teclado/capturas de tela em algumas demonstrações). Isso o torna melhor no ciclo escrever-executar-inspecionar-corrigir típico de loops de agentes.

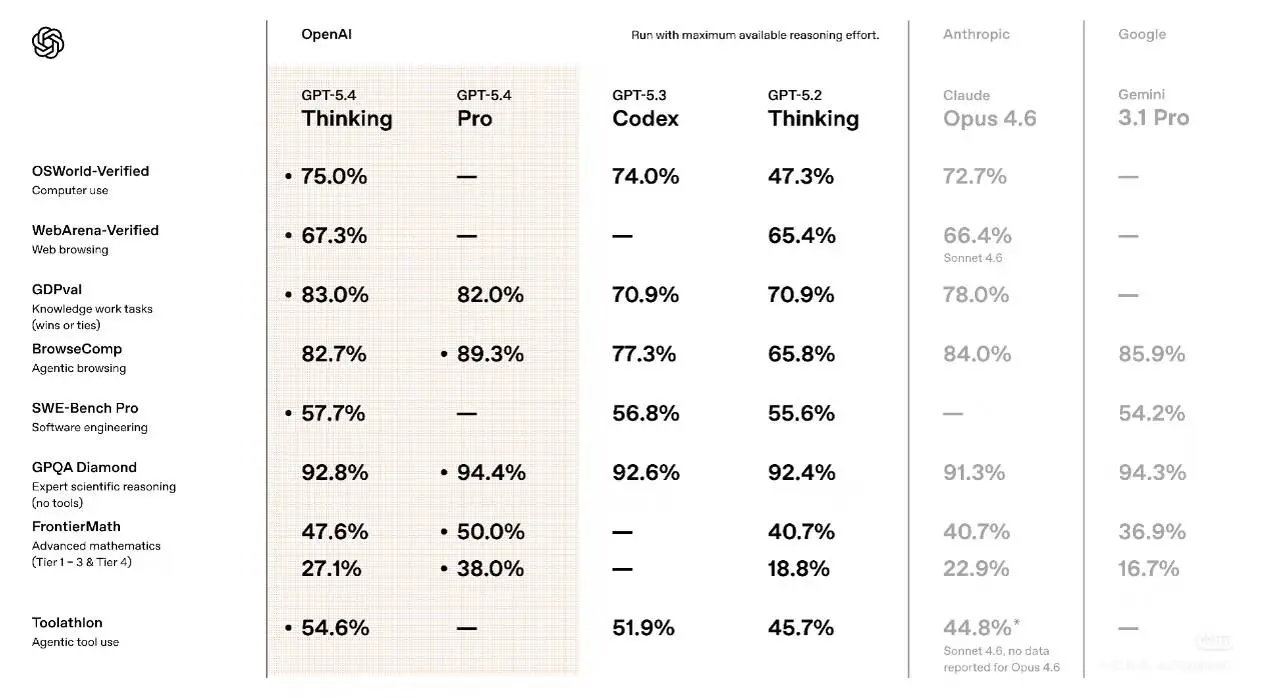

Benchmarks e contexto comparativo (o que significam os números)

- Modelagem de planilhas: benchmark interno de planilhas da OpenAI: pontuação média de ~87,3% para o GPT-5.4 vs ~68,4% para o GPT-5.2. Este é o destaque que o fornecedor usa para mostrar ganhos específicos de tarefa.

- Interação com computador (OSWorld / testes estilo agente): testadores independentes e execuções da comunidade mostram que o GPT-5.4 melhora em tarefas de interação de agente que envolvem manipulação de desktop ou UI simulada, às vezes superando variantes recentes de modelos da Anthropic por margens pequenas nesses conjuntos de tarefas (diferenças significativas para agentes, mas não necessariamente decisivas em toda carga de trabalho).

Interpretação: o GPT-5.4 não é uma “bala de prata” que vence tudo. Ele tem pontos fortes claros em uso integrado de ferramentas, padrões de execução de código e raciocínio com planilhas — exatamente as cargas de trabalho que agentes OpenClaw costumam executar. Para quem constrói agentes, a combinação de maior confiabilidade como executor (linhagem Codex) + competência de planejamento + melhor tratamento de contexto longo é altamente relevante.

OpenClaw com suporte ao GPT-5.4: o que mudou e por que isso importa

A release do OpenClaw (veja a página de releases do projeto) atualiza os resolvedores de modelos e o runtime para serem compatíveis com versões futuras em relação ao contexto expandido e limites de tokens do GPT-5.4, além de adicionar a capacidade de “troca a quente de memória” para que agentes possam alternar backends de memória ou modelos em tempo de execução. Isso é feito de três formas concretas: 1) atualizações de metadados de modelo e do resolvedor para aceitar o contexto maior e limites de tokens; 2) mudanças no runtime do agente para orquestrar trocas de modelo com graça e aquecimento de cache; 3) uma API de memória permitindo múltiplos canais de memória e gatilhos de troca a quente.

O suporte da versão 2026.3.7 ao GPT-5.4, somado ao design de memória com troca a quente, oferece duas vantagens práticas e complementares:

- Caminho de upgrade de modelo direto. O OpenClaw agora pode apresentar o GPT-5.4 como um “runtime” selecionável para agentes, permitindo que você troque de modelos GPT-5.x mais antigos ou de fornecedores alternativos sem retrabalhar a lógica do agente. A atualização do OpenClaw declara explicitamente a integração estável do GPT-5.4 no core.

- Troca a quente de memória. Em vez de persistir um único snapshot linear de memória, o Motor de Contexto do OpenClaw permite que partições de memória sejam destacadas, trocadas ou migradas em tempo de execução — por exemplo, trocar um shard de vetor de alto recall para depuração ou trocar para uma variante de memória sanitizada para GDPR em auditorias externas — sem parar o agente. Isso reduz o risco de interrupção em produção e habilita configurações de memória específicas por caso de uso (depuração vs privacidade vs desempenho).

avanços práticos de desempenho e vantagens

A integração do OpenClaw foca em três áreas práticas onde o GPT-5.4 se destaca:

- Fidelidade na orquestração de ferramentas. A melhoria interna do GPT-5.4 em busca de ferramentas e raciocínio reduz churn de chamadas de ferramentas (menos chamadas redundantes e menos retries). Isso se traduz em menos chamadas de API e conclusão mais rápida para fluxos complexos. Relatos iniciais indicam melhorias na eficiência de tokens e de chamadas de ferramentas em comparação a modelos GPT-5.x anteriores.

- Tratamento de contexto mais longo e rico. Agentes OpenClaw agora podem manter contextos ativos muito maiores (incluindo shards de memória trocados), permitindo gerenciar conversas longas, projetos com múltiplos arquivos e depuração iterativa sem perder estado.

- Saída de código mais determinística. Para fluxos que geram código automaticamente (ganchos de CI, stubs de funções, templates de infraestrutura), o GPT-5.4 tende a produzir saídas mais consistentes e executáveis, reduzindo a necessidade de revisão humana. Testes independentes mostram melhorias notáveis em métricas de qualidade de código vs modelos GPT-5 anteriores.

- Continuidade de memória — a “troca a quente de memória” permite substituir ou ampliar stores de memória (cache local, DB vetorial, memória do LLM) sem perder o estado ou contexto do agente, viabilizando testes A/B, upgrades contínuos e failover.

No teste de benchmark OOLONG, a nova versão do OpenClaw, em conjunto com o plugin lossless-claw, alcançou uma pontuação alta de 74,8, deixando o Claude Code (70,3 pontos) bem para trás. Em particular, o OpenClaw demonstrou estabilidade e precisão conforme o comprimento do contexto aumentou, levando os engenheiros que conduziram os testes no local a exclamarem que “é conservador demais dizer que funciona bem”.

Como configurar e usar o GPT-5.4 no OpenClaw (passo a passo)

Um fluxo de trabalho simples do OpenClaw usando o GPT 5.4:

- Uma configuração típica é mostrada abaixo:

- Usuários enviam mensagens por plataformas como Discord ou Telegram.

- O OpenClaw recebe as mensagens através de seu servidor gateway.

- O gateway encaminha os prompts para o GPT 5.4 via o provedor de API de IA.

- O GPT 5.4 gera uma resposta ou aciona uma ação de ferramenta.

- O OpenClaw envia o resultado final de volta ao usuário.

A seguir estão exemplos pragmáticos, copiáveis/coláveis de configuração e fluxos de trabalho para executar o GPT-5.4 no OpenClaw com segurança e reprodutibilidade. Eles são intencionalmente conservadores: habilite o modelo primeiro em um agente de teste e instrumente tudo para métricas e erros.

Pré-requisitos- OpenClaw atualizado para a release que inclui os mapeamentos do GPT-5.4 (as notas de release referenciadas acima).

- Chave de API válida da OpenAI com acesso ao GPT-5.4 (eu escolho o endpoint do CometAPI com preço mais barato).

1) Seleção de modelo e configuração do resolvedor (Json/ YAML / CLI)

Coloque isto em ~/.openclaw/openclaw.json (ou incorpore ao seu config existente). Ajuste o nome do provedor e a referência do token conforme seu ambiente exigir.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

O OpenClaw usa um resolvedor de modelos para mapear nomes lógicos de modelo (por exemplo, openai/gpt-5.4) para endpoints e configuração de runtime. Adicione ou atualize seu arquivo de resolvedor (exemplo models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Ou defina em tempo de execução via CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Observação: The

context_windowandmax

Notas

agents.defaults.model.primaryescolhe o modelo padrão. Usechannels.modelByChannelpara sobrescritas por canal, assim você pode direcionar canais de alto impacto para o GPT-5.4 e canais menos exigentes para modelos mais baratos. Veja a documentação de seleção de modelo do OpenClaw para a semântica de ordenação.- Consulte a página do modelo do CometAPI para nomes específicos. Se desejar usar a OpenAI, substitua a URL e a chave de API pelas da OpenAI.

- As chaves

context_windowemax_output_tokensrefletem as mudanças de compatibilidade futura no resolvedor do OpenClaw para que o agente não tente usar limites Codex obsoletos.

2) Como habilitar e testar a “troca a quente de memória”

O subsistema de memória do OpenClaw é baseado em arquivos (arquivos Markdown) além de indexadores/plugins de busca, para que você possa trocar com segurança plugins de backend (por exemplo, vetor SQLite, Milvus ou serviços externos de memória) sem perder os arquivos de memória brutos.

Um padrão comum:

- Padronize a localização da memória: use um workspace com git:

~/.openclaw/workspace/ondeMEMORY.mdememory/YYYY-MM-DD.mdsão autoritativos. - Instale e configure um plugin de memória (exemplo: sqlite-vec) e aponte

plugins.slots.memorypara ele no config. - Teste a migração: adicione um novo plugin, execute um job de indexação em sombra, compare os resultados de recuperação, depois troque o alias

plugins.slots.memorypara o novo plugin quando satisfeito.

Exemplo de troca de alias de plugin (pseudo-comandos bash):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Por que isso é “hot-swappable”: os arquivos de memória permanecem a fonte de verdade. Os plugins implementam camadas de indexação e recuperação; trocá-los reindexa, mas não altera os arquivos .md subjacentes. Isso permite trocas de modelo sem deriva catastrófica de identidade — o agente ainda lê as mesmas MEMÓRIAS.

3) Exemplo: fixar um agente individual ao GPT-5.4 (sobrescrita por agente)

Você pode sobrescrever modelos por agente; adicione uma entrada de agente como:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Se a release da comunidade ou sua versão específica do OpenClaw exigir CLI, você também pode definir um modelo por sessão em tempo de execução:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Dica operacional: fixar garante comportamento determinístico para esse agente enquanto você executa testes A/B nos demais.

Se desejar usar a OpenAI, substitua a URL e a chave de API pelas da OpenAI.

4) Usando opções de contexto 1M do Codex (parâmetros de API)

Se sua implantação do OpenClaw acessar endpoints do OpenAI Codex diretamente, passe opções de contexto:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Solicitações que excedem janelas de contexto padrão podem contar com taxas de uso diferentes (a documentação da OpenAI observa contabilização em dobro para solicitações além das janelas padrão no preview do Codex).

Boas práticas: maximizando os pontos fortes do GPT-5.4 no OpenClaw

Custo, latência e mix de modelos

- Estratégia de modelo híbrido: use um modelo menor e mais barato para consultas curtas e processamento em stream; troque a quente para o GPT-5.4 para análises pesadas, sumarização e geração de código que exigem contexto longo. Isso reduz o custo total de tokens preservando a qualidade. (Implemente via gatilhos na configuração de memória acima.)

- Compactação de tokens e recuperação aumentada: use pipelines de recuperação aumentada para limitar os tokens enviados ao modelo — armazene documentos longos em um DB vetorial, recupere segmentos relevantes e inclua apenas os trechos mais relevantes mais um plano compacto. A busca por ferramentas do GPT-5.4 ajuda aqui ao localizar ferramentas ou documentos úteis automaticamente.

- Aquecimento e cold start: após uma troca de modelo, aqueça o modelo com uma execução curta de priming de contexto para evitar picos de latência na primeira requisição. Precompile quaisquer templates de prompt e reidrate canais de memória críticos. A estratégia de rolling do OpenClaw (veja o config) suporta pré-aquecimento.

Confiabilidade e segurança

- Fallback gracioso: implemente timeouts e planos de fallback (por exemplo, degradar para uma resposta em cache de uma sessão anterior) para lidar com limites de taxa de API ou erros de cota.

- Camadas de segurança: mantenha filtros de política e uma etapa de verificação quando as saídas afetarem decisões. O GPT-5.4 reduz alucinações estatisticamente, mas a verificação ainda é importante em tarefas de alto impacto.

Avaliação e monitoramento

- Reproduza seus benchmarks: execute testes lado a lado para suas cargas de trabalho (completação de código, refatoração multi-arquivo, análise de planilhas) usando um critério padrão. Relatórios públicos indicam pontos fortes em planilhas e tarefas de produtividade — valide com seus dados.

- Telemetria: monitore consumo de tokens, latência do modelo, frequência de trocas de memória e qualidade das respostas (avaliações humanas/testes automatizados). Use a telemetria para refinar os limiares de troca.

Exemplo : agente de revisão de código que faz hot-swap

Objetivo: Executar um resumo rotineiro de lint + testes unitários no push (modelo barato) e escalar para o GPT-5.4 para sugestões de refatoração multi-arquivo quando os testes falharem ou os diffs excederem 10 arquivos.

Fluxo (alto nível):

- O gatilho de pre-commit executa

local/fast-small-coderpara gerar o resumo de lint. - Se

test_failures > 0oudiff_files > 10, acionehot_swapparaopenai/gpt-5.4. Promovalongterm_vectorcontendo o histórico do repositório. - Execute o prompt do GPT-5.4 que contém todas as stack traces com falha + arquivos de código relevantes trazidos para o contexto. Gere o patch de refatoração e as mudanças de testes unitários.

- O revisor humano avalia a saída; o feedback atualiza a memória.

Esqueleto de prompt (enviado ao GPT-5.4 após recuperação e compactação):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Este caso de uso destaca por que contexto grande + troca a quente de memória é valioso: você pode trazer toda a trace de falha e múltiplos arquivos para o modelo de uma só vez. Implemente gatilhos de troca de forma conservadora para controlar custos.

Por fim: quem deve adotar o GPT-5.4 no OpenClaw (e quando)

- Adote agora se seus agentes executam tarefas de código/ferramentas em múltiplas etapas, automação pesada de planilhas ou edição complexa de documentos onde ciclos iterativos de escrever-executar-inspecionar dominam o tempo do desenvolvedor. Os ganhos de produtividade e confiabilidade são mais visíveis aqui.

- Adote com cuidado se você opera canais de chat sensíveis a custo e de alto volume onde raciocínio simples é suficiente; use roteamento para preservar a eficiência de custo.

- Não presuma dominância de um único modelo: faça benchmark com seus dados. O GPT-5.4 é um forte concorrente para cargas de trabalho de agentes, mas a escolha do modelo deve ser guiada por evidências.

Desenvolvedores podem acessar o GPT-5.4 via CometAPI agora. Para começar, explore as capacidades do modelo no Playground e consulte o guia de integração do Openclaw para instruções detalhadas. Antes de acessar, certifique-se de que fez login no CometAPI e obteve a chave de API. O CometAPI oferece um preço muito inferior ao oficial para ajudar na sua integração.

Pronto para começar?→ Sign up fo openclaw today !

Se quiser saber mais dicas, guias e notícias sobre IA, siga-nos no VK, no X e no Discord!