Опыт разработчиков с видеосодержанием в ChatGPT часто упирается в стену: прямые ссылки на YouTube не работают, а загрузка MP4 возвращает «галлюцинирующие» резюме, которые упускают визуальные нюансы. Это не баг — это архитектурное ограничение. ChatGPT не «стримит» видео; он обрабатывает последовательности извлечённых кадров и текст транскрипта. Так что вы попробовали загрузить MP4, и это сработало… отчасти. В резюме упомянули аудиотранскрипт, но полностью пропустили визуальную шутку в третьей сцене, которая объясняет весь смысл ролика.

ChatGPT умеет анализировать видео — но не «смотреть» их на самом деле

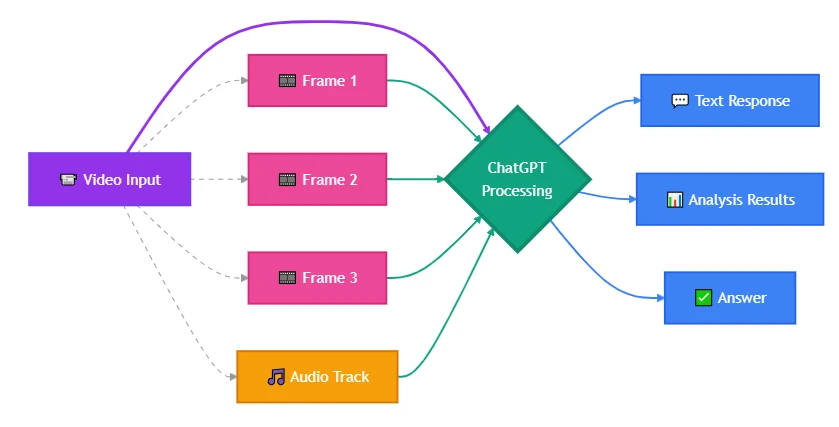

Вот что происходит на самом деле: ChatGPT не «смотрит» видео так, как это делаете вы. Он не нажимает «воспроизвести», не стримит контент и не наблюдает движение во времени. Он разбивает видео на компоненты, с которыми уже умеет работать, — статичные изображения и текстовые транскрипты — и рассуждает о них по отдельности. Модель видит ваше видео как фотоальбом с озвучкой, а не как непрерывный опыт. Поэтому она уловила сказанное объяснение, но упустила визуальный панчлайн: кадр с шуткой, вероятно, не попал в выборку.

Когда спрашивают «может ли ChatGPT смотреть видео», обычно имеют в виду один из двух вопросов: может ли он стримить визуальный контент как человеческий наблюдатель, или может ли извлекать и анализировать смысл из видеоданных — сцены, диалоги, таймкоды, действия на экране? Функциональный ответ — да на второй вопрос, с ограничениями, которые полностью ломают некоторые кейсы. Современные варианты ChatGPT обрабатывают видео, рассматривая его как выборку кадров в сочетании с аудиотранскрипцией — либо через автоматическое извлечение в веб‑интерфейсе, либо принимая предоставленные пользователем кадры через API. Это работает для суммаризации, описания сцен и извлечения текста. Это не работает для отслеживания движения, анализа, зависящего от тайминга, или всего, что требует от модели «увидеть», что происходит между кадрами.

Большинство гайдов ограничиваются подтверждением, что такая возможность существует, не объясняя, почему именно ваша реализация не сработала — и какой альтернативный метод ввода подошёл бы.

ChatGPT и работа с видео: что модель реально «видит»

ChatGPT не загружает MP4 и не «прокручивает» его кадр за кадром. У него есть возможность «видения» — анализ статичных изображений — и аудиотранскрипция через интеграцию Whisper. Когда вы отправляете видео через веб‑интерфейс или мобильные приложения ChatGPT, система извлекает ключевые кадры, отдельно транскрибирует аудио и подаёт оба потока в модель как независимые входы. Затем модель описывает то, что она «увидела» в этих кадрах, и то, что «услышала» в транскрипте.

С вашей точки зрения это выглядит как понимание видео. С точки зрения модели — это анализ изображений плюс обработка текста. Эта архитектурная разница и определяет, какие кейсы работают, а какие нет.

Если ваше видео опирается на движение, тонкие покадровые изменения или точный тайминг — например, на определение момента, когда объект появляется в кадре, или отслеживание анимации UI‑элемента — подход на основе ключевых кадров это упустит. ChatGPT не поймает двухсекундную визуальную подсказку, которая выпадет между выбранными кадрами. Он также не будет отслеживать объекты во времени, если вы явно не структурируете ввод, показывая прогрессию.

Текущие возможности видеоанализа в ChatGPT (на начало 2026 года):

- Анализ видео на основе изображений: принимает видеофайлы или извлечённые кадры; интерпретирует визуальный контент из выборки кадров

- Аудиотранскрипция: преобразует речь в текст с помощью Whisper; затем модель может суммировать или отвечать на вопросы по транскрипту

- Описание сцен: распознаёт объекты, действия, окружение и текст, видимый на предоставленных кадрах

- Запросы с таймштампами: может ссылаться на конкретные моменты, если вы укажете таймкоды кадров или вручную сегментируете видео

- Извлечение текста: считывает наэкранные субтитры, подписи UI или документы, видимые в кадрах

Конкретная частота выборки кадров и поведение автоматического выбора ключевых кадров в веб‑интерфейсе ChatGPT — публично не документированы по состоянию на дату отсечения знаний

Чего нет:

- Потокового ввода видео в реальном времени через API

- Идеально точного покадрового отслеживания движения или «сохранения» объектов во времени

- Нативной поддержки видео‑кодеков — вся обработка происходит на извлечённых кадрах и аудио

- Автоматического обнаружения смены сцен без явного запроса пользователя

Возможности по видео ограничены контекстом и размером файла, а не длительностью. Хотя 5–10 минут — практическая эвристика, фактические лимиты динамически зависят от визуальной плотности.

Если вашему кейсу требуются такие возможности, вы либо предварительно обрабатываете видео сами, извлекая нужные кадры, либо переходите на модель с нативной поддержкой видео. Следующий раздел показывает, какой способ ввода выбрать для конкретного сценария.

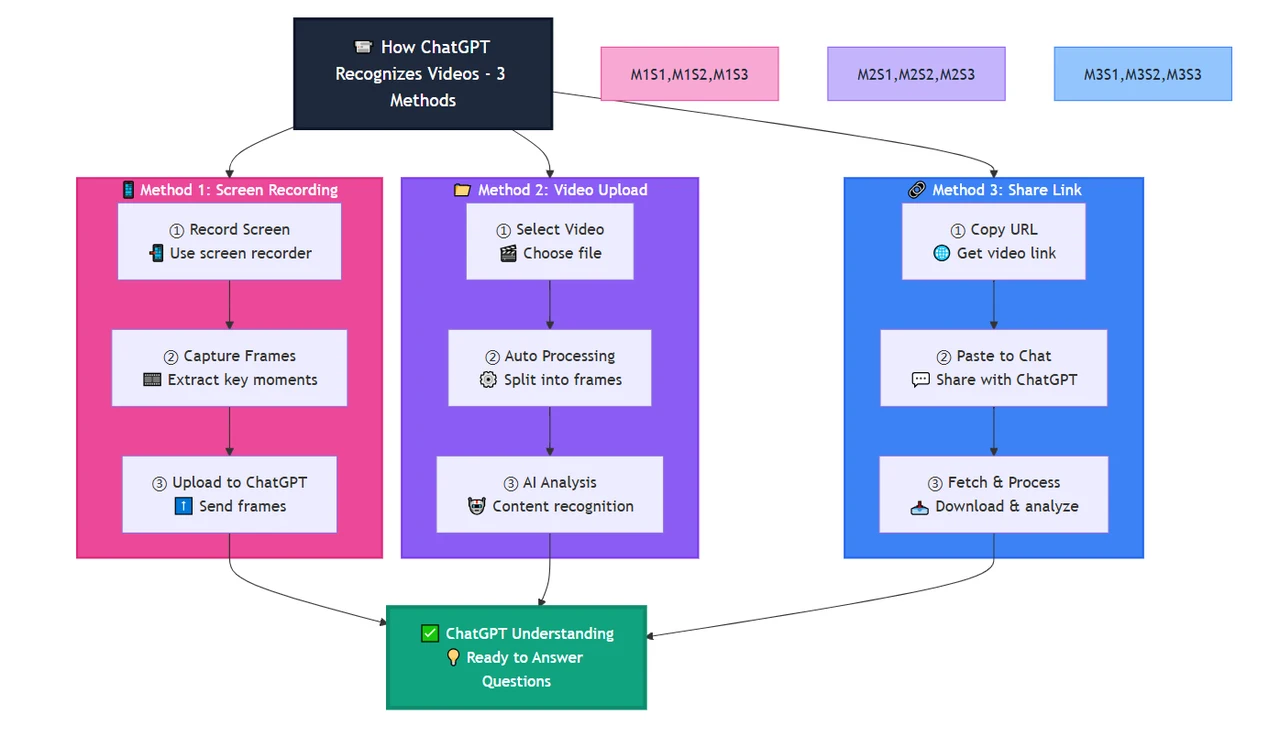

Как ChatGPT «распознаёт» видео: три практических метода

Единственного способа отправить видео в ChatGPT нет. Выбранный метод определяет, что модель сможет проанализировать, а что она упустит. Большинство провалов реализации — из‑за выбора удобного метода вместо правильного.

Метод 1: Ручное извлечение кадров + загрузка изображений

Извлеките кадры самостоятельно с помощью ffmpeg или аналогичных инструментов, затем загрузите именно эти кадры как изображения. Так вы полностью контролируете, что анализирует ChatGPT.

Пример рабочего процесса (bash):

# Извлечь один кадр каждые 5 секунд из видео

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Или извлекать кадры только при смене сцены

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Этот подход позволяет:

- Сфокусировать анализ на конкретных моментах (интро, ключевое действие, концовка), не тратя контекст на нерелевантные отрезки

- Захватывать движение, отправляя последовательные кадры с выбранной вами частотой

- Обходить ограничения размера файлов — изображения меньше полноценных видео

- Сохранять качество кадров, которое может ухудшиться при автоматической компрессии

Компромисс:

Вам придётся заняться препроцессингом. Для сотен видео на масштабе требуется автоматизация. Для разового глубокого анализа или отладки конкретных сцен это самый надёжный метод.

Когда использовать:

- Нужен покадровый анализ конкретных моментов

- Критически важная визуальная информация кратковременна или попадает между типичными интервалами выборки

- Вы сравниваете визуальные изменения в последовательности (смена состояний UI, кадры анимации)

- Вы хотите проверить, что именно «видела» модель, просмотрев загруженные кадры

Метод 2: Прямая загрузка файла через интерфейс ChatGPT

Веб‑ и мобильные приложения ChatGPT принимают видео напрямую в чате. Перетащите MP4 или MOV в поле ввода — система сама извлечёт кадры и сделает транскрипцию.

Что происходит внутри:

- Сервис выбирает кадры через интервалы (точная частота не документирована; по наблюдениям — 1–2 кадра в секунду)

- Аудио транскрибируется через Whisper или аналогичный сервис

- Оба выхода передаются модели как отдельные части контекста

- Модель генерирует ответы на основе видимых кадров и услышанного транскрипта

Этот метод подходит для:

- Высокоуровневых резюме видео, где не нужна покадровая точность

- Идентификации ключевых объектов, людей или окружения, которые держатся в сцене достаточно долго

- Извлечения речи или текста на экране, который появляется в нескольких кадрах

- Быстрого разведочного анализа без препроцессинга

Этот метод не подходит для:

- Покадрового анализа — вы не контролируете, какие кадры будут отобраны

- Длинного контента, превышающего комфортный объём контекста модели; требуется логическая сегментация. Без стратегического разбиения или препроцессинга качество может деградировать или обрываться по мере ускоренного расхода токенов при высокой визуальной плотности

- Обнаружения движения, переходов или задач, зависящих от тайминга и сравнения последовательных кадров

- Сценариев, где критическая визуальная информация появляется кратко между выбранными кадрами

Если вам нужен контроль над тем, какие моменты анализируются, используйте Метод 1.

Метод 3: Ссылка на YouTube + получение транскрипта

Некоторые плагины для ChatGPT и сторонние инструменты заявляют, что «анализируют видео с YouTube». На деле они получают публичные метаданные и транскрипт (если доступен), а затем передают этот текст в ChatGPT.

Работает, когда:

- У видео есть авто‑ или пользовательские субтитры

- Ваш анализ требует только речевого контента, без визуальной части

- Видео публично доступно (не приватное, не по скрытой ссылке и не с региональными ограничениями)

- Вы суммируете лекции, подкасты или интервью, где смысл несёт в основном звук

Не работает, когда:

- Нужно анализировать визуальный контент (демонстрации на экране, диаграммы, выражения лиц)

- У видео нет транскрипта или субтитров

- Критическая информация показана визуально и не упомянута в речи

- Вы работаете с приватными роликами или контентом за аутентификацией

Типичная ошибка: разработчики ожидают полного понимания видео (визуал + аудио), но получают только текстовую выжимку транскрипта. Для анализа речевого контента это нормально. Для обзора продуктовых демо, анализа визуального дизайна или любых задач, где важнее «что видно», а не «что сказано», это бесполезно.

Паттерн: Метод 2 — для быстрых резюме, где точность не критична. Метод 1 — для контролируемого анализа, когда нужны конкретные кадры. Метод 3 — для аудио‑ориентированного контента, где визуальная информация вторична или отсутствует. Выбирайте, исходя из того, где живёт критический сигнал вашего кейса: в движении, в конкретных кадрах или исключительно в диалоге.

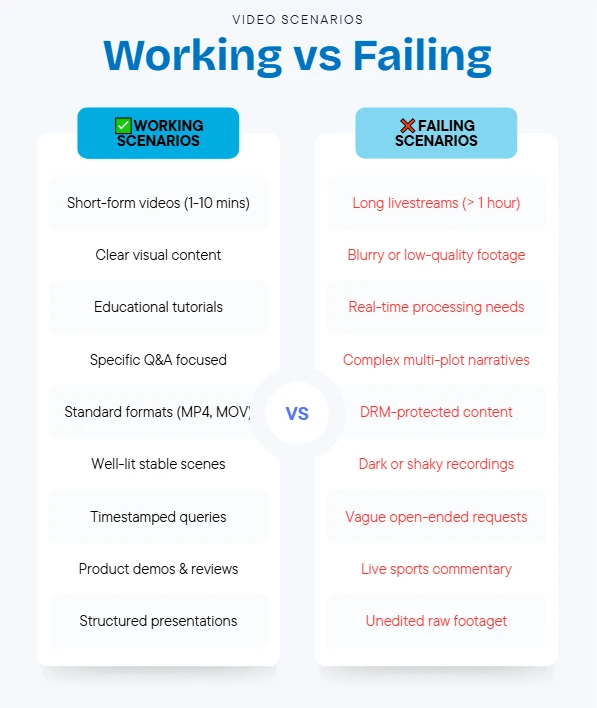

Сценарии применения видеоанализа в ChatGPT: что реально работает в продакшене

Знание того, что ChatGPT может обработать компоненты видео, ещё не отвечает, подходит ли он для вашей задачи. Ниже — сценарии, где анализ на основе кадров успешен, и где архитектурные ограничения ломают кейс.

Сценарий 1: Суммаризация образовательного контента

Use case: У вас 10‑минутный туториал, нужен структурированный конспект ключевых шагов, упомянутых инструментов и показанных визуальных примеров.

Why it works: Обучающие видео обычно имеют чёткие границы сцен, устойчивый наэкранный текст и озвучку, согласованную с визуалом. Спикер описывает то, что показывает, пока это видно. ChatGPT может транскрибировать объяснение, распознать инструменты или диаграммы на выбранных кадрах и объединить оба источника в структурированный результат.

Implementation approach: Загрузите видео через интерфейс ChatGPT или извлеките 8–12 ключевых кадров на переходах между темами. Промпт: «Перечисли основные шаги из этого видео, ссылаясь и на озвучку, и на видимый на экране текст, диаграммы или названия инструментов».

Where it breaks: Видео, опирающиеся на непрерывное движение — например, кодинг‑скринкаст, где инструктор быстро печатает по множеству файлов, — будут иметь пропуски между кадрами. Потребуется более высокая частота выборки кадров или фокус только на аудиотранскрипт.

Practical tip: Для лекций и туториалов комбинируйте автоматическую загрузку (ради транскрипта) с вручную извлечёнными кадрами 3–5 самых важных визуальных моментов. Так вы получите и полное покрытие речи, и качественные изображения ключевых концепций.

Сценарий 2: Анализ продуктового демо

Use case: Вы изучаете демо конкурента и хотите извлечь UI‑элементы, названия фич, пользовательские сценарии и ценовые детали, показанные на экране.

Why it works: В продуктовых демо каждый экран обычно держится достаточно долго, чтобы выборка охватила статичный UI. Текстовые оверлеи, подписи кнопок, структуры меню и ценовые таблицы видны в нескольких кадрах. Возможности «видения» ChatGPT позволяют прочитать и описать эти элементы, даже если они не упомянуты в речи.

Implementation approach: Извлеките кадры на сменах сцен (вступительный слайд, демо фичи 1, демо фичи 2, прайсинг, CTA). Загрузите эти кадры и попросите: «Для каждого кадра перечисли все видимые UI‑элементы, подписи кнопок, названия функций и любые показанные сведения о продукте и ценах».

Where it breaks: Демо с быстрыми переходами, ховер‑состояниями, которые кратко показывают информацию, или интерактивными элементами, видимыми 1–2 секунды, не будут захвачены выборкой. Если конкурент быстро «мигнёт» таблицей сравнения, вы это упустите, если именно этот момент не попал в кадр.

Practical tip: Сначала вручную пролистайте видео и отметьте таймкоды важных «раскрытий». Извлекайте кадры именно в эти моменты, а не полагайтесь на равномерные интервалы.

Сценарий 3: Транскрипция встречи или интервью с визуальным контекстом

Use case: Вы записали созвон с клиентом и хотите и транскрипт, и пометки о том, когда появлялись конкретные документы, слайды или шеринги экрана.

Why it works: Аудиотранскрипция покрывает речь. Когда участники шарят экран или показывают документ, это попадает в выбранные кадры. ChatGPT может аннотировать: «примерно в [таймкод] на экране был виден документ с договором» — рядом с транскриптом, что полезно для протоколов со ссылками на визуальные материалы.

Implementation approach: Загрузите видео и попросите: «Транскрибируй эту встречу и отметь моменты, когда на экране были видны документы, презентационные слайды, шеринг экрана или другие визуальные материалы. Для каждого опиши, что именно было показано».

Where it breaks: Короткие шеринги (менее 5–10 секунд) могут выпасть между выбранными кадрами. Текст, слишком мелкий для чтения на сжатых кадрах, не будет извлекаем. Для юридических/комплаенс‑кейсов с требованием дословной точности показанных документов убедитесь в качестве кадров и покрытии выборкой.

Practical tip: Для важных встреч пишите в более высоком разрешении и извлекайте кадры вручную в моменты, когда кто‑то говорит «давайте покажу документ» — это сигнал к появлению визуальной ссылки.

Сценарий 4: Модерация контента или комплаенс‑проверка

Use case: Нужно проверить пользовательские видео на запрещённый контент — конкретные логотипы, текстовые паттерны или визуальные элементы, нарушающие политику платформы.

Why it works: ChatGPT может сканировать кадры на наличие видимого текста, узнаваемых объектов или описанных сцен. Если вы ищете «появляется ли логотип конкурента», анализ кадров выявит логотипы, удерживающиеся на экране более секунды‑двух.

Implementation approach: Извлекайте кадры через равные интервалы (каждые 3–5 секунд), загружайте их и просите: «Проверьте эти кадры и укажите те, на которых есть [конкретный логотип, бренд, запрещённый символ и т. п.]. Для каждого совпадения опишите, где в кадре он находится».

Where it breaks: Нарушения по аудио (правообладательская музыка, запрещённая речь) требуют отдельного анализа звука. Нарушения по движению (запрещённые жесты, действия, растянутые во времени) не будут пойманы анализом статичных кадров. Краткое «вспышечное» запрещённое содержимое может не попасть в выборку.

Practical tip: Комбинируйте визуальный скрининг ChatGPT с профильными сервисами аудиофингерпринтинга и более высокой частотой выборки кадров для категорий высокого риска. Используйте ChatGPT как первичный фильтр, а не единственный слой модерации.

Общий паттерн успешных сценариев: значимая информация присутствует в дискретных, стабильных кадрах и коррелирует со звуком или текстом. Провалы случаются, когда критический сигнал живёт в движении, тайминге, переходах или появляется слишком кратко, чтобы надёжно попасть в выборку.

Возможности видео в Gemini и Claude по сравнению с ChatGPT

Если архитектура с выборкой кадров в ChatGPT не подходит вашему кейсу, стоит оценить альтернативы. Gemini и Claude предлагают разные видеовозможности — и именно эти различия определяют, какая модель подходит вашей реализации.

Нативная обработка видео в Gemini

Модели Gemini поддерживают нативный ввод видео на уровне API. Вы передаёте видеофайл напрямую, без предварительного разбиения на кадры. Модель обрабатывает видео как непрерывный поток, что позволяет отслеживать движение, обнаруживать смену сцен и рассуждать о временных зависимостях — то, чего не даёт подход ChatGPT на основе кадров.

Пример, где выигрывает Gemini:

Нужно зафиксировать, когда конкретный объект входит и выходит из кадра в 30‑секундном ролике, или отследить, как человек перемещается по сцене. Gemini может следить за объектами между кадрами и рассуждать о движении. ChatGPT увидит объект только на попавших в выборку кадрах — легко пропустив вход или выход.

Компромиссы:

- Нативный API Gemini экономичнее по стоимости, чем подход OpenAI с выборкой кадров. Благодаря кешированию контекста Gemini лучше масштабируется для длинного анализа

- При обработке длинных видео растёт латентность — модели нужно проглотить весь файл перед ответом

- Не все варианты Gemini поддерживают ввод видео; требуется поздние версии Gemini

- Есть ограничения по длительности, но они щедрее контекстных лимитов ChatGPT

Когда выбирать Gemini вместо ChatGPT:

- Ваш кейс требует отслеживания движения, обнаружения границ сцен или понимания временных отношений

- Критическая информация быстро появляется и исчезает между кадрами

- Вы анализируете видео, где важна последовательность событий (спорт, наблюдение, анализ анимации)

- Вы хотите избежать ручного извлечения кадров

Текущие ограничения видео в Claude

По состоянию на начало 2026 года модели Claude не поддерживают прямой ввод видео через API. Можно загружать изображения (включая вручную извлечённые кадры), но нативной видеоподдержки, сопоставимой с Gemini, нет.

Что умеет Claude:

- Анализировать последовательности загруженных кадров, аналогично ручной выборке для ChatGPT (Метод 2)

- Давать детальные описания визуального содержимого каждого кадра

- Рассуждать о предполагаемом движении или изменениях между кадрами, если явно сформулировать задачу

- Обрабатывать длинные последовательности изображений благодаря расширенному окну контекста (до 1M токенов в Claude Opus 4.7)

Чего не умеет Claude:

- Принимать видеофайлы напрямую через какой‑либо интерфейс

- Автоматически отслеживать движение или объекты между кадрами без явной покадровой постановки задачи

- Транскрибировать аудио — требуется внешний препроцессинг через Whisper или аналог, а затем передача транскрипта в Claude

Когда всё же выбрать Claude:

- Ваш процесс уже включает извлечение кадров как этап препроцессинга

- Вы анализируете длинные видео с большим числом кадров и нуждаетесь в крупном окне контекста

- Вы сравниваете качество визуального анализа и находите описания Claude более точными для вашей области (например, медизображения, технические схемы)

- Нужно комбинировать анализ кадров с большими объёмами дополнительного контекста

Таблица сравнения возможностей

| Возможность | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Прямая загрузка видеофайла | ✓ (веб/мобильный интерфейс) | ✓ (API + веб‑интерфейс) | ✗ |

| Нативное отслеживание движения | ✗ | ✓ | ✗ |

| Аудиотранскрипция | ✓ (интеграция Whisper) | ✓ (интегрировано) | ✗ (нужен внешний инструмент) |

| Анализ на основе кадров | ✓ | ✓ (также непрерывная обработка) | ✓ (только при ручном извлечении) |

| Обнаружение смены сцен | ✗ (только вручную) | ✓ (автоматически) | ✗ |

| Типовая длительность видео | ~5–10 мин (ограничения контекста) | ~1 час (зависит от разрешения) | Н/Д (число кадров ограничено контекстом) |

| Лучший кейс | Быстрые резюме, покадровый анализ с некоторым контролем | Отслеживание движения, временные зависимости, поток | Глубокие покадровые описания при больших контекстах |

| Поддержка видео через API | ✗ (только изображения) | ✓ | ✗ |

Рамка выбора:

- Выбирайте ChatGPT, когда: нужны быстрые резюме, критическая информация держится на экране несколько кадров, вы работаете с короткими клипами (до 10 минут) и не требуется отслеживание движения. Подходит для образовательного контента, статичных продуктовых демо, транскрипции встреч.

- Выбирайте Gemini, когда: кейс требует отслеживать движение, обнаруживать смену сцен или рассуждать о том, как элементы движутся/меняются во времени. Критично для наблюдения, спорта, анализа анимации — там, где важны события «между кадрами».

- Выбирайте Claude, когда: вы уже извлекаете кадры в конвейере, нужно анализировать много кадров с обширным контекстом или вы считаете описания Claude более точными в вашей визуальной доменной области. Потребует больше препроцессинга, но даёт самое большое окно контекста.

Для разработчиков, работающих с несколькими моделями, CometAPI предоставляет унифицированный интерфейс для тестирования качества видеопроцессинга среди GPT, Gemini и Claude без переписывания интеграции — удобно, когда вы сравниваете качество перед выбором провайдера.

Настоящий ответ на «может ли ChatGPT смотреть видео» не бинарный. Это «да, конвертируя видео в форматы, которые он уже умеет обрабатывать — с ограничениями, которые ломают часть кейсов». Большинство провалов — из‑за архитектурного несовпадения, а не нехватки возможностей. Модель работает ровно так, как спроектирована; просто разработчики ожидали другую архитектуру.

Если вы строите фичи видеоанализа на масштабе, тестируйте пайплайн на краевых кейсах: загрузите одно и то же видео напрямую, через вручную извлечённые кадры и только транскрипт. Сравните результаты. Метод, который захватывает критический сигнал вашего кейса — а не тот, что быстрее внедряется, — выдержит продакшен‑нагрузку.

Перед тем как выбрать ChatGPT для видео:

- Определите, где живёт критическая информация: в стабильных кадрах, движении или аудио

- Проверьте покрытие выборки, извлекая кадры вручную с ожидаемым интервалом

- Убедитесь, что наэкранный текст читаем при вашем разрешении после компрессии

- Подтвердите, что длительность вписывается в практические ограничения по контексту для вашего тарифа

- Держите план B для содержимого, которое появляется кратко или между выбранными кадрами

Для разработчиков, оценивающих несколько AI‑провайдеров под видеонагрузки, CometAPI предлагает единый «плейграунд» для тестирования ChatGPT, Gemini и Claude на одних и тех же видео — чтобы сравнить качество, задержки и стоимость до создания провайдер‑специфичных интеграций.

FAQ — Гид по AI‑анализу видео

Короткие ответы на частые вопросы о видеоанализе в ИИ.

Может ли ChatGPT анализировать видео?

Да, ChatGPT (GPT-4o и новее) анализирует видео, выбирая кадры (~1 в секунду) и транскрибируя аудио. Он хорошо справляется с резюме встреч, извлечением текста со слайдов и идентификацией объектов. Однако ему сложно с отслеживанием движения, видео дольше 10 минут и реальным временем.

Как загрузить видео в ChatGPT?

Прямая загрузка URL (рекомендуется): Загрузите по публичной ссылке для быстрого анализа. Лучше для роликов до 10 минут.

Ручное извлечение кадров: Извлекайте конкретные кадры для точного контроля. Лучше, когда надо анализировать определённые моменты или снижать расходы на токены.

Какая максимальная длительность видео, которую выдержит ChatGPT?

Надёжно — до 5–10 минут. Дальше придётся сегментировать ролик или перейти на Gemini 2.5 Pro, который нативно поддерживает видео до 60 минут.

Каковы ограничения видеоанализа ChatGPT?

- Не отслеживает непрерывное движение (спорт, танцы)

- Нечёткие таймкоды (точность ±1 секунда)

- Пропускает контент, который виден менее 1 секунды

- Практический предел — 10 минут

- Нет поддержки реального времени

- Сложности с низким качеством или тёмными видео

- Слабое временное причинно‑следственное рассуждение *

Выбрать ChatGPT или Gemini для анализа видео?

Используйте ChatGPT, если:

- Видео до 10 минут

- Нужны сильные текстовые рассуждения после анализа

- Нужен покадровый анализ (слайды, скриншоты)

Используйте Gemini, если:

- Видео 10–60 минут

- Нужно отслеживание движения и анализа перемещений

- Нужны временные рассуждения

- Спорт, танцы или наблюдение *

Может ли Claude анализировать видео?

Нет, Claude не поддерживает прямой ввод видео. Но вы можете извлекать кадры и анализировать их в Claude, который предлагает мощные текстовые рассуждения и большое окно контекста для длинных анализов.

Сколько стоит анализ видео?

Стоимость зависит от модели и длительности:

- ChatGPT 4o: ~$0.05 за минуту

- Gemini 2.5 Pro: ~$0.04 за минуту

CometAPI предлагает бонусные кредиты для новых пользователей.