TL;DR: В недавнем релизе OpenClaw добавлена полноценная, перспективно-совместимая поддержка GPT-5.4 от OpenAI и представлена архитектура «горячо заменяемой памяти», позволяющая агентам OpenClaw на лету менять активную модель и хранилище памяти с минимальными перебоями. Это открывает большие контекстные процессы (расширенные контекстные окна GPT-5.4), динамическую специализацию модели и оптимизацию стоимости/задержек для продакшн-агентов. Обновление доступно в релизах и документации OpenClaw; ниже приведены практические настройки, фрагменты кода, контекст бенчмарков и рекомендуемые лучшие практики.

Что именно вышло в обновлении OpenClaw (кратко)

9 марта 2026 года открытый фреймворк агентов OpenClaw (смежный с OpenAI) выпустил крупный релиз ядра (2026.3.7), добавив полноценную поддержку GPT-5.4 и новый механизм «горячо заменяемой памяти» в своём контекстном движке. Этот релиз превращает широко используемый экспериментальный фреймворк агентов в то, что мейнтейнеры называют «операционной системой агентов» — цель состоит в том, чтобы сделать промышленные рабочие процессы агентов и переключение моделей бесшовными для разработчиков и команд.

3 практических пункта, важных для разработчиков агентов:

- Полноценная поддержка GPT-5.4 — псевдонимы моделей и сопоставления провайдеров, позволяющие агентам выбирать GPT-5.4 в качестве основной модели выполнения (включая переопределения по каналам и закрепление модели на уровне агента).

- Контекстный движок и распределённая привязка каналов — улучшения в том, как OpenClaw собирает длинные контексты из памяти, выводов инструментов и истории каналов, чтобы модели большой ёмкости получали хорошо структурированные входы.

- Архитектура «горячо заменяемой памяти» — более ясные поверхности плагинов памяти и рабочие процессы, чтобы вы могли заменять бэкенды памяти или обновлять агентов без потери «идентичности» или порчи персистентного состояния (сама память остаётся единственным источником истины). Дизайн памяти OpenClaw (простые Markdown-файлы, индексированный поиск, плагинизированный ретривал) и позволяет безопасную горячую замену.

GPT-5.4 — что это и в чём прорыв бенчмарков

GPT-5.4 — последний релиз frontier-модели OpenAI, сфокусированный на профессиональной продуктивности (электронные таблицы, редактирование документов и презентаций, многошаговое рассуждение и управление инструментами). Согласно OpenAI и независимым обзорам, в релизе акцент сделан на:

- Расширенный контекст: GPT-5.4 выводит на новый уровень контекстные окна — экспериментальные 1M токенов и улучшенную работу с длинным контекстом через конечные точки Codex/Codex-совместимые; разработчикам доступны настройки вроде

model_context_windowиmodel_auto_compact_token_limit. Это позволяет держать куда больший объём состояния диалога, документов и кодовой базы в активном контексте. - Более высокая точность в таблицах и рассуждениях — OpenAI заявляет о серьёзном улучшении на задачах моделирования таблиц (средний балл ~87% против ~68% у GPT-5.2 на банковско-аналитическом бенчмарке).

- Улучшения точности и фактичности: ранние обзоры и QA показывают ~33% снижение галлюцинаций и меньше ошибок по сравнению с GPT-5.2, особенно в черновиках документов и работе с таблицами. Также отмечено ~18% снижение склонности к ошибкам на ряде продуктивных задач.

- Интегрированное взаимодействие с компьютером и улучшения по линии Codex — GPT-5.4 унаследовала возможности из ветки Codex, улучшающие генерацию кода, интерактивную отладку и операционное управление инструментами (мышь/клавиатура/скриншоты в некоторых демонстрациях). Это делает её сильнее в цикле write-run-inspect-patch, характерном для агентных петлей.

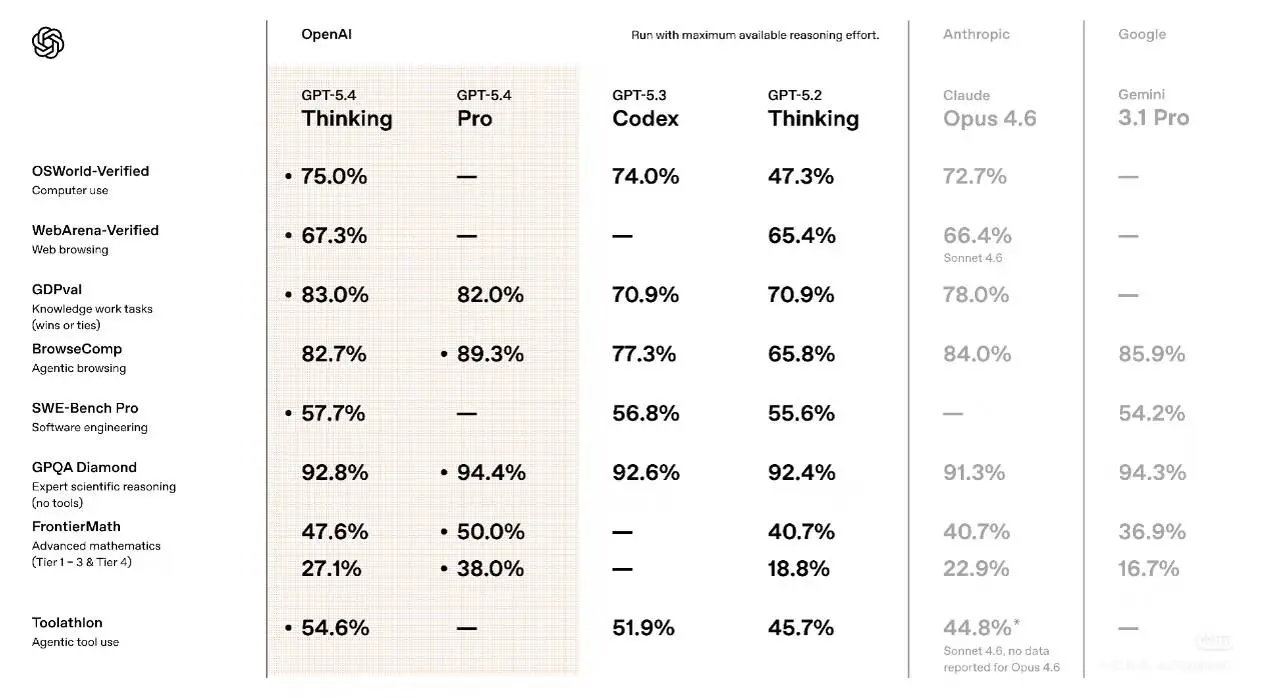

Бенчмарки и сравнение (что означают цифры)

- Моделирование таблиц: внутренний бенчмарк OpenAI по таблицам — ~87.3% средний балл у GPT-5.4 против ~68.4% у GPT-5.2. Это ключевой заголовок, иллюстрирующий прирост в задачах.

- Взаимодействие с компьютером (OSWorld / агентные тесты): независимые испытатели и комьюнити-раны показывают, что GPT-5.4 лучше справляется с агентными задачами, включающими манипуляции с десктопом или симулированным UI, иногда чуть опережая свежие варианты моделей Anthropic на отдельных наборах (разница ощутима для агентов, но не всегда решающая для каждого ворклоада).

Толкование: GPT-5.4 — не «серебряная пуля», побеждающая везде. У неё явные сильные стороны в интегрированном использовании инструментов, паттернах выполнения кода и рассуждениях по таблицам — а именно это часто и делают агенты OpenClaw. Для разработчиков агентов сочетание улучшенной надёжности исполнителя (линия Codex) + компетентного планирования + лучшей работы с длинным контекстом — крайне релевантно.

OpenClaw поддерживает GPT-5.4: что изменилось и зачем это важно

Релиз OpenClaw (см. страницу релизов проекта) обновляет резолверы моделей и рантайм так, чтобы они были перспективно-совместимы с расширенным контекстом и лимитами токенов GPT-5.4, и добавляет возможность «горячо заменяемой памяти», чтобы агенты могли переключать бэкенды памяти или модели на лету. Это сделано тремя конкретными способами: 1) обновление метаданных моделей и резолверов для принятия больших контекстов и лимитов токенов; 2) изменения в рантайме агентов для оркестровки плавной смены модели и прогрева кэша; 3) API памяти, позволяющее множественные каналы памяти и триггеры горячей смены.

Поддержка GPT-5.4 в версии 2026.3.7 плюс дизайн «горячо заменяемой» памяти дают две практичные, взаимодополняющие выгоды:

- Простой путь обновления модели. OpenClaw теперь может представить GPT-5.4 как выбираемый «рантайм» для агентов, позволяя переключаться со старых GPT-5.x или альтернативных вендоров без переработки логики агента. Обновление OpenClaw явно объявляет стабильную интеграцию GPT-5.4 в ядре.

- Горячая замена памяти. Вместо сохранения одного линейного снимка памяти, контекстный движок OpenClaw допускает отсоединение, подмену или миграцию разделов памяти на лету — например, подменить shard векторной БД с высоким recall для отладки или переключиться на вариант памяти, очищенный под GDPR, для внешних аудитов — без остановки агента. Это снижает риск сбоев в продакшене и позволяет подбирать конфигурации памяти под конкретные кейсы (отладка vs приватность vs производительность).

практические прорывы производительности и преимущества

Интеграция OpenClaw концентрируется на трёх практических областях, где GPT-5.4 особенно сильна:

- Точность оркестрации инструментов. Улучшенный поиск инструментов и рассуждения уменьшают «шум» вызовов инструментов (меньше лишних вызовов и повторов). Это означает меньше API-вызовов и более быстрое завершение сложных потоков. Ранние отчёты показывают улучшенную эффективность по токенам и вызовам инструментов относительно старых GPT-5.x.

- Длинный и богатый контекст. Агенты OpenClaw теперь могут держать гораздо большие активные контексты (включая подмешиваемые шарды памяти), что позволяет вести длинные диалоги, работать с проектами из многих файлов и итеративной отладкой без потери состояния.

- Более детерминированный код на выходе. В процессах автогенерации кода (хуки CI, заглушки функций, шаблоны инфраструктуры) GPT-5.4 чаще выдаёт последовательный и запускаемый код, снижая нагрузку на ручную проверку. Независимые тесты показывают заметный рост метрик качества кода относительно прежних GPT-5.

- Непрерывность памяти — «горячая замена» позволяет заменять или дополнять хранилища памяти (локальный кэш, векторная БД, память LLM) без потери состояния агента или контекста, включая A/B-тесты, поэтапные обновления и фейловер.

В тесте OOLONG новая версия OpenClaw совместно с плагином lossless-claw набрала высокий балл 74.8, существенно опередив Claude Code (70.3 балла). Особенно OpenClaw продемонстрировал стабильность и точность по мере роста длины контекста, что побудило инженеров при очном тестировании воскликнуть: «говорить, что он просто хорошо работает, — слишком консервативно».

Как настроить и использовать GPT-5.4 в OpenClaw (пошагово)

Простой рабочий процесс OpenClaw с GPT-5.4:

- Пример типовой конфигурации ниже:

- Пользователи отправляют сообщения через платформы вроде Discord или Telegram.

- OpenClaw получает сообщения через свой шлюз-сервер.

- Шлюз пересылает подсказки в GPT-5.4 через провайдера AI API.

- GPT-5.4 генерирует ответ или инициирует действие инструмента.

- OpenClaw возвращает конечный результат пользователю.

Ниже — прагматичные, готовые к копированию примеры конфигураций и рабочие процессы для безопасного и воспроизводимого запуска GPT-5.4 в OpenClaw. Они намеренно консервативны: сначала включите модель в тестовом агенте и инструментируйте всё на метрики и ошибки.

Предварительные требования

- OpenClaw обновлён до релиза с маппингами GPT-5.4 (см. примечания к релизу выше).

- Действующий ключ OpenAI API с доступом к GPT-5.4 (я выбираю конечную точку CometAPI с более низкой ценой).

1) Выбор модели и настройка резолвера (Json/YAML/CLI)

Поместите это в ~/.openclaw/openclaw.json (или слейте с вашим текущим конфигом). При необходимости скорректируйте имя провайдера и ссылку на токен под вашу среду.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw использует резолвер моделей для сопоставления логических имён моделей (например, openai/gpt-5.4) с конечными точками и конфигурацией рантайма. Добавьте или обновите файл резолвера (пример models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Или задайте на лету через CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Примечание: The

context_windowandmax

Примечания

agents.defaults.model.primaryзадаёт модель по умолчанию. Используйтеchannels.modelByChannelдля переопределений на уровне каналов, чтобы направлять важные каналы на GPT-5.4, а менее требовательные — на более дешёвые модели. См. документацию OpenClaw по порядку выбора моделей.- Пожалуйста, смотрите страницу модели CometAPI для конкретных имён. Если хотите использовать OpenAI, замените URL и ключ API на соответствующие OpenAI.

- Ключи

context_windowиmax_output_tokensотражают перспективно-совместимые изменения резолвера OpenClaw, чтобы агент не пытался использовать устаревшие лимиты Codex.

2) Как включить и протестировать «горячую замену памяти»

Подсистема памяти OpenClaw основана на файлах (Markdown) плюс индексаторы/плагины поиска, поэтому вы можете безопасно менять бэкенды (например, SQLite vector, Milvus или внешние сервисы памяти), не теряя исходные файлы памяти.

Типичный паттерн:

- Стандартизируйте расположение памяти: используйте git-бэкенд воркспейса:

~/.openclaw/workspace/, гдеMEMORY.mdиmemory/YYYY-MM-DD.md— авторитетные источники. - Установите и настройте плагин памяти (пример: sqlite-vec) и укажите его в

plugins.slots.memoryв конфиге. - Протестируйте миграцию: добавьте новый плагин, запустите теневую индексацию, сравните результаты извлечения, затем переключите алиас

plugins.slots.memoryна новый плагин, когда будете довольны.

Пример замены алиаса плагина (псевдокоманды bash):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Почему это «горячо заменяемо»: файлы памяти остаются источником истины. Плагины реализуют уровни индексации и извлечения; их замена приводит к переиндексации, но не меняет исходные .md-файлы. Это позволяет менять модели без катастрофического «сдвига идентичности» — агент по-прежнему читает те же MEMORIES.

3) Пример: закрепить конкретного агента на GPT-5.4 (переопределение на уровне агента)

Вы можете переопределять модели на уровне агента; добавьте запись агента:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Если релиз комьюнити или ваша версия OpenClaw требует CLI, можно также назначить модель на уровне сессии:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Операционный совет: закрепление обеспечивает детерминированное поведение этого агента, пока вы проводите A/B-тесты на других.

Если хотите использовать OpenAI, замените URL и ключ API на соответствующие OpenAI.

4) Использование опций контекста Codex 1M (API-настройки)

Если ваш деплой OpenClaw обращается к конечным точкам OpenAI Codex напрямую, передавайте опции контекста:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Запросы, превышающие стандартные контекстные окна, могут тарифицироваться по иным ставкам (в документации OpenAI отмечается двойной учёт запросов сверх стандартных окон в превью Codex).

Лучшие практики: как максимально использовать сильные стороны GPT-5.4 в OpenClaw

Стоимость, задержки и смесь моделей

- Гибридная стратегия моделей: используйте меньшую и дешёвую модель для коротких запросов и потоковой обработки; горячо переключайтесь на GPT-5.4 для тяжёлого анализа, суммаризации и генерации кода с длинным контекстом. Это снижает общую стоимость токенов при сохранении качества. (Реализуйте через триггеры в конфиге памяти выше.)

- Компактизация токенов и усиление извлечением: используйте конвейеры с retrieval-augment, чтобы ограничивать токены, отправляемые в модель — храните длинные документы в векторной БД, извлекайте релевантные сегменты и включайте только наиболее релевантные фрагменты плюс компактный план. Поиск инструментов в GPT-5.4 поможет автоматически находить полезные инструменты или документы.

- Прогрев и холодный старт: после смены модели прогрейте её коротким прогонном контекстом, чтобы избежать всплесков задержек при первом запросе. Предкомпилируйте шаблоны подсказок и «реидратируйте» критичные каналы памяти. Роллинг-стратегия OpenClaw (см. конфиг) поддерживает предварительный прогрев.

Надёжность и безопасность

- Плавная деградация: реализуйте таймауты и планы на случай отказов (например, деградируйте до кешированного ответа из прошлой сессии) для обработки лимитов и ошибок квот API.

- Слои безопасности: удерживайте фильтры политики и шаг верификации, когда выводы влияют на решения. GPT-5.4 статистически снижает галлюцинации, но верификация всё ещё важна для высокорисковых задач.

Оценка и мониторинг

- Воспроизведите свои бенчмарки: запустите лоб-в-лоб тесты для ваших ворклоадов (дополнение кода, рефакторинг многих файлов, анализ таблиц) по стандартной методике. Публичные отчёты указывают на силу в таблицах и продуктивных задачах — подтвердите на своих данных.

- Телеметрия: мониторьте потребление токенов, задержки модели, частоту переключений памяти и качество ответов (оценки людей/автотесты). Используйте телеметрию для настройки порогов переключений.

Пример: агент code review с горячей заменой

Цель: запускать рутинный линт + сводку юнит-тестов при пуше (дешёвая модель) и эскалировать на GPT-5.4 для предложений по рефакторингу многих файлов, когда тесты падают или диффы превышают 10 файлов.

Высокоуровневый поток:

- Триггер pre-commit запускает

local/fast-small-coderдля генерации сводки линта. - Если

test_failures > 0илиdiff_files > 10, инициируетсяhot_swapнаopenai/gpt-5.4. Продвигается longterm_vector, содержащий историю репозитория. - Запускается подсказка GPT-5.4, включающая полные падающие стек-трейсы + релевантные файлы кода, подтянутые в контекст. Генерируются патч рефакторинга и изменения в тестах.

- Человек-рецензент оценивает вывод; фидбек обновляет память.

Скелет подсказки (отправляется в GPT-5.4 после извлечения и компактизации):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Этот кейс показывает, зачем нужны большой контекст и горячая замена памяти: вы можете одновременно подать в модель полный падающий трейс и множество файлов. Настраивайте триггеры переключения консервативно, чтобы контролировать стоимость.

Наконец: кому и когда стоит внедрять GPT-5.4 в OpenClaw

- Внедряйте сейчас, если ваши агенты выполняют многошаговые задачи с кодом/инструментами, интенсивную автоматизацию таблиц или сложное редактирование документов, где цикл «написать—выполнить—проверить—подправить» доминирует по времени. Прирост продуктивности и надёжности здесь заметнее всего.

- Внедряйте аккуратно, если у вас чувствительные к стоимости, высокообъёмные чаты, где хватает простых рассуждений; используйте роутинг для сохранения эффективности затрат.

- Не предполагайте доминирование одной модели: бенчмаркте на своих данных. GPT-5.4 — сильный претендент для агентных ворклоадов, но выбор модели должен быть основан на фактах.

Разработчики уже могут получить доступ к GPT-5.4 через CometAPI (CometAPI — это единая платформа-агрегатор API больших моделей, таких как GPT API, Nano Banana API и др.). Для начала изучите возможности модели в Playground и обратитесь к руководству по интеграции OpenClaw за подробными инструкциями. Перед доступом убедитесь, что вы вошли в CometAPI и получили ключ API. CometAPI предлагает цену значительно ниже официальной, чтобы помочь вам с интеграцией.

Готовы начать? → Зарегистрируйтесь в OpenClaw сегодня!

Если хотите получать больше советов, гайдов и новостей об ИИ, подписывайтесь на нас в VK, X и Discord!