คำตอบฉับไว: นักพัฒนาควรให้ความสำคัญกับโมเดล AI ใดในปี 2026?

สำหรับงานที่ต้องการการให้เหตุผลแบบอัตโนมัติสูงสุดและฮัลลูซิเนชันให้น้อยที่สุด นักพัฒนาควรเลือก GPT-5.5 (xhigh) ซึ่งเป็นผู้นำตลาดด้วยดัชนีความฉลาดที่ 60 แอปพลิเคชันที่ต้องการปฏิสัมพันธ์แบบเรียลไทม์ควรใช้ Mercury 2 ผู้นำด้านความเร็วในปัจจุบันที่ประมาณ 859 โทเค็นต่อวินาที สำหรับการผลิตขนาดใหญ่ที่งบประมาณเป็นข้อจำกัดหลัก DeepSeek V4 Pro และ Kimi K2.6 มอบความฉลาดใกล้เคียงระดับแนวหน้าในต้นทุนประมาณ 10% ของโมเดลเจ้าของลิขสิทธิ์ระดับเรือธง

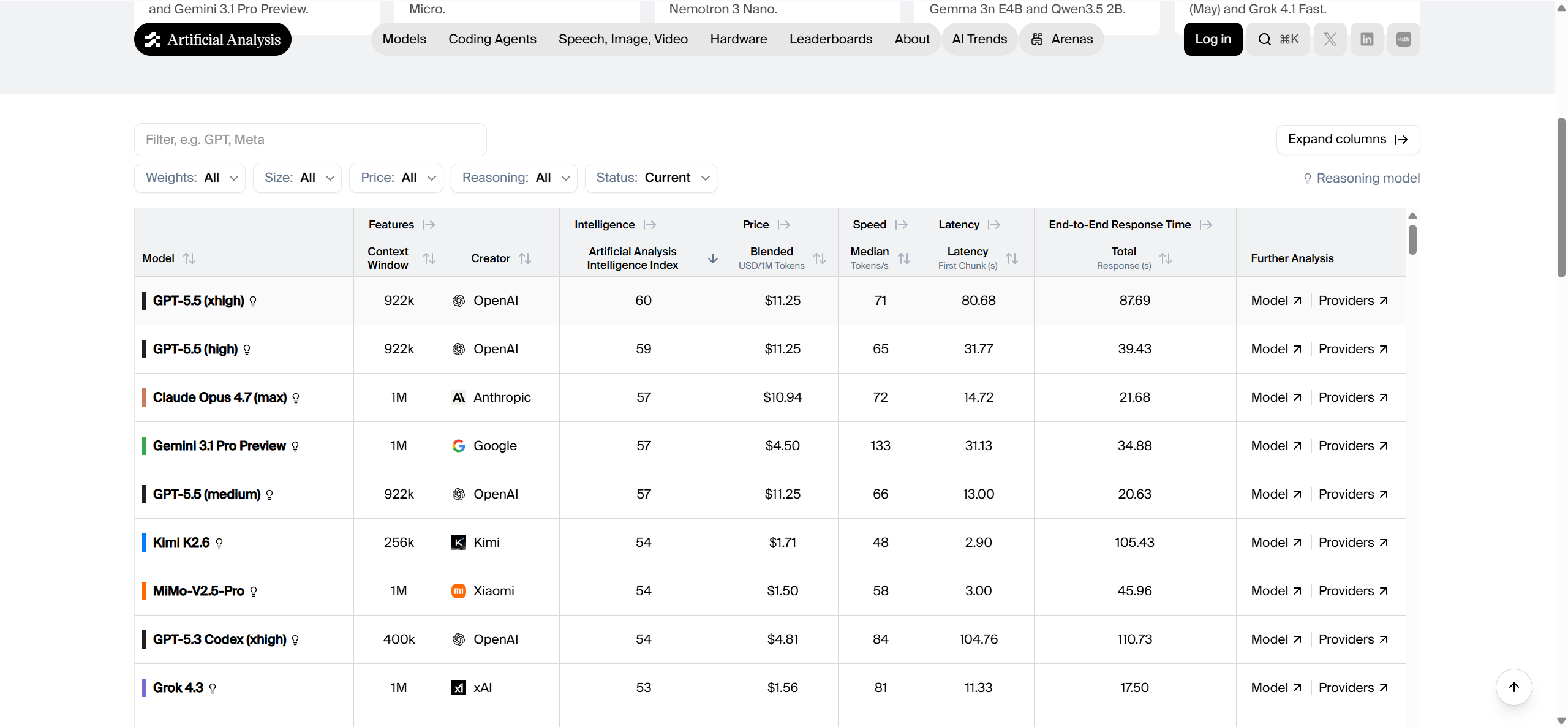

ดัชนีความฉลาด: จัดอันดับโมเดลระดับแนวหน้า

ภูมิทัศน์ AI ในปี 2026 เปลี่ยนจากการไล่ตามจำนวนพารามิเตอร์ไปสู่การเพิ่มประสิทธิภาพความหนาแน่นของ “การคิด” Artificial Analysis Intelligence Index v4.0 ทำหน้าที่เป็นมาตรฐานอุตสาหกรรมในการวัดขีดความสามารถของโมเดลในสิบมิติที่เชี่ยวชาญเฉพาะทาง รวมถึงการเขียนโค้ดระดับมืออาชีพและการอ้างเหตุผลเชิงตรรกะขั้นสุด

| โมเดล | ดัชนีความฉลาด | หน้าต่างบริบท | กรณีใช้งานที่เหมาะที่สุด |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | การวิจัยทางวิทยาศาสตร์และตรรกะ |

| GPT-5.5 (high) | 59 | 922K | การเขียนโค้ดระดับมืออาชีพ |

| Claude Opus 4.7 (max) | 57 | 1M | เอเจนต์อัตโนมัติและการวางแผน |

| Gemini 3.1 Pro | 57 | 1M - 2M | การสังเคราะห์ข้อมูลหลายโมดัล |

| Kimi K2.6 | 54 | 256K | งานเอเจนต์บนเทอร์มินัล |

| MiMo-V2.5-Pro | 54 | 1M | วิศวกรรมซอฟต์แวร์แบบฟูลสแต็ก |

| DeepSeek V4 Pro (Max) | 52 | 1M | เวิร์กโฟลว์การให้เหตุผลที่ปรับขนาดได้ |

| GLM-5.1 | 51 | 200K | งานอัตโนมัติระยะยาว |

วิธีอ่านตารางนี้

ในบรรดา 5 โมเดลอันดับแรก สามโมเดลเป็น GPT-5.5 ได้แก่ GPT-5.5 Medium, Claude Opus 4.7 และ Gemini 3.1 Pro โมเดลเรือธงจากตะวันตกทั้งสามนี้สูสีมาก ขณะที่ Kimi K2 และ mimo-v2.5 pro สองโมเดลจากจีนให้ประสิทธิภาพเทียบเท่ากับโมเดลชั้นนำจากตะวันตกในราคาที่แข่งขันได้อย่างยิ่ง

Artificial Analysis Intelligence Index เป็นเมตริกแบบปรับมาตรฐานที่ได้มาจากการประเมินอิสระ เช่น Terminal-Bench Hard และ IFBench ความแตกต่างเพียง 1 คะแนนแสดงให้เห็นช่องว่างที่มีนัยสำคัญทางสถิติใน “เกณฑ์ความเป็นอัตโนมัติ” ของโมเดล ตัวอย่างเช่น ช่องว่าง 3 คะแนนระหว่าง GPT-5.5 (60) และ Claude Opus 4.7 (57) มักแปลเป็นความแตกต่างระหว่างโมเดลที่ต้องการการแทรกแซงของมนุษย์ทุกไม่กี่ขั้นตอน กับโมเดลที่สามารถทำตามโซ่ตรรกะที่ซับซ้อนได้อย่างอิสระ คะแนนดัชนีที่สูงกว่า มักสัมพันธ์กับ อัตราความสำเร็จที่สูงขึ้นใน “Humanity's Last Exam” และการลดข้อผิดพลาดในการเรียกเครื่องมือในสภาพแวดล้อมแบบเอเจนต์

ปฏิกิริยา: เวลาแฝงและความเร็วในการสร้าง

สำหรับซอฟต์แวร์เชิงโต้ตอบ—ตั้งแต่ผู้ช่วย IDE แบบสดไปจนถึงเอเจนต์เสียงที่เผชิญลูกค้า—ความฉลาดเชิงดิบมีความสำคัญรองลงมาจาก Time to First Token (TTFT) และ Generation Throughput

5 โมเดลที่เร็วที่สุด (throughput)

Throughput วัดความเร็วที่โมเดลสร้างข้อความหลังผ่านขั้นตอนประมวลผลเริ่มต้น Throughput สูงจำเป็นต่อการสร้างเนื้อหาระยะยาวและการปรับโค้ดอย่างรวดเร็ว

- Mercury 2: ประมาณ 859 โทเค็น/วินาที

- Granite 4.0 H Small: ประมาณ 407 โทเค็น/วินาที

- Granite 3.3 8B: ประมาณ 365 โทเค็น/วินาที

- Gemini 3.1 Flash-Lite**** : ประมาณ 331 โทเค็น/วินาที

- Qwen3.5 0.8B: ประมาณ 287 โทเค็น/วินาที

5 โมเดลที่เวลาแฝงต่ำที่สุด (TTFT)

เวลาแฝงบ่งชี้ความล่าช้าก่อนที่โทเค็นแรกจะถึงผู้ใช้ เป็นเมตริกสำคัญสำหรับ “ความลื่นไหล” และความรู้สึกตอบสนองใน UI/UX

- NVIDIA Nemotron 3 Nano: ประมาณ 0.40 วินาที

- Ministral 3 3B: ประมาณ 0.47 วินาที

- Qwen3.5 0.8B: ประมาณ 0.52 วินาที

- LFM2 24B A2B: ประมาณ 0.55 วินาที

- Grok 3 mini Reasoning: ประมาณ 0.58 วินาที

วิธีเลือกโมเดลของคุณในปี 2026

การเลือกโมเดลต้องปรับสมดุลระหว่างสัดส่วน “ความฉลาดต่อดอลลาร์” กับข้อกำหนดเวลาให้บริการ (uptime) เฉพาะของแอปพลิเคชันของคุณ ตลาดในปี 2026 ได้แยกเป็นสามแนวทางสถาปัตยกรรมที่แตกต่างกันชัดเจน

นักพัฒนาอิสระและทีมที่อ่อนไหวต่องบประมาณ

สำหรับนักพัฒนาเดี่ยวหรือทีมเล็กที่รันลูปเอเจนต์เชิงทดลองนับพัน DeepSeek V4 Pro คือทางเลือกเชิงกลยุทธ์ที่เหมาะสมที่สุด ใช้สถาปัตยกรรม Mixture-of-Experts (MoE) ขนาดมหึมา 1.6T พารามิเตอร์ โดยเปิดใช้งานเพียง 49B พารามิเตอร์ต่อโทเค็น ทำให้ให้ประสิทธิภาพระดับเรือธงที่ประมาณ $0.416 ต่อหนึ่งล้านโทเค็น อีกตัวเลือกที่ยอดเยี่ยมสำหรับงานเขียนโค้ดเฉพาะทางคือ Kimi K2.6 ซึ่งเชี่ยวชาญเวิร์กโฟลว์แบบเน้นเทอร์มินัลก่อน โมเดลเหล่านี้ให้พลังการให้เหตุผลเกือบ 90% ของโมเดลพรีเมียม ในขณะที่มีราคาถูกกว่าประมาณ 70-80% ช่วยยืดระยะเวลาอยู่รอดของสตาร์ทอัพได้อย่างมีนัยสำคัญ

สภาพแวดล้อมการผลิตระดับองค์กร

สำหรับการปรับใช้ทั่วทั้งบริษัทที่ความเสถียรและการยึดตามพรอมต์ระบบที่ซับซ้อนเป็นสิ่งที่ไม่อาจประนีประนอม มาตรฐานอุตสาหกรรมยังคงเป็น GPT-5.5 Pro และ Claude Opus 4.7 GPT-5.5 Pro ถูกออกแบบมาสำหรับความแม่นยำสูงในภาวะเสี่ยง เช่น การสร้างแบบจำลองด้านธนาคารเพื่อการลงทุนและการสำรวจทางวิทยาศาสตร์ ซึ่งต้นทุนของข้อผิดพลาดสูงกว่าต้นทุนของการเรียก API Claude Opus 4.7 ได้รับความนิยมจากทีมที่ต้องการความเชื่อถือได้อย่างต่อเนื่องในโครงการหลายวัน เพราะแสดงอัตราฮัลลูซิเนชันต่ำกว่าอย่างมีนัยสำคัญในสภาพแวดล้อมเทอร์มินัลเมื่อเทียบกับตระกูล GPT โดยทั่วไป องค์กรมักใช้ CometAPI เพื่อเชื่อมต่อโมเดลเหล่านี้ผ่านเกตเวย์เดียว เพื่อรับประกัน uptime 99.9% และการสลับทดแทนทันทีหากผู้ให้บริการหลักเกิดเวลาแฝงพุ่งในบางภูมิภาค

แอปพลิเคชันเชิงโต้ตอบแบบเรียลไทม์

แอปเช่นบอตสนับสนุนลูกค้าแบบเรียลไทม์หรือการใส่คำบรรยายวิดีโอทันใจต้องการ AI ที่ “ลื่นไหล” และรู้สึกทันที ในหมวดนี้ Mercury 2 และ Gemini 3.1 Flash-Lite คือทางเลือกที่เหนือกว่า Mercury 2 ให้อัตราการสร้างผลลัพธ์เร็วเกือบสิบเท่าของโมเดลให้เหตุผลมาตรฐาน เหมาะอย่างยิ่งสำหรับการร่างเอกสารแบบเรียลไทม์ Gemini 3.1 Flash-Lite มอบความสามารถหลายโมดัลที่สมดุล ประมวลผลข้อความ เสียง และภาพภายในบริบทเดียวด้วยความเร็วประมาณ 2.5 เท่าจากรุ่นก่อนหน้า พร้อมรองรับหน้าต่างบริบท 1 ล้านโทเค็น

หน้าต่างบริบท: ตั้งแต่ชิ้นส่วนข้อความไปจนถึงคลังซอร์สโค้ดทั้งชุด

หน้าต่างบริบททำหน้าที่เป็น “ความจำระยะสั้น” ของโมเดล ในปี 2026 อุตสาหกรรมแบ่งออกระหว่างหน้าต่างมาตรฐาน (128K) และความจุระดับคลังซอร์สโค้ด (1M-10M)

- Llama 4 Scout: 10,000,000 โทเค็น

- Grok 4.20: 2,000,000 โทเค็น

- Gemini 3.1 Pro: ประมาณ 1,048,576 โทเค็น

- DeepSeek V4 Pro: 1,000,000 โทเค็น

- GPT-5.5 Pro: 1,050,000 โทเค็น

เมื่อไหร่ที่ขนาดบริบทมีความสำคัญ?

หน้าต่างบริบท 128K—มาตรฐานสำหรับโมเดลอย่าง DeepSeek-V3.2—ตอนนี้เป็นฐานสำหรับการสนทนาและการสรุปบทความเดี่ยว อย่างไรก็ตาม วิศวกรรมซอฟต์แวร์ระดับมืออาชีพต้องการการตระหนักรู้ “ทั้งระบบ”

หน้าต่าง 1 ล้านโทเค็น ช่วยให้เอเจนต์ AI รับทั้งคลังซอร์สโค้ด รวมทั้งไฟล์ซอร์สทั้งหมด เอกสารประกอบ และบันทึกประวัติ ในการประมวลผลครั้งเดียว ลด “การเลื่อนความจำ” ที่พบในระบบ RAG แบบดั้งเดิมที่ข้อมูลเกี่ยวข้องอาจตกหล่นระหว่างการแบ่งชิ้น ตัวอย่างที่ชัดเจนคือการรีแฟคเตอร์ฐานโค้ด: โมเดลที่มี 1M โทเค็นสามารถเข้าใจว่าการเปลี่ยนแปลงในสคีมาฐานข้อมูลหลักส่งผลต่อเอ็นด์พอยต์ API ห้าสิบรายการในไฟล์ต่าง ๆ อย่างไร ในขณะที่โมเดลที่เล็กกว่ามัก “เห็น” ได้เพียงไม่กี่ไฟล์ ทำให้เกิดการพึ่งพาที่เสียหาย

การเปรียบเทียบทางเศรษฐศาสตร์: ราคาต่อ 1 ล้านโทเค็น

ตารางต่อไปนี้ใช้เมตริก Blended USD/1M Tokens โดยสมมติสัดส่วนโทเค็นนำเข้า-ส่งออก 3:1 เพื่อสะท้อนรูปแบบการใช้งานในโลกจริง

| โมเดล | ราคาแบบผสม (ต่อ 1M) | มูลค่าสัมพัทธ์ | ส่วนลดผ่าน CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | ประมาณ $11.25 | พรีเมียม | ลด 20% |

| Claude Opus 4.7 (max) | ประมาณ $10.00 | สูง | ลด 20% |

| Gemini 3.1 Pro | ประมาณ $4.50 | สมดุล | ลด 20% |

| Kimi K2.6 | ประมาณ $1.71 | คุ้มค่าสูง | ลด 20% |

| DeepSeek V4 Pro | ประมาณ $0.53 | คุ้มค่าสุดขีด | ลด 20% |

| Qwen3.5 0.8B | ประมาณ $0.02 | ใช้งานทั่วไป | ลด 20% |

อัตราทั้งหมดตรวจสอบแล้ว ณ พฤษภาคม 2026 ราคาจากผู้ขายอย่างเป็นทางการมักจะสูงกว่า discounted rates ที่ให้ผ่านเกตเวย์แบบรวมประมาณ 20%

กลยุทธ์การเพิ่มประสิทธิภาพค่าใช้จ่าย

เพื่อช่วยในการวางแผนสถาปัตยกรรม เราประมาณค่าใช้จ่ายรายเดือนสำหรับสามระดับการเติบโตที่พบบ่อย

- ทีมผู้พัฒนาขนาดเล็ก (10M โทเค็น/เดือน): ทีมที่ใช้ Kimi K2.6 เป็นหลักสำหรับการสร้างฟีเจอร์และ DeepSeek V4 Flash สำหรับตรรกะง่าย ๆ จะมีค่าใช้จ่ายรายเดือนประมาณ $15 ถึง $40 ทำให้สามารถทดลองอย่างเข้มข้นโดยมีภาระทางการเงินไม่มากไปกว่าสมัครใช้ SaaS มาตรฐาน

- SaaS ขนาดกลาง (100M โทเค็น/เดือน): สตาร์ทอัพที่สเกลแพลตฟอร์มอัตโนมัติที่ขับเคลื่อนด้วย AI โดยใช้ Claude Sonnet 4.6 และ Gemini 3.1 Flash คาดว่ามีค่าใช้จ่ายรายเดือนระหว่าง $250 ถึง $550 โดยการใช้การแคชพรอมต์ที่มีในโมเดลเหล่านี้ ต้นทุนที่แท้จริงมักลดลงเพิ่มเติมอีก 15%

- องค์กรขนาดใหญ่ (1B โทเค็น/เดือน): บริษัทระดับโลกที่รันเวิร์กโฟลว์แบบเอเจนต์ที่มีความพร้อมกันสูงด้วย GPT-5.5 และ Claude Opus 4.7 อาจใช้จ่ายรายเดือนในช่วง $3,000 ถึง $6,500 ที่ระดับนี้ การเชื่อมต่อผ่านเกตเวย์ API แบบรวมเป็นสิ่งจำเป็นสำหรับการออกบิลแบบรวมศูนย์และหลีกเลี่ยงภาระในการจัดการสัญญาแยกกับผู้ขายหลายราย

บทสรุป: เลือกเส้นทางของคุณในปี 2026

ยุคของ “โมเดลอเนกประสงค์” ได้สิ้นสุดลงแล้ว สถาปัตยกรรม AI สมัยใหม่ต้องออร์เคสเทรตกองโมเดลเฉพาะทาง: GPT-5.5 สำหรับการให้เหตุผลที่ใช้คอมพิวต์สูง Mercury 2 สำหรับปฏิสัมพันธ์ และ DeepSeek V4 สำหรับการประมวลผลปริมาณมาก ด้วยการเชื่อมต่อครั้งเดียวกับ CometAPI นักพัฒนาจะได้ความสามารถในการสลับโมเดลตามบेंช์มาร์กที่พัฒนาไป พร้อมรับส่วนลดถาวร 20-40% ในทุกคำร้องขอ

คำถามที่พบบ่อย

โมเดล AI ใดฉลาดที่สุดในปัจจุบัน?

ตาม Artificial Analysis Intelligence Index v4.0 GPT-5.5 (xhigh) เป็นโมเดลที่ฉลาดที่สุดในปัจจุบัน โดยมีคะแนน 60 ตามด้วย GPT-5.5 (high) ที่ 59 และ Claude Opus 4.7 (max) ที่ 57

โมเดล AI ที่เร็วที่สุดสำหรับแอปเรียลไทม์คืออะไร?

Mercury 2 เป็นแชมป์ความเร็วในปี 2026 โดยให้ประมาณ 859.1 โทเค็นต่อวินาที สำหรับเวลาแฝงต่ำ (TTFT) NVIDIA Nemotron 3 Nano นำด้วยเวลาตอบสนองประมาณ 0.40 วินาที

คะแนนดัชนีความฉลาดต้องสูงแค่ไหนสำหรับเอเจนต์ในการผลิตจริง?

สำหรับระบบอัตโนมัติหรือการจัดหมวดหมู่พื้นฐาน คะแนนระหว่าง 30 ถึง 40 (เช่น GPT-5.4 nano) มักเพียงพอ อย่างไรก็ตาม สำหรับ “Agentic Engineering” ที่ AI จัดการฐานโค้ดหรือทั้งเซสชันเบราว์เซอร์ แนะนำคะแนนเหนือ 54 (เช่น Kimi K2.6 หรือ GPT-5.5) เพื่อให้แน่ใจว่ามีความสม่ำเสมอในแผนระยะยาว

เมื่อราคาคล้ายกัน ควรเลือก GPT-5.5 หรือ Claude Opus 4.7?

หากเวิร์กโฟลว์ของคุณเกี่ยวข้องกับการรันบนเทอร์มินัลและ “Vibe Coding” โดยทั่วไป GPT-5.5 จะโดดเด่นในบेंช์มาร์กเฉพาะเหล่านั้น อย่างไรก็ตาม หากคุณต้องการความสม่ำเสมอขั้นสุดสำหรับงานเขียนเชิงวิชาชีพ การวิจัยทางกฎหมาย หรือวงจรเอเจนต์หลายวันพร้อมฮัลลูซิเนชันต่ำ Claude Opus 4.7 เป็นผู้นำที่มีเอกสารรองรับในหมวดหมู่เหล่านั้น

ช่องว่างประสิทธิภาพจริงระหว่างโมเดลเปิดน้ำหนัก (DeepSeek) และโมเดลเจ้าของลิขสิทธิ์คืออะไร?

ในปี 2026 ช่องว่างแคบลงเหลือประมาณ 10-15% ในบेंช์มาร์กการให้เหตุผลแบบดิบ ขณะที่เรือธงเจ้าของลิขสิทธิ์อย่าง GPT-5.5 (xhigh) ยังนำใน “ตรรกะพีก” (Index 60) โมเดลเปิดน้ำหนักอย่าง DeepSeek V4 Pro (Index 52) และ Kimi K2.6 (Index 54) ให้ความสามารถมากกว่า 85% ด้วยต้นทุนประมาณหนึ่งในสิบ

ฉันจะลดต้นทุน API โดยรวมสำหรับโมเดลเหล่านี้ได้อย่างไร?

การใช้เลเยอร์ API แบบรวมอย่าง CometAPI ช่วยให้คุณเข้าถึงแคตตาล็อกทั้งหมดในอัตราที่ ต่ำกว่าราคาอย่างเป็นทางการ 20% ถึง 40% ผ่านการซื้อจำนวนมากและการกำหนดเส้นทางอย่างชาญฉลาด

โมเดลใดมีหน้าต่างบริบทใหญ่ที่สุดสำหรับเอกสารยาว?

Llama 4 Scout รองรับหน้าต่างบริบทที่ใหญ่ที่สุดในตลาดที่ 10 ล้านโทเค็น Grok 4.20 ตามมาที่ 2 ล้านโทเค็น ขณะที่ GPT-5.5 Pro, Gemini 3.1 Pro และ DeepSeek V4 Pro ต่างรองรับประมาณ 1 ล้านโทเค็น

มีวิธีทดสอบบेंช์มาร์กเหล่านี้โดยไม่ต้องเสียค่าใช้จ่ายเริ่มต้นสูงหรือไม่?

มี คุณสามารถสมัครบัญชีฟรีที่ CometAPI เพื่อรับเครดิตทดสอบโดยไม่ต้องใช้บัตรเครดิต ทำให้คุณสามารถรันการทดสอบเปรียบเทียบประสิทธิภาพในโมเดลกว่า 500 ตัวได้ใน Playground ที่มีให้ในตัว