ประสบการณ์ของนักพัฒนากับการให้ ChatGPT วิเคราะห์วิดีโอมักติดขัด: ลิงก์ YouTube โดยตรงใช้ไม่ได้ผล และการอัปโหลด MP4 มักได้สรุปแบบ “มโน” ที่พลาดรายละเอียดจากภาพเคลื่อนไหว นี่ไม่ใช่บั๊ก—แต่เป็นข้อจำกัดเชิงสถาปัตยกรรม ChatGPT ไม่ได้สตรีมวิดีโอ; มันประมวลผลชุดของเฟรมภาพที่สกัดออกมากับบทถอดเสียงข้อความ ดังนั้นคุณลองอัปโหลดไฟล์ MP4 แล้ว ผลลัพธ์กึ่งใช้ได้ สรุปพูดถึงบทถอดเสียงเสียง แต่พลาดมุกภาพในฉากที่สามซึ่งทำให้ทั้งวิดีโอมีความหมาย

ChatGPT วิเคราะห์วิดีโอได้ — แต่ไม่ได้ “ดู” แบบจริงๆ

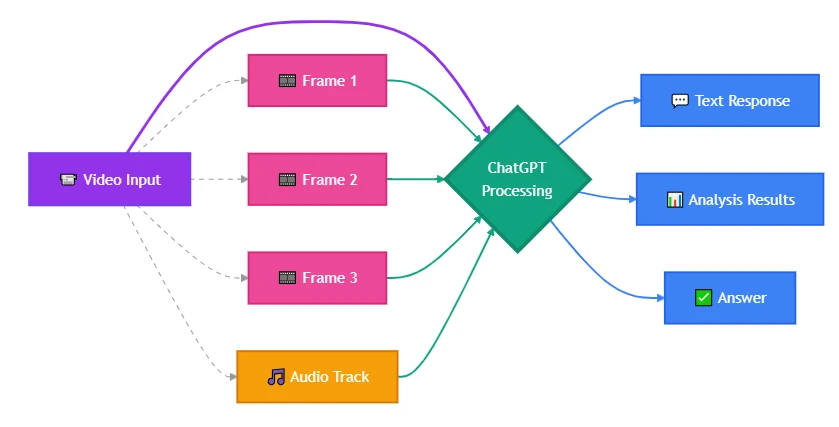

สิ่งที่เกิดขึ้นจริงคือ: ChatGPT ไม่ได้ “ดู” วิดีโอแบบที่คุณทำ มันไม่ได้กดเล่น สตรีม และสังเกตการเคลื่อนไหวตามเวลา สิ่งที่มันทำคือแยกวิดีโอออกเป็นองค์ประกอบที่มันถนัด—ภาพนิ่งและบทถอดเสียง—แล้วใช้เหตุผลกับชิ้นส่วนเหล่านั้นแยกกัน แบบจำลองจึงมองวิดีโอของคุณเป็นอัลบั้มภาพพร้อมบทบรรยาย ไม่ใช่ประสบการณ์ต่อเนื่อง นั่นจึงเป็นเหตุผลที่มันจับคำอธิบายที่พูดออกมาได้ แต่พลาดมุกภาพ: เฟรมที่มีมุกนั้นอาจไม่ได้ถูกสุ่มมาด้วย

เมื่อมีคนถามว่า “ChatGPT ดูวิดีโอได้ไหม” โดยมากหมายถึงสองอย่าง: มันสตรีมเนื้อหาภาพเหมือนผู้สังเกตมนุษย์ได้ไหม หรือมันสกัดและวิเคราะห์ความหมายจากข้อมูลวิดีโอ—ฉาก บทสนทนา ไทม์สแตมป์ การกระทำบนหน้าจอ—ได้ไหม คำตอบเชิงหน้าที่คือได้สำหรับข้อหลัง แต่มีข้อจำกัดที่ทำให้บางกรณีใช้งานไม่ได้เลย ChatGPT รุ่นสมัยใหม่ประมวลผลวิดีโอโดยมองเป็นเฟรมที่สุ่มเลือกผสานกับบทถอดเสียงเสียง ผ่านการสกัดอัตโนมัติในอินเทอร์เฟซเว็บ หรือรับเฟรมที่ผู้ใช้จัดเตรียมผ่าน API วิธีนี้ใช้ได้สำหรับการสรุป การอธิบายฉาก และการอ่านข้อความ แต่ใช้ไม่ได้กับการติดตามการเคลื่อนไหว การวิเคราะห์ที่อิงเวลาอย่างแม่นยำ หรือสิ่งใดก็ตามที่ต้อง “เห็น” สิ่งที่เกิดขึ้นระหว่างเฟรม

คำแนะนำส่วนใหญ่หยุดที่การยืนยันว่าความสามารถมีอยู่ โดยไม่อธิบายว่าทำไมการใช้งานของคุณถึงไม่เวิร์ก—หรือควรใช้วิธีป้อนข้อมูลแบบไหนแทน

ChatGPT ความสามารถด้านวิดีโอ: แบบจำลอง “เห็น” อะไรจริงๆ

ChatGPT ไม่ได้โหลดไฟล์ MP4 แล้วไล่ดูทีละเฟรม มันมีความสามารถด้านภาพ—วิเคราะห์ภาพนิ่ง—และมีการถอดเสียงด้วย Whisper เมื่อคุณส่งวิดีโอผ่านเว็บหรือแอปมือถือ ระบบจะสกัดคีย์เฟรม แปลงเสียงเป็นข้อความแยก แล้วป้อนทั้งสองอย่างให้โมเดลเป็นอินพุตแยกกัน จากนั้นโมเดลจะอธิบายสิ่งที่มัน “เห็น” ในเฟรม และสิ่งที่มัน “ได้ยิน” ในบทถอดเสียง

จากมุมคุณ มันดูเหมือนเข้าใจวิดีโอ จากมุมโมเดล มันคือการวิเคราะห์ภาพกับประมวลผลข้อความ ความแตกต่างเชิงสถาปัตยกรรมนี้เป็นตัวกำหนดว่ากรณีใดใช้ได้และกรณีใดใช้ไม่ได้

ถ้าวิดีโอของคุณพึ่งพาการเคลื่อนไหว การเปลี่ยนแปลงเฟรมต่อเฟรมแบบละเอียด หรือจังหวะเวลาเป๊ะๆ—อย่างการจับจังหวะที่วัตถุเข้ากรอบ หรือการติดตามแอนิเมชันขององค์ประกอบ UI—แนวทางแบบคีย์เฟรมจะพลาด ChatGPT จะไม่เห็นคิวภาพ 2 วินาทีที่เกิดระหว่างเฟรมที่สุ่มเลือก และจะไม่ติดตามวัตถุข้ามเวลาเว้นแต่คุณจะจัดโครงอินพุตให้แสดงความต่อเนื่องชัดเจน

ความสามารถวิดีโอของ ChatGPT (ช่วงต้นปี 2026):

- การวิเคราะห์วิดีโอบนฐานภาพ: รับไฟล์วิดีโอหรือเฟรมที่สกัด; ตีความเนื้อหาภาพจากเฟรมที่สุ่มเลือก

- การถอดเสียง: แปลงคำพูดเป็นข้อความด้วย Whisper; โมเดลสามารถสรุปหรือสอบถามจากบทถอดเสียงได้

- คำอธิบายฉาก: ระบุวัตถุ การกระทำ สภาพแวดล้อม และข้อความที่มองเห็นในเฟรมที่ให้มา

- คำถามอ้างอิงไทม์สแตมป์: อ้างถึงช่วงเวลาเฉพาะได้หากคุณให้ไทม์สแตมป์ของเฟรมหรือแบ่งวิดีโอด้วยตนเอง

- การอ่านข้อความ: อ่านคำบรรยาย ป้าย UI หรือเอกสารที่เห็นบนหน้าจอในเฟรม

อัตราการสุ่มเฟรมและพฤติกรรมเลือกคีย์เฟรมอัตโนมัติในอินเทอร์เฟซเว็บของ ChatGPT—ยังไม่เปิดเผยสาธารณะ ณ วันตัดความรู้

สิ่งที่ไม่มี:

- อินพุตวิดีโอแบบสตรีมเรียลไทม์ผ่าน API

- การติดตามการเคลื่อนไหวอย่างแม่นเฟรม หรือความคงอยู่ของวัตถุข้ามเวลา

- รองรับโค้เดควิดีโอโดยตรง—การประมวลผลเกิดบนเฟรมภาพที่สกัดและเสียง

- การตรวจจับการเปลี่ยนฉากอัตโนมัติโดยไม่มีพรอมป์ชี้นำ

ขีดความสามารถถูกจำกัดด้วยโทเค็นและขนาดไฟล์ ไม่ใช่ความยาว แม้ 5–10 นาทีจะเป็นเฮอริสติกที่ใช้งานจริง ขีดจำกัดจริงแปรตามความหนาแน่นของภาพ

หากกรณีใช้งานต้องการความสามารถเหล่านั้น คุณต้องพรีโพรเซสวิดีโอเองเพื่อสกัดเฟรมที่เหมาะสม หรือเปลี่ยนไปใช้โมเดลที่รองรับวิดีโอโดยกำเนิด ส่วนถัดไปจะอธิบายวิธีป้อนข้อมูลที่เหมาะกับสถานการณ์ของคุณ

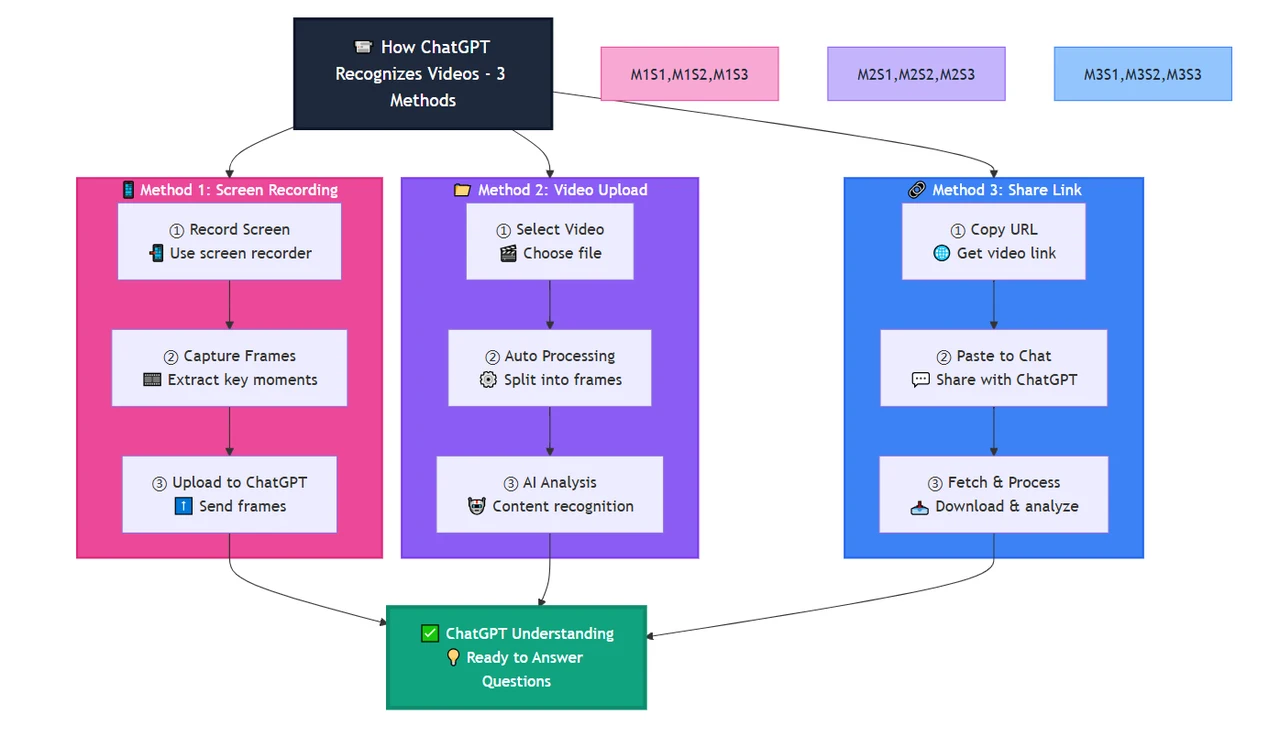

วิธีที่ ChatGPT “รู้จัก” วิดีโอ: 3 วิธีปฏิบัติ

การส่งวิดีโอให้ ChatGPT ไม่ได้มีวิธีเดียว วิธีที่คุณเลือกจะกำหนดว่าสิ่งใดที่โมเดลวิเคราะห์ได้และสิ่งใดที่จะพลาด ความล้มเหลวส่วนใหญ่เกิดจากการเลือกวิธีที่สะดวกแทนที่จะถูกต้อง

วิธีที่ 1: สกัดเฟรมด้วยตนเอง + อัปโหลดภาพ

สกัดเฟรมเองด้วย ffmpeg หรือเครื่องมือคล้ายกัน แล้วอัปโหลดเฟรมที่เลือกเป็นภาพ วิธีนี้ให้คุณควบคุมได้เต็มที่ว่า ChatGPT จะวิเคราะห์อะไร

เวิร์กโฟลว์ตัวอย่าง(bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

ข้อดีของวิธีนี้:

- โฟกัสการวิเคราะห์ในช่วงเวลาที่สำคัญ (อินโทร ช่วงไฮไลต์ บทสรุป) โดยไม่เปลืองคอนเท็กซ์กับส่วนที่ไม่เกี่ยวข้อง

- จับการเคลื่อนไหวได้ด้วยการอัปโหลดเฟรมต่อเนื่องตามอัตราที่คุณเลือก

- เลี่ยงข้อจำกัดขนาดไฟล์—ภาพเล็กกว่าไฟล์วิดีโอ

- รักษาคุณภาพเฟรมที่อาจลดลงจากการบีบอัดอัตโนมัติ

ข้อแลกเปลี่ยน:

คุณต้องจัดการพรีโพรเซสเอง สำหรับการวิเคราะห์วิดีโอจำนวนมากต้องมีระบบอัตโนมัติ สำหรับการวิเคราะห์เชิงลึกเป็นครั้งคราวหรือดีบักฉากเฉพาะ วิธีนี้เชื่อถือได้ที่สุด

ควรใช้เมื่อ:

- ต้องการการวิเคราะห์แม่นยำระดับเฟรมในช่วงเวลาที่ระบุ

- ข้อมูลภาพสำคัญมีช่วงเวลาสั้นหรือเกิดระหว่างคีย์เฟรมปกติ

- เปรียบเทียบการเปลี่ยนแปลงภาพในลำดับ (สถานะ UI เปลี่ยน เฟรมแอนิเมชัน)

- ต้องการยืนยันว่าโมเดล “เห็น” เฟรมใดจริง โดยตรวจเฟรมที่คุณอัปโหลด

วิธีที่ 2: อัปโหลดไฟล์โดยตรงผ่านอินเทอร์เฟซ ChatGPT

เว็บแอปและแอปมือถือของ ChatGPT รองรับการอัปโหลดวิดีโอโดยตรง วางไฟล์ MP4 หรือ MOV ในช่องป้อน ระบบจะสกัดเฟรมและถอดเสียงอัตโนมัติ

สิ่งที่เกิดขึ้นภายใน:

- บริการจะสุ่มเฟรมตามช่วง (อัตราไม่ระบุอย่างเป็นทางการ; จากการสังเกตประมาณ 1–2 เฟรมต่อวินาที)

- เสียงถอดเป็นข้อความผ่าน Whisper หรือบริการคล้ายกัน

- เอาต์พุตทั้งสองถูกส่งเข้าโมเดลเป็นบริบทแยก

- โมเดลสร้างคำตอบจากสิ่งที่เห็นในเฟรมและได้ยินในบทถอดเสียง

ใช้ได้ดีสำหรับ:

- สรุประดับสูงของวิดีโอโดยไม่ต้องการความละเอียดระดับเฟรม

- ระบุวัตถุ บุคคล หรือสภาพแวดล้อมหลักที่คงอยู่ข้ามฉาก

- สกัดเนื้อหาที่พูดหรือข้อความบนหน้าจอที่ปรากฏหลายเฟรม

- การสำรวจเบื้องต้นอย่างรวดเร็วโดยไม่ต้องพรีโพรเซส

ใช้ไม่ได้สำหรับ:

- การวิเคราะห์ระดับเฟรม—คุณควบคุมเฟรมที่ถูกสุ่มไม่ได้

- เนื้อหาวิดีโอยาวเกินขีดความสามารถของโมเดล จำเป็นต้องแบ่งอย่างมีตรรกะ หากไม่แยกหรือพรีโพรเซสอย่างมีกลยุทธ์ ประสิทธิภาพอาจลดลงหรือถูกตัดทอนเมื่อบริโภคโทเค็นมากกับภาพหนาแน่น

- การตรวจจับการเคลื่อนไหว ทรานซิชัน หรือเนื้อหาที่อิงเวลาและต้องเทียบเฟรมต่อเฟรม

- กรณีที่ข้อมูลภาพสำคัญปรากฏช่วงสั้นๆ ระหว่างเฟรมที่สุ่ม

ถ้าต้องการควบคุมช่วงเวลาที่วิเคราะห์ ให้ใช้วิธีที่ 1

วิธีที่ 3: ลิงก์ YouTube + ดึงบทถอดเสียง

ปลั๊กอินและเครื่องมือภายนอกบางตัวอ้างว่า “วิเคราะห์วิดีโอ YouTube” จริงๆ แล้วคือดึงเมตาดาตาและบทถอดเสียงของวิดีโอ (ถ้ามี) แล้วส่งข้อความนั้นให้ ChatGPT

ใช้ได้เมื่อ:

- วิดีโอนั้นมีคำบรรยายที่อัปโหลดหรือสร้างอัตโนมัติ

- การวิเคราะห์ต้องการเฉพาะเนื้อหาที่พูด ไม่ใช่ข้อมูลภาพ

- วิดีโอเป็นสาธารณะ (ไม่เป็นส่วนตัว, ไม่ unlisted, ไม่จำกัดภูมิภาค)

- คุณสรุปเลคเชอร์ พอดแคสต์ หรือสัมภาษณ์ที่เนื้อหาหลักอยู่ในเสียง

ใช้ไม่ได้เมื่อ:

- คุณต้องวิเคราะห์ข้อมูลภาพ (เดโมบนหน้าจอ แผนภาพ สีหน้าท่าทาง)

- วิดีโอไม่มีบทถอดเสียงหรือคำบรรยาย

- ข้อมูลสำคัญปรากฏทางภาพโดยไม่ได้ถูกกล่าวถึง

- คุณทำงานกับไฟล์ส่วนตัวหรือเนื้อหาหลังการยืนยันตัวตน

ความผิดพลาดที่พบบ่อย: นักพัฒนาคาดหวังความเข้าใจวิดีโอเต็มรูปแบบ (ภาพ + เสียง) แต่ได้สรุปบทถอดเสียงเท่านั้น ซึ่งพอสำหรับวิเคราะห์เนื้อหาที่พูด แต่ไร้ประโยชน์สำหรับรีวิวเดโมผลิตภัณฑ์ วิเคราะห์ออกแบบภาพ หรือกรณีที่ “สิ่งที่เห็น” สำคัญกว่า “สิ่งที่พูด”

แพทเทิร์น: วิธีที่ 2 สำหรับสรุปเร็วที่ไม่ซีเรียสเรื่องความแม่นยำ วิธีที่ 1 สำหรับการวิเคราะห์ที่ควบคุมได้เมื่อคุณต้องการเฟรมเฉพาะ วิธีที่ 3 สำหรับคอนเทนต์ที่โฟกัสเสียงเมื่อข้อมูลภาพมีความสำคัญรอง เลือกตามว่า “สัญญาณสำคัญ” ของกรณีใช้งานคุณอยู่ที่ไหน—ในความเคลื่อนไหว ในเฟรมเฉพาะ หรือในบทสนทนา

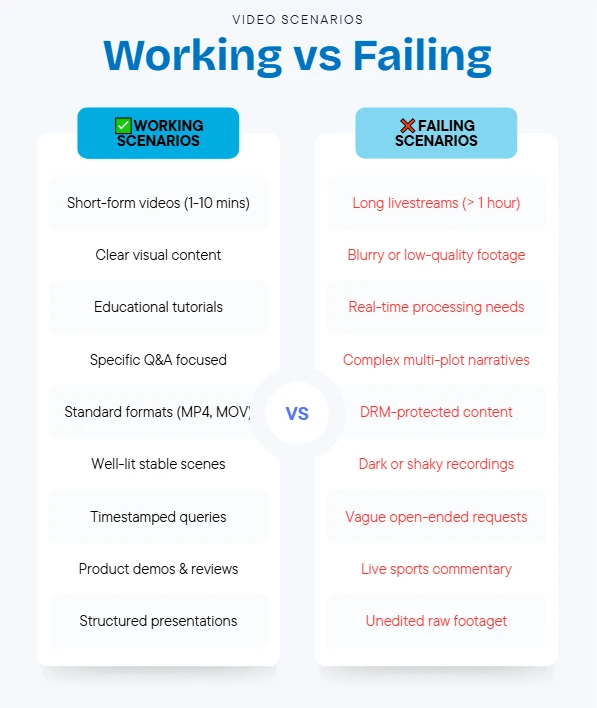

สถานการณ์ใช้งานวิดีโอของ ChatGPT: อะไรใช้ได้จริงในการผลิต

การรู้ว่า ChatGPT ประมวลผลองค์ประกอบวิดีโอได้ ไม่ได้บอกว่ามันเหมาะกับปัญหาของคุณหรือไม่ สถานการณ์เหล่านี้แสดงว่าที่ใดการวิเคราะห์แบบเฟรมได้ผล—และที่ใดข้อจำกัดเชิงสถาปัตยกรรมทำให้ใช้ไม่ได้

สถานการณ์ที่ 1: สรุปเนื้อหาการศึกษา

กรณีใช้งาน: มีวิดีโอสอน 10 นาที ต้องการสรุปโครงสร้างขั้นตอนหลัก เครื่องมือที่กล่าวถึง และตัวอย่างภาพที่แสดง

เหตุผลที่เวิร์ก: วิดีโอการศึกษามักมีขอบเขตฉากชัดเจน มีข้อความบนหน้าจอที่คงอยู่ และมีคำบรรยายเสียงสอดคล้องกับภาพ ผู้พูดอธิบายสิ่งที่กำลังแสดงขณะมันปรากฏ ChatGPT จึงถอดคำอธิบาย ระบุเครื่องมือหรือแผนภาพในเฟรมที่สุ่ม และผสานทั้งสองเป็นเอาต์พุตที่มีโครงสร้าง

วิธีทำ: อัปโหลดวิดีโอผ่านอินเทอร์เฟซ ChatGPT หรือสกัด 8–12 คีย์เฟรมในจุดเปลี่ยนหัวข้อหลัก พรอมป์: “สรุปขั้นตอนหลักในวิดีโอนี้ อ้างอิงทั้งคำบรรยายและข้อความบนหน้าจอ แผนภาพ หรือชื่อเครื่องมือที่เห็น”

จุดที่พัง: วิดีโอที่พึ่งพาการเคลื่อนไหวต่อเนื่อง—เช่นโค้ดดิ้งที่พิมพ์เร็วข้ามไฟล์—จะมีขั้นตอนที่ตกหล่นระหว่างเฟรม ต้องเพิ่มอัตราสุ่มเฟรมหรือโฟกัสบทถอดเสียงเสียงอย่างเดียว

ทิป: สำหรับเลคเชอร์/ติว ควบรวมการอัปโหลดอัตโนมัติ (เพื่อบทถอดเสียง) กับเฟรมสำคัญ 3–5 เฟรมที่สกัดเอง เพื่อให้ได้ทั้งความครอบคลุมเสียงและภาพคุณภาพสูงของแนวคิดหลัก

สถานการณ์ที่ 2: วิเคราะห์เดโมผลิตภัณฑ์

กรณีใช้งาน: รีวิวเดโมของคู่แข่ง ต้องการดึงองค์ประกอบ UI ชื่อฟีเจอร์ โฟลว์ผู้ใช้ และรายละเอียดราคาในหน้าจอ

เหตุผลที่เวิร์ก: เดโมมักค้างแต่ละหน้าจอนานพอให้สุ่มเฟรมจับ UI คงที่ ข้อความซ้อน ป้ายปุ่ม เมนู และตารางราคามักปรากฏหลายเฟรม ความสามารถด้านภาพของ ChatGPT อ่านและอธิบายองค์ประกอบเหล่านี้ได้แม้ไม่ได้ถูกพูดถึง

วิธีทำ: สกัดเฟรมที่จุดเปลี่ยนฉากหลัก (สไลด์นำเข้า เดโมฟีเจอร์ 1 เดโมฟีเจอร์ 2 หน้าราคา CTA) อัปโหลดและพรอมป์: “สำหรับแต่ละเฟรม ระบุองค์ประกอบ UI ป้ายปุ่ม ชื่อฟีเจอร์ และข้อมูลราคา/ผลิตภัณฑ์ที่แสดงทั้งหมด”

จุดที่พัง: เดโมที่ทรานซิชันเร็ว สถานะ hover ที่เผยข้อมูลสั้นๆ หรือองค์ประกอบอินเทอร์แอคทีฟที่โผล่เพียง 1–2 วินาทีจะไม่ถูกจับเว้นแต่สุ่มโดนจังหวะนั้น

ทิป: ไล่ดูวิดีโอด้วยตนเองเพื่อหาช่วงเวลาการเปิดเผยสำคัญ แล้วสกัดเฟรม ณ เวลานั้น แทนการพึ่งช่วงสุ่มอัตโนมัติ

สถานการณ์ที่ 3: ถอดความประชุม/สัมภาษณ์พร้อมบริบทภาพ

กรณีใช้งาน: บันทึกคุยกับลูกค้า ต้องการทั้งบทถอดเสียงและบันทึกว่าช่วงไหนมีเอกสาร สไลด์ หรือแชร์หน้าจอ

เหตุผลที่เวิร์ก: การถอดเสียงจัดการบทสนทนา เมื่อผู้เข้าร่วมแชร์หน้าจอหรือชูเอกสาร สิ่งเหล่านี้จะอยู่ในเฟรมที่สุ่ม ChatGPT จึงบันทึก “ประมาณช่วงเวลา [timestamp] มีเอกสารสัญญาปรากฏบนหน้าจอ” ควบคู่บทถอดเสียง—มีประโยชน์สำหรับรายงานการประชุมที่อ้างอิงสื่อภาพ

วิธีทำ: อัปโหลดวิดีโอและพรอมป์: “ถอดความการประชุมนี้ และบันทึกช่วงเวลาที่มีเอกสาร สไลด์ นำเสนอ แชร์หน้าจอ หรือสื่อภาพอื่นๆ ปรากฏ พร้อมอธิบายว่าเห็นอะไร”

จุดที่พัง: แชร์หน้าจอสั้น (ต่ำกว่า 5–10 วินาที) อาจตกหล่นระหว่างเฟรม ข้อความเล็กเกินอ่านในเฟรมที่ถูกบีบอัดจะอ่านไม่ได้ สำหรับกรณีที่ต้องการความถูกต้องตามกฎหมาย/คอมพลายแอนซ์ในการจับเอกสาร ให้ยืนยันคุณภาพเฟรมและความครอบคลุมเฟรมก่อนพึ่งผลลัพธ์

ทิป: สำหรับประชุมสำคัญ อัดที่ความละเอียดสูงขึ้น และสกัดเฟรมเมื่อมีคนพูดว่า “เดี๋ยวให้ดูเอกสารนี้”—บอกใบ้ว่าจะมีสื่อภาพ

สถานการณ์ที่ 4: การกลั่นกรองเนื้อหา/รีวิวคอมพลายแอนซ์

กรณีใช้งาน: สแกนวิดีโอที่ผู้ใช้อัปโหลดเพื่อหาสิ่งต้องห้าม—โลโก้ ข้อความ หรือองค์ประกอบภาพที่ผิดนโยบาย

เหตุผลที่เวิร์ก: ChatGPT สแกนเฟรมเพื่อหาข้อความ วัตถุ หรือฉากที่อธิบายได้ หากตรวจ “มีโลโก้คู่แข่งหรือไม่” การวิเคราะห์แบบเฟรมตรวจจับโลโก้ที่ค้างมากกว่า 1–2 วินาทีได้

วิธีทำ: สกัดเฟรมช่วงห่างปกติ (ทุก 3–5 วินาที) อัปโหลด และพรอมป์: “ตรวจเฟรมเหล่านี้และระบุเฟรมที่มี [โลโก้/แบรนด์/สัญลักษณ์ต้องห้าม] พร้อมบอกตำแหน่งในเฟรม”

จุดที่พัง: การละเมิดจากเสียง (เพลงลิขสิทธิ์ คำพูดต้องห้าม) ต้องวิเคราะห์เสียงแยก การละเมิดจากการเคลื่อนไหว (ท่าทางต้องห้าม, การกระทำข้ามเฟรม) จะไม่ถูกจับด้วยภาพนิ่ง สิ่งต้องห้ามที่กระพริบสั้นๆ อาจไม่ติดเฟรมที่สุ่ม

ทิป: ผสานการสแกนภาพของ ChatGPT กับบริการลายนิ้วมือเสียงและอัตราสุ่มเฟรมที่สูงขึ้นสำหรับหมวดความเสี่ยงสูง ใช้ ChatGPT เป็นชั้นคัดกรองแรก ไม่ใช่ชั้นเดียว

แพทเทิร์นของกรณีที่สำเร็จ: เนื้อหามีความหมายอยู่ในเฟรมที่นิ่งและมีความเกี่ยวโยงกับเสียงหรือข้อความ ความล้มเหลวเกิดเมื่อข้อมูลสำคัญอยู่ในความเคลื่อนไหว จังหวะ เวลา ทรานซิชัน หรือปรากฏสั้นเกินจะสุ่มได้อย่างเชื่อถือ

ความสามารถวิดีโอของ Gemini vs. Claude vs. ChatGPT

หากสถาปัตยกรรมแบบสุ่มเฟรมของ ChatGPT ไม่เหมาะกับกรณีคุณ คุณอาจพิจารณาทางเลือกอื่น Gemini และ Claude มีความสามารถด้านวิดีโอที่ต่างกัน—และความต่างนี้เป็นตัวตัดสินว่าโมเดลใดเหมาะกับงานของคุณ

การประมวลผลวิดีโอโดยกำเนิดของ Gemini

โมเดล Gemini รองรับอินพุตวิดีโอโดยกำเนิดในระดับ API คุณส่งไฟล์วิดีโอได้โดยตรงโดยไม่ต้องพรีโพรเซสเป็นเฟรม โมเดลประมวลวิดีโอเป็นสตรีมต่อเนื่อง ช่วยให้ติดตามการเคลื่อนไหว ตรวจจับการเปลี่ยนฉาก และให้เหตุผลเชิงเวลาได้ ซึ่งแนวทางของ ChatGPT ทำไม่ได้

กรณีใช้งานที่ Gemini ชนะ:

คุณต้องจับช่วงที่วัตถุเข้าสู่และออกจากเฟรมในคลิป 30 วินาที หรือดูการเคลื่อนที่ของคนในฉาก Gemini ติดตามวัตถุข้ามเฟรมและให้เหตุผลเกี่ยวกับการเคลื่อนไหวได้ ChatGPT จะเห็นวัตถุเฉพาะในเฟรมที่สุ่มได้เท่านั้น—อาจพลาดตอนเข้า/ออกกรอบ

ข้อแลกเปลี่ยน:

- API ของ Gemini แบบเนทีฟมักคุ้มค่ากว่า OpenAI ที่สุ่มเฟรม โดยหลีกเลี่ยงโอเวอร์เฮดโทเค็นแบบเชิงเส้นด้วย context caching ทำให้สเกลวิเคราะห์ยาวๆ ได้ดีกว่า

- การประมวลวิดีโอยาวทำให้หน่วงขึ้น—โมเดลต้องรับไฟล์ทั้งหมดก่อนตอบ

- ไม่ใช่ทุกรุ่นของ Gemini รองรับวิดีโอ; ต้องใช้รุ่นหลังๆ

- มีขีดจำกัดความยาว แต่ใจกว้างกว่า ChatGPT ที่ติดบริบท

เลือก Gemini แทน ChatGPT เมื่อ:

- งานต้องการติดตามการเคลื่อนไหว ตรวจจับขอบเขตฉาก หรือเข้าใจความสัมพันธ์เชิงเวลา

- ข้อมูลสำคัญปรากฏและหายไปเร็วข้ามเฟรม

- คุณวิเคราะห์วิดีโอที่ลำดับเหตุการณ์มีความหมาย (กีฬา กล้องวงจรปิด รีวิวแอนิเมชัน)

- คุณไม่ต้องการพรีโพรเซสสกัดเฟรมด้วยตนเอง

ข้อจำกัดปัจจุบันของ Claude กับวิดีโอ

ณ ช่วงต้นปี 2026 โมเดล Claude ยังไม่รองรับอินพุตวิดีโอโดยตรงผ่าน API คุณอัปโหลดภาพ (รวมเฟรมที่สกัด) ได้ แต่ไม่มีความสามารถวิดีโอแบบเนทีฟเทียบ Gemini

สิ่งที่ Claude ทำได้:

- วิเคราะห์ลำดับเฟรมที่อัปโหลด คล้ายวิธีสกัดเฟรมของ ChatGPT (วิธีที่ 2)

- ให้คำอธิบายภาพละเอียดในแต่ละเฟรม

- ให้เหตุผลเกี่ยวกับการเคลื่อนไหวที่อนุมานจากความต่างระหว่างเฟรมได้ หากมีพรอมป์ชี้นำ

- จัดการลำดับภาพที่ยาวกว่าได้ด้วยหน้าต่างบริบทขนาดใหญ่ (สูงถึง 1M โทเค็นใน Claude Opus 4.7)

สิ่งที่ Claude ทำไม่ได้:

- รับไฟล์วิดีโอโดยตรงผ่านอินเทอร์เฟซใดๆ

- ติดตามการเคลื่อนไหว/วัตถุอัตโนมัติโดยไม่พรอมป์แบบเฟรมต่อเฟรม

- ถอดเสียง—ต้องพรีโพรเซสด้วย Whisper หรือบริการอื่น แล้วส่งบทถอดเสียงให้ Claude

เมื่อใดที่ยังควรเลือก Claude:

- เวิร์กโฟลว์ของคุณมีการสกัดเฟรมเป็นขั้นตอนอยู่แล้ว

- คุณวิเคราะห์วิดีโอยาวที่ต้องใช้เฟรมจำนวนมากและต้องการบริบทยาวของ Claude

- คุณเปรียบเทียบคุณภาพการวิเคราะห์ภาพและพบว่า Claude ให้คำอธิบายภาพแม่น/ละเอียดกับโดเมนคุณ (เช่น ภาพการแพทย์ แผนภาพเทคนิค)

- คุณต้องผสานการวิเคราะห์เฟรมกับข้อมูลบริบทจำนวนมากอื่นๆ

ตารางเปรียบเทียบความสามารถ

| Feature | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Direct video file upload | ✓ (web/app interface) | ✓ (API + web interface) | ✗ |

| Native motion tracking | ✗ | ✓ | ✗ |

| Audio transcription | ✓ (Whisper integration) | ✓ (integrated) | ✗ (requires external tool) |

| Frame-based analysis | ✓ | ✓ (also continuous processing) | ✓ (manual extraction only) |

| Scene change detection | ✗ (manual only) | ✓ (automatic) | ✗ |

| Typical video length handling | ~5-10 min (context limited) | ~1 hour (resolution dependent) | N/A (frame count limited by context) |

| Best use case | Quick summaries, frame-level analysis with some control | Motion tracking, temporal reasoning, continuous video | Deep frame-by-frame description with large context needs |

| API video support | ✗ (images only) | ✓ | ✗ |

กรอบการตัดสินใจ:

- เลือก ChatGPT เมื่อ: ต้องการสรุปวิดีโอเร็ว ข้อมูลสำคัญคงอยู่ข้ามหลายเฟรม ทำงานกับคลิปสั้น (<10 นาที) และไม่ต้องการการติดตามการเคลื่อนไหว เหมาะกับคอนเทนต์การศึกษา เดโมคงที่ การถอดความประชุม

- เลือก Gemini เมื่อ: งานต้องการติดตามการเคลื่อนไหว ตรวจจับฉาก หรือให้เหตุผลเชิงเวลาว่าองค์ประกอบเคลื่อน/เปลี่ยนอย่างไร เหมาะกับฟุตเทจกีฬา กล้องวงจรปิด รีวิวแอนิเมชัน หรือกรณีที่ “สิ่งที่เกิดระหว่างเฟรม” สำคัญ

- เลือก Claude เมื่อ: คุณสกัดเฟรมในสายงานอยู่แล้ว ต้องวิเคราะห์เฟรมจำนวนมากพร้อมบริบทยาว หรือพบว่า Claude อธิบายภาพแม่นยำกับโดเมนของคุณ ต้องพรีโพรเซสมากที่สุดแต่ให้หน้าต่างบริบทใหญ่สุด

สำหรับนักพัฒนาที่ทำงานข้ามหลายโมเดล CometAPI มีอินเทอร์เฟซรวมเพื่อทดสอบคุณภาพการประมวลผลวิดีโอระหว่าง GPT, Gemini และ Claude โดยไม่ต้องเขียนโค้ดเชื่อมต่อใหม่—มีประโยชน์เมื่อเทียบคุณภาพก่อนเลือกผู้ให้บริการ

คำตอบจริงของ “ChatGPT ดูวิดีโอได้ไหม” ไม่ใช่ขาวหรือดำ แต่คือ “ได้ โดยแปลงวิดีโอเป็นรูปแบบที่มันถนัด—พร้อมข้อจำกัดที่ทำให้บางกรณีใช้งานไม่ได้” ความล้มเหลวส่วนใหญ่เกิดจากความไม่ลงรอยทางสถาปัตยกรรม ไม่ใช่ช่องว่างความสามารถ โมเดลทำงานตามแบบที่ออกแบบ; นักพัฒนาเพียงคาดหวังการออกแบบอีกแบบหนึ่ง

หากคุณสร้างฟีเจอร์วิเคราะห์วิดีโอในสเกล ทดสอบเวิร์กโฟลว์กับกรณีขอบก่อน: อัปโหลดวิดีโอเดียวกันผ่านไฟล์โดยตรง เฟรมที่สกัดด้วยตนเอง และวิธีบทถอดเสียงเท่านั้น เปรียบเทียบผลลัพธ์ วิธีที่จับ “สัญญาณสำคัญ” ของกรณีคุณได้—ไม่ใช่วิธีที่ทำเร็วสุด—คือวิธีที่อยู่รอดในทราฟฟิกการผลิต

ก่อนตัดสินใจใช้ ChatGPT กับวิดีโอ:

- ระบุว่าข้อมูลสำคัญของคุณอยู่ในเฟรมคงที่ การเคลื่อนไหว หรือเสียง

- ทดสอบความครอบคลุมการสุ่มเฟรมโดยสกัดเฟรมตามช่วงที่คาดหวัง

- ยืนยันว่าข้อความบนหน้าจออ่านได้ที่ความละเอียดหลังบีบอัด

- ตรวจว่าความยาววิดีโอพอดีกับขีดจำกัดบริบทที่แผนของคุณรองรับ

- เตรียมแผนสำรองสำหรับเนื้อหาที่ปรากฏสั้นหรือระหว่างเฟรมที่สุ่ม

สำหรับนักพัฒนาที่ประเมินผู้ให้บริการ AI หลายรายสำหรับงานวิดีโอ CometAPI มีพื้นที่เล่นรวมเพื่อทดสอบ ChatGPT, Gemini และ Claude ด้วยอินพุตวิดีโอเดียวกัน—ช่วยให้เทียบคุณภาพ เวลาตอบ และต้นทุนก่อนผูกกับผู้ให้บริการ

FAQ - คู่มือวิเคราะห์วิดีโอด้วย AI

คำตอบเร็วสำหรับคำถามพบบ่อยเกี่ยวกับการวิเคราะห์วิดีโอด้วย AI

ChatGPT วิเคราะห์วิดีโอได้ไหม?

ได้ ChatGPT (GPT-4o และรุ่นหลัง) วิเคราะห์วิดีโอโดยการสุ่มเฟรม (~1 เฟรมต่อวินาที) และถอดเสียง ทำได้ดีสำหรับสรุปการประชุม อ่านข้อความจากสไลด์ และระบุวัตถุ อย่างไรก็ตาม ยังลำบากกับการติดตามการเคลื่อนไหว วิดีโอเกิน 10 นาที และการสตรีมเรียลไทม์

อัปโหลดวิดีโอให้ ChatGPT อย่างไร?

อัปโหลดผ่าน URL โดยตรง (แนะนำ): อัปโหลดผ่าน URL สาธารณะเพื่อวิเคราะห์อย่างรวดเร็ว เหมาะกับวิดีโอไม่เกิน 10 นาที

สกัดเฟรมด้วยตนเอง: สกัดเฟรมเฉพาะช่วงเพื่อควบคุมอย่างแม่นยำ เหมาะเมื่อคุณต้องการช่วงเวลาที่ต้องวิเคราะห์หรืออยากลดค่าโทเค็น

ความยาววิดีโอสูงสุดที่ ChatGPT จัดการได้คือเท่าไร?

ChatGPT จัดการวิดีโอได้อย่างเชื่อถือประมาณ 5–10 นาที หากยาวกว่านั้นต้องแบ่งเป็นส่วนๆ หรือเปลี่ยนไปใช้ Gemini 2.5 Pro ที่รองรับวิดีโอแบบเนทีฟสูงสุด 60 นาที

ข้อจำกัดการวิเคราะห์วิดีโอของ ChatGPT มีอะไรบ้าง?

- ไม่สามารถติดตามการเคลื่อนไหวต่อเนื่อง (กีฬา เต้น)

- ไทม์สแตมป์คลาดเคลื่อน (±1 วินาที)

- พลาดเนื้อหาที่ปรากฏน้อยกว่า 1 วินาที

- ขีดจำกัดเชิงปฏิบัติ 10 นาที

- ไม่มีการสตรีมเรียลไทม์

- ยากกับวิดีโอคุณภาพต่ำหรือมืด

- อ่อนในการให้เหตุผลเหตุและผลเชิงเวลา *

ควรใช้ ChatGPT หรือ Gemini เพื่อวิเคราะห์วิดีโอ?

ใช้ ChatGPT เมื่อ:

- วิดีโอ < 10 นาที

- ต้องการเหตุผลเชิงข้อความที่เหนือหลังการวิเคราะห์วิดีโอ

- การวิเคราะห์ระดับเฟรม (สไลด์ สกรีนช็อต)

ใช้ Gemini เมื่อ:

- วิดีโอ 10–60 นาที

- ต้องติดตามการเคลื่อนไหวและการเคลื่อนที่

- งานให้เหตุผลเชิงเวลา

- ฟุตเทจกีฬา เต้น หรือกล้องวงจรปิด *

Claude วิเคราะห์วิดีโอได้ไหม?

ไม่ได้ Claude ยังไม่รองรับวิดีโอโดยตรง อย่างไรก็ตาม คุณสามารถสกัดเฟรมจากวิดีโอและให้ Claude วิเคราะห์ ซึ่งโดดเด่นด้านเหตุผลเชิงข้อความและหน้าต่างบริบทยาวสำหรับการวิเคราะห์ยาวๆ

ค่าใช้จ่ายการวิเคราะห์วิดีโอเท่าไร?

ต้นทุนแปรตามโมเดลและความยาววิดีโอ:

- ChatGPT 4o: ประมาณ $0.05 ต่อนาที

- Gemini 2.5 Pro: ประมาณ $0.04 ต่อนาที

CometAPI มีเครดิตสำหรับผู้ใช้ใหม่ในการเริ่มต้นใช้งาน