GLM-5-Turbo เป็นโมเดลพื้นฐาน LLM รุ่นใหม่จาก Zhipu AI ที่ได้รับการฝึกและปรับจูนมาเฉพาะสำหรับเวิร์กโฟลว์สไตล์เอเจนต์ (บริษัทเรียกนิเวศเป้าหมายว่า OpenClaw / สถานการณ์ “lobster”) โดยให้บริบทที่ยาวมาก (สูงสุดราว 200K โทเคน), การสตรีมและผลลัพธ์แบบมีโครงสร้าง, อัตราความผิดพลาดในการเรียกใช้เครื่องมือที่ต่ำกว่า (รายงานราว 0.67% ในการทดสอบโดยบุคคลที่สาม) และราคาต่อโทเคนที่ลดลงอย่างมีนัยสำคัญ โมเดลนี้มุ่งแลกปริมาณงานสูงสุดต่อเทิร์นเดียวเพียงเล็กน้อยเพื่อแลกกับความเสถียรที่ดีกว่าอย่างมาก, ความเชื่อถือได้ของเครื่องมือ, การจัดการงานแบบกำหนดเวลา/คงอยู่ และการดำเนินการแบบสายยาว—มีประโยชน์สำหรับเอเจนต์อัตโนมัติ, ระบบออร์เคสเตรชัน และไปป์ไลน์ที่ใช้หลายเครื่องมือ

GLM-5-Turbo คืออะไร?

GLM-5-Turbo ถูกนำเสนอโดย Zhipu ว่าเป็นโมเดลพื้นฐานที่สร้างขึ้นเพื่อการออร์เคสเตรชันของเอเจนต์และเวิร์กโฟลว์อัตโนมัติที่ซับซ้อน โดยไม่ใช่โมเดลแชตหรือมัลติโหมดทั่วไป ตัวเลือกการออกแบบเน้นไปที่:

- การฝึกแบบเอเจนต์โดยกำเนิด (การใช้เครื่องมือ, การทำตามคำสั่ง, งานแบบกำหนดเวลา/คงอยู่)

- หน้าต่างบริบทที่ใหญ่มากและความสามารถในการสร้างผลลัพธ์จำนวนมาก เพื่อรองรับเซสชันยาว ความจำ และการวางแผนเชิงห่วงโซ่

- อินเฟอเรนซ์ที่เสถียรและมีปริมาณงานสูงสำหรับโฟลว์ธุรกิจยาวและงานที่กำหนดเวลา

แตกต่างจาก LLM แบบดั้งเดิมที่ปรับให้เหมาะกับแชตหรือการสร้างข้อความ GLM-5-Turbo คือ:

- เน้นเอเจนต์เป็นหลัก (ไม่ใช่เน้นแชตเป็นหลัก)

- สร้างขึ้นสำหรับสภาพแวดล้อม OpenClaw (“lobster”)

- ออกแบบมาสำหรับเวิร์กโฟลว์อัตโนมัติหลายขั้นตอน

🦞 “Lobster Agent” หมายถึงอะไร?

แนวคิด “lobster” อ้างถึง OpenClaw นิเวศเอเจนต์ของ Zhipu ที่โมเดลสามารถ:

- ใช้เครื่องมือแบบไดนามิก

- ดำเนินงานเป็นห่วงโซ่งานยาว

- รักษาหน่วยความจำแบบถาวร

- ทำงานข้ามเทอร์มินัล แอป และ API

GLM-5-Turbo ได้รับการปรับให้เหมาะสมอย่างลึกซึ้งกับพาราไดม์นี้ แก้ปัญหาสำคัญของเอเจนต์ เช่น:

- ความน่าเชื่อถือในการเรียกเครื่องมือ

- การแตกงาน

- การวางแผนระยะยาว

- ความเสถียรในการดำเนินการ

คุณสมบัติหลักและเหตุผลที่สำคัญ

บริบทยาว + ความจุผลลัพธ์มหาศาล (200K / 128K)

หน้าต่างบริบท 200K โทเคนและความสามารถในการสร้างผลลัพธ์ 128K ช่วยให้ GLM-5-Turbo สามารถ:

- รักษาความทรงจำของบริบทก่อนหน้า (การสนทนา ผลลัพธ์จากเครื่องมือ ผลลัพธ์ระหว่างทาง)

- สร้างชิ้นงานยาวมาก (แผนหลายช่วง รายงานยาว โค้ดเบส) โดยไม่ต้องคอยเย็บบริบทซ้ำ

- โฮสต์เอเจนต์หลายเทิร์นที่ต้องรักษาประวัติการดำเนินการทั้งหมดเพื่อการตัดสินใจที่แม่นยำ

นี่เป็นทางเลือกทางเทคนิคโดยเจตนาสำหรับเอเจนต์—แทนที่จะแยกงานเป็นพรอมต์สั้น ๆ เอเจนต์สามารถรักษาสถานะที่สอดคล้องกันตลอดหลายพันเทิร์นหรือขั้นตอนของการสนทนา

องค์ประกอบพื้นฐานของเอเจนต์ฝังอยู่ในการฝึก

แทนที่จะนำโมเดลอเนกประสงค์ทั่วไปมาปรับให้เข้ากับงานเอเจนต์ GLM-5-Turbo ถูกฝึกด้วยวัตถุประสงค์สไตล์เอเจนต์ (เช่น พฤติกรรมการเรียกเครื่องมือ การแยกคำสั่ง/อาร์กิวเมนต์) ผลที่อ้างว่าทำให้เกิด อาการหลอนระหว่างการเรียกเครื่องมือน้อยลง แผนหลายขั้นตอนเสถียรขึ้น และเวลาแฝงดีขึ้นเมื่อรันยาว—ซึ่งล้วนมีค่าสำหรับการทำออโตเมชันที่ต้องเชื่อม API หรือเครื่องมือภายนอกจำนวนมากอย่างเชื่อถือได้

ปริมาณงานและความเสถียรในการดำเนินการ

GLM-5-Turbo variant ปรับปรุงความเสถียรในการดำเนินการและปริมาณงานสำหรับโฟลว์ธุรกิจยาวเมื่อเทียบกับโมเดลใหญ่ทั่วไป—ภาษาการตลาดเน้น “การดำเนินการที่มีปริมาณงานสูง” และ “ความเสถียรของการตอบสนองชั้นนำ” ในกลุ่มโมเดลใกล้เคียง เหล่านี้มีความหมายต่อการปรับใช้เอเจนต์ระดับองค์กรที่ขั้นตอนล้มเหลวขั้นตอนเดียวสามารถทำให้ไปป์ไลน์ทั้งชุดล่มได้ บททดสอบโดยบุคคลที่สามอิสระยังอยู่ระหว่างการทยอยเผยแพร่

ข้อมูล Benchmark ของ GLM-5-Turbo

หมายเหตุ: Zhipu ได้เผยแพร่การประเมินภายใน และมีเบนช์มาร์กโดยบุคคลที่สาม/สถาบันสำหรับ GLM-5 แล้ว ส่วน GLM-5-Turbo เพิ่งเปิดตัว; เบนช์มาร์กจากชุมชนอิสระจะทยอยปรากฏตามมา ด้านล่างคือค่าที่เผยแพร่และน่าเชื่อถือที่สุดพร้อมบริบทประกอบ

GLM-5 (อ้างอิง) — ตัวเลขที่เผยแพร่เป็นตัวแทน

GLM-5 (รุ่นธงก่อนหน้า Turbo) ของ Zhipu รายงานผลนำในหลายงานด้านวิศวกรรม/เวิร์กโฟลว์—เช่น:

- SWE-bench Verified: 77.8 (รายงานในเอกสาร GLM-5 ว่าเป็นคะแนนชั้นนำในหมวดโมเดลเปิด)

- Terminal Bench 2.0: 56.2 (รายงานว่าเป็นผลงานสูงสุดในกลุ่มโมเดลเปิดบนชุดทดสอบที่กำหนด)

ตัวเลขเหล่านี้ยืนยัน GLM-5 ว่าเป็นฐานที่แข็งแกร่งในงานวิศวกรรมซอฟต์แวร์และการดำเนินการ; GLM-5-Turbo ถูกวางตำแหน่งให้แลก “ความใหญ่/จำนวนพารามิเตอร์” บางส่วนเพื่อความเชื่อถือได้ของเอเจนต์และปริมาณงานที่ดีกว่า ในการทดสอบเปรียบเทียบ GLM-5-Turbo แสดง อัตราความผิดพลาดในการเรียกเครื่องมือราว 0.67% ต่ำกว่าการรัน GLM-5 เปรียบเทียบที่อยู่ในช่วง ราว 2.33% ถึง 6.41%

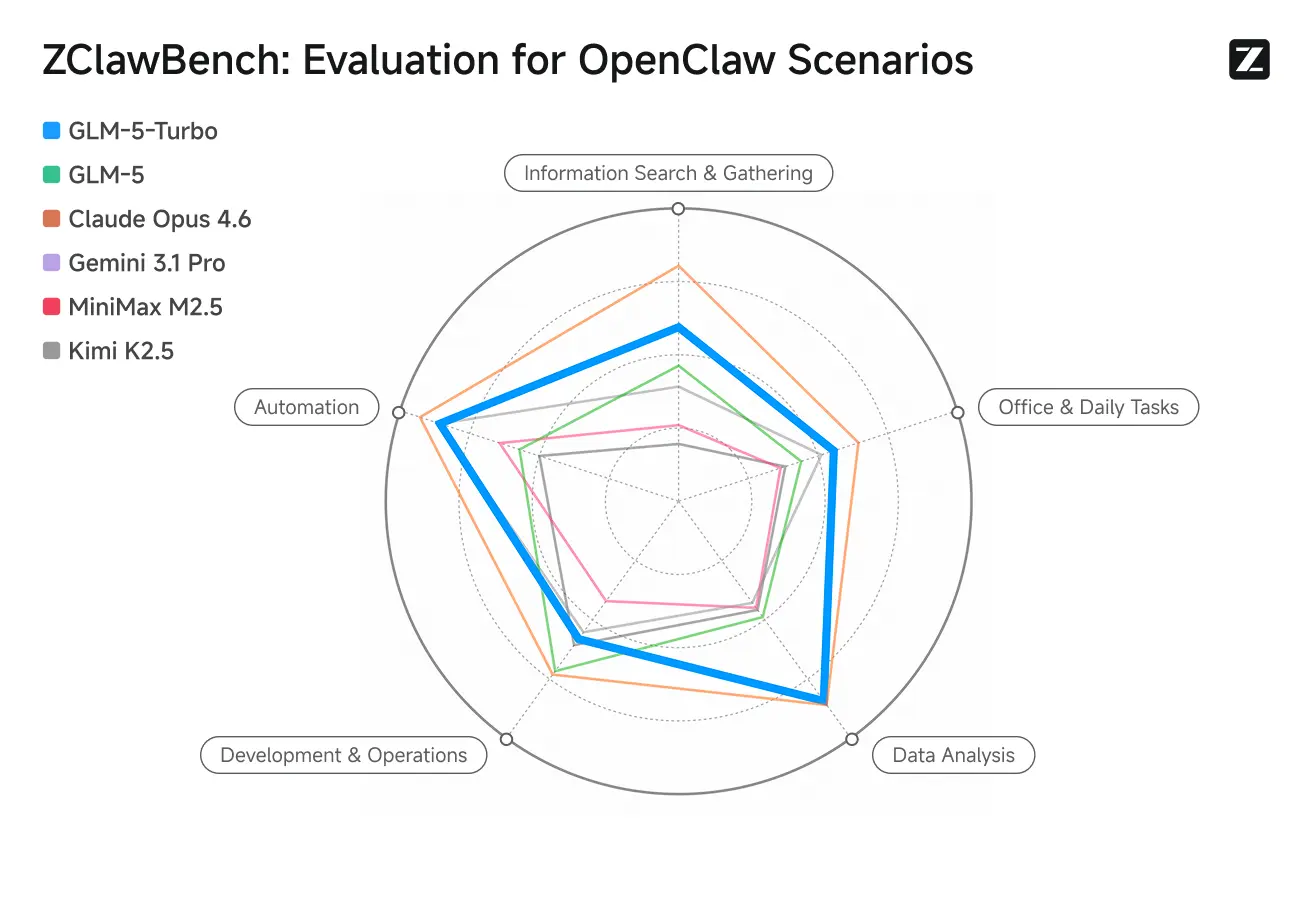

ZClawBench: Benchmark Test สำหรับสถานการณ์พร็อกซีของ OpenClaw

Zhipu ยังได้เผยแพร่เบนช์มาร์ก ZClawBench เพื่อประเมินเอเจนต์อัจฉริยะ ในการทดสอบแบบ blind ครอบคลุมสาขาหลากหลาย เช่น การพัฒนาโค้ด การวิเคราะห์ข้อมูล และการสร้างคอนเทนต์ โมเดลใหม่โค้ดเนม Pony-Alpha-2 ได้รับการโหวตจากผู้ตอบแบบสอบถาม 90%

ราคาและความพร้อมใช้งาน (ใครขายและราคาเท่าไร)

Zhipu ปรับขึ้นราคา API สำหรับ GLM-5-Turbo ราว 20% เมื่อเปิดตัว และเปิดตัวแพ็กเกจสมัครสมาชิก “Lobster Package” เพื่อช่วยปรับความคุ้มค่าราคาต่อโทเคนสำหรับการปรับใช้เอเจนต์

ระดับสมัครสมาชิกที่รายงาน (แพ็กเกจตัวอย่าง)

แพ็กเกจ Lobster ตัวอย่างสองแบบ (ราคาคืออัตราแปลงโดยประมาณ):

- แผน Entry Lobster: ราว 39 CNY / เดือน (ราว US$5.66) สำหรับ 35,000,000 โทเคน

- แผน Mid Lobster: ราว 99 CNY / เดือน (ราว US$14.36) สำหรับ 100,000,000 โทเคน

จากตัวเลขที่เผยแพร่ ค่าใช้จ่ายต่อ 1 ล้าน โทเคนประมาณ:

- แผน Entry: ราว US$0.162 ต่อ 1M โทเคน

- แผน Mid: ราว US$0.144 ต่อ 1M โทเคน

ตัวเลขต่อ 1M ข้างต้นคือนำค่าใช้จ่ายสมัครสมาชิกและเพดานโทเคนมาคำนวณตรง ๆ เพื่อให้เห็นเศรษฐศาสตร์สำหรับงานเอเจนต์ปริมาณสูง (คำนวณจากสกุลเงินและปริมาณโทเคนตามรายงานข่าว)

ราคา API

รายการในมาร์เก็ตเพลสตัวอย่าง (CometAPI): $0.96 ต่อ 1M โทเคนขาเข้า และ $3.20 ต่อ 1M โทเคนขาออก สำหรับ GLM-5-Turbo

หน้าราคาสำหรับนักพัฒนาบนเว็บไซต์ของ Zhipu (Z.ai) ระบุอัตราตรงที่สูงกว่าเล็กน้อยสำหรับ GLM-5-Turbo: $1.20 ต่อ 1M โทเคนขาเข้า และ $4.00 ต่อ 1M โทเคนขาออก (อัตราขาเข้าที่แคชไว้ต่ำกว่า)

GLM-5-Turbo vs GLM-5 — เปรียบเทียบเคียงข้าง

ในภาพรวม:

- GLM-5 = โมเดลพื้นฐานอเนกประสงค์รุ่นธง (เหตุผล โค้ดดิ้ง เบนช์มาร์กแข็งแกร่ง)

- GLM-5-Turbo = เวอร์ชัน ปรับให้เหมาะกับเอเจนต์ ของ GLM-5 (โฟกัสเวิร์กโฟลว์ยาว การใช้เครื่องมือ ความเสถียร)

GLM-5-Turbo ไม่ใช่สถาปัตยกรรมโมเดลใหม่ทั้งหมด แต่เป็น เวอร์ชันพิเศษที่ปรับให้พร้อมใช้งานจริงของ GLM-5 ออกแบบมาสำหรับระบบเอเจนต์อย่าง OpenClaw

การวางตำแหน่งหลัก

| Model | Positioning |

|---|---|

| GLM-5 | โมเดลพื้นฐานอเนกประสงค์รุ่นธง (เหตุผล โค้ดดิ้ง เบนช์มาร์กแข็งแกร่ง) |

| GLM-5-Turbo | โมเดลที่เน้นเอเจนต์เป็นหลัก (ออโตเมชัน ออร์เคสเตรชัน การใช้เครื่องมือ) |

👉 โดยสรุปง่าย ๆ:

- ใช้ GLM-5 → เมื่อต้องการ ความฉลาดสูงสุด

- ใช้ GLM-5-Turbo → เมื่อต้องการ ออโตเมชัน/เอเจนต์ที่เสถียร

การเปรียบเทียบความสามารถด้านเอเจนต์ (สำคัญที่สุด)

GLM-5 (ความสามารถด้านเอเจนต์) รองรับแล้ว:

- การใช้เครื่องมือ

- การให้เหตุผลหลายขั้นตอน

- เอเจนต์สำหรับการเขียนโค้ด

แต่มีข้อจำกัด:

- อาจสูญเสียบริบทในห่วงโซ่งานยาว

- การเรียกเครื่องมืออาจเสื่อมลงเมื่อเวลาผ่านไป

- ต้องการตรรกะออร์เคสเตรชันมากกว่า

GLM-5-Turbo ถูกปรับแต่งเฉพาะสำหรับเอเจนต์:

การปรับปรุงสำคัญ:

- ความน่าเชื่อถือในการเรียกเครื่องมือ ↑

- การแตกงาน (การวางแผน) ↑

- ความสอดคล้องของห่วงโซ่งานยาว ↑

- การรองรับการดำเนินการแบบคงอยู่ ↑

ตัวอย่างการปรับปรุง:

- ดำเนินการได้เสถียรต่อเนื่องมากกว่า 10+ ขั้นตอน โดยไม่สูญเสียบริบท

👉 สิ่งนี้สำคัญต่อ:

- ระบบสไตล์ AutoGPT

- เวิร์กโฟลว์แบบหลายเอเจนต์

- ออโตเมชันสำหรับ SaaS

ความเร็วและประสิทธิภาพ

| Aspect | GLM-5 | GLM-5-Turbo |

|---|---|---|

| ความเร็วอินเฟอเรนซ์ | ปานกลาง | เร็วกว่า |

| ปริมาณงาน | มาตรฐาน | สูงกว่า |

| เวลาแฝงงานยาว | อาจเสื่อมลง | ปรับให้เหมาะสม |

GLM-5-Turbo ถูกออกแบบมาเพื่อแก้ “ปัญหาอุตสาหกรรมจริง”:

โมเดลใหญ่ช้าลงหรือแตกพังระหว่างเวิร์กโฟลว์ยาว

การเปรียบเทียบราคา

| Model | Input ($/1M tokens) | Output ($/1M tokens) |

|---|---|---|

| GLM-5 | ราว $1.00 | ราว $3.20 |

| GLM-5-Turbo | ราว $1.20 | ราว $4.00 |

👉 GLM-5-Turbo แพงกว่า (ราว 20% สูงกว่า)

ทำไมแพงกว่า?

เพราะให้:

- ความน่าเชื่อถือของออร์เคสเตรชันที่ดีกว่า

- ความเสถียรในการผลิตที่สูงกว่า

- การปรับเฉพาะสำหรับเอเจนต์

👉 ในระดับองค์กร:

- คุณจ่าย มากขึ้นต่อโทเคน

- แต่ลด ต้นทุนความล้มเหลว + การเรียกซ้ำ

| Attribute | GLM-5 | GLM-5-Turbo |

|---|---|---|

| เป้าหมายหลัก | โมเดลพื้นฐานรุ่นธงอเนกประสงค์ (ความสามารถกว้าง โค้ดดิ้ง/เบนช์มาร์กแข็งแกร่ง) | โมเดลพื้นฐานที่ปรับให้เหมาะกับเอเจนต์/“OpenClaw” / lobster |

| หน้าต่างบริบท | (รายงานว่าสูง; GLM-5 เน้นราว 200K (GLM-5 ก็รองรับบริบทยาว)) | 200,000 โทเคน (ระบุไว้ชัดเจน) |

| โทเคนผลลัพธ์สูงสุด | (ใหญ่ ขึ้นกับรุ่น) | 128,000 โทเคน (มีเอกสารระบุ) |

| คะแนนเบนช์มาร์กเด่น | SWE-bench: 77.8; Terminal Bench 2.0: 56.2 (ตัวเลขที่ GLM-5 รายงาน) | การประเมินภายในอ้างว่าเสถียรภาพห่วงโซ่งานยาวและปริมาณงานดีขึ้นสำหรับเวิร์กโฟลว์เอเจนต์; เบนช์มาร์กสาธารณะอิสระยังรอติดตาม |

| โมดัลลิตี | ข้อความ (หลัก) ตระกูล GLM มีรุ่น vision ในโมเดลพี่น้อง | ข้อความเท่านั้น (ตามเอกสาร) — ปรับเพื่อเอเจนต์ที่ใช้เครื่องมือ |

| กรณีใช้งานแนะนำ | กว้าง: แชต โค้ด เหตุผล คอนเทนต์ | การออร์เคสเตรชันเอเจนต์ การเรียกเครื่องมือ ออโตเมชันระยะยาว |

| การตั้งราคา | ราคาที่มีอยู่ของ GLM-5 (แตกต่างตามแผน) | เปิดตัวใหม่ — รายงานขึ้นราคา API ราว 20%; เปิดตัวระดับสมัคร Lobster ใหม่ |

วิธีใช้งาน GLM-5-Turbo

CometAPI — เข้าถึงหลายโมเดลผ่าน API เดียว (เข้ากันได้กับ OpenAI)

CometAPI ระบุว่า GLM-5-Turbo พร้อมใช้งานและมี base URL/SDK ที่เข้ากันได้กับ OpenAI ให้ใช้สตริงโมเดลตามที่เผยแพร่ (ในเว็บไซต์พวกเขาระบุ GLM-5-Turbo ที่ราคาใกล้เคียงกัน) ตัวอย่างจากเอกสาร CometAPI:

curl (CometAPI):

curl -X POST "https://api.cometapi.com/v1/chat/completions" \ -H "Authorization: Bearer YOUR_COMETAPI_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "z-glm-5-turbo", // or use the exact model slug shown in CometAPI UI "messages": [{"role":"user","content":"Create a 5-step checklist for onboarding a new hire."}], "max_tokens": 800 }'

คุณค่าของ CometAPI คือความสะดวกในการเป็นตัวรวม (aggregator) เพียงครั้งเดียวสำหรับหลายโมเดล ตรวจสอบสลักชื่อโมเดลที่แน่นอนในแดชบอร์ด CometAPI ก่อนเรียกใช้งาน

แนวทางปฏิบัติที่ดีเมื่อสร้างเอเจนต์ Lobster / OpenClaw ด้วย GLM-5-Turbo

- ออกแบบเพื่อความเชื่อถือได้ ไม่ใช่เพื่อเวลาเริ่มตอบที่ต่ำสุด: ข้อได้เปรียบของ Turbo คืออัตราความล้มเหลวในการเรียกเครื่องมือที่ต่ำลงในห่วงโซ่งานยาว จัดโครงสร้างการรันเอเจนต์ให้ให้ความสำคัญกับความทนทาน (รีทราย, การเรียกเครื่องมือที่ idempotent) มากกว่ากำไรเล็กน้อยของโทเคนแรก

- ใช้สตรีมมิงและการเรียกเครื่องมือแบบเพิ่มทีละส่วน: ใช้สตรีมมิง/เอาต์พุตแบบแบ่งชิ้นเพื่อลดการทำงานซ้ำ และอนุญาตให้เรียกเครื่องมือเร็วขึ้นเมื่อเหมาะสม GLM-5-Turbo รองรับสตรีมมิง

- เอาต์พุตแบบมีโครงสร้างสำหรับตัวแยก: ให้ผลลัพธ์เป็น JSON หรือรูปแบบที่จัดระเบียบเพื่อการพาร์สแบบกำหนดได้ในเครื่องมือปลายทาง Turbo รองรับเอาต์พุตแบบมีโครงสร้าง

- วางแผนสำหรับงานที่กำหนดเวลา/คงอยู่: หากเอเจนต์ของคุณต้องตรวจสอบเป็นระยะหรือทำงานเบื้องหลัง ให้ใช้ความสามารถด้านเวลาและแคชของ Turbo เพื่อหลีกเลี่ยงการวางแผนซ้ำในทุกวัฏจักร

- ติดตามการเรียกเครื่องมือและเตรียมทางเลือก: บันทึกการเรียกเครื่องมือและออกแบบการล้มอย่างนุ่มนวล (เช่น รีทรายพร้อมปรับอุณหภูมิเล็กน้อย หรือเรียกใช้เครื่องมือสำรอง) เพราะเวิร์กโฟลว์แบบเอเจนต์มักเปราะบางเมื่อ API ภายนอกรายการหนึ่งล้มเหลว Turbo ลดอัตราความผิดพลาดแต่ไม่สามารถกำจัดความล้มเหลวภายนอกได้

นักพัฒนาสามารถเข้าถึง GLM-5 และ GLM-5 turbo API ผ่าน CometAPI ได้แล้วตอนนี้ เพื่อเริ่มต้น โปรดดู API guide สำหรับคำแนะนำโดยละเอียด ก่อนเข้าถึง โปรดตรวจสอบว่าคุณได้ล็อกอิน CometAPI และได้รับคีย์ API แล้ว CometAPI มีราคาต่ำกว่าราคาทางการอย่างมากเพื่อช่วยให้คุณผสานรวมได้ง่ายขึ้น

พร้อมลุยหรือยัง?→ Sign up fo GLM-5 and GLM-5 turbo today !