Gemini CLI คือเอเจนต์ AI แบบบรรทัดคำสั่งโอเพนซอร์สของ Google ที่นำพลังของ Gemini 2.5 Pro มาสู่เทอร์มินัลของคุณโดยตรง เปิดตัวเมื่อวันที่ 25 มิถุนายน 2025 เปิดโอกาสให้นักพัฒนาเข้าถึงความสามารถ AI ขั้นสูงได้ฟรี ไม่ว่าจะเป็นการสร้างโค้ด การสร้างเนื้อหา การทำงานอัตโนมัติ และอื่นๆ อีกมากมาย ผ่านคำสั่งภาษาธรรมชาติ Gemini CLI มีขีดจำกัดการใช้งานที่กว้างขวาง (60 คำขอโมเดลต่อนาที, 1,000 คำขอต่อวัน) ภายใต้ใบอนุญาต Gemini Code Assist ฟรี และรองรับระบบปฏิบัติการ Windows, macOS และ Linux Gemini CLI จึงเปลี่ยนเทอร์มินัลให้กลายเป็นพื้นที่ทำงานที่ขับเคลื่อนด้วย AI

Gemini CLI คืออะไร?

Gemini CLI คืออินเทอร์เฟซบรรทัดคำสั่งแบบโอเพนซอร์สที่เปิดตัวโดย Google ซึ่งนำประสิทธิภาพของ Gemini 2.5 Pro มาสู่เทอร์มินัลของนักพัฒนาโดยตรง เปิดตัวในเวอร์ชันพรีวิวเมื่อวันที่ 25 มิถุนายน 2025 ช่วยให้สามารถใช้งานเวิร์กโฟลว์ที่ขับเคลื่อนด้วย AI ได้ ตั้งแต่การสร้างโค้ดและการดีบัก ไปจนถึงการสร้างเนื้อหาและการร้องขอแบบหลายโหมด โดยไม่ต้องออกจากเชลล์ Gemini CLI เปลี่ยนเทอร์มินัลให้เป็นพื้นที่ทำงานที่เน้น AI เป็นหลัก ด้วยการแสดงพรอมต์ภาษาธรรมชาติ การเรียกใช้ฟังก์ชัน และเครื่องมือที่ผสานรวม เช่น Google Search และ Model Context Protocol (MCP) Gemini CLI จึงเปลี่ยนเทอร์มินัลให้เป็นพื้นที่ทำงานที่เน้น AI เป็นหลัก ลดการสลับบริบทและปรับปรุงขั้นตอนการพัฒนาให้มีประสิทธิภาพยิ่งขึ้น

Gemini CLI มีฟีเจอร์หลักอะไรบ้าง?

- การกระตุ้นด้วยภาษาธรรมชาติ: ออกคำสั่งข้อความง่ายๆ (เช่น

gemini run "Generate a REST API in Go.") เพื่อรับรหัส สรุป หรือข้อมูลเชิงลึกจากการวิจัย - การเรียกใช้ฟังก์ชันและการใช้เครื่องมือ:ใช้ประโยชน์จากการค้นหาของ Google เครื่องมือการดำเนินการโค้ด หรือฟังก์ชันที่กำหนดเองภายในคำเตือนเพื่อดึงข้อมูลแบบเรียลไทม์หรือดำเนินการงานที่ซับซ้อน

- การสนับสนุนหลายโหมด:เรียกใช้โมเดล Veo และ Imagen แบบอินไลน์เพื่อขอให้สร้างภาพหรือวิดีโอโดยตรงจาก CLI

- หน้าต่างบริบทขนาดใหญ่:โทเค็นสูงสุด 10,000 รายการสำหรับการประมวลผลฐานโค้ดขนาดใหญ่หรือเอกสารยาว

ความสามารถเหล่านี้ทำให้ Gemini CLI เป็นเครื่องมือเชิงกลยุทธ์สำหรับนักพัฒนาที่กำลังมองหาประสบการณ์เทอร์มินัลที่ขับเคลื่อนด้วย AI โดยไม่มีค่าใช้จ่ายในการจัดการการเข้าสู่ระบบคอนโซลบนคลาวด์หรือการติดตั้ง SDK

CometAPI ช่วยปรับปรุงประสบการณ์ Gemini CLI ได้อย่างไร

CometAPI คืออินเทอร์เฟซ REST แบบรวมศูนย์ที่รวบรวมโมเดล AI หลายร้อยโมเดล เช่น Google Gemini, ซีรีส์ GPT ของ OpenAI, Claude ของ Anthropic และอื่นๆ ไว้ภายใต้จุดสิ้นสุดเดียว พร้อมระบบจัดการคีย์ API ในตัว โควตาการใช้งาน และแดชบอร์ดการเรียกเก็บเงิน () การรวม Gemini CLI เข้ากับ CometAPI ช่วยให้นักพัฒนาสามารถเข้าถึงโมเดล Gemini ได้โดยไม่ขึ้นอยู่กับผู้ขาย โดยไม่ต้องสลับข้อมูลประจำตัวหรือจุดสิ้นสุดหลายรายการ

ข้อดีหลักในการใช้ CometAPI ร่วมกับ Gemini CLI ได้แก่:

- การจัดการจุดสิ้นสุดแบบง่าย:แทนที่จะชี้ CLI ไปที่ URL API เริ่มต้นของ Google คุณสามารถกำหนดค่าให้ใช้ URL พื้นฐานของ CometAPI ผ่านตัวแปรสภาพแวดล้อม โดยจะรวมการรับส่งข้อมูล AI ทั้งหมดไว้ผ่านอินเทอร์เฟซเดียว

- การเรียกเก็บเงินและโควตาแบบรวม:CometAPI นำเสนอราคาที่มีการแข่งขันกัน ซึ่งมักจะต่ำกว่าราคาอย่างเป็นทางการของ Google และยังมีแดชบอร์ดแบบรวมเพื่อติดตามการใช้งานใน Gemini, Claude, GPT และอื่นๆ อีกด้วย จึงขจัดปัญหาการเรียกเก็บเงินที่ซ้ำซ้อน

- การสลับโมเดลแบบไร้รอยต่อ:ด้วย CometAPI การสลับระหว่างผู้ให้บริการโมเดลที่แตกต่างกันเป็นเรื่องง่ายเหมือนกับการเปลี่ยนพารามิเตอร์โมเดลในคำขอของคุณ ช่วยให้การทดลองรวดเร็วขึ้นและควบคุมต้นทุนได้

การใช้ประโยชน์จาก CometAPI ช่วยให้ทีมงานสามารถคล่องตัว ไม่ขึ้นอยู่กับผู้จำหน่าย และคุ้มต้นทุนได้ ขณะเดียวกันก็ยังคงพลังเต็มรูปแบบของ Gemini CLI ไว้ในเทอร์มินัลของตน

ฉันจะติดตั้ง Gemini CLI ได้อย่างไร?

เบื้องต้น

ก่อนการติดตั้ง โปรดตรวจสอบให้แน่ใจว่าระบบของคุณตรงตามข้อกำหนดต่อไปนี้:

- ระบบปฏิบัติการที่รองรับ (Windows 10/11, macOS 10.15+, Ubuntu 20.04+ หรือ Debian 10+)

- Node.js v20 หรือสูงกว่า (หรือ v18+ สำหรับฟังก์ชันพื้นฐาน)

- NPM (Node Package Manager) ติดตั้งควบคู่ไปกับ Node.js

- A สถานีปลายทาง สภาพแวดล้อมบน Linux, macOS หรือ Windows (PowerShell, WSL หรือ Bash ดั้งเดิม)

ตรวจสอบเวอร์ชัน Node.js ของคุณ:

node -v

หากส่งคืนเวอร์ชันต่ำกว่า 18 ให้อัปเกรดผ่านตัวจัดการแพ็คเกจของคุณ (เช่น sudo apt install nodejs npm บน Ubuntu)

วิธีการติดตั้ง

คุณมี 3 ตัวเลือกหลักในการติดตั้ง Gemini CLI:

- การติดตั้งทั่วโลกผ่าน npm

npm install -g @google/gemini-cli

การติดตั้งทั่วโลกนี้ทำให้ gemini คำสั่งนี้ใช้ได้ทั่วทั้งระบบ อย่างไรก็ตาม การติดตั้งแบบทั่วโลกอาจทำให้เกิดความขัดแย้งของเวอร์ชันและต้องได้รับสิทธิ์ระดับสูง

- การดำเนินการครั้งเดียวผ่าน npx

npx https://github.com/google-gemini/gemini-cli

การดำเนินการนี้จะรัน CLI โดยไม่ต้องติดตั้งถาวร เหมาะสำหรับการทดลองใช้งานแบบด่วนหรือสภาพแวดล้อมชั่วคราว

เมื่อติดตั้งแล้วให้ตรวจสอบโดยรัน:

gemini --version

ฉันจะตรวจสอบสิทธิ์ Gemini CLI ด้วย CometAPI ได้อย่างไร

การตรวจสอบสิทธิ์ช่วยให้มั่นใจได้ว่าเซสชัน CLI ของคุณเชื่อมโยงกับบัญชี CometAPI อย่างปลอดภัย ช่วยให้สามารถจัดการการเรียกเก็บเงินและโควต้าแบบรวมศูนย์ในทุกโมเดล CometAPI รวบรวม Google Gemini เข้ากับผู้ให้บริการรายอื่น ๆ อีกหลายสิบราย ซึ่งหมายความว่าคีย์ API เพียงตัวเดียวสามารถปลดล็อกแบ็กเอนด์ AI หลายตัวได้

ฉันจะรับรหัส CometAPI ได้อย่างไร

- ลงทะเบียนหรือเข้าสู่ระบบ at โคเมตาปิดอทคอม และไปที่ส่วน “โทเค็น API” ในแดชบอร์ดของคุณ

- สร้างโทเค็นใหม่ โดยการคลิก “เพิ่มโทเค็น” คัดลอกคีย์ผลลัพธ์ (เช่น

sk-xxxxxxxxxxxx) และจัดเก็บไว้ในห้องนิรภัยที่ปลอดภัย

ฉันจะเชื่อมโยงคีย์กับ Gemini CLI ได้อย่างไร

หลังจากติดตั้งแล้วให้เรียกใช้:

gemini login

คำสั่งนี้จะนำคุณไปที่โฟลว์ OAuth ของ Google ในเบราว์เซอร์ของคุณ

การใช้งาน Gemini CLI กับ https://api.cometapi.comคุณจะต้องมีข้อมูลสำคัญสองส่วน:

**รหัส API (GEMINI_API_KEY)**นี่คือรหัสการเข้าถึงส่วนตัวของคุณที่ได้รับหลังจากลงทะเบียนบน api.cometapi.com แพลตฟอร์ม (โดยปกติจะเริ่มต้นด้วย sk-).

**จุดสิ้นสุด API (GOOGLE_GEMINI_BASE_URL)**นี่คือที่อยู่จุดสิ้นสุดบริการ API ของเรา ซึ่งได้รับการแก้ไขที่ https://api.cometapi.com.

# Navigate to your project folder

cd your-project-folder

# Set environment variables (replace YOUR_API_KEY with your actual key) export GEMINI_API_KEY=YOUR_API_KEY export GOOGLE_GEMINI_BASE_URL="https://www.cometapi.com/console/"

- CLI จะเปิดหน้าต่างเบราว์เซอร์เพื่อแจ้งให้คุณวางโทเค็น CometAPI ของคุณ

- หลังจากการตรวจสอบสิทธิ์สำเร็จแล้ว ไฟล์การกำหนดค่าภายในเครื่อง (

~/.gemini/config.json) จัดเก็บข้อมูลประจำตัวของคุณและข้อมูลทั้งหมดที่ตามมาgemini runคำสั่งกำหนดเส้นทางผ่านจุดสิ้นสุดเกตเวย์รวมของ CometAPI (https://api.cometapi.com)

ฉันจะรัน Gemini CLI ผ่าน CometAPI ได้อย่างไร

การเปิดตัวครั้งแรกและการเลือกธีม

หลังจากกำหนดค่าแล้ว ให้เปิด CLI โดยพิมพ์เพียง:

gemini

ในการรันครั้งแรก Gemini CLI จะแจ้งให้คุณเลือกธีมสี (Default, Dark, Solarized ฯลฯ) สำหรับเซสชันแบบอินเทอร์แอคทีฟ ขั้นตอนนี้จะเกิดขึ้นเพียงครั้งเดียวต่อการติดตั้งหนึ่งครั้ง

ขั้นตอนการตรวจสอบสิทธิ์

If GEMINI_KEY และ GEMINI_BASE_URL ถูกตั้งค่าไว้ CLI จะทำการตรวจสอบสิทธิ์โดยอัตโนมัติผ่านส่วนหัว โดยหลีกเลี่ยงการเข้าสู่ระบบแบบโต้ตอบ

การยืนยันตัวตนสำเร็จจะได้รับการยืนยันด้วยข้อความ “เข้าสู่ระบบในฐานะ…” พร้อมกับโควตาการใช้งานปัจจุบันของคุณ

การตรวจสอบการเชื่อมต่อ

ทดสอบการตั้งค่าของคุณโดยออกคำเตือนง่ายๆ:

gemini "Explain the difference between REST and GraphQL"

คุณควรได้รับการตอบสนองที่สร้างโดย AI ซึ่งดึงผ่านเกตเวย์ของ CometAPI ซึ่งแสดงให้เห็นว่าทั้งการแทนที่จุดสิ้นสุดและการจัดการคีย์ได้รับการกำหนดค่าอย่างถูกต้อง

ฉันจะรวม Gemini CLI เข้ากับเวิร์กโฟลว์การพัฒนาของฉันได้อย่างไร

กรณีการใช้งานทั่วไปมีอะไรบ้าง?

- การสร้างโค้ดและการรีแฟกเตอร์:สร้างโครงร่างโครงการ ปรับโครงสร้างฟังก์ชันใหม่ หรือสร้างการทดสอบยูนิตได้อย่างรวดเร็ว

- คำอธิบายข้อผิดพลาด:วางการติดตามข้อผิดพลาดและขอให้ AI วินิจฉัย

- เอกสารประกอบและความคิดเห็น: สร้าง docstrings หรือส่วน README ของมาร์กดาวน์โดยอัตโนมัติ

- เชลล์ ออโตเมชั่น:แปลงงานภาษาธรรมชาติเป็นคำสั่งเชลล์ (เช่น "บีบอัดโฟลเดอร์นี้ลงใน tar.gz และอัปโหลดไปยัง S3")

ฉันสามารถเขียนสคริปต์ Gemini CLI ใน CI/CD ได้หรือไม่?

แน่นอน เนื่องจาก Gemini CLI ส่งคืนผลลัพธ์เป็น JSON หรือข้อความธรรมดา คุณจึงสามารถเขียนสคริปต์พร้อมต์ในสคริปต์เชลล์ได้:

gemini --non-interactive "Optimize this Dockerfile for production" > optimized.Dockerfile

การดำเนินการนี้จะเปิดใช้งานการเพิ่มประสิทธิภาพที่ขับเคลื่อนด้วย AI ให้เป็นส่วนหนึ่งของขั้นตอนการสร้างของคุณ

Model Context Protocol (MCP) ทำงานอย่างไร?

MCP ช่วยให้ Gemini CLI สามารถดึงข้อมูลเว็บแบบเรียลไทม์ได้ ตัวอย่างเช่น หากต้องการสืบค้นผลการแข่งขันกีฬาสดหรือราคาหุ้น ให้ใช้:

gemini --mcp "What’s the current stock price of GOOGL?"

แนวทางแบบผสมผสานนี้ผสมผสานการใช้เหตุผลทางภาษาเข้ากับแหล่งข้อมูลภายนอก

ฉันสามารถสลับโมเดลได้ทันทีหรือไม่?

ใช่—ใช้ --model ธงให้เลือกระหว่าง gemini-2.5-pro, gemini-2.0-baseหรือรูปแบบอื่นๆ ในอนาคต ความยืดหยุ่นนี้ช่วยให้คุณปรับความเร็ว ต้นทุน หรือขนาดบริบทให้เหมาะสม:

gemini --model gemini-2.0-base "Summarize this file."

แนวทางปฏิบัติที่ดีที่สุดและเคล็ดลับสำหรับการใช้ Gemini CLI ผ่าน CometAPI

1. รันคำสั่งต่อไปนี้

พวกเขาจะผนวกการกำหนดค่าโดยอัตโนมัติ ~/.bash_profile, ~/.bashrc (สำหรับ Bash) และ ~/.zshrc (สำหรับ Zsh)

# Write your API Key to the config files (replace YOUR_API_KEY with your actual key)

echo -e '\nexport GEMINI_API_KEY="YOUR_API_KEY"' >> ~/.bash_profile

echo -e '\nexport GOOGLE_GEMINI_BASE_URL="https://www.cometapi.com/console/"' >> ~/.bash_profile

echo -e '\nexport GEMINI_API_KEY="YOUR_API_KEY"' >> ~/.bashrc

echo -e '\nexport GOOGLE_GEMINI_BASE_URL="https://www.cometapi.com/console/"' >> ~/.bashrc

echo -e '\nexport GEMINI_API_KEY="YOUR_API_KEY"' >> ~/.zshrc

echo -e '\nexport GOOGLE_GEMINI_BASE_URL="https://www.cometapi.com/console/"' >> ~/.zshrc

2. ใช้หลังจากรีสตาร์ทเทอร์มินัล

คุณต้องปิดและเปิดเทอร์มินัลของคุณใหม่ทั้งหมด เพื่อให้การเปลี่ยนแปลงมีผล หลังจากนั้น คุณสามารถนำทางไปยังไดเรกทอรีโครงการของคุณและรัน gemini.

cd your-project-folder

gemini

3.จะเกิดอะไรขึ้นหากการตรวจสอบสิทธิ์ล้มเหลว?

โทเค็น OAuth อาจหมดอายุหรือเสียหายได้ เรียกใช้ซ้ำ:

gemini logout && gemini login

4. ความหน่วงและประสิทธิภาพเป็นอย่างไรบ้าง?

- เลือกรุ่นที่เหมาะสม: สำหรับการแชทแบบเบาๆ หรือการสรุปงาน ให้เลือก

gemini-2.5-flash-lite-preview-06-17สำหรับการตอบสนองในเวลาต่ำกว่า 200 มิลลิวินาทีด้วยต้นทุนต่ำกว่า - คำขอแบบแบตช์:เมื่อประมวลผลชุดข้อมูลขนาดใหญ่ ให้รวมคำเตือนเป็นการเรียกที่น้อยลงแต่ใหญ่ขึ้นเพื่อลดค่าใช้จ่าย HTTP และเวลาแฝงต่อคำขอ

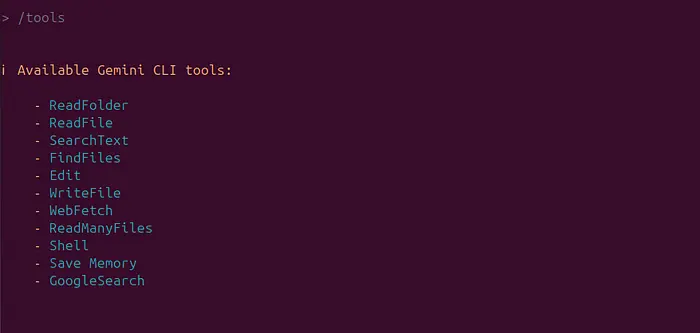

5.Gemini CLI มีเครื่องมือในตัวที่มีประโยชน์บางอย่าง

คุณสามารถใช้คำสั่งเช่น:

เริ่มต้นใช้งาน

CometAPI เป็นแพลตฟอร์ม API แบบรวมที่รวบรวมโมเดล AI มากกว่า 500 โมเดลจากผู้ให้บริการชั้นนำ เช่น ซีรีส์ GPT ของ OpenAI, Gemini ของ Google, Claude ของ Anthropic, Midjourney, Suno และอื่นๆ ไว้ในอินเทอร์เฟซเดียวที่เป็นมิตรกับนักพัฒนา ด้วยการนำเสนอการตรวจสอบสิทธิ์ การจัดรูปแบบคำขอ และการจัดการการตอบสนองที่สอดคล้องกัน CometAPI จึงทำให้การรวมความสามารถของ AI เข้ากับแอปพลิเคชันของคุณง่ายขึ้นอย่างมาก ไม่ว่าคุณจะกำลังสร้างแชทบ็อต เครื่องกำเนิดภาพ นักแต่งเพลง หรือไพพ์ไลน์การวิเคราะห์ที่ขับเคลื่อนด้วยข้อมูล CometAPI ช่วยให้คุณทำซ้ำได้เร็วขึ้น ควบคุมต้นทุน และไม่ขึ้นอยู่กับผู้จำหน่าย ทั้งหมดนี้ในขณะที่ใช้ประโยชน์จากความก้าวหน้าล่าสุดในระบบนิเวศ AI

CometAPI รองรับ gemini cli รายละเอียดดูที่ docเพิ่มประสิทธิภาพเทอร์มินัลของคุณด้วย Gemini CLI ของ Google บน CometAPIคุณสามารถวิเคราะห์ฐานโค้ดขนาดใหญ่ด้วยบริบทโทเค็น 1 ล้าน+ และเปลี่ยนไอเดีย ไดอะแกรม และแม้แต่ PDF ให้เป็นโค้ด รวมภายในไม่กี่นาทีและเริ่มสร้างสรรค์อย่างชาญฉลาดยิ่งขึ้น

นักพัฒนาสามารถเข้าถึงได้ API เวอร์ชันพรีวิว Gemini-2.5 Pro และ API แฟลช Gemini-2.5 เบื้องต้น ตลอด โคเมทเอพีไอรุ่นล่าสุดที่แสดงไว้เป็นข้อมูล ณ วันที่เผยแพร่บทความ ในการเริ่มต้น ให้สำรวจความสามารถของรุ่นใน สนามเด็กเล่น สำหรับคำแนะนำโดยละเอียด ก่อนเข้าใช้งาน โปรดตรวจสอบให้แน่ใจว่าคุณได้เข้าสู่ระบบ CometAPI และได้รับรหัส API แล้ว โคเมทเอพีไอ เสนอราคาที่ต่ำกว่าราคาอย่างเป็นทางการมากเพื่อช่วยคุณบูรณาการ

สรุป

ด้วยการผสาน Gemini CLI อันล้ำสมัยของ Google เข้ากับเกตเวย์ API แบบครบวงจรที่คุ้มค่าของ CometAPI นักพัฒนาจะปลดล็อกสภาพแวดล้อมเทอร์มินัลที่ขับเคลื่อนด้วย AI ได้อย่างราบรื่น ไม่ขึ้นกับผู้ขาย และปลอดภัย คุณจะได้รับประโยชน์จากโมเดลขั้นสูงของ Gemini ระดับชั้นฟรีที่กว้างขวาง และความยืดหยุ่นแบบโอเพนซอร์ส ขณะที่ CometAPI ช่วยลดความยุ่งยากในการจัดการปลายทาง การเรียกเก็บเงิน และการสลับโมเดล ไม่ว่าคุณจะกำลังเขียนโค้ด วิเคราะห์ข้อมูล หรือทำงาน DevOps อัตโนมัติ การผสานรวมนี้จะนิยามสิ่งที่เป็นไปได้ในเทอร์มินัลของคุณใหม่ ช่วยให้คุณทำงานซ้ำได้เร็วขึ้น ควบคุมต้นทุน และก้าวล้ำนำหน้าด้านนวัตกรรม AI