Nøglefunktioner

- Indbygget/kvalitetstekstrendering i billeder — udmærker sig ved at producere læsbar, semantisk korrekt tekst i genererede billeder (plakater, emballage, skærmbilleder) — et område, hvor mange tidligere billedmodeller havde udfordringer.

- Højfidel multimodalt output — producerer fotorealistiske og stiliserede billeder med gode detaljer og sprogbevidst layout.

- Stiloverførsel og detaljeforbedring — kan anvende konsistente kunstneriske stilarter eller forbedre lokale detaljer, mens scenens sammenhæng bevares.

Tekniske detaljer — hvordan Qwen-Image fungerer

Arkitektur og komponenter (nøgleord: MMDiT, Qwen2.5-VL). Modellen bruger en MMDiT-baseret diffusionstransformer til billedsyntese kombineret med en visuel-sprog-enkoder (Qwen2.5-VL) til at fortolke prompter og visuel kontekst. Denne adskillelse lader modellen behandle semantisk styring og pixeludseende forskelligt, hvilket forbedrer teksttrofasthed og redigeringskonsistens. Det officielle repository og den tekniske rapport angiver en rygrad på 20B parametre for den primære T2I-model.

Træningspipeline (nøgleord: curriculum learning, data pipeline). For at løse svær tekstrendering bruger Qwen-Image et progressivt curriculum: den starter med enklere ikke-tekstbilleder og træner gradvist på mere komplekse, teksttunge eksempler op til input på afsnitsniveau. Teamet konstruerede en omfattende pipeline, der inkluderer storskala indsamling, omhyggelig filtrering, syntetisk augmentering og balancering for at sikre, at modellen ser mange realistiske tekst-/fotokompositioner under træning. Denne strategiske curriculum er en hovedårsag til, at modellen excellerer i flersproget tekstrendering.

Redigeringsmekanisme (nøgleord: dual-encoding, VAE + VL encoder). Til redigering fødes det originale billede ind to gange: én gang i Qwen2.5-VL-enkoderen for semantisk kontrol og én gang i en VAE-enkoder for rekonstruktiv information om udseende. Dobbelt-indkodningsdesignet gør redigeringsmodulet i stand til at bevare identitet og visuel trofasthed, samtidig med at der tillades semantiske ændringer — for eksempel at erstatte et objekt eller ændre tekstindhold uden at forringe ikke-relaterede områder.

Benchmark-ydelse

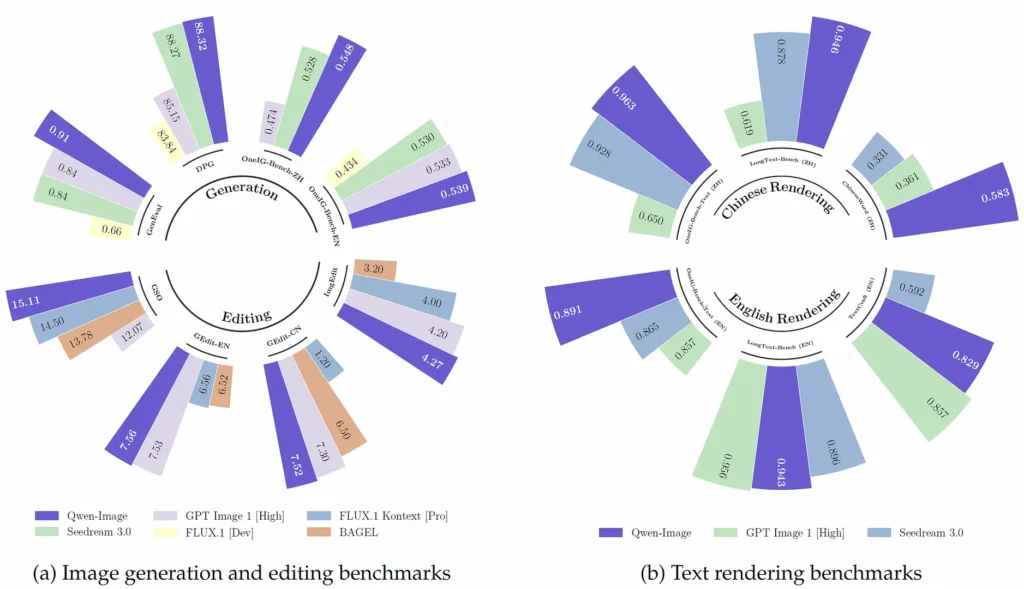

Qwen-Image opnår SOTA- eller nær-SOTA-ydelse på tværs af flere offentlige benchmarks for både generering og redigering, med særligt stærke resultater i tekstrenderingsopgaver og realistiske kompositionsbenchmarks (f.eks. T2I-CoreBench og kuraterede billedredigerings-suiter).

Hvordan Qwen-Image sammenlignes med andre førende modeller

Relative styrker: tekstrendering og tosproget teksttrofasthed er modellens markante fordele i forhold til mange generative konkurrenter (f.eks. DALL·E 3, SDXL, Midjourney), som ofte er stærkere i rent kunstnerisk komposition eller stilistisk diversitet, men svagere ved tætte, flerlinjede eller kinesiske tekstlayout. Flere sammenligninger fra fællesskabet og forfatternes benchmarktabeller understøtter denne karakteristik.

Relative afvejninger: sammenlignet med lukkede, stærkt finjusterede kommercielle systemer kan Qwen-Image kræve efterbehandling eller prompt-/adapterfinjustering for at nå identisk realisme i visse sammenhænge (forvrængning på buede overflader, fotorealistisk sammensætning), ifølge uafhængige tests. For brugere, der prioriterer skabelonbaserede designs, emballage-mockups eller tosprogede tekstlayout, er Qwen-Image typisk at foretrække.

Typiske og højværdi-brugsscenarier

- Emballage- og produktmockups: nøjagtig tekst og flerlinjede layout til etiketter og emballageafprøvninger.

- Annoncering og designtilgange: hurtig prototyping, hvor teksttrofasthed er vigtig (plakater, bannere).

- Dokumentlignende billedgenerering: generering af billeder, der skal indeholde læsbart indhold (menuer, skilte, grænseflader).

- Billedredigeringspipelines: målrettede redigeringer (tekstudskiftning, tilføj/fjern objekter), der bevarer stil og perspektiv.

- Sådan får du adgang til Qwen image API

Trin 1: Tilmeld dig for at få en API-nøgle

Log ind på cometapi.com. Hvis du ikke er vores bruger endnu, bedes du registrere dig først. Log ind på din CometAPI-konsol. Hent adgangslegitimations-API-nøglen til interfacet. Klik på “Add Token” ved API-tokenet i personcentret, hent token-nøglen: sk-xxxxx, og indsend.

Trin 2: Send forespørgsler til Qwen image API

Vælg “qwen-image ”-endpointet for at sende API-forespørgslen, og angiv anmodningskroppen. Forespørgselsmetoden og anmodningskroppen fås fra vores websteds API-dokumentation. Vores websted tilbyder også Apifox-test for din bekvemmelighed. Erstat <YOUR_API_KEY> med din faktiske CometAPI-nøgle fra din konto. base url is Images format(https://api.cometapi.com/v1/images/generations) via CometAPI.

Indsæt dit spørgsmål eller din anmodning i content-feltet — det er dette, som modellen vil svare på .

Trin 3: Hent og verificer resultater

Behandl API-svaret for at få det genererede svar. Efter behandlingen svarer API’et med opgavens status og outputdata.