เมื่อวันที่ 28 เมษายน 2025 Alibaba Cloud ได้เปิดตัว Qwen 3 ซึ่งเป็นเวอร์ชันล่าสุดในกลุ่มผลิตภัณฑ์โมเดลภาษาขนาดใหญ่ (LLM) การเปิดตัวครั้งนี้ถือเป็นก้าวสำคัญในการพัฒนา AI โอเพนซอร์ส โดยนำเสนอชุดโมเดลที่ตอบสนองความต้องการของแอปพลิเคชันและผู้ใช้ที่หลากหลาย ไม่ว่าคุณจะเป็นนักพัฒนา นักวิจัย หรือองค์กร การทำความเข้าใจวิธีการเข้าถึงและใช้งาน Qwen 3 จะช่วยปลดล็อกความเป็นไปได้ใหม่ๆ ในการประมวลผลภาษาธรรมชาติและอื่นๆ

Qwen 3 คืออะไร?

Qwen 3 คือซอฟต์แวร์โอเพ่นซอร์ส LLM รุ่นที่สามของ Alibaba Cloud ซึ่งสร้างขึ้นบนรากฐานที่รุ่นก่อนๆ วางไว้ Qwen 28 เปิดตัวเมื่อวันที่ 2025 เมษายน 3 โดยนำเสนอโมเดลต่างๆ ที่มีขนาดพารามิเตอร์แตกต่างกัน รวมถึงสถาปัตยกรรมแบบหนาแน่นและแบบเบาบาง โมเดลเหล่านี้ได้รับการฝึกฝนบนชุดข้อมูลที่ครอบคลุมจำนวน 36 ล้านล้านโทเค็นใน 119 ภาษาและสำเนียง ทำให้ Qwen 3 เป็นเครื่องมืออเนกประสงค์สำหรับแอปพลิเคชันทั่วโลก

คุณสมบัติหลักของ Qwen 3

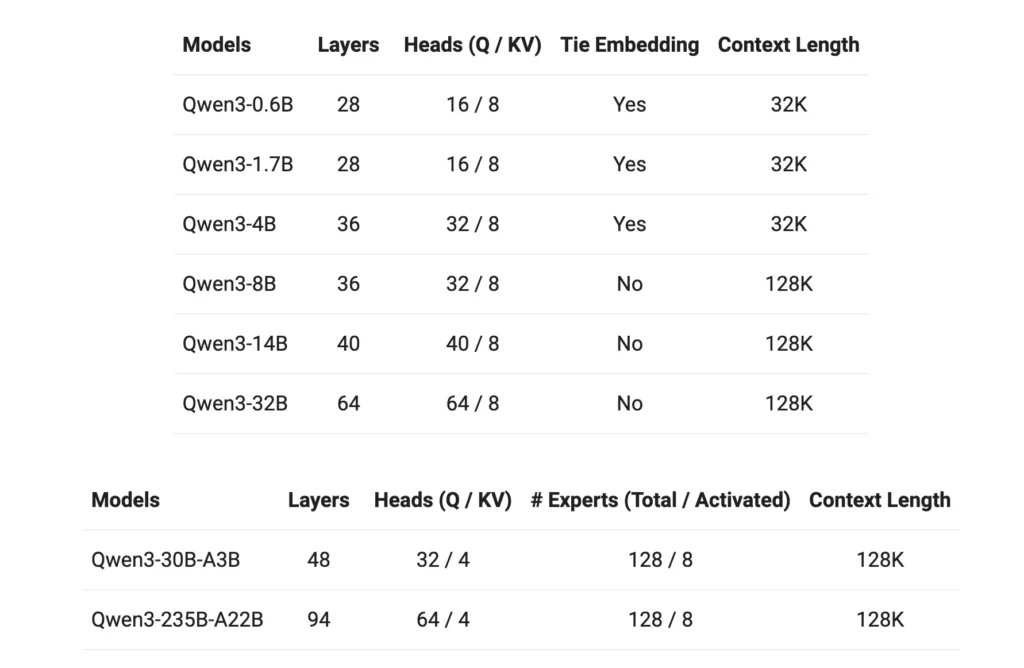

- รุ่น Variants:Qwen 3 นำเสนอโมเดลหนาแน่นด้วยพารามิเตอร์ 0.6B, 1.7B, 4B, 8B, 14B และ 32B เช่นเดียวกับโมเดลแบบเบาบางด้วย 30B (พารามิเตอร์ที่เปิดใช้งานแล้ว 3B) และ 235B (พารามิเตอร์ที่เปิดใช้งานแล้ว 22B)

- หน้าต่างบริบทขยาย:โมเดลส่วนใหญ่รองรับหน้าต่างบริบทโทเค็น 128K ช่วยให้การประมวลผลเนื้อหารูปแบบยาวเป็นไปได้สะดวกยิ่งขึ้น

- ความสามารถในการใช้เหตุผล:สามารถสลับการทำงานของการใช้เหตุผลขั้นสูงได้ผ่านโทเค็นไนเซอร์ ช่วยให้ปรับเปลี่ยนประสิทธิภาพได้ตามงานเฉพาะ

- ความสามารถหลายภาษา:ด้วยข้อมูลการฝึกอบรมที่ครอบคลุม 119 ภาษาและสำเนียง Qwen 3 จึงพร้อมสำหรับการใช้งานด้านภาษาที่หลากหลาย

- ลิขสิทธิ์:โมเดลทั้งหมดเปิดตัวภายใต้ใบอนุญาต Apache 2.0 ส่งเสริมการทำงานร่วมกันและนวัตกรรมโอเพนซอร์ส

คุณสามารถเข้าถึง Qwen3 ได้อย่างไร?

การเข้าถึง Qwen 3 ซึ่งเป็นชุดโมเดลภาษาขนาดใหญ่ (LLM) ล่าสุดของ Alibaba Cloud นั้นทำได้ง่ายและหลากหลาย ไม่ว่าคุณจะเป็นนักพัฒนาที่ต้องการผสานรวมความสามารถขั้นสูงของ AI เข้ากับแอปพลิเคชันของคุณหรือเป็นนักวิจัยที่กำลังสำรวจโมเดลที่ล้ำสมัย Qwen 3 ก็มีจุดเข้าถึงหลายจุดเพื่อตอบสนองความต้องการที่หลากหลาย

1. ผ่านทางอินเทอร์เฟซเว็บ QwenChat

สำหรับการโต้ตอบทันทีโดยไม่ต้องตั้งค่าใดๆ QwenChat มีอินเทอร์เฟซเว็บที่ใช้งานง่าย:

- เยี่ยมชม QwenChat: ไปที่ไฟล์ แพลตฟอร์ม QwenChat.

- เลือกรุ่น:เลือกจากรุ่นที่มีจำหน่าย เช่น Qwen3-8B, Qwen3-14B หรือ Qwen3-32B ตามความต้องการของคุณ

- เริ่มแชท:มีส่วนร่วมกับโมเดลโดยตรงผ่านอินเทอร์เฟซการแชทสำหรับงานต่างๆ เช่น ถามและตอบ สร้างเนื้อหา หรือช่วยเหลือในการเขียนโค้ด

2. การเข้าถึง API ผ่าน Alibaba Cloud

บูรณาการ Qwen 3 เข้ากับแอปพลิเคชันของคุณโดยใช้บริการ API ของ Alibaba Cloud:

รับข้อมูลรับรอง APIลงทะเบียนบน Alibaba Cloud และรับรหัส API ของคุณ

เลือกวิธีการเข้าถึง:

- API ที่เข้ากันได้กับ OpenAI:ใช้จุดสิ้นสุดที่เข้ากันได้กับ OpenAI เพื่อการรวมระบบที่ราบรื่น

bashPOST https://dashscope-intl.aliyuncs.com/compatible-mode/v1/chat/completions

- ชุดพัฒนาซอฟต์แวร์ DashScope:อีกวิธีหนึ่งคือใช้ DashScope SDK สำหรับการโต้ตอบที่ปรับแต่งได้มากขึ้น

- ตั้งค่าสภาพแวดล้อม:กำหนดค่าสภาพแวดล้อมการพัฒนาของคุณโดยตั้งค่าคีย์ API เป็นตัวแปรสภาพแวดล้อมและติดตั้ง SDK ที่จำเป็น

3. การเข้าถึงผ่าน Hugging Face และ ModelScope

สำหรับนักพัฒนาที่ต้องการแพลตฟอร์มโอเพ่นซอร์ส:

- กอดหน้า:เข้าถึงโมเดล Qwen 3 ผ่านทางองค์กร Qwen บน Hugging Face

pythonfrom transformers import AutoTokenizer, AutoModelForCausalLM tokenizer = AutoTokenizer.from_pretrained("Qwen/Qwen3-14B") model = AutoModelForCausalLM.from_pretrained("Qwen/Qwen3-14B")

- โมเดลสโคป:สำรวจโมเดลต่างๆ บน ModelScope ซึ่งนำเสนอรุ่น Qwen 3 มากมาย

4. ตัวเลือกการใช้งานในพื้นที่

ปรับใช้โมเดล Qwen 3 ในเครื่องเพื่อการควบคุมและการปรับแต่งที่ดียิ่งขึ้น:

โอลามา:แพลตฟอร์มที่ทำให้การบริหารจัดการโมเดลท้องถิ่นเป็นเรื่องง่าย

- การติดตั้ง:ดาวน์โหลดและติดตั้ง Ollama จาก ollama.com.

- การปรับใช้โมเดล:ใช้ Ollama's CLI เพื่อเรียกใช้โมเดล Qwen 3 ในเครื่อง

bashollama run qwen3-14b

วีแอลแอลเอ็ม:ปรับให้เหมาะสมสำหรับการให้บริการที่มีปริมาณงานสูงและความหน่วงต่ำ

- การติดตั้ง: ติดตั้ง vLLM โดยใช้ pip

bashpip install -U vllm

- การให้บริการแบบจำลอง:เสิร์ฟโมเดล Qwen 3 พร้อมความสามารถในการใช้เหตุผล

bashvllm serve Qwen/Qwen3-30B-A3B \ --enable-reasoning \ --reasoning-parser deepseek_r1

ปฏิสัมพันธ์:เข้าถึงโมเดลผ่านเซิร์ฟเวอร์ API เริ่มต้นที่ http://localhost:8000.

5. แพลตฟอร์มบุคคลที่สาม: CometAPI

ใช้ Qwen 3 ถึง โคเมทเอพีไอ ให้การเข้าถึงฟรี:

- โคเมทเอพีไอ:ลงทะเบียนเพื่อรับคีย์ API ฟรีและเลือกจากโมเดลเช่น Qwen3-8B, Qwen3-30B หรือ Qwen3-235B เพื่อรวมเข้ากับโปรเจ็กต์ของคุณ

วิธีการเริ่มต้นใช้งาน Qwen 3

วิธีเริ่มใช้ Qwen 3:

- กำหนดกรณีการใช้งานของคุณระบุว่าคุณต้องการอินเทอร์เฟซเว็บ การรวม API หรือการปรับใช้ภายในเครื่อง

- เลือกรุ่นที่เหมาะสมเลือกตัวแปรโมเดลที่สอดคล้องกับทรัพยากรการคำนวณและความซับซ้อนของงานของคุณ

- ตั้งค่าสภาพแวดล้อม: ทำตามขั้นตอนการติดตั้งและกำหนดค่าตามวิธีการเข้าถึงที่คุณเลือก

- บูรณาการและทดสอบ:รวม Qwen 3 ไว้ในแอปพลิเคชันของคุณและดำเนินการทดสอบเพื่อให้มั่นใจถึงประสิทธิภาพที่เหมาะสมที่สุด

หากทำตามขั้นตอนเหล่านี้ คุณจะสามารถใช้ความสามารถของ Qwen 3 ได้อย่างมีประสิทธิภาพเพื่อพัฒนาโครงการและการวิจัยของคุณ

การนำ Qwen 3 ไปใช้งาน: ข้อควรพิจารณาเชิงปฏิบัติ

ความต้องการของระบบ

การนำโมเดล Qwen 3 มาใช้ โดยเฉพาะโมเดลที่มีขนาดใหญ่กว่านั้น จำเป็นต้องใช้ทรัพยากรคอมพิวเตอร์จำนวนมาก ผู้ใช้ควรแน่ใจว่าสามารถเข้าถึงความสามารถของ GPU และหน่วยความจำที่เหมาะสมเพื่อรองรับขนาดของโมเดลและความต้องการในการประมวลผล

การบูรณาการและการปรับแต่ง

ลักษณะโอเพ่นซอร์สของ Qwen 3 ช่วยให้ปรับแต่งได้หลากหลาย นักพัฒนาสามารถปรับแต่งโมเดลบนข้อมูลเฉพาะโดเมน ปรับพารามิเตอร์เพื่อประสิทธิภาพที่เหมาะสมที่สุด และรวมโมเดลเข้ากับระบบที่มีอยู่เพื่อเพิ่มฟังก์ชันการทำงาน

ชุมชนและการสนับสนุน

การมีส่วนร่วมกับชุมชน Qwen 3 ผ่านทางฟอรัม การอภิปรายบน GitHub และแพลตฟอร์มการทำงานร่วมกันอื่นๆ สามารถให้ข้อมูลเชิงลึกและการสนับสนุนอันมีค่าได้ การแบ่งปันประสบการณ์และโซลูชันต่างๆ มีส่วนสนับสนุนความก้าวหน้าทางเทคโนโลยีโดยรวม

สรุป

Qwen 3 ถือเป็นความก้าวหน้าครั้งสำคัญในด้านโมเดลภาษาโอเพนซอร์สขนาดใหญ่ ด้วยการนำเสนอโมเดลที่หลากหลาย การรองรับภาษาที่ครอบคลุม และแพลตฟอร์มที่เข้าถึงได้ ทำให้ Qwen 3 เป็นเครื่องมือที่มีประสิทธิภาพสำหรับแอปพลิเคชันที่หลากหลาย ด้วยการเข้าใจวิธีการเข้าถึงและนำ Qwen XNUMX ไปใช้ ผู้ใช้สามารถใช้ประโยชน์จากความสามารถของ Qwen XNUMX เพื่อขับเคลื่อนการสร้างสรรค์นวัตกรรมและประสิทธิภาพในโดเมนที่เกี่ยวข้อง

เริ่มต้นใช้งาน

นักพัฒนาสามารถเข้าถึงได้ คเวน 3 API ผ่าน โคเมทเอพีไอในการเริ่มต้น ให้สำรวจความสามารถของโมเดลใน Playground และดู คู่มือ API สำหรับคำแนะนำโดยละเอียด โปรดทราบว่านักพัฒนาบางคนอาจจำเป็นต้องตรวจสอบองค์กรของตนก่อนใช้โมเดลนี้