สรุปสั้นๆ (TL;DR): เวอร์ชันล่าสุดของ OpenClaw เพิ่มการรองรับ GPT-5.4 ของ OpenAI แบบเต็มรูปแบบและรองรับอนาคต พร้อมเปิดตัวสถาปัตยกรรม “memory hot-swappable” ที่ทำให้เอเจนต์ของ OpenClaw สลับโมเดลและคลังหน่วยความจำที่ใช้งานอยู่ระหว่างรันไทม์ได้ด้วยการรบกวนต่ำมาก สิ่งนี้ปลดล็อกเวิร์กโฟลว์บริบทขนาดใหญ่ (หน้าต่างบริบทขยายของ GPT-5.4) การทำโมเดลให้เชี่ยวชาญเฉพาะทันที และการปรับต้นทุน/เวลาแฝงให้เหมาะสมสำหรับเอเจนต์ระดับโปรดักชัน อัปเกรดนี้มีให้ในรีลีสของ OpenClaw และเอกสารที่มาพร้อมกัน ตัวอย่างด้านล่างแสดงการคอนฟิกจริง โค้ดสั้นๆ บริบทเบนช์มาร์ก และแนวปฏิบัติที่แนะนำ

อัปเดตของ OpenClaw มีอะไรบ้าง (สรุปแบบรวดเร็ว)

เมื่อวันที่ 9 มีนาคม 2026 เฟรมเวิร์กเอเจนต์โอเพนซอร์ซที่อยู่ใกล้เคียงระบบนิเวศของ OpenAI ชื่อ OpenClaw ได้ปล่อยคอร์เวอร์ชันหลัก (2026.3.7) ที่เพิ่มการรองรับแบบเต็มรูปแบบสำหรับ GPT-5.4 และกลไก memory hot-swappable ใหม่ใน Context Engine รีลีสนี้ยกระดับเฟรมเวิร์กเอเจนต์เชิงทดลองที่ใช้อย่างกว้างขวางไปสู่สิ่งที่ผู้ดูแลเรียกว่า “Agent Operating System” — มีเป้าหมายเพื่อทำให้เวิร์กโฟลว์เอเจนต์ระดับโปรดักชันและการสลับโมเดลเป็นเรื่องราบรื่นสำหรับนักพัฒนาและทีม

3 ประเด็นปฏิบัติที่สำคัญสำหรับผู้สร้างเอเจนต์:

- รองรับ GPT-5.4 แบบเต็มรูปแบบ — มีนามแฝงของโมเดลและการแมปผู้ให้บริการที่ทำให้เอเจนต์เลือก GPT-5.4 เป็นโมเดลหลักในการรัน (รวมถึงการ override ต่อช่องและการปักหมุดโมเดลต่อเอเจนต์)

- Context Engine และการ bind ช่องทางแบบกระจาย — ปรับปรุงวิธีที่ OpenClaw ประกอบหน้าต่างบริบทยาวจากหน่วยความจำ เอาต์พุตเครื่องมือ และประวัติช่อง เพื่อให้โมเดลความจุสูงได้รับอินพุตที่มีโครงสร้างดี

- สถาปัตยกรรมหน่วยความจำแบบสลับได้ขณะทำงาน (memory hot-swappable) — ทำให้พื้นผิวปลั๊กอินของหน่วยความจำและเวิร์กโฟลว์ชัดเจนขึ้น เพื่อให้คุณแทนที่ backend หน่วยความจำหรืออัปเกรดเอเจนต์ได้โดยไม่สูญเสีย “อัตลักษณ์” หรือทำลายสถานะที่คงอยู่ (ตัวหน่วยความจำเองยังคงเป็นแหล่งความจริงเดียว) การออกแบบหน่วยความจำของ OpenClaw (ไฟล์ Markdown ธรรมดา การค้นหาดัชนี การเรียกค้นแบบปลั๊กอิน) คือสิ่งที่เอื้อต่อการสลับแบบปลอดภัย

GPT-5.4 — คืออะไร และทำไมเบนช์มาร์กถึงเป็นจุดเปลี่ยน

GPT-5.4 เป็นรุ่นแนวหน้าล่าสุดของ OpenAI ที่เน้นหนักไปที่ ประสิทธิภาพการทำงานระดับมืออาชีพ (สเปรดชีต การแก้ไขเอกสารและพรีเซนเทชัน การให้เหตุผลหลายขั้นและการขับเคลื่อนเครื่องมือ) ตามข้อมูลของ OpenAI และสื่ออิสระ จุดเน้นประกอบด้วย:

- บริบทที่ขยาย: GPT-5.4 แนะนำระดับถัดไปของหน้าต่างบริบท โดยมีแบบทดลอง 1M โทเคนและการจัดการบริบทยาวที่ดีขึ้นผ่านปลายทาง Codex/ที่เข้ากันได้กับ Codex — มีตัวเลือกคอนฟิกอย่าง

model_context_windowและmodel_auto_compact_token_limitสำหรับนักพัฒนา เพื่อให้คุณเก็บสถานะการสนทนา เอกสาร และฐานโค้ดขนาดใหญ่ไว้ในบริบทที่ใช้งานได้ - ความแม่นยำด้านสเปรดชีตและการให้เหตุผลที่สูงขึ้น — OpenAI รายงานการปรับปรุงครั้งใหญ่ในงานจำลองสเปรดชีต (คะแนนเฉลี่ยประมาณ 87% เทียบกับประมาณ 68% ของ GPT-5.2 บนเบนช์มาร์กสเปรดชีตด้านธนาคาร/นักวิเคราะห์)

- การปรับปรุงด้านความแม่นยำและข้อเท็จจริง: รีวิวและ QA ระยะแรกแสดง การลดอาการหลอนประมาณ 33% และลดผลลัพธ์ที่มีแนวโน้มผิดพลาดเมื่อเทียบกับ GPT-5.2 โดยเห็นผลเด่นในงานร่างเอกสารและงานสเปรดชีต ผู้รีวิวบางส่วนยังระบุ การลดลงประมาณ 18% ของการตอบที่ผิดพลาดในงานเพิ่มผลิตภาพบางประเภท

- การใช้งานคอมพิวเตอร์แบบบูรณาการและการสืบสายของ Codex ที่ดีขึ้น — GPT-5.4 รวมความสามารถจากสาย Codex ที่ช่วยปรับปรุงการสร้างโค้ด การดีบักแบบโต้ตอบ และการขับเคลื่อนเครื่องมือเชิงปฏิบัติการ (เมาส์/คีย์บอร์ด/ภาพหน้าจอในเดโมบางส่วน) ทำให้มันเหมาะกับวัฏจักรเขียน-รัน-ตรวจ-แก้ ที่เป็นแบบฉบับของลูปเอเจนต์

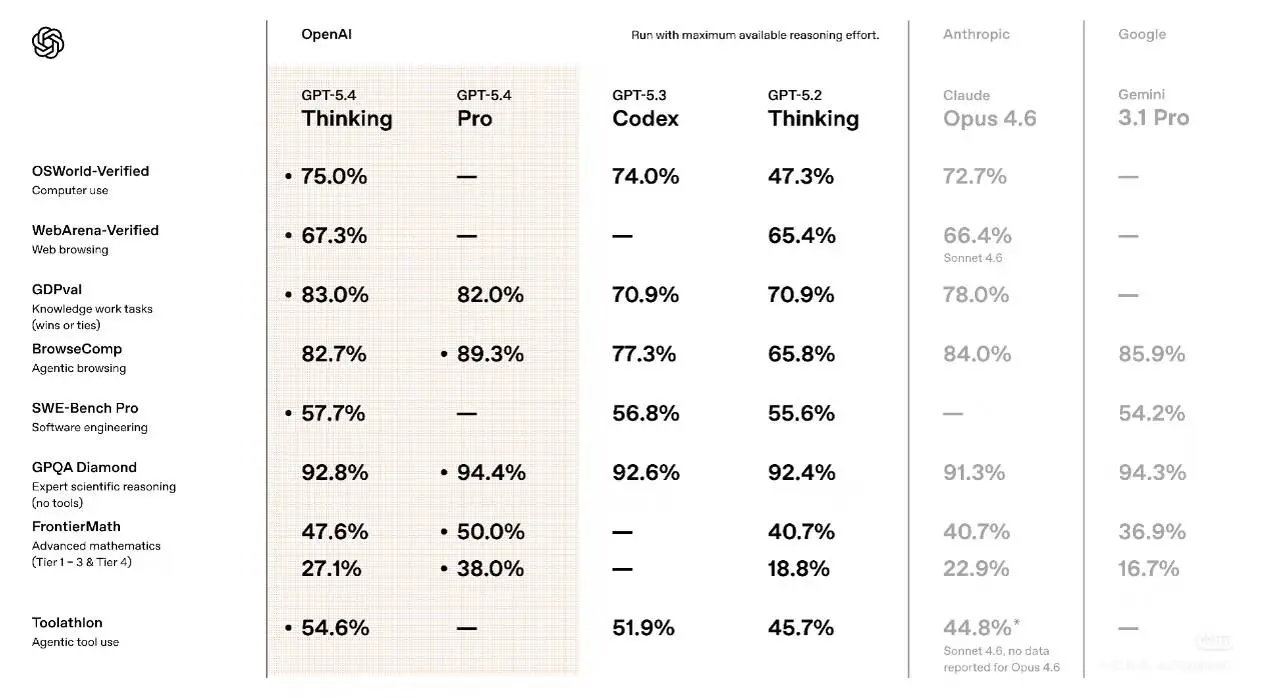

เบนช์ม์คาร์กและบริบทการเปรียบเทียบ (ตัวเลขบอกอะไร)

- การจำลองแบบสเปรดชีต: เบนช์มาร์กภายในของ OpenAI: คะแนนเฉลี่ย ประมาณ 87.3% สำหรับ GPT-5.4 เทียบกับ ประมาณ 68.4% สำหรับ GPT-5.2 นี่คือพาดหัวที่ผู้ผลิตใช้เพื่อชี้ให้เห็นความก้าวหน้าเฉพาะงาน

- ปฏิสัมพันธ์กับคอมพิวเตอร์ (OSWorld / การทดสอบเชิงเอเจนต์): ผู้ทดสอบอิสระและการรันทดลองโดยชุมชนแสดงว่า GPT-5.4 ทำได้ดีกว่าในงานที่เกี่ยวข้องกับการจัดการเดสก์ท็อปหรือ UI จำลอง โดยบางครั้งทำคะแนนเหนือรุ่นล่าสุดของ Anthropic ในส่วนต่างเล็กน้อยบนชุดงานเหล่านี้ (ความต่างมีความหมายต่อเอเจนต์ แต่ไม่จำเป็นต้องชี้ขาดสำหรับทุกเวิร์กโหลด)

คำตีความ: GPT-5.4 ไม่ใช่ “กระสุนวิเศษ” ที่ชนะทุกอย่าง มันมีจุดแข็งชัดเจนด้านการใช้เครื่องมือแบบบูรณาการ การรันโค้ด และการให้เหตุผลกับสเปรดชีต — ซึ่งเป็นเวิร์กโหลดที่เอเจนต์ของ OpenClaw ใช้บ่อย สำหรับผู้สร้างเอเจนต์ การผสมผสานระหว่างความน่าเชื่อถือในการเป็นตัวดำเนินการ (สาย Codex) + ความสามารถการวางแผน + การจัดการบริบทยาวที่ดีกว่า มีความสำคัญอย่างยิ่ง

OpenClaw รองรับ GPT-5.4: เปลี่ยนอะไร และทำไมถึงสำคัญ

รีลีสของ OpenClaw (ดูที่หน้ารายการรีลีสของโปรเจ็กต์) อัปเดตตัวแก้ไขโมเดลและรันไทม์ให้ รองรับอนาคต กับบริบทและขีดจำกัดโทเคนที่ขยายของ GPT-5.4 และเพิ่มความสามารถ “memory hot-swappable” เพื่อให้เอเจนต์สลับ backend หน่วยความจำหรือโมเดลระหว่างรันไทม์ได้ สิ่งนี้ทำผ่าน 3 ทางหลัก: 1) อัปเดตเมทาดาทาของโมเดลและตัวแก้ไขเพื่อรับค่าบริบทและขีดจำกัดโทเคนที่ใหญ่ขึ้น; 2) เปลี่ยนรันไทม์ของเอเจนต์เพื่อจัดการการสลับโมเดลอย่างราบรื่นและการวอร์มแคช; 3) มี API หน่วยความจำที่รองรับหลายช่องหน่วยความจำและทริกเกอร์การสลับแบบทันที

การรองรับ GPT-5.4 ของเวอร์ชัน 2026.3.7 รวมกับการออกแบบ memory hot-swappable ให้ข้อได้เปรียบเชิงปฏิบัติที่เป็นคู่เสริมกันสองประการ:

- เส้นทางอัปเกรดโมเดลที่ตรงไปตรงมา OpenClaw สามารถนำเสนอ GPT-5.4 เป็น “รันไทม์” ให้เอเจนต์เลือกได้ ทำให้คุณสลับจาก GPT-5.x รุ่นเก่าหรือผู้ให้บริการอื่นได้โดยไม่ต้องแก้ตรรกะเอเจนต์ อัปเดตนี้ประกาศการผสาน GPT-5.4 อย่างเสถียรไว้ในแกนกลาง

- Memory Hot-Swapping แทนที่จะเก็บภาพสแน็ปช็อตหน่วยความจำเชิงเส้นหนึ่งอัน Context Engine ของ OpenClaw อนุญาตให้แยก สลับ หรือย้ายพาร์ติชันหน่วยความจำระหว่างรันไทม์ — เช่น สลับเข้าชาร์ดเวกเตอร์ฐานข้อมูลแบบเน้น recall สูงเพื่อดีบัก หรือสลับเป็นหน่วยความจำที่ทำให้สอดคล้อง GDPR สำหรับการตรวจสอบภายนอก — โดยไม่ต้องหยุดเอเจนต์ ลดความเสี่ยงการรบกวนในโปรดักชันและเปิดให้คอนฟิกหน่วยความจำเฉพาะกรณีการใช้งาน (ดีบัก vs ความเป็นส่วนตัว vs ประสิทธิภาพ)

ความก้าวหน้าเชิงประสิทธิภาพเชิงปฏิบัติและข้อได้เปรียบ

การผสานของ OpenClaw โฟกัส 3 ด้านปฏิบัติที่ GPT-5.4 เด่น:

- ความเที่ยงตรงในการออร์เคสเตรตเครื่องมือ ความสามารถค้นหาเครื่องมือภายในและการให้เหตุผลที่ดีขึ้นของ GPT-5.4 ลดการเรียกใช้เครื่องมือซ้ำซ้อน (เรียกเครื่องมือน้อยลงและต้อง retry น้อยลง) แปลเป็นการเรียก API น้อยลงและจบงานเร็วขึ้นสำหรับโฟลว์ซับซ้อน รายงานระยะแรกบ่งชี้การใช้โทเคนและเครื่องมืออย่างมีประสิทธิภาพขึ้นเมื่อเทียบกับ GPT-5.x รุ่นก่อน

- การจัดการบริบทที่ยาวและสมบูรณ์ยิ่งขึ้น เอเจนต์ OpenClaw สามารถรักษาบริบทที่ใช้งานได้ขนาดใหญ่มาก (รวมถึงชิ้นหน่วยความจำที่สลับเข้ามา) ให้จัดการบทสนทนายาว โปรเจ็กต์หลายไฟล์ และการดีบักแบบวนซ้ำโดยไม่สูญเสียสถานะ

- เอาต์พุตโค้ดที่กำหนดได้มากขึ้น สำหรับเวิร์กโฟลว์ที่สร้างโค้ดอัตโนมัติ (CI hooks โครงร่างฟังก์ชัน เทมเพลตอินฟราสตรักเจอร์) GPT-5.4 มีแนวโน้มสร้างเอาต์พุตที่คงเส้นคงวาและรันได้ ลดภาระการรีวิวของมนุษย์ การทดสอบอิสระแสดงการปรับปรุงชัดเจนในเมตริกคุณภาพโค้ดเทียบกับรุ่น GPT-5 ก่อนหน้า

- ความต่อเนื่องของหน่วยความจำ — “memory hot-swappable” ช่วยให้คุณแทนที่หรือเสริมคลังหน่วยความจำ (แคชท้องถิ่น เวกเตอร์ DB หน่วยความจำ LLM) โดยไม่สูญเสียสถานะหรือบริบทของเอเจนต์ เปิดทางให้ A/B testing อัปเกรดแบบ rolling และ failover

ในการทดสอบ OOLONG benchmark เวอร์ชันใหม่ของ OpenClaw ร่วมกับปลั๊กอิน lossless-claw ทำคะแนนสูงถึง 74.8 ทิ้ง Claude Code (70.3 คะแนน) ไว้ไกล โดยเฉพาะอย่างยิ่ง OpenClaw แสดงเสถียรภาพและความแม่นยำเมื่อความยาวบริบทเพิ่มขึ้น จนวิศวกรที่ทดสอบในสถานที่เอ่ยปากว่า “พูดว่า ‘ทำงานดี’ ยังถือว่าอนุรักษ์นิยมเกินไป”

วิธีคอนฟิกและใช้งาน GPT-5.4 ใน OpenClaw (ทีละขั้น)

เวิร์กโฟลว์ OpenClaw แบบง่ายโดยใช้ GPT 5.4:

- ตัวอย่างคอนฟิกทั่วไปแสดงไว้ด้านล่าง:

- ผู้ใช้ส่งข้อความผ่านแพลตฟอร์มอย่าง Discord หรือ Telegram

- OpenClaw รับข้อความผ่านเกตเวย์เซิร์ฟเวอร์

- เกตเวย์ส่งต่อพรอมป์ต์ไปยัง GPT 5.4 ผ่านผู้ให้บริการ AI API

- GPT 5.4 สร้างคำตอบหรือทริกเกอร์การทำงานของเครื่องมือ

- OpenClaw ส่งผลลัพธ์สุดท้ายกลับไปยังผู้ใช้

ด้านล่างคือคอนฟิกและเวิร์กโฟลว์ที่คัดลอกไปใช้ได้จริง เพื่อรัน GPT-5.4 ใน OpenClaw อย่างปลอดภัยและทำซ้ำได้ ตั้งใจตั้งค่าแบบระมัดระวัง: เปิดใช้โมเดลในเอเจนต์ทดสอบก่อน และติดเครื่องมือวัดทุกอย่างทั้งเมตริกและข้อผิดพลาด

ข้อกำหนดเบื้องต้น- อัปเกรด OpenClaw เป็นรีลีสที่มีแมปปิ้ง GPT-5.4 (ตามบันทึกรีลีสที่อ้างถึงด้านบน)

- คีย์ OpenAI API ที่ถูกต้องและมีสิทธิ์เข้าถึง GPT-5.4 (ฉันเลือกใช้ปลายทางของ CometAPI ราคาถูกกว่า)

1) เลือกโมเดลและคอนฟิกตัวแก้ไข (Json/ YAML / CLI)

วางไฟล์นี้ใน ~/.openclaw/openclaw.json (หรือผสานเข้ากับคอนฟิกเดิมของคุณ) ปรับชื่อผู้ให้บริการและตัวอ้างอิงโทเคนตามสภาพแวดล้อมของคุณ

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw ใช้ตัวแก้ไขโมเดลเพื่อแมปชื่อโมเดลเชิงตรรกะ (เช่น openai/gpt-5.4) ไปยัง endpoint และคอนฟิกรันไทม์ เพิ่มหรืออัปเดตไฟล์ตัวแก้ไขของคุณ (ตัวอย่าง models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

หรือกำหนดระหว่างรันไทม์ผ่าน CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

หมายเหตุ:

context_windowและmax

บันทึก

agents.defaults.model.primaryเลือกโมเดลเริ่มต้น ใช้channels.modelByChannelเพื่อ override ต่อช่อง เพื่อให้คุณส่งช่องที่สำคัญไปยัง GPT-5.4 และช่องที่ต้องการน้อยไปยังโมเดลที่ประหยัดกว่า ดูเอกสารการเลือกโมเดลของ OpenClaw สำหรับลำดับความสำคัญ- โปรดอ้างอิงหน้ารายละเอียดโมเดลของ CometAPI สำหรับชื่อโมเดลเฉพาะ หากต้องการใช้ OpenAI ให้แทนที่ URL และคีย์ API ด้วยของ OpenAI

- คีย์

context_windowและmax_output_tokensสะท้อนการเปลี่ยนแปลงด้านความเข้ากันได้ล่วงหน้าในตัวแก้ไขของ OpenClaw เพื่อหลีกเลี่ยงการใช้ขีดจำกัดแบบเก่าของ Codex

2) วิธีเปิดใช้และทดสอบ “memory hot-swapping”

ซับซิสเต็มหน่วยความจำของ OpenClaw เป็นแบบไฟล์ (Markdown) รวมกับตัวทำดัชนี/ปลั๊กอินค้นหา เพื่อให้คุณสลับ backend หน่วยความจำ (เช่น SQLite เวกเตอร์, Milvus, หรือบริการหน่วยความจำภายนอก) ได้อย่างปลอดภัยโดยไม่สูญเสียไฟล์หน่วยความจำดิบ

รูปแบบที่พบบ่อย:

- มาตรฐานตำแหน่งหน่วยความจำ: ใช้ workspace ที่แบ็กอัพด้วย git:

~/.openclaw/workspace/โดยMEMORY.mdและmemory/YYYY-MM-DD.mdเป็นแหล่งอ้างอิงหลัก - ติดตั้งและคอนฟิกปลั๊กอินหน่วยความจำ (ตัวอย่าง: sqlite-vec) แล้วชี้

plugins.slots.memoryไปยังปลั๊กอินนั้นในคอนฟิก - ทดสอบการย้าย: เพิ่มปลั๊กอินใหม่ รันงานทำดัชนีแบบเงา เปรียบเทียบผลการเรียกค้น จากนั้นสลับ alias ของ

plugins.slots.memoryไปยังปลั๊กอินใหม่เมื่อพอใจผล

ตัวอย่างสลับ alias ของปลั๊กอิน (คำสั่ง bash แบบร่าง):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

ทำไมจึง “hot-swappable”: ไฟล์หน่วยความจำยังคงเป็น “แหล่งความจริง” ปลั๊กอินทำหน้าที่ชั้นการทำดัชนีและการเรียกค้น การสลับปลั๊กอินจะทำดัชนีใหม่แต่ไม่เปลี่ยนไฟล์ .md ด้านล่าง ช่วยให้สลับโมเดลได้โดยไม่เกิดการเบี่ยงเบนของอัตลักษณ์ — เอเจนต์ยังคงอ่าน MEMORIES เดิม

3) ตัวอย่าง: ปักหมุดเอเจนต์รายตัวให้ใช้ GPT-5.4 (override ต่อเอเจนต์)

คุณสามารถ override โมเดลรายเอเจนต์ได้; เพิ่มรายการเอเจนต์เช่น:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

หากรีลีสชุมชนหรือเวอร์ชัน OpenClaw ของคุณต้องการ CLI คุณยังสามารถตั้งโมเดลต่อเซสชันระหว่างรันไทม์ได้:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

เคล็ดลับเชิงปฏิบัติการ: การปักหมุดช่วยให้พฤติกรรมของเอเจนต์นั้นกำหนดได้มากขึ้นระหว่างที่คุณทำ A/B test เอเจนต์อื่น

หากต้องการใช้ OpenAI ให้แทนที่ URL และคีย์ API ด้วยของ OpenAI

4) ใช้ตัวเลือกบริบท 1M ของ Codex (API knobs)

ถ้า deployment ของ OpenClaw ของคุณเข้าถึง endpoint ของ OpenAI Codex โดยตรง ให้ส่งตัวเลือกบริบท:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

คำร้องที่เกินหน้าต่างบริบทมาตรฐานอาจถูกนับการใช้งานในอัตราที่ต่างออกไป (เอกสาร OpenAI ระบุการคิดจำนวนสองเท่าสำหรับคำร้องที่เกินหน้าต่างมาตรฐานในช่วงพรีวิวของ Codex)

แนวปฏิบัติที่ดี: ดึงศักยภาพของ GPT-5.4 ใน OpenClaw ให้เต็มที่

ต้นทุน เวลาแฝง และส่วนผสมของโมเดล

- กลยุทธ์โมเดลแบบไฮบริด: ใช้โมเดลเล็กและประหยัดสำหรับคำถามสั้นและการประมวลผลสตรีม; สลับเป็น GPT-5.4 เมื่อวิเคราะห์หนัก สรุปผล หรือสร้างโค้ดที่ต้องใช้บริบทยาว ลดต้นทุนโทเคนโดยยังคงคุณภาพ (ทำผ่านทริกเกอร์ในคอนฟิกหน่วยความจำด้านบน)

- การบีบอัดโทเคนและการเพิ่มการเรียกค้น (RAG): ใช้ไปป์ไลน์แบบเรียกค้นเสริม เพื่อลดโทเคนที่ส่งให้โมเดล — เก็บเอกสารยาวในเวกเตอร์ DB เรียกคืนส่วนที่เกี่ยวข้อง และใส่เฉพาะชิ้นส่วนที่เกี่ยวข้องที่สุดพร้อมแผนย่อ GPT-5.4 ช่วยค้นหาเครื่องมือ/เอกสารที่เป็นประโยชน์ได้อัตโนมัติ

- วอร์มอัปและคูลด์สตาร์ต: หลังสลับโมเดล ให้วอร์มโมเดลด้วยรันสั้นๆ เพื่อหลีกเลี่ยงสไปค์เวลาแฝงในการเรียกครั้งแรก คอมไพล์เทมเพลตพรอมป์ต์ล่วงหน้าและเติมช่องความจำสำคัญ OpenClaw รองรับกลยุทธ์ rolling สำหรับการพรีวอร์ม

ความน่าเชื่อถือและความปลอดภัย

- Fallback อย่างนุ่มนวล: ตั้ง timeout และแผน fallback (เช่น ลดระดับไปใช้คำตอบแคชจากเซสชันก่อน) เพื่อรับมือกับ rate limit หรือโควตา API

- ชั้นความปลอดภัย: รักษาตัวกรองนโยบายและขั้นตอนตรวจสอบเมื่อเอาต์พุตมีผลต่อการตัดสินใจ GPT-5.4 ลดอาการหลอนตามสถิติ แต่การตรวจสอบยังสำคัญในงานเดิมพันสูง

การประเมินและมอนิเตอร์

- ทำซ้ำเบนช์มาร์กของคุณ: ทดสอบ head-to-head กับเวิร์กโหลดของคุณ (เติมโค้ด การรีแฟกเตอร์หลายไฟล์ วิเคราะห์สเปรดชีต) โดยใช้รูบริกมาตรฐาน รายงานสาธารณะชี้จุดแข็งในงานสเปรดชีตและเพิ่มผลิตภาพ — ตรวจสอบกับข้อมูลของคุณเอง

- เทเลเมทรี: มอนิเตอร์การใช้โทเคน เวลาแฝงของโมเดล ความถี่การสลับหน่วยความจำ และคุณภาพคำตอบ (เรตติ้งมนุษย์/เทสอัตโนมัติ) ใช้ข้อมูลนี้เพื่อปรับเกณฑ์การสลับ

ตัวอย่าง: เอเจนต์รีวิวโค้ดที่สลับแบบร้อน

เป้าหมาย: รันสรุป lint + unit test ตามปกติเมื่อมีการ push (ใช้โมเดลราคาถูก) และยกระดับไปยัง GPT-5.4 เพื่อเสนอรีแฟกเตอร์หลายไฟล์เมื่อการทดสอบล้มเหลวหรือ diff เกิน 10 ไฟล์

โฟลว์ (ระดับสูง):

- ทริกเกอร์ pre-commit รัน

local/fast-small-coderเพื่อสร้างสรุป lint - ถ้า

test_failures > 0หรือdiff_files > 10ให้ทริกเกอร์hot_swapไปที่openai/gpt-5.4และโปรโมตlongterm_vectorที่มีประวัติ repo - รันพรอมป์ต์ GPT-5.4 ที่บรรจุ stack trace ที่ล้มเหลวทั้งหมด + ไฟล์โค้ดที่เกี่ยวข้องที่ดึงมาในบริบท สร้างแพตช์รีแฟกเตอร์และการเปลี่ยนแปลง unit test

- ผู้รีวิวให้คะแนนเอาต์พุต; ข้อเสนอแนะจะอัปเดตหน่วยความจำ

โครงพรอมป์ต์ (ส่งให้ GPT-5.4 หลังการดึงข้อมูล & บีบอัด):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

กรณีใช้งานนี้ชี้ให้เห็นว่าทำไมบริบทขนาดใหญ่ + memory hot-swap จึงมีคุณค่า: คุณสามารถนำ trace ที่ล้มเหลวทั้งหมดและหลายไฟล์เข้าโมเดลพร้อมกัน กำหนดทริกเกอร์การสลับอย่างระมัดระวังเพื่อควบคุมต้นทุน

สุดท้าย: ใครควรนำ GPT-5.4 ใน OpenClaw ไปใช้ (และเมื่อไร)

- ควรใช้ทันที หากเอเจนต์ของคุณทำงานหลายขั้นกับโค้ด/เครื่องมือ อัตโนมัติสเปรดชีตหนัก หรือแก้ไขเอกสารซับซ้อนที่วนลูปเขียน-รัน-ตรวจ-แก้ ผลผลิตและความน่าเชื่อถือจะเห็นชัดที่สุด

- ใช้อย่างระมัดระวัง หากคุณทำงานในช่องสนทนาปริมาณสูงที่อ่อนไหวต่อค่าใช้จ่ายและการให้เหตุผลเรียบง่ายเพียงพอ; ใช้การจัดเส้นทางเพื่อคุมค่าใช้จ่าย

- อย่าคิดว่าโมเดลเดียวครองทุกอย่าง: เบนช์มาร์กกับข้อมูลของคุณ GPT-5.4 เป็นตัวเลือกแข็งแกร่งสำหรับเวิร์กโหลดเชิงเอเจนต์ แต่การเลือกโมเดลควรขับเคลื่อนด้วยหลักฐาน

นักพัฒนาสามารถเข้าถึง GPT-5.4 ผ่าน CometAPI (CometAPI คือแพลตฟอร์มรวบรวม API โมเดลขนาดใหญ่แบบวันสต็อป เช่น GPT APIs, Nano Banana APIs เป็นต้น) ได้แล้ว เริ่มต้นโดยสำรวจความสามารถของโมเดลใน Playground และดู คู่มือการผสาน Openclaw สำหรับคำแนะนำโดยละเอียด ก่อนเข้าถึง โปรดตรวจสอบว่าคุณได้ล็อกอิน CometAPI และได้รับ API key แล้ว CometAPI มีราคาถูกกว่าราคาอย่างเป็นทางการมากเพื่อช่วยให้คุณผสานได้ง่ายขึ้น

พร้อมลุยหรือยัง?→ สมัคร OpenClaw วันนี้!

หากต้องการติดตามทิป คู่มือ และข่าวสาร AI เพิ่มเติม ตามเราได้ทาง VK, X และ Discord!