فوری جواب: 2026 میں ڈویلپرز کو کس AI ماڈل کو ترجیح دینی چاہیے؟

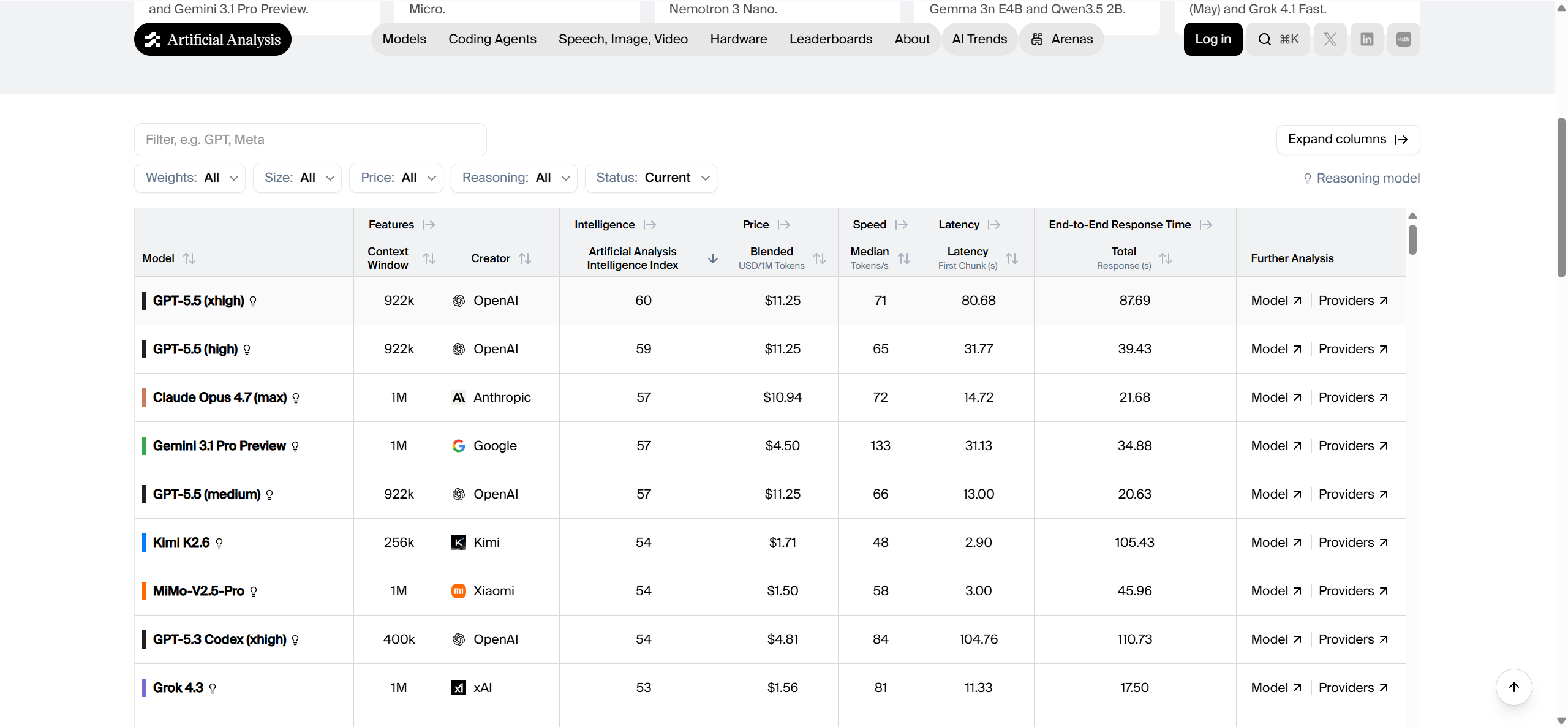

جن کاموں میں زیادہ سے زیادہ خودمختار استدلال اور کم سے کم ہیلوسینیشن درکار ہو، ڈویلپرز کو GPT-5.5 (xhigh) منتخب کرنا چاہیے، جو 60 کے انٹیلیجنس انڈیکس کے ساتھ مارکیٹ میں سبقت رکھتا ہے۔ حقیقی وقت کی تعامل پر مبنی ایپلی کیشنز کے لیے Mercury 2 استعمال کریں، جو اس وقت تقریباً 859 ٹوکنز فی سیکنڈ کی رفتار کے ساتھ سب سے تیز ہے۔ بڑے پیمانے پر پروڈکشن میں جہاں بجٹ مرکزی پابندی ہو، DeepSeek V4 Pro اور Kimi K2.6 فلیگ شپ ملکیتی ماڈلز کی لاگت کے تقریباً 10% میں فرنٹیئر کے قریب انٹیلیجنس فراہم کرتے ہیں۔

The Intelligence Index: فرنٹیئر ماڈلز کی درجہ بندی

2026 کے AI منظرنامے میں "پیرا میٹر" کی تعداد کے پیچھے بھاگنے سے "سوچ" کی کثافت کو بہتر بنانے کی طرف رخ ہو گیا ہے۔ Artificial Analysis Intelligence Index v4.0 دس تخصصی ابعاد پر ماڈل کی صلاحیت کو مقداری طور پر ناپنے کا صنعتی معیار ہے، جن میں پروفیشنل گریڈ کوڈنگ اور انتہائی منطقی استنتاج شامل ہیں۔

| Model | Intelligence Index | Context Window | Best Use Case |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | سائنسی تحقیق اور منطق |

| GPT-5.5 (high) | 59 | 922K | پروفیشنل درجے کی کوڈنگ |

| Claude Opus 4.7 (max) | 57 | 1M | خودکار ایجنٹس اور منصوبہ بندی |

| Gemini 3.1 Pro | 57 | 1M - 2M | ملٹی موڈل ڈیٹا کی ترکیب |

| Kimi K2.6 | 54 | 256K | ٹرمنل پر مبنی ایجنٹک کام |

| MiMo-V2.5-Pro | 54 | 1M | فل اسٹیک سافٹ ویئر انجینئرنگ |

| DeepSeek V4 Pro (Max) | 52 | 1M | قابلِ توسیع ریزننگ ورک فلو |

| GLM-5.1 | 51 | 200K | طویل مدتی خودمختار کام |

یہ جدول کیسے پڑھیں

سرفہرست پانچ ماڈلز میں سے تین GPT-5.5 ماڈلز، GPT-5.5 Medium، Claude Opus 4.7، اور Gemini 3.1 Pro ہیں۔ یہ تین مغربی فلیگ شپ ماڈلز شانہ بشانہ ہیں، جبکہ Kimi K2 اور mimo-v2.5 pro، دو چینی ماڈلز، انتہائی مسابقتی قیمتوں پر اعلیٰ مغربی ماڈلز کے ہم پلہ کارکردگی پیش کرتے ہیں۔

Artificial Analysis Intelligence Index ایک معمول پر لایا گیا میٹرک ہے جو Terminal-Bench Hard اور IFBench جیسی آزادانہ جانچوں سے اخذ کیا جاتا ہے۔ ایک پوائنٹ کا فرق ماڈل کی "خودمختاری کی حد" میں شماریاتی طور پر معنی خیز خلا کی نمائندگی کرتا ہے۔ مثال کے طور پر، GPT-5.5 (60) اور Claude Opus 4.7 (57) کے درمیان 3 پوائنٹس کا فرق اکثر اس بات میں ڈھلتا ہے کہ ایک ماڈل کو ہر چند مراحل پر انسانی مداخلت درکار ہوتی ہے جبکہ دوسرا پیچیدہ منطقی سلسلہ خود مکمل کر سکتا ہے۔ زیادہ انڈیکس اسکور عموماً "Humanity's Last Exam" میں زیادہ کامیابی کی شرح اور ایجنٹک ماحول میں ٹول کالنگ کی غلطیوں میں کمی سے وابستہ ہوتا ہے۔

The Reflexes: لیٹنسی اور جنریشن کی رفتار

انٹرایکٹو سافٹ ویئر—چاہے لائیو IDE اسسٹنٹس ہوں یا صارفین کے سامنے والے وائس ایجنٹس—میں خام انٹیلیجنس کی نسبت Time to First Token (TTFT) اور Generation Throughput زیادہ اہم ہوتے ہیں۔

ٹاپ 5 تیز ترین ماڈلز (تھروپٹ)

تھروپٹ اس رفتار کو ناپتا ہے جس سے ماڈل ابتدائی پروسیسنگ کے بعد متن جنریٹ کرتا ہے۔ لمبی شکل کے مواد کی تیاری اور تیز کوڈ ریفیکٹرنگ کے لیے زیادہ تھروپٹ ضروری ہے۔

- Mercury 2: تقریباً 859 ٹوکنز/سیکنڈ

- Granite 4.0 H Small: تقریباً 407 ٹوکنز/سیکنڈ

- Granite 3.3 8B: تقریباً 365 ٹوکنز/سیکنڈ

- Gemini 3.1 Flash-Lite**** : تقریباً 331 ٹوکنز/سیکنڈ

- Qwen3.5 0.8B: تقریباً 287 ٹوکنز/سیکنڈ

ٹاپ 5 کم ترین لیٹنسی ماڈلز (TTFT)

لیٹنسی وہ تاخیر ہے جو پہلے ٹوکن کے صارف تک پہنچنے سے قبل ہوتی ہے۔ UI/UX میں "وائب" اور محسوس شدہ ردعمل کے لیے یہ کلیدی میٹرک ہے۔

- NVIDIA Nemotron 3 Nano: تقریباً 0.40s

- Ministral 3 3B: تقریباً 0.47s

- Qwen3.5 0.8B: تقریباً 0.52s

- LFM2 24B A2B: تقریباً 0.55s

- Grok 3 mini Reasoning: تقریباً 0.58s

2026 میں اپنا ماڈل کیسے چنیں

ماڈل کے انتخاب میں "Intelligence-per-Dollar" تناسب کو آپ کی ایپلی کیشن کی مخصوص اپ ٹائم ضروریات کے ساتھ متوازن کرنا ہوتا ہے۔ 2026 کی مارکیٹ تین الگ الگ معماری راستوں میں بٹ چکی ہے۔

آزاد ڈویلپرز اور بجٹ حساس ٹیمیں

انفرادی ڈویلپرز یا چھوٹی ٹیمیں جو ہزاروں تجرباتی ایجنٹ لوپس چلاتی ہیں، ان کے لیے DeepSeek V4 Pro ایک بہترین اسٹریٹیجک انتخاب ہے۔ یہ 1.6T پیرا میٹر Mixture-of-Experts (MoE) آرکیٹیکچر استعمال کرتا ہے جہاں فی ٹوکن صرف 49B پیرا میٹرز ایکٹیویٹ ہوتے ہیں، جس سے یہ تقریباً $0.416 فی ملین ٹوکنز پر فلیگ شپ کارکردگی دیتا ہے۔ کوڈنگ مخصوص کاموں کے لیے ایک اور عمدہ آپشن Kimi K2.6 ہے، جو ٹرمنل فرسٹ ورک فلو میں مہارت رکھتا ہے۔ یہ ماڈلز پریمیم ماڈلز کی ریزننگ پاور کا تقریباً 90% فراہم کرتے ہیں جبکہ قیمت میں تقریباً 70-80% سستے ہوتے ہیں، جس سے اسٹارٹ اپ کا رن وے مؤثر طور پر بڑھ جاتا ہے۔

انٹرپرائز پروڈکشن ماحول

ادارے بھر میں تعیناتی، جہاں استحکام اور پیچیدہ سسٹم پرامپٹس کی پابندی ناقابلِ سمجھوتہ ہو، کے لیے صنعتی معیار GPT-5.5 Pro اور Claude Opus 4.7 ہی ہیں۔ GPT-5.5 Pro اعلی حساسیت والے شعبوں میں انتہائی درستی کے لیے تیار کیا گیا ہے، جیسے انویسٹمنٹ بینکنگ ماڈلنگ اور سائنسی تحقیق، جہاں غلطی کی قیمت API کال کی قیمت سے زیادہ ہوتی ہے۔ Claude Opus 4.7 ان ٹیموں کی پسند ہے جنہیں کئی دنوں تک جاری رہنے والے منصوبوں میں پائیدار بھروسا درکار ہو، کیونکہ یہ ٹرمنل ماحول میں GPT فیملی کے مقابلے نمایاں طور پر کم ہیلوسینیشن ریٹ دکھاتا ہے۔ ادارے عموماً CometAPI کے ذریعے ان ماڈلز کو ایک گیٹ وے سے ضم کرتے ہیں، جس سے 99.9% اپ ٹائم اور فوری فیل اوور یقینی بنتا ہے اگر بنیادی فراہم کنندہ کو کسی خطے میں لیٹنسی بڑھنے کا سامنا ہو۔

حقیقی وقت کی انٹرایکٹو ایپلی کیشنز

حقیقی وقت کے کسٹمر سپورٹ بوٹس یا فوری ویڈیو کیپشننگ جیسی ایپس کو ایسا "سیال" AI چاہیے جو فوراً محسوس ہو۔ اس زمرے میں Mercury 2 اور Gemini 3.1 Flash-Lite بہترین انتخاب ہیں۔ Mercury 2 کی تھروپٹ معیاری ریزننگ ماڈلز سے تقریباً دس گنا زیادہ ہے، جو اسے حقیقی وقت میں دستاویز نویسی کے لیے موزوں بناتی ہے۔ Gemini 3.1 Flash-Lite متوازن ملٹی موڈل صلاحیت دیتا ہے، متن، آڈیو اور تصاویر کو یکجا کونٹیکسٹ میں سابقہ نسلوں کی نسبت تقریباً 2.5x رفتار سے پروسیس کرتا ہے، جبکہ 1 ملین ٹوکنز کی کونٹیکسٹ ونڈو کی سپورٹ برقرار رکھتا ہے۔

Context Window: سنیپٹس سے لے کر مکمل ریپوزٹریز تک

کونٹیکسٹ ونڈو ماڈل کی "مختصر مدتی یادداشت" کا کردار ادا کرتی ہے۔ 2026 میں صنعت معیاری ونڈوز (128K) اور ریپوزٹری سطح کی گنجائش (1M-10M) کے درمیان بٹ گئی ہے۔

- Llama 4 Scout: 10,000,000 ٹوکنز

- Grok 4.20: 2,000,000 ٹوکنز

- Gemini 3.1 Pro: تقریباً 1,048,576 ٹوکنز

- DeepSeek V4 Pro: 1,000,000 ٹوکنز

- GPT-5.5 Pro: 1,050,000 ٹوکنز

کب کونٹیکسٹ سائز اہم ہوتا ہے؟

ایک 128K کونٹیکسٹ ونڈو—جو DeepSeek-V3.2 جیسے ماڈلز کے لیے معیاری ہے—اب واحد مضامین کی گفتگو اور خلاصہ نویسی کے لیے بنیادی معیار ہے۔ تاہم، پروفیشنل سافٹ ویئر انجینئرنگ کو "پورے نظام" کی آگہی درکار ہوتی ہے۔

ایک 1 ملین ٹوکنز کی ونڈو ایک AI ایجنٹ کو پوری سافٹ ویئر ریپوزٹری بشمول تمام سورس فائلز، دستاویزات، اور تاریخی لاگز—کو ایک ہی فاروڈ پاس میں ہضم کرنے دیتی ہے۔ یہ روایتی RAG سسٹمز کے ساتھ وابستہ "میموری ڈرفٹ" کو روکتی ہے جہاں چنکنگ کے دوران متعلقہ ڈیٹا چھوٹ سکتا ہے۔ ایک ٹھوس مثال کوڈ بیس ریفیکٹر ہے: 1M ٹوکنز والا ماڈل سمجھ سکتا ہے کہ کور ڈیٹا بیس اسکیمہ میں تبدیلی کس طرح الگ الگ فائلوں میں پھیلے پچاس مختلف API اینڈ پوائنٹس کو متاثر کرتی ہے، جبکہ چھوٹا ماڈل بیک وقت چند فائلیں ہی "دیکھ" پاتا ہے، جس سے منحصرات ٹوٹ سکتی ہیں۔

اقتصادی موازنہ: فی 1 ملین ٹوکنز یونٹ قیمت

ذیل کا جدول Blended USD/1M Tokens میٹرک استعمال کرتا ہے، جس میں حقیقی دنیا کے استعمال کے پیٹرنز کی عکاسی کے لیے ان پٹ اور آؤٹ پٹ ٹوکنز کا 3:1 تناسب فرض کیا گیا ہے۔

| Model | Blended Price (per 1M) | Relative Value | Discount via CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | تقریباً $11.25 | پریمیم | 20% OFF |

| Claude Opus 4.7 (max) | تقریباً $10.00 | ہائی | 20% OFF |

| Gemini 3.1 Pro | تقریباً $4.50 | متوازن | 20% OFF |

| Kimi K2.6 | تقریباً $1.71 | ہائی ویلیو | 20% OFF |

| DeepSeek V4 Pro | تقریباً $0.53 | ایکسٹریم ویلیو | 20% OFF |

| Qwen3.5 0.8B | تقریباً $0.02 | یوٹیلٹی | 20% OFF |

تمام ریٹس مئی 2026 تک تصدیق شدہ ہیں۔ آفیشل وینڈر ریٹس عموماً متحدہ گیٹ ویز کے ذریعے فراہم کی گئی discounted rates سے تقریباً 20% زیادہ ہوتے ہیں۔

لاگت کی بہتر حکمتِ عملی

معماری منصوبہ بندی میں مدد کے لیے ہم نے تین عام ترقیاتی مراحل کے لیے ماہانہ اخراجات کا اندازہ لگایا ہے۔

- چھوٹی ڈویلپر ٹیم (10M ٹوکنز/ماہ): جو ٹیمیں فیچر بلڈز کے لیے بنیادی طور پر Kimi K2.6 اور سادہ منطق کے لیے DeepSeek V4 Flash استعمال کرتی ہیں ان کے ماہانہ اخراجات $15 سے $40 کی حد میں رہیں گے۔ اس سے جارحانہ پروٹو ٹائپنگ ممکن ہوتی ہے، مالی بوجھ ایک معیاری SaaS سبسکرپشن سے بڑا نہیں ہوتا۔

- درمیانے درجے کی SaaS (100M ٹوکنز/ماہ): وہ اسٹارٹ اپس جو Claude Sonnet 4.6 اور Gemini 3.1 Flash کے ساتھ AI سے چلنے والا آٹومیشن پلیٹ فارم اسکیل کر رہے ہیں، ان کے ماہانہ اخراجات عموماً $250 سے $550 کے درمیان ہوں گے۔ ان ماڈلز پر دستیاب پرومپٹ کیشنگ استعمال کر کے مؤثر لاگت مزید 15% تک کم ہو جاتی ہے۔

- بڑی انٹرپرائز (1B ٹوکنز/ماہ): عالمی ادارے جو GPT-5.5 اور Claude Opus 4.7 کے ساتھ ہائی کنکرنسی ایجنٹک ورک فلو چلاتے ہیں، ان کے ماہانہ اخراجات غالباً $3,000 سے $6,500 ہوں گے۔ اس پیمانے پر متحدہ API گیٹ وے کے ذریعے انضمام مرکزی بلنگ اور متعدد وینڈرز کے علیحدہ معاہدے سنبھالنے کے اوور ہیڈ سے بچنے کے لیے ناگزیر ہو جاتا ہے۔

نتیجہ: 2026 میں اپنی راہ چنیں

"آل پرپز ماڈل" کا دور ختم ہو چکا ہے۔ جدید AI آرکیٹیکچر میں مخصوص ماڈلز کے بیڑے کی آرکسٹریشن درکار ہے: ہائی کمپیوٹ ریزننگ کے لیے GPT-5.5، انٹرایکٹوٹی کے لیے Mercury 2، اور ہائی والیوم ایکزی کیوشن کے لیے DeepSeek V4۔ CometAPI کے ساتھ ایک بار انضمام کر کے، ڈویلپرز بینچ مارکس کی تبدیلی کے ساتھ ماڈلز کو بدلنے کی پورٹیبلٹی حاصل کرتے ہیں، جبکہ ہر ریکویسٹ پر مستقل 20-40% ڈسکاؤنٹ بھی یقینی بناتے ہیں۔

عمومی سوالات

فی الحال سب سے ذہین AI ماڈل کون سا ہے؟

Artificial Analysis Intelligence Index v4.0 کے مطابق GPT-5.5 (xhigh) فی الوقت سب سے ذہین ماڈل ہے، جس کا اسکور 60 ہے۔ اس کے بعد GPT-5.5 (high) 59 پر اور Claude Opus 4.7 (max) 57 پر ہیں۔

حقیقی وقت کی ایپلی کیشنز کے لیے سب سے تیز AI ماڈل کون سا ہے؟

Mercury 2 2026 کا رفتار چیمپئن ہے، جو تقریباً 859.1 ٹوکنز فی سیکنڈ فراہم کرتا ہے۔ کم لیٹنسی (TTFT) کے لیے NVIDIA Nemotron 3 Nano تقریباً 0.40 سیکنڈ کے ردعمل کے ساتھ سرفہرست ہے۔

پروڈکشن ایجنٹس کے لیے انٹیلیجنس انڈیکس اسکور کتنا ہونا چاہیے؟

بنیادی آٹومیشن یا درجہ بندی کے لیے 30 سے 40 کے درمیان اسکور (جیسے GPT-5.4 nano) اکثر کافی ہوتا ہے۔ تاہم، "Agentic Engineering" جہاں AI کوڈ بیس یا مکمل براؤزر سیشنز سنبھالتا ہے، میں 54 سے اوپر اسکور (مثلاً Kimi K2.6 یا GPT-5.5) مستقل مزاج طویل المدتی پلاننگ کے لیے تجویز کیا جاتا ہے۔

یکساں قیمتوں کی صورت میں کیا مجھے GPT-5.5 لینا چاہیے یا Claude Opus 4.7؟

اگر آپ کے ورک فلو میں ٹرمنل ایکزی کیوشن اور "Vibe Coding" شامل ہے تو GPT-5.5 عمومی طور پر ان مخصوص بینچ مارکس میں بہتر رہتا ہے۔ لیکن اگر آپ کو پروفیشنل رائٹنگ، قانونی تحقیق، یا کم ہیلوسینیشن ریٹ کے ساتھ کئی روزہ ایجنٹ سائیکلز میں انتہائی یکسانیت درکار ہو تو Claude Opus 4.7 ان زمروں میں دستاویزی طور پر سرِفہرست ہے۔

کھلے وزن والے ماڈلز (DeepSeek) اور ملکیتی ماڈلز کے درمیان اصل کارکردگی کا فرق کتنا ہے؟

2026 میں خام ریزننگ بینچ مارکس میں یہ خلا تقریباً 10-15% رہ گیا ہے۔ اگرچہ GPT-5.5 (xhigh) جیسے فلیگ شپ اب بھی "عروج" منطق (Index 60) میں سبقت رکھتے ہیں، DeepSeek V4 Pro (Index 52) اور Kimi K2.6 (Index 54) جیسے اوپن ویٹ ماڈلز تقریباً 1/10 لاگت پر 85% سے زیادہ صلاحیت فراہم کرتے ہیں۔

میں ان ماڈلز کی مجموعی API لاگت کیسے کم کر سکتا/سکتی ہوں؟

CometAPI جیسے متحدہ API لیئر کا استعمال آپ کو بڑے پیمانے کی خریداری اور ذہین پاتھ راؤٹنگ کے ذریعے آفیشل وینڈر پرائسنگ کے مقابلے 20% سے 40% کم نرخوں پر پورے کیٹلاگ تک رسائی دیتا ہے۔

طویل دستاویزات کے لیے سب سے بڑا کونٹیکسٹ ونڈو کس ماڈل میں ہے؟

Llama 4 Scout فی الحال مارکیٹ میں سب سے بڑی 10 ملین ٹوکنز کی کونٹیکسٹ ونڈو سپورٹ کرتا ہے۔ اس کے بعد Grok 4.20 2 ملین ٹوکنز کے ساتھ ہے، جبکہ GPT-5.5 Pro، Gemini 3.1 Pro، اور DeepSeek V4 Pro تقریباً 1 ملین ٹوکنز سپورٹ کرتے ہیں۔

کیا ان بینچ مارکس کو زیادہ ابتدائی لاگت کے بغیر آزمانے کا کوئی طریقہ ہے؟

ہاں۔ آپ CometAPI پر مفت اکاؤنٹ بنا کر بغیر کریڈٹ کارڈ کے ٹیسٹ کریڈٹس حاصل کر سکتے ہیں، جس سے آپ بلٹ اِن پلیگراؤنڈ میں 500 سے زائد ماڈلز پر تقابلی کارکردگی کے ٹیسٹ چلا سکتے ہیں۔