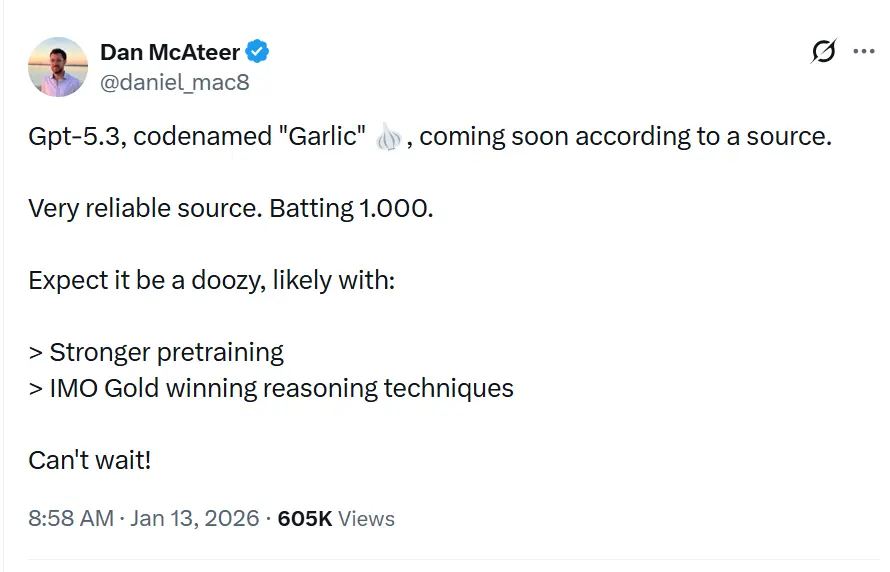

The codename GPT-5.3"Garlic"، کو لیکس اور رپورٹس میں GPT-5.x کی اگلی تدریجی/تکراری ریلیز کے طور پر بیان کیا گیا ہے، جس کا مقصد OpenAI کے لیے استدلال، کوڈنگ، اور پروڈکٹ کارکردگی میں خلا کو پُر کرنا ہے، اور یہ Google کے Gemini اور Anthropic کے Claude کے مسابقتی دباؤ کے جواب میں ہے۔

OpenAI ایک زیادہ گھنی، زیادہ مؤثر GPT-5.x تکرار پر تجربہ کر رہا ہے، جس کی توجہ محض مزید بڑے پیرامیٹر کاؤنٹس کے بجائے زیادہ مضبوط استدلال، تیز تر انفرنس، اور طویل کانٹیکسٹ ورک فلووز پر ہے۔ یہ محض Generative Pre-trained Transformer سلسلے کی ایک اور تکرار نہیں ہے؛ یہ ایک اسٹریٹجک جوابی حملہ ہے۔ CEO Sam Altman کی جانب سے دسمبر 2025 میں اعلان کردہ داخلی "Code Red" سے جنم لینے والا "Garlic"، اس "bigger is better" نظریے کو مسترد کرتا ہے جس نے نصف دہائی سے LLM ترقی پر حکمرانی کی ہے۔ اس کے بجائے، یہ سب کچھ ایک نئے پیمانے پر داؤ پر لگاتا ہے: cognitive density۔

GPT-5.3 “Garlic” کیا ہے؟

GPT-5.3 — جس کا کوڈ نیم “Garlic” ہے — کو OpenAI کے GPT-5 خاندان میں اگلے تکراری قدم کے طور پر بیان کیا جا رہا ہے۔ لیک کو بیان کرنے والے ذرائع Garlic کو ایک سادہ checkpoint یا token tweak کے طور پر نہیں، بلکہ architecture اور training میں ایک ہدفی refinement کے طور پر پیش کرتے ہیں: مقصد یہ ہے کہ محض خام پیمانے پر انحصار کرنے کے بجائے ایک زیادہ کمپیکٹ، inference-efficient ماڈل سے زیادہ اعلیٰ استدلالی کارکردگی، بہتر multi-step planning، اور بہتر long-context رویہ حاصل کیا جائے۔ یہ فریم ورک وسیع تر انڈسٹری رجحانات سے ہم آہنگ ہے جو “dense” یا “high-efficiency” ماڈل ڈیزائنز کی طرف بڑھ رہے ہیں۔

"Garlic" نام—جو ماضی کے celestial (Orion) یا botanical-sweet (Strawberry) کوڈ نیمز سے ایک نمایاں انحراف ہے—رپورٹس کے مطابق ایک دانستہ داخلی استعارہ ہے۔ جس طرح لہسن کی ایک کلی بڑے مگر پھیکے اجزاء کے مقابلے میں پورے کھانے میں زیادہ طاقتور ذائقہ بھر سکتی ہے، اسی طرح اس ماڈل کو اس طرح ڈیزائن کیا گیا ہے کہ یہ انڈسٹری کے دیو ہیکل ماڈلز کے بھاری computational overhead کے بغیر مرتکز ذہانت فراہم کرے۔

"Code Red" کی ابتدا

Garlic کے وجود کو اس وجودی بحران سے الگ نہیں کیا جا سکتا جس نے اسے جنم دیا۔ 2025 کے اواخر میں، ChatGPT کے آغاز کے بعد پہلی بار OpenAI خود کو "defensive position" میں پا رہا تھا۔ Google کا Gemini 3 multimodal benchmarks میں تاج حاصل کر چکا تھا، اور Anthropic کا Claude Opus 4.5 پیچیدہ coding اور agentic workflows کے لیے de-facto معیار بن چکا تھا۔ جواباً، OpenAI کی قیادت نے peripheral projects—بشمول ad-platform experiments اور consumer agent expansions—کو روک دیا تاکہ مکمل توجہ ایسے ماڈل پر دی جا سکے جو ان حریفوں پر ایک "tactical strike" کر سکے۔

Garlic وہی حملہ ہے۔ اسے دنیا کا سب سے بڑا ماڈل بنانے کے لیے نہیں ڈیزائن کیا گیا؛ اسے ہر پیرامیٹر کے حساب سے سب سے ذہین بنانے کے لیے ڈیزائن کیا گیا ہے۔ یہ پچھلے داخلی منصوبوں کی تحقیقی لائنوں کو یکجا کرتا ہے، خاص طور پر "Shallotpeat"، اور اس میں bug fixes اور pre-training efficiencies شامل ہیں جو اسے اپنے وزن سے کہیں بڑھ کر کارکردگی دکھانے کے قابل بناتے ہیں۔

GPT-5.3 ماڈل کی مشاہدہ شدہ تکراروں کی موجودہ حالت کیا ہے؟

جنوری 2026 کے وسط تک، GPT-5.3 داخلی validation کے آخری مراحل میں ہے، جسے Silicon Valley میں اکثر "hardening" کہا جاتا ہے۔ یہ ماڈل فی الحال داخلی logs میں نظر آ رہا ہے اور سخت non-disclosure agreements کے تحت منتخب enterprise partners کی جانب سے spot-test بھی کیا جا چکا ہے۔

مشاہدہ شدہ تکراریں اور "Shallotpeat" انضمام

Garlic تک کا راستہ سیدھا نہیں تھا۔ Chief Research Officer Mark Chen کی لیک شدہ داخلی یادداشتوں سے ظاہر ہوتا ہے کہ Garlic دراصل دو الگ تحقیقی راستوں کا مرکب ہے۔ ابتدا میں، OpenAI ایک ماڈل تیار کر رہا تھا جس کا کوڈ نیم "Shallotpeat" تھا، جو ایک براہِ راست تدریجی اپ ڈیٹ کے طور پر بنایا جا رہا تھا۔ تاہم، Shallotpeat کی pre-training کے دوران محققین نے استدلالی patterns کو "compress" کرنے کا ایک نیا طریقہ دریافت کیا—بنیادی طور پر ماڈل کو training process کے ابتدائی مرحلے ہی میں فالتو neural pathways کو ترک کرنا سکھایا گیا۔

اس دریافت کی وجہ سے standalone Shallotpeat ریلیز کو منسوخ کر دیا گیا۔ اس کی architecture کو زیادہ تجرباتی "Garlic" branch کے ساتھ ضم کر دیا گیا۔ نتیجہ ایک hybrid iteration کی صورت میں نکلا جس میں ایک پختہ GPT-5 variant کا استحکام بھی ہے اور ایک نئی architecture کی دھماکہ خیز استدلالی efficiency بھی۔

ہم کب اندازہ لگا سکتے ہیں کہ ریلیز کا وقت آئے گا؟

OpenAI کی ریلیز تاریخوں کی پیش گوئی کرنا بدنام حد تک مشکل ہے، لیکن "Code Red" کی حیثیت عام ٹائم لائنز کو تیز کر دیتی ہے۔ لیکس، vendor updates، اور competitor cycles کے امتزاج کی بنیاد پر، ہم ایک ممکنہ ریلیز ونڈو کا اندازہ لگا سکتے ہیں۔

بنیادی ونڈو: Q1 2026 (January - March)

اندرونی حلقوں میں اتفاقِ رائے Q1 2026 لانچ پر ہے۔ "Code Red" دسمبر 2025 میں نافذ کیا گیا تھا، ساتھ ہی "as soon as possible" ریلیز کرنے کی ہدایت بھی دی گئی تھی۔ چونکہ ماڈل پہلے ہی checking/validation میں ہے (اور "Shallotpeat" merger نے ٹائم لائن کو مزید تیز کر دیا ہے)، اس لیے جنوری کے آخر یا فروری کے آغاز میں ریلیز سب سے زیادہ ممکن دکھائی دیتی ہے۔

"Beta" رول آؤٹ

ہم ایک مرحلہ وار ریلیز دیکھ سکتے ہیں:

- Late January 2026: منتخب partners اور ChatGPT Pro users کے لیے ایک "preview" ریلیز (ممکنہ طور پر "GPT-5.3 (Preview)" لیبل کے تحت)۔

- February 2026: مکمل API دستیابی۔

- March 2026: ChatGPT کے free tier میں انضمام (محدود queries کے ساتھ) تاکہ Gemini کی مفت رسائی کا مقابلہ کیا جا سکے۔

GPT-5.3 کی 3 نمایاں خصوصیات؟

اگر افواہیں درست ثابت ہوئیں، تو GPT-5.3 ایسی خصوصیات کا ایک مجموعہ متعارف کرائے گا جو محض raw generative creativity کے بجائے utility اور integration کو ترجیح دیتا ہے۔ اس کی feature set systems architects اور enterprise developers کی خواہشات کی فہرست جیسی لگتی ہے۔

1. High-Density Pre-Training (EPTE)

Garlic کا سب سے قیمتی اثاثہ اس کی Enhanced Pre-Training Efficiency (EPTE) ہے۔

روایتی ماڈلز بڑی مقدار میں data دیکھ کر اور associations کا ایک پھیلا ہوا نیٹ ورک بنا کر سیکھتے ہیں۔ اطلاعات کے مطابق Garlic کے training process میں ایک "pruning" مرحلہ شامل ہوتا ہے جہاں ماڈل فعال طور پر معلومات کو condensed کرتا ہے۔

- نتیجہ: ایسا ماڈل جو جسمانی طور پر چھوٹا ہے (VRAM requirements کے اعتبار سے) مگر ایک بہت بڑے سسٹم کی "World Knowledge" برقرار رکھتا ہے۔

- فائدہ: تیز تر inference speeds اور نمایاں طور پر کم API costs، جو "intelligence-to-cost" ratio کے اس مسئلے کو حل کرتی ہیں جس نے Claude Opus جیسے ماڈلز کی بڑے پیمانے پر اپنانے میں رکاوٹ ڈالی۔

2. Native Agentic Reasoning

پچھلے ماڈلز کے برعکس، جنہیں agents کی طرح کام کرنے کے لیے "wrappers" یا پیچیدہ prompt engineering درکار ہوتی تھی، Garlic میں native tool-calling capabilities موجود ہیں۔

یہ ماڈل API calls، code execution، اور database queries کو اپنی vocabulary میں "first-class citizens" سمجھتا ہے۔

- گہرا انضمام: یہ صرف "جانتا" نہیں کہ code کیسے لکھنا ہے؛ یہ code کے environment کو سمجھتا ہے۔ اطلاعات کے مطابق یہ file directory میں navigate کر سکتا ہے، بیک وقت متعدد files کو edit کر سکتا ہے، اور external orchestration scripts کے بغیر اپنے unit tests چلا سکتا ہے۔

3. Massive Context and Output Windows

Gemini کے million-token window کا مقابلہ کرنے کے لیے، افواہ ہے کہ Garlic ایک 400,000-token context window کے ساتھ آئے گا۔ اگرچہ یہ Google کی پیشکش سے چھوٹا ہے، لیکن اس کی بنیادی امتیازی خصوصیت اس window پر "Perfect Recall" ہے، جو ایک نئے attention mechanism کو استعمال کرتی ہے جو 2025 کے ماڈلز میں عام "middle-of-the-context" loss کو روکتی ہے۔

- 128k Output Limit: شاید developers کے لیے اس سے بھی زیادہ دلچسپ چیز output limit کا 128,000 tokens تک بڑھ جانا ہے۔ اس سے ماڈل ایک ہی pass میں مکمل software libraries، جامع legal briefs، یا مکمل طوالت کی novellas تیار کر سکے گا، اور "chunking" کی ضرورت ختم ہو جائے گی۔

4. Drastically Reduced Hallucination

Garlic ایک post-training reinforcement technique استعمال کرتا ہے جس کی توجہ "epistemic humility" پر ہے—ماڈل کو سختی سے یہ سکھایا جاتا ہے کہ وہ کیا نہیں جانتا۔ داخلی tests سے پتہ چلتا ہے کہ اس کی hallucination rate GPT-5.0 کے مقابلے میں نمایاں طور پر کم ہے، جس سے یہ biomedicine اور law جیسی high-stakes industries کے لیے قابلِ عمل بن جاتا ہے۔

یہ Gemini اور Claude 4.5 جیسے حریفوں کے مقابلے میں کیسا ہے؟

Garlic کی کامیابی کو تنہائی میں نہیں، بلکہ اس میدان کے دو موجودہ حکمرانوں—Google کے Gemini 3 اور Anthropic کے Claude Opus 4.5—کے ساتھ براہِ راست موازنہ میں ناپا جائے گا۔

GPT-5.3 “Garlic” بمقابلہ Google Gemini 3

Scale بمقابلہ Density کی جنگ۔

- Gemini 3: اس وقت "kitchen sink" ماڈل ہے۔ یہ multimodal understanding (video، audio، native image generation) میں غالب ہے اور اس کے پاس تقریباً لامحدود context window ہے۔ یہ "messy" حقیقی دنیا کے data کے لیے بہترین ماڈل ہے۔

- GPT-5.3 Garlic: Gemini کی raw multimodal breadth کا مقابلہ نہیں کر سکتا۔ اس کے بجائے، یہ Gemini پر Reasoning Purity کے محاذ پر حملہ کرتا ہے۔ خالص text generation، code logic، اور پیچیدہ instruction following کے لیے، Garlic کا مقصد زیادہ sharp اور "refusal" یا بھٹکاؤ کی طرف کم مائل ہونا ہے۔

- فیصلہ: اگر آپ کو 3 گھنٹے کی video کا تجزیہ کرنا ہے، تو آپ Gemini استعمال کریں گے۔ اگر آپ کو banking app کا backend لکھنا ہے، تو آپ Garlic استعمال کریں گے۔

GPT-5.3 “Garlic” بمقابلہ Claude Opus 4.5

Developer کی روح کے لیے جنگ۔

- Claude Opus 4.5: 2025 کے آخر میں جاری ہونے والا یہ ماڈل developers کو اپنی "warmth" اور "vibes" کی وجہ سے پسند آیا۔ یہ صاف، انسان کے پڑھنے کے قابل code لکھنے اور system instructions پر فوجی درجے کی درستگی سے عمل کرنے کے لیے مشہور ہے۔ تاہم، یہ مہنگا اور سست ہے۔

- GPT-5.3 Garlic: یہی براہِ راست ہدف ہے۔ Garlic کا مقصد Opus 4.5 کی coding proficiency کا مقابلہ کرنا ہے، مگر 2x رفتار اور 0.5x لاگت پر۔ "High-Density Pre-Training" استعمال کر کے، OpenAI Opus-level intelligence کو Sonnet-level budget پر پیش کرنا چاہتا ہے۔

- فیصلہ: "Code Red" خاص طور پر coding میں Opus 4.5 کی بالادستی کی وجہ سے نافذ کیا گیا تھا۔ Garlic کی کامیابی مکمل طور پر اس بات پر منحصر ہے کہ آیا یہ developers کو اپنی API keys دوبارہ OpenAI کی طرف منتقل کرنے پر قائل کر سکتا ہے یا نہیں۔ اگر Garlic Opus جتنا اچھا code لکھ سکے مگر زیادہ تیز چلے، تو مارکیٹ راتوں رات بدل جائے گی۔

Takeway

Garlic کے ابتدائی داخلی builds پہلے ہی مخصوص، high-value domains میں Google کے Gemini 3 اور Anthropic کے Opus 4.5 سے بہتر کارکردگی دکھا رہے ہیں:

- Coding Proficiency: داخلی "hard" benchmarks میں (معیاری HumanEval سے آگے)، Garlic نے GPT-4.5 کے مقابلے میں "logic loops" میں پھنسنے کے رجحان میں کمی دکھائی ہے۔

- Reasoning Density: صحیح نتائج تک پہنچنے کے لیے ماڈل کو "thinking" کے کم tokens درکار ہوتے ہیں، جو o1 (Strawberry) series کی "chain-of-thought" heaviness کے بالکل برعکس ہے۔

| Metric | GPT-5.3 (Garlic) | Google Gemini 3 | Claude 4.5 |

|---|---|---|---|

| Reasoning (GDP-Val) | 70.9% | 53.3% | 59.6% |

| Coding (HumanEval+) | 94.2% | 89.1% | 91.5% |

| Context Window | 400K Tokens | 2M Tokens | 200K Tokens |

| Inference Speed | Ultra-Fast | Moderate | Fast |

نتیجہ

“Garlic” ایک فعال اور قابلِ یقین افواہ ہے: OpenAI کی ایک ہدفی engineering track جو reasoning density، efficiency، اور real-world tooling کو ترجیح دیتی ہے۔ اس کا ظہور ماڈل فراہم کنندگان (OpenAI، Google، Anthropic) کے درمیان تیز ہوتی ہوئی اسلحہ دوڑ کے تناظر میں بہتر طور پر سمجھا جا سکتا ہے—ایسی دوڑ جس میں اسٹریٹجک انعام صرف raw capability نہیں بلکہ فی ڈالر اور فی millisecond latency قابلِ استعمال capability بھی ہے۔

اگر آپ اس نئے ماڈل میں دلچسپی رکھتے ہیں، تو براہِ کرم CometAPI کو فالو کریں۔ یہ ہمیشہ مناسب قیمت پر جدید ترین اور بہترین AI models کے ساتھ اپ ڈیٹ رہتا ہے۔

Developers اب GPT-5.2 ،Gemini 3، Claude 4.5 تک CometAPI کے ذریعے رسائی حاصل کر سکتے ہیں۔ آغاز کے لیے، Playground میں CometAPI کی model capabilities دیکھیں اور تفصیلی ہدایات کے لیے API guide سے رجوع کریں۔ رسائی سے پہلے، براہِ کرم یقینی بنائیں کہ آپ نے CometAPI میں لاگ اِن کیا ہے اور API key حاصل کر لی ہے۔ CometAPI integration میں مدد کے لیے سرکاری قیمت سے کہیں کم قیمت پیش کرتا ہے۔

Ready to Go?→ Sign up for CometAPI today !

اگر آپ AI سے متعلق مزید tips، guides اور news جاننا چاہتے ہیں تو ہمیں VK، X اور Discord پر فالو کریں!