Luma AI کا Uni-1 محض ایک نیا ٹیکسٹ-ٹو-امیج ماڈل نہیں ہے۔ Luma کی اپنی تعبیر میں، یہ ایک “multimodal reasoning model that can generate pixels” ہے، جو “Unified Intelligence” پر قائم ہے تاکہ یہ نیت سمجھ سکے، ہدایات پر عمل کر سکے، اور “آپ کے ساتھ سوچ” سکے۔ کمپنی کی ٹیکنیکل رپورٹ کے مطابق یہ ماڈل ایک decoder-only autoregressive transformer استعمال کرتا ہے جس میں متن اور تصاویر کو ایک واحد interleaved sequence میں پیش کیا جاتا ہے، اور Uni-1 تصویر سازی سے پہلے اور دوران میں ساختہ داخلی استدلال انجام دے سکتا ہے۔ یہی امتزاج Uni-1 کو 2026 کے سب سے دلچسپ امیج ماڈلز میں سے ایک بناتا ہے۔

What is the UNI-1 image model?

Uni-1، Luma AI کا نیا امیج ماڈل ہے اُن کاموں کے لیے جن میں ایک ہی نظام میں فہم اور جنریشن دونوں درکار ہوں۔ Luma اسے ایک ملٹی موڈل ریزننگ ماڈل کے طور پر پیش کرتی ہے، نہ کہ ایک کلاسک diffusion-only امیج انجن کے طور پر؛ یہ فرق اس لیے اہم ہے کہ ماڈل صرف بصری طور پر خوشنما نتائج پیدا کرنے کے بجائے زیادہ کچھ کرتا ہے: یہ ہدایات کی تعبیر، حوالہ جاتی پابندیوں کا تحفظ، اور جنریشن کے حصے کے طور پر منظر کی منطق پر غور کرنے کے لیے ڈیزائن کیا گیا ہے۔ کمپنی کی ٹیکنیکل رپورٹ Uni-1 کو اس کا پہلا unified understanding-and-generation ماڈل قرار دیتی ہے جو ملٹی موڈل جنرل انٹیلیجنس کی سمت ایک قدم ہے۔

Why Uni-1 is different

پرانے پائپ لائن کی ایک حد ہے: فہم کے بغیر امیج جنریشن محدود رہتی ہے۔ Uni-1 کو “unified intelligence” کی سمت ایک قدم کے طور پر پیش کیا گیا ہے، جہاں زبان، ادراک، تخیل، منصوبہ بندی، اور نفاذ سب ایک ہی معمار کے اندر انجام پاتے ہیں۔ یہ محض برانڈنگ نہیں ہے۔ Uni-1 بصری مشابہت سے آگے بڑھ کر ارادی کمپوزیشن، معقولیت، اور منظر کی منطق تک جا سکتا ہے۔

بڑا قصہ یہ ہے کہ امیج ماڈلز زیادہ “ایجینٹک” ہوتے جا رہے ہیں۔ Google کا نیا امیج اسٹیک اب conversational editing، سرچ گراؤنڈنگ، ملٹی امیج فیوژن، اور کردار کی مطابقت پر زور دیتا ہے؛ OpenAI کے GPT Image خاندان میں نیٹو ملٹی موڈیلٹی اور instruction following نمایاں ہیں۔ Uni-1 اسی رُجحان میں شامل ہے، لیکن یہ اس خیال پر زیادہ زور دیتا ہے کہ ماڈل کو تصویر بنانے سے پہلے اس پر “سوچنا” چاہیے۔ یہ Uni-1 کو اُن ورک فلو کے لیے خاص طور پر دلچسپ بناتا ہے جہاں دقت اور تکرار پذیری، بصری نکھار جتنی ہی اہم ہوں۔

How does Uni-1 actually work?

🔬 Tokenization Process

- Text → token sequence

- Image → tokenized patches

- Combined into single interleaved sequence

🔁 Generation Process

- Input prompt + references

- Model performs internal reasoning

- Plans composition

- Generates tokens sequentially

Mathematically: P(x1,...,xn)=∏P(xi∣x1,...,xi−1)P(x_1,...,x_n) = \prod P(x_i | x_1,...,x_{i-1})P(x1,...,xn)=∏P(xi∣x1,...,xi−1)

🧠 Internal Reasoning Layer

Uni-1:

- ہدایات کو توڑ کر اجزا میں بانٹتا ہے

- پابندیوں کو حل کرتا ہے

- رینڈرنگ سے پہلے لے آؤٹ کی منصوبہ بندی کرتا ہے

👉 یہ ڈفیوژن ماڈلز کے مقابلے میں ایک بڑا قدم ہے۔

Decoder-only autoregressive generation

اہم ترین تکنیکی نکتہ یہ ہے کہ Uni-1 ڈفیوژن پر مبنی نہیں بلکہ آٹو ریگریسیو ہے۔ Luma کی ٹیک رپورٹ کے مطابق یہ ایک decoder-only autoregressive transformer ہے، اور متن و تصاویر ایک ہی interleaved sequence میں انکوڈ ہوتے ہیں۔ سادہ الفاظ میں، ماڈل محض شور سے شروع ہو کر رفتہ رفتہ “ڈینویز” کرتے ہوئے تصویر تک نہیں پہنچتا؛ اس کے بجائے یہ ٹوکنز قدم بہ قدم جنریٹ کرتا ہے، جس سے ماڈل کو پرامپٹ پر استدلال کرنے، متضاد پابندیوں کو حل کرنے، اور کمپوزیشن کی منصوبہ بندی کرنے کا موقع ملتا ہے—رینڈرنگ سے پہلے اور اس کے دوران۔

🔬 Tokenization Process

- Text → token sequence

- Image → tokenized patches

- Combined into single interleaved sequence

Diffusion vs Autoregressive

| Feature | Diffusion Models | Uni-1 (Autoregressive) |

|---|---|---|

| Generation | Noise → Image | Token-by-token |

| Reasoning | Limited | Strong |

| Editing | Weak | Multi-turn |

| Text rendering | Poor | Strong |

| Control | Low | High |

Core Architecture

Uni-1 ہے:

- Decoder-only autoregressive transformer

- متن + تصاویر کے لیے مشترکہ ٹوکن اسپیس

یہ معمار اس لیے اہم ہے کہ یہ ماڈل کو اُس وقت ربط برقرار رکھنے کا موقع دیتا ہے جب پرامپٹ پیچیدہ ہو۔ Luma کہتی ہے کہ Uni-1 ہدایات کو توڑ سکتا ہے، متصادم پابندیوں کو سلجھا سکتا ہے، اور رینڈرنگ شروع ہونے سے پہلے تصویر کی منصوبہ بندی کر سکتا ہے۔ یہ خصوصاً اُن کاموں کے لیے مفید ہے جیسے structured scene completion، کثیر موضوعات کی جگہ بندی، ملٹی ٹرن ریفائنمنٹ، اور ایسی ترامیم جن میں آؤٹ پُٹ کو ریفرنس امیج کے مطابق رہتے ہوئے نئی ہدایات پر بھی عمل کرنا ہو۔

What the model seems designed to do better

تصاویر بنانا سیکھنے سے فہم بہتر ہوتی ہے۔ Luma کہتی ہے کہ ماڈل کی امیج-جنریشن ٹریننگ باریک بصری فہم کو مادّی طور پر بہتر بناتی ہے—خصوصاً ریجنز، آبجیکٹس، اور لے آؤٹس پر۔ یہی وجہ ہے کہ Uni-1 کو یک طرفہ جنریٹر کے بجائے ایک متحدہ نظام کے طور پر دیکھا جاتا ہے جہاں جنریشن اور فہم ایک دوسرے کو مضبوط کرتے ہیں۔ انفرنس کے لحاظ سے، اس کا مطلب ہے Uni-1 “دیکھنے” اور “بننے” کے فرق کو کم کرنے کی کوشش کرتا ہے۔ یہ ڈفیوژن ماڈلز کے مقابلے میں ایک بڑا قدم ہے۔

Generation Process:

- Input prompt + references

- Model performs internal reasoning

- Plans composition

- Generates tokens sequentially

Mathematically: P(x1,...,xn)=∏P(xi∣x1,...,xi−1)P(x_1,...,x_n) = \prod P(x_i | x_1,...,x_{i-1})P(x1,...,xn)=∏P(xi∣x1,...,xi−1)

What features and core advantages does Uni-1 offer?

Strong instruction-following and directability

Uni-1 کی سب سے بڑی خوبی کنٹرول ہے۔ ماڈل precision ایڈیٹنگ، ساختہ ریفرنس کے استعمال، اور تکرار پذیر ورک فلو کے لیے بنایا گیا ہے۔ تخلیق کاروں کے لیے اس کا مطلب ہے کم پرامپٹ آزمایشی پن اور زیادہ قابلِ تکرار نتائج۔

Uni-1 کی ایک عملی برتری یہ ہے کہ یہ کنٹرولڈ iteration کے لیے تیار ہے۔ سیڈز سے نتائج قابلِ نقل رہتے ہیں، جبکہ ریفرنس رولز ماڈل کو بتاتے ہیں کہ کسی تصویر کو کردار کی شناخت، موڈ، پیلیٹ، یا کمپوزیشن کی رہنمائی کرنی ہے یا نہیں۔ اس سے Uni-1 محض پرامپٹ-ڈرائیون ماڈل کے مقابلے میں زیادہ قابلِ ہدایت بنتا ہے—خصوصاً اُن ٹیموں کے لیے جو اشتہارات، اسٹوری بورڈز، پروڈکٹ ماک اپس، یا برانڈ اثاثے تیار کرتی ہیں جہاں مطابقت اہم ہو۔

Reference-based generation that preserves identity

ایک بڑی خوبی ریفرنس ہینڈلنگ ہے۔ Luma واضح طور پر کہتی ہے کہ Uni-1 source-grounded کنٹرولز استعمال کرتا ہے اور ایک یا زیادہ ریفرنسز سے شناخت، کمپوزیشن، اور کلیدی بصری پابندیوں کو برقرار رکھ سکتا ہے۔ یہ اسے تجارتی ورک فلو کے لیے پرکشش بناتا ہے، جیسے برانڈ کردار، پروڈکٹ ماک اپس، کیمپین اثاثے، اور ہر وہ پروجیکٹ جہاں موضوع کو مختلف ورژنز میں بھی قابلِ شناخت رہنا ہو۔ یہ اُن واضح طریقوں میں سے ایک ہے جن میں Uni-1 محض جمالیاتی امیج سسٹمز سے مختلف ہے۔

Cultural fluency and style breadth

Luma ثقافتی طور پر باخبر جنریشن پر بھی زور دیتا ہے۔ اس کا “Cultured” سیکشن میمز، مانگا، سنیماٹک لک، کیژول فوٹوز، کھیل، اور جانوروں کی تصویریات تک پھیلا ہوا ہے—یہ دکھاتے ہوئے کہ ماڈل ایک عام اسٹائل کے بجائے کثیر بصری زبانوں میں کام کرنے کے لیے بنایا گیا ہے۔ یہ اس لیے اہم ہے کہ ایک اچھا جدید امیج ماڈل صرف حقیقت پسندانہ منظر نہیں بناتا؛ اسے انٹرنیٹ کلچر، ایڈیٹوریل ڈیزائن، اسٹائلائزڈ السٹریشن، اور سوشل کانٹینٹ کے بصری ضوابط بھی سمجھنے ہوتے ہیں۔

Multimodal thinking as a design choice

اصل فرق صرف یہ نہیں کہ Uni-1 تصاویر بناتا ہے، بلکہ یہ کہ Luma امیج جنریشن کو ایک reasoning ٹاسک کے طور پر فریم کرتی ہے۔ Uni-1 ساختہ داخلی استدلال کر سکتا ہے، اور تصاویر بنانا سیکھنے سے ریجنز، آبجیکٹس، اور لے آؤٹس پر باریک فہم بہتر ہوتی ہے۔ یہ اس بات کی طرف اشارہ ہے کہ ماڈل رینڈرنگ سے پہلے منظر کو سمجھنے کے لیے بنایا گیا ہے، نہ کہ صرف پرامپٹ کی شماریاتی تقلید کے لیے۔

Performance Benchmarks

Luma’s own human-preference results

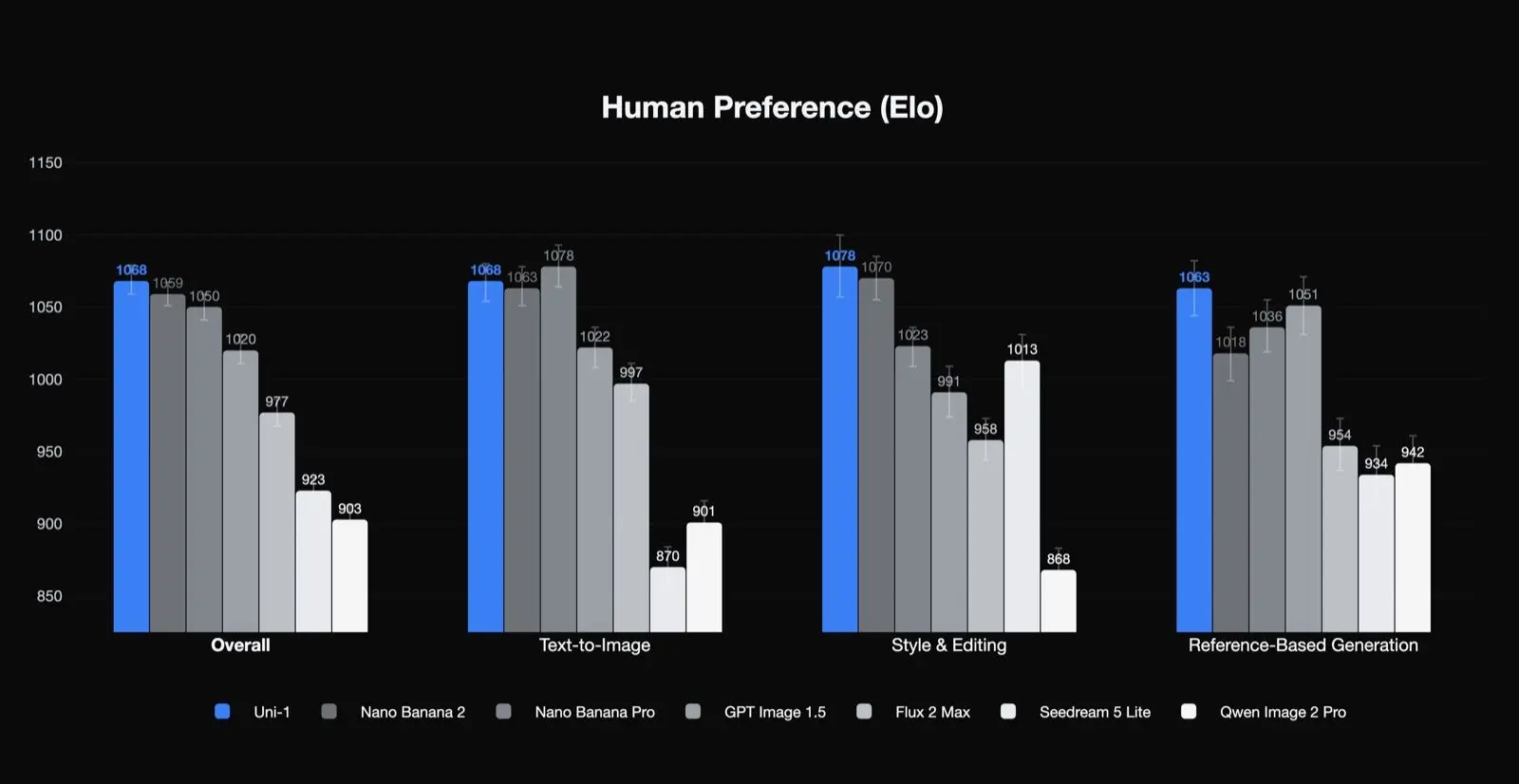

Uni-1 انسانی ترجیح کے Elo میں مجموعی معیار، اسٹائل اور ایڈیٹنگ، اور ریفرنس-بنیاد جنریشن میں پہلے نمبر پر، جبکہ ٹیکسٹ-ٹو-امیج میں دوسرے نمبر پر ہے۔ یہ نتیجہ معنی خیز ہے کیونکہ یہ ظاہر کرتا ہے کہ ماڈل اُن کاموں میں خاصا مضبوط ہے جن کی پروڈکشن ٹیموں کو فکر ہوتی ہے: ایڈیٹنگ، مطابقت، اور guided transformation۔ یہ یہ بھی اشارہ کرتا ہے کہ اس کے بہترین استعمالات محض ایک-شاٹ ٹیکسٹ-ٹو-امیج سے آگے جاتے ہیں۔

RISEBench: reasoning-informed visual editing

سب سے زیادہ توجہ پانے والا بینچ مارک RISEBench ہے، جو reasoning-informed visual editing کو زمانی، سببی، مکانی، اور منطقی استدلال پر پرکھتا ہے۔ Luma کے لانچ پر تیسری فریق کی رپورٹس کے مطابق Uni-1 کا مجموعی اسکور RISEBench پر 0.51 ہے، جو Google کے Nano Banana 2 کے 0.50، Nano Banana Pro کے 0.49، اور OpenAI کے GPT Image 1.5 کے 0.46 سے آگے ہے۔ مکانی استدلال پر، Uni-1 کا بتایا گیا اسکور 0.58 ہے، جبکہ Nano Banana 2 کا 0.47۔ منطقی استدلال پر، Uni-1 کا بتایا گیا اسکور 0.32 ہے—جو GPT Image 1.5 کے 0.15 سے دگنا سے زیادہ ہے۔ مجموعی فرق بہت بڑا نہیں، مگر مشکل ترین استدلالی زمروں میں کافی نمایاں ہے۔

ODinW-13 and the “generation improves understanding” claim

Uni-1، ODinW-13—ایک اوپن-وکیبلری ڈینس ڈٹیکشن بینچ مارک—پر بھی مضبوط کارکردگی دکھاتا ہے۔ Luma کے ٹیکنیکل ڈیٹا کی رپورٹنگ کے مطابق مکمل ماڈل 46.2 mAP اسکور کرتا ہے، جو Google کے Gemini 3 Pro کے 46.3 کے قریب ہے۔ اسی رپورٹنگ کے مطابق ایک understanding-only ویریئنٹ 43.9 mAP اسکور کرتا ہے، جس سے ظاہر ہوتا ہے کہ جنریشن ٹریننگ فہم کو 2.3 پوائنٹس تک بہتر بناتی ہے۔ یہ قابلِ ذکر دریافت ہے کیونکہ یہ Luma کے مرکزی موقف کی تائید کرتی ہے: امیج جنریشن اور امیج انڈرسٹینڈنگ ممکن ہے باہم تقویت دیں، نہ کہ ایک دوسرے کے مقابل ہوں۔

Price of Uni-1 API

| Input price (text) | $0.50 |

|---|---|

| Input price (images) | $1.20 |

| Output price (text and thinking) | $3.00 |

| Output price (images) | $45.45 |

صارفین کی جانب پر، Luma کے پرائسنگ پیج پر Plus $30/month، Pro $90/month، اور Ultra $300/month درج ہیں، جن میں مفت ٹرائل کریڈٹس تمام پلانز میں شامل ہیں۔ اس کا مطلب یہ ہے کہ غور کرنے کے لیے بنیادی طور پر دو پرتیں ہیں: پلیٹ فارم کے لیے کنزیومر ممبرشپ اور پروڈکشن استعمال کے لیے ماڈل-سطح کی API پرائسنگ۔

فی الحال، CometAPI کی Uni-1 API “جلد دستیاب” ہے، اور لانچ پر ڈسکاؤنٹ کا وعدہ ہے۔ موجودہ وقت میں، CometAPI بہترین raw image ماڈلز بھی پیش کرتا ہے، مثلاً Midjourney اور Nano Banana 2۔

Uni-1 vs GPT Image 1.5 vs Nano Banana 2

Uni-1 versus Google’s Nano Banana 2

Nano Banana 2 ریفرنس ہینڈلنگ کی وسعت اور ایکو سسٹم انٹیگریشن پر زیادہ مضبوط دکھائی دیتا ہے۔ Google امیج سرچ گراؤنڈنگ، مکالماتی تکرار، اور زیادہ سے زیادہ 14 ریفرنسز کے ساتھ ریفرنس-ہیوی ورک فلوز پر زور دیتا ہے۔ اس کے برعکس، Uni-1 کو زیادہ واضح طور پر reasoning، منظر کی معقولیت، اور precision ایڈیٹنگ کے گرد ایک متحدہ ماڈل معمار میں فریم کیا گیا ہے۔ عملی طور پر، Google رفتار، مرکزی دھارے کی پروڈکشن اسکیل، اور نیٹو Google گراؤنڈنگ کے لیے موزوں دکھائی دیتا ہے؛ Luma ساختہ بصری استدلال اور قابلِ ہدایت امیج ایڈیٹنگ کے لیے موزوں نظر آتا ہے۔

Uni-1 کے گرد عوامی تقابل میں، سودا صاف ہے: Nano Banana 2 خالص text-to-image معیار اور رفتار میں بہت مضبوط دکھائی دیتا ہے، جبکہ Uni-1 استدلال-بھاری ایڈیٹنگ، ریفرنس کنٹرول، اور instruction fidelity پر زیادہ زور دیتا ہے۔

Uni-1 versus OpenAI’s GPT Image

بینچ مارک رپورٹنگ میں، Uni-1 مجموعی طور پر RISEBench پر GPT Image 1.5 سے آگے ہے، اور منطقی استدلال میں زیادہ واضح برتری دکھاتا ہے۔ OpenAI کے GPT Image خاندان کے مقابلے میں، Uni-1 زیادہ تنگ اور جارحانہ طور پر بصری استدلال اور کنٹرولڈ ایڈیٹنگ کے گرد پوزیشنڈ ہے۔ OpenAI کی دستاویزات عالمی علم، ملٹی موڈل فہم، اور سیاقی آگاہی پر زور دیتی ہیں؛ Luma کی دستاویزات ساختہ داخلی استدلال، ریفرنس-گراؤنڈڈ کنٹرول، اور بینچ مارکڈ visual-editing مہارت پر۔ چنانچہ دونوں ملٹی موڈل ہیں، مگر Uni-1 زیادہ واضح طور پر “امیج-اسپیشلسٹ ریزننگ ماڈل” ہے، جبکہ GPT Image ایک عام ملٹی موڈل سسٹم پڑھتا ہے جو تصاویر بہت اچھی طرح بناتا ہے۔

Price comparison across the three

پرائسنگ میں تقابل آؤٹ پٹ سائز اور پروڈکٹ ٹِیر پر منحصر ہے، لہٰذا یہ مکمل طور پر ایک جیسا موازنہ نہیں۔ Uni-1 کا شائع شدہ 2048px مساوی تقریباً $0.0909 فی امیج ہے۔ Google کے تازہ امیج-ماڈل پرائسنگ پیج پر تازہ Gemini امیج پریویو کے لیے $0.134 فی 1K/2K امیج اور $0.24 فی 4K امیج درج ہے، جبکہ OpenAI کے GPT Image پرائسنگ پیج پر 1024x1024 کے لیے کم معیار پر فی امیج $0.011، درمیانی معیار پر $0.042، اور اعلیٰ معیار پر $0.167 درج ہے، بڑے اعلیٰ معیار کے آؤٹ پٹس $0.25 تک۔ دوسرے لفظوں میں، کم سرے پر OpenAI کہیں سستا ہو سکتا ہے، رفتار-اور-اسکیل سرے پر Google جارحانہ ہے، اور Uni-1 ایک مضبوط 2K-مائل قیمت-کارکردگی پروفائل کے ساتھ درمیان میں آتا ہے۔

Philosophical Differences

| Model | Approach |

|---|---|

| Uni-1 | Unified multimodal intelligence |

| GPT Image | LLM + image generation |

| Nano Banana 2 | Optimized production diffusion |

Detailed Comparison Table

| Feature | Uni-1 | GPT Image 1.5 | Nano Banana 2 |

|---|---|---|---|

| Architecture | Autoregressive | Hybrid | Diffusion |

| Multimodal unification | ✅ Native | Partial | ❌ |

| Reasoning ability | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ |

| Image quality | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Text rendering | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐ |

| Editing workflows | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐⭐ |

| Speed | Medium | Fast | Fast |

| Control | High | Medium | Medium |

CometAPI GPT Image 1.5، Nano Banana 2، اور آنے والے Uni-1 کے لیے انٹرایکٹو raw images اور API پروگرامنگ فراہم کرتا ہے۔ ڈسکاؤنٹڈ پرائسنگ اور pay-as-you-go آپشنز اسے ڈویلپرز کی پسندیدہ چوائس بناتے ہیں۔

What Uni-1 is best for

Uni-1 اُن حالات کے لیے خاص طور پر مضبوط دکھائی دیتا ہے جہاں آپ کو repeatability، character consistency، یا multi-reference control درکار ہو۔ اس میں برانڈ کیمپینز، پروڈکٹ ماک اپس، ایڈیٹوریل کانسیپٹس، اسٹوری بورڈز، لوکلائزیشن ویرینٹس، اور وہ امیج ایڈٹس شامل ہیں جہاں کمپوزیشن برقرار رہنی چاہیے مگر اسٹائل یا ماحول بدل سکتا ہو۔ Luma کی اپنی مثالیں انہی استعمالات پر زور دیتی ہیں، اور ماڈل کا “Create vs Modify” تقسیم بنیادی طور پر عام پروڈکشن درد کے نکات کا براہِ راست جواب ہے۔

اگر آپ کا کام زیادہ تر “ایک پرامپٹ سے کچھ خوبصورت بنا دو” ہے، تو فرق کم ڈرامائی محسوس ہو سکتا ہے۔ مگر اگر آپ کا ورک فلو یہ ہے کہ “پانچ متعلقہ ورژنز بناؤ، کردار وہی رکھو، فریمنگ برقرار رکھو، روشنی بدل دو، اور آئندہ ہفتے بھی اسے دہرایا جا سکے” تو Uni-1 کی ڈیزائن یقیناً معنی خیز ہو جاتی ہے۔ یہ ایک استنباط ہے، مگر وہی جو Luma کی کنٹرول خصوصیات سے فطری طور پر نکلتا ہے۔

Best practices for getting better results with Uni-1

صحیح موڈ سے آغاز کریں۔ Luma کی رہنمائی سادہ ہے: جب نئی سِین چاہیے ہو تو Create، اور جب موجودہ کو برقرار رکھنا ہو تو Modify۔ ان نیتوں کو ملانے سے آؤٹ پٹس غیر مستحکم ہو جاتی ہیں۔

ریفرنس لیبلز کو پیشہ ورانہ انداز میں استعمال کریں۔ Luma “Use IMAGE1 as a STYLE reference” یا “Use IMAGE2 as LIGHTING” جیسے فقرے تجویز کرتی ہے۔ ماڈل تب بہتر کرتا ہے جب ہر ریفرنس کا ایک واضح “کام” ہو، محض مبہم “inspiration” کے بجائے۔

اچھی چیز ملتے ہی سیڈ لاک کر دیں۔ Luma واضح طور پر پہلے بغیر سیڈ کے ایکسپلور کرنے، پھر مضبوط نتیجہ ملنے پر سیڈ محفوظ کرنے کی سفارش کرتی ہے۔ اس کے بعد ایک وقت میں ایک متغیر بدلیں۔ یہ جنریشن کو کنٹرولڈ پروڈکشن سسٹم میں بدلنے کا آسان ترین طریقہ ہے۔

واضح اور ٹھوس رہیں۔ Luma “beautiful” یا “amazing” جیسے مبہم الفاظ سے گریز کا کہتی ہے، اور اس کے بجائے “1970s Italian giallo film poster” یا ٹھیک ٹھیک کیمرا-اسٹائل جیسے اشاروں کی حوصلہ افزائی کرتی ہے۔ عملی طور پر، مخصوص پرامپٹس اکثر شاعرانہ پرامپٹس سے بہتر ہوتے ہیں کیونکہ ماڈل حقیقی ساخت پر اینکر ہو سکتا ہے۔

Create → Modify چین استعمال کریں۔ Luma اسے اپنے طاقتور ترین ورک فلوز میں سے ایک کہتی ہے: Create میں ایکسپلور کریں، پھر Modify میں ریفائن کریں۔ سنجیدہ پروڈکشن کام کے لیے یہی میٹھا نقطہ ہے، کیونکہ یہ بیک ٹریکنگ کم کرتا ہے اور کمپوزیشن کے اچھے حصے محفوظ رکھتے ہوئے تفصیلات سخت کرتا ہے۔

Final verdict

Uni-1 Luma کا واضح ترین بیان ہے کہ امیج جنریشن “پرامپٹ اندر، تصویر باہر” سے “reasoning-guided بصری تخلیق” کی طرف بڑھ رہی ہے۔ اس کی عوامی مضبوطیاں کنٹرول، ریفرنس ہینڈلنگ، reproducibility، اور ایک ایسا ماڈل معمار ہے جو زبان اور پکسلز کو ایک ہی نظام میں رکھتا ہے۔

تخلیق کاروں اور ٹیموں کے لیے جو high-click بصری آؤٹ پُٹ، مسلسل کردار، دقیق ترامیم، اور ہائی-ریزولوشن پرائسنگ کی وضاحت کو اہمیت دیتے ہیں، Uni-1 یقیناً دیکھنے کے لائق ماڈل ہے۔ اگر API رول آؤٹ ہمواری سے ہوا، تو یہ 2026 میں Google کے Nano Banana 2 اور OpenAI کے GPT Image 1.5 کا سب سے دلچسپ متبادل بن سکتا ہے۔

Planning to start creating raw images? CometAPI، ملٹی موڈل ماڈل APIs کے لیے ایک آل-ان-ون ایگریگیشن پلیٹ فارم، آپ کا خیر مقدم کرتا ہے!