خلاصہ (TL;DR): OpenClaw کے حالیہ ریلیز میں OpenAI کے GPT-5.4 کے لیے فرسٹ کلاس، فارورڈ-کمپیٹیبل سپورٹ شامل کی گئی ہے اور “memory hot-swappable” آرکیٹیکچر متعارف کرایا گیا ہے جس سے OpenClaw ایجنٹس رَن ٹائم کے دوران کم سے کم خلل کے ساتھ یہ بدل سکتے ہیں کہ کون سا ماڈل اور کون سا میموری اسٹور ایکٹیو ہو۔ اس سے بڑے کانٹیکسٹ والے ورک فلو (GPT-5.4 کی وسیع تر کانٹیکسٹ ونڈوز)، آن دی فلائی ماڈل اسپیشلائزیشن، اور پروڈکشن ایجنٹس کے لیے لاگت/لیٹنسی آپٹیمائزیشن کھلتی ہیں۔ اپ گریڈ OpenClaw کی ریلیزز اور ساتھ کی ڈاکس میں دستیاب ہے؛ ذیل کی مثالیں عملی کنفیگریشن، کوڈ اسنیپٹس، بینچ مارک سیاق و سباق، اور تجویز کردہ بہترین طریقوں کو دکھاتی ہیں۔

OpenClaw کے اپ ڈیٹ نے درحقیقت کیا بھیجا (فوری خلاصہ)

9 مارچ، 2026 کو اوپن سورس ایجنٹ فریم ورک OpenAI سے متصل پروجیکٹ OpenClaw نے ایک بڑا کور ریلیز (2026.3.7) جاری کیا جس نے GPT-5.4 کے لیے فرسٹ کلاس سپورٹ اور اس کے کانٹیکسٹ انجن میں ایک نیا memory hot-swappable میکانزم شامل کیا۔ یہ ریلیز ایک وسیع پیمانے پر استعمال ہونے والے تجرباتی ایجنٹ فریم ورک کو مینٹینرز کے بقول “Agent Operating System” میں تبدیل کرتی ہے — جس کا ہدف ڈیولپرز اور ٹیموں کے لیے پروڈکشن گریڈ ایجنٹ ورک فلو اور ماڈل سوئچنگ کو بے رکاوٹ بنانا ہے۔

ایجنٹ بلڈرز کے لیے 3 عملی نکات:

- فرسٹ کلاس GPT-5.4 سپورٹ — ماڈل الیاسز اور پرووائیڈر میپنگز جن سے ایجنٹس GPT-5.4 کو پرائمری ایکزیکیوشن ماڈل کے طور پر منتخب کر سکتے ہیں (چینل اووررائیڈز اور per-agent ماڈل پنز سمیت)۔

- کانٹیکسٹ انجن اور ڈسٹری بیوٹڈ چینل بائنڈنگ — اس میں بہتری کہ OpenClaw میموری، ٹول آؤٹ پٹس، اور چینل ہسٹری سے طویل کانٹیکسٹ کیسے اسمبل کرتا ہے تاکہ ہائی کیپیسٹی ماڈلز کو اچھی ساخت والے ان پٹس ملیں۔

- میموری hot-swappable آرکیٹیکچر — زیادہ واضح میموری پلگ اِن سرفیسز اور ورک فلو، تاکہ آپ میموری بیک اینڈز بدل سکیں یا ایجنٹس اپ گریڈ کر سکیں بغیر “شناخت” کھوئے یا پرسسٹڈ اسٹیٹ کرپٹ کیے (میموری خود سنگل سورس آف ٹروتھ رہتی ہے)۔ OpenClaw کی میموری ڈیزائن (سادہ Markdown فائلیں، انڈیکسڈ سرچ، پلگ انائزڈ ریٹریول) وہی ہے جو محفوظ ہاٹ-سواپنگ کو ممکن بناتی ہے۔

GPT-5.4 — GPT-5.4 کیا ہے اور بینچ مارک میں پیش رفت

GPT-5.4 OpenAI کا تازہ ترین فرنٹیئر ماڈل ریلیز ہے جو پیشہ ورانہ پروڈکٹیوٹی پر بھرپور توجہ دیتا ہے (اسپریڈشیٹس، ڈاکیومنٹ اور پریزنٹیشن ایڈٹنگ، ملٹی اسٹیپ ریزننگ اور ٹول ڈرائیونگ)۔ OpenAI اور آزادانہ پریس کوریج کے مطابق، اس ریلیز میں زور دیا گیا ہے:

- وسیع تر کانٹیکسٹ: GPT-5.4 نے کانٹیکسٹ ونڈوز کی اگلی سطح متعارف کرائی ہے، تجرباتی 1M ٹوکن اور بہتر لانگ کانٹیکسٹ ہینڈلنگ Codex/Codex-کمپیٹیبل اینڈ پوائنٹس کے ذریعے دستیاب ہے — کنفیگریشن نوابز جیسے

model_context_windowاورmodel_auto_compact_token_limitڈیولپرز کے لیے ایکسپوزڈ ہیں۔ اس سے آپ بات چیت کی بہت بڑی اسٹیٹ، ڈاکیومنٹس اور کوڈ بیسز کو ایکٹیو کانٹیکسٹ میں رکھ سکتے ہیں۔ - اسپریڈشیٹ اور ریزننگ کی اعلیٰ درستگی — OpenAI رپورٹ کرتا ہے کہ اسپریڈشیٹ ماڈلنگ ٹاسکس پر بڑا بہتری آئی (mean اسکورز ~87% بمقابلہ ~68% GPT-5.2 پر ان کے بینکنگ/اینالسٹ اسپریڈشیٹ بینچ مارک میں)۔

- درستگی اور فیکچوالٹی میں بہتری: ابتدائی ریویوز اور QA بتاتے ہیں کہ ہیلوسینیشنز میں ~33% کمی اور GPT-5.2 کے مقابلے میں کم error-prone آؤٹ پٹس ہیں، خصوصاً ڈاکیومنٹ ڈرافٹنگ اور اسپریڈشیٹ کام میں۔ ریویورز نے کچھ پروڈکٹیوٹی ٹاسکس پر error-prone رسپانسز میں ~18% کمی کا بھی حوالہ دیا۔

- انٹیگریٹڈ کمپیوٹر-یوز اور Codex لینئج میں بہتری — GPT-5.4 میں Codex لینئج سے اخذ کردہ صلاحیتیں شامل ہیں جو کوڈ جنریشن، انٹرایکٹو ڈیبگنگ، اور آپریشنل ٹول ڈرائیونگ (کچھ ڈیموز میں ماؤس/کی بورڈ/اسکرین شاٹ آٹومیشن) کو بہتر بناتی ہیں۔ یہ اسے write-run-inspect-patch سائیکل کے لیے زیادہ موزوں بناتا ہے جو ایجنٹ لوپس میں عام ہے۔

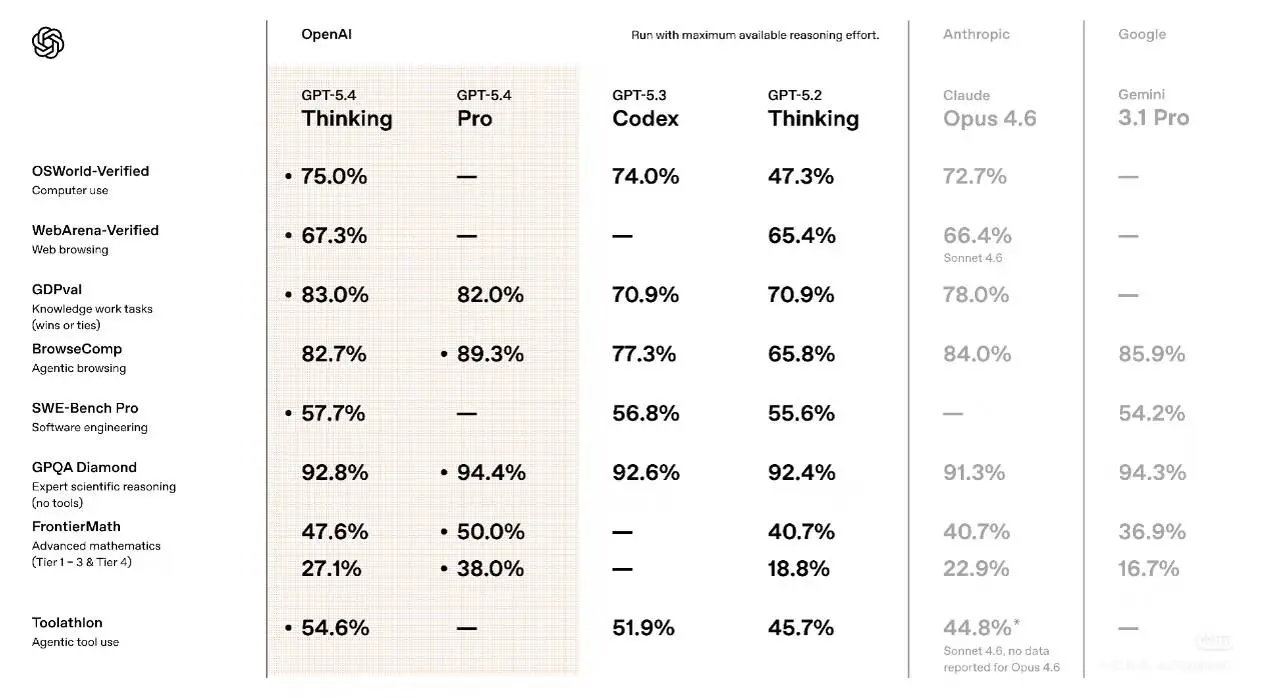

بینچ مارکس اور تقابلی سیاق (نمبر کیا معنی رکھتے ہیں)

- اسپریڈشیٹ ماڈلنگ: OpenAI کا داخلی اسپریڈشیٹ بینچ مارک: GPT-5.4 کے لیے ~87.3% mean اسکور بمقابلہ GPT-5.2 کے لیے ~68.4%۔ یہ وہ سرخی ہے جو وینڈر ٹاسک-اسپیسیفک فائدے دکھانے کے لیے استعمال کرتا ہے۔

- کمپیوٹر انٹریکشن (OSWorld / ایجنٹ اسٹائل ٹیسٹس): آزاد ٹیسٹرز اور کمیونٹی رنز دکھاتے ہیں کہ GPT-5.4 ایجنٹ انٹریکشن ٹاسکس میں بہتری لاتا ہے جن میں ڈیسک ٹاپ یا سمولیٹڈ UI مینیپولیشن شامل ہو، بعض اوقات ان ٹاسک سوئیٹس پر حالیہ Anthropic ماڈل ویریئنٹس کو معمولی فرق سے پیچھے چھوڑ دیتا ہے (ایجنٹس کے لیے یہ فرق معنی خیز ہیں، مگر ہر ورک لوڈ میں فیصلہ کن نہیں)۔

تشریح: GPT-5.4 کوئی “جادو کی گولی” نہیں جو ہر چیز جیت لے۔ اس کی واضح طاقتیں انٹیگریٹڈ ٹول یوز، کوڈ ایکزیکیوشن پیٹرنز، اور اسپریڈشیٹ ریزننگ میں ہیں — جو بالکل وہی ورک لوڈز ہیں جو OpenClaw ایجنٹس اکثر چلاتے ہیں۔ ایجنٹ بلڈرز کے لیے Codex لینئج سے بہتر ایگزیکیوٹر ریلائی ایبیلٹی + پلانر کی قابلیت + بہتر لانگ کانٹیکسٹ ہینڈلنگ کا امتزاج نہایت متعلقہ ہے۔

OpenClaw GPT-5.4 کو سپورٹ کرتا ہے: کیا بدلا اور کیوں اہم ہے

OpenClaw کا ریلیز (پراجیکٹ ریلیزز پیج دیکھیں) ماڈل ریزولوَرز اور رَن ٹائم کو GPT-5.4 کے وسیع کانٹیکسٹ اور ٹوکن لمٹس کے ساتھ فارورڈ-کمپیٹیبل بناتا ہے اور “memory hot-swappable” قابلیت شامل کرتا ہے تاکہ ایجنٹس رَن ٹائم میں میموری بیک اینڈز یا ماڈلز بدل سکیں۔ یہ تین ٹھوس طریقوں سے کیا گیا: 1) بڑے کانٹیکسٹ اور ٹوکن لمٹس قبول کرنے کے لیے ماڈل میٹا ڈیٹا اور ریزولوَر اپ ڈیٹس؛ 2) ایجنٹ رَن ٹائم تبدیلیاں تاکہ ماڈل سوئچز گریس فُلی آرکسٹریٹ ہوں اور کیش وارم اپ ہو سکے؛ 3) ایک میموری API جو متعدد میموری چینلز اور ہاٹ سوئچ ٹرگرز کی اجازت دیتا ہے۔

ورژن 2026.3.7 میں GPT-5.4 کی سپورٹ اور memory hot-swappable ڈیزائن دو عملی، تکمیلی فوائد فراہم کرتے ہیں:

- سادہ ماڈل اپ گریڈ راستہ۔ OpenClaw اب GPT-5.4 کو ایجنٹس کے لیے منتخب کیے جانے والے “رَن ٹائم” کے طور پر پیش کر سکتا ہے، جس سے آپ پرانے GPT-5.x ماڈلز یا متبادل وینڈرز سے سوئچ کر سکتے ہیں بغیر اپنے ایجنٹ لاجک کو دوبارہ بنانے کے۔ OpenClaw اپ ڈیٹ کور میں GPT-5.4 کے مستحکم انٹیگریشن کا واضح اعلان کرتا ہے۔

- میموری ہاٹ-سواپنگ۔ ایک واحد لکیری میموری اسنیپ شاٹ پرسسٹ کرنے کے بجائے، OpenClaw کا کانٹیکسٹ انجن میموری پارٹیشنز کو رَن ٹائم پر ڈی ٹیچ، سواپ یا مائیگریٹ کرنے دیتا ہے — مثلاً ڈیبگنگ کے لیے ہائی-ریکال ویکٹر DB شارڈ سوئچ کریں یا بیرونی آڈٹس کے لیے GDPR-سینیٹائزڈ میموری ویریئنٹ — وہ بھی بغیر ایجنٹ روکے۔ اس سے پروڈکشن میں خلل کا خطرہ کم ہوتا ہے اور مخصوص استعمالات کے لیے میموری کنفیگریشنز ممکن ہوتی ہیں (ڈیبگنگ بمقابلہ پرائیویسی بمقابلہ کارکردگی)۔

عملی کارکردگی میں پیش رفت اور فوائد

OpenClaw کی انٹیگریشن تین عملی شعبوں پر فوکس کرتی ہے جہاں GPT-5.4 نمایاں ہے:

- ٹول آرکسٹریشن کی درستگی۔ GPT-5.4 کی بہتر اندرونی ٹول-سرچ اور ریزننگ غیر ضروری ٹول کالز اور ری ٹرائز کم کرتی ہے۔ اس کا نتیجہ پیچیدہ فلو کے لیے کم API کالز اور تیز کمپلیشن ہے۔ ابتدائی رپورٹس بتاتی ہیں کہ ٹوکن اور ٹول کال ایفیشینسی میں پرانے GPT-5.x ماڈلز کے مقابلے میں بہتری ہے۔

- طویل اور بھرپور کانٹیکسٹ ہینڈلنگ۔ اب OpenClaw ایجنٹس کہیں زیادہ بڑا ایکٹیو کانٹیکسٹ برقرار رکھ سکتے ہیں (سوئچ کی گئی میموری شارڈز سمیت)، جس سے طویل مکالمات، ملٹی فائل پروجیکٹس، اور تدریجی ڈیبگنگ بغیر اسٹیٹ کھوئے سنبھالی جا سکتی ہے۔

- زیادہ متعین کوڈ آؤٹ پٹ۔ ایسے ورک فلو کے لیے جو خودکار کوڈ جنریٹ کرتے ہیں (CI ہُکس، فنکشن سٹبس، انفراسٹرکچر ٹیمپلیٹس)، GPT-5.4 نسبتاً زیادہ مستقل اور رَن ایبل آؤٹ پٹس دیتا ہے، جس سے انسانی ریویو کا بوجھ کم ہوتا ہے۔ آزادانہ ٹیسٹس سابقہ GPT-5 ماڈلز کے مقابلے میں کوڈ کوالٹی میٹرکس میں نمایاں بہتری دکھاتے ہیں۔

- میموری تسلسل — “memory hot-swappable” آپ کو میموری اسٹورز (لوکل کیش، ویکٹر DB، LLM میموری) تبدیل یا بڑھانے دیتا ہے بغیر ایجنٹ اسٹیٹ یا کانٹیکسٹ کھوئے، جس سے A/B ٹیسٹنگ، رولنگ اپ گریڈز، اور فیل اوور ممکن ہوتے ہیں۔

OOLONG بینچ مارک ٹیسٹ میں، OpenClaw کے نئے ورژن نے lossless-claw پلگ اِن کے ساتھ مل کر 74.8 کا اعلیٰ اسکور حاصل کیا، جس نے Claude Code (70.3 پوائنٹس) کو کافی پیچھے چھوڑ دیا۔ خاص طور پر، OpenClaw نے کانٹیکسٹ لینتھ بڑھنے کے ساتھ استحکام اور درستگی دکھائی، جس نے آن سائٹ ٹیسٹنگ کرنے والے انجینئرز کو یہ کہنے پر مجبور کیا کہ "یہ کہنا کہ یہ اچھا چلتا ہے بہت زیادہ محتاط بیان ہے۔"

OpenClaw میں GPT-5.4 کو کیسے کنفیگر اور استعمال کریں (مرحلہ وار)

ایک سادہ OpenClaw ورک فلو جو GPT-5.4 استعمال کرتا ہے:

- ایک عام کنفیگریشن ذیل میں دکھائی گئی ہے:

- صارفین Discord یا Telegram جیسے پلیٹ فارمز کے ذریعے پیغامات بھیجتے ہیں۔

- OpenClaw اپنے گیٹ وے سرور کے ذریعے پیغامات وصول کرتا ہے۔

- گیٹ وے پرامپٹس کو GPT-5.4 کو AI API پرووائیڈر کے ذریعے فارورڈ کرتا ہے۔

- GPT-5.4 ایک جواب جنریٹ کرتا ہے یا کوئی ٹول ایکشن ٹرگر کرتا ہے۔

- OpenClaw حتمی نتیجہ صارف کو واپس بھیجتا ہے۔

ذیل میں عملی، کاپی-پیست کنفیگریشن مثالیں اور ورک فلو ہیں جن سے آپ GPT-5.4 کو OpenClaw میں محفوظ اور قابلِ اعادہ طریقے سے چلا سکتے ہیں۔ یہ جان بوجھ کر محتاط ہیں: پہلے ماڈل کو ٹیسٹ ایجنٹ میں فعال کریں اور ہر چیز کے لیے میٹرکس اور ایررز کی انسٹرومنٹیشن کریں۔

پیشگی تقاضے

- OpenClaw کو اس ریلیز پر اپ گریڈ کیا گیا ہو جس میں GPT-5.4 میپنگز شامل ہوں (اوپر حوالہ دی گئی ریلیز نوٹس)۔

- GPT-5.4 تک رسائی کے ساتھ ایک درست OpenAI API key (میں سستا دام ہونے کے باعث CometAPI اینڈ پوائنٹ منتخب کرتا/کرتی ہوں)۔

1) ماڈل سلیکشن اور ریزولوَر کنفیگریشن (Json / YAML / CLI)

اسے ~/.openclaw/openclaw.json میں رکھیں (یا اپنے موجودہ کنفیگ میں مرج کریں)۔ اپنے ماحول کے مطابق پرووائیڈر نام اور ٹوکن ریفرنس ایڈجسٹ کریں۔

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw ایک ماڈل ریزولوَر استعمال کرتا ہے جو منطقی ماڈل ناموں (مثلاً openai/gpt-5.4) کو اینڈ پوائنٹس اور رَن ٹائم کنفیگ سے میپ کرتا ہے۔ اپنا ریزولوَر فائل شامل/اپ ڈیٹ کریں (مثال models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

یا CLI کے ذریعے رَن ٹائم پر سیٹ کریں:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

نوٹ: The

context_windowandmax

نوٹس

agents.defaults.model.primaryڈیفالٹ ماڈل منتخب کرتا ہے۔channels.modelByChannelکو per-channel اووررائیڈز کے لیے استعمال کریں تاکہ ہائی امپیکٹ چینلز کو GPT-5.4 پر اور کم تقاضوں والے چینلز کو سستے ماڈلز پر رُوٹ کر سکیں۔ آرڈرنگ سیمنٹکس کے لیے OpenClaw ماڈل سلیکشن ڈاکس دیکھیں۔- مخصوص ماڈل ناموں کے لیے براہ کرم CometAPI ماڈل پیج دیکھیں۔ اگر آپ OpenAI استعمال کرنا چاہیں تو URL اور API key کو OpenAI کے مطابق بدل دیں۔

context_windowاورmax_output_tokensکیز OpenClaw کے ریزولوَر میں فارورڈ-کمپیٹیبلٹی تبدیلیوں کی عکاسی کرتی ہیں تاکہ ایجنٹ سٹیل Codex لمٹس استعمال کرنے کی کوشش نہ کرے۔

2) “memory hot-swapping” کو کیسے فعال اور ٹیسٹ کریں

OpenClaw کا میموری سب سسٹم فائل بیسڈ (Markdown فائلیں) ہے، ساتھ میں انڈیکسزرز/سرچ پلگ اِنز جن سے آپ محفوظ طور پر بیک اینڈ پلگ اِنز (مثلاً SQLite ویکٹر، Milvus، یا بیرونی میموری سروسز) سواپ کر سکتے ہیں بغیر خام میموری فائلیں کھوئے۔

ایک عام پیٹرن:

- میموری لوکیشن کو معیاری بنائیں: git-بیکڈ ورک اسپیس استعمال کریں:

~/.openclaw/workspace/جہاںMEMORY.mdاورmemory/YYYY-MM-DD.mdauthoritative ہوں۔ - کوئی میموری پلگ اِن انسٹال اور کنفیگر کریں (مثال: sqlite-vec) اور کنفیگ میں

plugins.slots.memoryکو اس کی طرف پوائنٹ کریں۔ - مائیگریشن ٹیسٹ کریں: نیا پلگ اِن شامل کریں، شیڈو انڈیکسنگ جاب چلائیں، ریٹریول نتائج کا موازنہ کریں، پھر مطمئن ہونے پر

plugins.slots.memoryالیاس کو نئے پلگ اِن پر سوئچ کریں۔

مثال: پلگ اِن الیاس سواپ (bash فرضی کمانڈز):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

کیوں یہ “ہاٹ-سواپ ایبل” ہے: میموری فائلیں ہی سورس آف ٹروتھ رہتی ہیں۔ پلگ اِنز انڈیکسنگ اور ریٹریول لیئرز نافذ کرتے ہیں؛ انہیں بدلنے سے دوبارہ انڈیکسنگ ہوتی ہے مگر بنیادی .md فائلیں نہیں بدلتی جاتیں۔ یہ ماڈل سوئچز کو شناختی بگاڑ کے بغیر ممکن بناتا ہے — ایجنٹ وہی MEMORIES پڑھتا رہتا ہے۔

3) مثال: کسی انفرادی ایجنٹ کو GPT-5.4 پر پن کرنا (per-agent اووررائیڈ)

آپ ماڈلز کو فی ایجنٹ اووررائیڈ کر سکتے ہیں؛ اس طرح کا ایجنٹ اندراج شامل کریں:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

اگر کمیونٹی ریلیز یا آپ کے مخصوص OpenClaw ورژن میں CLI درکار ہو، تو آپ رَن ٹائم پر per-session ماڈل بھی سیٹ کر سکتے ہیں:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

عملی مشورہ: پننگ اس ایجنٹ کے لیے متعین برتاؤ کو یقینی بناتی ہے جب کہ آپ دوسروں پر A/B ٹیسٹس چلاتے ہیں۔

اگر آپ OpenAI استعمال کرنا چاہیں تو URL اور API key کو OpenAI کے مطابق بدل دیں۔

4) Codex 1M context اختیارات استعمال کرنا (API knobs)

اگر آپ کا OpenClaw ڈپلائمنٹ OpenAI Codex اینڈپوائنٹس کو براہِ راست ایکسیس کرتا ہے، تو کانٹیکسٹ اختیارات پاس کریں:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

جو درخواستیں معیاری کانٹیکسٹ ونڈوز سے تجاوز کرتی ہیں وہ مختلف یوزج ریٹس پر شمار ہو سکتی ہیں (OpenAI ڈاکس Codex پری ویو میں معیاری ونڈوز سے زائد درخواستوں کے لیے ڈبل اکاؤنٹنگ کا نوٹ کرتی ہیں)۔

بہترین طریقے: OpenClaw میں GPT-5.4 کی طاقت سے زیادہ سے زیادہ فائدہ

لاگت، لیٹنسی اور ماڈل مرکب

- ہائبرڈ ماڈل حکمتِ عملی: مختصر سوالات اور اسٹریم پروسیسنگ کے لیے چھوٹا، سستا ماڈل استعمال کریں؛ بھاری بھرکم اینالسس، سمریزیشن، لانگ کانٹیکسٹ درکار کوڈ جنریشن کے لیے GPT-5.4 پر ہاٹ-سواپ کریں۔ اس سے مجموعی ٹوکن لاگت کم رہتی ہے اور معیار برقرار رہتا ہے۔ (اسے اوپر دی گئی میموری کنفیگ میں ٹرگرز کے ذریعے نافذ کریں۔)

- ٹوکن کمپیکشن اور ریٹریول آگمینٹیشن: ماڈل کو بھیجے جانے والے ٹوکن محدود رکھنے کے لیے ریٹریول-آگمینٹڈ پائپ لائنز استعمال کریں — طویل ڈاکیومنٹس کو ویکٹر DB میں رکھیں، متعلقہ حصے ریٹریو کریں، اور صرف انتہائی متعلقہ چَنکس اور ایک کمپیکٹ پلان شامل کریں۔ GPT-5.4 کی ٹول سرچ یہاں مدد کرتی ہے کیونکہ یہ خودکار طور پر مفید ٹولز یا ڈاکیومنٹس تلاش کرتی ہے۔

- وارم اپ اور کولڈ اسٹارٹ: ماڈل سوئچ کے بعد، پہلی درخواست کی لیٹنسی اسپائکس سے بچنے کے لیے مختصر کانٹیکسٹ پرائمنگ رَن سے ماڈل کو وارم اپ کریں۔ کسی بھی پرامپٹ ٹیمپلیٹس کو پہلے سے کمپائل کریں اور اہم میموری چینلز کو ری ہائیڈریٹ کریں۔ OpenClaw کی رولنگ حکمت عملی (کنفیگ دیکھیں) پری-وارمنگ کو سپورٹ کرتی ہے۔

اعتمادیت اور حفاظت

- گریس فل فالبیک: API ریٹ لمٹس یا کوٹہ ایررز کو ہینڈل کرنے کے لیے ٹائم آؤٹس اور فالبیک پلانز نافذ کریں (مثلاً پچھلے سیشن کے کیچڈ جواب پر گر جائیں)۔

- حفاظتی لیئرز: پالیسی فلٹرز اور ایک ویریفکیشن اسٹیپ برقرار رکھیں جب آؤٹ پٹس فیصلوں کو متاثر کرتے ہوں۔ GPT-5.4 شماریاتی طور پر ہیلوسینیشنز کم کرتا ہے، مگر ہائی-اسٹیکس ٹاسکس کے لیے ویریفکیشن پھر بھی اہم ہے۔

جانچ اور مانیٹرنگ

- اپنے بینچ مارکس دوبارہ پیدا کریں: اپنے ورک لوڈز (کوڈ کمپلیشن، ملٹی فائل ریفیکٹر، اسپریڈشیٹ اینالسس) پر ہیڈ-ٹو-ہیڈ ٹیسٹس ایک معیاری روبریک کے ساتھ چلائیں۔ عوامی رپورٹس اسپریڈشیٹ اور پروڈکٹیوٹی ٹاسکس میں طاقتیں ظاہر کرتی ہیں — اپنی ڈیٹا سے تصدیق کریں۔

- ٹیلی میٹری: ٹوکن کھپت، ماڈل لیٹنسی، میموری سواپ فریکوئنسی، اور جواب کے معیار (انسانی ریٹنگز/خودکار ٹیسٹس) کی نگرانی کریں۔ سواپ تھریش ہولڈز بہتر بنانے کے لیے ٹیلی میٹری استعمال کریں۔

مثال: ایسا کوڈ ریویو ایجنٹ جو ہاٹ-سواپ کرتا ہے

مقصد: پُش پر روٹین لنٹ + یونٹ ٹیسٹ سمری (سستا ماڈل) چلائیں اور جب ٹیسٹس فیل ہوں یا ڈِف فائلیں 10 سے تجاوز کریں تو ملٹی فائل ریفیکٹر تجاویز کے لیے GPT-5.4 پر اسکیلٹ کریں۔

اعلی سطح کا فلو:

- pre-commit ٹرگر

local/fast-small-coderچلاتا ہے جو لنٹ سمری بناتا ہے۔ - اگر

test_failures > 0یاdiff_files > 10، توhot_swapکوopenai/gpt-5.4پر ٹرگر کریں۔longterm_vectorکو پروموٹ کریں جس میں ریپو ہسٹری ہو۔ - GPT-5.4 پرومپٹ چلائیں جس میں پورے فیل ہونے والے اسٹیک ٹریسز + متعلقہ کوڈ فائلیں کانٹیکسٹ میں کھینچی گئی ہوں۔ ریفیکٹر پیچ اور یونٹ ٹیسٹ تبدیلیاں جنریٹ کریں۔

- انسانی ریویور آؤٹ پٹ کو ریٹ کرے؛ فیڈبیک میموری اپ ڈیٹ کرے۔

پرومپٹ ڈھانچہ (retrieval اور compaction کے بعد GPT-5.4 کو بھیجا جائے):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

یہ استعمال کیس واضح کرتا ہے کہ بڑا کانٹیکسٹ + میموری ہاٹ-سواپ کیوں قیمتی ہے: آپ بیک وقت مکمل فیلنگ ٹریس اور متعدد فائلیں ماڈل میں لا سکتے ہیں۔ لاگت کنٹرول کے لیے سواپ ٹرگرز محتاط رکھیں۔

آخر میں: کس کو OpenClaw میں GPT-5.4 اپنانا چاہیے (اور کب)

- ابھی اپنائیں اگر آپ کے ایجنٹس ملٹی اسٹیپ کوڈ/ٹول ٹاسکس، بھاری اسپریڈشیٹ آٹومیشن، یا پیچیدہ ڈاکیومنٹ ایڈٹنگ کرتے ہیں جہاں iterative write-run-inspect سائیکلز ڈیولپر وقت پر غالب ہوتے ہیں۔ پروڈکٹیوٹی اور اعتمادیت کے فوائد یہاں سب سے زیادہ نمایاں ہیں۔

- احتیاط سے اپنائیں اگر آپ لاگت حساس، ہائی والیوم چیٹ چینلز چلاتے ہیں جہاں سادہ ریزننگ کافی ہے؛ لاگت کی ایفیشینسی برقرار رکھنے کے لیے راؤٹنگ استعمال کریں۔

- ایک ماڈل کی برتری فرض نہ کریں: اپنی ڈیٹا پر بینچ مارک کریں۔ GPT-5.4 ایجنٹ ورک لوڈز کے لیے مضبوط امیدوار ہے، مگر ماڈل کا انتخاب ثبوت پر مبنی ہونا چاہیے۔

ڈیولپرز اب CometAPI کے ذریعے GPT-5.4 تک رسائی حاصل کر سکتے ہیں۔ شروعات کے لیے، ماڈل کی قابلیتیں Playground میں دریافت کریں اور تفصیلی ہدایات کے لیے OpenClaw کی integration guide دیکھیں۔ رسائی سے پہلے، یقینی بنائیں کہ آپ CometAPI میں لاگ اِن ہیں اور API key حاصل کر لی ہے۔ CometAPI انضمام میں مدد کے لیے سرکاری قیمت سے کہیں کم قیمت پیش کرتا ہے۔

تیار ہیں؟ → آج ہی OpenClaw کے لیے سائن اپ کریں!

اگر آپ مزید ٹپس، گائیڈز اور AI خبروں سے باخبر رہنا چاہتے ہیں تو ہمیں VK، X اور Discord پر فالو کریں!