Google DeepMind bracht op 2 april 2026 officieel Gemma 4 uit, een belangrijke mijlpaal in open-source AI. Deze modelfamilie levert intelligentie per parameter op frontier-niveau, gebouwd op hetzelfde onderzoek en dezelfde technologie die Gemini 3 aandrijft. In tegenstelling tot eerdere Gemma-versies met aangepaste licenties, wordt Gemma 4 geleverd onder een volledig permissieve Apache 2.0-licentie, waarmee onbeperkt commercieel gebruik, modificatie en herdistributie mogelijk is.

Gemma 4 onderscheidt zich door zijn multimodale mogelijkheden (tekst + beeldinvoer voor alle groottes, plus audio op edge-modellen), native ondersteuning voor geavanceerde redenering en agentische workflows, lange contextvensters tot 256K tokens, en optimalisatie voor alles van smartphones en Raspberry Pi tot high-end GPU's. Het ondersteunt meer dan 140 talen en legt de nadruk op efficiëntie, waardoor krachtige AI toegankelijk wordt op consumenten- en edge-hardware zonder cloudafhankelijkheid.

CometAPI biedt uitstekende API's voor open-source en closed-source modellen.

Wat is Gemma 4?

Gemma 4 is de nieuwste familie van open multimodale large language models (LLM's) van Google DeepMind, speciaal ontworpen voor geavanceerde redenering, agentische AI-workflows en efficiënte implementatie op het apparaat. Het maximaliseert “intelligentie-per-parameter” door inzichten uit het proprietaire Gemini 3-onderzoek te benutten, terwijl het volledig open-weight en open-source blijft.

Belangrijkste verbeteringen ten opzichte van eerdere Gemma-modellen zijn:

- Native multimodaliteit: Tekst + beeldbegrip (alle modellen), met audio-ondersteuning op kleinere edge-varianten.

- Configureerbare denkmodus: Stapsgewijze redenering met gestructureerde <|think|>-uitvoer.

- Native functieaanroepen en toolgebruik: Ideaal voor autonome agents.

- Uitgebreide context: Tot 256K tokens op grotere modellen.

- Hybride attention-architectuur: Combineert lokale sliding-window- en globale attention voor efficiëntie en prestaties op lange context.

- Embeddings per laag (PLE) in kleinere modellen en gedeelde KV-cache voor geheugensbesparing.

- Brede meertalige ondersteuning: Voorgetraind op data die 140+ talen omvat met aandacht voor culturele nuances.

Uitgebracht onder Apache 2.0, verwijdert Gemma 4 eerdere licentiebeperkingen die enterprise-adoptie in de weg stonden. Ontwikkelaars kunnen nu zonder frictie fine-tunen, implementeren en commercialiseren—en positioneren het als een directe concurrent voor volledig open ecosystemen zoals Llama en Qwen.

Gemma 4 richt zich op diverse hardware: edge-apparaten (telefoons, IoT, Raspberry Pi, Jetson Nano) voor offline AI met lage latency, en werkstations/GPU's voor high-performance lokale servers. Dit “local-first”-ontwerp geeft prioriteit aan privacy, kostenbesparing en nul-latentie-inferentie.

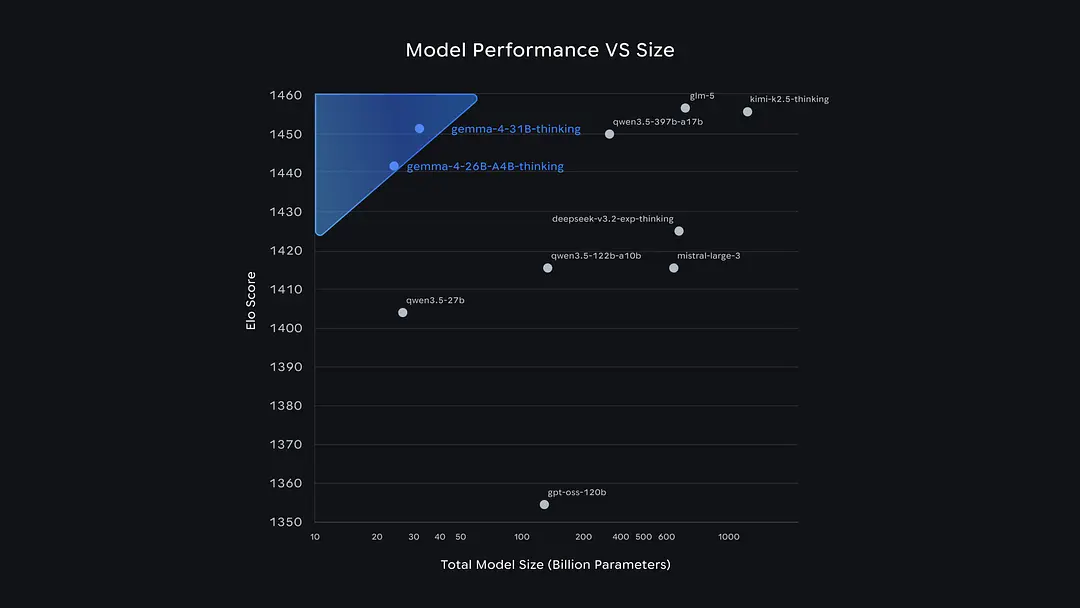

De open-source modellen die hoger scoren op de Arena-ranglijst zijn voornamelijk afkomstig van Chinese teams. Gemma 4 verschilt niet veel van Qwen 3.5 en GLM-5, maar verschilt aanzienlijk van OpenAI's GPT-OSS-120B.

Ontwikkelaars kunnen nu GLM-5, Qwen 3.5, enz. vinden op CometAPI.

De vier versies van Gemma 4

Google bracht Gemma 4 uit in vier zorgvuldig geoptimaliseerde groottes, elk met een balans tussen prestaties, efficiëntie en implementatiescenario's. Twee gebruiken dense architecturen met innovatieve embeddings per laag (PLE) voor edge-efficiëntie; één is een Mixture-of-Experts (MoE) voor hoge prestaties tegen lage actieve-parameterkosten; en één is een dense vlaggenschipmodel.

| Model | Architectuur | Totaal aantal parameters | Actieve parameters (MoE) | Effectieve parameters | Contextlengte | Modaliteiten | Doelhardware |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Dense + PLE | ~5.1B (incl. embeddings) | n.v.t. | 2.3B | 128K | Tekst, beeld, audio | Smartphones, Raspberry Pi, edge-IoT |

| Gemma 4 E4B | Dense + PLE | ~8B (incl. embeddings) | n.v.t. | 4.5B | 128K | Tekst, beeld, audio | Mobiele apparaten, lichte GPU's, Jetson |

| Gemma 4 26B A4B | MoE (8 actief / 128 totaal + 1 gedeeld) | 25.2B | 3.8B–4B | n.v.t. | 256K | Tekst, beeld | Workstations, consument-GPU's, lokale servers |

| Gemma 4 31B | Dense | 30.7B | n.v.t. | n.v.t. | 256K | Tekst, beeld | High-end GPU's (past op één H100/A100 in FP16) |

Gemma 4 E2B en E4B (edge-geoptimaliseerd): Gebruiken PLE om per-laagspecialisatie toe te voegen met minimale parameteroverhead. Ideaal voor batterijgevoede of geheugengerichte apparaten. Audio-encoder (USM-style Conformer, ~300M parameters) maakt spraak-naar-tekst en vertaling mogelijk.

Gemma 4 26B A4B (MoE): Activeert slechts ~4B parameters tijdens inferentie, ondanks een totale grootte van 25B+. Levert bijna-31B prestaties tegen aanzienlijk lagere rekencost—perfect voor kostenefficiënte opschaling.

Gemma 4 31B (Dense): Het vlaggenschip voor maximale capaciteit. Past op een enkele 80GB GPU in volle precisie en behoort tot de top open modellen op ranglijsten.

Alle modellen omvatten instructie-afgestemde (“-it”) varianten die zijn geoptimaliseerd voor chat, redenering en toolgebruik, plus voorgetrainde basisversies voor fine-tuning. De twee grote modellen hanteren verschillende benaderingen: het 31B Dense-model streeft naar ultieme kwaliteit en dient als de beste basis voor fine-tuning; het 26B MoE-model geeft prioriteit aan snelheid en activeert slechts 3.8 miljard parameters tijdens inferentie, wat resulteert in veel snellere woordgeneratie, maar met iets lagere algehele kwaliteit.

De twee kleinere modellen, E2B en E4B, zijn specifiek ontworpen voor mobiele telefoons en IoT-apparaten: ze kunnen volledig offline draaien, wat geheugen en stroom bespaart. Bovendien bezitten deze kleinere modellen een vermogen dat de grotere modellen missen: native audio-invoer, waarmee directe spraakherkenning mogelijk is.

Kernmogelijkheden van Gemma 4

Gemma 4 blinkt uit in de gebieden die het belangrijkst zijn voor AI-toepassingen in de echte wereld:

1. Geavanceerde redenering & Denkmodus

Configureerbare stapsgewijze redenering via systeemprompts of enable_thinking=True. Geeft gestructureerde <|think|>-tags uit gevolgd door definitieve antwoorden. Verbetert de prestaties op complexe taken aanzienlijk zonder extra fine-tuning.

2. Multimodaal begrip

- Vision: Objectdetectie (JSON-bounding boxes), OCR (meertalig), document/PDF-parsing, grafiekbegrip, UI-begrip, handschriftherkenning en afhandeling van afbeeldingen met variabele resolutie (tokenbudgetten: 70–1120 tokens).

- Video: Tot 60 seconden (1 fps frameverwerking).

- Audio (alleen E2B/E4B): Automatische spraakherkenning (ASR) en spraak-naar-tekst vertaling (max. 30s).

- Verweven invoer: Mix tekst, afbeeldingen en audio in elke volgorde.

3. Agentische workflows & functieaanroepen

Native ondersteuning voor toolgebruik maakt autonome agents mogelijk voor meerstapsplanning, API-calls, app-navigatie en taakafronding. Sterk op τ2-bench (agentisch toolgebruik).

4. Coderen & ontwikkelaarstools

Uitzonderlijke codegeneratie, aanvulling, debuggen en begrip op repository-niveau. Ondersteunt JSON-gestructureerde uitvoer voor naadloze integratie. Het scoort 80.0% (31B) op LiveCodeBench v6, en positioneert zich als een local-first AI-programmeerassistent die geschikt is voor offline ontwikkelscenario's.

5. Lange context & meertaligheid

Verwerkt 128K–256K tokens betrouwbaar (getest op MRCR needle-in-haystack). Voorgetraind op diverse data tot de afkapdatum januari 2025, met sterke cross-linguale prestaties. Dit is niet slechts meertalige vertaling; het is native getraind en dekt meer dan 140 talen.

Benchmarkgegevens: prestatieoverzicht van Gemma 4

Gemma 4 zet nieuwe standaarden voor open modellen. De 31B- en 26B-varianten leveren scores die voorheen waren voorbehouden aan veel grotere propriëtaire systemen, terwijl edge-modellen beter presteren dan de grotere voorganger Gemma 3.

Volledige benchmarkresultaten (instructie-afgestemde modellen)

| Benchmark | Categorie | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (zonder denkmodus) |

|---|---|---|---|---|---|---|

| MMLU Pro | Redenering & kennis | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Wiskunde | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Wetenschap op graduate-niveau | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Agentisch toolgebruik | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Coderen | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Competitief programmeren | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Multimodale redenering | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Wiskunde + beeld | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Lange context | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Belangrijkste inzichten:

- Grote sprong ten opzichte van Gemma 3: Het 31B-model verbetert AIME-wiskunde van 20.8% naar 89.2% en LiveCodeBench van 29.1% naar 80.0%.

- MoE-efficiëntie: 26B A4B benadert 31B terwijl het tijdens inferentie veel minder compute gebruikt.

- Edge-dominantie: E4B en E2B overtreffen Gemma 3 27B op veel metrics ondanks dat ze 6–10x kleiner zijn.

- Ranglijsten: 31B behaalt ~1452 op Arena AI (tekst); 26B A4B ~1441. Van de 26B-variant wordt gezegd dat deze veel grotere modellen zoals Qwen 3.5 397B overtreft in gebruikersvoorkeur en coderen.

Vision- en audiobenchmarks bevestigen sterke out-of-the-box multimodale prestaties zonder gespecialiseerde fine-tuning.

Ecosysteem en toolondersteuning

Gemma 4 geniet onmiddellijke, brede ecosysteemintegratie:

- Hugging Face: Ondersteuning vanaf dag één met

transformers,pipeline("any-to-any"), GGUF, ONNX en multimodale processors. - Lokale runtimes: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon met TurboQuant), Mistral.rs (Rust), Transformers.js (WebGPU-browserinferentie).

- Fine-tuning: TRL, Unsloth, PEFT, Vertex AI en volledige ondersteuning voor multimodale datasets.

- Hardware-optimalisatie: NVIDIA RTX/DGX Spark/Jetson (via TensorRT-LLM), Google AI Edge-tools en implementatie op het apparaat voor Android/iOS.

- Agent-frameworks: OpenClaw, Hermes, Pi en CARLA-simulatietests.

- Cloud/Studio: Google AI Studio voor snel testen; Kaggle Models voor download.

Met dit ecosysteem is Gemma 4 binnen enkele minuten inzetbaar op laptops, servers of edge-apparaten.

Beperkingen & veiligheid:

- Afkapdatum trainingsdata: januari 2025 (geen realtime kennis zonder tools).

- Audio beperkt tot spraak (geen muziek); video begrensd tot 60s.

- Het risico op hallucinaties blijft bestaan—gebruik de denkmodus en verificatie.

- Veiligheid: strenge filtering en evaluaties volgens de Google AI Principles; ontwikkelaars moeten toepassingsspecifieke waarborgen toevoegen.

Waarom Gemma 4 ertoe doet in 2026

Gemma 4 democratiseert frontier-AI. Door multimodale intelligentie, agentische capaciteiten en Apache 2.0-vrijheid te combineren met hardware-agnostische efficiëntie, stelt het ontwikkelaars en ondernemingen in staat om veilige, private en kosteneffectieve AI-oplossingen op schaal te bouwen. De doorbraak in intelligentie-per-parameter—met name zichtbaar in edge-modellen die de vlaggenschip-openmodellen van gisteren overtreffen—markeert een verschuiving naar werkelijk alomtegenwoordige AI.

Of je nu een 2B-model op een telefoon draait of lokaal een 31B-krachtpatser, Gemma 4 bewijst dat open-source AI de gesloten alternatieven heeft ingehaald (en in veel gevallen overtroffen) in praktische bruikbaarheid.