GPT-5.4 Mini và GPT-5.4 Nano là các biến thể gọn nhẹ mới của OpenAI thuộc dòng mô hình tiên phong GPT-5.4: Mini nhắm tới cân bằng hiệu năng/độ trễ tốt nhất cho lập trình, các tác vụ UI đa phương thức và khối lượng công việc của tác tử phụ; Nano nhắm tới chi phí và độ trễ siêu thấp cho phân loại, trích xuất, xếp hạng và các tác tử phụ song song với quy mô lớn. Mini đem lại độ chính xác gần mức tiên phong trên nhiều benchmark dành cho nhà phát triển đồng thời chạy nhanh hơn >2× so với các phiên bản “mini” trước đây; Nano rẻ hơn đáng kể theo từng token và lý tưởng cho nơi thông lượng và khả năng phản hồi là quan trọng nhất. Các mô hình này đã có sẵn trong API (GPT 5.4 Mini và Nano có trên CometAPI).

GPT-5.4 Mini và GPT-5.4 Nano là gì?

Định nghĩa ngắn: GPT-5.4 Mini và GPT-5.4 Nano là các biến thể thu gọn, được thiết kế của họ GPT-5.4 nhằm đưa các thế mạnh cốt lõi của GPT-5.4 lớn (suy luận, lập trình, nhận thức đa phương thức, sử dụng công cụ) vào những mô hình nhanh hơn, chi phí thấp hơn, tập trung cho khối lượng công việc lớn và độ trễ thấp. Các mô hình này được OpenAI công bố trong đợt ra mắt GPT-5.4.

- GPT-5.4 Mini — Mô hình nhỏ hiệu năng cao “tiệm cận hiệu năng của GPT-5.4 trên một số đánh giá”, đồng thời được tối ưu cho tốc độ và chi phí thấp. Được nhấn mạnh đặc biệt cho lập trình, suy luận, diễn giải UI đa phương thức (ảnh chụp màn hình), và làm tác tử phụ trong hệ thống tác tử. OpenAI cho biết nó chạy nhanh hơn hơn 2× so với các biến thể “mini” trước đây.

- GPT-5.4 Nano — Biến thể nhỏ nhất, rẻ nhất của GPT-5.4; được khuyến nghị cho phân loại, trích xuất, xếp hạng và các tác tử phụ “hỗ trợ” xử lý các tác vụ hẹp, lặp lại với thông lượng rất cao. Nó đánh đổi khả năng suy luận sâu để lấy độ trễ và chi phí.

Khả dụng và giá

OpenAI cung cấp hai dữ liệu cụ thể để bạn so sánh chi phí:

- Giá API đầu vào GPT-5.4 (đầu bảng): $2.50 / 1M tokens (và giá đầu ra cao hơn trên mô hình đầu bảng).

- Giá API đầu vào GPT-5.4 mini: $0.75 / 1M tokens và đầu ra $4.50 / 1M tokens.

- Giá API đầu vào GPT-5.4 nano: $0.20 / 1M và đầu ra $1.25 / 1M.

Đặt cạnh nhau: giá token đầu vào của mini (0.75) bằng 30% so với đầu bảng (2.50), tức khoảng một phần ba chi phí đầu vào; giá đầu ra của mini (4.50) vào khoảng 32% so với một mức giá đầu ra của đầu bảng được trích dẫn trong bảng giá API, tức cũng khoảng một phần ba. Nano còn rẻ hơn: chi phí đầu vào của nó khoảng 8% so với đầu vào của đầu bảng, và chi phí đầu ra dưới 10% so với đầu ra của đầu bảng. Các tỷ lệ này chính là lý do OpenAI mô tả mini/nano là “khoảng một phần ba” (mini) và “một phần nhỏ” (nano) chi phí so với việc dùng các mô hình lớn nhất cho tác vụ khối lượng lớn. Giá token của nano tăng từ $0.05 lên $0.20, và giá token của mini tăng từ $0.25 lên $0.75 (cho token đầu vào).

Trên nền tảng OpenAI

GPT-5.4 mini có mặt ở ba nơi: OpenAI API, Codex (nền tảng IDE/ứng dụng cho nhà phát triển của OpenAI), và ChatGPT (có cho người dùng Free và Go thông qua tùy chọn “Thinking” và là phương án dự phòng khi bị giới hạn tốc độ cho các gói trả phí). Trong API, nó hỗ trợ đầu vào văn bản và hình ảnh, sử dụng công cụ (gọi hàm), tìm kiếm web/tệp, sử dụng máy tính và kỹ năng — và cung cấp cửa sổ ngữ cảnh rất lớn (400k tokens) để phục vụ quy trình nhiều tài liệu và đa ảnh chụp màn hình. Giá API là $0.75 cho mỗi 1M token đầu vào và $4.50 cho mỗi 1M token đầu ra.

GPT-5.4 nano chỉ có qua API. Giá niêm yết là $0.20 cho mỗi 1M token đầu vào và $1.25 cho mỗi 1M token đầu ra — định vị nó là lựa chọn chi phí thấp nhất trong họ GPT-5.4. Mô hình nano cố ý đánh đổi năng lực để lấy chi phí và tốc độ.

Trên nền tảng bên thứ ba

CometAPI là nền tảng tổng hợp API AI đa phương thức, hiện đã ra mắt GPT 5.4 Series API, gồm GPT 5.4 Mini và GPT 5.4 Nano, với giá giảm 20% so với OpenAI.

GPT 5.4 Nano:

| Giá Comet (USD / M Tokens) | Giá chính thức (USD / M Tokens) |

|---|---|

| Đầu vào:$0.16/M; Đầu ra:$1/M | Đầu vào:$0.2/M; Đầu ra:$1.25/M |

GPT 5.4 Nano:

| Giá Comet (USD / M Tokens) | Giá chính thức (USD / M Tokens) |

|---|---|

| Đầu vào:$0.6/M; Đầu ra:$3.6/M | Đầu vào:$0.75/M; Đầu ra:$4.5/M |

Tính năng chính và Điểm mới

Dưới đây là các năng lực nổi bật — lý do các kỹ sư và đội sản phẩm sẽ quan tâm.

Mã hóa & hỗ trợ ngữ cảnh dài

Cửa sổ ngữ cảnh: GPT-5.4 mini hỗ trợ cửa sổ ngữ cảnh 400k token (OpenAI ghi rõ mini có 400k ngữ cảnh). Đây là đủ lớn cho các mã nguồn đa tệp, tài liệu dài, hoặc phiên tác tử nhiều lượt nơi ngữ cảnh quan trọng. Ngữ cảnh của Nano nhỏ hơn so với GPT-5.4 đầy đủ nhưng vẫn đáng kể cho các tác vụ ngắn, nhanh.

Suy luận

Mức độ suy luận: OpenAI cung cấp reasoning_effort có thể cấu hình (none → xhigh); mini và nano có thể chạy với mức nỗ lực khác nhau, nhưng mini thu hẹp khoảng cách với GPT-5.4 đầy đủ trên nhiều benchmark suy luận ở mức nỗ lực cao. Trên một số benchmark trí tuệ (ví dụ, GPQA Diamond), mini đạt 88.0% so với 93.0% của GPT-5.4, và nano đạt 82.8%, cho thấy khả năng suy luận đáng nể đối với mô hình nhỏ. Đây là kết quả OpenAI công bố trong bài ra mắt.

Hiểu đa phương thức (thị giác & UI)

Nhận thức thị giác & tác vụ UI: GPT-5.4 mini thể hiện hiệu năng đa phương thức rất mạnh cho tác vụ UI (ảnh chụp màn hình, ảnh tài liệu dày đặc). Trên OSWorld-Verified (benchmark sử dụng máy tính), mini đạt 72.1%, rất gần với 75.0% của GPT-5.4 và vượt xa các “mini” trước đây — đây là lý do mini được định vị cho tự động hóa dựa trên ảnh chụp màn hình và trợ lý đa phương thức phản hồi nhanh. Nano có điểm thấp hơn trên các benchmark thị giác nhưng vẫn hữu ích cho các tác vụ ảnh đơn giản.

Gọi công cụ & sử dụng máy tính

Khả năng công cụ/nhấp chuột bản địa: GPT-5.4 giới thiệu và mở rộng bộ công cụ sử dụng máy tính bản địa; mini kế thừa khả năng gọi công cụ, gọi hàm, diễn giải ảnh chụp màn hình và điều phối tác tử phụ. Các benchmark gọi công cụ (Toolathlon, MCP Atlas) cho thấy mini và nano đạt điểm đáng kể (Toolathlon: mini 42.9%, nano 35.5%) — định lượng khả năng gọi và phối hợp công cụ bên ngoài. Các số liệu này đến từ thông báo của OpenAI.

Ảo giác / tính xác thực / tỷ lệ lỗi

OpenAI báo cáo GPT-5.4 là “mô hình có tính xác thực cao nhất đến nay” và cho thấy giảm ảo giác so với GPT-5.2; mini và nano có tính xác thực tuyệt đối thấp hơn so với mô hình đầy đủ (ví dụ, HLE w/ tools: GPT-5.4 52.1%, mini 41.5%, nano 37.7%) — gợi ý cần tăng cường xác minh khi dùng mô hình nhỏ cho tác vụ đòi hỏi độ chính xác cao. Hãy dùng xác minh dựa trên công cụ (gọi công cụ, trích dẫn) khi độ đúng đắn quan trọng.

Tốc độ

OpenAI cho biết GPT-5.4 mini chạy nhanh hơn hơn 2× so với GPT-5 mini trước đó theo các ước tính độ trễ kiểu sản xuất (dựa trên hành vi sản xuất mô phỏng gồm thời lượng gọi công cụ và token mẫu). Sự tăng tốc này là tuyên bố trung tâm cho dòng mới và là lý do mini có thể dùng như tác tử phụ phản hồi nhanh trong ứng dụng tương tác như trợ lý lập trình.

Mini và nano hoạt động ra sao — chúng có “tiệm cận” GPT-5.4 đầy đủ không?

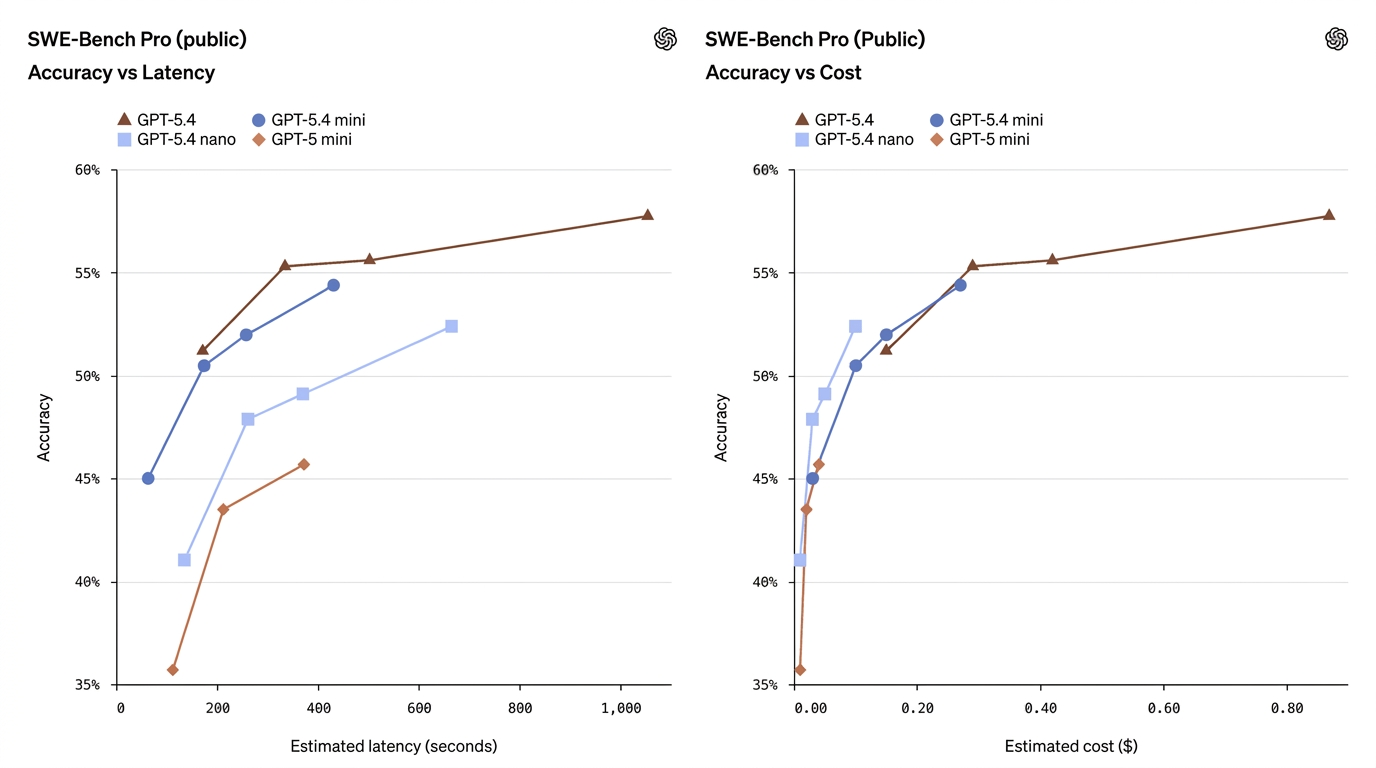

OpenAI đã công bố bộ so sánh benchmark toàn diện trên lập trình, sử dụng công cụ, tác vụ sử dụng máy tính đa phương thức, bài kiểm tra trí tuệ và đánh giá ngữ cảnh dài. Các con số tiêu biểu (xhigh reasoning effort khi áp dụng) gồm:

| Benchmark | GPT-5.4 | GPT-5.4 Mini | GPT-5.4 Nano | GPT-5 Mini (Cũ) | Ghi chú |

|---|---|---|---|---|---|

| SWE-Bench Pro (Lập trình) | 57.7% | 54.4% | 52.4% | 45.7% | Mini tiệm cận hiệu năng lập trình của mô hình đầy đủ |

| Terminal-Bench 2.0 (Lập trình tương tác) | 75.1% | 60.0% | 46.3% | — | Khả năng lập trình thời gian thực mạnh cho Mini |

| Toolathlon (Sử dụng công cụ) | 54.6% | 42.9% | 35.5% | — | Đo khả năng điều phối & gọi công cụ |

| GPQA Diamond (Hỏi đáp nâng cao) | 93.0% | 88.0% | 82.8% | — | Benchmark trí tuệ & suy luận |

| OSWorld-Verified (Tác vụ GUI) | 75.0% | 72.1% | 39.0% | 42.0% | Khả năng UI/sử dụng máy tính |

Các con số này cho thấy mini thường thu hẹp khoảng cách đáng kể — đặc biệt trên lập trình và sử dụng máy tính — trong khi nano giữ vị trí trung gian hữu ích giữa năng lực và chi phí.

Nói dễ hiểu thì các con số này có ý nghĩa gì?

- GPT-5.4 Mini ≈ “gần như đầu bảng” trên nhiều tác vụ sản xuất. Trên SWE-Bench Pro (thước đo pass-rate cho lập trình), mini đạt 54.4% so với 57.7% của đầu bảng — chênh lệch nhỏ với nhiều tác vụ lập trình thực tế, nhất là khi độ trễ quan trọng. Trên OSWorld (sử dụng máy tính), mini đạt 72.1% so với 75.0% của đầu bảng — một lần nữa, rất gần cho các tác vụ UI/ảnh chụp màn hình.

- GPT-5.4 Nano đánh đổi nhiều năng lực để lấy tốc độ/chi phí. Điểm lập trình của Nano (52.4% trên SWE-Bench Pro) là đáng nể so với các “mini” cũ, nhưng điểm OSWorld giảm xuống 39.0%, cho thấy với tác vụ cần hiểu UI đa bước phức tạp hoặc chuỗi công cụ tác tử, nano kém phù hợp hơn. Nano tỏa sáng ở phân loại một lượt, trích xuất, và các trợ nhiệm vụ nhỏ.

- Khả năng dùng công cụ được cải thiện, nhưng vẫn nhạy cảm. Toolathlon và các thước đo khác tăng đáng kể khi chuyển từ GPT-5 mini sang GPT-5.4 mini/nano, cho thấy kỹ thuật của OpenAI đã cải thiện độ tin cậy gọi công cụ trong các mô hình nhỏ hơn — nhưng mô hình đầy đủ vẫn dẫn đầu ở điều phối công cụ phức tạp.

Cách chúng vận hành trong môi trường sản xuất

Nén, chưng cất và tối ưu kỹ thuật

Các mô hình gọn như mini/nano thường kết hợp chưng cất mô hình, lượng tử hóa, và cắt tỉa kiến trúc để bảo toàn các năng lực giá trị cao (heuristics lập trình, nhận thức thị giác) trong khi giảm chi phí suy luận. Cách diễn đạt của OpenAI cho thấy tối ưu kỹ thuật tập trung để giữ gìn các bộ kỹ năng cụ thể (lập trình, hiểu UI đa phương thức) trong kích thước nhỏ hơn.

Mẫu khuyến nghị

- Mẫu điều phối + tác tử phụ: Dùng GPT-5.4 (lớn) làm bộ lập kế hoạch/trọng tài và phân phối công việc cho các tác tử phụ GPT-5.4 mini / nano để thực thi nhanh (tìm kiếm, phân tích, chỉnh sửa). Điều này giảm tổng chi phí và hạ độ trễ cho người dùng. OpenAI nêu rõ ủng hộ mẫu thiết kế này.

- Dự phòng & xử lý giới hạn tốc độ: Lộ trình mini như phương án dự phòng khi bị giới hạn tốc độ trong ChatGPT hoặc Codex để các truy vấn nhạy thời gian vẫn nhận được câu trả lời đủ mạnh khi mô hình đầy đủ không khả dụng.

- Kiến trúc phân tầng để kiểm soát chi phí: Pipeline số lượng lớn (lập chỉ mục, trích xuất) → GPT-5.4 nano; thành phần UI tương tác → GPT-5.4 mini; phán xét biên tập cuối/cuỗi chuỗi phức tạp → GPT-5.4 đầy đủ. Cách tiếp cận đa tầng này cân bằng chi phí và năng lực.

Độ trễ và song song hóa

Mini và nano được tối ưu cho tác tử phụ song song, nơi nhiều “worker” nhỏ chạy đồng thời — ví dụ, quét hàng nghìn PDF song song. Khái niệm “tool yields” của OpenAI đo cách các cuộc gọi công cụ song song giảm thời gian thực; mini/nano được thiết kế để làm cho các mẫu này hiệu quả về chi phí.

Tôi nên dùng mini và nano như thế nào trong thực tế

Có nên thay thế mọi cuộc gọi tới mô hình đầu bảng bằng mini/nano không?

Không tự động. Mẫu đúng OpenAI khuyến nghị là ủy thác: dùng mô hình lớn cho lập kế hoạch, phán xét phức tạp hoặc xác minh cuối, và phân chia nhiều tác vụ phụ ngắn cho các tác tử mini hoặc nano. Mẫu này giảm chi phí và độ trễ trong khi giữ lại “lan can” của mô hình lớn ở nơi quan trọng. Trường hợp sử dụng:

- Trợ lý lập trình tương tác: mô hình đầu bảng lên kế hoạch & rà soát; mini xử lý tìm kiếm mã nhanh, chỉnh sửa, và unit test ngắn.

- Tác tử “sử dụng máy tính” dựa trên ảnh chụp màn hình: mini có thể phân tích giao diện dày đặc nhanh chóng; mô hình đầu bảng xử lý lập kế hoạch đa bước mơ hồ.

- Pipeline trích xuất & phân loại khối lượng lớn: nano xử lý các batch lớn (biểu mẫu, log) và trả kết quả có cấu trúc; mô hình đầu bảng xử lý ngoại lệ và biên phức tạp.

Mini hoặc nano có thể dùng cho tác vụ đa phương thức hoặc hình ảnh không?

Có — mini hỗ trợ đầu vào hình ảnh và đạt kết quả tốt trên các benchmark đa phương thức/thị giác (MMMUPro/OmniDocBench), tiệm cận đầu bảng ở một số bài kiểm. Sức mạnh đa phương thức của nano hạn chế hơn: dù cải thiện so với các nano trước, nó không phải lựa chọn tốt nhất cho suy luận đa phương thức sâu hoặc tác vụ tác tử dựa trên hình ảnh.

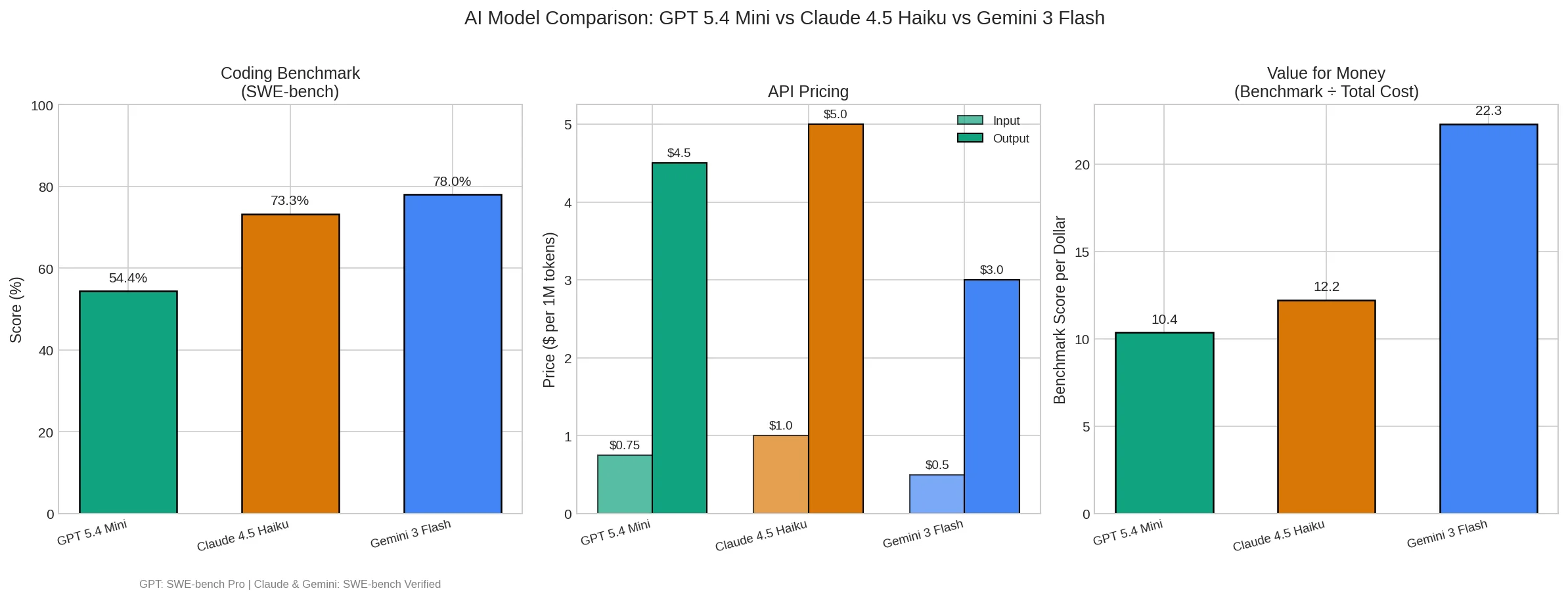

Cuộc đua năng lực của các mô hình nhỏ đang tăng nhiệt

Ba tháng trước, các mô hình nhỏ còn được coi là “đủ dùng”. Giờ đây, GPT-5.4 mini đang tiệm cận mô hình đầu bảng trên benchmark lập trình và gần như bắt kịp về hiệu năng tính toán.

Xu hướng phía sau rất rõ: năng lực của các mô hình đầu bảng đang được chuyển giao nhanh chóng sang mô hình nhỏ hơn. OpenAI, Google và Anthropic đều đang làm điều tương tự: chưng cất các năng lực cốt lõi của mô hình lớn vào phiên bản nhỏ hơn, nhanh hơn, rẻ hơn.

Kết luận

Sự ra mắt của hai mô hình này đánh dấu sự dịch chuyển của ứng dụng AI từ trọng tâm “quy mô” sang “hiệu quả thực dụng”. Thông qua khả năng phản hồi nhanh, chúng mang lại nền tảng đáng tin cậy hơn cho tương tác AI thời gian thực và phân rã các luồng tác vụ phức tạp.

Với nhà phát triển, điều này có nghĩa cấu trúc chi phí của hệ thống tác tử đang được định nghĩa lại. Khi chi phí giảm đến mức này, nhiều kịch bản tác tử trước đây “khả thi về mặt lý thuyết nhưng không khả thi về kinh tế” trở nên khả thi.

Nhà phát triển có thể truy cập GPT 5.4 Mini và GPT-5.4 Nano qua CometAPI (CometAPI là nền tảng tổng hợp một cửa cho các API mô hình lớn như GPT APIs, Nano Banana APIs, v.v.) ngay bây giờ. Trước khi truy cập, hãy đảm bảo bạn đã đăng nhập CometAPI và lấy API key. CometAPI cung cấp mức giá thấp hơn nhiều so với giá chính thức để giúp bạn tích hợp.

Sẵn sàng bắt đầu chứ?

.png&w=3840&q=75)