Trong giai đoạn 2025–2026, hệ sinh thái công cụ AI tiếp tục được hợp nhất: các gateway API (như CometAPI) mở rộng để cung cấp quyền truy cập kiểu OpenAI cho hàng trăm mô hình, trong khi các ứng dụng LLM cho người dùng cuối (như AnythingLLM) tiếp tục cải tiến nhà cung cấp “Generic OpenAI” để cho phép ứng dụng desktop và ưu tiên local gọi bất kỳ endpoint tương thích OpenAI nào. Điều đó giúp hôm nay việc định tuyến lưu lượng của AnythingLLM qua CometAPI trở nên đơn giản, tận dụng lợi ích về lựa chọn mô hình, định tuyến chi phí và hóa đơn hợp nhất — đồng thời vẫn dùng giao diện cục bộ và các tính năng RAG/agent của AnythingLLM.

AnythingLLM là gì và vì sao bạn muốn kết nối nó với CometAPI?

AnythingLLM là gì?

AnythingLLM là một ứng dụng AI mã nguồn mở, tất cả-trong-một, và là client local/cloud để xây dựng trợ lý trò chuyện, quy trình tạo sinh tăng cường truy xuất (RAG) và agent dựa trên LLM. Ứng dụng cung cấp giao diện mượt, API dành cho nhà phát triển, các tính năng workspace/agent, và hỗ trợ LLM local và đám mây — thiết kế ưu tiên riêng tư theo mặc định và có thể mở rộng qua plugin. AnythingLLM cung cấp nhà cung cấp Generic OpenAI cho phép nó giao tiếp với các API LLM tương thích OpenAI.

CometAPI là gì?

CometAPI là nền tảng tổng hợp API thương mại cung cấp 500+ mô hình AI qua một giao diện REST kiểu OpenAI và hóa đơn hợp nhất. Trên thực tế, nó cho phép bạn gọi các mô hình từ nhiều nhà cung cấp (OpenAI, Anthropic, Google/Gemini và biến thể, mô hình hình ảnh/âm thanh, v.v.) qua cùng các endpoint https://api.cometapi.com/v1 và một khóa API duy nhất (định dạng sk-xxxxx). CometAPI hỗ trợ các endpoint chuẩn kiểu OpenAI như /v1/chat/completions, /v1/embeddings, v.v., giúp dễ dàng thích ứng các công cụ vốn đã hỗ trợ API tương thích OpenAI.

Tại sao tích hợp AnythingLLM với CometAPI?

Ba lý do thực tiễn:

- Lựa chọn mô hình & linh hoạt nhà cung cấp: AnythingLLM có thể dùng “bất kỳ LLM tương thích OpenAI” qua wrapper Generic OpenAI. Trỏ wrapper đó về CometAPI giúp truy cập tức thì hàng trăm mô hình mà không cần thay đổi giao diện hay luồng của AnythingLLM.

- Tối ưu chi phí/vận hành: Dùng CometAPI cho phép chuyển đổi mô hình (hoặc hạ xuống mô hình rẻ hơn) tập trung để kiểm soát chi phí, và giữ hóa đơn hợp nhất thay vì phải quản lý nhiều khóa của nhà cung cấp.

- Thử nghiệm nhanh hơn: Bạn có thể A/B các mô hình khác nhau (ví dụ

gpt-4o,gpt-4.5, các biến thể Claude, hoặc mô hình đa phương thức nguồn mở) ngay trong giao diện AnythingLLM — hữu ích cho agent, phản hồi RAG, tóm tắt và tác vụ đa phương thức.

Môi trường và điều kiện cần chuẩn bị trước khi tích hợp

Yêu cầu hệ thống & phần mềm (mức cao)

- Máy tính để bàn hoặc máy chủ chạy AnythingLLM (Windows, macOS, Linux) — cài đặt desktop hoặc tự lưu trữ. Xác nhận bạn đang dùng bản mới có phần LLM Preferences / AI Providers.

- Tài khoản CometAPI và khóa API (bí mật kiểu

sk-xxxxx). Bạn sẽ dùng bí mật này trong nhà cung cấp Generic OpenAI của AnythingLLM. - Kết nối mạng từ máy của bạn tới

https://api.cometapi.com(không bị tường lửa chặn HTTPS outbound). - Tùy chọn nhưng khuyến nghị: môi trường Python hoặc Node hiện đại để thử (Python 3.10+ hoặc Node 18+), curl, và một HTTP client (Postman / HTTPie) để kiểm tra nhanh CometAPI trước khi tích hợp vào AnythingLLM.

Điều kiện cụ thể cho AnythingLLM

Nhà cung cấp LLM Generic OpenAI là tuyến khuyến nghị cho các endpoint mô phỏng bề mặt API của OpenAI. Tài liệu của AnythingLLM lưu ý nhà cung cấp này hướng tới nhà phát triển và bạn nên hiểu rõ các tham số đưa vào. Nếu bạn dùng streaming hoặc endpoint của bạn không hỗ trợ streaming, AnythingLLM có cài đặt để tắt streaming cho Generic OpenAI.

Danh sách kiểm tra bảo mật & vận hành

- Xử lý khóa CometAPI như mọi bí mật khác — đừng commit vào repo; lưu trong keychain hệ điều hành hoặc biến môi trường khi có thể.

- Nếu bạn định dùng tài liệu nhạy cảm trong RAG, đảm bảo cam kết bảo mật của endpoint đáp ứng yêu cầu tuân thủ của bạn (xem tài liệu/điều khoản của CometAPI).

- Quyết định giới hạn max tokens và context window để tránh hóa đơn tăng đột biến.

Cách cấu hình AnythingLLM để dùng CometAPI (từng bước)?

Dưới đây là chuỗi bước cụ thể — tiếp theo là ví dụ biến môi trường và đoạn mã để kiểm tra kết nối trước khi bạn lưu cài đặt trong giao diện AnythingLLM.

Bước 1 — Lấy khóa CometAPI của bạn

- Đăng ký hoặc đăng nhập tại CometAPI.

- Điều hướng đến “API Keys” và tạo khóa — bạn sẽ nhận một chuỗi trông như

sk-xxxxx. Giữ bí mật.

Bước 2 — Xác minh CometAPI hoạt động bằng một yêu cầu nhanh

Dùng curl hoặc Python để gọi endpoint chat completion đơn giản nhằm xác nhận kết nối.

Ví dụ curl

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

Nếu trả về 200 và JSON có mảng choices, khóa và mạng của bạn đang hoạt động. (Tài liệu CometAPI cho thấy bề mặt và các endpoint kiểu OpenAI).

Ví dụ Python (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

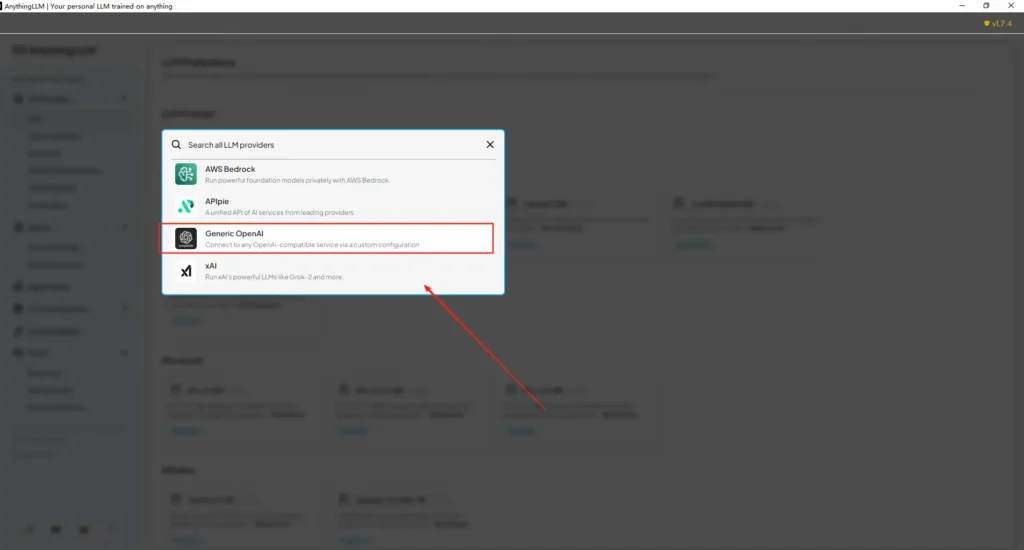

Bước 3 — Cấu hình AnythingLLM (UI)

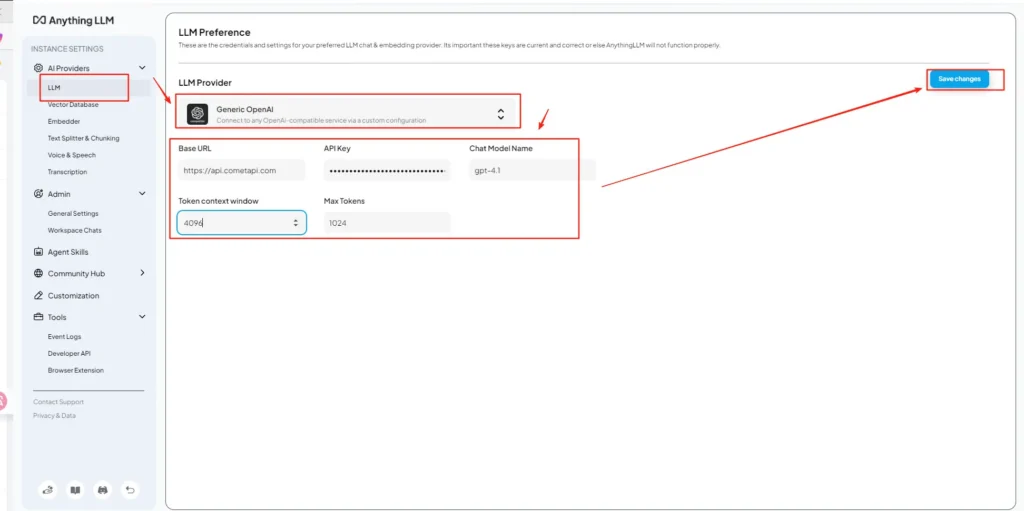

Mở AnythingLLM → Settings → AI Providers → LLM Preferences (hoặc đường dẫn tương tự tùy phiên bản). Dùng nhà cung cấp Generic OpenAI và điền các trường như sau:

API Configuration (example)

• Vào menu cài đặt của AnythingLLM, tìm LLM Preferences trong AI Providers.

• Chọn Generic OpenAI làm nhà cung cấp mô hình, nhậphttps://api.cometapi.com/v1vào ô URL.

• Dánsk-xxxxxtừ CometAPI vào ô API key. Điền Token context window và Max Tokens theo đúng mô hình thực tế. Bạn cũng có thể tùy chỉnh tên mô hình trên trang này, ví dụ thêm mô hìnhgpt-4o.

Điều này phù hợp với hướng dẫn “Generic OpenAI” (wrapper dành cho nhà phát triển) của AnythingLLM và cách đặt base URL tương thích OpenAI của CometAPI.

Bước 4 — Đặt tên mô hình & giới hạn token

Ngay trên màn hình cài đặt đó, thêm hoặc tùy biến tên mô hình đúng như CometAPI công bố (ví dụ gpt-4o, minimax-m2, kimi-k2-thinking) để giao diện AnythingLLM có thể hiển thị các mô hình đó cho người dùng. CometAPI công bố chuỗi model cho từng nhà cung cấp.

Bước 5 — Kiểm thử trong AnythingLLM

Bắt đầu cuộc chat mới hoặc dùng workspace hiện có, chọn nhà cung cấp Generic OpenAI (nếu bạn có nhiều nhà cung cấp), chọn một trong các tên mô hình của CometAPI bạn đã thêm, và chạy một prompt đơn giản. Nếu nhận được câu trả lời mạch lạc, bạn đã tích hợp thành công.

Cách AnythingLLM sử dụng các cài đặt đó ở bên trong

Wrapper Generic OpenAI của AnythingLLM sẽ tạo các yêu cầu kiểu OpenAI (/v1/chat/completions, /v1/embeddings), vì vậy khi bạn trỏ base URL và cung cấp khóa CometAPI, AnythingLLM sẽ định tuyến các cuộc trò chuyện, cuộc gọi agent, và yêu cầu embedding qua CometAPI một cách minh bạch. Nếu bạn dùng agent của AnythingLLM (luồng @agent), chúng sẽ thừa hưởng cùng nhà cung cấp.

Các thực tiễn tốt nhất và những cạm bẫy có thể gặp?

Thực tiễn tốt nhất

- Dùng cài đặt ngữ cảnh phù hợp mô hình: Khớp Token Context Window và Max Tokens của AnythingLLM với mô hình bạn chọn trên CometAPI. Không khớp có thể dẫn tới cắt cụt ngoài ý muốn hoặc lỗi gọi.

- Bảo mật khóa API: Lưu khóa CometAPI trong biến môi trường và/hoặc secret manager/Kubernetes; không bao giờ đưa vào git. AnythingLLM sẽ lưu khóa trong cài đặt cục bộ nếu bạn nhập qua UI — coi nơi lưu trữ đó là nhạy cảm.

- Bắt đầu với mô hình rẻ/nhỏ khi thử nghiệm: Dùng CometAPI để thử các mô hình chi phí thấp cho môi trường phát triển, dành mô hình cao cấp cho sản xuất. CometAPI nhấn mạnh khả năng chuyển đổi chi phí và hóa đơn hợp nhất.

- Giám sát sử dụng & đặt cảnh báo: CometAPI có bảng điều khiển sử dụng — đặt ngân sách/cảnh báo để tránh hóa đơn bất ngờ.

- Kiểm thử agent và công cụ một cách độc lập: Agent của AnythingLLM có thể kích hoạt hành động; kiểm thử với prompt an toàn và trên môi trường staging trước.

Lỗi thường gặp

- Xung đột giữa UI và

.env: Khi tự lưu trữ, cài đặt trong UI có thể ghi đè thay đổi trong.env(và ngược lại). Kiểm tra tệp/app/server/.envđược tạo nếu mọi thứ quay lại sau khi khởi động lại. Cộng đồng báo cáoLLM_PROVIDERbị reset. - Sai tên mô hình: Dùng tên mô hình không có trên CometAPI sẽ gây lỗi 400/404 từ gateway. Luôn xác nhận danh sách mô hình sẵn có trên CometAPI.

- Giới hạn token & streaming: Nếu cần phản hồi streaming, xác minh mô hình trên CometAPI hỗ trợ streaming (và phiên bản UI của AnythingLLM hỗ trợ). Một số nhà cung cấp có khác biệt về ngữ nghĩa streaming.

Những trường hợp sử dụng thực tế nào mà tích hợp này mở ra?

Tạo sinh tăng cường truy xuất (RAG)

Dùng bộ nạp tài liệu + vector DB của AnythingLLM với các LLM từ CometAPI để tạo câu trả lời theo ngữ cảnh. Bạn có thể thử nghiệm embedding rẻ + chat đắt, hoặc giữ mọi thứ trên CometAPI để có hóa đơn hợp nhất. Luồng RAG là tính năng cốt lõi tích hợp sẵn của AnythingLLM.

Tự động hóa agent

AnythingLLM hỗ trợ quy trình @agent (duyệt trang, gọi công cụ, chạy tự động hóa). Định tuyến các cuộc gọi LLM của agent qua CometAPI cho phép bạn lựa chọn mô hình cho bước điều khiển/diễn giải mà không cần sửa mã agent.

Thử nghiệm A/B đa mô hình và tối ưu chi phí

Chuyển mô hình theo workspace hoặc tính năng (ví dụ gpt-4o cho câu trả lời sản xuất, gpt-4o-mini cho phát triển). CometAPI giúp hoán đổi mô hình dễ dàng và tập trung hóa chi phí.

Chuỗi xử lý đa phương thức

CometAPI cung cấp các mô hình hình ảnh, âm thanh và chuyên biệt. Hỗ trợ đa phương thức của AnythingLLM (thông qua nhà cung cấp) cùng các mô hình của CometAPI cho phép tạo pipeline chú thích ảnh, tóm tắt đa phương thức hoặc phiên âm âm thanh qua cùng một giao diện.

Kết luận

CometAPI tiếp tục định vị mình là một gateway đa mô hình (500+ mô hình, API kiểu OpenAI) — khiến nó trở thành đối tác tự nhiên cho các ứng dụng như AnythingLLM vốn đã hỗ trợ nhà cung cấp Generic OpenAI. Đồng thời, nhà cung cấp Generic của AnythingLLM và các tùy chọn cấu hình gần đây giúp việc kết nối với các gateway như vậy trở nên dễ dàng. Sự hội tụ này đơn giản hóa thử nghiệm và chuyển dịch sang sản xuất vào cuối năm 2025.

Cách bắt đầu với Comet API

CometAPI là nền tảng API hợp nhất tổng hợp hơn 500 mô hình AI từ các nhà cung cấp hàng đầu — như dòng GPT của OpenAI, Gemini của Google, Claude của Anthropic, Midjourney, Suno và nhiều hơn nữa — vào một giao diện thân thiện với nhà phát triển. Bằng cách cung cấp cơ chế xác thực, định dạng yêu cầu và xử lý phản hồi nhất quán, CometAPI giúp việc tích hợp năng lực AI vào ứng dụng của bạn trở nên cực kỳ đơn giản. Dù bạn đang xây chatbot, trình tạo hình ảnh, công cụ sáng tác nhạc hay pipeline phân tích dữ liệu, CometAPI giúp bạn lặp nhanh hơn, kiểm soát chi phí và không phụ thuộc nhà cung cấp — đồng thời tận dụng các đột phá mới nhất trên toàn hệ sinh thái AI.

Để bắt đầu, hãy khám phá khả năng của CometAPI trong Playground và tham khảo hướng dẫn API để biết chỉ dẫn chi tiết. Trước khi truy cập, hãy đảm bảo bạn đã đăng nhập CometAPI và lấy khóa API. CometAPI cung cấp mức giá thấp hơn đáng kể so với giá chính thức để hỗ trợ bạn tích hợp.

Sẵn sàng bắt đầu?→ Sign up for CometAPI today !

Nếu bạn muốn biết thêm mẹo, hướng dẫn và tin tức về AI, hãy theo dõi chúng tôi trên VK, X và Discord!