GLM-4.6 là bản phát hành lớn mới nhất trong dòng GLM của Z.ai (trước đây là Zhipu AI): một mô hình ngôn ngữ lớn thế hệ thứ 4 kiểu MoE (Mixture-of-Experts), được tinh chỉnh cho quy trình tác tử, suy luận ngữ cảnh dài và lập trình thực tế. Bản phát hành nhấn mạnh tích hợp tác tử/công cụ mang tính thực tiễn, cửa sổ ngữ cảnh rất lớn, và trọng số mở cho triển khai cục bộ.

Tính năng chính

- Ngữ cảnh dài — cửa sổ ngữ cảnh gốc 200K token (mở rộng từ 128K). (docs.z.ai)

- Khả năng lập trình & tác tử — cải thiện được quảng bá trên các tác vụ lập trình thực tế và khả năng gọi công cụ tốt hơn cho tác tử.

- Hiệu quả — báo cáo tiêu thụ token thấp hơn ~30% so với GLM-4.5 trong các bài kiểm tra của Z.ai.

- Triển khai & lượng tử hóa — lần đầu công bố tích hợp FP8 và Int4 cho chip Cambricon; hỗ trợ FP8 bản địa trên Moore Threads qua vLLM.

- Kích thước mô hình & loại tensor — hiện vật công bố cho thấy mô hình ~357B tham số (tensor BF16 / F32) trên Hugging Face.

Chi tiết kỹ thuật

Phương thức & định dạng. GLM-4.6 là LLM chỉ văn bản (phương thức đầu vào và đầu ra: văn bản). Độ dài ngữ cảnh = 200K token; đầu ra tối đa = 128K token.

Lượng tử hóa & hỗ trợ phần cứng. Nhóm báo cáo lượng tử hóa FP8/Int4 trên chip Cambricon và FP8 bản địa trên GPU Moore Threads bằng vLLM cho suy luận — quan trọng để giảm chi phí suy luận và cho phép triển khai on-prem và đám mây nội địa.

Công cụ & tích hợp. GLM-4.6 được phân phối qua API của Z.ai, mạng lưới nhà cung cấp bên thứ ba (ví dụ, CometAPI), và tích hợp vào các tác tử lập trình (Claude Code, Cline, Roo Code, Kilo Code).

Chi tiết kỹ thuật

Phương thức & định dạng. GLM-4.6 là LLM chỉ văn bản (phương thức đầu vào và đầu ra: văn bản). Độ dài ngữ cảnh = 200K token; đầu ra tối đa = 128K token.

Lượng tử hóa & hỗ trợ phần cứng. Nhóm báo cáo lượng tử hóa FP8/Int4 trên chip Cambricon và FP8 bản địa trên GPU Moore Threads bằng vLLM cho suy luận — quan trọng để giảm chi phí suy luận và cho phép triển khai on-prem và đám mây nội địa.

Công cụ & tích hợp. GLM-4.6 được phân phối qua API của Z.ai, mạng lưới nhà cung cấp bên thứ ba (ví dụ, CometAPI), và tích hợp vào các tác tử lập trình (Claude Code, Cline, Roo Code, Kilo Code).

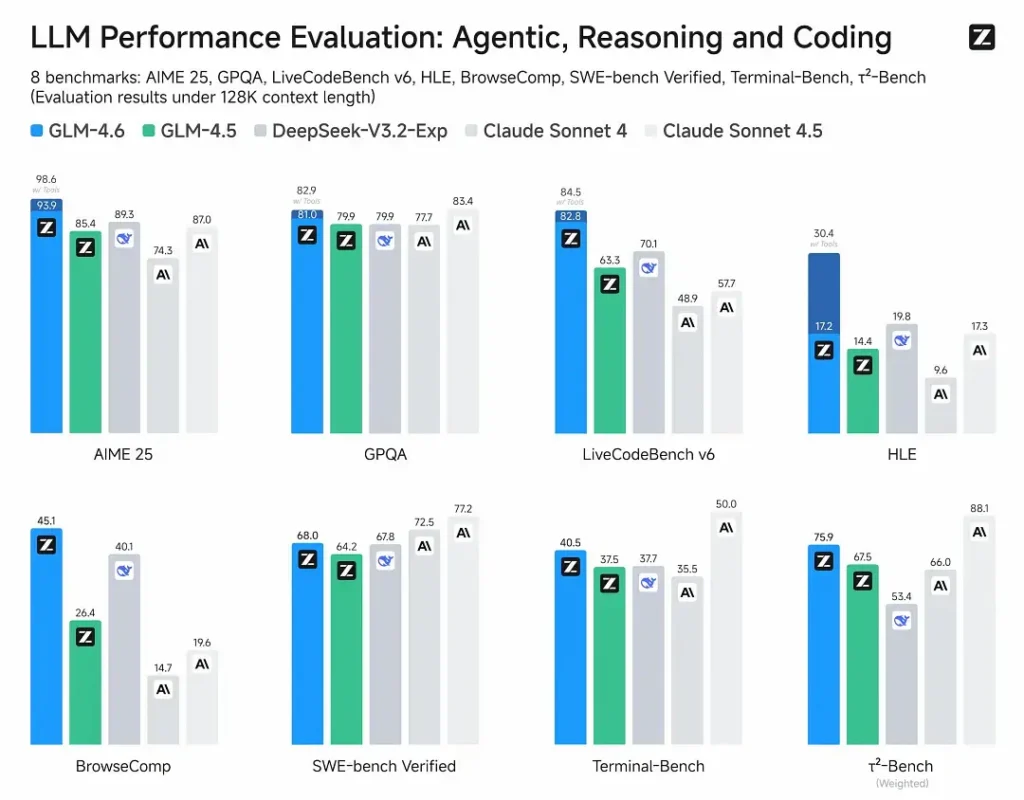

Hiệu năng benchmark

- Đánh giá đã công bố: GLM-4.6 được thử nghiệm trên tám benchmark công khai bao phủ tác tử, suy luận và lập trình và cho thấy cải thiện rõ rệt so với GLM-4.5. Trong các bài kiểm tra lập trình thực tế được con người đánh giá (CC-Bench mở rộng), GLM-4.6 dùng ít hơn ~15% token so với GLM-4.5 và đạt tỷ lệ thắng ~48,6% so với Claude Sonnet 4 của Anthropic (gần như ngang bằng trên nhiều bảng xếp hạng).

- Định vị: kết quả cho rằng GLM-4.6 cạnh tranh với các mô hình hàng đầu trong nước và quốc tế (ví dụ trích dẫn gồm DeepSeek-V3.1 và Claude Sonnet 4).

Hạn chế & rủi ro

- Ảo giác & sai sót: như tất cả LLM hiện nay, GLM-4.6 có thể mắc lỗi thực tế — tài liệu của Z.ai nêu rõ đầu ra có thể chứa sai sót. Người dùng nên áp dụng xác minh & retrieval/RAG cho nội dung quan trọng.

- Độ phức tạp mô hình & chi phí phục vụ: ngữ cảnh 200K và đầu ra rất lớn làm tăng mạnh yêu cầu bộ nhớ & độ trễ và có thể nâng chi phí suy luận; cần lượng tử hóa/kỹ thuật suy luận để chạy ở quy mô.

- Khoảng cách theo lĩnh vực: dù GLM-4.6 báo cáo hiệu năng tác tử/lập trình mạnh, một số báo cáo công khai lưu ý mô hình vẫn tụt hậu so với một số phiên bản của mô hình cạnh tranh ở các microbenchmark cụ thể (ví dụ, một số chỉ số lập trình so với Sonnet 4.5). Nên đánh giá theo từng tác vụ trước khi thay thế mô hình sản xuất.

- An toàn & chính sách: trọng số mở tăng khả năng tiếp cận nhưng cũng đặt ra câu hỏi về quản trị (giảm thiểu, hàng rào bảo vệ và red-teaming là trách nhiệm của người dùng).

Trường hợp sử dụng

- Hệ thống tác tử & phối hợp công cụ: vết tác tử dài, lập kế hoạch đa công cụ, gọi công cụ động; tinh chỉnh agentic của mô hình là điểm bán hàng chính.

- Trợ lý lập trình thực tế: tạo mã nhiều lượt, đánh giá mã và trợ lý IDE tương tác (tích hợp trong Claude Code, Cline, Roo Code — theo Z.ai). Cải thiện hiệu quả token khiến mô hình hấp dẫn cho các gói nhà phát triển sử dụng nặng.

- Quy trình tài liệu dài: tóm tắt, tổng hợp đa tài liệu, đánh giá pháp lý/kỹ thuật dài nhờ cửa sổ 200K.

- Sáng tạo nội dung & nhân vật ảo: đối thoại kéo dài, duy trì nhân vật nhất quán trong các kịch bản nhiều lượt.

GLM-4.6 so sánh với các mô hình khác

- GLM-4.5 → GLM-4.6: thay đổi bước về kích thước ngữ cảnh (128K → 200K) và hiệu quả token (~15% ít token hơn trên CC-Bench); cải thiện sử dụng tác tử/công cụ.

- GLM-4.6 vs Claude Sonnet 4 / Sonnet 4.5: Z.ai báo cáo gần ngang bằng trên nhiều bảng xếp hạng và tỷ lệ thắng ~48,6% trên các tác vụ lập trình thực tế CC-Bench (cạnh tranh sát sao, với một số microbenchmark Sonnet vẫn dẫn đầu). Với nhiều nhóm kỹ thuật, GLM-4.6 được định vị là lựa chọn hiệu quả chi phí.

- GLM-4.6 vs các mô hình ngữ cảnh dài khác (DeepSeek, biến thể Gemini, họ GPT-4): GLM-4.6 nhấn mạnh ngữ cảnh lớn & quy trình lập trình agentic; điểm mạnh tương đối phụ thuộc vào chỉ số (hiệu quả token/tích hợp tác tử so với độ chính xác tổng hợp mã thô hoặc quy trình an toàn). Lựa chọn thực nghiệm nên được dẫn dắt bởi tác vụ.

Zhipu AI phát hành mẫu flagship mới nhất GLM-4.6: tổng 355B tham số, 32B hoạt động. Vượt GLM-4.5 ở mọi năng lực cốt lõi.

- Lập trình: Tiệm cận Claude Sonnet 4, tốt nhất ở Trung Quốc.

- Ngữ cảnh: Mở rộng lên 200K (từ 128K).

- Suy luận: Cải thiện, hỗ trợ gọi công cụ trong quá trình suy luận.

- Tìm kiếm: Tăng cường gọi công cụ và hiệu năng tác tử.

- Viết: Phù hợp hơn với sở thích của con người về phong cách, khả năng đọc và nhập vai.

- Đa ngôn ngữ: Tăng cường dịch xuyên ngôn ngữ.