TL;DR: Bản phát hành gần đây của OpenClaw bổ sung hỗ trợ hạng nhất, tương thích về sau cho GPT-5.4 của OpenAI và giới thiệu kiến trúc “hoán đổi nóng bộ nhớ” cho phép tác nhân OpenClaw thay đổi model và kho bộ nhớ đang hoạt động ngay trong thời gian chạy với gián đoạn tối thiểu. Điều này mở khóa các quy trình có ngữ cảnh lớn (cửa sổ ngữ cảnh mở rộng của GPT-5.4), chuyên biệt hóa model tức thời và tối ưu chi phí/độ trễ cho các tác nhân sản xuất. Nâng cấp có trong các bản phát hành và tài liệu đi kèm của OpenClaw; ví dụ dưới đây cung cấp cấu hình thực tế, đoạn mã, bối cảnh benchmark và khuyến nghị thực hành tốt.

Bản cập nhật của OpenClaw thực sự phát hành những gì (tóm tắt nhanh)

Vào ngày 9 tháng 3 năm 2026, dự án mã nguồn mở “láng giềng” OpenAI là OpenClaw đã phát hành một bản phát hành lõi lớn (2026.3.7) bổ sung hỗ trợ hạng nhất cho GPT-5.4 và cơ chế “hoán đổi nóng bộ nhớ” mới trong động cơ ngữ cảnh. Bản phát hành này chuyển đổi một framework tác nhân thử nghiệm được dùng rộng rãi thành thứ mà nhóm duy trì mô tả là “Hệ điều hành Tác nhân” — hướng tới việc giúp quy trình tác nhân cấp sản xuất và chuyển đổi model trở nên liền mạch cho nhà phát triển và đội ngũ.

3 mục thực tiễn quan trọng với người xây tác nhân:

- Hỗ trợ hạng nhất GPT-5.4 — bí danh model và ánh xạ nhà cung cấp cho phép tác nhân chọn GPT-5.4 làm model thực thi chính (bao gồm ghi đè theo kênh và ghim model theo tác nhân).

- Động cơ ngữ cảnh & liên kết kênh phân tán — cải tiến cách OpenClaw lắp ráp cửa sổ ngữ cảnh dài từ bộ nhớ, đầu ra công cụ và lịch sử kênh để các model dung lượng cao nhận được đầu vào có cấu trúc tốt.

- Kiến trúc bộ nhớ hoán đổi nóng — bề mặt plugin bộ nhớ và quy trình rõ ràng hơn để bạn có thể thay thế backend bộ nhớ hoặc nâng cấp tác nhân mà không làm mất “định danh” hay làm hỏng trạng thái đã lưu (bản thân bộ nhớ vẫn là nguồn chân lý duy nhất). Thiết kế bộ nhớ của OpenClaw (tệp Markdown thuần, tìm kiếm được lập chỉ mục, truy xuất dạng plugin) là một phần giúp hoán đổi nóng an toàn.

GPT-5.4 — GPT-5.4 là gì và bứt phá benchmark

GPT-5.4 là bản phát hành frontier model mới nhất của OpenAI tập trung mạnh vào năng suất chuyên nghiệp (bảng tính, chỉnh sửa tài liệu & trình chiếu, suy luận nhiều bước và điều khiển công cụ). Theo OpenAI và các trang tin độc lập, bản phát hành nhấn mạnh:

- Mở rộng ngữ cảnh: GPT-5.4 giới thiệu cấp tiếp theo của cửa sổ ngữ cảnh, với thử nghiệm 1 triệu token và cải thiện xử lý ngữ cảnh dài thông qua các endpoint Codex/tương thích Codex — các núm cấu hình như

model_context_windowvàmodel_auto_compact_token_limitđược mở cho nhà phát triển. Điều này cho phép bạn giữ trạng thái hội thoại, tài liệu và codebase lớn hơn nhiều trong ngữ cảnh hoạt động. - Độ chính xác bảng tính và suy luận cao hơn — OpenAI báo cáo cải thiện lớn trên tác vụ mô hình hóa bảng tính (điểm trung bình ~87% so với ~68% của GPT-5.2 trên benchmark bảng tính ngân hàng/nhà phân tích của họ).

- Cải thiện độ chính xác và tính xác thực: đánh giá sớm và QA cho thấy giảm ~33% ảo giác và ít đầu ra dễ lỗi hơn so với GPT-5.2, với lợi ích đáng kể trong soạn thảo tài liệu và công việc bảng tính. Người đánh giá cũng ghi nhận giảm ~18% phản hồi dễ lỗi ở một số tác vụ năng suất nhất định.

- Tích hợp khả năng sử dụng máy tính và cải tiến từ phả hệ Codex — GPT-5.4 bao gồm các năng lực kế thừa từ dòng Codex giúp cải thiện sinh mã, gỡ lỗi tương tác và điều khiển công cụ vận hành (tự động chuột/bàn phím/chụp màn hình trong một số demo). Điều này giúp nó tốt hơn ở chu trình viết-chạy-kiểm-tra-sửa thường thấy trong vòng lặp tác nhân.

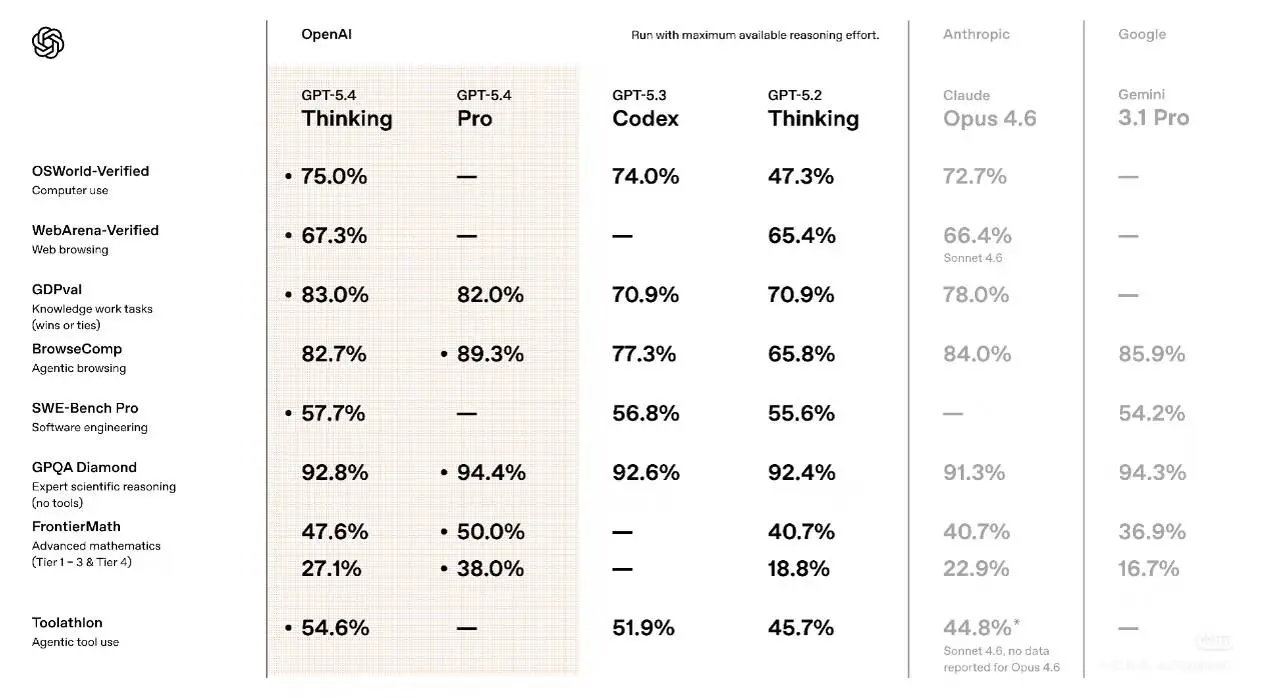

Benchmark & bối cảnh so sánh (những con số nói gì)

- Mô hình hóa bảng tính: benchmark nội bộ của OpenAI: điểm trung bình ~87.3% cho GPT-5.4 so với ~68.4% cho GPT-5.2. Đây là tiêu đề mà nhà cung cấp dùng để cho thấy mức tăng theo tác vụ.

- Tương tác máy tính (OSWorld / kiểm thử kiểu tác nhân): người kiểm thử độc lập và cộng đồng cho thấy GPT-5.4 cải thiện ở các tác vụ tương tác tác nhân liên quan thao tác desktop hoặc UI mô phỏng, đôi khi vượt một số biến thể model Anthropic gần đây với biên nhỏ trên các bộ tác vụ này (khác biệt có ý nghĩa với tác nhân, nhưng không nhất thiết quyết định ở mọi khối lượng công việc).

Diễn giải: GPT-5.4 không phải “viên đạn bạc” thắng mọi thứ. Nó có thế mạnh rõ ở sử dụng công cụ tích hợp, mẫu thực thi mã và suy luận bảng tính — chính là khối công việc tác nhân OpenClaw thường chạy. Với người xây tác nhân, kết hợp giữa độ tin cậy bộ thực thi cải thiện (phả hệ Codex) + năng lực lập kế hoạch tốt hơn + xử lý ngữ cảnh dài vượt trội là cực kỳ phù hợp.

OpenClaw hỗ trợ GPT-5.4: đã thay đổi gì và vì sao quan trọng

Bản phát hành của OpenClaw (xem trang phát hành dự án) cập nhật bộ phân giải model và runtime để tương thích về sau với ngữ cảnh mở rộng và giới hạn token của GPT-5.4 và bổ sung khả năng “hoán đổi nóng bộ nhớ” để tác nhân có thể chuyển đổi backend bộ nhớ hoặc model trong thời gian chạy. Điều này được thực hiện theo ba cách cụ thể: 1) cập nhật metadata model và bộ phân giải để chấp nhận ngữ cảnh và giới hạn token lớn hơn; 2) thay đổi runtime của tác nhân để điều phối hoán đổi model trơn tru và làm ấm cache; 3) API bộ nhớ cho phép nhiều kênh bộ nhớ và trigger hoán đổi nóng.

Hỗ trợ GPT-5.4 của phiên bản 2026.3.7 cùng thiết kế “hoán đổi nóng bộ nhớ” mang lại hai lợi thế thực tiễn, bổ sung cho nhau:

- Lộ trình nâng cấp model đơn giản. OpenClaw giờ có thể trình bày GPT-5.4 như “runtime” có thể chọn cho tác nhân, cho phép bạn chuyển từ các model GPT-5.x cũ hơn hoặc nhà cung cấp khác mà không phải viết lại logic tác nhân. Bản cập nhật OpenClaw tuyên bố tích hợp GPT-5.4 ổn định trong lõi.

- Hoán đổi nóng bộ nhớ. Thay vì lưu một snapshot bộ nhớ tuyến tính duy nhất, Động cơ Ngữ cảnh của OpenClaw cho phép phân vùng bộ nhớ được tách rời, hoán đổi hoặc di trú trong thời gian chạy — ví dụ, hoán đổi vào shard vector DB có recall cao để debug hoặc chuyển sang biến thể bộ nhớ đã khử dữ liệu theo GDPR cho audit bên ngoài — mà không dừng tác nhân. Điều đó giảm rủi ro gián đoạn trong sản xuất và cho phép cấu hình bộ nhớ theo trường hợp sử dụng (debug so với quyền riêng tư so với hiệu năng).

đột phá hiệu năng thực tiễn & lợi thế

Tích hợp của OpenClaw tập trung vào ba lĩnh vực thực tế nơi GPT-5.4 tỏa sáng:

- Độ trung thành điều phối công cụ. Cải thiện tìm kiếm công cụ nội bộ và suy luận của GPT-5.4 giảm churn gọi công cụ (ít cuộc gọi dư thừa và ít retry hơn). Điều đó chuyển thành ít cuộc gọi API hơn và hoàn thành nhanh hơn cho luồng phức tạp. Báo cáo sớm cho thấy cải thiện hiệu quả token và cuộc gọi công cụ so với các model GPT-5.x cũ hơn.

- Xử lý ngữ cảnh dài, phong phú hơn. Tác nhân OpenClaw giờ có thể giữ ngữ cảnh hoạt động lớn hơn nhiều (bao gồm các shard bộ nhớ được hoán đổi vào), cho phép quản lý hội thoại dài, dự án đa tệp và debug lặp mà không mất trạng thái.

- Đầu ra mã mang tính quyết định tốt hơn. Với quy trình tự động sinh mã (hook CI, khung hàm, template hạ tầng), GPT-5.4 có xu hướng tạo đầu ra nhất quán và chạy được hơn, giảm chi phí rà soát thủ công. Bài kiểm thử độc lập cho thấy cải thiện đáng kể ở các chỉ số chất lượng mã so với model GPT-5 trước đó.

- Tính liên tục bộ nhớ — “hoán đổi nóng bộ nhớ” cho phép thay thế hoặc bổ sung kho bộ nhớ (bộ nhớ cục bộ, vector DB, bộ nhớ LLM) mà không làm mất trạng thái hoặc ngữ cảnh của tác nhân, hỗ trợ A/B test, nâng cấp cuốn chiếu và chuyển đổi dự phòng.

Trong bài kiểm thử benchmark OOLONG, phiên bản mới của OpenClaw, kết hợp với plugin lossless-claw, đạt điểm cao 74.8, bỏ xa Claude Code (70.3 điểm). Đặc biệt, OpenClaw thể hiện độ ổn định và chính xác khi độ dài ngữ cảnh tăng, khiến các kỹ sư thử nghiệm tại chỗ phải thốt lên rằng “nói chạy tốt là quá khiêm tốn”.

Cách cấu hình và dùng GPT-5.4 trong OpenClaw (từng bước)

Một quy trình OpenClaw đơn giản dùng GPT 5.4:

- Cấu hình điển hình như dưới đây:

- Người dùng gửi tin nhắn qua các nền tảng như Discord hoặc Telegram.

- OpenClaw nhận tin qua máy chủ gateway của mình.

- Gateway chuyển tiếp prompt đến GPT 5.4 qua nhà cung cấp API AI.

- GPT 5.4 tạo phản hồi hoặc kích hoạt hành động công cụ.

- OpenClaw gửi kết quả cuối cùng về cho người dùng.

Dưới đây là các ví dụ cấu hình thực dụng, có thể sao-chép-dán và quy trình để chạy GPT-5.4 trong OpenClaw một cách an toàn và tái lập. Chúng cố ý thận trọng: bật model trước trong một tác nhân thử nghiệm và gắn công cụ đo cho mọi thứ về metric và lỗi.

Điều kiện tiên quyết

- OpenClaw đã nâng cấp lên bản phát hành có ánh xạ GPT-5.4 (xem ghi chú phát hành ở trên).

- OpenAI API key hợp lệ có quyền truy cập GPT-5.4 (tôi chọn endpoint CometAPI với giá rẻ hơn).

1) Lựa chọn model & cấu hình bộ phân giải (Json/ YAML / CLI)

Đặt nội dung này vào ~/.openclaw/openclaw.json (hoặc trộn vào config hiện có của bạn). Điều chỉnh tên nhà cung cấp và tham chiếu token theo môi trường của bạn.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw dùng một bộ phân giải model để ánh xạ tên model logic (ví dụ, openai/gpt-5.4) tới endpoint và cấu hình runtime. Thêm hoặc cập nhật tệp bộ phân giải (ví dụ models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Hoặc đặt tại thời gian chạy qua CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Lưu ý: The

context_windowandmax

Ghi chú

agents.defaults.model.primarychọn model mặc định. Dùngchannels.modelByChannelđể ghi đè theo kênh nhằm định tuyến kênh quan trọng sang GPT-5.4 và kênh ít đòi hỏi sang model rẻ hơn. Xem tài liệu chọn model của OpenClaw về thứ tự ưu tiên.- Vui lòng tham khảo trang model của CometAPI để biết tên model cụ thể. Nếu muốn dùng OpenAI, thay URL và API key bằng của OpenAI.

- Các khóa

context_windowvàmax_output_tokensphản ánh thay đổi tương thích về sau trong bộ phân giải của OpenClaw để tác nhân không cố dùng giới hạn Codex lỗi thời.

2) Cách bật và kiểm thử “hoán đổi nóng bộ nhớ”

Hệ thống bộ nhớ của OpenClaw dựa trên tệp (tệp Markdown) cộng với plugin lập chỉ mục/tìm kiếm để bạn có thể hoán đổi backend plugin (ví dụ, vector SQLite, Milvus hoặc dịch vụ bộ nhớ bên ngoài) an toàn mà không mất tệp bộ nhớ thô.

Mẫu phổ biến:

- Chuẩn hóa vị trí bộ nhớ: dùng workspace có git:

~/.openclaw/workspace/nơiMEMORY.mdvàmemory/YYYY-MM-DD.mdlà nguồn tham chiếu. - Cài đặt & cấu hình một plugin bộ nhớ (ví dụ: sqlite-vec) và trỏ

plugins.slots.memorytới plugin đó trong config. - Kiểm thử di trú: thêm plugin mới, chạy job lập chỉ mục song song, so sánh kết quả truy xuất, rồi chuyển alias

plugins.slots.memorysang plugin mới khi hài lòng.

Ví dụ hoán đổi alias plugin (bash pseudo-commands):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Vì sao đây là “hoán đổi nóng”: các tệp bộ nhớ vẫn là nguồn chân lý. Plugin triển khai lớp lập chỉ mục và truy xuất; hoán đổi chúng sẽ lập chỉ mục lại nhưng không thay đổi các tệp .md bên dưới. Điều này cho phép hoán đổi model mà không bị trôi định danh thảm họa — tác nhân vẫn đọc cùng những BỘ NHỚ đó.

3) Ví dụ: ghim một tác nhân riêng lẻ vào GPT-5.4 (ghi đè theo tác nhân)

Bạn có thể ghi đè model theo từng tác nhân; thêm mục tác nhân như:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Nếu bản phát hành cộng đồng hoặc phiên bản OpenClaw của bạn yêu cầu CLI, bạn cũng có thể đặt model theo phiên tại thời gian chạy:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Mẹo vận hành: ghim đảm bảo hành vi có tính quyết định cho tác nhân đó trong khi bạn chạy A/B test trên các tác nhân khác.

Nếu bạn muốn dùng OpenAI, hãy thay URL và API key bằng của OpenAI.

4) Dùng tùy chọn ngữ cảnh 1M của Codex (API knobs)

Nếu triển khai OpenClaw của bạn truy cập trực tiếp các endpoint OpenAI Codex, truyền tùy chọn ngữ cảnh:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Các yêu cầu vượt quá cửa sổ ngữ cảnh tiêu chuẩn có thể bị tính theo mức sử dụng khác (tài liệu OpenAI ghi chú việc tính kép cho các yêu cầu vượt cửa sổ tiêu chuẩn ở giai đoạn xem trước Codex).

Thực hành tốt: tối đa hóa thế mạnh của GPT-5.4 trong OpenClaw

Chi phí, độ trễ & pha trộn model

- Chiến lược model lai: Dùng model nhỏ, rẻ cho truy vấn ngắn và xử lý luồng; hoán đổi nóng sang GPT-5.4 cho phân tích nặng, tóm tắt, sinh mã cần ngữ cảnh dài. Điều này giảm tổng chi phí token mà vẫn giữ chất lượng. (Thực hiện qua trigger trong cấu hình bộ nhớ ở trên.)

- Nén token & tăng cường truy xuất: Dùng pipeline tăng cường truy xuất để giới hạn token gửi lên model — lưu tài liệu dài trong vector DB, truy xuất đoạn liên quan và chỉ đưa vào các mảnh phù hợp nhất cùng một kế hoạch gọn. Tìm kiếm công cụ của GPT-5.4 giúp tự động định vị công cụ hoặc tài liệu hữu ích.

- Khởi động ấm & lạnh: Sau khi hoán đổi model, làm ấm model với một lượt mồi ngữ cảnh ngắn để tránh đột biến độ trễ ở yêu cầu đầu tiên. Tiền biên dịch template prompt và tái nạp các kênh bộ nhớ thiết yếu. Chiến lược rolling của OpenClaw (xem cấu hình) hỗ trợ tiền làm ấm.

Độ tin cậy & an toàn

- Dự phòng êm: Triển khai timeout và kế hoạch dự phòng (ví dụ, giảm cấp về câu trả lời đã cache từ phiên trước) để xử lý rate limit hoặc lỗi quota API.

- Lớp an toàn: Duy trì bộ lọc chính sách và bước xác minh khi đầu ra ảnh hưởng quyết định. GPT-5.4 giảm ảo giác về mặt thống kê, nhưng xác minh vẫn quan trọng với tác vụ rủi ro cao.

Đánh giá & giám sát

- Tái lập benchmark của bạn: Chạy head-to-head cho khối lượng công việc của bạn (hoàn thành mã, refactor đa tệp, phân tích bảng tính) bằng thang đo chuẩn. Báo cáo công khai chỉ ra thế mạnh ở tác vụ bảng tính và năng suất — hãy xác nhận bằng dữ liệu của bạn.

- Telemetry: Giám sát tiêu thụ token, độ trễ model, tần suất hoán đổi bộ nhớ và chất lượng câu trả lời (đánh giá của con người/kiểm thử tự động). Dùng telemetry để tinh chỉnh ngưỡng hoán đổi.

Ví dụ: Tác nhân review code có hoán đổi nóng

Mục tiêu: Chạy tóm tắt lint + unit test định kỳ khi push (model rẻ) và nâng cấp sang GPT-5.4 cho gợi ý refactor đa tệp khi test fail hoặc diff vượt 10 tệp.

Luồng (cấp cao):

- Trigger pre-commit chạy

local/fast-small-coderđể tạo tóm tắt lint. - Nếu

test_failures > 0hoặcdiff_files > 10, kích hoạthot_swapsangopenai/gpt-5.4. Thăng hạnglongterm_vectorchứa lịch sử repo. - Chạy prompt GPT-5.4 có toàn bộ stack trace lỗi + các tệp mã liên quan được đưa vào ngữ cảnh. Tạo bản vá refactor và thay đổi unit test.

- Người review đánh giá đầu ra; phản hồi cập nhật vào bộ nhớ.

Khung prompt (gửi tới GPT-5.4 sau truy xuất & nén):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Trường hợp này cho thấy vì sao ngữ cảnh lớn + hoán đổi nóng bộ nhớ có giá trị: bạn có thể đưa toàn bộ trace lỗi và nhiều tệp vào model cùng lúc. Triển khai trigger hoán đổi một cách thận trọng để kiểm soát chi phí.

Cuối cùng: ai nên áp dụng GPT-5.4 trong OpenClaw (và khi nào)

- Áp dụng ngay nếu tác nhân của bạn thực hiện tác vụ công cụ/nhiều bước, tự động hóa bảng tính nặng, hoặc chỉnh sửa tài liệu phức tạp nơi chu trình viết-chạy-kiểm-tra chi phối thời gian của nhà phát triển. Lợi ích về năng suất và độ tin cậy dễ thấy nhất ở đây.

- Áp dụng thận trọng nếu bạn vận hành các kênh chat khối lượng lớn, nhạy chi phí nơi suy luận đơn giản là đủ; dùng định tuyến để bảo toàn hiệu quả chi phí.

- Đừng giả định một model thống trị: benchmark trên dữ liệu của bạn. GPT-5.4 là ứng viên mạnh cho khối công việc tác nhân, nhưng chọn model phải dựa trên bằng chứng.

Nhà phát triển có thể truy cập GPT-5.4 qua CometAPI (CometAPI là nền tảng tổng hợp API mô hình lớn một cửa như GPT API, Nano Banana API, v.v.) ngay bây giờ. Để bắt đầu, hãy khám phá khả năng của model trong Playground và tham khảo hướng dẫn tích hợp Openclaw để biết hướng dẫn chi tiết. Trước khi truy cập, hãy đảm bảo bạn đã đăng nhập CometAPI và lấy API key. CometAPI cung cấp mức giá thấp hơn nhiều so với giá chính thức để giúp bạn tích hợp.

Sẵn sàng bắt đầu? → Đăng ký OpenClaw ngay hôm nay!

Nếu bạn muốn biết thêm mẹo, hướng dẫn và tin tức về AI, hãy theo dõi chúng tôi trên VK, X và Discord!