DeepSeek đã phát hành DeepSeek V3.2 như người kế nhiệm cho dòng V3.x và biến thể đi kèm DeepSeek-V3.2-Speciale mà công ty định vị là phiên bản hiệu năng cao, “ưu tiên lập luận” dành cho tác tử/công cụ. V3.2 được xây dựng trên công trình thử nghiệm (V3.2-Exp) và giới thiệu năng lực lập luận cao hơn, một ấn bản Speciale tối ưu cho hiệu năng toán học/lập trình thi đấu “cấp vàng”, cùng hệ thống “hai chế độ ‘suy nghĩ + công cụ’” mà DeepSeek mô tả là lần đầu tiên có, tích hợp chặt chẽ lập luận nội bộ theo từng bước với việc gọi công cụ bên ngoài và quy trình tác tử.

DeepSeek V3.2 là gì — và V3.2-Speciale khác gì?

DeepSeek-V3.2 là người kế nhiệm chính thức của nhánh thử nghiệm V3.2-Exp của DeepSeek. DeepSeek mô tả đây là một dòng mô hình “ưu tiên lập luận” được xây dựng cho tác tử, tức các mô hình không chỉ được tinh chỉnh cho chất lượng hội thoại tự nhiên mà còn đặc biệt cho suy luận nhiều bước, gọi công cụ và kiểu lập luận dạng chuỗi suy nghĩ đáng tin cậy khi hoạt động trong các môi trường có công cụ bên ngoài (API, thực thi mã, kết nối dữ liệu).

DeepSeek-V3.2 (base) là gì

- Được định vị là người kế nhiệm sản xuất chủ lưu cho dòng thử nghiệm V3.2-Exp; dự kiến cung cấp rộng rãi qua ứng dụng/web/API của DeepSeek.

- Giữ cân bằng giữa hiệu quả tính toán và lập luận vững chắc cho các tác vụ tác tử.

DeepSeek-V3.2-Speciale là gì

DeepSeek-V3.2-Speciale là một biến thể mà DeepSeek quảng bá như “Phiên bản Đặc biệt” năng lực cao, tinh chỉnh cho lập luận cấp thi đấu, toán học nâng cao và hiệu năng tác tử. Được quảng bá là biến thể năng lực cao hơn “đẩy giới hạn năng lực lập luận”. Hiện DeepSeek cung cấp Speciale dưới dạng model chỉ-API với định tuyến truy cập tạm thời; các điểm chuẩn ban đầu cho thấy nó được định vị để cạnh tranh với các mô hình đóng cao cấp trong các bài đánh giá về lập luận và mã hóa.

Dòng dõi và lựa chọn kỹ thuật nào dẫn tới V3.2?

V3.2 kế thừa chuỗi kỹ thuật lặp mà DeepSeek công bố trong năm 2025: V3 → V3.1 (Terminus) → V3.2-Exp (bước thử nghiệm) → V3.2 → V3.2-Speciale. Bản thử nghiệm V3.2-Exp đã giới thiệu DeepSeek Sparse Attention (DSA) — một cơ chế chú ý thưa tinh chỉnh nhằm giảm chi phí bộ nhớ và tính toán cho ngữ cảnh rất dài trong khi vẫn giữ chất lượng đầu ra. Nghiên cứu DSA và công việc giảm chi phí đó là bước đệm kỹ thuật cho dòng V3.2 chính thức.

Có gì mới trong DeepSeek 3.2 chính thức?

1) Tăng cường năng lực lập luận — lập luận được cải thiện thế nào?

DeepSeek quảng bá V3.2 là “ưu tiên lập luận.” Điều đó có nghĩa kiến trúc và tinh chỉnh tập trung vào việc thực hiện suy luận nhiều bước một cách đáng tin cậy, duy trì chuỗi suy nghĩ nội bộ và hỗ trợ kiểu suy ngẫm có cấu trúc mà tác tử cần để sử dụng công cụ đúng đắn.

Cụ thể, cải tiến gồm:

- Huấn luyện và RLHF (hoặc các thủ tục căn chỉnh tương tự) được tinh chỉnh để khuyến khích giải quyết vấn đề theo từng bước tường minh và các trạng thái trung gian ổn định (hữu ích cho lập luận toán, sinh mã nhiều bước và bài toán logic).

- Lựa chọn kiến trúc và hàm mất mát giúp bảo toàn cửa sổ ngữ cảnh dài hơn và cho phép mô hình tham chiếu trung thực các bước lập luận trước đó.

- Các chế độ thực dụng (xem “hai chế độ” bên dưới) cho phép cùng một mô hình hoạt động hoặc ở chế độ “chat” nhanh hơn, hoặc ở chế độ “suy nghĩ” cẩn trọng nơi mô hình cố ý đi qua các bước trung gian trước khi hành động.

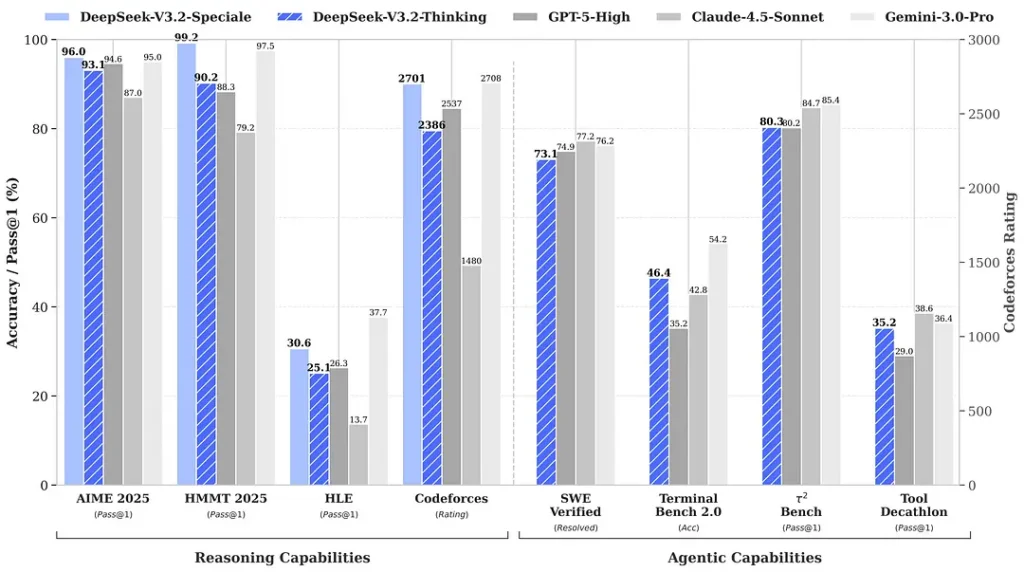

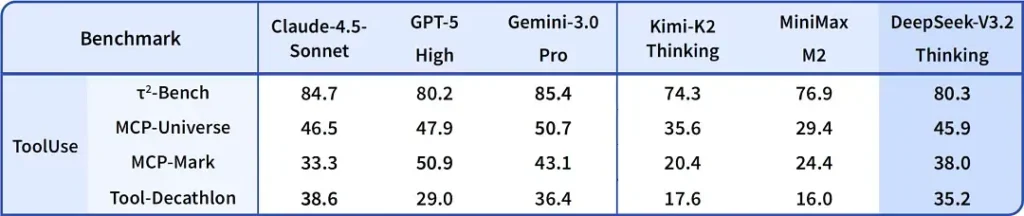

Các điểm chuẩn được trích dẫn xung quanh thời điểm phát hành cho thấy những cải thiện đáng kể trong các bộ đánh giá toán và lập luận; các điểm chuẩn cộng đồng độc lập ban đầu cũng báo cáo điểm số ấn tượng trên các bộ đánh giá cạnh tranh:

2) Hiệu năng đột phá ở Phiên bản Đặc biệt — tốt hơn bao nhiêu?

DeepSeek-V3.2-Speciale được cho là mang lại bước nhảy về độ chính xác lập luận và phối dàn tác tử so với V3.2 tiêu chuẩn. Nhà cung cấp định khung Speciale như một tầng hiệu năng nhắm đến khối lượng công việc lập luận nặng và các tác vụ tác tử đầy thách thức; hiện chỉ cung cấp qua API và là một endpoint năng lực cao tạm thời (DeepSeek cho biết tính sẵn sàng của Speciale ban đầu sẽ hạn chế). Phiên bản Speciale tích hợp mô hình toán học trước đó DeepSeek-Math-V2; Nó có thể chứng minh định lý toán học và tự xác minh lập luận logic; Nó đã đạt kết quả đáng chú ý ở nhiều cuộc thi đẳng cấp thế giới:

- 🥇 IMO (International Mathematical Olympiad) Huy chương Vàng

- 🥇 CMO (Chinese Mathematical Olympiad) Huy chương Vàng

- 🥈 ICPC (International Computer Programming Contest) Hạng Nhì (Cuộc thi của con người)

- 🥉 IOI (International Olympiad in Informatics) Hạng Mười (Cuộc thi của con người)

| Benchmark | GPT-5 High | Gemini-3.0 Pro | Kimi-K2 Thinking | DeepSeek-V3.2 Thinking | DeepSeek-V3.2 Speciale |

|---|---|---|---|---|---|

| AIME 2025 | 94.6 (13k) | 95.0 (15k) | 94.5 (24k) | 93.1 (16k) | 96.0 (23k) |

| HMMT Feb 2025 | 88.3 (16k) | 97.5 (16k) | 89.4 (31k) | 92.5 (19k) | 99.2 (27k) |

| HMMT Nov 2025 | 89.2 (20k) | 93.3 (15k) | 89.2 (29k) | 90.2 (18k) | 94.4 (25k) |

| IMOAnswerBench | 76.0 (31k) | 83.3 (18k) | 78.6 (37k) | 78.3 (27k) | 84.5 (45k) |

| LiveCodeBench | 84.5 (13k) | 90.7 (13k) | 82.6 (29k) | 83.3 (16k) | 88.7 (27k) |

| CodeForces | 2537 (29k) | 2708 (22k) | — | 2386 (42k) | 2701 (77k) |

| GPQA Diamond | 85.7 (8k) | 91.9 (8k) | 84.5 (12k) | 82.4 (7k) | 85.7 (16k) |

| HLE | 26.3 (15k) | 37.7 (15k) | 23.9 (24k) | 25.1 (21k) | 30.6 (35k) |

3) Triển khai lần đầu một hệ thống “hai chế độ ‘suy nghĩ + công cụ’”

Một trong những tuyên bố thực tiễn thú vị ở V3.2 là quy trình hai chế độ tách (và cho phép bạn chọn) giữa vận hành hội thoại nhanh và chế độ “suy nghĩ” chậm hơn, tích hợp chặt chẽ với việc dùng công cụ.

- Chế độ “Chat / nhanh”: Thiết kế cho độ trễ thấp, giao diện hướng người dùng với câu trả lời ngắn gọn và ít dấu vết lập luận nội bộ — phù hợp trợ giúp thông thường, hỏi–đáp ngắn và ứng dụng nhạy tốc độ.

- Chế độ “Thinking / reasoner”: Tối ưu cho chuỗi suy nghĩ chặt chẽ, lập kế hoạch theo bước và phối dàn công cụ bên ngoài (API, truy vấn cơ sở dữ liệu, thực thi mã). Khi hoạt động ở chế độ suy nghĩ, mô hình tạo ra nhiều bước trung gian tường minh hơn, có thể kiểm tra hoặc dùng để dẫn dắt các cuộc gọi công cụ an toàn, chính xác trong hệ thống tác tử.

Mẫu hình này (thiết kế hai chế độ) đã có ở các nhánh thử nghiệm trước đây, và DeepSeek đã tích hợp sâu hơn trong V3.2 và Speciale — hiện Speciale chỉ hỗ trợ chế độ suy nghĩ (vì thế được kiểm soát qua API). Khả năng chuyển đổi giữa tốc độ và sự cẩn trọng rất giá trị về mặt kỹ thuật vì cho phép nhà phát triển chọn đúng đánh đổi giữa độ trễ và độ tin cậy khi xây dựng tác tử phải tương tác với hệ thống thực.

Điểm đáng chú ý: Nhiều hệ thống hiện đại hoặc cung cấp mô hình chuỗi suy nghĩ mạnh (để giải thích lập luận) hoặc một lớp phối dàn tác tử/công cụ riêng. Cách tiếp cận của DeepSeek gợi ý sự kết nối chặt chẽ hơn — mô hình có thể “nghĩ” rồi gọi công cụ một cách xác định, dùng phản hồi công cụ để thông tin cho các bước suy nghĩ tiếp theo — qua đó liền mạch hơn cho nhà phát triển khi xây dựng tác tử tự động.

Cách lấy DeepSeek v3.2

Câu trả lời ngắn — bạn có thể lấy DeepSeek v3.2 theo vài cách tùy nhu cầu:

- Web/ứng dụng chính thức (dùng trực tuyến) — thử giao diện web hoặc ứng dụng di động của DeepSeek để dùng V3.2 tương tác.

- Truy cập API — DeepSeek cung cấp V3.2 qua API (tài liệu gồm tên model /

base_urlvà giá). Đăng ký khóa API và gọi endpoint v3.2. - Trọng số có thể tải về/mở (Hugging Face) — mô hình (các biến thể V3.2 / V3.2-Exp) được phát hành trên Hugging Face và có thể tải về (open-weight). Dùng

huggingface-hubhoặctransformersđể lấy tệp. - CometAPI — Nền tảng tổng hợp API AI cung cấp endpoint lưu trữ V3.2-Exp. Giá rẻ hơn giá chính thức.

Một vài ghi chú thực tế:

- Nếu bạn muốn trọng số để chạy cục bộ, vào trang mô hình trên Hugging Face (chấp nhận các điều kiện cấp phép/truy cập tại đó) và dùng

huggingface-clihoặctransformersđể tải; kho GitHub thường có lệnh cụ thể. - Nếu bạn muốn sử dụng sản xuất qua API, hãy theo dõi nền tảng bạn muốn như tài liệu API của CometAPI để biết tên endpoint và

base_urlchính xác cho biến thể V3.2.

DeepSeek-V3.2-Speciale:* Chỉ mở cho mục đích nghiên cứu, hỗ trợ đối thoại “Thinking Mode”, nhưng không hỗ trợ gọi công cụ.

- Đầu ra tối đa có thể đạt 128K token (Chuỗi Suy nghĩ siêu dài).

- Hiện miễn phí thử nghiệm đến ngày 15 tháng 12, 2025.

Tổng kết

DeepSeek-V3.2 đánh dấu một bước tiến có ý nghĩa trong quá trình trưởng thành của các mô hình lấy lập luận làm trung tâm. Sự kết hợp giữa năng lực suy luận nhiều bước được cải thiện, các ấn bản hiệu năng cao chuyên biệt (Speciale), và tích hợp sản xuất hóa “suy nghĩ + công cụ” đáng lưu tâm với bất kỳ ai xây dựng tác tử nâng cao, trợ lý mã hóa, hoặc quy trình nghiên cứu cần đan xen suy ngẫm với hành động bên ngoài.

Nhà phát triển có thể truy cập DeepSeek V3.2 qua CometAPI. Để bắt đầu, hãy khám phá khả năng của mô hình trên CometAPI trong Playground và tham khảo Hướng dẫn API để biết hướng dẫn chi tiết. Trước khi truy cập, hãy đảm bảo bạn đã đăng nhập CometAPI và lấy khóa API. CometAPI cung cấp mức giá rẻ hơn nhiều so với giá chính thức để giúp bạn tích hợp.

Sẵn sàng bắt đầu? → Đăng ký CometAPI ngay hôm nay!

Nếu bạn muốn biết thêm mẹo, hướng dẫn và tin tức về AI, hãy theo dõi chúng tôi trên VK, X và Discord!