Ngày 28 tháng 7 năm 2025, startup có trụ sở tại Bắc Kinh Zhipu AI chính thức ra mắt dòng mô hình ngôn ngữ lớn nguồn mở GLM‑4.5, đánh dấu bản phát hành mạnh mẽ nhất của hãng cho đến nay và hướng tới các ứng dụng tác tử thông minh tiên tiến. Thông báo — được đưa ra qua một sự kiện trực tuyến trực tiếp sau Hội nghị Thế giới về Trí tuệ Nhân tạo (WAIC) — giới thiệu hai biến thể: GLM‑4.5 quy mô đầy đủ với tổng 355 tỷ tham số (32 tỷ đang hoạt động) và GLM‑4.5‑Air gọn nhẹ hơn với tổng 106 tỷ tham số (12 tỷ đang hoạt động). Cả hai mô hình áp dụng kiến trúc suy luận lai “thinking” và “non‑thinking” được thiết kế để cân bằng suy luận sâu với phản hồi nhanh, và cung cấp cửa sổ ngữ cảnh 128,000 token cho các trường hợp sử dụng hội thoại và định hướng tác vụ quy mô lớn.

Việc ra mắt GLM‑4.5 diễn ra trong bối cảnh cuộc đua AI trong nước ngày càng khốc liệt. Theo Tân Hoa Xã do nhà nước Trung Quốc vận hành, các nhà phát triển Trung Quốc đã phát hành 1,509 mô hình ngôn ngữ lớn tính đến tháng 7 năm 2025, dẫn đầu tổng số toàn cầu là 3,755 mô hình — minh chứng rõ ràng cho quy mô và tốc độ mở rộng của hệ sinh thái AI Trung Quốc.

Giấy phép nguồn mở của GLM‑4.5

Khác biệt rõ rệt so với các mô hình đóng‑độc quyền, Z.ai phát hành GLM‑4.5 theo giấy phép nguồn mở kiểu MIT, có thể kiểm toán đầy đủ, trao cho doanh nghiệp khả năng minh bạch hoàn toàn về trọng số mô hình và mã huấn luyện. Tổ chức có thể triển khai GLM‑4.5 on‑premise, tinh chỉnh trên tập dữ liệu sở hữu, hoặc tích hợp thông qua dịch vụ suy luận tự lưu trữ, từ đó tránh bị khóa nhà cung cấp và cấu trúc định giá API không minh bạch.

Sự sẵn có của cả GLM‑4.5 cho các tác vụ tác tử tổng quát và GLM‑4.5‑Air, biến thể nhẹ tối ưu cho môi trường tài nguyên thấp, đảm bảo phổ trường hợp sử dụng rộng — từ triển khai trung tâm dữ liệu quy mô lớn đến suy luận trên thiết bị biên.

Về mặt chiến lược, cách tiếp cận nguồn mở của Zhipu đặt công ty đối trọng với các nhà cung cấp phương Tây đóng nguồn như OpenAI. Bằng cách dân chủ hóa quyền truy cập vào một mô hình có khả năng sánh với GPT‑4 theo giấy phép MIT, Zhipu hướng tới bồi đắp một cộng đồng nhà phát triển hạ nguồn vững mạnh và thiết lập các chuẩn mực kỹ thuật cho năng lực AI tác tử. Các nhà quan sát ngành cho rằng động thái này nằm trong xu hướng rộng hơn giữa các “Hổ AI” của Trung Quốc, bao gồm Moonshot AI và Step AI, những đơn vị cũng đã mở nguồn các mô hình lớn để tăng tốc chu kỳ đổi mới.

Điểm chuẩn hiệu năng và phân tích so sánh

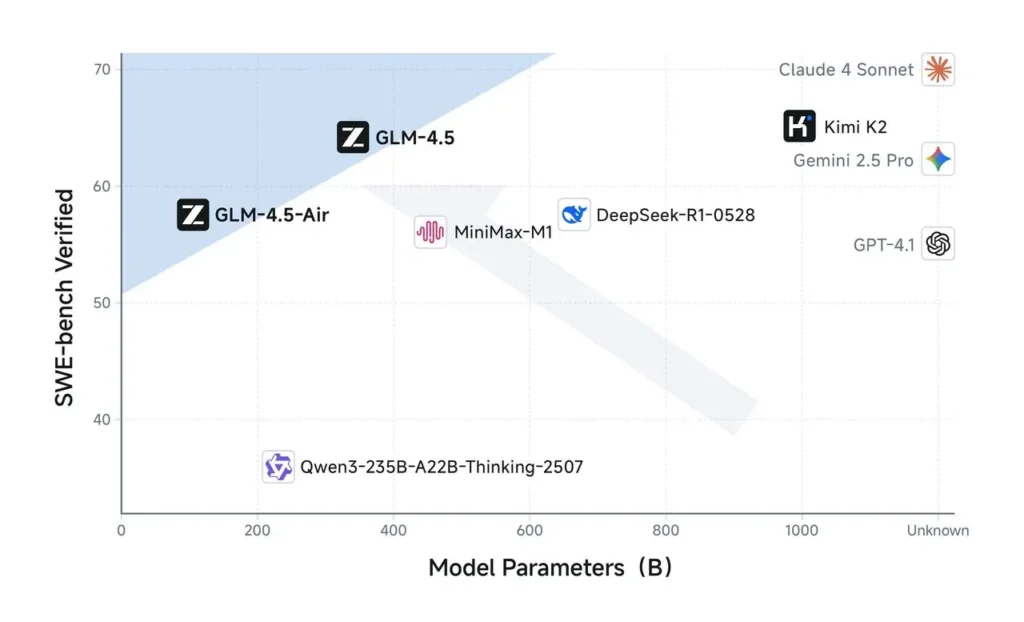

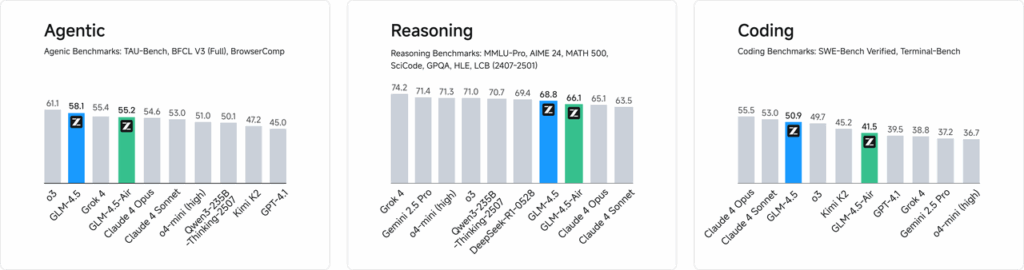

Các điểm chuẩn sơ bộ do Zhipu AI cung cấp cho thấy GLM‑4.5 đạt điểm tổng hợp 63.2 trên 12 bộ đánh giá tiêu chuẩn ngành — xếp thứ ba trong cả mô hình nguồn mở lẫn mô hình sở hữu độc quyền — trong khi GLM‑4.5‑Air tinh gọn đạt 59.8, cân bằng hiệu suất với độ chính xác cao. Các đánh giá mã hóa nội bộ còn cho thấy GLM‑4.5 vượt trội so với các đối thủ lớn, đạt tỷ lệ thắng 53.9 phần trăm trước Kimi K2 và tỷ lệ thành công 80.8 phần trăm so với Qwen3‑Coder trên 52 tác vụ lập trình đa dạng.

Các bản demo trong sự kiện trực tiếp nhấn mạnh năng lực tác tử của GLM‑4.5: mô hình tự động thực hiện nghiên cứu web — truy xuất và tổng hợp thông tin từ nhiều nguồn — và tương tác với môi trường mạng xã hội và phát triển được mô phỏng để tạo bài đăng, thực thi đoạn mã và thao tác các thành phần giao diện người dùng theo thời gian thực. Người dùng quan tâm có thể dùng thử ngay mô hình quy mô đầy đủ miễn phí qua cổng Qingyan của Zhipu và nền tảng CometAPI, trong khi nhà phát triển có thể truy cập các endpoint API trên dịch vụ BigModel của CometAPI hoặc tải xuống đầy đủ trọng số mô hình từ Hugging Face và ModelScope theo giấy phép MIT.

Hiệu quả chi phí là nền tảng trong chiến lược của Z.ai. Được huấn luyện trên kho dữ liệu 15 nghìn tỷ token, GLM‑4.5 tận dụng các đường suy luận tối ưu hóa để đạt thông lượng 100–200 token mỗi giây — nhanh hơn tối đa tám lần so với các đối thủ nội địa cùng hạng — với mức giá công bố chỉ $0.11 cho mỗi một triệu token, thấp hơn các mô hình như DeepSeek‑R1 và các bản phát hành mới nhất của Alibaba. Theo giấy phép MIT thông thoáng, toàn bộ trọng số mô hình, mã và tài liệu được cung cấp miễn phí qua Hugging Face, nhằm nuôi dưỡng một cộng đồng nhà phát triển và nghiên cứu sôi động trên toàn thế giới.

“GLM‑4.5 thể hiện cam kết của chúng tôi trong việc dân chủ hóa khả năng tiếp cận công nghệ AI hàng đầu,” ông Zhang Peng, CEO của Z.ai, nói trong một cuộc phỏng vấn với CNBC. “Bằng việc mở nguồn một mô hình xuất sắc về suy luận, lập trình và chức năng tác tử, chúng tôi trao quyền cho các tổ chức ở mọi quy mô đổi mới mà không bị ràng buộc bởi API độc quyền hay chi phí đắt đỏ.”

Bắt đầu

CometAPI là một nền tảng API hợp nhất, tổng hợp hơn 500 mô hình AI từ các nhà cung cấp hàng đầu — như dòng GPT của OpenAI, Gemini của Google, Claude của Anthropic, Midjourney, Suno và nhiều hơn nữa — vào một giao diện thân thiện với nhà phát triển. Bằng cách cung cấp cơ chế xác thực, định dạng yêu cầu và xử lý phản hồi nhất quán, CometAPI đơn giản hóa đáng kể việc tích hợp năng lực AI vào ứng dụng của bạn. Dù bạn đang xây dựng chatbot, trình tạo hình ảnh, trình sáng tác âm nhạc hay các pipeline phân tích dựa trên dữ liệu, CometAPI giúp bạn lặp nhanh hơn, kiểm soát chi phí và tránh phụ thuộc nhà cung cấp — đồng thời tận dụng những đột phá mới nhất trong toàn hệ sinh thái AI.

Nhà phát triển có thể truy cập API GLM‑4.5 thông qua CometAPI, phiên bản Claude mới nhất được liệt kê là tính đến ngày bài viết được xuất bản. Để bắt đầu, hãy khám phá khả năng của mô hình trong Playground và tham khảo hướng dẫn API để biết hướng dẫn chi tiết. Trước khi truy cập, vui lòng đảm bảo bạn đã đăng nhập CometAPI và lấy khóa API. CometAPI cung cấp mức giá thấp hơn nhiều so với giá chính thức để hỗ trợ bạn tích hợp.