开发者在使用 ChatGPT 进行视频分析时的体验常常遇到瓶颈:直接的 YouTube 链接不可用,而上传 MP4 则会得到“幻觉化”的摘要,错过细微的视觉信息。这不是 Bug——而是架构上的限制。ChatGPT 不会流式播放视频;它处理的是提取帧序列和转录文本。所以你尝试上传了一个 MP4 文件,确实“能用”……但不尽如人意。摘要提到了音频转录,却完全漏掉了第三个场景里的视觉笑点——而那恰恰是让整段视频说得通的关键。

ChatGPT 可以分析视频——但并非真正“观看”视频

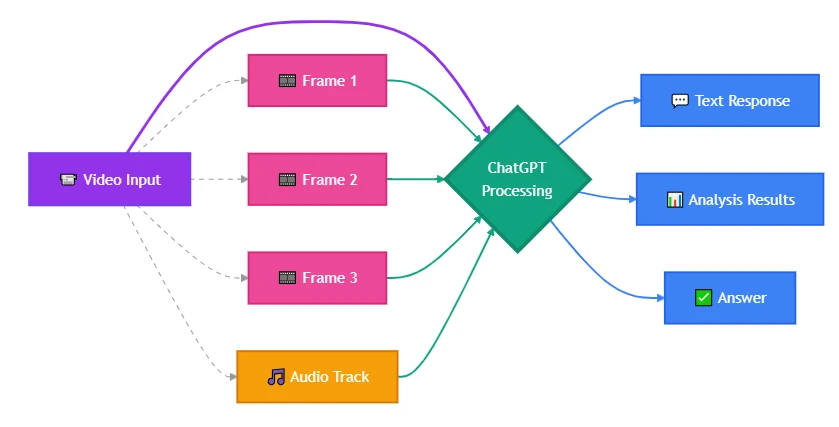

实际情况是:ChatGPT 并不像你那样“观看”视频。它不会按下播放、流式消费内容,也不会观察随时间发生的连续运动。它会把视频拆分为它已经擅长处理的组件——静态图像和文本转录——然后分别对这些部分进行推理。在模型看来,你的视频更像是一本配有旁白的相册,而不是连续的观看体验。这就是它能够抓住口述解释却错过视觉包袱的原因:包含笑点的那一帧,很可能没有被采样到。

当有人问“ChatGPT 能看视频吗”,他们通常在问两个问题之一:它能否像人类观察者那样流式观看视觉内容,或者它能否从视频数据中提取并分析意义——场景、对话、时间戳、屏幕上的动作?从功能上看,第二个问题的答案是“可以”,但存在会彻底破坏某些用例的约束。现代 ChatGPT 变体通过将视频视为采样帧与音频转录的组合来处理视频,既可以在网页界面中自动提取,也可以通过 API 接受用户提供的帧。这适用于摘要、场景描述和文本提取。但在需要跟踪运动、依赖时间精度或需要模型“看到”帧间发生的内容时,它会失效。

大多数指南止步于确认“有这个能力”,却没有解释为什么你的具体实现没有奏效——或应当选择哪种替代输入方式。

ChatGPT 视频能力:模型实际“看到”的是什么

ChatGPT 并不会加载一个 MP4 并逐帧擦拭(scrub)。它具备“视觉能力”——分析静态图像——以及通过 Whisper 集成进行音频转录的能力。当你通过 ChatGPT 的网页或移动端上传视频时,系统会提取关键帧,单独转录音频,并将两者分别作为输入提供给模型。随后,模型会描述它在这些帧里“看到”的内容,以及它在转录中“听到”的内容。

对你而言,这看起来像是视频理解;对模型而言,这是图像分析加文本处理。这一架构上的差异决定了哪些用例可行、哪些不可行。

如果你的视频依赖运动、细微的逐帧变化或精确的时间点——比如检测某个物体何时进入画面、或跟踪 UI 元素的动画——基于关键帧的方法会错过它。对于落在采样帧之间的一次两秒钟的视觉提示,ChatGPT 无法捕捉。除非你明确构造输入来展示进程,否则它也不会在时间上跟踪对象。

当前 ChatGPT 的视频能力(截至 2026 年初):

- 图像式的视频分析:接受视频文件或提取的帧;从采样图像中理解视觉内容

- 音频转录:通过 Whisper 将口语转换为文本;模型随后可对转录内容进行总结或查询

- 场景描述:识别提供帧中的对象、动作、环境和可见文本

- 基于时间戳的查询:如果你提供帧的时间戳或手动分段,模型可以引用具体时刻

- 文本提取:读取帧中可见的屏幕字幕、UI 标签或文档文字

ChatGPT 网页界面的具体帧采样率与自动关键帧选择行为——在知识截止时尚未公开文档化

不包括的能力:

- 通过 API 的实时流式视频输入

- 帧级精准的运动跟踪或跨时间的对象持久性

- 对视频编解码器的原生支持——所有处理都发生在提取帧与音频上

- 无需显式提示的自动场景切换检测

视频容量受限于 token 限制和文件大小,而非时长。虽然 5–10 分钟是一个实用的经验法则,但实际限制会随视觉密度动态变化。

如果你的用例需要上述能力,你要么自行预处理视频以提取合适的帧,要么切换到具备原生视频支持的模型。下一节将分解针对具体场景应选用的输入方式。

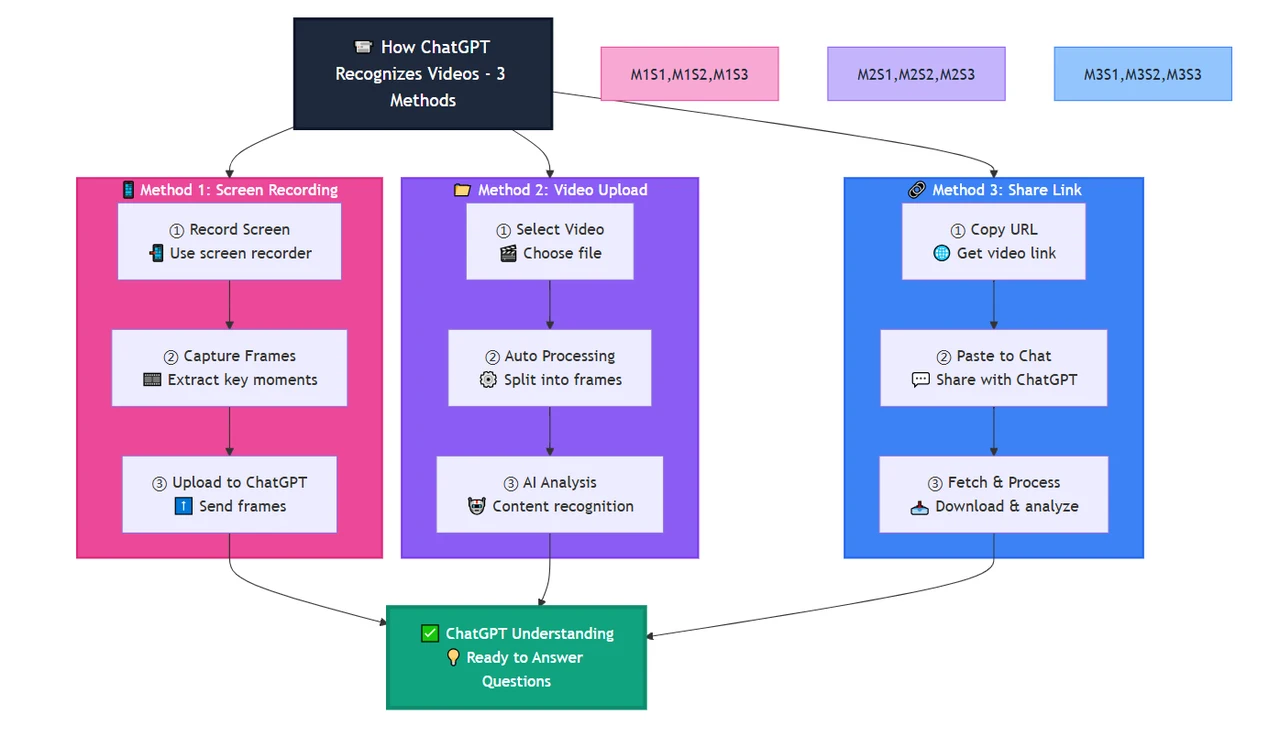

ChatGPT 识别视频的三种实用方法

没有唯一的提交方式。你选择的方法决定了模型能分析什么、会遗漏什么。大多数实现失败源于选择了方便的方法,而非正确的方法。

方法一:手动提取帧 + 上传图片

使用 ffmpeg 或类似工具自行提取帧,然后将这些特定帧作为图片上传。这样你可以完全控制 ChatGPT 分析的内容。

示例工作流(bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

这种方式可以让你:

- 将分析聚焦在特定时刻(开场、关键动作、结论),避免将上下文浪费在无关片段

- 通过按自定采样率上传连续帧来捕捉运动

- 绕过文件大小限制——图像比完整视频更小

- 保留帧质量,避免自动压缩导致的劣化

权衡:

你需要自行处理预处理工作。若要规模化分析数百段视频,就需要自动化。对于一次性的深度分析或调试特定场景,这是最可靠的方法。

何时使用本方法:

- 需要对特定时刻进行帧级精确分析

- 关键视觉信息很短暂或落在典型关键帧间隔之间

- 需要比较序列中的视觉变化(UI 状态变化、动画帧)

- 想通过检查你上传的确切帧来验证模型究竟“看到了什么”

方法二:通过 ChatGPT 界面直接上传文件

ChatGPT 网页和移动应用支持在聊天中直接上传视频。将 MP4 或 MOV 文件拖入输入框,系统自动处理帧提取和转录。

内部发生的事情:

- 服务按间隔对帧进行采样(具体速率未文档化;基于观察行为估计为每秒 1–2 帧)

- 音频通过 Whisper 或类似服务转录

- 两个输出作为独立上下文输入提供给模型

- 模型基于可见帧与听到的转录生成响应

适用场景:

- 不需要帧级精度的高层视频摘要

- 识别跨场景持续存在的关键对象、人物或环境

- 提取多帧中出现的口述内容或屏幕文字

- 无需预处理的快速探索性分析

不适用的场景:

- 帧级精确分析——你无法控制哪些帧被采样

- 对于超出模型舒适上下文容量的长内容,需要进行逻辑分段。若没有策略性分块或预处理,随着高密度视觉数据导致的 token 消耗加速,模型可能出现退化或截断

- 检测需要比较连续帧才能发现的运动、过渡或依赖时间的内容

- 关键视觉信息仅在采样帧之间短暂出现 1–2 秒

若你需要控制被分析的具体时刻,请使用方法一。

方法三:YouTube 链接 + 转录抓取

一些 ChatGPT 插件和第三方工具宣称能够“分析 YouTube 视频”。它们实际做的是拉取视频的公开元数据和转录(如可用),然后将这些文本传给 ChatGPT。

在以下情况下有效:

- 视频有自动生成或用户上传的字幕

- 你的分析只需要口述内容,而不需要视觉信息

- 视频公开可访问(非私有、非不公开、非区域限制)

- 总结讲座、播客或访谈等以音频为主的内容

在以下情况下无效:

- 你需要分析视觉内容(屏幕演示、图表、面部表情)

- 视频缺少转录或字幕

- 关键信息以视觉形式出现,且未在对话中提及

- 你处理的是私有文件或需要认证的内容

常见错误: 开发者期待获得完整的视频理解(视觉 + 音频),却只得到转录摘要。对于口述材料的内容分析来说这没有问题,但对于评审产品演示、分析视觉设计或任何“所见”比“所言”更重要的场景,这就毫无用处。

规律是:方法二适用于对精度要求不高的快速摘要。方法一适用于需要精确控制、聚焦特定帧的分析。方法三适用于以音频为中心、视觉信息次要或不存在的内容。选择时要看你用例的关键信号在哪里——在运动里、在特定帧里,还是纯粹在对话里。

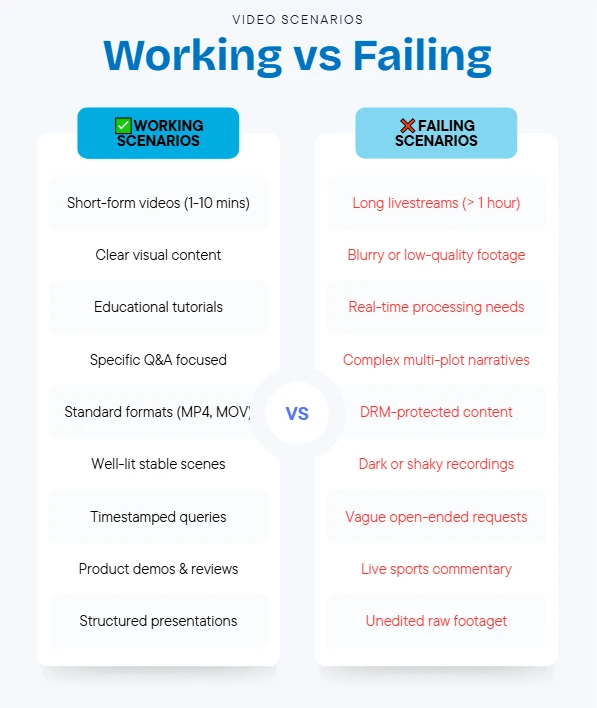

ChatGPT 的视频应用场景:在生产中真正有效的是什么

知道 ChatGPT 能处理视频组件,并不代表它就是解决你问题的正确工具。以下场景展示了帧式分析能成功的地方——以及架构约束会让用例失败的地方。

场景一:教育内容摘要

用例: 你有一段 10 分钟的教程视频,需要一个结构化摘要,包含关键步骤、提到的工具和展示的视觉示例。

为何可行: 教学视频通常有清晰的场景边界、持久的屏幕文字,并且解说与视觉同步。讲者在显示某些内容时会进行描述。ChatGPT 可以转录讲解,识别采样帧中的工具或图表,并将两者结合成结构化输出。

实现思路: 通过 ChatGPT 界面上传视频,或在主要主题切换处提取 8–12 张关键帧。提示词:“列出这段视频讲解的主要步骤,同时参考旁白以及你在屏幕文字、图表或工具名称中看到的内容。”

失效之处: 依赖连续运动的视频——比如讲师在多个文件之间快速敲代码的录屏——会在帧之间丢失步骤。你需要更高的帧采样率,或仅聚焦音频转录。

实用建议: 对讲座或教程内容,结合自动上传(获取转录)与手动提取 3–5 个最重要视觉时刻的帧。这既能覆盖完整音频,又能获得关键概念的高质量图像。

场景二:产品演示分析

用例: 你在评审竞品的产品演示,想提取 UI 元素、功能名称、用户流程以及屏幕上展示的定价信息。

为何可行: 产品演示通常会在每个屏幕停留足够长时间,使采样捕获静态 UI。文字覆盖、按钮标签、菜单结构和定价表通常会跨多帧可见。即使旁白没有提及,ChatGPT 的视觉能力也能读取并描述这些元素。

实现思路: 在主要场景变更处提取帧(开场幻灯片、功能 1 演示、功能 2 演示、定价页、CTA)。上传这些帧并提示:“对每一帧,识别所有可见的 UI 元素、按钮标签、功能名称,以及任何显示的定价或产品信息。”

失效之处: 快速切换的画面、只短暂显示 1–2 秒的悬停态信息或交互元素,会被帧采样遗漏。如果对方快速闪现功能对比表,你会错过,除非刚好采样到那一刻。

实用建议: 先手动预览视频,找出重要信息揭示的时间点。在这些特定时刻提取帧,而不是依赖固定采样间隔。

场景三:会议或访谈的转录与视觉上下文

用例: 你录制了一次客户会议,需要转录,并标注何时出现了特定文档、幻灯片或屏幕共享。

为何可行: 音频转录处理口语内容。当参与者共享屏幕或举起文档时,这些会出现在被采样的帧中。ChatGPT 可以在转录旁注记“在大约 [timestamp],屏幕上出现了一份合同文档”,用于在会议纪要中引用视觉材料。

实现思路: 上传视频并提示:“转录这次会议,并标注任何出现文档、演示幻灯片、屏幕共享或其他视觉引用的时刻。对每个视觉元素,描述屏幕所示内容。”

失效之处: 短于 5–10 秒的屏幕共享可能刚好落在采样帧之间。压缩后帧中文字太小无法辨认也无法提取。对于需要精确保真的法律或合规模块,请先验证帧质量与采样覆盖率再依赖输出。

实用建议: 对重要会议,使用更高分辨率录制,并在有人说“让我给你看这个文档”时段手动提取帧——这往往预示即将出现视觉引用。

场景四:内容审核或合规审查

用例: 你需要扫描用户上传的视频以查找违规内容——特定 Logo、文本模式或违反平台政策的视觉元素。

为何可行: ChatGPT 可以扫描帧中的可见文本、可识别对象或描述的场景。如果你要检查“这些视频中是否出现某竞品的 Logo”,只要该 Logo 在屏幕上持续超过一两秒,帧式分析就能检测到。

实现思路: 以固定间隔(每 3–5 秒)提取帧,上传并提示:“审查这些帧,识别任何包含 [特定 Logo、品牌名、禁用符号等] 的帧。对于每个匹配,描述其在画面中出现的位置。”

失效之处: 音频层面的违规(版权音乐、禁语)需要单独的音频分析。基于运动的违规(特定手势、跨多帧的动作)无法靠静帧捕捉。短暂闪现的违规内容可能不在采样帧内。

实用建议: 将 ChatGPT 的视觉扫描与专门的音频指纹服务结合,并对高风险类别提高帧采样率。将 ChatGPT 用作第一道筛选,而非唯一的审核层。

各个成功场景的共同点:有意义的内容存在于离散、稳定的帧中,并与音频或文本元素相关。失败发生在关键信息存在于运动、时间、过渡,或出现时间太短而无法可靠采样的时候。

Gemini 的视频能力 vs. Claude 的视频能力 vs. ChatGPT

如果 ChatGPT 的帧采样架构不适配你的用例,可以评估替代方案。Gemini 和 Claude 提供不同的视频相关能力——这些差异决定了哪种模型适合你的具体实现。

Gemini 的原生视频处理

Gemini 模型在 API 层支持原生视频输入。你可以直接传入视频文件而无需预先拆帧。模型作为连续流处理视频,从而支持运动跟踪、场景切换检测以及 ChatGPT 的帧式方法无法完成的时间推理。

Gemini 更适合的用例示例:

你需要检测一个特定对象在 30 秒片段中何时进入和退出画面,或跟踪人物在场景中的移动。Gemini 可以跨帧跟踪对象并对运动进行推理。ChatGPT 只能在采样到的帧里看到对象——可能完全错过进入或离开的瞬间。

权衡:

- Gemini 的原生 API 在成本上比 OpenAI 的帧式采样更高效。借助上下文缓存避免线性 token 开销,Gemini 在长视频分析上具有更好的扩展性

- 处理较长视频会增加时延——模型需要在响应前摄取整段文件

- 并非所有 Gemini 变体都支持视频输入;需要较新的 Gemini 型号

- 存在视频长度限制,但相比 ChatGPT 的上下文约束更宽松

何时选择 Gemini 而非 ChatGPT:

- 用例需要运动跟踪、场景边界检测或对时间关系的理解

- 关键信息在帧间快速出现与消失

- 你分析的是事件进程很重要的视频(体育、监控回放、动画分析)

- 你希望避免手动拆帧的预处理

Claude 的当前视频限制

截至 2026 年初,Claude 模型不支持通过 API 直接输入视频。你可以上传图像(包括手动提取的视频帧),但不存在类似 Gemini 的原生视频处理能力。

Claude 能做的:

- 分析上传的帧序列,类似于 ChatGPT 的手动提取方法(方法二)

- 提供每帧视觉内容的详细描述

- 在明确提示下对帧间变化进行推理

- 由于扩展的上下文窗口(在 Claude Opus 4.7 可达 1M tokens),能处理更长的图像序列

Claude 不能做的:

- 直接接受视频文件输入

- 在没有逐帧明确提示的情况下自动跟踪运动或对象

- 转录音频——需要先用 Whisper 或类似服务预处理,再将转录传给 Claude

仍然选择 Claude 的情况:

- 你的工作流已包含帧提取作为预处理步骤

- 需要分析长视频、包含大量帧,并需要 Claude 的大上下文窗口

- 在特定视觉领域(如医学影像、技术图示)对比后,发现 Claude 的视觉描述更准确或更符合你的需求

- 需要将视频帧分析与大量其他上下文信息结合

能力对比表

| 功能 | ChatGPT | Gemini | Claude |

|---|---|---|---|

| 直接上传视频文件 | ✓(网页/应用界面) | ✓(API + 网页界面) | ✗ |

| 原生运动跟踪 | ✗ | ✓ | ✗ |

| 音频转录 | ✓(Whisper 集成) | ✓(集成) | ✗(需外部工具) |

| 基于帧的分析 | ✓ | ✓(亦支持连续处理) | ✓(仅手动提取) |

| 场景切换检测 | ✗(仅手动) | ✓(自动) | ✗ |

| 典型可处理视频时长 | ~5–10 分钟(受上下文限制) | ~1 小时(受分辨率影响) | N/A(帧数受上下文限制) |

| 最佳用例 | 快速摘要、在一定可控下的帧级分析 | 运动跟踪、时间推理、连续视频 | 大上下文需求下的逐帧详解 |

| API 视频支持 | ✗(仅图像) | ✓ | ✗ |

决策框架:

- 选择 ChatGPT 的场景:需要快速视频摘要、关键信息在多个帧中持续存在、处理短片段(10 分钟以内),且不需要运动跟踪。适用于教育内容、静态产品演示、会议转录。

- 选择 Gemini 的场景:需要运动跟踪、场景切换检测,或对随时间变化的元素进行推理。对监控、体育、动画回放等“帧间发生了什么很重要”的场景至关重要。

- 选择 Claude 的场景:你的流程已包含帧提取、需要在大量帧与扩展上下文下分析,或在特定视觉领域更偏好 Claude 的描述质量。需要最多的预处理,但提供最大的上下文窗口。

对于跨多模型工作的开发者,CometAPI 提供统一接口,可在不重写集成代码的情况下测试各类 GPT、Gemini 与 Claude 变体的视频处理质量——在承诺指定供应商前对比输出质量十分有用。

关于“ChatGPT 能看视频吗”的正确答案不是二元的。答案是“可以,通过将视频转换为它已能处理的格式——但这些转换的限制会破坏特定用例”。大多数实现失败源于架构不匹配,而非能力缺失。模型完全按设计工作;只是开发者期待的是另一种设计。

如果你要在规模上构建视频分析功能,请先用边界案例测试你的工作流:用直接上传、手动提取帧、仅转录三种方法分别上传同一视频。对比输出。能捕捉你用例关键信号的方法——而非实现最快的方法——才经得起生产流量考验。

在将视频任务交给 ChatGPT 之前:

- 明确关键信息存在于稳定帧、运动还是音频

- 以预期间隔手动提取帧,测试采样覆盖

- 验证压缩后分辨率下的屏幕文字是否可读

- 确认视频长度适配你订阅等级的实际上下文限制

- 为短暂出现或落在采样帧之间的内容准备兜底方案

对于评估多家 AI 供应商以承载视频工作负载的开发者,CometAPI 提供统一的测试平台,可用相同视频输入对比 ChatGPT、Gemini 与 Claude 的输出质量、时延与成本——帮助你在构建供应商特定集成前做出选择。

FAQ - AI 视频分析指南

快速解答关于 AI 视频分析的常见问题。

ChatGPT 能分析视频吗?

可以。ChatGPT(GPT-4o 及之后)通过采样帧(约每秒 1 帧)并转录音频进行分析。它在会议摘要、从幻灯片提取文字、识别对象方面表现良好。但在运动跟踪、超 10 分钟视频以及实时流式场景中表现欠佳。

我该如何把视频上传到 ChatGPT?

直接 URL 上传(推荐): 通过公共 URL 上传以快速分析。适用于 10 分钟以内的视频。

手动提取帧: 提取特定帧以获得精确控制。适用于需要分析特定时刻或降低 token 成本的情况。

ChatGPT 能处理的最大视频长度是多少?

ChatGPT 稳定处理时长为 5–10 分钟的视频。超过这一范围需要分段,或切换到原生支持最长 60 分钟视频的 Gemini 2.5 Pro。

ChatGPT 的视频分析有哪些限制?

- 无法跟踪连续运动(体育、舞蹈)

- 时间戳不够精确(±1 秒)

- 会漏掉出现少于 1 秒的内容

- 10 分钟的实用上限

- 不支持实时流式

- 对低质量或暗光视频表现较弱

- 在时间上的因果推理能力较弱 *

我应该用 ChatGPT 还是 Gemini 做视频分析?

使用 ChatGPT 的场景:

- 10 分钟以内的视频

- 视频分析后的文本推理更强

- 帧级分析(幻灯片、截图)

使用 Gemini 的场景:

- 10–60 分钟的视频

- 运动跟踪与移动分析

- 时间推理任务

- 体育、舞蹈或监控片段 *

Claude 能分析视频吗?

不能。Claude 不支持直接视频输入。但你可以从视频中提取帧并用 Claude 分析;它在文本推理与大上下文方面具有优势,适合长篇分析。

视频分析的成本是多少?

成本因模型与视频长度而异:

- ChatGPT 4o: 约 $0.05 每分钟

- Gemini 2.5 Pro: 约 $0.04 每分钟

CometAPI 为新用户提供启动积分。