TL;DR: OpenClaw 的最新版本为 OpenAI 的 GPT-5.4 提供了一流的、前向兼容的支持,并引入了“记忆热插拔”(memory hot-swappable)架构,让 OpenClaw 代理在运行时以最小扰动更换正在使用的模型与记忆存储。这解锁了大上下文工作流(GPT-5.4 的扩展上下文窗口)、即席模型专化,以及面向生产代理的成本/时延优化。该升级已在 OpenClaw 的发布版本与配套文档中提供;下方示例给出可操作的配置、代码片段、基准背景与推荐最佳实践。

OpenClaw 更新实际发布了什么(快速摘要)

在 2026 年 3 月 9 日,与 OpenAI 生态相邻的开源代理框架 OpenClaw 发布了一个核心重大版本(2026.3.7),新增对 GPT-5.4 的一流支持,并在其上下文引擎中引入了新颖的“记忆热插拔”机制。该版本将一个被广泛使用的实验性代理框架转化为维护者所称的“Agent 操作系统”——旨在让面向生产的代理工作流与模型切换对开发者和团队而言变得无缝。

对代理构建者真正有用的 3 件事:

- 一流的 GPT-5.4 支持——模型别名与提供方映射,允许代理选择 GPT-5.4 作为主执行模型(包括通道覆盖与按代理固定模型)。

- 上下文引擎与分布式通道绑定——改进了 OpenClaw 如何从记忆、工具输出与通道历史中组装长上下文,使高容量模型获得结构良好的输入。

- 记忆热插拔架构——更清晰的记忆插件接口与工作流,让你在不丢失“身份”或破坏持久状态的情况下替换记忆后端或升级代理(记忆本身仍是单一事实源)。OpenClaw 的记忆设计(纯 Markdown 文件、索引检索、插件化召回)正是实现安全热插拔的关键。

GPT-5.4——是什么以及基准突破

GPT-5.4 是 OpenAI 最新的前沿模型,重点面向“专业生产力”(表格、文档与演示编辑、多步推理与工具驱动)。据 OpenAI 与独立媒体报道,此次发布强调:

- 扩展上下文:GPT-5.4 引入新一档上下文窗口,实验性提供 100 万 token 级别与改进的长上下文处理,可通过 Codex/Codex 兼容端点获得——开发者可使用

model_context_window与model_auto_compact_token_limit等配置开关。这让你可以在活动上下文中保留更大规模的对话状态、文档与代码库。 - 更高的表格与推理准确度——OpenAI 报告在表格建模任务上有显著提升(其银行/分析表格基准的平均得分约 87%,而 GPT-5.2 为约 68%)。

- 准确性与事实性改进:早期评测与 QA 显示,相较 GPT-5.2,“幻觉”约减少 33%,在文档起草与表格工作方面的易错输出也更少。评测者还提到在某些生产力任务上“易错响应”约降低 18%。

- 集成的计算机操作与 Codex 系谱改进——GPT-5.4 融合了 Codex 系谱带来的能力,提升了代码生成、交互式调试与操作工具驱动(在部分演示中包括鼠标/键盘/截图自动化)。这使其更擅长代理循环中典型的“编写-运行-检查-修补”。

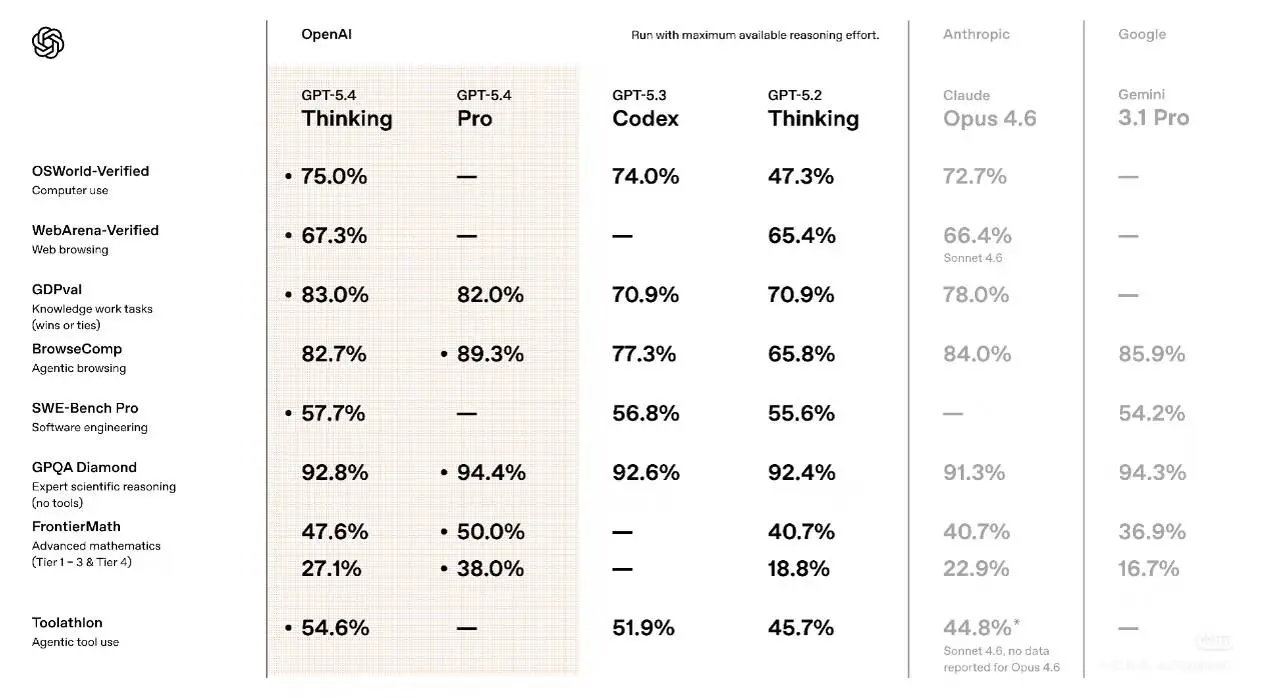

基准与比较背景(这些数字意味着什么)

- 表格建模:OpenAI 内部表格基准上,GPT-5.4 的平均得分约 87.3%,而 GPT-5.2 为约 68.4%。这是厂商用来展示任务特定增益的头条指标。

- 计算机交互(OSWorld / 代理风格测试):独立测试者与社区跑分显示,GPT-5.4 在涉及桌面或模拟 UI 操作的代理交互任务上有提升,有时在这些任务集上以小幅优势超过近期 Anthropic 模型变体(差距对代理而言有意义,但不一定在每项工作负载上决定胜负)。

解释:GPT-5.4 不是无所不能的“银弹”。它在集成工具使用、代码执行模式与表格推理方面有明显优势——而这正是 OpenClaw 代理常见的工作负载。对代理构建者而言,改进的执行器可靠性(Codex 系谱)+ 规划器能力 + 更好的长上下文处理的组合高度相关。

OpenClaw 支持 GPT-5.4:改了什么、为何重要

OpenClaw 的此次发布(见项目发布页面)更新了模型解析器与运行时以对 GPT-5.4 的扩展上下文与 token 限制“前向兼容”,并新增“记忆热插拔”能力,使代理可在运行时切换记忆后端或模型。具体包括三点:1)更新模型元数据与解析器以接受更大上下文与 token 限制;2)代理运行时变更,用于编排优雅的模型切换与缓存预热;3)记忆 API 支持多个记忆通道与热切换触发器。

版本 2026.3.7 对 GPT-5.4 的支持加上“记忆热插拔”设计,带来两项务实且互补的优势:

- 直接的模型升级路径。OpenClaw 现在可将 GPT-5.4 作为可选“运行时”呈现给代理,让你从旧的 GPT-5.x 或其他厂商平滑切换,无需重写代理逻辑。此次更新在核心层明确声明了稳定的 GPT-5.4 集成。

- 记忆热插拔。不再只持久化线性记忆快照,OpenClaw 的上下文引擎允许在运行时分离、替换或迁移记忆分区——例如,为调试换入高召回向量数据库分片,或为外部审计切换到 GDPR 净化的记忆变体——而无需停止代理。这降低生产中的扰动风险,并支持按用例配置记忆(调试 vs 隐私 vs 性能)。

实用性能突破与优势

OpenClaw 的集成重点契合 GPT-5.4 擅长的三个实用领域:

- 工具编排保真度。GPT-5.4 改进的工具检索与推理减少了工具调用抖动(更少冗余调用与重试)。对复杂流程而言,这意味着更少 API 调用与更快完成。早期报告显示,较旧的 GPT-5.x 模型,在 token 与工具调用效率上有所提升。

- 更长、更丰富的上下文处理。OpenClaw 代理现在可保留更大的活动上下文(包括换入的记忆分片),从而在长对话、多文件项目与迭代调试中不丢失状态。

- 更确定性的代码输出。对自动生成代码(CI 钩子、函数桩、基础设施模板)的工作流,GPT-5.4 往往输出更一致且可运行的结果,降低人工审阅成本。独立测试显示相较过往 GPT-5 模型在代码质量指标上有明显改善。

- 记忆连续性——“记忆热插拔”允许在不丢失代理状态或上下文的情况下替换或增强记忆存储(本地缓存、向量库、LLM 记忆),支持 A/B 测试、滚动升级与故障切换。

在 OOLONG 基准测试中,新版 OpenClaw 配合 lossless-claw 插件取得了 74.8 的高分,远超 Claude Code(70.3 分)。尤其是当上下文长度增加时,OpenClaw 展现了稳定性与准确度,现场测试的工程师惊叹“说它跑得好都太保守了”。

如何在 OpenClaw 中配置并使用 GPT-5.4(分步)

一个使用 GPT-5.4 的简单 OpenClaw 工作流:

- 典型配置如下:

- 用户通过 Discord 或 Telegram 等平台发送消息。

- OpenClaw 通过其网关服务器接收消息。

- 网关通过 AI API 提供方将提示转发给 GPT-5.4。

- GPT-5.4 生成回复或触发工具动作。

- OpenClaw 将最终结果返回给用户。

以下是务实的、可直接复制使用的配置示例与工作流,用于在 OpenClaw 中安全可复现实行 GPT-5.4。这些配置有意保守:先在测试代理中启用模型,并为指标与错误打好埋点。

先决条件——OpenClaw 已升级到包含 GPT-5.4 映射的版本(见上方发布说明)。

- 有效的 OpenAI API Key 且具备 GPT-5.4 访问权限(我选择价格更低的 CometAPI 端点)。

1)模型选择与解析器配置(JSON / YAML / CLI)

将以下内容放入 ~/.openclaw/openclaw.json(或合并到现有配置中)。根据你的环境调整提供方名称与令牌引用。

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw 使用模型解析器将逻辑模型名(例如 openai/gpt-5.4)映射到端点与运行时配置。添加或更新你的解析器文件(示例 models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

或通过 CLI 在运行时设置:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

注意:

context_window和max

注意事项

agents.defaults.model.primary选择默认模型。使用channels.modelByChannel进行按通道覆盖,这样可以将高影响通道路由到 GPT-5.4,将低要求通道路由到更便宜的模型。有关排序语义请参阅 OpenClaw 的模型选择文档。- 请参考 CometAPI 模型页面获取具体模型名称。如需使用 OpenAI,请将 URL 与 API Key 替换为 OpenAI 的。

context_window与max_output_tokens体现了 OpenClaw 解析器的前向兼容变更,避免代理仍沿用过时的 Codex 限制。

2)如何启用并测试“记忆热插拔”

OpenClaw 的记忆子系统由文件(Markdown 文件)+ 索引/搜索插件组成,因此可在不丢失原始记忆文件的情况下安全替换后端插件(如 SQLite 向量库、Milvus 或外部记忆服务)。

常见模式:

- 标准化记忆位置:使用一个 git 管理的工作区:

~/.openclaw/workspace/,其中MEMORY.md与memory/YYYY-MM-DD.md为权威来源。 - 安装并配置一个记忆插件(示例:sqlite-vec),然后在配置中将

plugins.slots.memory指向它。 - 测试迁移:添加新插件,运行暗影索引任务,对比检索结果;满意后将

plugins.slots.memory的别名切换到新插件。

插件别名切换示例(bash 伪命令):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

为何可称为“热插拔”: 记忆文件始终是“单一事实源”。插件实现索引与检索层;替换插件会重建索引,但不会更改底层 .md 文件。这让模型切换不会引发灾难性的身份漂移——代理仍然读取相同的记忆。

3)示例:将单个代理固定到 GPT-5.4(按代理覆盖)

你可以为每个代理覆盖模型;添加如下代理条目:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

如果社区发布或你的 OpenClaw 版本需要 CLI,你也可以在运行时为会话设置模型:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

运维提示: 固定可确保该代理在你对其他代理进行 A/B 测试期间保持确定性行为。

如需使用 OpenAI,请将 URL 与 API Key 替换为 OpenAI 的。

4)使用 Codex 的 1M 上下文选项(API 开关)

如果你的 OpenClaw 部署直接访问 OpenAI 的 Codex 端点,传入如下上下文选项:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

超出标准上下文窗口的请求可能按不同的计费率计算(OpenAI 文档指出在 Codex 预览中,超出标准窗口的请求可能按双倍计费)。

最佳实践:在 OpenClaw 中最大化 GPT-5.4 的优势

成本、时延与模型混用

- 混合模型策略:对短查询与流式处理使用更小、更便宜的模型;对重型分析、需要长上下文的摘要与代码生成,热切换到 GPT-5.4。在保证质量的同时降低总体 token 成本。(可通过上文记忆配置中的触发器实现。)

- Token 压缩与检索增强:用检索增强管线限制发送给模型的 token——将长文档存入向量库,检索相关片段,仅包含最相关的块与紧凑的计划。GPT-5.4 的工具检索在定位有用工具或文档方面有所助益。

- 预热与冷启动:模型切换后,用短上下文的预热运行避免首个请求的时延尖峰。预编译提示模板并回填关键记忆通道。OpenClaw 的滚动策略(见配置)支持预热。

可靠性与安全

- 优雅回退:实现超时与回退方案(例如降级为上次会话的缓存答案)以应对 API 限流或配额错误。

- 安全层:当输出影响决策时,保持策略过滤与验证步骤。GPT-5.4 在统计上减少了幻觉,但在高风险任务中仍需验证。

评测与监控

- 复现你的基准:针对你的工作负载(代码补全、多文件重构、表格分析)进行对照测试并使用统一量表。公开报告显示其在表格与生产力任务上有优势——请用你的数据验证。

- 遥测:监控 token 消耗、模型时延、记忆切换频率与答案质量(人工评分/自动化测试)。使用这些遥测数据优化切换阈值。

示例:支持热切换的代码评审代理

目标:在推送时运行例行 lint + 单测摘要(便宜模型),当测试失败或 diff 超过 10 个文件时,升级到 GPT-5.4 进行多文件重构建议。

流程(高层):

- 预提交触发

local/fast-small-coder生成 lint 摘要。 - 若

test_failures > 0或diff_files > 10,触发hot_swap到openai/gpt-5.4。提升包含仓库历史的longterm_vector。 - 使用 GPT-5.4 的提示,包含完整失败堆栈与相关代码文件(通过检索与压缩获得)。生成重构补丁与单测改动。

- 人工评审对输出打分;反馈写入记忆。

提示骨架(检索与压缩后发送给 GPT-5.4):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

此用例凸显大上下文 + 记忆热切换的价值:你可以一次性带入完整失败轨迹与多份文件。保守设置切换触发器以控制成本。

最后:谁应该在 OpenClaw 中采用 GPT-5.4(以及何时)

- 现在就采用:如果你的代理执行多步代码/工具任务、重型表格自动化,或复杂文档编辑,且迭代的“写-运行-检查”循环占据大量开发者时间——此处生产力与可靠性提升最明显。

- 谨慎采用:如果你在成本敏感、高并发的聊天通道中运行,且仅需简单推理;使用路由以保持成本效率。

- 不要假设单一模型称霸:用你的数据做基准测试。GPT-5.4 是代理工作负载的强力竞争者,但模型选择必须以证据为依据。

开发者现在可以通过 CometAPI 访问 GPT-5.4。开始之前,可在 Playground 体验模型能力,并查阅 Openclaw 的集成指南获取详细说明。访问前请确保已登录 CometAPI 并获取 API Key。CometAPI 提供远低于官方的价格,便于你集成。

Ready to Go?→ 立即注册 openclaw!