開發者在使用 ChatGPT 進行影片分析時常會碰壁:直接貼 YouTube 連結不可行,而上傳 MP4 則常得到「幻覺式」的摘要,忽略了視覺細節。這不是 Bug,而是架構限制。ChatGPT 不會串流影片;它處理的是擷取出的影格序列與逐字稿文字。所以你嘗試上傳 MP4 檔,確實「能用」……但不盡如人意。摘要提到了音訊逐字稿,卻完全錯過第三幕的視覺笑點,而那正是讓整支影片說得通的關鍵。

ChatGPT 可以分析影片——但不是以實際「觀看」的方式

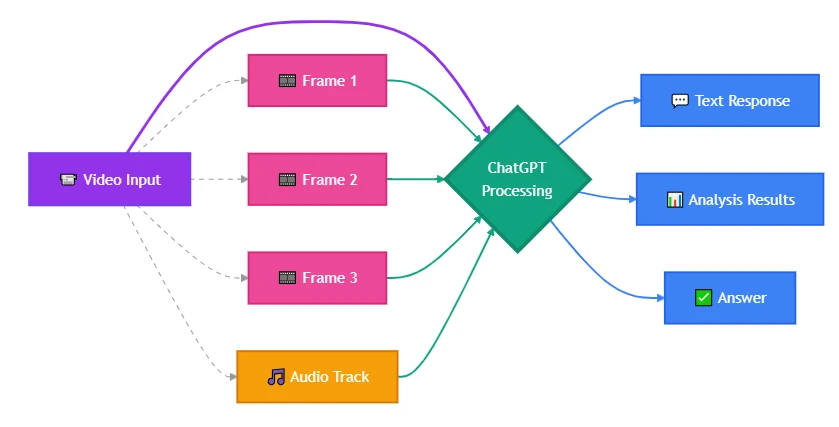

實際上發生的是:ChatGPT 並不像你那樣「看」影片。它不會按下播放、串流內容,並在時間軸上觀察連續的動作。它做的是把影片拆成它已經擅長處理的部件——靜態影像與文字逐字稿——然後分別對這些部分進行推理。對模型而言,你的影片就像一本帶旁白的相簿,而不是連續體驗。這就是為什麼它抓到口語說明,卻錯過視覺上的笑點:那個笑點所在的影格很可能不在取樣集合裡。

當有人問「ChatGPT 能看影片嗎」,通常其實在問兩個問題之一:它能否像人類觀察者那樣串流視覺內容,或它能否從影片資料中擷取並分析意義——場景、對白、時間戳、螢幕上的動作?功能層面的答案是第二個問題可以,但存在會讓某些使用情境完全失效的限制。現代的 ChatGPT 變體透過將影片視為取樣影格與音訊轉寫的組合來處理影片,方式要嘛是介面自動擷取,要嘛是透過 API 接受使用者提供的影格。這種方法適用於摘要、場景描述與文字擷取;但不適合動作追蹤、依賴精準時序的分析,或任何需要模型「看到」影格之間發生什麼事的任務。

大多數指南僅止於確認這項能力存在,卻沒有解釋為什麼你的實作不奏效——或你其實該採用哪種替代的輸入方式。

ChatGPT 視訊能力:模型實際「看到」什麼

ChatGPT 不會載入一支 MP4 並逐影格撥放查看。它具備「視覺能力」——分析靜態影像的能力——以及透過 Whisper 進行的音訊轉寫。當你在 ChatGPT 的網頁或行動介面提交影片時,系統會擷取關鍵影格、將音訊分開轉寫,再把兩者作為不同的輸入餵給模型。模型接著會描述它在那些影格中「看到」的內容,以及它在逐字稿中「聽到」的內容。

從你的角度看,這像是影片理解;從模型的角度,這是影像分析加上文字處理。這種架構區別決定了哪些使用情境可行、哪些不可行。

如果你的影片依賴動作、影格間的細微變化,或精準時序——例如偵測某物體何時進入畫面,或追蹤 UI 元件的動畫——基於關鍵影格的做法會錯過這些資訊。對於短暫出現於取樣影格之間的兩秒視覺提示,ChatGPT 不會捕捉到。除非你明確將輸入結構化,展示事件的演進,否則它也不會跨時間追蹤物體。

目前 ChatGPT 的影片能力(2026 年初):

- 以影像為基礎的影片分析:接受影片檔或擷取的影格;從取樣影像解讀視覺內容

- 音訊轉寫:透過 Whisper 將口說內容轉為文字;模型可據此摘要或查詢

- 場景描述:識別提供影格中可見的物體、動作、環境與文字

- 依時間戳查詢:若你提供影格時間戳或手動分段,模型可引用特定時刻

- 文字擷取:讀取影格中可見的字幕、UI 標籤或文件

ChatGPT 網頁介面中的具體影格取樣率與自動關鍵影格選擇行為——在知識截止時尚未公開文件

不包含的功能:

- 透過 API 的即時串流視訊輸入

- 逐影格精準的動作追蹤或跨時間的物體持續性

- 對影片編解碼的原生支援——所有處理皆發生於擷取影格與音訊層

- 未經提示的自動場景切換偵測

影片處理能力受限於 Token 上限與檔案大小,而非時長。雖然 5–10 分鐘是實務上的經驗值,實際限制會隨視覺密度動態變化。

如果你的使用情境需要上述能力,你要嘛自行預處理影片以擷取合適影格,要嘛改用具備原生影片支援的模型。下一節將拆解應針對你的情境選用哪種輸入方式。

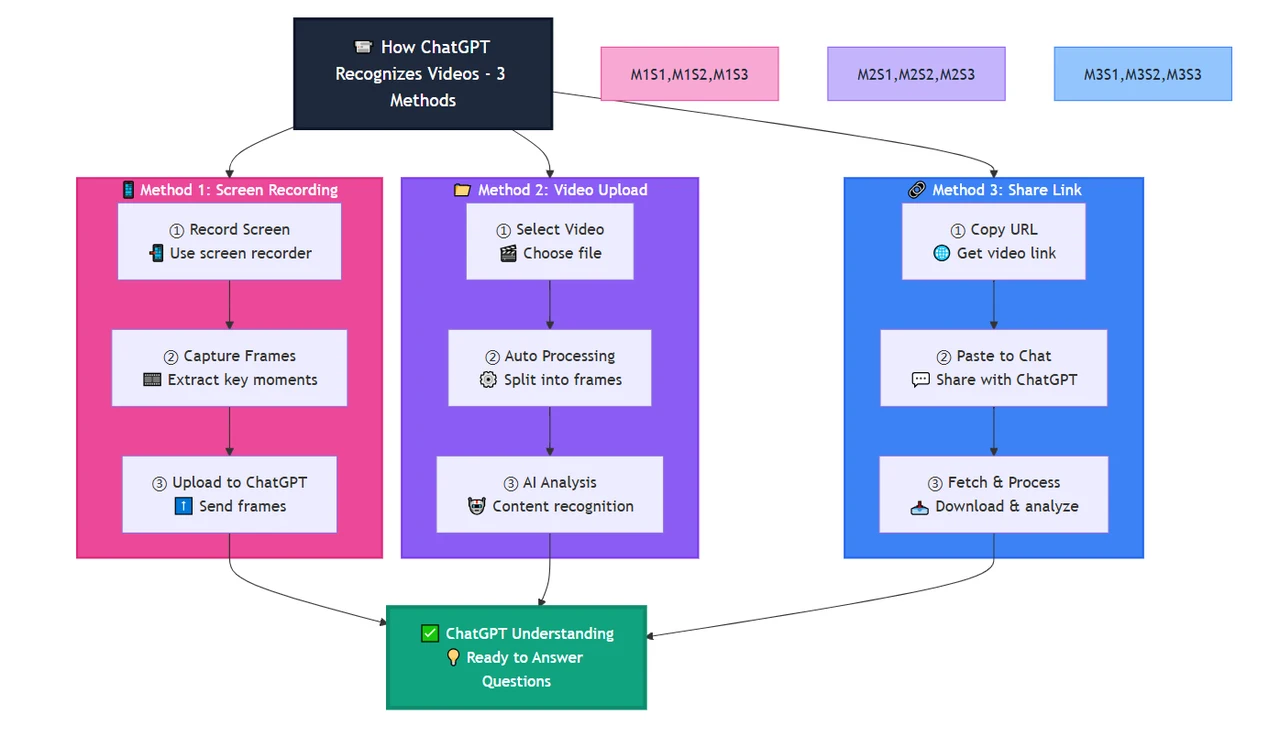

ChatGPT 如何識別影片:三種實用方法

提交影片給 ChatGPT 並沒有唯一方法。你選擇的方法決定了模型能分析什麼、會錯過什麼。大多數實作失敗都是因為選了方便的方法,而不是正確的方法。

方法一:手動擷取影格 + 上傳影像

使用 ffmpeg 或類似工具自行擷取影格,再將這些特定影格作為圖片上傳。這讓你完全掌控 ChatGPT 分析的內容。

範例流程(bash):

# 從影片每 5 秒擷取 1 張影格

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# 或僅在場景變換時擷取影格

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

此作法可讓你:

- 聚焦於特定時刻(開場、關鍵動作、結尾),避免將無關片段浪費在上下文

- 透過以上傳連續影格、以你選擇的取樣率來捕捉動作

- 規避檔案大小限制——影像通常比完整影片小

- 保留影格品質,避免自動壓縮造成的劣化

權衡:

你必須自行處理預處理。要在規模化分析上百支影片時,需要自動化;對一次性的深度分析或針對特定場景除錯,這是最可靠的方法。

適用時機:

- 你需要對特定時刻進行影格級精準分析

- 關鍵視覺資訊很短暫,或發生在典型關鍵影格間隔之間

- 你在比較一段序列中的視覺變化(UI 狀態變化、動畫影格)

- 你想藉由檢視自己上傳的精確影格,驗證模型實際「看到」了什麼

方法二:透過 ChatGPT 介面直接上傳檔案

ChatGPT 的網頁與行動應用可在對話中直接接收影片上傳。將 MP4 或 MOV 拖入輸入欄,系統會自動處理影格擷取與轉寫。

內部發生的事:

- 服務會以一定間隔取樣影格(具體速率未文件化;依觀察約 1–2 影格/秒)

- 音訊透過 Whisper 或類似服務轉寫

- 兩份輸出以獨立的上下文輸入提供給模型

- 模型據以產生基於影格可見內容與逐字稿的回應

此方法適用於:

- 不需影格級細節的高層次影片摘要

- 辨識跨場景持續存在的關鍵物件、人物或環境

- 擷取口語內容或多次出現在影格中的螢幕文字

- 無需預處理的快速探索式分析

此方法不適用於:

- 影格級精準分析——你無法控制取樣到哪些影格

- 對於長篇內容超出模型舒適上下文容量時,需要進行邏輯分段。若不採用策略性分塊或預處理,隨著高密度視覺資料快速消耗 Token,模型可能出現品質劣化或截斷

- 偵測動作、轉場或需要連續影格比較的時序依賴內容

- 關鍵視覺資訊僅在取樣影格之間短暫(1–2 秒)出現的情境

若你需要掌控被分析的時刻,請使用方法一。

方法三:YouTube 連結 + 逐字稿擷取

某些 ChatGPT 外掛與第三方工具宣稱能「分析 YouTube 影片」。它們實際做的是擷取影片的公開中繼資料與逐字稿(若可用),然後將文字交給 ChatGPT。

可行於:

- 影片有自動或上傳的字幕

- 你的分析只需要口語內容,不需要視覺資訊

- 影片是公開可存取的(非私人、非不公開、非區域限制)

- 你在摘要講座、Podcast 或訪談,且音訊承載了大部分意義

不適用於:

- 你需要分析視覺內容(螢幕示範、圖表、表情)

- 影片沒有逐字稿或字幕

- 關鍵資訊僅以視覺呈現,未在對白中提及

- 你處理的是私人影片或需授權才能存取的內容

常見錯誤: 開發者期待完整的影片理解(視覺 + 音訊),卻只收到逐字稿摘要。對於口語內容分析而言這沒問題;但對於產品示範審查、視覺設計分析或任何重視「所見」多於「所說」的情境,這就毫無用處。

模式結論:需要精準度不高的快速摘要用方法二;需要可控分析、必須指定影格時用方法一;以音訊為主、視覺次要或不存在時用方法三。請依你的關鍵資訊所在之處選擇——是在動作、特定影格,還是純屬對話。

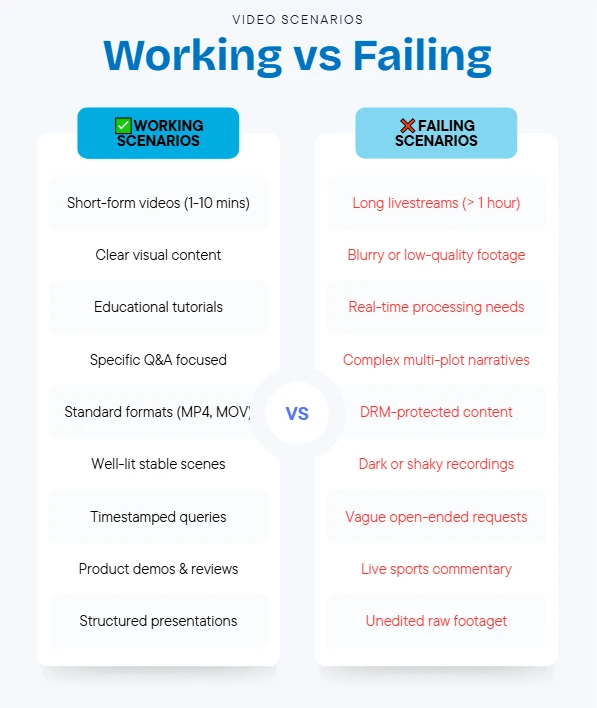

ChatGPT 影片應用情境:哪些在生產環境中真的可行

知道 ChatGPT 能處理影片構件,並不代表它適合你的問題。以下情境顯示基於影格的分析在哪些地方成功——以及架構限制在哪些地方會讓使用情境失效。

情境一:教育內容摘要

使用案例: 你有一支 10 分鐘的教學影片,需要關鍵步驟、提到的工具、以及顯示的視覺範例的結構化摘要。

可行原因: 教學影片通常有清楚的場景邊界、穩定的螢幕文字,且旁白與視覺一致。講者會在顯示內容時進行說明。ChatGPT 可轉寫解說、在取樣影格中識別工具或圖表,並結合兩者輸出結構化結果。

實作方式: 透過 ChatGPT 介面上傳影片,或在主要主題轉換處擷取 8–12 張關鍵影格。提示詞:「列出影片中講解的主要步驟,同時參考旁白與螢幕上的文字、圖表或工具名稱。」

失效點: 依賴連續動作的影片——例如講師快速在多個檔案間打字的程式碼實作影片——會在影格間遺失步驟。你需要更高的影格取樣率,或僅聚焦音訊逐字稿。

實用建議: 對於講座或教學內容,將自動上傳(取得逐字稿)與手動擷取 3–5 個最重要視覺片刻的影格結合。這同時提供完整音訊覆蓋與高品質的關鍵概念影像。

情境二:產品示範分析

使用案例: 你在審視競品的產品示範,想擷取 UI 元件、功能名稱、用戶流程與畫面上顯示的定價資訊。

可行原因: 產品示範通常會在每個畫面停留足夠久,使取樣影格捕捉到靜態 UI。文字覆蓋、按鈕標籤、選單結構與定價表格會跨多個影格可見。即使旁白未提及,ChatGPT 的視覺能力也能讀取並描述這些元素。

實作方式: 在主要場景變換處擷取影格(開場投影片、功能 1 示範、功能 2 示範、定價畫面、CTA)。上傳這些影格並提示:「對每張影格,辨識所有可見的 UI 元件、按鈕標籤、功能名稱,以及任何顯示的定價或產品資訊。」

失效點: 節奏快速的畫面轉換、僅短暫出現的 hover 狀態,或只顯示 1–2 秒的互動元素,可能不會被取樣影格捕捉。若競品快速閃現功能比較表,除非剛好取樣到那一刻,否則會錯過。

實用建議: 先手動拖曳觀看影片,找出重要揭露的時間點。於那些時刻擷取影格,而非依賴固定間隔取樣。

情境三:會議或訪談的轉寫與視覺脈絡

使用案例: 你錄了一場客戶會議,需要逐字稿並標註何時出現了特定文件、投影片或螢幕分享。

可行原因: 音訊轉寫可處理口語對白。當與會者分享螢幕或展示文件時,這些會出現在取樣影格中。ChatGPT 可在逐字稿旁註記「約在 [timestamp],螢幕上出現了一份合約文件」,對會議紀要中引用視覺材料很實用。

實作方式: 上傳影片並提示:「轉寫本次會議,並標註任何出現文件、簡報投影片、螢幕分享或其他視覺參考的時刻。對每個視覺元素,描述其內容。」

失效點: 短於 5–10 秒的螢幕分享可能落在取樣影格之間。壓縮後解析度過低致使文字難以辨認時,無法擷取。若是法律或合規情境需要精準呈現所顯示文件,請先驗證影格品質與取樣覆蓋,再依賴輸出。

實用建議: 對重要會議,以更高解析度錄製;當有人說「讓我給你看這份文件」時,於該時刻擷取影格。

情境四:內容審核或合規檢查

使用案例: 你需要掃描用戶上傳的影片以找出違規內容——特定標誌、文字樣式或視覺元素。

可行原因: ChatGPT 可在影格中掃描可見文字、可辨識物件或描述性的場景。如果你要檢查「影片是否顯示某競品標誌」,針對停留超過一兩秒的標誌,影格分析能偵測到。

實作方式: 以固定間隔(每 3–5 秒)擷取影格,上傳並提示:「檢視這些影格,找出任何包含 [特定標誌、品牌名稱、違禁符號等] 的畫面。對每個匹配,描述其在畫面中的位置。」

失效點: 僅音訊層面的違規(版權音樂、違禁言論)需額外音訊分析。基於動作的違規(違禁手勢、跨多影格的行為)無法由靜態影格捕捉。短暫閃現的違禁內容可能未出現在取樣影格中。

實用建議: 將 ChatGPT 的視覺掃描與專用的音訊指紋服務以及更高的影格取樣率結合,用於高風險內容類別。將 ChatGPT 作為第一層篩檢,而非唯一的審核層。

成功情境的共通點:具有意義的內容存在於離散、穩定的影格中,且與音訊或文字要素互相對應。失敗發生在關鍵資訊存在於動作、時序、轉場,或出現得過於短暫而難以穩定取樣的情況。

Gemini 視訊能力 vs. Claude 視訊能力 vs. ChatGPT

如果 ChatGPT 的影格取樣架構不符合你的使用情境,你會考量替代方案。Gemini 與 Claude 提供不同的與影片相關能力——這些差異決定了哪個模型適合你的實作。

Gemini 的原生影片處理

Gemini 模型在 API 層支援「原生影片輸入」。你可直接傳入影片檔,無需先擷取影格。模型以連續串流方式處理影片,使得 ChatGPT 的影格式方法無法辦到的動作追蹤、場景切換偵測與時間推理成為可能。

Gemini 具優勢的使用案例:

你需要在 30 秒片段中偵測特定物體何時進入與離開畫面,或追蹤人物如何在場景中移動。Gemini 能跨影格追蹤物體、推理動作;ChatGPT 只會看到被取樣到的影格,可能錯過進場或退場。

權衡:

- Gemini 的原生 API 相對於 OpenAI 的影格取樣更具成本效率。透過避免線性 Token 開銷與上下文快取,Gemini 在長片分析上更具延展性

- 處理較長影片會增加延遲——模型必須先攝入整個檔案才會回應

- 並非所有 Gemini 變體都支援影片輸入;需要較新的 Gemini

- 影片長度有限制,但相較於 ChatGPT 受上下文限制更寬鬆

何時選 Gemini 而非 ChatGPT:

- 你的使用情境需要動作追蹤、場景邊界偵測,或對時間關係的理解

- 關鍵資訊快速地在影格間出現/消失

- 你分析的是事件進程至關重要的影片(運動賽事、監視畫面、動畫)

- 你想避免手動擷取影格的預處理

Claude 的當前影片限制

截至 2026 年初,Claude 模型「不支援」透過 API 的直接影片輸入。你可以上傳影像(包含手動擷取的影片影格),但沒有可與 Gemini 相比的原生影片處理能力。

Claude 可做的:

- 分析上傳影格序列,類似於 ChatGPT 的手動擷取方法(方法二)

- 對每張影格的視覺內容提供詳細描述

- 若明確提示,可對影格間的變化進行推理

- 由於更大的上下文視窗(Claude Opus 4.7 可達 1M Token),能處理較長的影像序列

Claude 做不到的:

- 直接接受影片檔於任一介面

- 在沒有逐影格明確引導的情況下,自動跨影格追蹤動作或物體

- 轉寫音訊——需要 Whisper 或類似工具預處理,再將逐字稿傳給 Claude

仍會選 Claude 的情境:

- 你的流程已包含影格擷取作為預處理步驟

- 你分析長影片需要大量影格,且需要 Claude 的大上下文視窗

- 你比較視覺分析品質後發現 Claude 在你的領域(如醫學影像、技術圖)更準確

- 你需要把影格分析與大量其他背景資訊結合

能力比較表

| Feature | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Direct video file upload | ✓ (web/app interface) | ✓ (API + web interface) | ✗ |

| Native motion tracking | ✗ | ✓ | ✗ |

| Audio transcription | ✓ (Whisper integration) | ✓ (integrated) | ✗ (requires external tool) |

| Frame-based analysis | ✓ | ✓ (also continuous processing) | ✓ (manual extraction only) |

| Scene change detection | ✗ (manual only) | ✓ (automatic) | ✗ |

| Typical video length handling | ~5-10 min (context limited) | ~1 hour (resolution dependent) | N/A (frame count limited by context) |

| Best use case | Quick summaries, frame-level analysis with some control | Motion tracking, temporal reasoning, continuous video | Deep frame-by-frame description with large context needs |

| API video support | ✗ (images only) | ✓ | ✗ |

決策框架:

- 選擇 ChatGPT 的時機:你需要快速影片摘要,關鍵資訊可在多個影格中持續存在,影片較短(10 分鐘內),且不需要動作追蹤。適合教育內容、靜態產品示範、會議轉寫。

- 選擇 Gemini 的時機:你的使用情境需要動作追蹤、場景切換偵測,或跨時間軸的推理。對監視畫面、運動分析、動畫評論,或任何「影格之間發生了什麼」很重要的任務至關重要。

- 選擇 Claude 的時機:你的管線已包含影格擷取,需要分析大量影格與龐大背景資訊,或你發現 Claude 在你的視覺領域描述更準確。需要最多的預處理,但提供最大的上下文視窗。

對於跨多個模型工作的開發者,CometAPI 提供統一介面,可用相同影片輸入測試 GPT、Gemini 與 Claude 的處理品質——這在你比較輸出品質、再決定綁定特定供應商時很有用。

對「ChatGPT 能看影片嗎」的真正答案不是二元的。答案是「可以,方法是把影片轉成它已能處理的格式——但存在會讓特定使用情境失效的限制」。多數實作失敗源於架構不匹配,而非能力缺口。模型完全按設計工作,只是開發者期待的是不同的設計。

如果你要在規模上構建影片分析功能,先用邊界案例測試你的流程:針對同支影片,分別使用直接上傳、手動擷取影格、僅逐字稿三種方式,上傳並比較輸出。能捕捉你使用情境關鍵訊號的方法——而不是實作最快的方法——才是能撐過生產流量的方法。

在決定用 ChatGPT 進行影片分析前:

- 確認你的關鍵資訊是存在於穩定影格、動作,還是音訊

- 以預期的間隔手動擷取影格,測試取樣覆蓋率

- 驗證經壓縮後的影片解析度下,螢幕文字仍可讀

- 確認影片長度在你的訂閱等級的實務上下文限制內

- 為短暫出現或落在取樣影格間的內容預留備援方案

對於評估多家 AI 供應商以處理影片工作負載的開發者,CometAPI 提供統一的操作環境,可用相同影片輸入測試 ChatGPT、Gemini 與 Claude——讓你在建立供應商特定整合前,先比較輸出品質、延遲與成本。

FAQ - AI 影片分析指南

關於 AI 影片分析的常見問題速答。

ChatGPT 能分析影片嗎?

可以。ChatGPT(GPT-4o 與後續)可透過約每秒 1 張影格的取樣與音訊轉寫來分析影片。它擅長會議摘要、擷取投影片文字與辨識物件。不過,對動作追蹤、超過 10 分鐘的影片,以及即時串流會有困難。

我該如何上傳影片到 ChatGPT?

Direct URL Upload(推薦): 透過公開 URL 上傳,快速分析。最適合 10 分鐘以內的影片。

Manual Frame Extraction: 擷取特定影格以獲得精準控制。最適合你需要分析特定時刻或降低 Token 成本時。

ChatGPT 可處理的影片最長多長?

ChatGPT 在 5–10 分鐘以內較為可靠。更長的影片需要分段,或改用原生支援長影片的 Gemini 2.5 Pro(可處理長達 60 分鐘)。

ChatGPT 的影片分析有哪些限制?

- 無法追蹤連續動作(運動、舞蹈)

- 時間戳不精準(±1 秒)

- 錯過少於 1 秒的內容

- 實務上約 10 分鐘限制

- 不支援即時串流

- 低品質或昏暗影片表現不佳

- 在時間因果推理上較弱(*)

我應該用 ChatGPT 還是 Gemini 做影片分析?

使用 ChatGPT 當:

- 影片少於 10 分鐘

- 影片分析後需要更強的文字推理

- 以影格為主的分析(投影片、截圖)

使用 Gemini 當:

- 影片長度 10–60 分鐘

- 需要動作追蹤與移動分析

- 需要時間序列推理

- 運動、舞蹈或監視畫面(*)

Claude 能分析影片嗎?

不行,Claude 不支援直接影片輸入。不過你可以從影片擷取影格後用 Claude 分析;它提供更大的上下文視窗與良好的文字推理,適合長篇分析。

影片分析要多少費用?

成本視模型與影片長度而定:

- ChatGPT 4o:約 $0.05 per minute

- Gemini 2.5 Pro:約 $0.04 per minute

CometAPI 為新用戶提供體驗額度以便開始使用。