DeepSeek 已正式預覽將 V4 作為開源模型家族推出,而重點不僅僅是「又一次模型更新」。公司將 V4 定位為面向真實工作負載的長上下文、對代理友好的系統:文檔密集分析、程式助理、搜尋代理與多步自動化。該發佈已在 Web、App 與 API 上線,且 V4 系列在其官方服務中引入具成本效益的 1M-token 上下文視窗。

此次發佈之所以格外值得關注,在於同時兼顧規模與效率。DeepSeek 表示 V4-Pro 具備 1.6T 總參數、49B 活躍參數,而 V4-Flash 具備 284B 總參數、13B 活躍參數。在技術報告中,DeepSeek 還稱 V4 架構採用混合注意力、MoE 路由與後訓練,旨在提升代理式行為的同時,降低超長上下文的計算負擔。

什麼是 DeepSeek V4?

DeepSeek-V4 是公司最新的預覽旗艦系列,此次發佈包含兩個公開變體:V4-Pro 與 V4-Flash。DeepSeek 將 V4-Pro 描述為在世界知識、數學、STEM、程式與代理式編碼方面更強的模型,而 V4-Flash 則是更靈敏、具成本效益的選項,同時保留了相當多的推理品質與長上下文能力。V4-Pro 在代理式編碼與世界知識方面領先當前開源模型,而 V4-Flash 則面向速度與經濟部署設計。

V4 採用結合 Compressed Sparse Attention (CSA) 與 Heavily Compressed Attention (HCA) 的混合注意力架構,並引入 Manifold-Constrained Hyper-Connections 與 Muon 最佳化器。公司還表示,模型預訓練超過 32T tokens,且在 1M 上下文下,V4-Pro 的單 token 推理 FLOPs 僅為 DeepSeek-V3.2 的 27%,KV 快取僅為其 10%。這項效率才是此次發佈背後的真正亮點。

DeepSeek-V4-Pro 對比 DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro 是針對最重視品質的使用者而設計的旗艦模型。DeepSeek-V4-Pro 提供更強的代理式編碼能力、更豐富的世界知識與世界級推理表現,且依據發佈頁面,其在世界知識上僅次於 Gemini-3.1-Pro。技術報告指出,V4-Pro 是系列中較大的模型,並可透過與 V4-Flash 相同的 OpenAI 相容與 Anthropic 相容介面取得。

DeepSeek-V4-Flash

V4-Flash 是效率優先的模型,其推理能力與 V4-Pro 相當接近,並在簡單代理任務上表現與 V4-Pro 相當;同時使用更小的參數規模並具備更快的回應時間,支援思考與非思考兩種模式,擁有與 Pro 相同的 1M 上下文長度與核心特性,但成本更低。

該選哪一個?

當任務高度關乎成敗、知識密集或難以驗證時(如企業研究、複雜程式設計、多步決策支援,或你希望獲得最強答案的任務),請使用 V4-Pro。當吞吐量、延遲或 token 成本比追求最後幾分的基準成績更重要時,請使用 V4-Flash。此選擇與官方定位及兩者間的基準差距報告一致。

| 項目 | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| 總參數量 | 284B | 1.6T |

| 活躍參數 | 13B | 49B |

| 上下文長度 | 1M | 1M |

| 推理模式 | 非思考 + 思考 | 非思考 + 思考 |

| 最佳適用 | 快速推理、高吞吐應用、對成本敏感的代理 | 最強推理能力、更難的程式與知識任務 |

| 官方 API 價格 | 快取命中 $0.028 / 快取未命中 $0.14 / 輸出 $0.28(每 1M tokens) | 快取命中 $0.145 / 快取未命中 $1.74 / 輸出 $3.48(每 1M tokens) |

| 最大輸出 | 384K | 384K |

CometAPI 提供對 Deepseek v4 Pro 與 V4 Flash 的存取——比官方便宜 20%——並可透過單一 OpenAI 相容或 Anthropic Messages 端點,在 500+ 模型(GPT-5.4、Gemini 3.1 等)間無縫切換。

效能基準

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

在基礎模型對比表中,V4-Flash 與 V4-Pro 在核心基準上均超越 DeepSeek-V3.2,且通常由 V4-Pro 領先。例如,報告列出以下分數:AGIEval 82.6 / 83.1 對比 V3.2 的 80.1;MMLU 88.7 / 90.1 對比 87.8;MMLU-Pro 68.3 / 73.5 對比 65.5;HumanEval 69.5 / 76.8 對比 62.8;LongBench-V2 44.7 / 51.5 對比 40.2。其中中間數為 V4-Flash,最後為 V4-Pro。

| 基準 | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

來源:DeepSeek-V4 技術報告,表 1。

模式很清楚:Flash 縮小與 Pro 的差距,但 Pro 仍是更強的一般模型。這使得 V4-Flash 成為許多生產系統的實用預設,而當答案品質比成本或延遲更重要時,就選擇 V4-Pro。

西方模型對比:V4 的定位

在一次中文白領任務的人評中,報告稱 DeepSeek-V4-Pro-Max 的表現優於 Claude Opus 4.6-Max,具備 63% 不敗率。在研發編碼基準中,DeepSeek-V4-Pro「顯著優於」Claude Sonnet 4.5,並接近 Claude Opus 4.5。

| 評估領域 | DeepSeek 結果 | 西方模型對比 | 啟示 |

|---|---|---|---|

| 中文白領任務 | V4-Pro-Max,不敗率 63% | vs Claude Opus 4.6-Max | 在實務商務類任務中表現強勁 |

| 研發編碼基準 | V4-Pro-Max 通過率 67 | vs Claude Sonnet 4.5 為 47;Opus 4.5 為 70;Opus 4.6 Thinking 為 80 | 與領先前沿模型具競爭力,尤其相對 Sonnet 等級系統 |

它並非「各方面都第一」,但已達到「必須嚴肅評估」的水準。

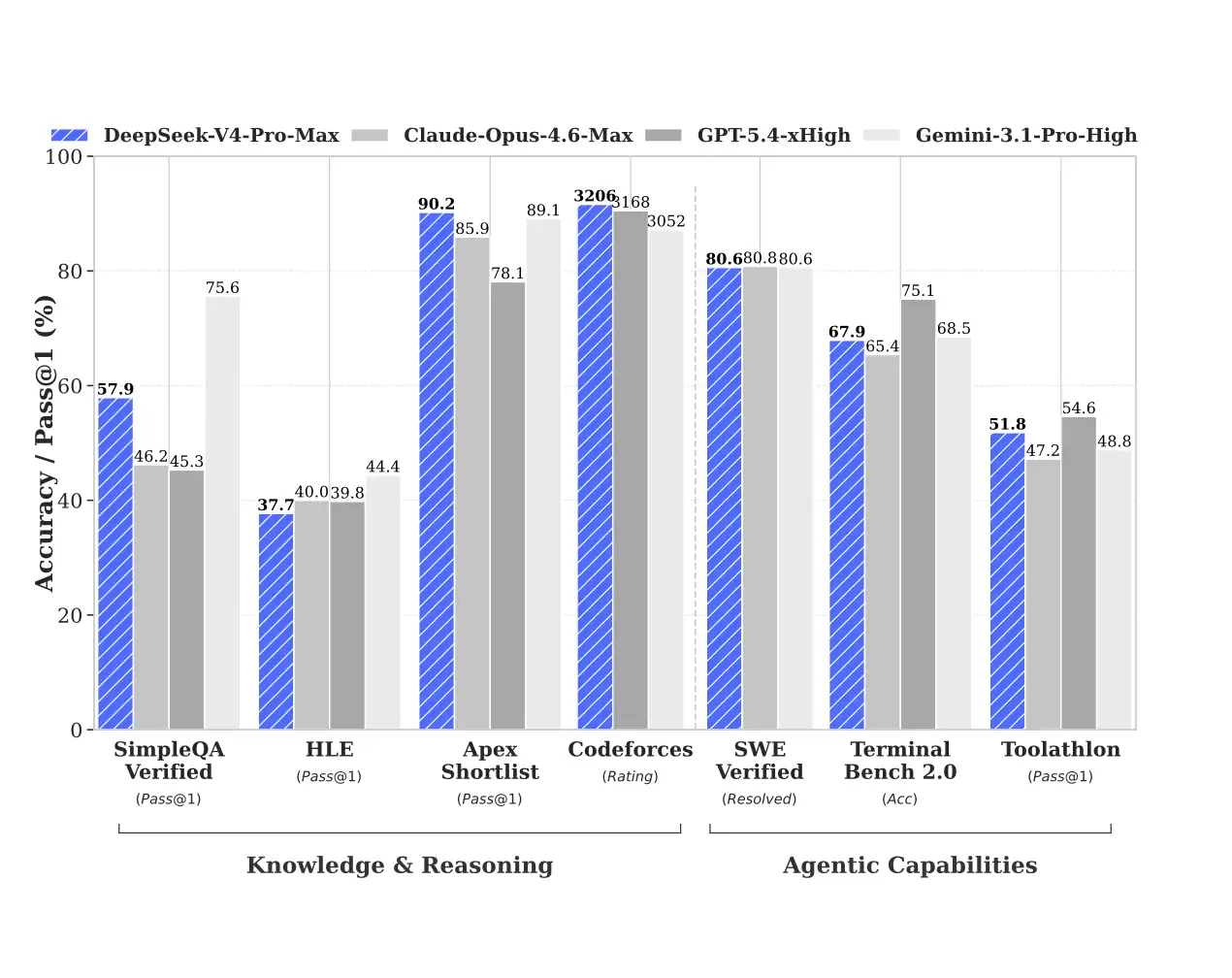

DeepSeek 的技術報告在同一張表中比較了 V4-Pro-Max 與 Claude Opus 4.6 Max、GPT-5.4 xHigh、Gemini 3.1 Pro High。結果並不簡化:西方閉源模型在某些知識與推理面向仍然很強;然而,V4-Pro-Max 在程式、長上下文與部分代理任務上具有非常強的存在感。換言之,敘事已不再是低維度的「國產替代」,而是進入了「你的場景更適合哪個」的階段。

在知識與推理能力方面,它與 Opus 4.6 Max、GPT-5.4 xHigh、Gemini 3.1 ProHigh 不相上下。但在代理能力上稍有落後,不過差距並不大。

DeepSeek-V4-Pro-Max 在偏向程式與長上下文的場景中極具競爭力,而西方模型在若干純推理與知識基準中仍十分強勢。正確的理解方式是:DeepSeek V4 已穩居前沿討論之列,但基準領先仍取決於任務類型。

如何存取 DeepSeek V4

1) 使用官方 Web 與 App

DeepSeek 表示 V4 Preview 目前已可在 Web、App 與 API 使用。對一般用戶來說,最簡單的方式仍是官方聊天介面,可透過 Expert Mode 或 Instant Mode 存取該模型。

2) 使用 API

我強烈推薦透過 CometAPI 存取 deepseek V4,因為其具備最佳價格與聚合優勢。

模型名稱為:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek 也表示舊名稱

deepseek-chat與deepseek-reasoner將被棄用,並在 2026-07-24 前暫時對應至 V4-Flash 的非思考與思考模式。若你已有舊版整合在線上,這對遷移規劃很重要。

- 前往 CometAPI 註冊並取得 API 金鑰。

- 使用標準的 OpenAI Python SDK(或任何相容用戶端),設定自訂 base URL:

以下是使用官方 OpenAI 相容格式的簡潔範例:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

此請求模式遵循快速入門指引:設定 base URL,選擇 deepseek-v4-pro 或 deepseek-v4-flash,並在需要更深入推理時啟用思考。

如何高效使用 DeepSeek V4

對長文檔流程而言,最佳做法是保持上下文乾淨且結構化。V4 的 1M-token 視窗是重大優勢,但當輸入按章節、來源摘錄、任務指令與明確輸出約束來組織時,模型表現最佳。這是最自然發揮 DeepSeek 所強調長上下文能力的方式。

對程式與代理流程,先用 V4-Flash 快速迭代,然後在最後一輪或最困難步驟升級至 V4-Pro。這與官方定位一致:Flash 是效率選項,Pro 更強,且兩者共享相同的 API 介面與上下文長度。

結語

DeepSeek-V4 的重要性在於同時把市場長期追求的四件事放在一起:長上下文、強推理、開放可用性與激進定價。真正的故事不只是又發了一個模型,而是嘗試讓前沿級 AI 在生產中具有經濟可行性。對於評估下一步 AI 投入的團隊,這是一個值得測試而非忽視的訊號。

對於跨多供應商構建的團隊而言,這正是值得納入自家系統進行基準測試的發佈。CometAPI 可以成為務實的中介層,讓你在不迫使產品團隊每次跟隨市場變化而重建整合的情況下,把 DeepSeek-V4 與其他前沿模型並行比較。