GPT-5.4 Mini 與 GPT-5.4 Nano 是 OpenAI 的 GPT-5.4 前沿家族的新緊湊變體:Mini 以在程式設計、多模態 UI 任務與子代理工作負載上達成同級最佳的效能/延遲權衡為目標;Nano 則面向分類、抽取、排序與大規模平行子代理,追求極低成本與延遲。Mini 在許多開發者基準上提供接近前沿的準確度,同時運行速度比先前的 mini 快超過 2×;Nano 則在每個 token 的成本上顯著更低,適合最看重吞吐量與即時性的場景。這些模型已可透過 API 使用(GPT 5.4 Mini 與 Nano 已在 CometAPI 上線)。

什麼是 GPT-5.4 Mini 與 GPT-5.4 Nano?

簡短定義: GPT-5.4 Mini 與 GPT-5.4 Nano 是 GPT-5.4 家族中經工程壓縮的緊湊變體,旨在將大型 GPT-5.4 的核心優勢(推理、程式設計、多模態感知、工具使用)帶入更快、成本更低的模型,針對高流量、低延遲工作負載。這些模型作為 GPT-5.4 發布的一部分由 OpenAI 宣布。

- GPT-5.4 Mini — 一款高效的小型模型,在多項評測中「接近 GPT-5.4 的表現」,同時針對速度與更低成本進行了優化。它特別適用於程式設計、推理、多模態 UI 解讀(螢幕截圖)以及在代理系統中作為子代理。OpenAI 報告其運行速度比先前的「mini」變體快超過 2×。

- GPT-5.4 Nano — GPT-5.4 家族中最小且最便宜的變體;建議用於分類、抽取、排序,以及在高吞吐的狹義、重複性任務中充當「支援型」子代理。它以較低的延遲與成本為代價,換取更深層推理能力的部分折衷。

可用性與價格

OpenAI 提供兩個可用於比較成本的具體數據點:

- GPT-5.4(完整旗艦)API 輸入價格:每 1M tokens $2.50(旗艦輸出價格更高)。

- GPT-5.4 mini API 輸入價格:每 1M tokens $0.75,輸出價格為每 1M tokens $4.50。

- GPT-5.4 nano API 輸入價格:每 1M tokens $0.20,輸出價格為每 1M tokens $1.25。

並列比較:mini 的輸入 token 價格(0.75)是旗艦(2.50)的 30%,也就是輸入成本約為三分之一;mini 的輸出價格(4.50)約為 API 價格表中旗艦輸出價格的 32%,同樣約為三分之一。Nano 更便宜:其輸入成本約為旗艦輸入成本的 8%,輸出成本則不到旗艦輸出成本的 10%。這些比例正是 OpenAI 將 mini/nano 定位為「約三分之一」(mini)以及「一小部分」(nano)旗艦模型使用成本的原因。nano token 的價格由 $0.05 上調至 $0.20,mini token 的價格由 $0.25 上調至 $0.75(針對輸入 tokens)。

在 OpenAI 平台

GPT-5.4 mini 可在三個地方使用:OpenAI API、Codex(OpenAI 的開發者 IDE/應用平台)與 ChatGPT(Free 與 Go 用戶可透過「Thinking」選項使用,並作為付費層級的額度退回備援)。在 API 中,它支援文字與影像輸入、工具使用(函式呼叫)、網頁/檔案搜尋、電腦操作與 skills,並提供非常大的上下文視窗(400k tokens),以服務以文件為主或多螢幕截圖的工作流程。API 的定價為每 1M 輸入 tokens $0.75、每 1M 輸出 tokens $4.50。

GPT-5.4 nano 只能透過 API 使用。其標價為每 1M 輸入 tokens $0.20、每 1M 輸出 tokens $1.25——定位為 GPT-5.4 家族中成本最低的選擇。Nano 模型在能力上有意做出取捨,以換取成本與速度。

在第三方平台

CometAPI 是一個 AI API 多模態聚合平台,現已上線 GPT 5.4 系列 API,包括 GPT 5.4 Mini 與 GPT 5.4 Nano,價格較 OpenAI 官方價優惠 20%。

GPT 5.4 Nano:

| Comet 價格(USD / M Tokens) | 官方價格(USD / M Tokens) |

|---|---|

| 輸入:$0.16/M;輸出:$1/M | 輸入:$0.2/M;輸出:$1.25/M |

GPT 5.4 Nano:

| Comet 價格(USD / M Tokens) | 官方價格(USD / M Tokens) |

|---|---|

| 輸入:$0.6/M;輸出:$3.6/M | 輸入:$0.75/M;輸出:$4.5/M |

主要功能與新特性

以下是重點能力——工程師與產品團隊會關注的原因。

編碼與長上下文支援

上下文視窗: GPT-5.4 mini 支援 400k token 的上下文視窗(OpenAI 明確列出 mini 為 400k 上下文)。這足以覆蓋多檔案程式碼庫、超長文檔,或需要保留上下文的重要多輪代理工作流程。Nano 的上下文相較完整 GPT-5.4 較小,但對於快速的短任務仍相當充足。

推理

推理等級: OpenAI 提供可配置的 reasoning_effort(none → xhigh);mini 與 nano 可在不同努力等級下運行,但在較高等級時,mini 在許多推理基準上縮小與完整 GPT-5.4 的差距。在多項智能基準(例如 GPQA Diamond)上,mini 達到 88.0%,而 GPT-5.4 為 93.0%,nano 為 82.8%,顯示小型模型亦具備不俗的推理能力。這些是 OpenAI 在發布文章中公布的結果。

多模態理解(視覺與 UI)

視覺感知與 UI 任務: GPT-5.4 mini 在 UI 任務(螢幕截圖、密集文檔影像)上表現相當強勁。在 OSWorld-Verified(電腦使用基準)上,mini 獲得 72.1%,接近 GPT-5.4 的 75.0%,遠高於以往的 mini——這也是 mini 被定位於截圖驅動的自動化與反應迅速的多模態助理的原因。Nano 在視覺基準上的表現較低,但對較簡單的影像任務仍有用。

工具調用與電腦操作

原生工具/點擊能力: GPT-5.4 引入並擴展了原生的電腦操作工具;mini 承襲了呼叫工具、進行函式呼叫、解讀螢幕截圖與協調子代理的能力。工具呼叫基準(Toolathlon、MCP Atlas)顯示 mini 與 nano 都取得了不錯的分數(Toolathlon:mini 42.9%,nano 35.5%)——量化了它們呼叫與協調外部工具的能力。這些數據來自 OpenAI 的公告。

幻覺/事實性/錯誤率

OpenAI 報告稱 GPT-5.4 是迄今「最具事實性」的模型,較 GPT-5.2 進一步降低了幻覺;mini 與 nano 的絕對事實性低於完整模型(例如 HLE w/ tools:GPT-5.4 52.1%,mini 41.5%,nano 37.7%),這意味著在高度依賴事實的任務中使用小型模型時,需要增加驗證。例如在正確性至關重要時使用工具型驗證(工具呼叫、引文回溯)。

速度

OpenAI 報告 GPT-5.4 mini 在典型的生產級延遲估計中比先前的 GPT-5 mini 快超過 2×(這些估計基於模擬的生產行為,包括工具呼叫時長與採樣 token)。這一加速是新系列的核心主張,使得 mini 能在互動式應用(如程式助手)中作為反應迅速的子代理。

Mini 與 Nano 的表現如何——是否「接近」完整的 GPT-5.4?

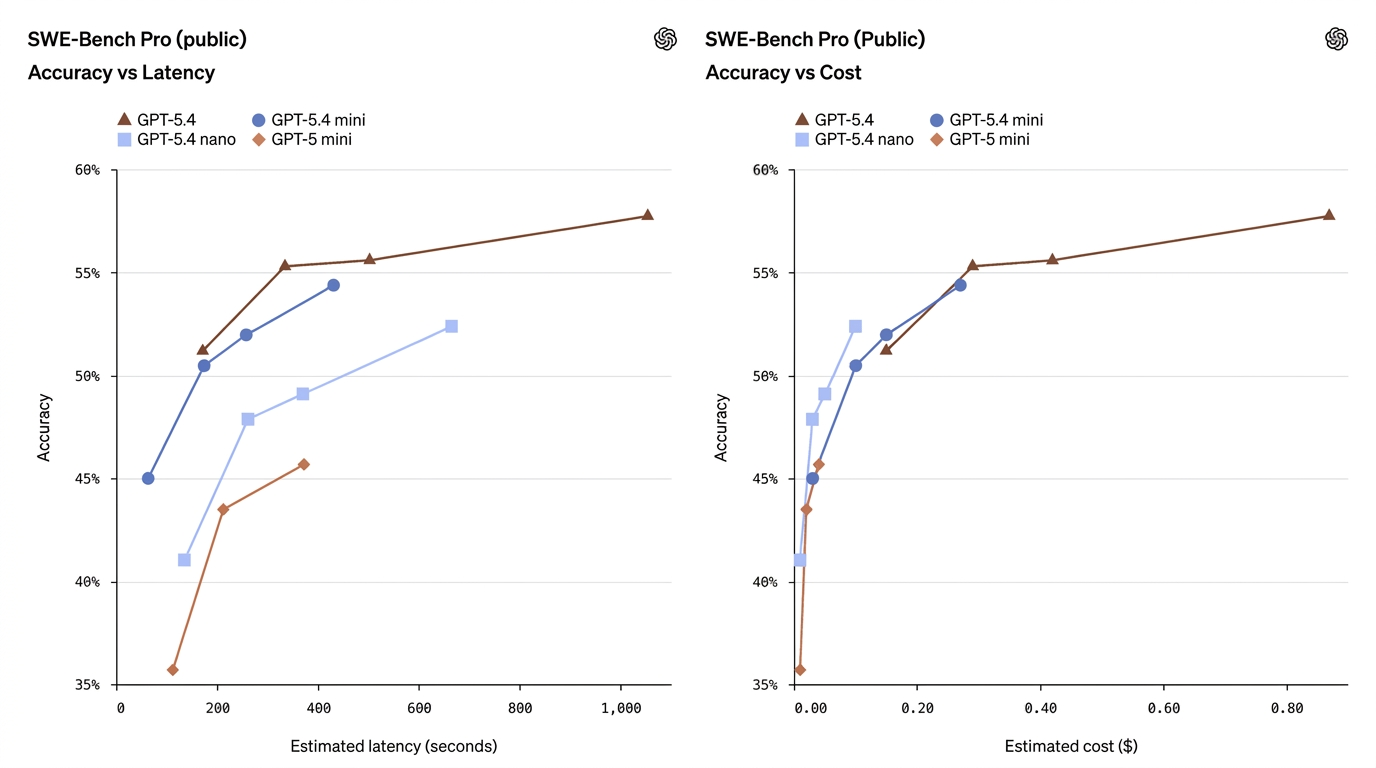

OpenAI 發布了涵蓋程式設計、工具使用、多模態電腦操作、智能測試與長上下文評估的全面基準比較。重點數字(在適用情況下採用 xhigh 推理等級)包括:

| 基準測試 | GPT-5.4 | GPT-5.4 Mini | GPT-5.4 Nano | GPT-5 Mini(舊) | 備註 |

|---|---|---|---|---|---|

| SWE-Bench Pro(程式設計) | 57.7% | 54.4% | 52.4% | 45.7% | Mini 接近完整模型的程式設計效能 |

| Terminal-Bench 2.0(互動式程式設計) | 75.1% | 60.0% | 46.3% | — | Mini 具備強勁的即時程式能力 |

| Toolathlon(工具使用) | 54.6% | 42.9% | 35.5% | — | 衡量編排與工具呼叫能力 |

| GPQA Diamond(進階問答) | 93.0% | 88.0% | 82.8% | — | 智能與推理基準 |

| OSWorld-Verified(GUI 任務) | 75.0% | 72.1% | 39.0% | 42.0% | UI/電腦使用能力 |

這些數字顯示,mini 在許多方面大幅縮小差距——特別是在程式設計與電腦使用任務上——而 nano 則在能力與成本之間占據實用的中間地帶。

用通俗的話說,這些數字代表什麼?

- GPT-5.4 Mini ≈ 許多生產任務上「接近旗艦」。 在 SWE-Bench Pro(程式設計通過率)上,mini 為 54.4%,旗艦為 57.7%——對許多真實世界的程式任務而言是幅度不大的差距,尤其在延遲重要時。在 OSWorld(電腦使用)上,mini 為 72.1%,旗艦為 75.0%——在 UI/截圖任務上同樣非常接近。

- GPT-5.4 Nano 以更多能力換取速度/成本。 Nano 的程式得分(SWE-Bench Pro 52.4%)相對以往 mini 已相當不錯,但在 OSWorld 中降至 39.0%,顯示對需要複雜多步驟 UI 理解或代理式工具序列的任務,nano 較不適合。Nano 擅長單輪分類、抽取與小型輔助任務。

- 工具使用有所提升,但仍然敏感。 從 GPT-5 mini 切換到 GPT-5.4 mini/nano,Toolathlon 等工具使用指標顯著提高,顯示 OpenAI 在較小模型中改進了工具調用可靠性——但在複雜工具編排上,完整模型仍領先。

在生產環境中的運作方式

壓縮、蒸餾與工程化優化

像 mini/nano 這樣的緊湊模型通常結合 模型蒸餾、量化 與 架構剪枝,在降低推理計算量的同時保留高價值能力(程式啟發式、視覺表徵)。OpenAI 的描述指出在較小規模下重點保留特定技能(程式、對多模態 UI 的理解)的工程取向。

建議模式

- 協調者 + 子代理模式: 使用 GPT-5.4(大型)作為規劃者/評審,並將任務分派給 GPT-5.4 mini / nano 子代理快速執行(搜尋、解析、編輯)。這能降低總成本並縮短用戶端延遲。OpenAI 明確推薦此設計模式。

- 退回與速率限制處理: 在 ChatGPT 或 Codex 中將 mini 暴露為額度退回備援,確保在完整模型不可用時,時間敏感的查詢仍能獲得具能力的回應。

- 為成本控制設計的分層架構: 批量管線(索引、抽取)→ GPT-5.4 nano;互動式 UI 元件 → GPT-5.4 mini;最終編輯判斷/複雜鏈條 → GPT-5.4 完整模型。這種多層方式平衡成本與能力。

延遲與平行化

Mini 與 nano 針對 平行子代理 進行了優化,適合許多小型工作者並行運行的場景——例如並行掃描數千份 PDF。OpenAI 的「tool yields」概念評估了平行工具呼叫如何降低壁鐘時間;mini/nano 的工程設計使這些模式更具成本效益。

實務上該如何使用 mini 與 nano

是否應該在所有地方以 mini/nano 取代旗艦模型呼叫?

不應一刀切。OpenAI 明確推薦的正確模式是 委派:對規劃、複雜判斷或最終驗證使用較大的模型,並將許多支援性的短任務分派給 mini 或 nano 子代理。這種模式在保留大型模型關鍵防護欄的同時,降低成本與延遲。使用案例:

- 互動式程式助理: 旗艦負責規劃與審查;mini 負責快速程式碼搜尋、編輯與短單元測試。

- 截圖驅動的「電腦使用」代理: mini 可快速解析密集界面;旗艦處理含糊的多步驟規劃。

- 高流量抽取與分類管線: nano 處理大量批次輸入(表單、日誌),回傳結構化結果;旗艦處理例外與複雜邊界案例。

mini 或 nano 能用於多模態或影像任務嗎?

可以——mini 支援影像輸入,並在多模態/視覺驅動的基準(MMMUPro/OmniDocBench)上表現出色,在部分測試中接近旗艦。Nano 的多模態能力較為受限:雖然相較以往 nano 有提升,但並非深層多模態推理或代理式影像任務的最佳選擇。

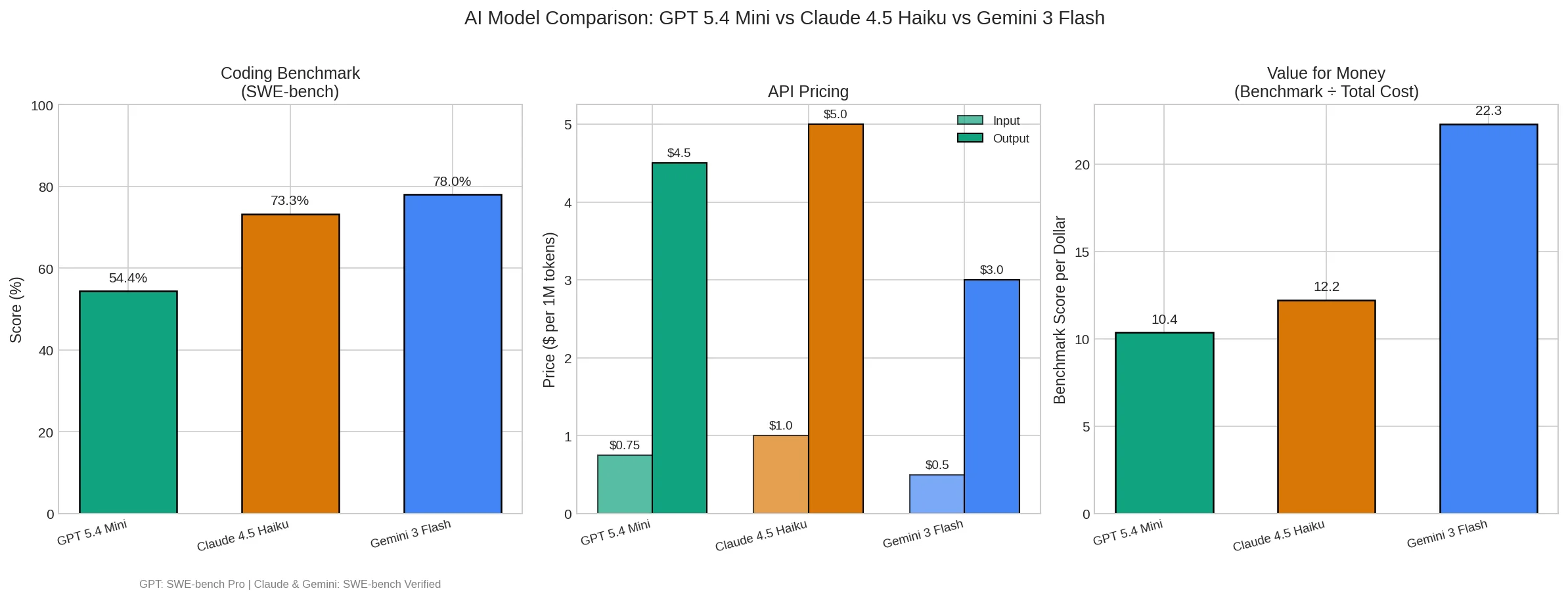

小型模型能力之戰加劇

三個月前,小型模型還被視為「夠用」。現在,GPT-5.4 mini 在程式基準上正逼近旗艦模型,且在計算效能上幾近匹敵。

背後趨勢十分明顯:旗艦模型的能力正快速向小型模型遷移。OpenAI、Google 與 Anthropic 都在做同樣的事:將大型模型的核心能力蒸餾到更小、更快、更廉價的版本中。

結論

這兩款模型的發布標誌著 AI 應用從一味追求規模轉向關注實用效率。透過快速響應能力,它們為即時 AI 互動與複雜任務流程的拆解提供了更可靠的底層支撐。

對開發者而言,這意味著代理系統的成本結構正在被重新定義。當成本降至這個級別時,許多先前「理論上可行但經濟上不可行」的代理場景將變得可行。

開發者現在即可透過 CometAPI 存取 GPT 5.4 Mini 與 GPT-5.4 Nano。在存取之前,請確保已登入 CometAPI 並取得 API 金鑰。CometAPI 提供遠低於官方的價格,協助你完成整合。

準備好了嗎?

.png&w=3840&q=75)