DeepSeek發布 深尋V3.2 以及一個高計算變體 DeepSeek-V3.2-Speciale這兩個模型都配備了全新的稀疏注意力引擎 (DSA)、改進的智能體/工具行為以及能夠展現內部推理過程的「思考」(思維鏈)模式。它們均可透過 DeepSeek 的 API(相容於 OpenAI 的介面)取得,模型工件/技術報告也已公開發布。

什麼是 DeepSeek V3.2?

DeepSeek V3.2 是 DeepSeek V3 系列的後續產品,該系列是一個大型的、長上下文的生成模型系列,專為…而設計。 推理優先 工作流程和代理商使用。 V3.2 將先前的實驗性改進(V3.2-Exp)整合到一個主流模型系列中,並透過 DeepSeek 的應用程式、Web UI 和 API 對外開放。它既支援快速對話式輸出,也支援專用的 思維 (心智圖)模式適用於數學、調試和規劃等多步驟推理任務。

V3.2 版本為何重要(簡單背景介紹)

DeepSeek V3.2 之所以引人注目,主要有三個實際原因:

- 詳細背景: 最多可處理 128k 個標記上下文窗口,因此適用於長文件、法律合約或多文件研究。

- 推理優先設計: 該模型將思維鏈(「思考」)整合到工作流程和工具使用中——這是向需要中間推理步驟的智慧應用程式轉變。

- 成本與效率: 引入稀疏注意力 (DSA) 可以減少長序列的計算量,從而能夠以更低的成本對大型上下文進行推理。

DeepSeek-V3.2-Speciale是什麼?它與基礎版v3.2有何不同?

「Speciale」版本有何特別之處?

DeepSeek V3.2-Speciale 是一款 高運算能力,高推理能力 Speciale 是 v3.2 系列的變體。與平衡版 v3.2 相比,Speciale 專門針對多步驟推理、數學和智能體任務進行了調整(並進行了後訓練);它在訓練過程中利用了來自人類反饋的額外強化學習 (RLHF) 和擴展的內部思維鏈。此臨時端點和 Speciale API 存取已宣佈為有時限(Speciale 路徑的端點將於 2025 年 12 月 15 日到期)。

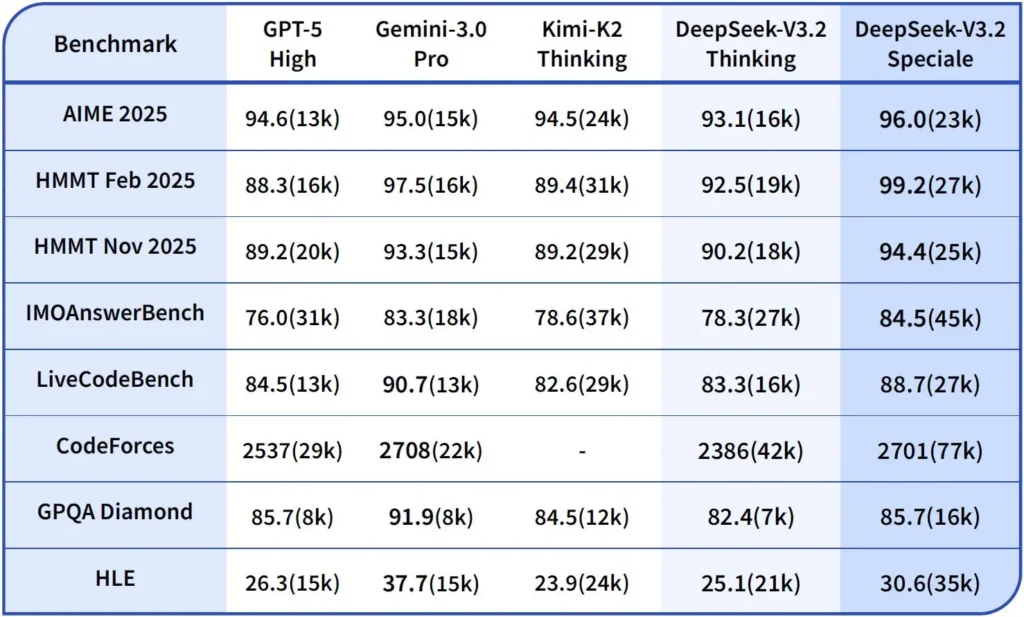

性能和基準

DeepSeek-V3.2-Speciale 是 V3.2 的高運算量、推理最佳化版本。 Speciale 版本整合了先前的數學模型 DeepSeek-Math-V2,定位為工作負載需要更高計算量時使用的模型。 最深層的思維鏈、多步驟問題解決、競爭性推理(例如,數學奧林匹克競賽風格)以及複雜的智能體協調.

它可以獨立證明數學定理並驗證邏輯推理;它在多項世界級比賽中取得了顯著成績:

- 國際數學奧林匹克競賽金牌

- 中國數學奧林匹克(CMO)金牌

- ICPC(國際電腦程式設計競賽)第二名(人類參賽組)

- 國際資訊學奧林匹克競賽(IOI)第十名(人類競賽)

DeepSeek v3.2 中的推理模式是什麼?

DeepSeek 暴露了一個明確的 思考/推理模式 這導致模型產生一個 思想鏈(CoT) 作為輸出的一個離散部分 之前 最終答案。 API 會公開此 CoT,以便用戶端應用程式可以檢查、顯示或提煉它。

機制-API 提供的功能

reasoning_content領域啟用思考模式後,回應結構包含一個reasoning_content領域(CoT)與最終水準相同content這樣,客戶端就可以以程式方式存取內部步驟。- 思考過程中的工具調用V3.2 聲稱支援工具調用 內 思維軌跡:此模型可以交錯推理步驟和工具調用,從而提高複雜任務的表現。

DeepSeek v3.2 API 如何實作推理

3.2 版本引入了標準化的推理鏈 API 機制,以在多輪對話中保持推理邏輯的一致性:

- 每個推理請求都包含一個

reasoning_content模型中的場; - 如果使用者希望模型繼續推理,則必須將此欄位傳遞到下一輪;

- 當一個新的問題出現時,舊的

reasoning_content必須清除以防止邏輯污染; - 此模型可以在推理模式下多次執行「推理→工具呼叫→重新推理」循環。

如何存取和使用 DeepSeek v3.2 API

簡稱: CometAPI 是一個 OpenAI 風格的網關,它透過以下方式公開許多模型(包括 DeepSeek 系列): https://api.cometapi.com/v1 所以你可以透過改變以下方式來交換型號: model 請求中包含字串。請先在 CometAPI 註冊並取得 API 金鑰。

為什麼要使用 CometAPI 而不是直接使用 DeepSeek?

- CometAPI 集中管理計費、速率限制和型號選擇(如果您打算在不更改程式碼的情況下切換供應商,這將非常方便)。

- 直接 DeepSeek 端點(例如,

https://api.deepseek.com/v1仍然存在一些功能,有時會暴露特定於提供者的功能;為了方便起見,可以選擇 CometAPI,或使用提供者的直接端點來存取其原生控制項。在使用 CometAPI 之前,請先驗證哪些功能(例如,Speciale、實驗性端點)可用。

步驟 A — 建立 CometAPI 帳戶並取得 API 金鑰

- 前往 CometAPI(註冊/控制台)並產生 API 金鑰(儀表板通常會顯示)。

sk-...保密。 彗星API

步驟 B — 確認可用的確切型號名稱

- 查詢模型清單以確認 CometAPI 公開的確切模型字串(模型名稱可以包含變體後綴)。在硬編碼名稱之前,請使用模型端點:

curl -s -H "Authorization: Bearer $COMET_KEY" \

https://api.cometapi.com/v1/models | jq .

查找 DeepSeek 條目(例如) deepseek-v3.2 or deepseek-v3.2-exp)並記下確切的 ID。 CometAPI 公開了一個 /v1/models 清單.

步驟 C — 發起基本聊天呼叫(curl)

更換 <COMET_KEY> deepseek-v3.2 您已確認的型號 ID:

curl https://api.cometapi.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer <COMET_KEY>" \

-d '{

"model": "deepseek-v3.2",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize DeepSeek v3.2 in two sentences."}

],

"max_tokens":300

}'

這是與 OpenAI 風格的呼叫模式相同的——CometAPI 將請求轉發給選定的提供者。

相容性和注意事項

- 支持在 Claude Code 環境中啟用思考模式;

- 在命令列(CLI)中,只需輸入模型名稱 deepseek-reasoner;

- 但是,目前它可能與 Cline 和 RooCode 等非標準工具不相容;

- 建議對普通任務使用非思考模式,對複雜的邏輯推理使用思考模式。

實際應用模式:幾個架構範例

1 — 開發人員工作流程的輔助代理

- 模式: Speciale(思考模式)用於產生複雜的程式碼和創建測試;快速聊天模式用於內聯助理。

- 安全性: 對產生的程式碼使用 CI 管線檢查和沙箱測試執行。

- 主機: API 或自架在 vLLM + 多 GPU 叢集上,適用於大型上下文。

2 — 為法律/財務團隊進行文件分析

- 模式: V3.2 版本採用 DSA 長上下文優化,可處理長合約並產生結構化摘要和行動清單。

- 安全性: 下游決策需經律師簽署確認;發送至託管終端前需對個人識別資訊進行編輯。

3 — 自主資料管道編排器

- 模式: 思考模式用於規劃多步驟 ETL 任務,呼叫工具查詢資料庫並呼叫驗證測試。

- 安全性: 在進行任何不可逆操作(例如,破壞性資料庫寫入)之前,實施操作確認和可驗證檢查。

以上每種模式目前在 V3.2 系列模型中都是可行的,但您必須將模型與驗證工具和保守的治理結合。

如何優化 v3.2 的成本和效能?

刻意使用雙模式

- 微互動快速模式:對於延遲至關重要的短時檢索、格式轉換或直接 API 呼叫,請使用無需思考的工具模式。

- 規劃與驗證的思考模式:將複雜任務、多動作代理或安全敏感決策路由至思考模式。擷取中間步驟,並在執行關鍵操作前執行驗證(自動或手動)。

我該選擇哪個型號?

- deepseek-v3.2 — 通用代理任務的平衡生產模型。

- deepseek-v3.2-Speciale — 專門的重推理變體;最初可能僅提供 API,當您需要最佳的推理/基準測試性能(並接受可能更高的成本)時使用。

實用的成本控制和技巧

- 提示工程:保持系統指令簡潔,避免傳送冗餘訊息。明確的系統指令:使用明確說明模式意圖的系統提示,例如:「您目前處於思考模式-請在呼叫工具前列出您的計畫。」 對於工具模式,新增類似「與計算器 API 互動時,僅輸出包含下列欄位的 JSON」的約束。

- 分塊 + 檢索增強:使用外部檢索器,僅發送與每個使用者問題最相關的片段。

- 溫度和採樣:降低工具互動溫度以提高確定性;提高探索性或構思性任務的溫度。

基準測試和測量

- 在驗證之前,應將輸出視為不可信:即使是推理輸出也可能錯誤。在採取不可逆操作之前,應新增確定性檢查(單元測試、類型檢查)。

- 在確定最終版本之前,請先對範例工作負載(延遲、令牌使用量、正確性)進行 A/B 測試。 v3.2 在推理基準測試中取得了顯著提升,但實際應用表現取決於提示設計和輸入分佈。

常見問題

Q:從模型中取得CoT的建議方法是什麼?

A: 購買 deepseek-reasoner 模型或套裝 thinking/thinking.type = enabled 您的請求中包含以下內容。回覆包括 reasoning_content (CoT)和最終 content.

問:模型在思考模式下能否呼叫外部工具?

答:是的-V3.2 版本引入了工具在思考模式和非思考模式下均可使用的功能;模型可以在內部推理過程中發出結構化的工具呼叫。 strict 模式和清晰的 JSON 模式,以避免格式錯誤的呼叫。

Q:使用思考模式會增加成本嗎?

答:是的-思考模式會輸出中間的CoT代幣,這會增加代幣的使用量,進而增加成本。請將系統設計成僅在必要時才啟用思考模式。

Q:我應該使用哪個端點和基本 URL?

答:CometAPI 提供與 OpenAI 相容的端點。預設基本 URL 為: https://api.cometapi.com 主要的聊天端點是 /v1/chat/completions /chat/completions 取決於您選擇的基本 URL)。

Q:使用刀具呼叫是否需要特殊工具?

答:不-API 不支援 JSON 中的結構化函數宣告。您需要提供 tools 參數、工具模式以及應用程式中的 JSON 函數生命週期管理:接收函數呼叫 JSON,執行函數,然後將結果傳回給模型以供繼續或結束。思考模式增加了一個返回參數的要求。 reasoning_content 同時提供工具測試結果。

結論

DeepSeek V3.2 和 DeepSeek-V3.2-Speciale 代表著向…方向的明確推動。 開放的、以推理為中心的 LLM(邏輯邏輯模型)能夠明確思維鏈並支援智慧體工具的工作流程。它們提供強大的新原語(動態結構分析、思維模式、工具使用訓練),可以簡化建立可信賴智能體的過程——前提是您需要考慮令牌成本、謹慎的狀態管理和操作控制。

開發人員可以訪問 Deepseek v3.2 API 等等,透過 CometAPI, 最新型號版本 始終與官方網站同步更新。首先,探索該模型的功能 游乐场 並諮詢 API指南 以獲得詳細說明。造訪前請確保您已經登入CometAPI並取得API金鑰。 彗星API 提供遠低於官方價格的價格,幫助您整合。

準備出發了嗎? → deepseek v3.2 免費試用 !