MiniMax-M2.5 是 MiniMax 推出的新一代、聚焦生產力的大型語言模型,針對程式設計、Agent 式工具使用與辦公流程進行最佳化。你可以透過原生的 MiniMax 平台,或是透過 CometAPI 等 API 聚合器來呼叫它。你只需取得 CometAPI 的 API 金鑰即可使用 API,因為 MiniMax-M2.5 也支援聊天格式。

什麼是 MiniMax-M2.5?

MiniMax-M2.5 是 MiniMax 最新的主要模型版本:作為 M2 系列的演進,官方將其定位為通用型、具備 Agent 能力的模型,並在程式碼生成、工具使用與多步推理方面表現尤其強勁。M2.5 系列於 2026 年 2 月發佈,包含標準版 M2.5 與強調低延遲、但維持相同核心能力的「highspeed」變體。M2.5 系列在軟體工程評測的分數有所提升,與外部工具(搜尋、Agent 等)的互動行為也更佳。

供應商將 M2.5 描述為相較早期 M2.x 版本的升級:更強的推理、更好的程式碼生成、與更可靠的工具調用。MiniMax 在 2026 年 2 月上旬的公開發佈說明中將 M2.5 標記為一個里程碑:更精煉的指令微調、更強的程式碼理解能力,並在多個以程式碼為重點的基準測試上取得可量化的提升。此次發佈包含:

- 標準版 M2.5(強調準確性與推理)。

- M2.5-highspeed 變體,為互動式開發者工作流程降低延遲。

- 面向大量程式碼生成使用場景的「Coding Plan」之明確指引與計費選項。

主要技術亮點

- 架構:MoE(總參數量大,但推理時啟用子網較小),在重負載任務中實現成本/效能的最佳平衡。

- 強項:最先進的程式碼表現、多輪推理、長脈絡處理,以及與 Agent/工具的整合。

- 風味:MiniMax 發布多個變體(例如

MiniMax-M2.5與M2.5-highspeed),在吞吐與延遲間做取捨調校。

為什麼這在今天很重要:許多打造開發者工具、程式助理與 Agent 自動化的團隊需要能跨多輪對話推理、能安全調用工具、並能輸出高品質程式碼的模型。M2.5 憑藉其架構與訓練選擇,便針對這些場景進行了明確的市場定位。

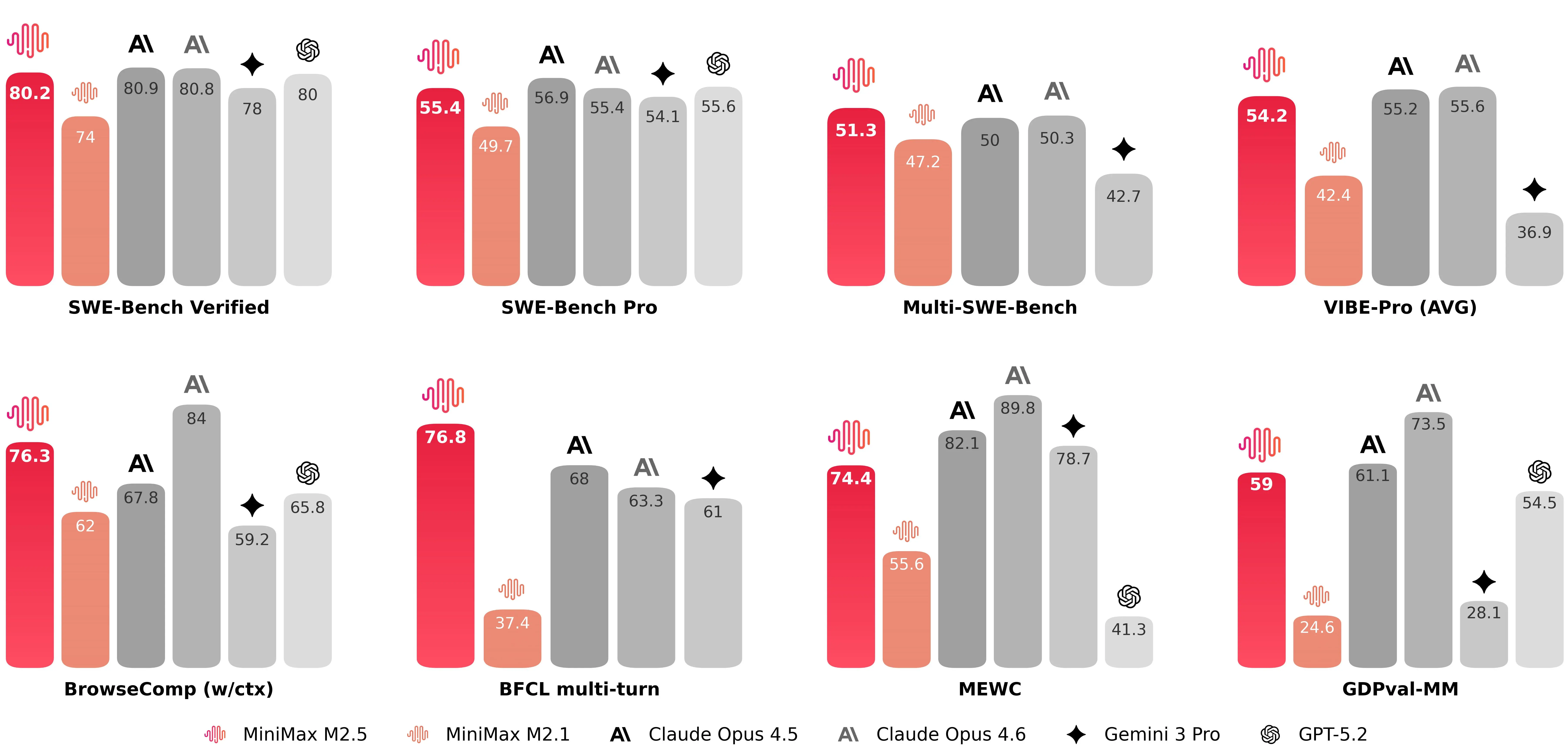

MiniMax-M2.5 的基準測試

M2.5 在程式相關基準上的表現

MiniMax-M2.5 在 SWE-Bench Verified 上取得 80.2% 的分數,並在多任務程式碼與瀏覽增強基準上有亮眼表現(官方公布的數據包括 Multi-SWE-Bench 51.3%、在啟用脈絡管理時 BrowseComp 76.3%)。這些數據讓 M2.5 在發佈時,即位居公開可用的頂尖程式碼生成與問題解決模型之列。MiniMax-M2.5 的發佈印證了 M2.5 正與頂級程式碼模型競爭。

對開發者而言,收益有兩點:

- 更高的首次成功率:更少的返工、更少的人為偵錯、以及更低的自主程式代理「看護」成本。

- 更完整的全端覆蓋:M2.5 被描述為支援桌面、行動與跨平台工具鏈的全端工作流程,目標不只生成片段,而是能產出多檔案的一致解與建置腳本。

為 Agent 式工作流程而生

M2.5 被描述為「原生為 Agent 場景設計」。實務上,這表示其架構與訓練更重視:

- 工具調用準確性:以正確的語法與參數發出 API 呼叫或執行 shell/SQL 指令。

- 脈絡切換與記憶:在中斷後持續多步操作而不遺失先前的狀態。

- 檔案操作:可程式化地生成與編輯常見辦公格式(例如先產生 PowerPoint,然後依後續要求進行修訂)。

搜尋與瀏覽增強

當 M2.5 與瀏覽或檢索層搭配時,MiniMax 報告在瀏覽型基準上的分數明顯提升,反映出其在整合外部資訊與引註方面的更強能力。這讓 M2.5 適用於需要擷取最新內容、交叉檢核 API 結果,或以真實世界資料增強程式碼生成的工具(例如擷取最新 SDK 文件並在生成程式碼時正確使用)。對於打造「Agent 式」能力(如自動化 QA、CI 工具鏈或文件驅動助理)的團隊而言,這些能力十分關鍵。

如何透過 CometAPI 使用 MiniMax-M2.5 API?

CometAPI 是一個 API 聚合平台,透過單一、相容 OpenAI 的 REST 介面提供數百個模型。由於 CometAPI 的介面與 OpenAI 的 chat/completions 端點相仿,你通常只需切換 api_base 與 API 金鑰,就能重用既有的 OpenAI 風格客戶端。若你不想直接整合至 MiniMax 平台(例如為了統一計費、多模型 A/B 測試、或供應商抽象化),你可以透過 CometAPI 的「chat」介面呼叫 MiniMax-M2.5。CometAPI 平台提供一致的請求格式、SDK 與網頁試用台,並公開每個模型的名稱與參數(因此呼叫時可選擇精確的 provider/model 字串)。

以下是透過 CometAPI 呼叫 MiniMax-M2.5 的精簡實用指南,附有 curl 與 Python 範例。

如何開始的基本步驟?

- 註冊 CometAPI 帳號並取得 API 金鑰。(CometAPI 提供試用台與 SDK 以測試模型。)

- 前往 CometAPI 的模型清單或 CometAPI 試用台,找到 MiniMax-M2.5 的精確模型名稱。

- 發送已驗證的 POST 請求,將

model參數設為所選的 MiniMax 模型,並依 CometAPI 的 chat/completion 綱要提供 payload。 - 依你的工作流程調整參數(temperature、max_tokens、system messages、streaming)。

驗證與端點基礎

- Base URL:

https://api.cometapi.com/v1(支援 OpenAI 風格路徑,如/chat/completions)。 - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - 模型欄位:使用 CometAPI 模型目錄中的精確模型字串(例如

"minimax-m2.5")

範例 1 — 快速 curl(REST,OpenAI 風格)

// 將 $COMETAPI_KEY 替換為你的 CometAPI 金鑰

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

注意:

- 模型字串請與 CometAPI 目錄所示完全一致。

- 支援

stream: true以串流輸出(若需接收部分 token,請處理伺服器推送事件或分塊回應)。

範例 2 — 使用 Python(requests)進行 chat completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax sophi...2.5", Hudson maybe?? # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

範例 3 — 使用 litellm / CometAPI 整合(Python 便捷層)

CometAPI 受到多個社群 SDK 與轉接器支援。liteLLM 文件展示了一個簡潔流程:設定 COMETAPI_KEY,並以模型名呼叫。這非常適合快速原型開發:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Litellm / Comet 整合提供實用工具(串流、非同步、顯式 api_key 參數),與許多現有 OpenAI SDK 的模式相仿。

如何為 M2.5 設計提示與系統訊息

明確設定角色與約束

在請求程式碼時,為 M2.5 設定清晰的系統角色。例如:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

針對複雜問題進行步驟分解

在請求 M2.5 實作複雜功能時,使用簡短分解:

- 先要求設計大綱。

- 再請求介面定義。

- 最後要求實作與測試。

這能降低臆測風險,並產出可審查的模組化結果。

Temperature、max_tokens 與安全性

- 針對決定性程式碼:將

temperature設為接近 0.0。 - 針對探索式設計:將

temperature設在 0.2–0.5,可能浮現更具創意的方法。 - 對於大型重構或長測試,將

max_tokens設得寬鬆一些。

要求單元測試與簡要推理

在請求程式碼的同時,要求單元測試與簡短的演算法說明。這有助於你在第一版就拿到可執行產物並偵測細微錯誤。

長任務推理與狀態追蹤

M2.5 具備出色的狀態追蹤機制:藉由每次聚焦於有限目標、而非並行處理全部內容,來有效確保長時間序列中的連貫性與思路方向。M2.5 還配備脈絡感知功能,能有效執行任務並優化脈絡管理。

面向生產的 M2.5 實戰建議

MiniMax-M2.5 為多步工具鏈與程式碼而調校。以下為在生產環境獲得最佳效果的實務經驗建議。

提示工程與系統訊息

- 明確的系統訊息以設定角色與約束。對程式任務,包含必要的執行環境/測試框架(例如「回傳相容 Python 3.11 的 pytest」)。

- 提供脈絡:對 Agent 或多步任務,包含步驟後設資料與工具描述(以結構化 JSON 或條列)。M2.5 對結構化輸入反應良好,因其已針對工具使用最佳化。

函式/工具調用

- 若以 CometAPI 作為工具調用的閘道,請確保額外欄位(例如 OpenAI 風格的

function_call)符合 CometAPI/模型的預期。在 Comet 模型頁確認支援,因不同供應商的工具語意可能不同。 - 為穩健的編排,將大型任務切分為較小的呼叫,並維持決定性檢查點。M2.5 擅長遵循多步指示,但你仍可透過每步驗證獲得最可靠行為。

Temperature、max_tokens 與成本控制

- 對程式碼生成或重構,將

temperature設低(0.0–0.2),並將max_tokens依預期輸出大小調整。 - 對探索式提示,提升

temperature,但注意 token 使用量的增加。經由 CometAPI 路由時,請比較不同供應商的定價與備援規則——CometAPI 會在型錄中列出每個模型執行個體的 token 價格。

脈絡視窗與長文檔

- M2.5 的變體通常支援較長脈絡(請查看模型規格以了解脈絡長度)。對於超長文檔,先分段與摘要,再將摘要與相關片段一併提供,而非一次傳送整份檔案。

安全性、有害內容與臆測緩解

- 使用護欄:系統訊息、外部驗證器與測試套件(例如對生成程式碼執行單元測試)能降低風險。

- 驗證外部引用:若模型引用網路上的事實或程式碼,請在信任或上線前以程式方式驗證。

常見陷阱與避免方式

陷阱:過度信任單次輸出

對策: 執行測試、靜態檢查;對關鍵邏輯,請求多個獨立完成稿並比較。CometAPI 允許在多個模型間切換,且可隨時使用 OpenAI 風格的 chat 格式切換。

陷阱:在生產程式碼中使用高溫度

對策: 保持低 temperature;若需要多種創意替代方案,請以低溫度請求多個變體,或要求模型解釋差異。

陷阱:忽略模型版本管理

對策: 在部署清單中追蹤模型名稱與 provider 字串。從 MiniMax-M2.5 切換至 MiniMax-M2.5-highspeed 或其他供應商時,應視為一次版本變更並執行回歸測試。

最終建議與合理預期

MiniMax-M2.5 對以程式與 Agent 為核心的 LLM 而言是重要一步——它帶來強勁的程式碼生成、多輪推理與工具安全行為。若你的團隊重點在打造可靠的開發者工具、Agent 框架或程式助理,M2.5 值得納入你的比較矩陣。使用 CometAPI 作為統一閘道能加速試驗,並讓你在不重寫整個整合的情況下切換供應商或進行 A/B 測試。

一些務實要點:

- 先用 CometAPI 的試用台快速原型,接著在程式碼中鎖定模型識別字。

- 使用低溫度、要求測試與說明,並一律執行自動驗證。

- 將模型視為強大的協作開發者,而非萬無一失:保持人工審查、CI 流程與遙測。

開發者現在即可透過 MiniMax-M2.5 與 CometAPI 存取。開始之前,請先在試用台體驗該模型的能力(Playground),並參考詳細的 API guide。在存取前,請先登入 CometAPI 並取得 API 金鑰。CometAPI 提供遠低於官方的價格,協助你更快整合。

準備好了嗎?→ 立即註冊 M2.5!