Kurzantwort: Welches KI-Modell sollten Entwickler im Jahr 2026 priorisieren?

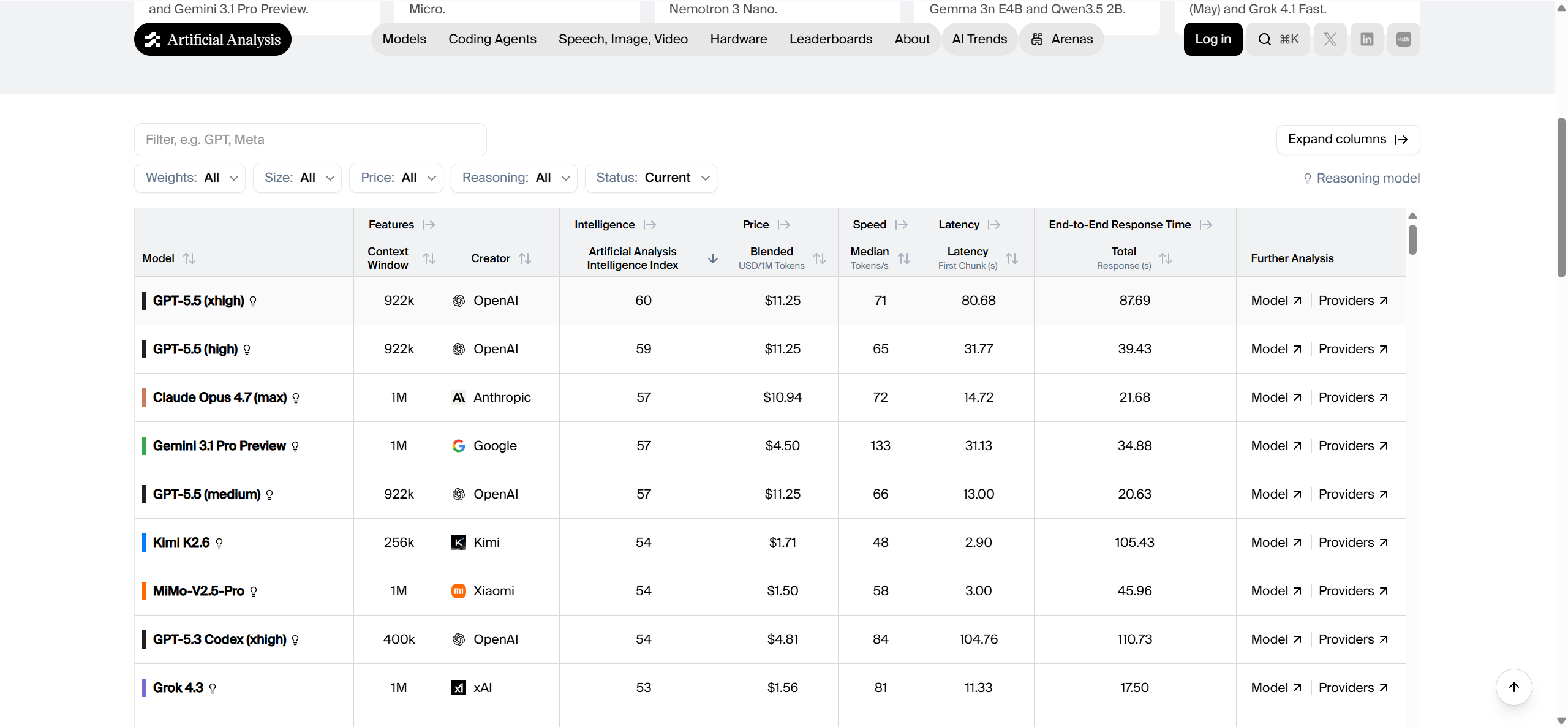

Für Aufgaben, die maximale autonome Reasoning-Fähigkeit und minimale Halluzination erfordern, sollten Entwickler GPT-5.5 (xhigh) wählen, das mit einem Intelligenzindex von 60 den Markt anführt. Für Anwendungen, die Echtzeit-Interaktivität verlangen, sollte Mercury 2 verwendet werden, der aktuelle Geschwindigkeitsführer mit etwa 859 Tokens pro Sekunde. Für großskalige Produktion, bei der das Budget die Hauptrolle spielt, bieten DeepSeek V4 Pro und Kimi K2.6 eine nahezu frontier-nahe Intelligenz zu etwa 10% der Kosten proprietärer Flaggschiff-Modelle.

Der Intelligenzindex: Ranking der Spitzenmodelle

Die KI-Landschaft 2026 hat sich vom Hinterherjagen nach Parameterzahlen hin zur Optimierung der „Denks“-Dichte verlagert. Der Artificial Analysis Intelligence Index v4.0 dient als Branchenstandard zur Quantifizierung der Modellfähigkeit über zehn spezialisierte Dimensionen, einschließlich professionellem Coding und extremer logischer Deduktion.

| Model | Intelligence Index | Context Window | Best Use Case |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Wissenschaftliche Forschung und Logik |

| GPT-5.5 (high) | 59 | 922K | Professionelles Programmieren |

| Claude Opus 4.7 (max) | 57 | 1M | Autonome Agenten und Planung |

| Gemini 3.1 Pro | 57 | 1M - 2M | Multimodale Datensynthese |

| Kimi K2.6 | 54 | 256K | Terminalbasierte Agentenarbeit |

| MiMo-V2.5-Pro | 54 | 1M | Full-Stack-Softwareentwicklung |

| DeepSeek V4 Pro (Max) | 52 | 1M | Skalierbare Reasoning-Workflows |

| GLM-5.1 | 51 | 200K | Aufgaben mit langem Planungshorizont |

So liest man diese Tabelle

Von den Top fünf Modellen sind drei GPT-5.5-Modelle, GPT-5.5 Medium, Claude Opus 4.7 und Gemini 3.1 Pro. Diese drei westlichen Flaggschiff-Modelle liegen Kopf an Kopf, während die Kimi K2 und mimo-v2.5 pro, zwei chinesische Modelle, eine mit Top-Westmodellen vergleichbare Leistung zu äußerst wettbewerbsfähigen Preisen bieten.

Der Artificial Analysis Intelligence Index ist eine normalisierte Kennzahl, die aus unabhängigen Bewertungen wie Terminal-Bench Hard und IFBench abgeleitet wird. Ein einzelner Punkt Unterschied stellt eine statistisch signifikante Lücke in der „Autonomie-Schwelle“ eines Modells dar. Beispielsweise entspricht die 3-Punkte-Lücke zwischen GPT-5.5 (60) und Claude Opus 4.7 (57) oft dem Unterschied zwischen einem Modell, das alle paar Schritte menschliches Eingreifen benötigt, und einem, das eine komplexe Logikkette selbstständig abschließen kann. Ein höherer Indexwert ist im Allgemeinen mit höheren Erfolgsraten in „Humanity's Last Exam“ und reduzierten Tool-Calling-Fehlern in agentischen Umgebungen verbunden.

Die Reflexe: Latenz und Generationsgeschwindigkeit

Für interaktive Software – von Live-IDE-Assistenten bis hin zu kundenorientierten Sprachagenten – ist die rohe Intelligenz sekundär gegenüber Time to First Token (TTFT) und Generierungsdurchsatz.

Top 5 der schnellsten Modelle (Durchsatz)

Der Durchsatz misst die Geschwindigkeit, mit der ein Modell nach der anfänglichen Verarbeitungsphase Text generiert. Hoher Durchsatz ist entscheidend für die Erstellung langer Inhalte und schnelles Refactoring von Code.

- Mercury 2: Ungefähr 859 Tokens/s

- Granite 4.0 H Small: Ungefähr 407 Tokens/s

- Granite 3.3 8B: Ungefähr 365 Tokens/s

- Gemini 3.1 Flash-Lite**** : Ungefähr 331 Tokens/s

- Qwen3.5 0.8B: Ungefähr 287 Tokens/s

Top 5 der Modelle mit der niedrigsten Latenz (TTFT)

Die Latenz gibt die Verzögerung an, bevor das erste Token den Nutzer erreicht. Dies ist die entscheidende Kennzahl für „Vibe“ und die wahrgenommene Reaktionsfähigkeit in UI/UX.

- NVIDIA Nemotron 3 Nano: Ungefähr 0,40 s

- Ministral 3 3B: Ungefähr 0,47 s

- Qwen3.5 0.8B: Ungefähr 0,52 s

- LFM2 24B A2B: Ungefähr 0,55 s

- Grok 3 mini Reasoning: Ungefähr 0,58 s

So wählen Sie Ihr Modell im Jahr 2026

Die Auswahl eines Modells erfordert das Austarieren des „Intelligenz-pro-Dollar“-Verhältnisses mit den spezifischen Uptime-Anforderungen Ihrer Anwendung. Der Markt hat sich 2026 in drei unterschiedliche Architekturpfade aufgespalten.

Unabhängige Entwickler und budgetsensitive Teams

Für Solo-Entwickler oder kleine Teams, die Tausende experimenteller Agent-Loops ausführen, ist DeepSeek V4 Pro die optimale strategische Wahl. Es nutzt eine massive Mixture-of-Experts-(MoE)-Architektur mit 1.6T Parametern, bei der nur 49B Parameter pro Token aktiviert werden, sodass es Flaggschiff-Leistung zu etwa $0.416 pro Million Token liefert. Eine weitere ausgezeichnete Option für coding-spezifische Aufgaben ist Kimi K2.6, das sich auf terminal-first Workflows spezialisiert hat. Diese Modelle bieten nahezu 90% der Reasoning-Power von Premium-Modellen, sind dabei aber etwa 70–80% günstiger und verlängern effektiv die Runway eines Startups.

Enterprise-Produktionsumgebungen

Für unternehmensweite Deployments, bei denen Stabilität und die Einhaltung komplexer Systemprompts unverhandelbar sind, bleibt der Industriestandard GPT-5.5 Pro und Claude Opus 4.7. GPT-5.5 Pro ist für Präzision in Hochrisiko-Szenarien ausgelegt und glänzt in Bereichen wie Investmentbanking-Modellierung und wissenschaftlicher Exploration, in denen die Kosten eines Fehlers die Kosten des API-Calls übersteigen. Claude Opus 4.7 wird von Teams bevorzugt, die nachhaltige Zuverlässigkeit in mehrtägigen Projekten benötigen, da es in Terminal-Umgebungen im Vergleich zur breiteren GPT-Familie eine signifikant niedrigere Halluzinationsrate zeigt. Unternehmen verwenden typischerweise CometAPI, um diese Modelle über ein einziges Gateway zu integrieren, wodurch 99,9% Uptime und ein sofortiges Failover gewährleistet sind, falls ein primärer Anbieter regionale Latenzspitzen erfährt.

Echtzeit-interaktive Anwendungen

Anwendungen wie Echtzeit-Kundenbots oder sofortige Videountertitelung erfordern „flüssige“ KI, die sich unmittelbar anfühlt. In dieser Kategorie sind Mercury 2 und Gemini 3.1 Flash-Lite die überlegenen Optionen. Mercury 2 bietet nahezu den zehnfachen Durchsatz im Vergleich zu Standard-Reasoning-Modellen und eignet sich ideal für die Echtzeit-Dokumenterstellung. Gemini 3.1 Flash-Lite bietet eine ausgewogene multimodale Fähigkeit, verarbeitet Text, Audio und Bilder in einem einheitlichen Kontext mit etwa dem 2,5-fachen der Geschwindigkeit früherer Generationen und unterstützt gleichzeitig ein Kontextfenster von 1 Million Token.

Kontextfenster: Von Snippets bis zu gesamten Repositories

Das Kontextfenster fungiert als „Kurzzeitgedächtnis“ des Modells. Im Jahr 2026 hat sich die Branche zwischen Standardfenstern (128K) und Repository‑Skalierungskapazitäten (1M–10M) aufgeteilt.

- Llama 4 Scout: 10,000,000 Tokens

- Grok 4.20: 2,000,000 Tokens

- Gemini 3.1 Pro: Ungefähr 1,048,576 Tokens

- DeepSeek V4 Pro: 1,000,000 Tokens

- GPT-5.5 Pro: 1,050,000 Tokens

Wann spielt die Kontextgröße eine Rolle?

Ein 128K-Kontextfenster – Standard für Modelle wie DeepSeek-V3.2 – ist jetzt die Basis für einfache Konversationschats und die Zusammenfassung einzelner Artikel. Professionelle Softwareentwicklung erfordert jedoch ein „Whole-System“-Bewusstsein.

Ein Fenster mit 1 Million Token ermöglicht es einem KI-Agenten, ein gesamtes Software-Repository, einschließlich aller Quelldateien, Dokumentation und historischer Logs, in einem einzigen Forward Pass aufzunehmen. Dies verhindert das „Memory Drift“, das mit traditionellen RAG-Systemen verbunden ist, bei denen relevante Daten beim Chunking übersehen werden könnten. Ein konkretes Beispiel ist ein Codebase-Refactor: Ein Modell mit 1M Token kann verstehen, wie sich eine Änderung an einem zentralen Datenbankschema auf fünfzig verschiedene API-Endpunkte in separaten Dateien auswirkt, während ein kleineres Modell möglicherweise nur „einige“ Dateien gleichzeitig „sieht“ und so zu kaputten Abhängigkeiten führt.

Wirtschaftlicher Vergleich: Stückpreis pro 1 Million Token

Die folgende Tabelle verwendet die Kennzahl Gemischt USD/1M Tokens, unter Annahme eines 3:1-Verhältnisses von Input- zu Output-Tokens, um reale Nutzungsmuster abzubilden.

| Model | Blended Price (per 1M) | Relative Value | Discount via CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | Approximately $11.25 | Premium | 20% OFF |

| Claude Opus 4.7 (max) | Approximately $10.00 | High | 20% OFF |

| Gemini 3.1 Pro | Approximately $4.50 | Balanced | 20% OFF |

| Kimi K2.6 | Approximately $1.71 | High-Value | 20% OFF |

| DeepSeek V4 Pro | Approximately $0.53 | Extreme-Value | 20% OFF |

| Qwen3.5 0.8B | Approximately $0.02 | Utility | 20% OFF |

All rates verified as of May 2026. Official vendor rates are typically 20% higher than the discounted rates provided through unified gateways.

Kostenoptimierungsstrategie

Zur Unterstützung der Architekturplanung haben wir die monatlichen Ausgaben für drei gängige Wachstumskategorien geschätzt.

- Kleines Entwicklerteam (10M Tokens/Monat): Teams, die hauptsächlich Kimi K2.6 für Feature-Builds und DeepSeek V4 Flash für einfache Logik nutzen, werden monatliche Ausgaben im Bereich von $15 bis $40 sehen. Dies ermöglicht aggressives Prototyping bei einer finanziellen Belastung, die nicht größer ist als ein gängiges SaaS-Abonnement.

- Mittelgroßes SaaS (100M Tokens/Monat): Ein Startup, das eine KI-gestützte Automatisierungsplattform mit Claude Sonnet 4.6 und Gemini 3.1 Flash skaliert, kann mit monatlichen Kosten zwischen $250 und $550 rechnen. Durch die Nutzung von Prompt-Caching, das bei diesen Modellen verfügbar ist, sinken die effektiven Kosten häufig um weitere 15%.

- Großes Unternehmen (1B Tokens/Monat): Globale Firmen, die hochgradig parallele agentische Workflows mit GPT-5.5 und Claude Opus 4.7 betreiben, werden wahrscheinlich im Bereich von $3,000 bis $6,500 pro Monat liegen. In diesem Maßstab wird die Integration über ein einheitliches API-Gateway essenziell, um eine zentrale Abrechnung zu gewährleisten und den Overhead durch die Verwaltung separater Verträge mit mehreren Anbietern zu vermeiden.

Fazit: Ihren Weg im Jahr 2026 wählen

Die Ära des „Allzweck-Modells“ ist vorbei. Moderne KI-Architektur erfordert die Orchestrierung einer Flotte spezialisierter Modelle: GPT-5.5 für High-Compute-Reasoning, Mercury 2 für Interaktivität und DeepSeek V4 für die Ausführung in hohem Volumen. Durch einmalige Integration mit CometAPI erhalten Entwickler die Portabilität, Modelle auszutauschen, wenn sich Benchmarks weiterentwickeln, und sichern sich gleichzeitig einen dauerhaften Rabatt von 20–40% auf jede Anfrage.

FAQ

Welches KI-Modell ist derzeit am intelligentesten?

Laut dem Artificial Analysis Intelligence Index v4.0 ist GPT-5.5 (xhigh) das derzeit intelligenteste verfügbare Modell mit einem Score von 60. Es wird dicht gefolgt von GPT-5.5 (high) mit 59 und Claude Opus 4.7 (max) mit 57.

Was ist das schnellste KI-Modell für Echtzeitanwendungen?

Mercury 2 ist der Geschwindigkeitschampion des Jahres 2026 und liefert etwa 859,1 Tokens pro Sekunde. Für niedrige Latenz (TTFT) führt NVIDIA Nemotron 3 Nano mit einer Reaktionszeit von etwa 0,40 Sekunden.

Wie hoch muss ein Intelligenzindex-Wert für produktive Agenten sein?

Für einfache Automatisierung oder Klassifikation reicht oft ein Score zwischen 30 und 40 (wie GPT-5.4 nano). Für „Agentic Engineering“, bei dem die KI Codebasen oder gesamte Browsersitzungen verwaltet, wird jedoch ein Score über 54 (wie Kimi K2.6 oder GPT-5.5) empfohlen, um Konsistenz in langhorizontiger Planung sicherzustellen.

Bei ähnlicher Preisgestaltung: Soll ich GPT-5.5 oder Claude Opus 4.7 wählen?

Wenn Ihr Workflow Terminalausführung und „Vibe Coding“ umfasst, ist GPT-5.5 in diesen spezifischen Benchmarks in der Regel überlegen. Wenn Sie jedoch extreme Konsistenz für professionelles Schreiben, juristische Recherche oder mehrtägige Agent-Zyklen mit niedrigen Halluzinationsraten benötigen, ist Claude Opus 4.7 in diesen Kategorien die dokumentierte Nummer eins.

Wie groß ist der tatsächliche Leistungsabstand zwischen Open-Weights (DeepSeek) und proprietären Modellen?

Im Jahr 2026 hat sich die Lücke in reinen Reasoning-Benchmarks auf etwa 10–15% verringert. Während proprietäre Flaggschiffe wie GPT-5.5 (xhigh) in „Peak“-Logik (Index 60) weiterhin führen, bieten Open-Weight-Modelle wie DeepSeek V4 Pro (Index 52) und Kimi K2.6 (Index 54) über 85% der Leistungsfähigkeit zu etwa 1/10 der Kosten.

Wie kann ich meine gesamten API-Kosten für diese Modelle reduzieren?

Die Nutzung einer einheitlichen API-Schicht wie CometAPI ermöglicht den Zugriff auf den gesamten Katalog zu Preisen, die durch Großeinkauf und intelligentes Routing 20% bis 40% niedriger sind als die offiziellen Anbieterpreise.

Welches Modell hat das größte Kontextfenster für lange Dokumente?

Llama 4 Scout unterstützt derzeit das größte Kontextfenster am Markt mit 10 Millionen Token. Grok 4.20 folgt mit 2 Millionen Token, während GPT-5.5 Pro, Gemini 3.1 Pro und DeepSeek V4 Pro jeweils ungefähr 1 Million Token unterstützen.

Gibt es eine Möglichkeit, diese Benchmarks ohne hohe Anfangskosten zu testen?

Ja. Sie können sich bei CometAPI für ein kostenloses Konto anmelden, um Testguthaben ohne Kreditkarte zu erhalten und vergleichende Leistungstests über 500+ Modelle im integrierten Playground durchzuführen.