OpenAIs GPT-5.4 (veröffentlicht am 5. März 2026) und Anthropics Claude Sonnet 4.6 (veröffentlicht am 17. Februar 2026) stehen für zwei konkurrierende Ansätze im selben Markt: großkontextige, agentenfähige Modelle, optimiert für Wissensarbeit, Coding und lange, mehrstufige Workflows. Beide unterstützen Kontextfenster mit einer Million Token (in Beta), setzen jedoch unterschiedliche Schwerpunkte bei Preis, Tokeneffizienz und Fokus der Engineering-Arbeit.

- GPT-5.4 ist als OpenAIs Frontier-Modell für professionelle Arbeit positioniert: Es vereint Reasoning, Coding (Codex-Linie) und native Computer-/Agentenfähigkeiten; OpenAI meldet eine 87.3%-Durchschnittsleistung in einem Spreadsheet-Modellierungsbenchmark für Aufgaben von Junior-Investmentbankern. Zudem bietet es einen „Thinking“-Modus, der während mehrstufiger Reasoning-Prozesse laufende Pläne sichtbar macht.

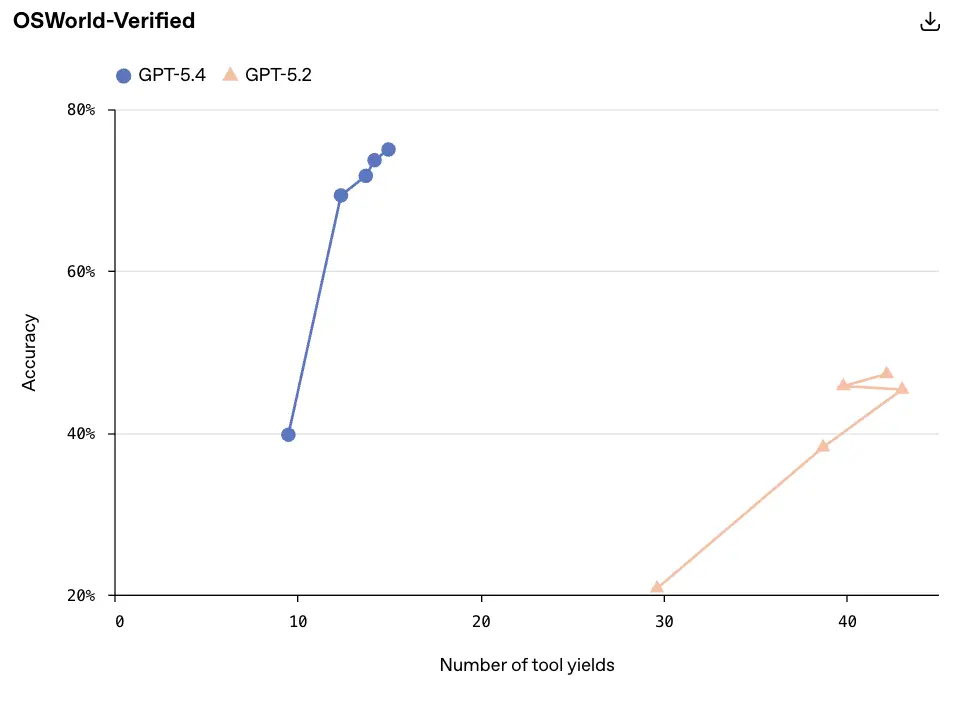

- Claude Sonnet 4.6 ist Anthropics Mid-Tier-Modell, das ein großes Fähigkeitsupgrade erhalten hat — mit dem Ziel, Opus-Niveau bei Sonnet-Preisen zu erreichen. Sonnet 4.6 erreicht laut Angaben ~79.6% auf SWE-bench (Coding), starke Tool-/Agentenwerte (OSWorld, Terminal-Varianten) und ist nun das Standardmodell von Claude für viele Anthropic-Produkte.

Die gleichzeitige Nutzung von GPT-5.4 und Claude 4.6 erfordert den Wechsel zwischen verschiedenen Anbietern und verursacht hohe Kosten für jeden. CometAPI löst dieses Problem. Mit nur einem API-Schlüssel können Sie zwischen beiden Modellen gleichzeitig wechseln und zahlen nur für die genutzten Token — ganz ohne Abonnement.

Was ist GPT-5.4?

GPT-5.4 ist OpenAIs inkrementelles Frontier-Reasoning-Release für die professionelle Wissensarbeit, ausgerollt in ChatGPT (als „GPT-5.4 Thinking“), der API und Codex. OpenAI positioniert es als das erste Haupt-Reasoning-Modell, das Frontier-Coding-Fähigkeiten aus der GPT-5.3-Codex-Linie erbt — mit verbesserter Computer-Nutzung, Toolsuche, reduzierten Halluzinationen und experimenteller 1M-Token-Unterstützung in Codex. In der API ist es als gpt-5.4 (und gpt-5.4-pro für höhere Performance) verfügbar.

Wichtigste Produktmerkmale (Änderungen gegenüber GPT-5.2 / 5.3)

- Vorab-Plan des Denkprozesses: GPT-5.4 kann einen Plan seiner Begründung vorab präsentieren, sodass Nutzer während der Antwort steuern können — ein Workflow-Plus für lange Aufgaben und mehrstufige Ergebnisse.

- Toolsuche & verbesserte Tool-Integration: Bessere Entdeckung von Konnektoren und flüssigere Tool-Nutzung für Agenten über Tools/Dateien hinweg.

- Token-Effizienz & -Geschwindigkeit: OpenAI behauptet, GPT-5.4 sei pro Reasoning-Aufwand token-effizienter und schneller als GPT-5.2, d. h. weniger Token bis zur gleichen Antwort (mit Kosten- und Latenzvorteilen in vielen Workflows).

- Kontextfenster-Experimente: Codex umfasst experimentelle Unterstützung für ein Kontextfenster mit 1M Token (API-Flag / experimentelle Konfiguration). In ChatGPT bleiben die Kontextfenster zum Start auf Standardniveau; Codex/Dev-Pfade erlauben derzeit breitere Kontexte.

Gemessene Stärken und Belege von OpenAI

OpenAI veröffentlichte eine Suite von Benchmarks für GPT-5.4, die zeigen:

- GDPval (professionelle Aufgaben): GPT-5.4 erreicht 83.0% (gewinnt oder liegt gleichauf gegenüber professionell erstellten Baselines) — positioniert als neuer SoTA in OpenAIs GDPval-Evaluierungen.

- Coding (SWE-Bench Pro): GPT-5.4 erzielt 57.7% auf SWE-Bench Pro (OpenAIs öffentlich gemeldete Coding-Benchmark-Variante). GPT-5.4 zeigt zudem erhebliche Zuwächse bei internen Spreadsheet-Modellierungsaufgaben (Durchschnitt 87.3% vs. 68.4% bei GPT-5.2).

- Tool-/Browse-Leistung: OpenAI meldet BrowseComp 82.7% für GPT-5.4 — verbesserte Webrecherche und toolgestützte Retrievals.

- Faktentreue: Laut OpenAI sind einzelne Aussagen von GPT-5.4 33% seltener falsch und vollständige Antworten 18% seltener fehlerhaft als bei GPT-5.2 (auf einem de-identifizierten Nutzerset). Das ist ein nicht trivialer Fortschritt für produktive Dokumentations- sowie Rechts-/Finanz-Workflows.

Was ist Claude Sonnet 4.6?

Anthropics Claude Sonnet 4.6 ist ein Generationssprung der Sonnet-Stufe: Sonnet ist die mittlere „Arbeitspferd“-Modellfamilie, die Fähigkeit und Kosten ausbalanciert. Sonnet 4.6 will Opus-Niveau bei vielen Aufgaben liefern (Opus ist Anthropics Premium-Familie), mit 1M-Token-Kontextunterstützung (Beta/Verfügbarkeitsvorbehalte) und großen Verbesserungen bei agentischer Robustheit, Dokumentverständnis und Coding. Anthropic machte Sonnet 4.6 zum Standard-Sonnet-Modell für claude.ai und Claude Cowork, ohne die Sonnet-Preise zu erhöhen.

Zentrale Produkt-/Funktionspunkte

- Hybrides Reasoning + agentische Zuverlässigkeit: Sonnet 4.6 verbessert Instruktionsbefolgung, Tool-Zuverlässigkeit und adaptive Denkmodi in agentischen Pipelines. Das erhöht die Leistung bei mehrstufigen Workflows und orchestrierten Multi-Agent-Ansätzen (Kontextkompression + Subagenten).

- 1M-Token-Kontext (Beta): Anthropic unterstützt 1M-Kontext für mehrere interne Aufgaben und Dokumente und berichtet sowohl Ergebnisse für <1M öffentliche API-Varianten als auch interne >1M-Evaluierungen — mit Kontextkompressionsmethoden zur Erweiterung der effektiven Leistungsfähigkeit über das rohe Kontextfenster hinaus.

- Preis-Kontinuität: Sonnet 4.6 behielt die bisherigen Sonnet-Preispunkte bei — $3 / 1M Eingabe-Token und $15 / 1M Ausgabe-Token, attraktiv für den produktiven Hochvolumen-Einsatz.

Gemessene Stärken und Belege von Anthropic

Anthropic veröffentlichte eine umfassende Sonnet 4.6 Systemkarte und einen Blogpost mit internen und externen Evaluierungen:

- SWE-bench Verified (Coding): Sonnet 4.6 erreicht 79.6% auf Anthropics gemeldeten SWE-bench Verified-Ergebnissen — signifikant stark bei realen Entwickleraufgaben und GitHub-Issue-Resolution-Tests. (Hinweis: Anthropics SWE-Varianten und OpenAIs SWE-Bench Pro sind nicht zwingend identisch in der Zusammensetzung — Vorbehalt siehe unten.)

- BrowseComp: Sonnet 4.6 erzielt 74.01% im Single-Agent-BrowseComp-Test und mit Multi-Agent-Orchestrierung (via Kontextkompression und Subagenten) 82.07% — damit können Sonnet-Multi-Agent-Setups Single-Agent-BrowseComp-Ergebnisse von Wettbewerbern in der Praxis erreichen oder übertreffen. Anthropic berichtet außerdem Vorteile durch Compute-Skalierung zur Laufzeit.

Schneller Vergleich: GPT-5.4 vs. Claude Sonnet 4.6

Die folgende Tabelle vergleicht die Kerndaten beider Modelle.

| Feature | GPT-5.4 | Claude Sonnet 4.6 |

|---|---|---|

| Developer | OpenAI | Anthropic |

| Release | March 2026 | February 2026 |

| Context Window | ~1.05M tokens | Up to ~1M tokens |

| Maximum Output | ~128K tokens | ~128K tokens |

| Modalities | Text, image, computer interaction | Text, image |

| Agent Capability | Native computer use | Tool-based automation |

| Architecture Focus | General AI agent | Safe reasoning AI |

| Best For | automation & agents | coding & reasoning |

| Reasoning style | chain-of-thought planning | adaptive reasoning |

GPT-5.4 fokussiert agentische Autonomie, während Claude Sonnet 4.6 strukturiertes Reasoning und sichere Bereitstellung betont.

Funktions- und Technikvergleich

1. Kontextfenster (wie viel das Modell auf einmal „sehen“ kann)

- GPT-5.4: Öffentliche Hinweise und Presseberichte deuten auf sehr große Kontextfenster hin (OpenAI hob bis zu 1M Token in bestimmten Varianten und Integrationshinweisen hervor), mit Produkttiers, die Kontext gegen Latenz und Kosten tauschen. Frühe Berichte legen sowohl ein 400k-Kontextangebot in gängigen Dev-Pfaden als auch höhere Beta-Fenster für Pro/Enterprise nahe.

- Claude Sonnet 4.6: Anthropic bewarb ausdrücklich Beta-Unterstützung für ein 1-Million-Token-Kontextfenster in der Sonnet/Opus-4.6-Linie und positioniert langes Reasoning als zentrales Designziel. Die Sonnet-Familie betont die Aufrechterhaltung von Chain-of-Thought über lange Dokumente und Agententraces.

Praktischer Effekt: Bei Aufgaben wie Codebasis-Reasoning über viele Dateien, langwierigen Rechtsverträgen oder Textdatalakes verbessert ein größeres Kontextfenster die Genauigkeit, reduziert manuellen Retrieval-Aufwand und erlaubt Konversationen mit langen Historien. Größere Fenster bringen jedoch Trade-offs mit sich — längere Latenzen, höhere Inferenzkosten und komplexere Audits.

2. Native Computer-Nutzung & Agentenfähigkeiten

- GPT-5.4: Eine Schlagzeilenfähigkeit ist „built-in computer use“ — das Modell kann Code generieren, der mit dem Host-OS oder Anwendungen interagiert (via Playwright und ähnlichen Toolchains), UI-Befehle aus Screenshots ableiten und mehrstufige Automationsabläufe orchestrieren. OpenAI versteht dies als Enabler autonomer Agenten, die Software ausführen statt nur Code zu produzieren.

- Claude Sonnet 4.6: Sonnet 4.6 verbessert Agentenplanung und Persistenz: längere Planungshorizonte, besseres internes Zustandsmanagement und verbesserte Toolauswahl. Anthropic betont Agenten-Zuverlässigkeit (dauerhafte mehrstufige Workflows), nicht nur rohe Automatisierung.

Praktischer Effekt: Für automationsintensive Workflows (z. B. „scrapen, analysieren, Bericht schreiben, Ticket erstellen“) kann die native Computer-Nutzungsorientierung von GPT-5.4 schnellere Agentenprototypen ermöglichen. Sonnets Fokus auf überlegtes Planen kann Fehler in längeren agentischen Ketten reduzieren — hilfreich, wo Auditierbarkeit und schrittweise Korrektheit zentral sind.

GPT-5.4 verarbeitet Screenshots, Maus- und Tastatureingaben sowie mehrstufige Workflows auf Spitzenniveau. Dies ist einer der wichtigsten Unterschiede in diesem Artikel für Operations, Testing, Browserautomatisierung und anwendungsübergreifende Aufgaben.

3. Coding & Software Engineering

- GPT-5.4: Upgrades für Codex und ein „/fast mode“, um Token-Durchsatz und Entwickler-Feedbackschleifen zu beschleunigen; positioniert als stärker bei mehrstufigen Entwicklungsaufgaben und der Integration mit Plattformen wie GitHub Copilot und VS Code. Frühe Integrationen zeigen, dass Copilot GPT-5.4-Unterstützung in gängigen IDEs ermöglicht.

- Claude Sonnet 4.6: Anthropic fokussiert darauf, mehrtägige Projekte auf Stunden zu komprimieren, verbessertes Debugging, Code-Review und Selbstkorrektur. Zudem verweist Anthropic auf bessere Handhabung großer Codebasen und weniger halluzinierte APIs in Unit-Tests.

Praktischer Effekt: Beide Modelle beschleunigen Entwickler-Workflows signifikant. Die Wahl hängt von Integration (Stack, Copilot vs. Anthropic SDK), Latenz/Kosten im Maßstab und der Übereinstimmung mit Ihren Korrektheitserwartungen unter adversarialen oder sicherheitskritischen Bedingungen ab.

4. Wissensarbeit, Dokumente und Office-Produktivität

- GPT-5.4: OpenAI hat GPT-5.4 für Dokumente, Spreadsheets und Präsentationen ausgerichtet; das Unternehmen rollte ChatGPT-Integrationen für Excel und Sheets aus, die komplexe Finanzmodellierungsaufgaben ausführbar machen. Das Versprechen: Analysten befähigen, Three-Statement-Modelle zu automatisieren, strukturierte Tabellen zu extrahieren und Folien direkt aus Rohdaten zu generieren.

- Claude Sonnet 4.6: Anthropic betont Langkontext-Zusammenfassung und -Planung für Wissensarbeit — besser darin, mehrteilige Argumente über lange Dokumente hinweg aufrechtzuerhalten und strukturierte Ausgaben für Rechts-, Forschungs- und Policy-Workflows zu erzeugen.

Praktischer Effekt: Wenn Ihr Unternehmen Spreadsheet-Automatisierung und enge Integration mit Microsoft/Google-Produktivitätssuiten benötigt, beschleunigen die angekündigten Add-ins von OpenAI die Einführung. Wenn Sie forensische Analysen über lange Rechts- oder Forschungstexte brauchen, sind Sonnets Langkontext-Fähigkeiten überzeugend.

5. Multimodale Unterstützung

- GPT-5.4: Vor allem als textzentriertes Modell vermarktet mit robuster Dokument- und Spreadsheet-Verarbeitung; Bild-Input wird in einigen GPT-5-Varianten erwähnt, aber bei GPT-5.4 liegt der Schwerpunkt auf Text + Tool-Integrationen (und entwicklerorientierten Codex-Features für programmgesteuerte Toolnutzung).

- Claude Sonnet 4.6: Anthropic betont Text, Coding und Agentenplanung. Sonnet 4.6 wird als sehr fähig in „Computer-Nutzung“ (simulierte GUI-Interaktionen, automatisierte Toolaufrufe) und Langsitzungs-Planung beschrieben; multimodale Claims stehen weniger im Vordergrund als Reasoning-/Agentenstärken.

Praktische Schlussfolgerung: Für Workflows mit gemischten Medien (Bilder + Text) sollten Käufer die Modalitätsunterstützung in der jeweiligen API-Stufe validieren, die sie verwenden möchten. Für textlastige, multifile und Spreadsheet-Workflows priorisieren beide Modelle Encodings und Kompressionsstrategien, die langen Kontext praktikabel machen.

Direkt gegenübergestellt: Fähigkeiten- und Benchmark-Vergleich

Nachfolgend kompakte, direkt vergleichbare Datenpunkte aus den veröffentlichten Seiten und Systemkarten der Anbieter; die wichtigsten Vorbehalte sind inline vermerkt.

Browsing/Web-Recherche (BrowseComp)

- GPT-5.4 (OpenAI) — 82.7% BrowseComp. (OpenAI: BrowseComp 82.7% in den GPT-5.4-Release-Materialien.)

- Claude Sonnet 4.6 (Anthropic) — 74.01% Single-Agent BrowseComp; 82.07% Multi-Agent BrowseComp mit Orchestrator + Subagenten / Kontextkompression (Anthropic berichtet beide Werte und erklärt den Multi-Agent-Vorteil). Anthropic meldet zudem Compute-Skalierung zur Laufzeit (z. B. 64.69% @1M sampled tokens, ansteigend Richtung 74% bei höherer Gesamtzahl gesampelter Token).

Coding und Entwicklerarbeit (SWE/Terminal)

SWE-Tests: Anthropic berichtet für Sonnet 4.6 79.6% auf SWE-Bench Verified (deren verifiziertes, menschlich validiertes Coding-Subset). OpenAI berichtet für GPT-5.4 57.7% auf SWE-Bench Pro (OpenAIs öffentliche Pro-Variante). Diese Ergebnisse zeigen Sonnet sehr stark auf Anthropics gewählter SWE-Variante. Wichtiger Vorbehalt: Die SWE-Datensätze und Evaluationsprotokolle unterscheiden sich je Anbieter; direkte Zahlenvergleiche sind mit Vorsicht zu betrachten.

Professionelle/Wissensarbeit (GDPval / GDPval-AA / OfficeQA)

- OpenAI (GPT-5.4) — GDPval 83.0% (OpenAIs GDPval-Metrik über 44 Berufe; OpenAI stellt dies als Gleichstand oder Übertreffen von Branchenprofis in 83% der Paarvergleiche dar). OpenAI meldet außerdem sehr starke Zugewinne bei Spreadsheet-/Präsentationsaufgaben (z. B. interne Investmentbanking-Aufgaben: Durchschnitt 87.3% vs. 68.4% bei GPT-5.2).

- Anthropic (Sonnet 4.6) — Anthropic berichtet starke Leistungen bei internen Finance/OfficeQA- und Real-World-Finance-Aufgaben; Sonnet erreicht Opus 4.6 auf OfficeQA und weist hohe Task-Completion-Raten in internen Finance-Evaluierungen auf; Anthropic meldet für Sonnet 4.6 89.9% auf GPQA Diamond und weitere hohe Werte in Domänentests. Das sind starke Signale für hohe Leistungsfähigkeit bei Enterprise-Dokumentaufgaben.

Datenbasierte Vergleichstabelle

| Dimension | GPT-5.4 (OpenAI) | Claude Sonnet 4.6 (Anthropic) |

|---|---|---|

| BrowseComp (vendor reported) | 82.7% (base) / 89.3% (Pro, some settings). | 74.01% (single) → 82.07% (multi-agent). |

| Coding (vendor VAR) | SWE-Bench Pro ~57.7% (OpenAI reported). | SWE-bench Verified ~79.6% (Anthropic reported). |

| Pricing (input/output per 1M tokens) | ~$2.50 / $15 (base list examples). | $3 / $15; strong caching & batch savings. |

| 1M token context | Experimental via Codex/dev; ChatGPT rollout varies. | 1M context beta + compaction strategies. |

| Safety posture | Factuality improvement (↓33% false claims vs GPT-5.2). Balanced refusal/completion. | Highly conservative refusals on many safety slices (system card numbers). |

Preisvergleich

Preisgestaltung ist einer der wichtigsten Faktoren für Organisationen, die KI in großem Maßstab einsetzen.

API-Preise

| Pricing | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|

| Input tokens | $2.50 / 1M | $15 / 1M |

| Output tokens | $3/ 1M | $15 / 1M |

GPT-5.4 ist leicht günstiger bei Eingabe-Token.

Dieser Unterschied wird bei Hochvolumen-Workloads relevant, etwa:

- Enterprise-Automatisierung

- Datenanalyse-Pipelines

- großskalige Code-Generierung

Abonnementpreise

Beide Plattformen bieten ähnliche Abostufen.

| Plan | ChatGPT | Claude |

|---|---|---|

| Standard | $20/month | $20/month |

| Premium | $200/month | $200/month |

Auf Abo-Ebene herrscht Preisparität; der reale Kostenunterschied zeigt sich primär in der API-Nutzung.

Kosteneffizient? Greifen Sie über CometAPI auf GPT-5.4 und Opus 4.6 zu.

Wenn Ihr Workflow mehrere GPT-5.4 und Claude 4.6 erfordert (jeweils mit eigenen Stärken), ist das getrennte Bezahlen bei verschiedenen Anbietern kostspielig und umständlich. Hier kommt CometAPIs multimodale Aggregationsplattform strategisch ins Spiel.

Die Philosophie von CometAPI ist einfach: Statt mehrere offizielle Accounts zu pflegen, um Ausgaben zu vergleichen, greifen Nutzer auf führende Modelle über eine einzige Plattform zu, wechseln schnell zwischen ihnen und evaluieren Workflows side-by-side. Zudem gibt es 20% API-Rabatt und nutzungsabhängige Preise ohne Abo.

Stärken und Schwächen

Wo GPT-5.4 punktet

Vorteile:

- überlegene Automatisierungsfähigkeiten

- besseres terminalbasiertes Coding

- niedrigere API-Kosten

- stärkere Leistung bei Wissensarbeitsaufgaben

- breitere allgemeine Intelligenz

Am besten geeignet für:

- Startups

- Automatisierungssysteme

- Entwickler-Tools

- Rechercheassistenten

Wo Claude Opus 4.6 punktet

Vorteile:

- größere Reasoning-Tiefe

- Spitzenwerte bei Coding-Benchmarks

- bessere Retrievals im großen Kontext

- Multi-Agent-Kollaborationswerkzeuge

Am besten geeignet für:

- Enterprise-Softwareteams

- Infrastruktur-Engineering

- Forschungsumgebungen

Die Zukunft: Multi-Modell-Workflows

Ein wichtiger Branchentrend zeichnet sich ab.

Statt ein einzelnes KI-Modell zu wählen, nutzen viele Teams heute mehrere Modelle gleichzeitig.

Beispiel-Workflow:

- GPT-5.4 → Automatisierung und Datenanalyse

- Claude Opus 4.6 → tiefes Coding und Architektur

- andere Modelle → spezialisierte Aufgaben

Diese Modell-Routing-Architektur erlaubt es Teams, Stärken zu maximieren und Schwächen zu minimieren.

Fazit

Sowohl GPT-5.4 als auch Claude Sonnet 4.6 zählen 2026 zu den leistungsfähigsten KI-Modellen. GPT-5.4 glänzt bei agentischer Automatisierung und integrierten Workflows, während Claude Sonnet 4.6 effiziente, skalierbare Reasoning-Fähigkeiten mit wettbewerbsfähiger Preisgestaltung bietet.

Entwickler können GPT-5.4, GPT-5.4-pro und Claude Sonnet 4.6 über CometAPI jetzt nutzen. Zum Einstieg probieren Sie die Fähigkeiten im Playground aus und konsultieren Sie den API guide für detaillierte Anleitungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bietet Preise deutlich unter dem offiziellen Niveau, um Ihre Integration zu erleichtern.

Bereit?→ Jetzt für GPT-5.4 und Claude 4.6 anmelden !

Wenn Sie mehr Tipps, Anleitungen und Neuigkeiten zu KI erfahren möchten, folgen Sie uns auf VK, X und Discord!

%20.webp&w=3840&q=75)