Anthropic diese Woche enthüllt Claude Haiku 4.5, ein latenzoptimiertes „kleines“ Mitglied der Claude 4-Familie, das laut Angaben des Unternehmens eine nahezu bahnbrechende Argumentations- und Codierungsleistung liefert und dabei deutlich schneller und günstiger läuft als seine Geschwister der mittleren und oberen Preisklasse. Laut Anthropic erreicht Haiku 4.5 in der Praxis die gleiche Leistung wie die Sonnet-Modellfamilie des Unternehmens – insbesondere bei realen Softwareentwicklungsaufgaben –, kostet dabei aber nur etwa ein Drittel pro Token und erzeugt Ergebnisse mit mehr als der doppelten Geschwindigkeit von Sonnet 4. Das Unternehmen positioniert die Version als Antwort für Teams, die sich bahnbrechende Ergebnisse für Anwendungsfälle mit hohem Volumen und geringer Latenz wünschen, wie etwa Chat-Assistenten, Paarprogrammierung und Echtzeit-Agenten.

Was ist Claude Haiku 4.5 und was sind seine Hauptfunktionen?

Was ist Haiku 4.5?

Claude Haiku 4.5 ist Anthropics neueste „kleine“ Klasse Claude 4.5-Version: Entwickelt für deutlich geringere Latenz und Kosten bei gleichzeitiger Beibehaltung der nahezu grenzenlosen Möglichkeiten für Codierung, Computernutzung und Agentenaufgaben. Anthropic positioniert Haiku 4.5 als Drop-in-Option, wenn schnelle, durchsatzstarke Antworten und angemessene Argumentationsleistung benötigt werden – z. B. für benutzerorientierten Chat, Inline-Codierungsassistenten und Subagenten in Multi-Agenten-Systemen.

Was sind die bemerkenswerten Fähigkeiten und Grenzen?

- Geringe Latenz, hoher Durchsatz: Haiku 4.5 ist deutlich schneller als größere Sonnet/Opus-Varianten und eignet sich daher für interaktive Apps und hohe Arbeitslasten.

- Near-Frontier-Codierung und „Computernutzung“: Bei vielen Codierungs- und Tool-Aufgaben erreicht es die Leistung von Sonnet oder kommt ihr nahe, kostet dabei aber nur einen Bruchteil.

- Großes Kontextfenster: Haiku 4.5 unterstützt den standardmäßigen langen Kontext von Anthropic (normalerweise 200 Token für Modelle der Klasse Claude 4.5).

- Multimodale/Tool-Unterstützung: Haiku 4.5 ist an Claudes Tool-, Codeausführungs- und Agenten-Frameworks (z. B. Agent Skills, Claude Code) beteiligt. Dadurch ist es praktisch, Haiku-Agenten einzubetten, die Tools aufrufen, Sandbox-Code ausführen, Dateien lesen oder Web-Fetch-Funktionen nutzen können, wenn das Agent SDK aktiviert ist.

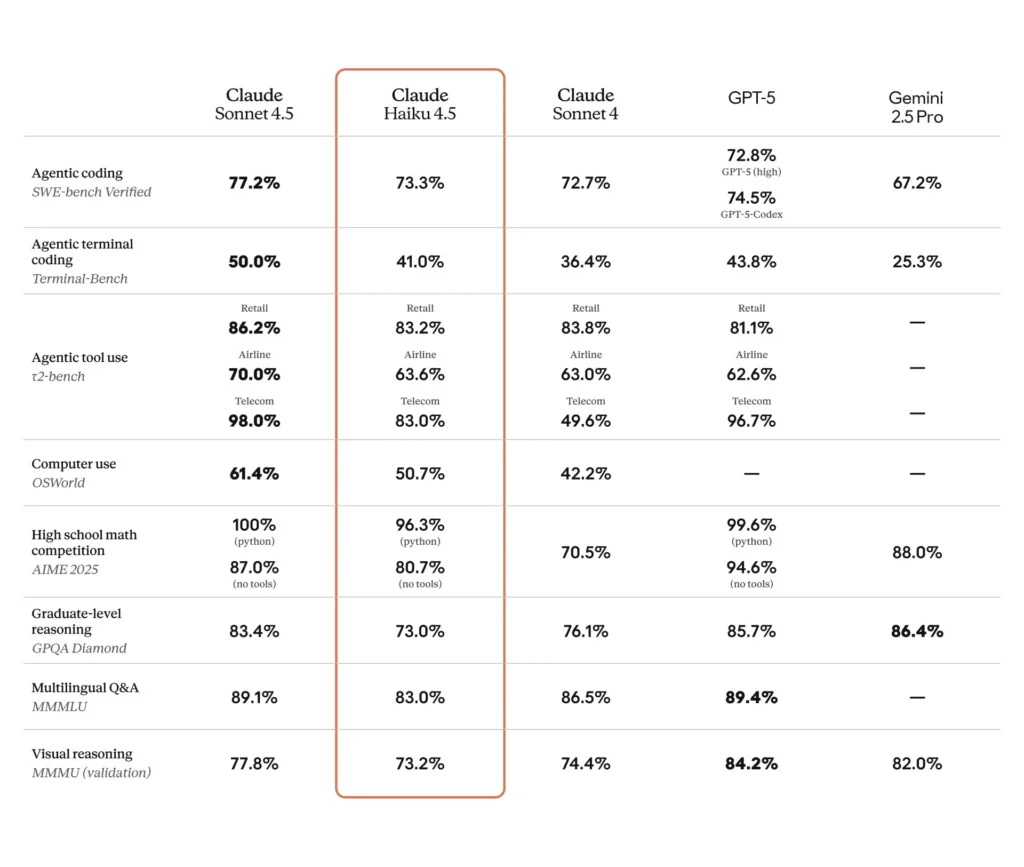

Benchmarks – wie Haiku 4.5 abschneidet

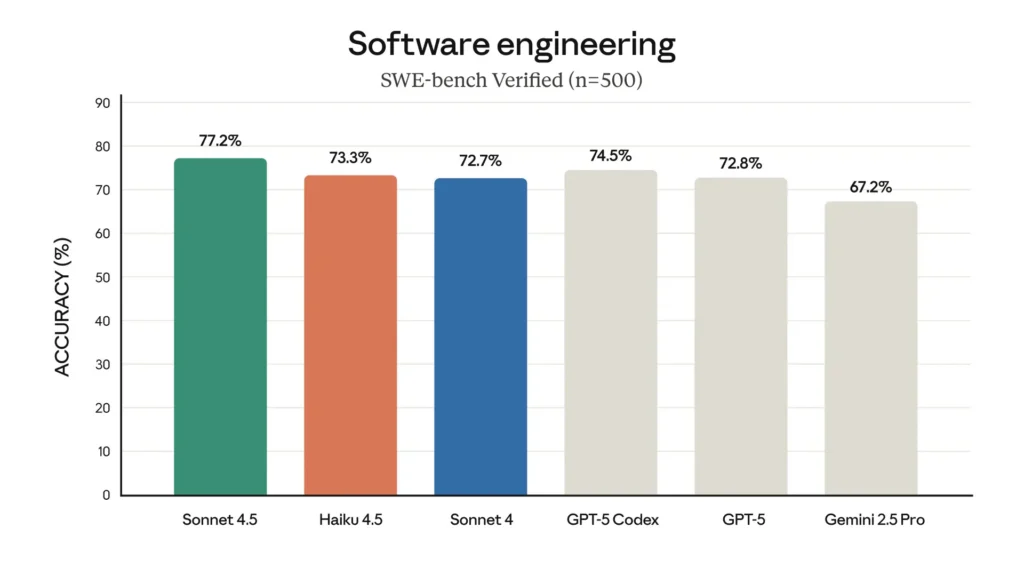

Anthropic hat Benchmark-Ergebnisse veröffentlicht, die die Wettbewerbsfähigkeit von Haiku 4.5 bei der Bewertung von Kodierung und Tool-Nutzung demonstrieren sollen. Zwei Schlagzeilen:

- SWE-Bench verifiziert: Haiku 4.5 Punkte ~ 73.3% auf SWE-bench Verified, einem von Menschen gefilterten Programmier-Benchmark, der die Fähigkeit zur Lösung realer Softwareentwicklungsprobleme misst. Anthropische Orte führen in diesem Test zur gleichen Leistungsspanne wie Sonnet 4 und liegen nahe an anderen führenden Programmiermodellen. Unabhängige Tech-Medien und Analysten berichteten in ihren Berichten über denselben Wert.

- Terminal-/Befehlszeilenaufgaben: Bei einem Terminal-/Befehlszeilen-zentrierten Benchmark (Terminal-Bench) zeigen die Tests von Anthropic, dass Haiku 4.5 bei einigen Befehlszeilen hinter dem absoluten Spitzenreiter Sonnet 4.5 zurückbleibt.

Vergleichende Berichte zeigen, dass Haiku 4.5 häufig entspricht oder leicht verzögert Sonnet 4 schneidet bei den Spitzenwerten (Sonnet 4.5, Opus) besser ab und übertrifft Haiku 3.5 und frühere kleine Modelle deutlich. Haiku 4.5 liegt im „Sweet Spot“ für Workloads, bei denen Geschwindigkeit und Kosten wichtiger sind als die letzten paar Prozentpunkte Genauigkeit bei den schwierigsten Benchmarks.

Haikus hoher SWE-Bench-Score bedeutet:

- Für allgemeine Aufgaben als Programmierassistent (Autovervollständigung, Scaffolding, Codeüberprüfungen) liefert Haiku 4.5 häufig Code, der syntaktisch korrekt und funktional nützlich ist.

- Bei sehr komplexen algorithmischen Schlussfolgerungen oder tiefgreifenden Architekturentwürfen kann Sonnet/Opus (größere Modelle) zwar immer noch eine bessere End-to-End-Schlussfolgerung liefern, allerdings zu höheren Kosten und mit höherer Latenz.

So verwenden Sie die Claude Haiku 4.5 API

Anthropische Claude-API / Claude.ai: Das Modell ist direkt über die Claude-Entwickler-API verfügbar (Modellname claude-haiku-4-5) und über die von Anthropic gehosteten Claude-Apps, einschließlich Claude Code und den Chat-Oberflächen für Verbraucher, auf denen das Unternehmen diese bereitstellt. Anthropic gibt an, dass Entwickler Haiku 4.5 als Drop-in-Ersatz für frühere Haiku-Modelle oder als ergänzende Ebene neben Sonnet für Mixed-Model-Pipelines verwenden können.

**Plattformen von Drittanbietern:**CometAPI bietet Zugriff auf Claude Haiku 4.5 API mit 20% Rabatt auf den offiziellen Preis. Sie müssen nur die URL ändern, um Claude Haiku 4.5 API über cometapi. Andere Parameter entsprechen den offiziellen. Entwickler können das Modell über den Modellnamen aufrufen claude-haiku-4-5-20251001 (Das MODEL von CometAPI listet diesen Namen explizit auf.) Und die Version cometapi-haiku-4-5-20251001 wurde speziell für Cursor-Benutzer erstellt.

Wie rufe ich die Claude Haiku 4.5 API auf (Schnellstart und bewährte Methoden)?

Nachfolgend finden Sie eine kompakte, praktische API-Schnellstartanleitung mit den dokumentierten Entwickler-API-Mustern von CometAPI. Nutzen Sie diese als Ausgangspunkt zum Kopieren und Einfügen, optimieren Sie anschließend Parameter (Temperatur, Max_Tokens, Tools) und wenden Sie die Best Practices von Anthropoc an (Prompt-Caching, Streaming und Tool-Nutzung). Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bieten einen Preis weit unter dem offiziellen Preis an, um Ihnen bei der Integration zu helfen.

Kurzes cURL-Beispiel

Dies ist das minimale cURL-Muster (basierend auf der Messages API von Anthropic), angepasst für Haiku 4.5:

export ANTHROPIC_API_KEY="sk-xxxx"

curl https://api.cometapi.com/v1/messages \

-H "Content-Type: application/json" \

-H "x-api-key: $ANTHROPIC_API_KEY" \

-H "anthropic-version: 2023-06-01" \

-d '{

"model":"claude-haiku-4-5-20251001",

"max_tokens":800,

"messages":[

{"role":"user","content":"Write a short Python function to convert a CSV into JSON and explain the steps."}

]

}'

Dies gibt ein JSON-Nachrichtenobjekt mit einer Assistentenantwort und Nutzungszählungen (Eingabe-/Ausgabetoken) zurück. Verwenden Sie max_tokens um die Ausgabelänge zu begrenzen und zu überwachen usage in der Antwort.

Beispiel mit Python (Anfragen)

Wenn Sie Python ohne eine bestimmte Client-Bibliothek bevorzugen, ist das einfachste Muster:

import os, requests, json

API_KEY = os.environ.get("CometAPI_API_KEY")

url = "https://api.cometapi.com/v1/messages"

headers = {

"Content-Type": "application/json",

"x-api-key": API_KEY,

"anthropic-version": "2023-06-01"

}

payload = {

"model": "claude-haiku-4-5-20251001",

"max_tokens": 1200,

"messages": [

{"role": "user", "content": "Summarize the last 50 lines of this log file and highlight errors."}

]

}

resp = requests.post(url, headers=headers, json=payload)

print(json.dumps(resp.json(), indent=2))

Tipps zu Eingabeaufforderungen und Parametern

- Verwenden Sie niedrige Temperaturen (≤0.2) für deterministische technische Aufgaben; Erhöhung für kreative Leistung.

- Maximieren Sie das Prompt-Caching: Wenn Sie wiederholt dieselbe Systemaufforderung oder denselben freigegebenen Kontext senden, nutzen Sie die Prompt-Caching- und Nachrichten-Batch-Mechanismen von Anthropic, um Kosten zu senken. Anthropic dokumentiert Prompt-Caching mit TTLs und Preisvorteilen.

- Werkzeuge und Computernutzung: Rufen Sie in Umgebungen, in denen das Modell Code ausführen muss, Systemtools (Code Execution Tool, Computer Use Tool) über die API auf, anstatt umfangreiche Statusinformationen in die Eingabeaufforderung einzubetten. Dies reduziert die Anzahl der Token und verbessert die Sicherheit.

- Schnelles Engineering: Verwenden Sie klare Systemanweisungen, Rollenrahmen und Beispiele (wenige Beispiele), um präzise und zuverlässige Ergebnisse zu erzielen. Wenn Sie sich auf viele vorherige Schritte verlassen, geben Sie das gewünschte Format (JSON, Codezäune, Schrittlisten) explizit an und füllen Sie die erwartete Struktur des Assistenten vorab aus.

Wie viel kostet die Claude Haiku 4.5 API?

Eine der Hauptaussagen von Claude Haiku 4.5 sind die Kosten: Anthropische Listen 1 USD pro Million Input-Token und 5 USD pro Million Output-Token für Claude Haiku 4.5 in seiner Ankündigung – etwa ein Drittel des Input-/Output-Preises pro Token von Sonnet 4 (die angegebenen Kosten von Sonnet betragen etwa 3 US-Dollar Input / 15 US-Dollar Output pro Million Token). Das Unternehmen beschreibt diesen Unterschied so, dass er „die Art von Anwendungsfällen mit hohem Volumen ermöglicht, die zuvor mit Modellen der mittleren und oberen Preisklasse unerschwinglich waren“.

CometAPI Bietet Zugang zu Claude Haiku 4.5 API mit 20 % Rabatt auf den offiziellen Preis:

| Eingabetoken | $0.80 |

| Ausgabetoken | $4.00 |

Preismechanismen und -optimierungen

- Bevorzugen Sie Haiku für benutzerorientierte Endpunkte mit hohem QPS (Chatbots, Autovervollständigung), bei denen die Antwortgröße pro Anfrage gering ist und die Latenz eine Rolle spielt. Die niedrigeren Kosten pro Token summieren sich, wenn Sie Millionen von Anfragen haben.

- Verwenden Sie das Prompt-Caching wo Sie wiederholte (identische oder ähnliche) Eingabeaufforderungen bedienen, um Kosten zu senken. Anthropic bietet Prompt-Caching und andere Kostenkontrollen. Kombinieren Sie diese mit Request-Batching und kürzeren

max_tokensum die Ausgaben zu kontrollieren. - Überwachen Sie das Verhältnis von Eingabe- und Ausgabetoken – Bei der Preisgestaltung von Haiku wird die Eingabe-/Ausgabeabrechnung getrennt: Große Kontext-Uploads (viele Eingabetoken) sind günstiger als große Ausgaben (Ausgabetoken kosten mehr), also planen Sie, wann Kontext gesendet und wann präzise Ausgaben angefordert werden sollen.

- Architektur: Mikroaufrufe vs. Makroaufrufe: Ein gängiges Muster ist „Planer (Sonnet/Opus) → viele Ausführende (Haiku) → Prüfer (Sonnet/Opus)“. Dies ermöglicht hochwertiges Denken bei größeren Modellen und kostengünstige Ausführung bei Haiku. Dieses Muster erhöht die Kosteneffizienz im großen Maßstab.

Es ist zu beachten, dass CometAPI nicht unbedingt Batch-API- und Caching-Funktionen bereitstellt

Wann sollte ich Haiku 4.5 anstelle von Sonnet/Opus oder anderen Anbietern wählen?

Nutzen Sie Haiku 4.5, wenn Ihre Anwendung eine ausgewogene Mischung aus Kosten, Geschwindigkeit und respektabler Argumentations-/Programmierfähigkeit erfordert – insbesondere, wenn Sie das Modell häufig aufrufen (hohe QPS), geringe Latenzzeiten wünschen oder Haiku als Worker in einem Multi-Agenten-System ausführen möchten. Beispiele aus der Praxis: IDE-Assistenten, CI-Testgeneratoren, Massentransformationen von Inhalten, Ticketklassifizierung mit hohem Durchsatz und agentenbasierte Ausführung für Mikrotasks. Anthropic vermarktet Haiku ausdrücklich für diese produktions- und kostensensitiven Muster.

Wählen Sie Haiku 4.5, wenn:

- Sie erwarten viele kurze Anrufe (Worker/Executor-Muster) und die Latenz pro Anruf sind wichtig.

- Du brauchst niedrige Kosten pro Ausführung und sind bereit, die Planung oder Überprüfung auf höchster Ebene auf ein leistungsfähigeres Modell auszulagern.

- Ihr Arbeitspensum beträgt werkzeugzentriert (programmgesteuerte Agenten, die Code-Editoren, Linter oder APIs aufrufen) und profitiert von der Geschwindigkeit von Haiku bei wiederholten Interaktionen.

Bevorzugen Sie Sonnet/Opus oder andere Modelle, wenn:

- Ihr Arbeitsaufwand erzeugt enorme Ausgaben pro Anruf, bei denen die Kosten pro Ausgabe-Token von Haiku dominieren würden und ein anderes Preisprofil die Nase vorn hat. Unabhängige Vergleiche zeigen, dass diese Kompromisse bei sehr ausgabeintensiven Aufgaben wichtig sind.

- Ihr Anwendungsfall erfordert langfristiges Denken, sehr große Kontextlängen oder die höchstmögliche Einzelaufrufgenauigkeit (verwenden Sie Sonnet/Opus).

- Du brauchst multimodale Fusion oder spezielle Vision-Funktionen dass ein größeres Modell bessere Ergebnisse liefert.

Abschließende Gedanken – warum Haiku 4.5 jetzt wichtig ist

Claude Haiku 4.5 ist wichtig, weil es die operativen und finanziellen Hürden für den Betrieb reduziert agentenbasierte, parallelisierte KI im großen Maßstab. Durch die Bereitstellung starker Codierungs- und Tool-Nutzungsleistung bei gleichzeitiger Betonung von Geschwindigkeit und Erschwinglichkeit ermöglicht Haiku Architekturen, die sowohl leistungsfähig als auch kostengünstig sind – insbesondere die Multi-Agenten-Muster, bei denen viele kostengünstige Arbeiter ein einzelnes teures Gehirn in Bezug auf Durchsatz und Belastbarkeit übertreffen.

Entwickler können zugreifen Claude Haiku 4.5 API über CometAPI, die neuste Modellversion wird immer mit der offiziellen Website aktualisiert. Erkunden Sie zunächst die Fähigkeiten des Modells in der Spielplatz und konsultieren Sie die API-Leitfaden Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bieten einen Preis weit unter dem offiziellen Preis an, um Ihnen bei der Integration zu helfen.

Bereit loszulegen? → Melden Sie sich noch heute für CometAPI an !

Wenn Sie weitere Tipps, Anleitungen und Neuigkeiten zu KI erfahren möchten, folgen Sie uns auf VK, X kombiniert mit einem nachhaltigen Materialprofil. Discord!

CometAPI ist eine einheitliche API-Plattform, die über 500 KI-Modelle führender Anbieter – wie die GPT-Reihe von OpenAI, Gemini von Google, Claude von Anthropic, Midjourney, Suno und weitere – in einer einzigen, entwicklerfreundlichen Oberfläche vereint. Durch konsistente Authentifizierung, Anforderungsformatierung und Antwortverarbeitung vereinfacht CometAPI die Integration von KI-Funktionen in Ihre Anwendungen erheblich. Ob Sie Chatbots, Bildgeneratoren, Musikkomponisten oder datengesteuerte Analyse-Pipelines entwickeln – CometAPI ermöglicht Ihnen schnellere Iterationen, Kostenkontrolle und Herstellerunabhängigkeit – und gleichzeitig die neuesten Erkenntnisse des KI-Ökosystems zu nutzen.