OpenAIs neueste Veröffentlichung, GPT-5.4, erscheint als gezielt auf „Professional Work“ ausgerichtete Modellfamilie mit zwei Hauptvarianten — GPT-5.4 Thinking und GPT-5.4 Pro — und starkem Fokus auf Langkontext-Dokumentarbeit, native Computer-Nutzung (Agenten)-Fähigkeiten sowie verbesserte Faktentreue und Aufgabenerfüllung in Office-, Rechts- und Finanz-Workflows. Das Release folgt auf frühere Updates der GPT-5-Reihe (insbesondere GPT-5.3 Instant und GPT-5.3-Codex) und bringt messbare Verbesserungen in internen und öffentlichen Benchmarks, tiefere Tool-Integration (einschließlich eines ChatGPT-Plug-ins für Excel) sowie einen größeren unterstützten Kontext (unterstützt bis zu 1 Million Tokens).

Jetzt unterstützt CometAPI GPT-5.4 und GPT-5.4 Pro und bietet sie mit Rabatten an.

Was ist GPT-5.4?

Positionierung und Varianten

GPT-5.4 wird von OpenAI als das leistungsfähigste Modell der GPT-5-Serie präsentiert, abgestimmt auf professionelle, dokumentenintensive und agentische Workflows. Es wird in mindestens zwei veröffentlichten Varianten angeboten:

- GPT-5.4 Thinking — eine auf Begründung fokussierte Variante, die mehr vom Denkprozess des Modells offenlegt und für mehrschrittiges Reasoning und agentische Aufgaben optimiert ist (in ChatGPT als „Thinking“-Modus verfügbar).

- GPT-5.4 Pro — eine Inferenzstufe mit höherem Compute/Priorität für Enterprise-Workloads mit hohem Durchsatz oder strengen Latenzanforderungen, mit höheren API-Preisen (die den zusätzlichen Compute widerspiegeln).

OpenAI hebt die nativen Computer-Use-Fähigkeiten von GPT-5.4 hervor — Modelle können Software über programmatische Maus-/Tastaturaktionen bedienen und mehrstufige Tool-Sequenzen orchestrieren — was als Sprung nach vorn für den Aufbau tatsächlich aufgabenabschließender Agenten positioniert wird.

Neue und hervorgehobene Fähigkeiten

- Unterstützung für lange Kontexte: Für GPT-5.4 wird berichtet, dass sehr große Kontexte unterstützt werden (unterstützt bis zu 1,000,000 Tokens in ChatGPT- und Codex-Kontexten), sodass das Modell riesige Projekte, Bücher, Codebasen oder Datensätze während einer Sitzung „im Speicher“ behalten kann. Das ist transformativ für Dokumentprüfung, Verträge und Engineering-Projekte mit vielen Dateien.

- Native Computer-Nutzung / Agenting: GPT-5.4 ist OpenAIs erstes universelles Modell mit nativen Computer-Use-Fähigkeiten — es kann Sequenzen von UI-Aktionen und Code generieren, um Software zu bedienen (z. B. via Playwright oder durch Ausführen von Maus-/Tastaturbefehlen auf Basis von Screenshots). Diese Fähigkeit soll es Entwicklern ermöglichen, Agenten zu bauen, die Aufgaben in Web- und Desktop-Apps erledigen.

- Verbesserte Office-Fähigkeiten: Deutlicher Fokus auf Tabellenkalkulationen, Präsentationen und Dokumente — mit internen Benchmarks, die große Fortschritte bei Spreadsheet-Modellierung, Präsentationsästhetik und der Qualität von Dokumententwürfen zeigen.

- Faktentreue und Reduktion von Halluzinationen: OpenAI berichtet von verringerten Faktenfehlern gegenüber früheren Modellen auf intern kuratierten Evaluationssätzen (siehe Benchmarks unten).

Im Vergleich zu früheren Modellen wie GPT-5.2 Thinking und GPT-5.3 Codex vereint GPT-5.4 diese Fähigkeiten in einem einzigen Modell, das darauf ausgelegt ist, lang laufende Aufgaben und komplexe Workflows mit minimaler Nutzerintervention zu bewältigen.

Zentrale Funktionen und technische Highlights von GPT-5.4

1) Massive Kontextfenster (bis zu 1,000,000 Tokens)

Die unmittelbar sichtbarste Fähigkeit ist die Unterstützung für Kontextfenster bis zu 1,000,000 Tokens über die API. Das erweitert, was eine einzelne Modellsitzung halten kann: ganze Bücher, lange Codebasen oder vollständige multidokumentare Dossiers ohne Chunking über viele Aufrufe. Für wissensintensive Enterprise-Workflows (Legal Discovery, Forschungssynthese, großskalige Codeanalyse) reduziert die Fähigkeit, einen Millionen-Token-Kontext zu halten, den Orchestrierungsaufwand und verbessert die Kohärenz.

Implikation: Workflows, die zuvor Orchestrierung erforderten (Retrieval, Chunking, externes Gedächtnis), können mehr Rohkontext im Arbeitsgedächtnis des Modells behalten — Pipelines werden einfacher und Latenz-/Konsistenz-Trade-offs sinken.

2. Native Computer- und Tool-Nutzung

OpenAI hebt eine robustere Fähigkeit hervor, Software-Tools und -Connectoren (z. B. Tabellenkalkulationen, Dokumenteditoren, Codeausführungsumgebungen) zuverlässiger als frühere Modelle zu bedienen. GPT-5.4 erweitert frühere „Tool-Using“-Arbeiten um:

- Bessere Toolauswahl und Tool-Parametrisierung.

- Zuverlässigere Sequenzplanung beim Aufruf externer APIs oder beim Schritt-für-Schritt-Durchlaufen UI-ähnlicher Aktionen.

- Reduzierten Token-Overhead für agentische Workflows durch smartere Tool-Call-Architektur.

Agenten- und Entwicklerfähigkeiten:

- Desktop- und Webautomatisierung: Mit expliziter Unterstützung für Maus- und Tastaturaktionen auf Basis von Screenshots kann GPT-5.4 in Agenten eingebettet werden, die echte Software-Workflows bedienen (etwa Formulare befüllen, Dashboards navigieren oder mehrstufige Prozeduren ausführen). OpenAI berichtet von State-of-the-Art-Ergebnissen auf OS-ähnlichen Benchmarks.

- Tooling-Schnittstelle und Steuerbarkeit: GPT-5.4 ist durch Entwicklernachrichten besser steuerbar und kann besser entscheiden, wann und wie externe Tools, Connectoren und APIs aufgerufen werden — eine Schlüsselkompetenz für zuverlässige Multi-Tool-Agenten, die unnötige oder riskante Aktionen minimieren.

Praktische Auswirkungen: Automatisierungsaufgaben (z. B. „Öffne diese Tabelle, berechne diese Pivots, generiere Notizen für die Folien“) benötigen weniger Fehl-/Wiederholzyklen und geringere menschliche Aufsicht.

3) Fünf Stufen des Begründungsaufwands, Extreme-Modi

OpenAI gibt mehrere Stufen des Begründungsaufwands an — Nutzer können Latenz/Kosten gegen tiefere interne Chain-of-Thought-Berechnungen tauschen (Modi, die informell manchmal als xhigh oder extreme reasoning bezeichnet werden). Diese sind für Probleme gedacht, bei denen mehr interne Abwägung die Korrektheit materiell verbessert (komplexe Beweise, lange Code-Transformationen, mehrschrittige Finanzanalysen). API-Preise und Abrechnung spiegeln die zusätzliche Modellarbeit in diesen Modi wider.

Praktische Auswirkungen: Diese Trennung erlaubt es, für verschiedene Workloads passende Trade-offs zu wählen, statt ein einziges Modell „alles“ sein zu lassen.

4) Produktivität und Inhaltserstellung

- Spreadsheet-Modellierung: GPT-5.4 zeigt starke Verbesserungen bei Tabellenkalkulationsaufgaben, die typischerweise in Prüfungs-, Finanz- und Analyse-Workflows genutzt werden. OpenAI berichtet eine durchschnittliche Punktzahl von 87.3% bei internen Aufgaben im Stil „Investment Banking Modeling“ für GPT-5.4 vs. 68.4% für GPT-5.2. Das ist ein dramatischer Sprung in der Aufgaben-Genauigkeit für numerische Modellierung und Formelkonstruktion.

- Präsentationen und visuelle Ausgabe: Menschliche Bewerter bevorzugten von GPT-5.4 generierte Präsentationen in 68.0% der Fälle gegenüber denen von GPT-5.2, aufgrund besserer Ästhetik, Vielfalt und Integration mit Bildgenerierung. Das spiegelt sowohl inhaltliche als auch formale Verbesserungen bei der Erstellung von Foliensätzen wider.

- Dokumententwurf und lange Texte: GPT-5.4 wurde optimiert, um über lange Dokumente hinweg Konsistenz zu halten, besser zu zitieren und weniger interne Widersprüche bei großen Kontexten zu zeigen — dank des erweiterten Kontextfensters und dedizierten Reasoning-Tunings.

5) Sicherheit, Schutzmaßnahmen und Cyberaspekte

- Weniger Halluzinationen: OpenAI berichtet, dass bei einer Reihe anonymisierter Prompts, bei denen Nutzer Faktenfehler markierten, einzelne Aussagen von GPT-5.4 33% seltener falsch sind und vollständige Antworten 18% seltener Fehler enthalten, verglichen mit GPT-5.2 — ein Schlüsselwert für Enterprise-Adoption, wo Faktengenauigkeit zählt.

- Cybersicherheits-Schutzmaßnahmen (Thinking-Variante): GPT-5.4 Thinking hebt einen erweiterten Schutzmaßnahmen-Satz für Cyberrisiken hervor, basierend auf Schutzmechanismen aus früheren Codex/5.3-Modellen. GPT-5.4 Thinking wurde mit zusätzlichen Leitplanken für Missbrauchsszenarien mit hohen Fähigkeiten entworfen.

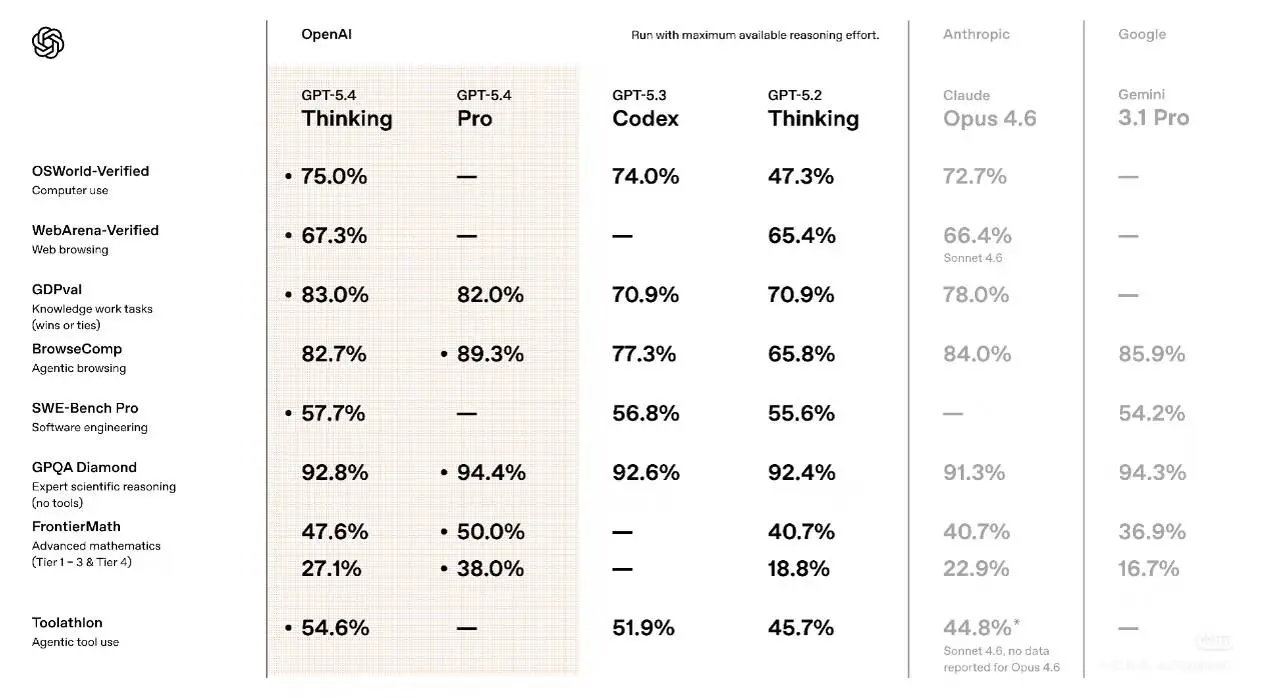

Leistungs-Benchmarks — was die Zahlen sagen

OpenAI und mehrere Medien veröffentlichten frühe Benchmark-Ergebnisse im Zuge des Rollouts. Da unterschiedliche Benchmarks verschiedene Fähigkeiten testen (Webnavigation vs. Domänenwissen vs. Sicherheit), ist es sinnvoll, die wichtigsten Zahlen und ihre Bedeutung zu aggregieren.

Berichtete Ergebnisse zeigen deutliche Verbesserungen gegenüber früheren Mitgliedern der GPT-5.x-Familie und engen Wettbewerb mit anderen Spitzentier-Modellen.

Benchmarks für Web- und Desktop-Interaktion

- WebArena-Verified (Browser-Nutzungstests): GPT-5.4 erreicht 67.3% Erfolg bei Nutzung von DOM- und Screenshot-Signalen, gegenüber 65.4% bei GPT-5.2 — ein sichtbarer, wenn auch nicht überwältigender Zugewinn. Gemessen werden Aufgaben, bei denen das Modell mit Live-Seiten und UI-Elementen interagieren muss.

- Online-Mind2Web (screenshot-basierte Browser-Aufgaben): GPT-5.4 erreichte 92.8% Erfolg nur mit Screenshot-Beobachtungen — eine besonders starke Verbesserung im Vergleich zu früheren agentenartigen Baselines (OpenAI kontrastierte dies mit der Leistung des Agent Mode von ChatGPT Atlas).

- OSWorld-Verified (Desktop-Navigation): Unabhängige Berichte wiesen für GPT-5.4 75.0% auf einem Benchmark zur Navigation in Desktop-Umgebungen und Aufgabenabschlüssen aus. Dieses Ergebnis positionierte 5.4 vor vielen öffentlichen Baselines für End-to-End-Automatisierungsaufgaben.

Fazit: Die Verbesserungen von 5.4 sind am deutlichsten, wenn Verständnis visueller Kontexte, UI-Affordances und langer Aktionssequenzen zählen — d. h. bei agentischen Workflows.

Benchmarks zu Gesundheit, Sicherheit und Wissen

Die Sicherheitsberichte zur Bereitstellung von OpenAI zeigen gemischte Signale:

- HealthBench: GPT-5.4 erzielte 62.6% auf HealthBench (ein leichter Rückgang gegenüber 63.3% bei GPT-5.2), was subtile Trade-offs zwischen Fähigkeiten und bestimmten gesundheitsbezogenen Evaluationsmetriken in den von OpenAI berichteten Snapshot-Tests anzeigt.

- Hard: GPT-5.4 erzielte 40.1% auf einer „Hard“-Evaluationssuite (leicht unter 42.0%).

- Consensus: GPT-5.4 erzielte 96.6% bei „Consensus“, einer Metrik, die die Übereinstimmung mit kuratierten Konsensantworten widerspiegelt (ein Anstieg um ca. 2.1 Punkte).

OpenAI merkte auch Änderungen der durchschnittlichen Antwortlänge bei Gesundheitsevaluationen an (GPT-5.4 durchschnittlich ca. 3,311 Zeichen vs. 2,676 bei GPT-5.2), was beeinflussen kann, wie ein Modell sensible Themen einordnet.

Interpretation: Die Sicherheits- und Gesundheitsmetriken zeigen insgesamt eine gesteigerte Konsens-Alignment und veränderte Antwortlängen bei 5.4, während einige enge Gesundheitswerte leicht sanken. Dieses Muster spiegelt oft ein Rebalancing von Modellzielen wider — entschlossenere, längere Antworten können Nutzen und Konsens fördern, erfordern jedoch sorgfältige Überwachung in sensiblen Domänen.

Domänenspezifische Beispiele und Aussagen

Frühe Tests lieferten konkrete, domänisierte Aussagen (OpenAI und Drittquellen):

- Legal Reasoning Benchmark (BigLaw Bench) — GPT-5.4 erreichte ~91% auf rechtlichen Begründungsteilen in frühen Tests, ein starkes Signal für Dokumentanalyse-Aufgaben; zu beachten ist, dass dies frühe, nicht peer-reviewte Zahlen sind.

- Reduktion von Halluzinationen: Antworten von GPT-5.4 sind ~33% seltener mit falschen Behauptungen und ~18% seltener mit Faktenfehlern als bestimmte frühere Baselines. Diese Prozentsätze wurden in Zweitberichten und Unternehmenskommunikation hervorgehoben; wie bei solchen Angaben hängt dies von Benchmark-Suite und Stichprobenmethodik ab.

Wie man GPT-5.4 erhält und bezahlt

ChatGPT-Tarife und Enterprise-Zugriff

Laut OpenAI und Produktberichten:

- ChatGPT Plus / Team / Pro Nutzer waren die ersten, die GPT-5.4 Thinking im Produkt erhielten. Enterprise- und Education-Administratoren können frühen Zugang über Admin-Steuerungen aktivieren. Free/Go-Nutzer sind nicht garantiert sofort dabei. Entwickler können die Endpunkte

gpt-5.4undgpt-5.4-proüber die API aufrufen.

API-Preissnapshot (veröffentlichte Entwicklerpreise)

OpenAIs Entwicklerpreise listen GPT-5.4 als Frontier-Modell mit Token-basierten Gebühren. Wie zum Zeitpunkt der Ankündigung auf der öffentlichen Preisseite veröffentlicht, sind Beispielraten für GPT-5.4 ungefähr:

| Modell | Eingabe | Zwischengespeicherte Eingabe | Ausgabe |

|---|---|---|---|

| gpt-5.4 (<272K Kontextlänge) | $2.50 | $0.25 | $15.00 |

| gpt-5.4 (>272K Kontextlänge) | $5.00 | $0.50 | $22.50 |

| gpt-5.4-pro (<272K Kontextlänge) | $30.00 | $180.00 | |

| gpt-5.4-pro (>272K Kontextlänge) | $60.00 | $270.00 |

In CometAPI(eine One-Stop-Aggregationsplattform für große Modell-APIs):

| Modell | Comet-Preis (USD / M Tokens) | Offizieller Preis (USD / M Tokens) | Rabatt |

|---|---|---|---|

| gpt-5.4 | Eingabe:$2/M; Ausgabe:$16/M | Eingabe:$2.5/M; Ausgabe:$20/M | -20% |

| gpt-5.4-pro | Eingabe:$24/MAusgabe:$192/M | Eingabe:$30/MAusgabe:$240/M | -20% |

Daher empfehle ich CometAPI nachdrücklich, da es die API-Kosten erheblich senken kann.

Überlegungen zum Kostenmanagement

Wenn Sie das Modell im großen Maßstab nutzen möchten, insbesondere bei Langdokumenten oder hohem Durchsatz, sollten Sie Folgendes berücksichtigen:

- Caching und Deduplizierung von Eingaben (um nach Möglichkeit Preise für zwischengespeicherte Eingaben zu nutzen).

- Prompt-Engineering, um Kontext zu komprimieren und redundante Tokens zu vermeiden.

- Batching-Strategien und Nachbearbeitung, die teure Ausgabeerzeugung minimieren.

- Überwachung der Nutzung der Reasoning-Modi, da tiefere Reasoning-Modi höhere Rechenkosten mit sich bringen können.

Vergleich: GPT-5.4 vs GPT-5.3

Wo GPT-5.4 gegenüber GPT-5.3 verbessert wurde

- Reasoning-Tiefe und Tool-Orchestrierung: 5.4 Thinking wurde explizit darauf getunt, 5.3 bei mehrschrittigen Reasoning- und agentischen Anwendungsfällen zu übertreffen. Das zeigt sich in Web-/Desktop-Interaktionsbenchmarks und Agenten-Erfolgsmetriken.

- Kontextkapazität: Das 1M-Token-Angebot von 5.4 ist ein klarer technischer Schritt über das hinaus, was 5.3 in der Mainstream-API bot, und ermöglicht neue Klassen von Einzelsitzungsaufgaben.

- Leistungszuwächse in Domänen: Frühe Zahlen von OpenAI und Drittquellen deuten auf Verbesserungen bei bestimmten Rechts- und Dokumentbenchmarks hin, bei denen längerer Kontext und spezialisiertes Tuning von 5.4 helfen.

Abwägungen und wo 5.3 weiterhin vorzuziehen sein könnte

- Leichte, konversationelle Nutzung: GPT-5.3 Instant bleibt für schnelle, wirtschaftliche Konversationsabläufe optimiert; Organisationen, die geringste Latenz/Kosten für kurze Chat-Interaktionen suchen, könnten dies vorziehen.

- Stabilität der Sicherheitsmetriken: Einige Gesundheits- und „harte“ Evaluationswerte zeigten in OpenAIs Snapshots leichte Rückgänge bei 5.4 gegenüber 5.2; Unternehmen in sensiblen regulierten Domänen sollten das Modell auf ihren eigenen Evaluationssuites validieren, bevor sie es umfassend ausrollen.

Anwendungsfälle und Auswirkungen auf die Branche

Die Kombination aus tiefem Reasoning, Langzeitgedächtnis im Kontext und Tool-Nutzung eröffnet mit GPT-5.4 mehrere praktische und strategische Chancen.

1. Professional Services und Consulting

Unternehmen, die lange Deliverables erstellen (z. B. Rechtsgutachten, mehrteilige Consulting-Reports, M&A-Due-Diligence-Pakete), können gesamte Dokumente und Datensätze im Kontext behalten und so kohärente querdokumentare Synthesen, automatisierte QA und Executive Summaries ohne manuelles Chunk-Stitching ermöglichen. Benchmark-Erfolge auf APEX-Agents entsprechen dieser Positionierung.

2. Software Engineering und Codebase-Reasoning

Längerer Kontext bedeutet, dass ein einzelner Modellaufruf ganze Repositories oder lange Log-Traces enthalten kann. Die Verbesserungen von GPT-5.4 in SWE-Benchmarks deuten auf bessere Leistungen bei Debugging-, Refactoring- und Code-Review-Workflows hin — besonders in Kombination mit Pro für anhaltende Lasten.

3. Autonome Agenten und Enterprise-Automatisierung

Agentische Systeme, die über Tools (Tabellen, Ticketingsysteme, Weboberflächen) arbeiten, profitieren von verbesserter Toolauswahl, reduziertem Token-Overhead für Agenten-Workflows und verbessertem Erhalt von Langzeit-Zuständen in GPT-5.4. Das macht GPT-5.4 attraktiv für Enterprise-Automatisierungspipelines und „Assistants that act“ über mehrere Systeme hinweg.

Fazit — was GPT-5.4 verändert

GPT-5.4 stellt einen pragmatischen, fähigkeitsgetriebenen Fortschritt hin zu Modellen dar, die lange, multidokumentare Begründungen bewältigen, agentische Workflows verlässlicher ausführen und sich über Pro-Verträge in professionelle Pipelines skalieren lassen. Für Organisationen mit lang angelegten, toolabhängigen Workflows ist GPT-5.4 ein sprunghafter Produktivitätsschub.

Entwickler können GPT-5.4, GPT-5.4-pro, und GPT 5.3 Chat über CometAPI jetzt aufrufen.Um zu beginnen, erkunden Sie die Fähigkeiten des Modells im Playground und lesen Sie den API-Leitfaden für detaillierte Anweisungen. Bevor Sie zugreifen, stellen Sie bitte sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bietet einen deutlich niedrigeren Preis als der offizielle Preis, um Ihnen bei der Integration zu helfen.

Bereit loszulegen?→ Melden Sie sich noch heute für GPT-5.4 an !

Wenn Sie weitere Tipps, Anleitungen und Neuigkeiten zu KI erfahren möchten, folgen Sie uns auf VK, X und Discord!

.webp&w=3840&q=75)