La experiencia de los desarrolladores con el análisis de video de ChatGPT suele chocar con un muro: los enlaces directos de YouTube fallan y las subidas de MP4 devuelven resúmenes “alucinados” que pasan por alto matices visuales. Esto no es un error: es una limitación de arquitectura. ChatGPT no transmite video; procesa secuencias de fotogramas extraídos y texto de transcripción. Así que probaste subir un archivo MP4, lo cual funcionó… más o menos. El resumen mencionó la transcripción de audio pero omitió por completo el chiste visual en la tercera escena que daba sentido a todo el video.

ChatGPT puede analizar videos — pero no “viéndolos” realmente

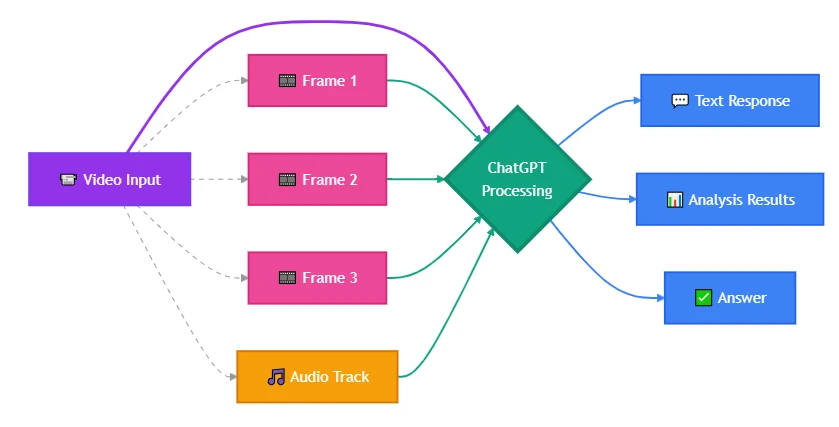

Esto es lo que realmente sucede: ChatGPT no “ve” videos como tú. No presiona reproducir, transmite el contenido y observa el movimiento a lo largo del tiempo. Lo que hace es descomponer el video en componentes que ya sabe manejar — imágenes fijas y transcripciones de texto — y luego razona sobre esas piezas de forma independiente. El modelo ve tu video como un álbum de fotos con narración, no como una experiencia continua. Por eso captó la explicación hablada pero se perdió el remate visual: probablemente el fotograma con el chiste no estaba en el conjunto muestreado.

Cuando alguien pregunta “¿puede ChatGPT ver videos?”, normalmente se refiere a una de dos cosas: ¿Puede transmitir contenido visual como lo haría un observador humano, o puede extraer y analizar significado de datos de video — escenas, diálogos, marcas de tiempo, acciones en pantalla? La respuesta funcional es sí a la segunda, con limitaciones que invalidan por completo ciertos casos de uso. Las variantes modernas de ChatGPT procesan video tratándolo como fotogramas muestreados combinados con transcripción de audio, ya sea mediante extracción automatizada en la interfaz web o aceptando fotogramas proporcionados por el usuario vía API. Esto funciona para la resumen, la descripción de escenas y la extracción de texto. Falla para el seguimiento de movimiento, el análisis dependiente del tiempo o cualquier cosa que requiera que el modelo “vea” lo que ocurre entre fotogramas.

La mayoría de las guías se quedan en confirmar que la capacidad existe sin explicar por qué tu implementación específica no funcionó — o qué método de entrada alternativo sería el adecuado.

ChatGPT Capacidades de video: lo que el modelo realmente ve

ChatGPT no carga un MP4 ni lo recorre fotograma a fotograma. Tiene capacidad de visión — la capacidad de analizar imágenes estáticas — y transcripción de audio mediante integración con Whisper. Cuando envías video a través de la interfaz web o móvil de ChatGPT, el sistema extrae fotogramas clave, transcribe el audio por separado y alimenta ambos al modelo como entradas distintas. El modelo entonces describe lo que “vio” en esos fotogramas y lo que “oyó” en la transcripción.

Desde tu perspectiva, parece comprensión de video. Desde la perspectiva del modelo, es análisis de imágenes más procesamiento de texto. Esa distinción arquitectónica determina qué casos de uso funcionan y cuáles no.

Si tu video depende del movimiento, de cambios sutiles entre fotogramas o de una temporización precisa — como detectar exactamente cuándo un objeto entra en cuadro, o seguir cómo se anima un elemento de la UI — un enfoque basado en fotogramas clave lo pasará por alto. ChatGPT no captará una señal visual de dos segundos que caiga entre los fotogramas muestreados. Tampoco seguirá objetos a lo largo del tiempo a menos que estructures explícitamente la entrada para mostrar progresión.

Capacidades actuales de video de ChatGPT (a principios de 2026):

- Análisis de video basado en imágenes: acepta archivos de video o fotogramas extraídos; interpreta contenido visual a partir de imágenes muestreadas

- Transcripción de audio: convierte palabras habladas a texto mediante Whisper; el modelo luego puede resumir o consultar la transcripción

- Descripción de escenas: identifica objetos, acciones, entornos y texto visible en los fotogramas proporcionados

- Consultas basadas en marcas de tiempo: puede referirse a momentos específicos si proporcionas marcas de tiempo de fotogramas o segmentas manualmente el video

- Extracción de texto: lee subtítulos en pantalla, etiquetas de UI o documentos visibles en los fotogramas

Tasa específica de muestreo de fotogramas y comportamiento de selección automática de fotogramas clave en la interfaz web de ChatGPT — no documentados públicamente hasta el corte de conocimiento

Lo que no incluye:

- Entrada de video en streaming en tiempo real a través de la API

- Seguimiento de movimiento perfecto por fotograma o persistencia de objetos a lo largo del tiempo

- Compatibilidad nativa con códecs de video — todo el procesamiento ocurre sobre fotogramas extraídos y audio

- Detección automática de cambios de escena sin indicaciones explícitas del usuario

La capacidad está limitada por los tokens y el tamaño de archivo, no por la duración. Aunque 5–10 minutos es una heurística práctica, los límites reales escalan dinámicamente con la densidad visual.

Si tu caso de uso requiere esas capacidades, o bien preprocesas el video tú mismo para extraer los fotogramas correctos, o cambias a un modelo con soporte nativo de video. La siguiente sección desglosa qué método de entrada usar para tu escenario específico.

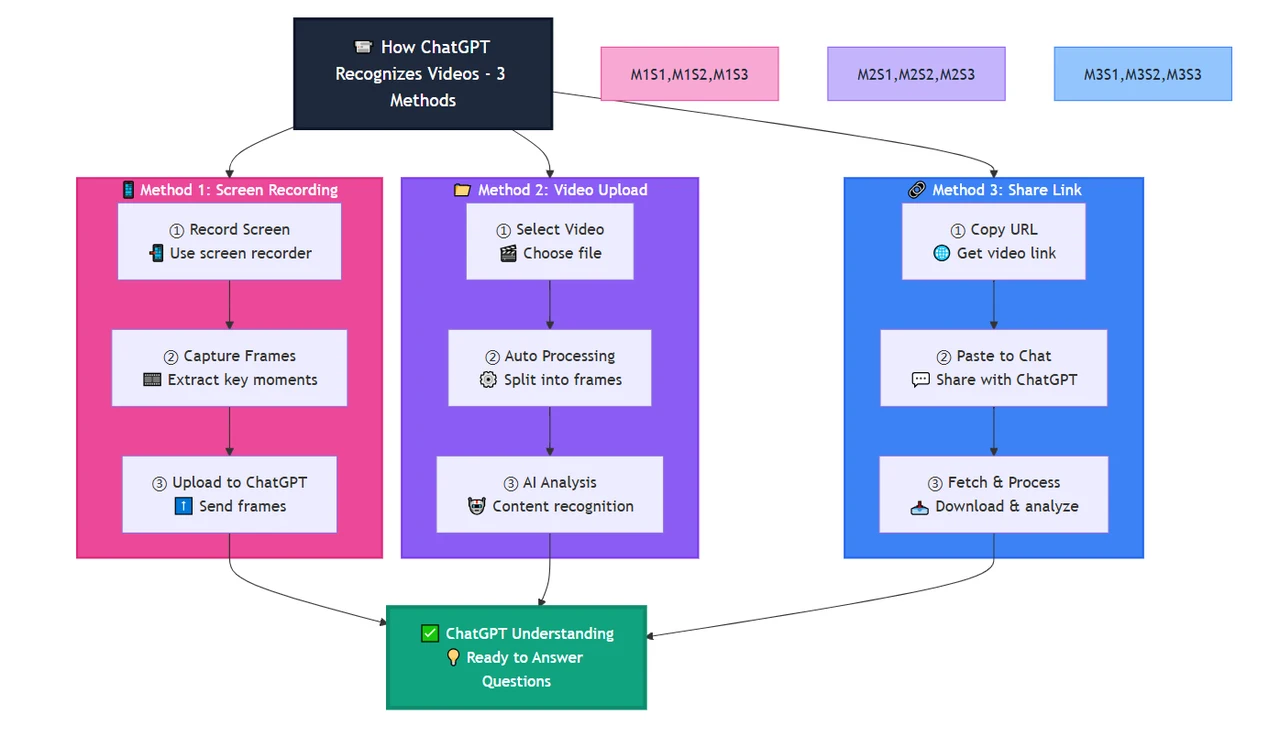

Cómo ChatGPT reconoce videos: tres métodos prácticos

No hay una sola forma de enviar video a ChatGPT. El método que elijas controla qué puede analizar el modelo y qué se perderá. La mayoría de los fallos de implementación provienen de elegir el método conveniente en lugar del correcto.

Método 1: Extracción manual de fotogramas + carga de imágenes

Extrae fotogramas tú mismo usando ffmpeg u otras herramientas y luego sube esos fotogramas específicos como imágenes. Esto te da control total sobre lo que ChatGPT analiza.

Flujo de trabajo de ejemplo (bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Este enfoque te permite:

- Enfocar el análisis en momentos específicos (introducción, acción clave, conclusión) sin desperdiciar contexto en secciones irrelevantes

- Capturar movimiento subiendo fotogramas consecutivos a la frecuencia de muestreo que elijas

- Sortear límites de tamaño de archivo — las imágenes son más pequeñas que los archivos de video completos

- Conservar la calidad del fotograma que podría degradarse durante la compresión automática

La contrapartida:

Tú te encargas del preprocesamiento. Para analizar cientos de videos a escala, esto requiere automatización. Para análisis puntuales profundos o para depurar escenas específicas, es el método más fiable.

Cuándo usar este método:

- Necesitas análisis con precisión de fotograma en momentos específicos

- La información visual crítica es breve o ocurre entre intervalos típicos de fotogramas clave

- Estás comparando cambios visuales a lo largo de una secuencia (cambios de estado en la UI, fotogramas de animación)

- Quieres verificar lo que el modelo realmente “vio” inspeccionando los fotogramas exactos que subiste

Método 2: Carga directa de archivos mediante la interfaz de ChatGPT

Las aplicaciones web y móviles de ChatGPT aceptan cargas de video directamente en el chat. Arrastra un archivo MP4 o MOV al campo de entrada y el sistema gestiona automáticamente la extracción de fotogramas y la transcripción.

Qué ocurre internamente:

- El servicio muestrea fotogramas a intervalos (frecuencia específica no documentada; estimada en 1–2 fotogramas por segundo según comportamientos observados)

- El audio se transcribe mediante Whisper o un servicio similar

- Ambos resultados se pasan al modelo como entradas de contexto separadas

- El modelo genera respuestas basadas en los fotogramas visibles y la transcripción

Este método funciona para:

- Resúmenes de alto nivel donde no necesitas detalle con precisión de fotograma

- Identificar objetos clave, personas o entornos que persisten a lo largo de escenas

- Extraer contenido hablado o texto en pantalla que aparece en múltiples fotogramas

- Análisis exploratorio rápido sin preprocesamiento

Este método falla para:

- Análisis con precisión de fotograma — no controlas qué fotogramas se muestrean

- Para contenido de video extenso que excede la capacidad de contexto cómoda del modelo, se requiere segmentación lógica. Sin particionado estratégico o preprocesamiento, los modelos pueden degradarse o truncarse a medida que el consumo de tokens se acelera con datos visuales de alta densidad

- Detectar movimiento, transiciones o contenido dependiente del tiempo que requiera comparar fotogramas consecutivos

- Escenarios donde la información visual crítica aparece brevemente entre los fotogramas muestreados

Si necesitas control sobre qué momentos se analizan, usa el Método 1.

Método 3: Enlace de YouTube + recuperación de transcripción

Algunos complementos de ChatGPT y herramientas de terceros afirman “analizar videos de YouTube”. Lo que realmente hacen es obtener los metadatos públicos y la transcripción del video (si está disponible) y luego pasar ese texto a ChatGPT.

Esto funciona cuando:

- El video tiene subtítulos generados automáticamente o subidos por el usuario

- Tu análisis solo requiere contenido hablado, no información visual

- El video es públicamente accesible (no privado, no oculto, ni restringido por región)

- Estás resumiendo clases, podcasts o entrevistas donde el audio porta la mayor parte del significado

Esto no funciona cuando:

- Necesitas analizar contenido visual (demostraciones en pantalla, diagramas, expresiones faciales)

- El video carece de transcripción o subtítulos

- La información crítica aparece visualmente sin mencionarse en el diálogo

- Trabajas con archivos de video privados o contenido detrás de autenticación

Error común: Los desarrolladores esperan comprensión completa del video (visual + audio) pero reciben solo un resumen de la transcripción. Esto está bien para análisis de contenido hablado. Es inútil para revisar demostraciones de producto, analizar diseño visual o cualquier escenario donde lo que ves importa más que lo que se dice.

El patrón: Método 2 para resúmenes rápidos donde la precisión no importa. Método 1 para análisis controlado donde necesitas fotogramas específicos. Método 3 para contenido centrado en audio donde la información visual es secundaria o inexistente. Elige según dónde vive la señal crítica de tu caso de uso — en el movimiento, en fotogramas específicos o puramente en el diálogo.

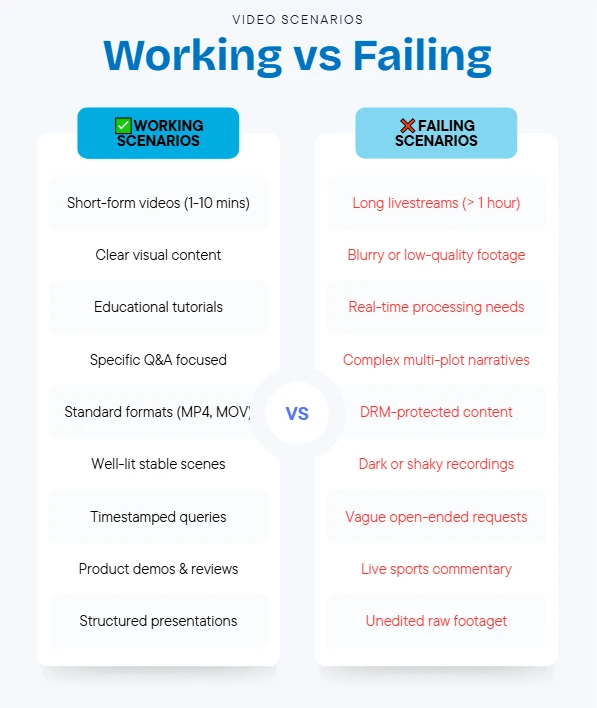

Escenarios de aplicación de video con ChatGPT: lo que realmente funciona en producción

Saber que ChatGPT puede procesar componentes de video no te dice si es la herramienta adecuada para tu problema. Estos escenarios muestran dónde el análisis basado en fotogramas tiene éxito — y dónde las limitaciones arquitectónicas rompen el caso de uso.

Escenario 1: Resumen de contenido educativo

Caso de uso: Tienes un video tutorial de 10 minutos y necesitas un resumen estructurado de los pasos clave, las herramientas mencionadas y los ejemplos visuales mostrados.

Por qué funciona: Los videos educativos suelen tener límites de escena claros, texto en pantalla persistente y narración alineada con lo visual. La persona describe lo que muestra mientras está visible. ChatGPT puede transcribir la explicación, identificar herramientas o diagramas en los fotogramas muestreados y combinar ambos en una salida estructurada.

Enfoque de implementación: Sube el video mediante la interfaz de ChatGPT o extrae 8–12 fotogramas clave en las transiciones de tema principales. Indicación: “Enumera los pasos principales explicados en este video, haciendo referencia tanto a la narración como a cualquier texto en pantalla, diagramas o nombres de herramientas que veas.”

Dónde falla: Videos que dependen de movimiento continuo — como un screencast de código donde el instructor escribe rápidamente en varios archivos — tendrán pasos faltantes entre fotogramas. Necesitarás tasas de muestreo más altas o centrarte solo en el audio.

Consejo práctico: Para contenido de clase o tutorial, combina la carga automática (para la transcripción) con fotogramas extraídos manualmente de los 3–5 momentos visuales más importantes. Obtendrás cobertura completa del audio e imágenes de alta calidad de los conceptos clave.

Escenario 2: Análisis de demo de producto

Caso de uso: Estás revisando la demostración de un producto de la competencia y quieres extraer elementos de la UI, nombres de funciones, flujos de usuario y detalles de precios mostrados en pantalla.

Por qué funciona: Las demos de producto suelen mantener cada pantalla el tiempo suficiente para que el muestreo capture la UI estática. Superposiciones de texto, etiquetas de botones, estructuras de menús y tablas de precios permanecen visibles en múltiples fotogramas. La visión de ChatGPT puede leer y describir estos elementos aunque no se mencionen en la narración.

Enfoque de implementación: Extrae fotogramas en los cambios de escena principales (diapositiva de introducción, demo de la función 1, demo de la función 2, pantalla de precios, CTA). Sube esos fotogramas e indica: “Para cada fotograma, identifica todos los elementos visibles de la UI, etiquetas de botones, nombres de funciones y cualquier información de producto o precio mostrada.”

Dónde falla: Demos con transiciones rápidas de pantalla, estados hover que revelan información brevemente o elementos interactivos mostrados solo 1–2 segundos no serán capturados por el muestreo. Si la competencia muestra rápidamente una tabla de comparación de funciones, te la perderás a menos que ese momento exacto haya sido muestreado.

Consejo práctico: Recorre el video manualmente primero para identificar marcas de tiempo de revelaciones importantes. Extrae fotogramas en esos momentos específicos en lugar de depender de intervalos de muestreo automáticos.

Escenario 3: Transcripción de reunión o entrevista con contexto visual

Caso de uso: Grabaste una llamada con un cliente y necesitas tanto la transcripción como anotaciones indicando cuándo aparecieron documentos, diapositivas o pantallas compartidas específicas.

Por qué funciona: La transcripción de audio maneja el diálogo hablado. Cuando los participantes comparten pantalla o sostienen documentos, esos aparecen en los fotogramas muestreados. ChatGPT puede anotar “aproximadamente en [marca de tiempo], se mostró un documento de contrato en pantalla” junto con la transcripción — útil para actas que referencian materiales visuales.

Enfoque de implementación: Sube el video e indica: “Transcribe esta reunión y señala los momentos en que aparecieron documentos, diapositivas de presentación, pantallas compartidas u otras referencias visuales. Para cada elemento visual, describe lo que se mostró.”

Dónde falla: Comparticiones de pantalla breves (menos de 5–10 segundos) pueden caer entre fotogramas muestreados. Texto demasiado pequeño en fotogramas comprimidos no será legible. Para casos legales o de cumplimiento que requieran exactitud literal de documentos mostrados, verifica la calidad del fotograma y la cobertura de muestreo antes de confiar en el resultado.

Consejo práctico: Para reuniones importantes, graba a mayor resolución y extrae fotogramas manualmente en los momentos en que alguien diga “déjame mostrarte este documento” — indicando que está por aparecer una referencia visual.

Escenario 4: Moderación de contenido o revisión de cumplimiento

Caso de uso: Necesitas escanear videos subidos por usuarios en busca de contenido prohibido — logos específicos, patrones de texto o elementos visuales que violen políticas de la plataforma.

Por qué funciona: ChatGPT puede revisar fotogramas en busca de texto visible, objetos reconocibles o escenas descritas. Si estás comprobando “¿alguno de estos videos muestra el logo de un competidor?”, el análisis por fotogramas detecta logos que persisten en pantalla más de uno o dos segundos.

Enfoque de implementación: Extrae fotogramas a intervalos regulares (cada 3–5 segundos), súbelos e indica: “Revisa estos fotogramas e identifica cualquiera que contenga [logo específico, nombre de marca, símbolo prohibido, etc.]. Para cada coincidencia, describe dónde aparece en el fotograma.”

Dónde falla: Infracciones basadas en audio (música con copyright, discurso prohibido) requieren análisis de audio separado. Infracciones basadas en movimiento (gestos prohibidos, acciones que abarcan múltiples fotogramas) no se detectarán con imágenes fijas. Contenido prohibido mostrado brevemente puede no aparecer en los fotogramas muestreados.

Consejo práctico: Combina el escaneo visual de ChatGPT con servicios dedicados de huella de audio y tasas de muestreo de fotogramas más altas para categorías de alto riesgo. Usa ChatGPT como filtro de primera pasada, no como única capa de moderación.

El patrón en los escenarios exitosos: el contenido significativo existe en fotogramas discretos y estables y se correlaciona con audio o elementos de texto. Los fallos ocurren cuando la información crítica vive en el movimiento, la temporización, las transiciones o aparece demasiado brevemente para muestrearse de forma fiable.

Capacidades de video de Gemini vs. Claude vs. ChatGPT

Si la arquitectura de muestreo por fotogramas de ChatGPT no encaja con tu caso de uso, evaluarás alternativas. Gemini y Claude ofrecen capacidades relacionadas con video diferentes — y esas diferencias determinan qué modelo funciona para tu implementación específica.

Procesamiento nativo de video en Gemini

Los modelos Gemini admiten entrada de video nativa a nivel de API. Pasas un archivo de video directamente sin preprocesarlo en fotogramas. El modelo procesa el video como un flujo continuo, habilitando seguimiento de movimiento, detección de cambios de escena y razonamiento temporal que el enfoque basado en fotogramas de ChatGPT no puede manejar.

Caso de uso donde gana Gemini:

Necesitas detectar cuándo un objeto específico entra y sale del cuadro a lo largo de un clip de 30 segundos, o seguir cómo se mueve una persona por la escena. Gemini puede seguir objetos a través de fotogramas y razonar sobre el movimiento. ChatGPT solo vería el objeto en los fotogramas que se muestrearon — pudiendo perder la entrada o la salida por completo.

Contrapartidas:

- La API nativa de Gemini es más rentable que el muestreo por fotogramas de OpenAI. Al evitar una sobrecarga lineal de tokens mediante almacenamiento en caché del contexto, Gemini escala mejor para análisis de larga duración.

- Procesar videos más largos implica mayor latencia — el modelo debe ingerir el archivo completo antes de responder

- No todas las variantes de Gemini admiten entrada de video; requiere modelos posteriores de Gemini

- Existen límites de duración de video, pero son más generosos que las restricciones basadas en contexto de ChatGPT

Cuándo elegir Gemini sobre ChatGPT:

- Tu caso de uso requiere seguimiento de movimiento, detección de límites de escena o comprensión de relaciones temporales

- La información crítica aparece y desaparece rápidamente entre fotogramas

- Analizas videos donde la progresión de eventos importa (deportes, revisión de vigilancia, análisis de animación)

- Quieres evitar el preprocesamiento manual de extracción de fotogramas

Limitaciones actuales de video en Claude

A principios de 2026, los modelos Claude no admiten entrada directa de video vía API. Puedes subir imágenes (incluyendo fotogramas de video extraídos manualmente), pero no hay una capacidad de procesamiento de video nativa comparable a la de Gemini.

Lo que Claude sí puede hacer:

- Analizar secuencias de fotogramas subidos, similar al método de extracción manual de ChatGPT (Método 2)

- Proporcionar descripciones detalladas del contenido visual en cada fotograma

- Razonar sobre movimiento implícito o cambios entre fotogramas si se le indica explícitamente

- Manejar secuencias más largas de imágenes gracias a una ventana de contexto extendida (hasta 1M de tokens en Claude Opus 4.7)

Lo que Claude no puede hacer:

- Aceptar archivos de video directamente por ninguna interfaz

- Seguir automáticamente el movimiento u objetos a través del tiempo sin un guiado explícito fotograma a fotograma

- Transcribir audio — requiere preprocesamiento separado con Whisper u otro servicio, y luego pasar la transcripción a Claude

Cuándo aún elegirías Claude:

- Tu flujo de trabajo ya incluye la extracción de fotogramas como paso de preprocesamiento

- Estás analizando videos largos que requieren muchos fotogramas y necesitas la ventana de contexto más grande de Claude

- Estás comparando la calidad del análisis visual y encuentras que las descripciones por fotograma de Claude son más precisas o detalladas para tu dominio (por ejemplo, imágenes médicas, diagramas técnicos)

- Necesitas combinar el análisis de fotogramas con grandes cantidades de otra información contextual

Tabla comparativa de capacidades

| Característica | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Carga directa de archivo de video | ✓ (interfaz web/app) | ✓ (API + interfaz web) | ✗ |

| Seguimiento nativo de movimiento | ✗ | ✓ | ✗ |

| Transcripción de audio | ✓ (integración con Whisper) | ✓ (integrada) | ✗ (requiere herramienta externa) |

| Análisis basado en fotogramas | ✓ | ✓ (también procesamiento continuo) | ✓ (solo extracción manual) |

| Detección de cambios de escena | ✗ (solo manual) | ✓ (automática) | ✗ |

| Manejo típico de duración de video | ~5–10 min (limitado por contexto) | ~1 hora (dependiente de resolución) | N/D (número de fotogramas limitado por contexto) |

| Mejor caso de uso | Resúmenes rápidos, análisis a nivel de fotograma con cierto control | Seguimiento de movimiento, razonamiento temporal, video continuo | Descripción detallada fotograma a fotograma con necesidades de gran contexto |

| Soporte de video en API | ✗ (solo imágenes) | ✓ | ✗ |

Marco de decisión:

- Elige ChatGPT cuando: Necesitas resúmenes rápidos de video, la información crítica persiste a lo largo de varios fotogramas, trabajas con clips cortos (menos de 10 minutos) y no necesitas seguimiento de movimiento. Ideal para contenido educativo, demos estáticas de producto, transcripción de reuniones.

- Elige Gemini cuando: Tu caso de uso requiere seguimiento de movimiento, detección de cambios de escena o razonamiento temporal sobre cómo los elementos se mueven o cambian con el tiempo. Fundamental para metraje de vigilancia, análisis deportivo, revisión de animación o cualquier escenario donde “lo que ocurre entre fotogramas” importe.

- Elige Claude cuando: Ya estás extrayendo fotogramas como parte de tu pipeline, necesitas analizar muchos fotogramas con contexto adicional extenso o encuentras que las descripciones visuales de Claude son más precisas para tu dominio específico. Requiere más preprocesamiento, pero ofrece la mayor ventana de contexto.

Para desarrolladores que trabajan con varios modelos, CometAPI proporciona una interfaz unificada para probar la calidad de procesamiento de video entre GPT, Gemini y Claude sin reescribir el código de integración — útil cuando comparas la calidad de salida antes de comprometerte con un proveedor específico.

La respuesta real a “¿puede ChatGPT ver videos?” no es binaria. Es “sí, convirtiendo el video en formatos que ya maneja — con limitaciones que rompen casos de uso específicos”. La mayoría de los fallos de implementación provienen de desajustes arquitectónicos, no de carencias de capacidad. El modelo funciona exactamente como fue diseñado; los desarrolladores simplemente esperaban un diseño distinto.

Si estás construyendo funciones de análisis de video a escala, prueba tu flujo de trabajo con casos límite primero: sube el mismo video mediante archivo directo, fotogramas extraídos manualmente y solo transcripción. Compara resultados. El método que capture la señal crítica de tu caso de uso — no el más rápido de implementar — será el que sobreviva al tráfico de producción.

Antes de comprometerte con ChatGPT para video:

- Identifica si tu información crítica vive en fotogramas estables, en el movimiento o en el audio

- Prueba la cobertura de muestreo de fotogramas extrayéndolos manualmente a tus intervalos esperados

- Verifica que el texto en pantalla sea legible a la resolución de tu video después de la compresión

- Confirma que la duración de tu video se ajusta a los límites prácticos de contexto para tu nivel de suscripción

- Ten un plan alternativo para contenido que aparezca brevemente o entre fotogramas muestreados

Para desarrolladores que evalúan múltiples proveedores de IA para cargas de trabajo de video, CometAPI ofrece un laboratorio unificado para probar ChatGPT, Gemini y Claude con las mismas entradas de video — permitiéndote comparar calidad de salida, latencia y costo antes de construir integraciones específicas de proveedor.

Preguntas frecuentes - Guía de análisis de video con IA

Respuestas rápidas a preguntas comunes sobre análisis de video con IA.

¿Puede ChatGPT analizar videos?

Sí, ChatGPT (GPT-4o y posteriores) puede analizar videos muestreando fotogramas (~1 por segundo) y transcribiendo audio. Funciona bien para resúmenes de reuniones, extracción de texto de diapositivas e identificación de objetos. Sin embargo, tiene dificultades con el seguimiento de movimiento, videos de más de 10 minutos y streaming en tiempo real.

¿Cómo subo videos a ChatGPT?

Carga directa mediante URL (recomendado): Sube a través de una URL pública para un análisis rápido. Ideal para videos de menos de 10 minutos.

Extracción manual de fotogramas: Extrae fotogramas específicos para un control preciso. Ideal cuando necesitas analizar momentos concretos o reducir costos de tokens.

¿Cuál es la longitud máxima de video que ChatGPT puede manejar?

ChatGPT maneja de forma fiable videos de hasta 5–10 minutos. Más allá de eso, tendrás que segmentar el video o cambiar a Gemini 2.5 Pro, que admite videos de hasta 60 minutos de forma nativa.

¿Cuáles son las limitaciones del análisis de video de ChatGPT?

- No puede seguir movimiento continuo (deportes, danza)

- Marcas de tiempo imprecisas (±1 segundo de exactitud)

- Omite contenido que aparece menos de 1 segundo

- Límite práctico de 10 minutos

- Sin soporte de streaming en tiempo real

- Dificultades con videos de baja calidad u oscuros

- Débil en razonamiento temporal de causa y efecto *

¿Debo usar ChatGPT o Gemini para análisis de video?

Usa ChatGPT para:

- Videos de menos de 10 minutos

- Razonamiento de texto superior después del análisis de video

- Análisis a nivel de fotograma (diapositivas, capturas de pantalla)

Usa Gemini para:

- Videos de 10–60 minutos

- Seguimiento de movimiento y análisis de desplazamiento

- Tareas de razonamiento temporal

- Metraje de deportes, danza o vigilancia *

¿Puede Claude analizar videos?

No, Claude no admite entrada directa de video. Sin embargo, puedes extraer fotogramas de videos y analizarlos con Claude, que ofrece mejor razonamiento de texto y una ventana de contexto amplia para análisis largos.

¿Cuánto cuesta el análisis de video?

Los costos varían según el modelo y la duración del video:

- ChatGPT 4o: ~$0.05 por minuto

- Gemini 2.5 Pro: ~$0.04 por minuto

CometAPI ofrece crédito para que nuevos usuarios comiencen.